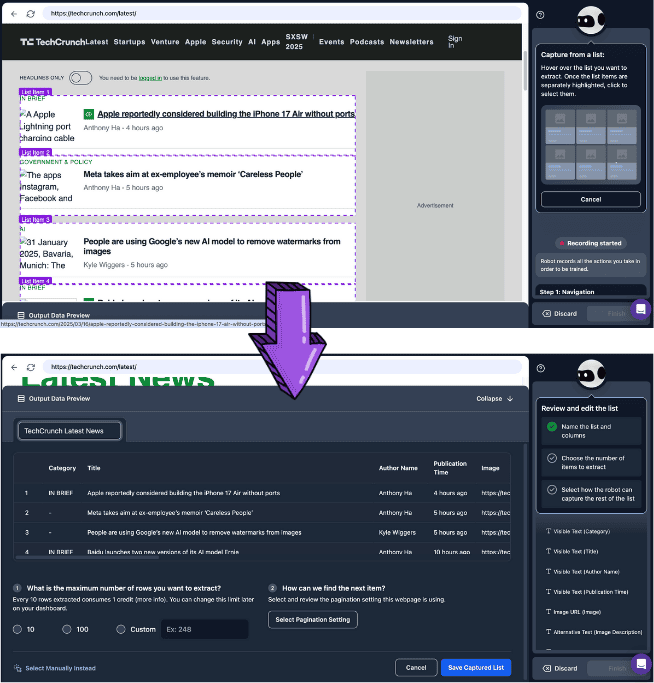

トレンド記事を追いかけるために、200以上のニュースソースを監視する必要がありました。手作業ですか? それでは専任業務になってしまいます。従来型のスクレイパーですか? サイトのレイアウトが少し変わるたびに壊れていました。

そこでAI記事スクレイパーを試してみたところ、ワンクリックでクリーンなデータが取れ、CSSセレクタも不要。まさに別世界でした。

ジャーナリスト、SEO担当者、研究者として、記事を大規模に取得する必要があるなら、この比較記事が試行錯誤の手間を大きく減らしてくれます。従来のノーコードスクレイパーとAI搭載型の両方を検証したうえで、実際に何が使えるのかを紹介します。

要点だけ先に

| メリット | デメリット | 最適な用途 | |

|---|---|---|---|

| AI記事スクレイパー | - 複数サイトを高精度でスクレイピングできる - ノイズを自動で除去 - ウェブ構造の変化に適応できる - 動的コンテンツの読み込みに対応 - データクレンジングコストが低い | - 計算コストが高い - 処理時間が長い - 一部ページでは手動介入が必要 - スクレイピング対策に引っかかる場合がある | - ニュースポータルやSNSなど、複雑または動的なサイトの取得 - 大規模なデータ収集 |

| 従来型ノーコード記事スクレイパー | - 実行が速い - コストが低い - サーバーやローカルのリソース消費が少ない - コントロールしやすい | - ウェブ構造の変化により頻繁なメンテナンスが必要 - 複数サイトを同時に取得できない - 動的コンテンツに対応できない - データクレンジングコストが高い | - 単純な静的ページを短時間で大規模にスクレイピングしたい場合 - 計算資源や予算が限られている場合 |

記事スクレイパーとは? なぜAI記事スクレイパーが重要なのか?

は、ニュースサイトから見出し、著者名、公開日、本文、キーワード、画像、動画などの情報を見つけて取得し、JSON、CSV、Excelのような構造化された形式に整理できるの一種です。

は、ページの構造に基づいてコンテンツを抽出するためにを使います。ただし、この方法には弱点があります。

- 汎用性が低い: ウェブ構造が異なればサイトごとに個別のが必要で、構造が変わると使えなくなり、頻繁な更新が求められます。

- 動的コンテンツに対応できない: 多くのサイトはAJAXやJavaScriptでコンテンツを読み込みますが、では直接スクレイピングできません。

- データ処理が限定的: で取得できるのはの断片だけで、その後のデータクレンジング、整形、意味解析、感情分析までは対応できません。

の出番です。

の出番です。

-

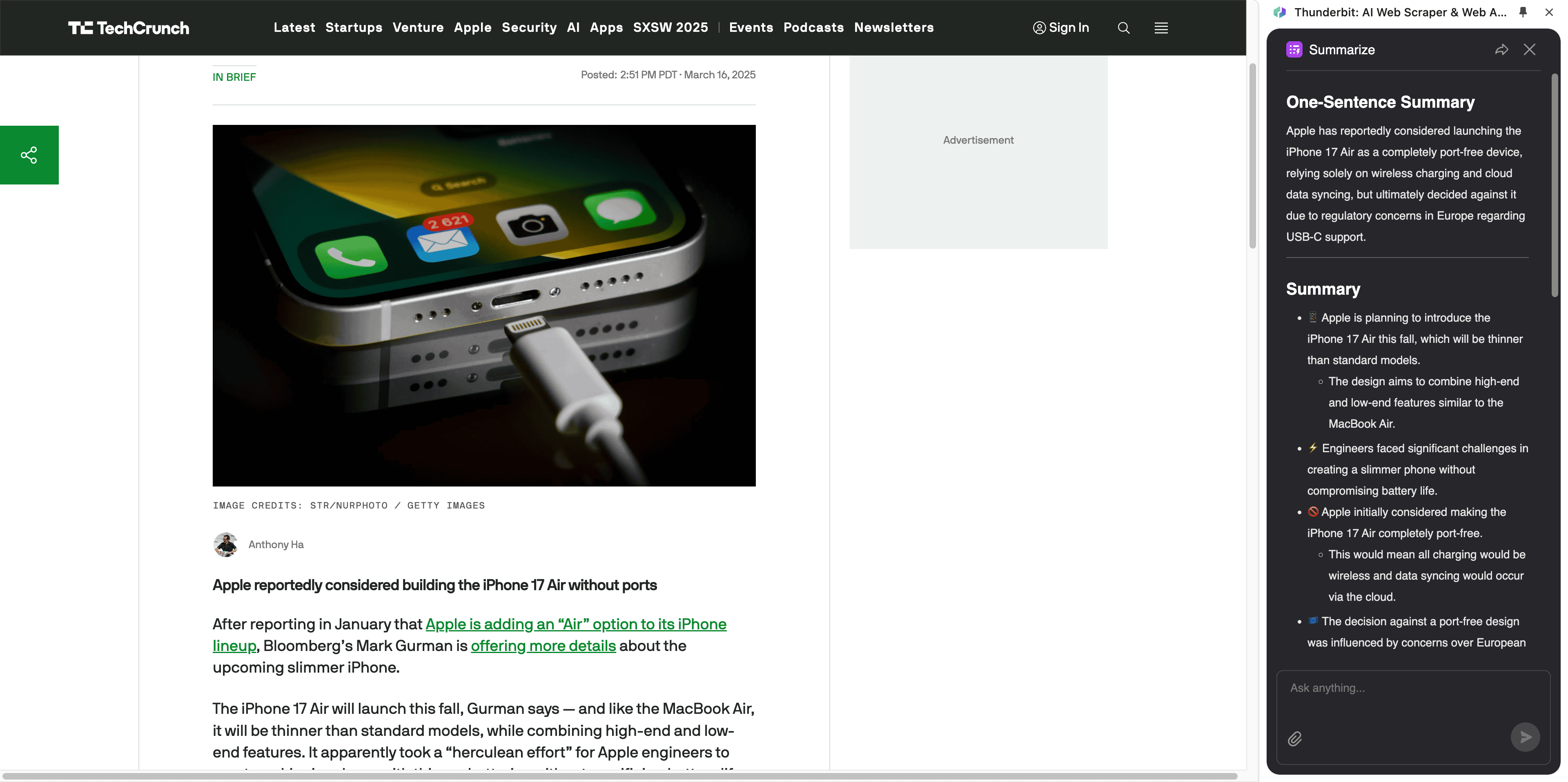

この技術はLLMでウェブページを理解し、次のような機能を提供します。

- インテリジェントな認識: 見出し、著者名、要約、本文を識別します。

- ノイズの自動除去: 本文とナビゲーション、広告、関連記事を見分けて分離し、データ品質とスクレイピング効率を高めます。

- ウェブ変化への適応: ウェブ構造やスタイルが変わっても、意味理解と視覚的特徴をもとにスクレイピングを継続できます。

- サイト横断の汎用性: と違い、AIスクレイパーは手動調整なしで異なるサイトに適用できます。

- NLPと深層学習との統合: 翻訳、要約、感情分析などの作業までこなせます。

2026年に最適な記事スクレイパーとは?

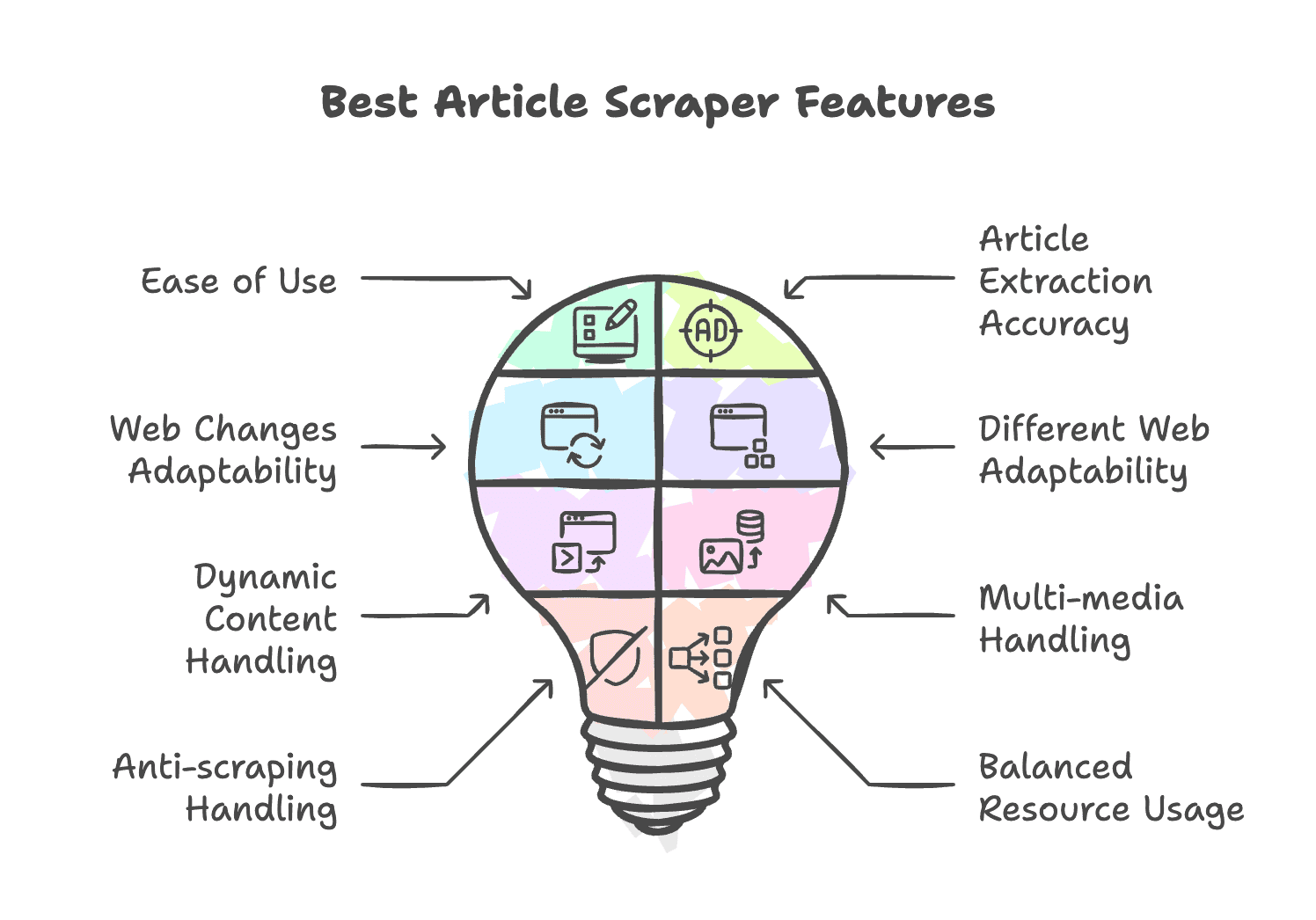

優れた記事スクレイパーは、性能、コスト、使いやすさ、柔軟性、拡張性のバランスが取れています。2026年に最適な記事スクレイパーを選ぶ基準は次のとおりです。

- 使いやすさ: 直感的な操作画面で、コーディング不要。

- 記事抽出の精度: 広告やナビゲーションを除いた関連情報を正確に識別。

- ウェブ変化への適応力: 頻繁な保守をしなくても、構造や見た目の変化に自動対応。

- さまざまなウェブへの対応力: 多様なウェブ構造で動作。

- 動的コンテンツ対応: JavaScriptやAJAXによる動的読み込みをサポート。

- マルチメディア対応: 画像、動画、音声を認識。

- スクレイピング対策への対応: IPローテーション、CAPTCHA対策、プロキシを使って回避。

- リソース使用のバランス: メモリや計算資源を過剰に消費しない。

ベストな記事・ニューススクレイパー一覧

| ツール | 主な機能 | 最適な用途 | 料金 |

|---|---|---|---|

| Thunderbit | AI搭載スクレイパー; 事前構築テンプレート; PDF、画像、ドキュメントのスクレイピング対応; 高度なデータ処理機能 | 技術知識がないまま複数のニッチサイトをスクレイピングしたいユーザー | 7日間無料トライアル、月額9ドルから(年額プラン) |

| WebScraper.io | ブラウザ拡張機能; 動的コンテンツ対応; プロキシ統合なし | 複雑なページや高度な機能を必要としないユーザー | 7日間無料トライアル、月額40ドルから(年額プラン) |

| Browse.ai | ノーコードのウェブスクレイパー兼モニター; 事前構築ロボット; 仮想ブラウザ; 各種ページネーション方式; 強力な連携機能 | 大規模で複雑なサイトをスクレイピングしたい企業 | 月額19ドル(年額プラン) |

| Octoparse | CSSセレクタベースのノーコードスクレイパー; 自動検出とスクレイピングワークフロー生成; 事前構築の記事スクレイパーテンプレート; 仮想ブラウザ; スクレイピング対策回避機能 | 複雑なサイトをスクレイピングしたい企業 | 月額99ドルから(年額プラン) |

| Bardeen | 包括的なウェブ自動化機能; 事前構築テンプレート; ノーコードスクレイパー; ワークスペースとのシームレスな連携 | 記事スクレイピングを既存ワークフローに組み込みたいGTMチーム | 7日間無料トライアル、月額99ドルから(年額プラン) |

| PandaExtract | 使いやすいUI; 自動検出とラベリング | 複雑な設定なしで、すばやくワンクリック抽出したいユーザー | 49ドルの買い切り |

ビジネスユーザー向けの最も強力なAI記事スクレイパー

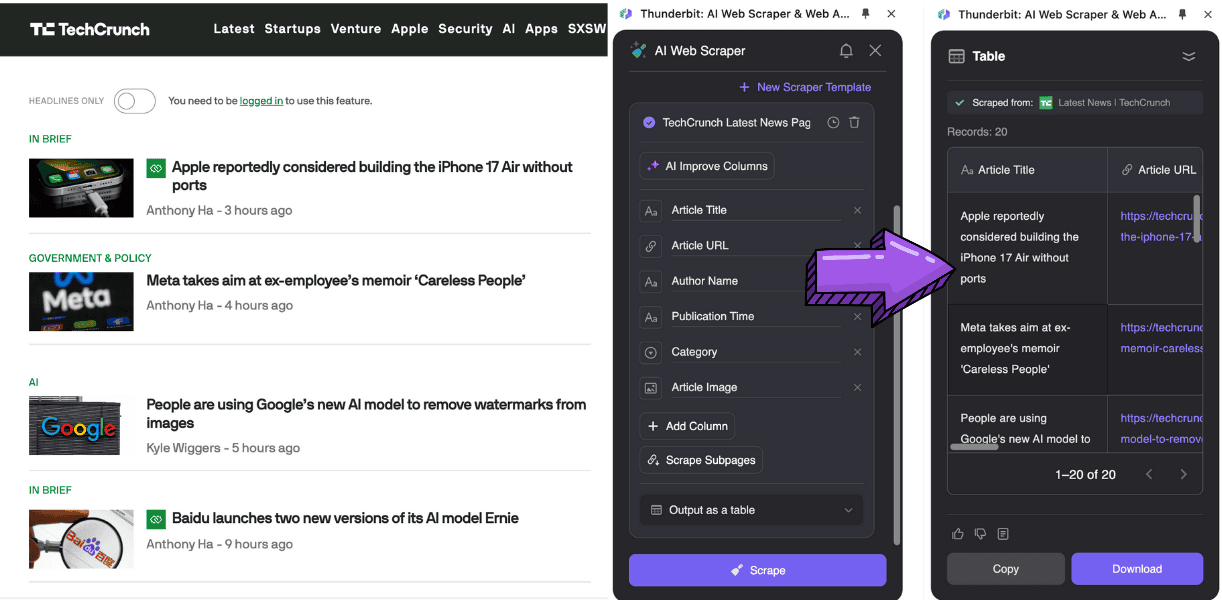

- メリット:

- 自然言語でAIを呼び出し、CSSセレクタなしでウェブ情報の認識と分析ができる

- 形式変換、、分類、翻訳、タグ付けなどのAI支援データ分析に対応

- で、記事一覧と本文をワンクリックでスクレイピングできる

- デメリット:

- 現在はとしてのみ利用可能

- 大規模データのスクレイピングには向かない

- 複数ページのスクレイピングでは速度がやや遅いが、バックグラウンドで実行して結果を早めることは可能

企業向けのAI搭載記事スクレイパー

Browse.ai

- メリット:

- ノーコードの記事スクレイパー兼モニター

- スクレイピング対策を引き起こしにくい仮想ブラウザ操作に対応

- 、、などをワンクリックで取得できる、豊富な事前構築ロボット

- やなどのプラットフォームと深く連携し、ツールをつなげられる

- デメリット:

- ディープ抽出には2つのロボットを作成する必要があり、手順が複雑

- CSSセレクタの精度がニッチサイトでは不十分

- 料金が高く、継続的な大規模データスクレイピング向き

小規模データ抽出向けのノーコードスクレイパー

PandaExtract

- メリット:

- 使いやすいインターフェースで、記事一覧と詳細を自動識別

- 一覧、詳細、メール、画像を抽出でき、小規模な構造化データのスクレイピングに適している

- 買い切りで半永久的に利用可能

- デメリット:

- ブラウザ拡張機能としてのみ利用でき、クラウド実行は不可

- 無料版はコピーのみ対応で、CSVやJSONなどへのエクスポートはできない

組織向けのオールインワン記事スクレイパー

Octoparse

- メリット:

- ウェブ構造の認識とスクレイピングワークフロー生成を自動で行うノーコード記事スクレイパー

- 豊富な事前構築の記事スクレイパーテンプレートですぐ使える

- 仮想ブラウザ、IPローテーション、CAPTCHA対策、プロキシを使ってスクレイピング対策を回避

- デメリット:

- 自動検出は依然としてCSSセレクタのロジックに依存しており、精度は平均的

- 高度な機能には学習と技術スキルが必要

- 大規模データスクレイピングではコストが高い

GTMチーム向けの最も包括的な自動化

Bardeen

- メリット:

- LLMを使ったワンクリック自動化ができるノーコードの記事スクレイパー

- 、、を含む100以上のアプリと連携

- データ取得後のAI分析に使える強力なウェブ自動化ツール

- 既存ワークフローへのデータスクレイピング組み込みに最適

- デメリット:

- 事前構築プレイブックへの依存が強く、カスタムワークフローは試行錯誤が必要

- ノーコードでも、複雑な自動化の理解と設定には非技術者の学習時間が必要になる場合がある

- サブページ抽出の設定が複雑

- 非常に高価

即時データ抽出向けの軽量記事スクレイパー

Webscraper.io

- メリット:

- ポイント&クリック型のノーコードスクレイパー

- 動的コンテンツの読み込みに対応

- クラウドベースで動作

- 、、と連携

- デメリット:

- 事前構築テンプレートがなく、カスタムサイトマップの作成が必要

- CSSセレクタに不慣れなユーザーには学習コストがある

- ページネーションやサブページ抽出の設定が複雑

- クラウド版は高価

エンジニア向けのさらに高度な選択肢

技術的な背景がある方には、という選択肢があります。これらのソリューションには次のような利点があります。

- 柔軟性: カスタムスクレイピングのために直接APIを呼び出せ、動的レンダリングやIPローテーションにも対応

- 拡張性: 企業向けの高頻度・大規模データ需要に合わせて、独自のデータパイプラインへ組み込み可能

- 保守コストの低さ: プロキシプールやスクレイピング対策を管理する必要がなく、運用時間を節約できる

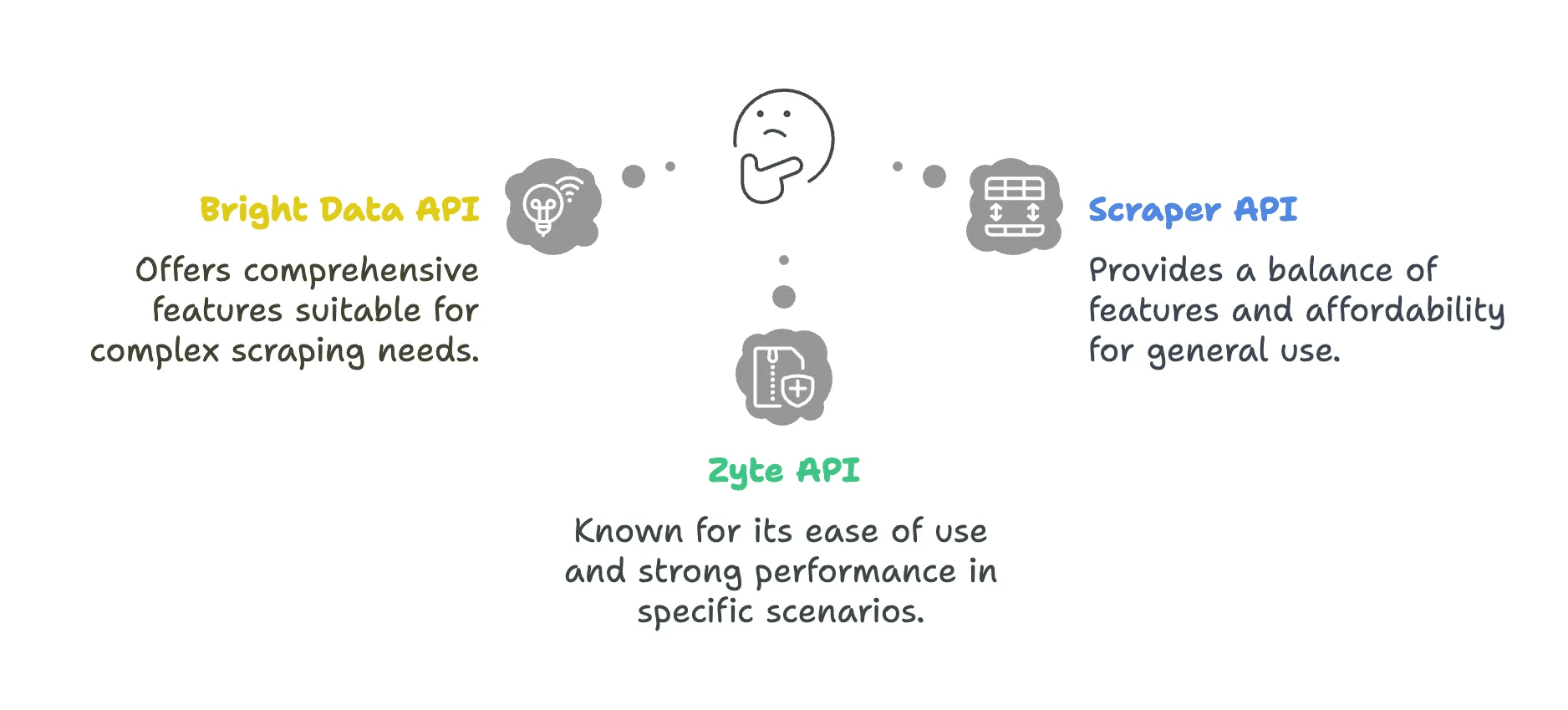

APIソリューション一覧

| API | メリット | デメリット |

|---|---|---|

| Bright Data API | - 広範なプロキシネットワーク(195か国で7,200万以上のIP) - 都市/郵便番号レベルまで対応する高度なジオターゲティング - IPローテーション用の強力なProxy Manager | - 応答速度が遅め(平均22.08秒) - 料金が高く、小規模チームには不向き - 設定の学習コストが高い |

| ScraperAPI | - 49ドルから始めやすい - 自動データ抽出のAutoparse機能 - テスト用のWeb UIプレーヤー | - ブロックされたリクエストにも課金されることが多い - JavaScriptレンダリング機能が限定的 - プレミアムパラメータでコストが膨らむ可能性がある |

| Zyte API | - AIによる解析機能 - 失敗したリクエストには課金されない | - 初期コストが高い(約月450ドル) - クレジットは翌月に繰り越されない |

- Bright Data Web Scraper API

- メリット:

- 195か国を72M以上の住宅IPでカバーし、自動IPローテーションとジオロケーションのシミュレーションに対応。厳しいスクレイピング対策のあるサイトに最適(例: 、)

- JavaScriptの動的コンテンツ読み込みとページスナップショット取得をサポート

- デメリット:

- コストが高く(リクエスト数と帯域で課金)、小規模プロジェクトでは費用対効果が低い

- メリット:

- Scraper API

- メリット:

- 世界中で4,000万のプロキシ、自動のデータセンター/住宅IP切り替え、Cloudflare認証の回避、などのCAPTCHA対策ツール連携に対応

- 構造化エンドポイントと非同期スクレイパーで、より高速に取得できる

- デメリット:

- 動的ページのレンダリングには追加料金が必要で、複雑なAJAXサイトへの対応は限定的

- メリット:

- Zyte API

- メリット:

- AI搭載の自動ウェブデータ抽出で、サイトごとに抽出ルールを開発・保守する必要がない

- 柔軟な従量課金制

- デメリット:

- セッション管理やスクリプト実行可能ブラウザなどの高度な機能には学習が必要

- メリット:

記事・ニューススクレイパーの選び方

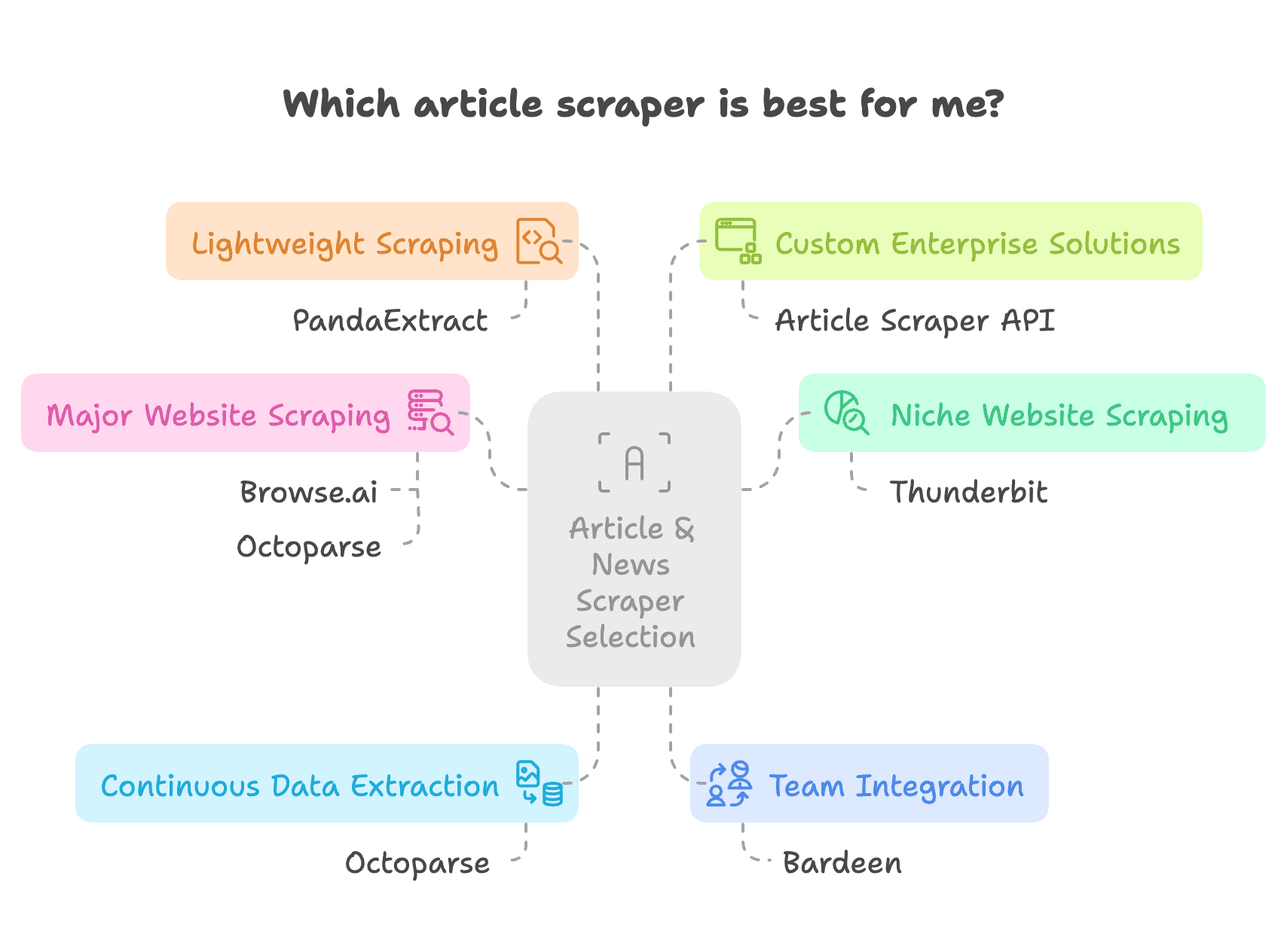

記事・ニューススクレイパーを選ぶときは、業務要件、技術的背景、予算を考えましょう。

- 各ページごとにスクレイパーを作らずに複数のニッチサイトを取得したい、かつ予算があるなら、が最有力です。に頼らず、AIでウェブ構造を解析し、データ取得後のAI分析にも対応します。Thunderbit AIにとって、すべてのウェブサイトは同じです。記事全体を高精度で取得できます。

- やのような大規模サイトからニュースや記事をスクレイピングするには、強力なスクレイピング対策と事前構築テンプレートを備えた記事スクレイパーが必要です。Browse.aiやOctoparseのようなツールが該当します。ただし、最もおすすめなのはのようなChrome拡張機能です。実際のブラウジングやコピペに近い形でデータ取得できるため、複雑な設定なしでログイン情報も扱えます。

- 大規模かつ継続的にデータを取得したい場合は、Octoparseのようなスケジュール機能付きツールのほうが適しています。

- チーム利用や既存ワークフローへのスムーズな統合を重視するなら、Bardeenが最適です。記事スクレイピング以外にも幅広いウェブ自動化ツールを備えています。

- 学習に時間をかけず、小規模なデータ抽出に使える軽量な記事スクレイパーが欲しいなら、PandaExtractのようなポイント&クリック型を選びましょう。

- 技術的な背景がある、または企業向けの記事スクレイパーを構築しているなら、これらのに加えて、APIツールや自作スクレイパーも検討してください。

結論

この記事では、記事・ニューススクレイパーの概念とビジネスシーンを紹介しました。はを基盤としており、特に高度な操作ではウェブのやに関する一定の知識が必要です。一方、新世代のは、AIの意味理解と視覚認識だけに依拠しており、ウェブ構造の変化への適応、サイト横断での汎用性、動的コンテンツ対応、その後のデータクレンジングと分析においてを上回ります。

また、開発者向けに便利な記事・ニューススクレイパーとAPIツールを6つ紹介し、それぞれの長所と短所、適したデータ規模、ウェブ機能、対象ユーザーを比較しました。記事・ニュースのスクレイピングを検討する際は、性能とコストのバランスを見ながら、自社のニーズに合うソリューションを選びましょう。

よくある質問

1. AI記事スクレイパーとは何ですか? どう動作しますか?

- AIを使ってウェブページを解析し、CSSセレクタなしでコンテンツを抽出します。

- 見出し、著者名、公開日、本文を高精度で識別します。

- 広告、ナビゲーションメニュー、その他の不要要素を自動で除去します。

- ウェブ構造の変化に適応し、異なるサイトでも動作します。

2. 従来型スクレイパーと比べて、AI搭載記事スクレイパーを使う利点は何ですか?

- 1つのツールで複数サイトからコンテンツを抽出できます。

- JavaScriptやAJAXで読み込まれるページを含む動的コンテンツにも対応します。

- CSSベースのスクレイパーより手動設定と保守が少なくて済みます。

- 要約、翻訳、感情分析などの追加機能も使えます。

3. コーディング不要でThunderbitを使ってAI記事スクレイピングできますか?

- はい。Thunderbitは、技術知識がないユーザー向けに設計されたシンプルなノーコードUIを備えています。

- AIが記事コンテンツを自動で検出・抽出します。

- 事前構築テンプレートで、素早く効率的にスクレイピングできます。

- CSV、JSON、Googleスプレッドシートなど、さまざまな形式へエクスポートできます。

さらに詳しく: