を使えば、We Work Remotely のリモート求人一覧を数分でスクレイピングできます。AI搭載のウェブスクレイパーがページ内容を読み取り、求人情報を整理された行データに変換。AI Suggest Columns をクリックしてから Scrape を実行するだけで、職種名・企業名・勤務地・タグ・日付・URLなどをAIが自動で構造化し、エクスポートできます。さらに深い情報が必要な場合は、subpage scraping で各求人ページを開き、説明文や応募リンクを追加してデータを充実させられます。

🧑💻 We Work Remotely Scraper とは

We Work Remotely Scraper は、Thunderbit の Chrome 拡張機能を使って から求人一覧や求人詳細を抽出できる AIウェブスクレイパー です。コードを書いたり壊れやすいセレクタを組んだりする代わりに、取得したいページ(例:リモート求人ディレクトリ)を開いて AI Suggest Columns → Scrape の順にクリックするだけで、ダウンロードや各種ツール連携に使える整ったテーブルを作成できます。

Thunderbit では、さらに次のことも可能です:

- ページネーション や長いリストにも対応

- Subpage Scraping で各求人ページを開き、詳細説明・要件・応募URLまで取得

- Excel / Google Sheets / Airtable / Notion へ(無料のエクスポートオプションで)出力

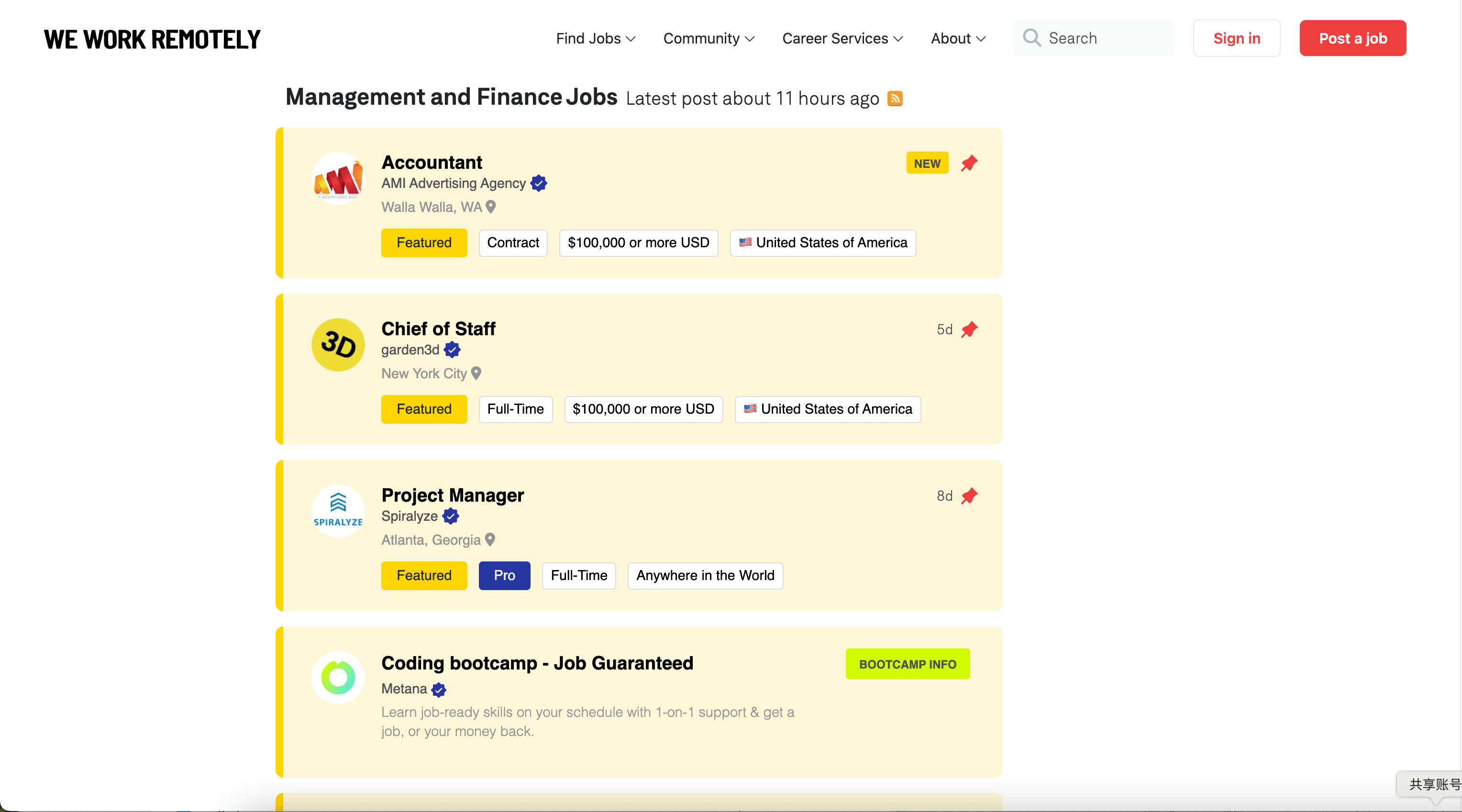

🗂️ We Work Remotely で何をスクレイピングできる?

We Work Remotely は、エンジニアリング、プロダクト、デザイン、マーケティング、カスタマーサポートなど幅広い職種のリモート求人が集まる人気サイトです。Thunderbit の AIウェブスクレイパー(https://thunderbit.com/)を使えば、採用ソーシング、分析、アラート、レポーティングに活用できる「構造化された求人データベース」を作れます。

We Work Remotely の全リモート求人をスクレイピング

このケースでは、メインの求人ディレクトリ を対象にスクレイピングします。カテゴリや企業を横断して広く集めたいときに最適で、必要に応じて各求人の詳細ページをスクレイピングして行データを拡張できます。

手順:

- をインストールし、アカウント登録します。

- 取得したいページへ移動します(例):https://weworkremotely.com/remote-jobs

- AI Suggest Columns をクリックして、推奨カラムを生成します。

- Scrape をクリックしてスクレイピングを実行し、データを取得してファイルをダウンロードします。

カラム名

| Column | Description |

|---|---|

| 🧾 Job Title | 一覧に表示される職種名(例:「Senior Backend Engineer」)。 |

| 🏢 Company | 求人を掲載している企業名。 |

| 📍 Location / Region | 「Worldwide」「US only」などの勤務地条件や地域制約。 |

| 🏷️ Tags / Category | Programming / Design / Marketing など、一覧に表示されるタグやカテゴリ。 |

| 🗓️ Posted Date | 掲載日(または「◯日前」などの相対表示)。 |

| 🔗 Job URL | 求人詳細ページへのリンク(サブページスクレイピングに便利)。 |

| 🖼️ Company Logo URL | 一覧に表示される場合の企業ロゴ画像URL。 |

| 🧩 Short Summary | 一覧ページに表示される短い抜粋・プレビュー文。 |

Tip: 一覧を取得した後、Scrape Subpages を使って各 Job URL を巡回し、詳細説明、要件、(あれば)給与、応募リンクなどの項目を追加できます。

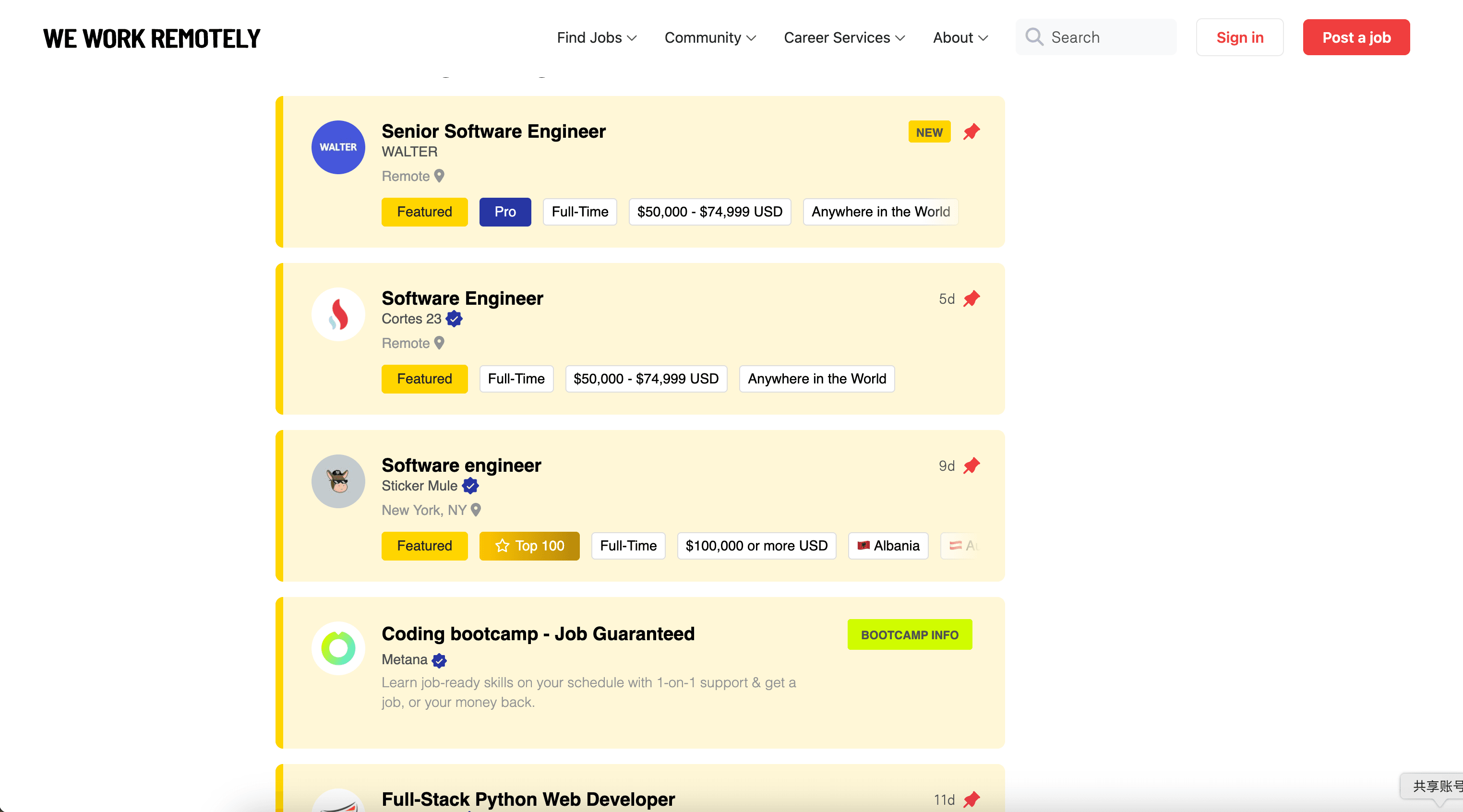

We Work Remotely のリモート開発求人(Programming)をスクレイピング

このケースでは、特定カテゴリのページ を対象にします。エンジニア職だけが欲しい場合に、後からフィルタリングする手間を減らして、よりクリーンなデータセットを作れます。

手順:

- をインストールし、アカウント登録します。

- 取得したいページへ移動します(例):https://weworkremotely.com/categories/remote-programming-jobs

- AI Suggest Columns をクリックして、推奨カラムを生成します。

- Scrape をクリックしてスクレイピングを実行し、データを取得してファイルをダウンロードします。

カラム名

| Column | Description |

|---|---|

| 💻 Job Title | カテゴリページに表示される開発系の職種名。 |

| 🏢 Company | 採用企業名。 |

| 🌎 Location / Timezone | 国・地域・タイムゾーン重なりなどの勤務地条件。 |

| 🧠 Tech / Tags | 表示される場合の技術スタック、シニアリティ、雇用形態などを示すタグ。 |

| 🗓️ Posted Date | 掲載日または相対時間の表示。 |

| 🔗 Job URL | サブページスクレイピングで詳細を追加するための求人詳細URL。 |

| 🧾 Category | カテゴリ名(複数カテゴリを統合する場合に便利)。 |

| 📝 Notes (AI) | 任意:Field AI Prompt を追加して、求人要約や分類(例:Backend/Frontend/Full-stack)を行う。 |

🎯 We Work Remotely ツールを使う理由

We Work Remotely をスクレイピングすると、流れの速い求人ボードを「検索・絞り込み・運用」できるデータセットに変換できます。

チームが We Work Remotely をスクレイピングする主な理由:

- 採用・タレントソーシング: リモート採用中の企業リストを作り、新着求人を追跡し、地域・技術スタック・シニアリティで優先順位付け。

- 営業・パートナーシップ: リモートファーストで成長中の企業を見つけ、求人(採用活動)をシグナルとしてリードを強化(採用=予算・緊急度の可能性)。

- 市場調査: カテゴリ別(開発 vs デザイン)トレンド、勤務地制約、職種の出現頻度を時系列で把握。

- 求職者・キャリアコーチ: Google Sheets や Notion で個人用の求人トラッカーを作り、重複を除外し、新着を監視。

- EC/オペレーション組織で技術人材を採用するチーム: 自社領域に近いエンジニア求人を継続的にリスト化。

Thunderbit の強みは、ビジネスの実務フロー向けに設計されている点です。AIウェブスクレイパー(https://thunderbit.com/)がデータを自動で整形し、Subpage Scraping で複雑なクローラーを作らずに各行をリッチ化できます。

最新のスクレイピング運用の考え方を知りたい場合は、以下のガイドも参考になります:

🧩 We Work Remotely Chrome 拡張機能の使い方

- Thunderbit Chrome Extension をインストール: から入手し、 でアカウントを作成します。

- We Work Remotely のページを開く: または を開きます。

- AIスクレイパーを起動: AI Suggest Columns をクリックして、カラム名・データ型・任意の Field AI Prompts を生成します。カラム名の変更や、「Seniority」「Comp Range (if listed)」などの追加も可能です。

- スクレイピング+リッチ化: Scrape で行データを取得。続いて Scrape Subpages で各求人URLを開き、詳細説明、応募リンクなどを抽出します。

Pro workflow: 共同作業なら Google Sheets へ、簡易ATS風のデータベースにしたいなら Airtable / Notion への出力がおすすめです。エクスポートは無料です。

💳 We Work Remotely の料金

Thunderbit は分かりやすいクレジット制です:

- 1クレジット = 出力1行(結果テーブルの求人1行)。

- AIによるスクレイピング体験はプランに含まれており、データのエクスポートは無料(CSV/JSON、Excel、Google Sheets、Airtable、Notion)。

無料で試せる内容:

- Free tier: 月 6ページ までスクレイピング可能。

- Free trial: 10ページ を無料でスクレイピング可能。We Work Remotely で「一覧+サブページのリッチ化」を試すのに最適です。

1回あたりの典型的なコスト例:

- 一覧を5ページ取得して合計80件の求人行になった場合、80クレジット。

- その80件をサブページスクレイピングでリッチ化しても、基本的には 出力される行数 がカウント対象なので、最終的に欲しい求人行数を基準にクレジットを見積もるのがおすすめです。

有料プラン(月額・年額)は利用量に応じて拡張でき、継続的に使う場合は年額の方が割安になることが多いです。詳細は をご覧ください。

| Tier | Pricing (Monthly) | Pricing (Yearly) | Yearly Total Price | Credits (Monthly) | Credits (Yearly) |

|---|---|---|---|---|---|

| Free | Free | Free | Free | 6 pages | N/A |

| Starter | $15 | $9 | $108 | 500 | 5,000 |

| Pro 1 | $38 | $16.5 | $199 | 3,000 | 30,000 |

| Pro 2 | $75 | $33.8 | $398 | 6,000 | 60,000 |

| Pro 3 | $125 | $68.4 | $796 | 10,000 | 120,000 |

| Pro 4 | $249 | $137.5 | $1,592 | 20,000 | 240,000 |

❓ FAQ

-

AI Powered We Work Remotely Scraper とは?

AI Powered We Work Remotely Scraper は、We Work Remotely から求人一覧と求人詳細を抽出し、構造化テーブルに変換する Thunderbit のワークフローです。一覧ページをスクレイピングした後、サブページスクレイピングで求人詳細ページを巡回し、各行をリッチ化できます。 -

Thunderbit とは?

は、コーディング不要でWebサイト・PDF・画像から構造化データを抽出できる AIウェブスクレイパー の Chrome 拡張機能です。ビジネスユーザー向けに、素早いセットアップ、安定した抽出、Google Sheets / Airtable / Notion などへの簡単な出力を重視して設計されています。 -

We Work Remotely をスクレイピングするのにプログラミングは必要?

不要です。AI Suggest Columns をクリックすると、ページ上の内容をもとに Thunderbit のAIが抽出項目を提案します。英語の指示(自然文)でカラムを調整してから Scrape を押すだけです。 -

求人の詳細説明や応募リンクも取得できますか?

はい。一覧ページを取得した後、Subpage Scraping で各求人の詳細ページを開き、説明文全文、業務内容、要件、応募URLなどを抽出できます。一覧に職種名と企業名しか出ていない場合に特に有効です。 -

We Work Remotely のページネーションはどう扱われますか?

Thunderbit は、クリック式のページネーションと長いスクロール型リストの両方に対応します(サイト構造によります)。ディレクトリが複数ページに分かれている場合でも、1回の実行で複数ページを取得し、出力を1つのテーブルにまとめられます。 -

どんな形式で、どこへエクスポートできますか?

CSV/JSON でのエクスポート、Excel 用のダウンロード、または Google Sheets / Airtable / Notion への直接送信が可能です。エクスポートは無料なので、共有用の求人トラッカーや検索可能なデータベースを簡単に作れます。 -

求人ボードにおける Cloud Scraping と Browser Scraping の違いは?

Cloud Scraping は一般に高速で、公開求人のように大量ページをまとめて処理したい場合に向きます。Browser Scraping は Chrome のセッション上で動作し、ログインが必要なサイトや、ローカルセッションに応じて表示が変わるコンテンツに適しています。 -

無料プランで何件の求人を取得できますか?

無料プランは「求人件数」ではなく「ページ数」で計測され、月 6ページ までスクレイピングできます。1ページに多くの求人が載っていれば十分なデータ量を確保でき、ワークフロー検証中は無料トライアルで 10ページ まで試せます。 -

採用やリサーチ目的で We Work Remotely をスクレイピングしても大丈夫?

公開WebページのスクレイピングはリサーチやBIで一般的ですが、適用される法令の遵守、プライバシーへの配慮、サイトの利用規約の確認は必ず行ってください。本番運用では、適切な頻度に抑えるなど、責任あるデータ利用を推奨します。

📚 もっと知る

- 拡張機能を入手:

- 製品と活用例:

- チュートリアル:

- 実践ガイド:

AIウェブスクレイパー(https://thunderbit.com/)で We Work Remotely から整ったリモート求人データセットを作りませんか?Thunderbit をインストールし、対象の求人ページを開いて AI Suggest Columns、続けて Scrape をクリックするだけです。