ネットの世界には、ものすごい量のデータが転がっていて、それが今やビジネスのエンジンになっています。営業やEC、不動産、競合リサーチなど、どんな業界でも「必要な情報をいかに早く手に入れるか」が勝負の分かれ目。でも、ウェブサイトから手作業でコピペするのは正直やりたくないですよね。そんなときに頼りになるのがウェブスクレイピング。実は、思っているよりずっと手軽に始められるんです。

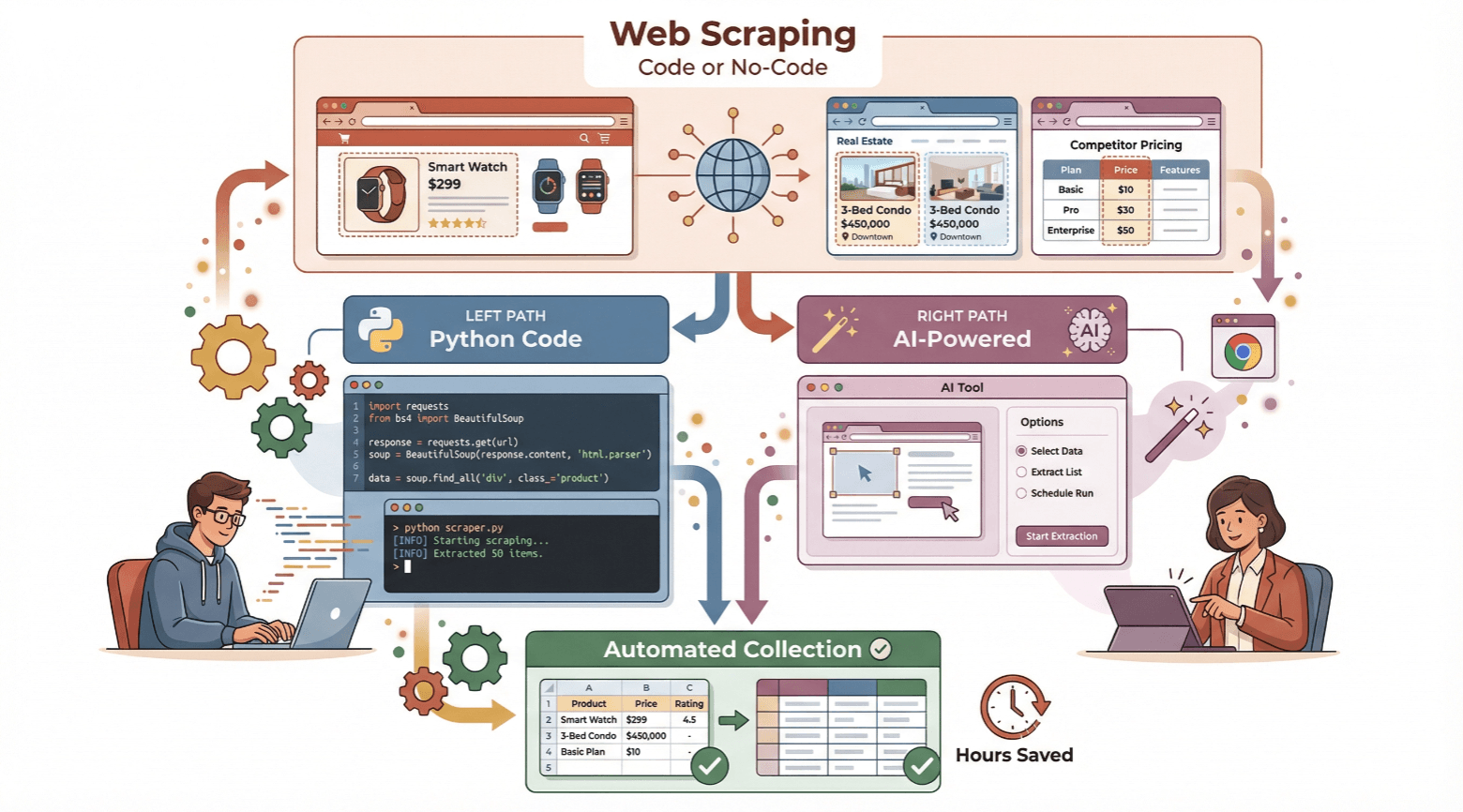

この記事では、ウェブスクレイパーの作り方を初心者向けに分かりやすく解説します。Pythonで自作したい人も、コード不要のAIツール「Thunderbit」を使いたい人も、どちらのやり方もステップごとに紹介。自分に合った方法がきっと見つかります。自動化で時間を節約して、データ活用の幅を広げましょう!

ウェブスクレイパーって何?基本を押さえよう

ウェブスクレイパーは、ウェブサイトから必要な情報を自動で集めてくれるツールやサービスのこと。たとえば、街中のカフェの住所や電話番号をリスト化したいとき、手作業で一つずつコピペするのは大変。でもウェブスクレイパーなら一発でまとめてゲットできます。

ウェブスクレイパーは、まるでデジタル秘書みたいにウェブページを読み込んで、価格や商品名、連絡先など指定したデータを抽出し、スプレッドシートやデータベースに整理してくれます。ブラウザとExcelを行ったり来たりする手間がなくなり、データ収集が圧倒的に効率化されます。

仕組みはとてもシンプル:

- リクエスト送信:スクレイパーがウェブページにアクセスしてHTMLデータを取得。

- 解析:HTML構造を解析して、欲しい情報(例:

<span>タグ内の価格など)を探す。 - 抽出・保存:見つけたデータをCSVやExcel、Googleスプレッドシートなどの形式で保存。

手作業のコピペはスプーンで穴を掘るようなもの。ウェブスクレイピングはパワーショベルで一気に掘る感覚です。

なぜウェブスクレイパー作成がビジネスで重要なの?

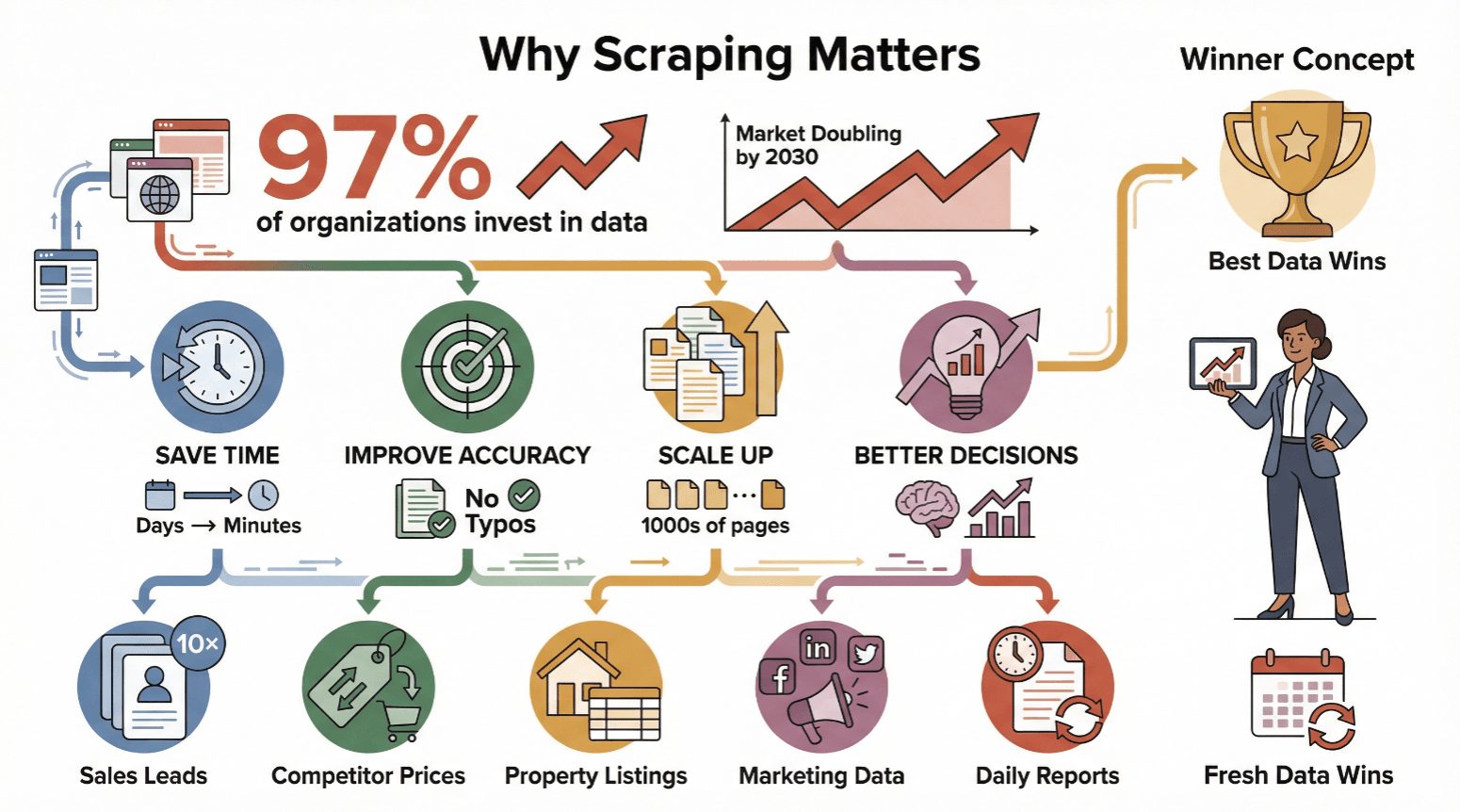

ウェブスクレイピングは、エンジニアやデータサイエンティストだけのものじゃありません。今や、最新で正確な情報を求めるすべてのビジネスパーソンにとって必須の手段。実際、がデータドリブンな意思決定に投資していて、ウェブスクレイピング市場は2030年までに倍増すると言われています。

多くの企業がウェブスクレイピングを導入する理由はこんな感じ:

- 時間短縮:自動化で何日もかかる作業が数分で終わる

- 精度アップ:ソフトは疲れ知らず、ミスもなし

- スケール拡大:数千ページでも一括で収集OK

- 意思決定の質向上:新鮮なデータで価格調整やリード獲得、トレンド分析がサクサク進む

実際の活用例はこちら:

| ユースケース | 主な利用者 | 得られる効果 |

|---|---|---|

| ディレクトリから営業リードを抽出 | 営業チーム | リード数10倍、見込み客探しの時間を大幅短縮 |

| ECサイトで競合価格を監視 | ECマネージャー | リアルタイムで価格調整、利益率の維持 |

| 不動産サイトから物件情報を集約 | 不動産会社 | 取引機会の発見が早く、市場データも常に最新 |

| ウェブやSNSからマーケティングデータを収集 | マーケティング部門 | ターゲット精度の高いキャンペーン、効果測定の効率化 |

| 日次のウェブデータレポートを自動化 | オペレーション、アナリスト | 人件費削減、エラー減少、レポートの安定供給 |

つまり、「より新鮮で質の高いデータを持つ人が勝つ」ってことです。

初心者向け:Pythonでシンプルなウェブスクレイパーを作る方法

ウェブスクレイピングの仕組みを知りたい人にはPythonがぴったり。プログラミング未経験でも、基本的なスクレイパーなら数ステップで作れます。

開発環境の準備

まずはPythonをパソコンにインストール。から最新版をダウンロードして、「Add Python to PATH」にチェックを入れてインストールしましょう。

次に、ターミナル(またはコマンドプロンプト)で必要なライブラリをインストール:

1pip install requests

2pip install bs4

3pip install pandasrequests:ウェブページ取得用bs4(Beautiful Soup):HTML解析用pandas:データのCSVやExcel保存用

ウェブサイト構造の確認

コードを書く前に、欲しいデータがHTMLのどこにあるかを調べます。Chromeで対象ページを開いて、取得したいデータ(例:求人タイトル)を右クリック→「検証」を選択。該当するHTMLタグやクラス名(例:<a class="jobtitle">)をメモしておきましょう。

スクレイパーの作成と実行

例えば、求人一覧ページから「職種」と「会社名」を取得したい場合、こんなスクリプトになります:

1import requests

2from bs4 import BeautifulSoup

3import pandas as pd

4URL = "https://example.com/jobs" # ここを対象URLに変更

5response = requests.get(URL)

6soup = BeautifulSoup(response.text, 'html.parser')

7# 職種と会社名を抽出(セレクタはサイトに合わせて調整)

8titles = [t.get_text().strip() for t in soup.find_all('a', class_='jobtitle')]

9companies = [c.get_text().strip() for c in soup.find_all('div', class_='company')]

10# CSVに保存

11df = pd.DataFrame({'Job Title': titles, 'Company': companies})

12df.to_csv('jobs.csv', index=False)

13print("スクレイピング完了!jobs.csvに保存しました")- URLやクラス名は対象サイトに合わせて変更してください。

- ターミナルで

python ファイル名.pyを実行。 jobs.csvを開いて結果を確認。

ワンポイント:ページ送りや動的コンテンツがある場合はループやSeleniumなどの追加ツールが必要ですが、静的なページならこの方法で十分です。

コード不要!Thunderbitでウェブスクレイパーを作る方法

「プログラミングはちょっと…」という人には、みたいなノーコード・AIウェブスクレイパーが超おすすめ。Thunderbitなら「このデータが欲しい」と思ったら、たった2クリックでスプレッドシート化できます。

使い方はめちゃくちゃ簡単:

ステップ1:Thunderbit Chrome拡張機能をインストール

から拡張機能を追加して、無料アカウントを作成(無料プランでお試しOK)。

ステップ2:対象ウェブサイトを開く

Chromeで取得したいページを開きます。必要ならログインして、動的コンテンツもスクロールして表示させておきましょう。

ステップ3:抽出したいデータを指示

Thunderbitアイコンをクリックしてサイドバーを開きます。次のどちらかでデータを指定:

- **「AIフィールド提案」**をクリックすると、ThunderbitのAIがページを解析して「商品名」「価格」「画像」などのカラムを自動提案。

- もしくは、自然な日本語で「このページから本のタイトルと著者を抽出して」などと入力。

AIが自動でフィールドやデータ型を提案。必要に応じてカラム名の変更や追加・削除もOK。

ステップ4:スクレイピング実行

フィールドが決まったら**「スクレイプ」をクリック。Thunderbitがデータを抽出し、ページ送りも自動で対応。サブページ(商品詳細など)も「サブページをスクレイプ」**で一括取得できます。

ステップ5:結果の確認とエクスポート

Thunderbitのテーブルでデータを確認。問題なければ**「エクスポート」**をクリックして、Excel、CSV、Googleスプレッドシート、Airtable、Notion、JSONなど好きな形式で保存できます。エクスポートは無料・無制限です。

これだけ。コードもテンプレートも不要、手間いらず!

従来型とノーコード型ウェブスクレイパーの比較

2つのやり方を比べてみましょう:

| ソリューション | セットアップ時間 | 必要なスキル | メンテナンス | 柔軟性 | エクスポート形式 |

|---|---|---|---|---|---|

| Python + Beautiful Soup | 数時間〜数日 | コーディング・HTML基礎 | 高(壊れやすい) | 非常に高い | CSV, Excel, JSON(要コード) |

| 従来型ノーコードツール | 30〜60分 | 多少のIT知識 | 中(手動修正必要) | 静的サイト向き | CSV, Excel |

| Thunderbit(AIノーコード) | 数分 | 不要(日本語でOK) | 低(AIが自動対応) | 高(動的サイトも対応) | Excel, CSV, Sheets, Notion... |

ThunderbitのAI活用型なら、設定や修正の手間が激減して、データ活用に集中できます。

従来型ウェブスクレイパーの悩みもThunderbitで解決

従来のスクレイパーには、よくある悩みがつきもの:

- サイト構造の変化:レイアウトが変わるとコードが動かなくなる。ThunderbitのAIは自動で変化に対応、再コーディング不要。

- ボット対策:多くのサイトが自動スクリプトをブロック。Thunderbitはブラウザ(ログイン・セッション利用)やクラウドで実行OK。

- 動的コンテンツ:「もっと見る」や無限スクロールもThunderbitのAIが自動で処理。

- ログイン必須データ:Thunderbitのブラウザモードなら、Chromeで見えるものは全部取得可能。

つまり、Thunderbitは今どきの複雑なウェブサイトにも柔軟に対応できる設計です。

効率爆上げ!Thunderbitの高度なウェブスクレイピング機能

Thunderbitは「データを取る」だけじゃなく、「すぐ使える形で、きれいに、速く」取得できるのが強み。主な機能はこちら:

自動ページ送り・サブページ取得

複数ページにまたがる商品リストもThunderbitなら「次へ」ボタンや無限スクロールを自動検出して一括取得。サブページ(詳細ページ)も「サブページをスクレイプ」でリンク先の追加情報をまとめて収集できます。

AIによるフィールド提案・データ構造化

ThunderbitのAIは、ただのカラム推測じゃなく、文脈を理解してカラム名やデータ型(テキスト、数値、画像、メールなど)を自動設定。さらに「100円以上のみ」「説明文を英語に翻訳」などカスタム指示もOK。分類や要約、書式変換もプロンプトで柔軟に対応します。

テンプレート&即時スクレイピング

Amazon、Zillow、Googleマップ、Instagramなど人気サイトはテンプレートが用意されていて、選ぶだけで全てのフィールドが自動設定。面倒な初期設定は不要です。

スケジューリング・自動化

毎日最新データが欲しい場合は「毎週月曜9時」などスケジュール設定で自動実行。Googleスプレッドシートやデータベースも自動更新されます。

クラウド・ローカル両対応

ログインやインタラクティブなサイトはブラウザ実行、公開データはクラウド実行(最大50ページ同時)と使い分けOK。

Thunderbitの高度な機能は、信頼性・拡張性・使いやすさを求めるビジネスユーザーにぴったりです。

実践ガイド:Thunderbitでウェブスクレイパーを作る手順

クイックスタートの流れ:

- Thunderbitをインストール:してアカウント登録。

- 対象サイトを開く:必要ならログイン、コンテンツを表示。

- Thunderbitサイドバーを開く:拡張アイコンをクリック。

- データを指示:「AIフィールド提案」またはプロンプト入力。

- フィールド確認:カラム名の変更・追加・削除もOK。

- 「スクレイプ」実行:Thunderbitが自動で抽出。

- (任意)サブページ取得:詳細データも一括収集。

- 結果確認:テーブルで精度をチェック。

- データエクスポート:Excel、CSV、Google Sheets、Notion、Airtable、JSONなど。

- 保存・テンプレート・スケジュール:設定を保存、定期実行も可能。

トラブルシューティング:

- データが抜けている場合はプロンプトを工夫、またはカスタム指示を追加。

- 動的コンテンツはブラウザモードで実行。

- 無料枠の上限に達したら有料プランも検討。

まとめ・ポイント

ウェブスクレイパー作成は、もうエンジニアだけのものじゃありません。Pythonでじっくり学びたい人も、AIに任せて手軽に始めたい人も、今なら誰でも簡単に自動化できます。

覚えておきたいポイント:

- ウェブスクレイピングは時間短縮・精度アップ・データ活用に最適。

- Pythonは学習やカスタマイズにぴったりだけど、コーディングや保守が必要。

- Thunderbitならノーコードで「やりたいこと」を伝えるだけでOK。

- 自動ページ送り、サブページ取得、AIフィールド提案など高度な機能も充実。

- Thunderbitは無料で試せて、数分で結果が出る。

もうコピペ作業に悩まされる必要なし!して、ウェブスクレイピングの手軽さを体感してみてください。さらに詳しく知りたい人はもぜひチェック!

よくある質問

1. ウェブスクレイパー作成にプログラミングは必要?

いえ、不要です!Python+Beautiful Soupみたいなコーディングもできますが、Thunderbitのようなノーコードツールなら日本語の指示と数クリックで誰でも強力なウェブスクレイパーを作れます。

2. Thunderbitでどんなデータが取れる?

Thunderbitはテキスト、数値、画像、メールアドレス、電話番号など、ほぼ全てのウェブサイトから抽出OK。ページ送りやサブページも対応、人気サイト用テンプレートも使えます。

3. サイトのレイアウトが変わったらThunderbitはどうなる?

ThunderbitのAIは多くのレイアウト変更に自動対応。従来型スクレイパーのようにサイト更新で壊れる心配が少なく、意味を理解して柔軟に動きます。

4. ウェブスクレイピングは合法で安全?

公開データを対象にし、各サイトの利用規約を守れば合法です。Thunderbitは適切な利用を推奨し、コンプライアンスをサポートする機能も備えています。

5. 定期的なスクレイピングや自動エクスポートはできる?

はい!Thunderbitなら日次・週次など好きな間隔で自動実行、Google SheetsやNotion、Airtable、Excel、CSVへの自動エクスポートも可能です。

データ収集を自動化したい人は、してみてください。ウェブスクレイピングが誰でも簡単に始められます。

さらに詳しく知りたい人はこちらもチェック!