月曜の朝8時30分を思い浮かべてみてください。目の前にはスプレッドシート。10個以上のサイトを行ったり来たりしながら、会社名、メールアドレス、電話番号をひたすらコピペしている——そんな場面です。これはあなただけの話ではありません。実際、従業員の75%以上が、毎日およそ3時間を、データをある場所から別の場所へ移す作業に費やしていると言われています()。私自身も経験がありますが、週の始まりとしては正直、まったく気分が上がる仕事ではありません。営業チームではさらに深刻です。営業職の72%が、毎日1時間を手作業のデータ入力に使っていると回答し()、20%以上がそれをCRMにおける最大の悩みだと答えています。

世界はデータで動いていますが、その集め方は長らく古いままでした。でも今は違います。WebスクレイパーやAI搭載のデータ抽出ツールのおかげで、終わりの見えないコピペ地獄からようやく抜け出せるようになりました。このガイドでは、データ抽出とは何か、なぜ重要なのか、そしてどう使えば何時間もかかる単純作業を数分のインサイトに変えられるのかを、わかりやすく解説します。営業でも、ECでも、オペレーションでも、これは“がんばる”ではなく“賢く動く”ための近道です。

データ抽出をわかりやすく解説:そもそも何で、なぜ重要なのか?

難しい言い回しは抜きにしましょう。データ抽出とは、ひとことで言えば「いろいろな場所にある役立つ情報を集めて、整理された一覧にまとめること」です。たとえば、複数の果樹園からリンゴを摘んで、いちばん良いものだけをかごに入れるようなイメージです。これがデータ抽出の基本です。

正式には、さまざまなソースからデータを取得し、分析・レポート・保存に使える形式へ変換するプロセスのことです()。目的は、あちこちに散らばったデータをサイロから解放し、実際に活用できる場所へ集約することにあります。

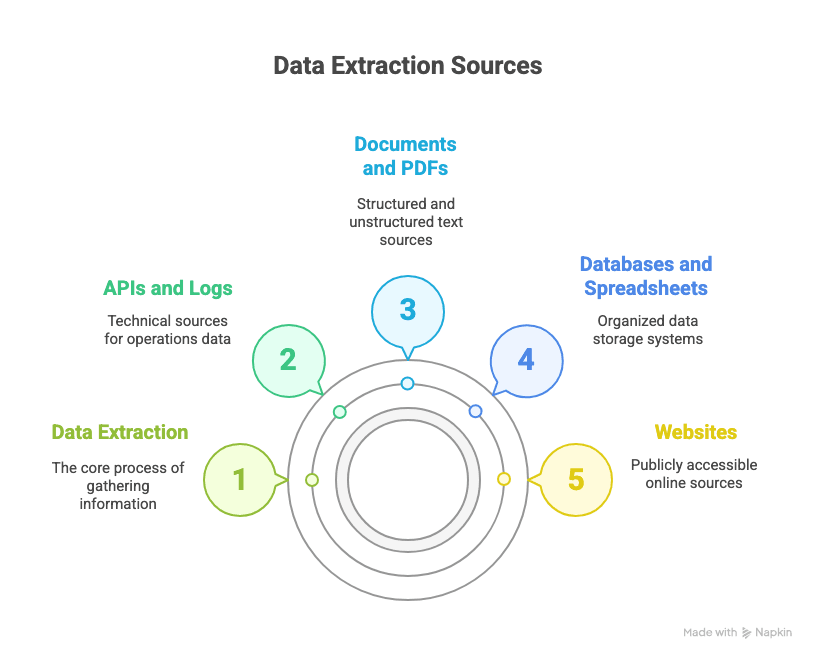

データ抽出はどこで行われる?

- Webサイト:公開ディレクトリ、商品一覧、レビューサイトなど

- データベースやスプレッドシート:CRM、ERP、あるいは終わりの見えないExcelファイル

- ドキュメントやPDF:請求書、レポート、契約書など

- APIやログ:少し技術寄りですが、オペレーションデータの宝庫です

データがきちんと構造化されたデータであれ、SNS投稿のようにカオスな非構造化データであれ、まず最初に必要なのがデータ抽出です。要するに、これは「超強化版コピペ」。より速く、より正確で、しかも精神的消耗がずっと少ない方法です。

現代ビジネスにおいてデータ抽出が欠かせない理由

現実を見ましょう。時間はお金です。チームがデータ整理に費やす1時間は、営業、戦略立案、顧客対応に使えたはずの1時間でもあります。実際、生産性の低下と不適切なリード管理による損失は、企業全体で年間推定1兆ドルにのぼるとされています()。1兆ドルです。桁違いですね。

でも、価値は時短だけではありません。自動データ抽出は、こんな形でビジネスに貢献します。

| 活用例 | 恩恵を受ける人 | 具体的なイメージ |

|---|---|---|

| リード獲得 | 営業チーム | ディレクトリ、LinkedIn、企業サイトから連絡先情報を抽出し、そのまま使えるリストにまとめる |

| 価格・在庫の監視 | EC運営 | 数百SKUにわたって競合価格や在庫状況を監視。手動チェックは不要に |

| 市場調査 | 分析担当・マーケティング | レビュー、SNS投稿、商品スペックを集約して競合分析に活用 |

| 仕入先管理 | 調達部門 | サプライヤーのカタログや価格更新を自動で追跡 |

| データの付加情報追加 | 全員 | メール、電話番号、住所などの追加情報を補完し、CRMやDBを強化 |

さらに、正確性も見逃せません。手作業のデータ入力には約1%のエラー率があります()。一見すると小さく感じるかもしれませんが、件数が増えれば、営業担当が間違った番号に電話したり、価格ダッシュボードが数百ドル単位でズレたりします。

自動データ抽出ツールは、時間を節約するだけではありません。高くつくミスを防ぎ、より速く、より良い判断を下せるようにしてくれます。70%近くの働く人が、オートメーションの最大の利点は反復作業の無駄な時間を減らせることだと感じているのも納得です()。

データ抽出における現実的な課題

データ抽出がそんなに便利なら、なぜ全員がすでに使っていないのでしょうか?答えは簡単。昔ながらの方法は、まあ…「人を鍛える」には向いていました。

よくある問題はこんな感じでした:

- 手作業のコピペは遅く、ミスも多い。 どんなに几帳面な人でも、50行目を超えたあたりでミスが出てきます。そもそも、誰も「コピペ忍者」になるために仕事をしているわけではありません。

- スクリプトはすぐ壊れる。 技術に強い人なら自作のWebスクレイピングスクリプトを書けますが、Webサイトはしょっちゅう見た目や構造を変えます。少し変更が入っただけで、スクリプトは使いものにならなくなります()。

- サイトごとに仕様が違う。 あるサイトで動くものが、別のサイトではそのまま使えません。ページネーションが複雑だったり、ボタンの裏にデータが隠れていたり、ログインが必要だったりします。

- ボット対策の壁。 CAPTCHA、IPブロックなど、スクレイパーを締め出す仕組みが使われています()。

- 法務・コンプライアンスの悩み。 すべてのサイトがデータ取得を歓迎しているわけではありませんし、GDPRのようなプライバシー規制にも配慮が必要です。

そして、たぶん最大の課題は、非技術系のビジネスユーザーと技術チームの間にある“伝わらなさ”です。営業マネージャーが必要な内容を開発者に説明したのに、次のサイト更新で動かなくなる“ほぼ動く”スクリプトが返ってきた——そんな場面を何度も見てきました。

データ抽出の流れ:手作業から自動化へ

では、実際にどうやってデータを抽出するのでしょうか?手作業でも最新のAIでも、基本の流れは意外と似ています。

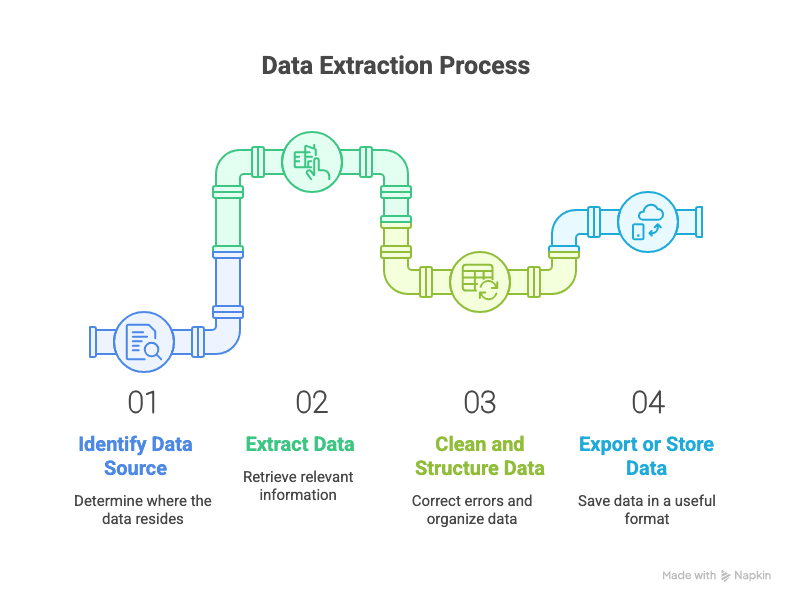

- データソースを特定する。 情報はどこにある?(Webサイト、PDF、データベースなど)

- データを抽出する(スクレイピングする)。 必要な部分を取り出す。方法は、コピペ、スクリプト、ツール利用など。

- データを整えて構造化する。 টাইポ修正、形式の統一、重複削除。

- データを出力・保存する。 Excel、Google Sheets、データベースなど、使いやすい場所に保存する。

主な方法を比べてみましょう。

| 方法 | メリット | デメリット |

|---|---|---|

| 手作業のコピペ | 誰でもできる | 遅い、ミスが多い、拡張しにくい |

| コードベースのスクレイパー | 柔軟で強力 | プログラミングが必要、壊れやすい、保守が大変 |

| ノーコード / AI Webスクレイパー | 速い、使いやすい、変化に強い | 複雑な例外ケースではカスタマイズ性に限界があることも |

特にAI搭載の最新ツールは、この流れを自動パイプラインに変えてくれました。やりたいことを伝えるだけで、あとはツールが重い作業をこなしてくれます。コードは不要です。

データ抽出ツールを知る:Webスクレイパー、API、その他

世の中にはいろいろなデータ抽出ツールがありますが、大きく分けると次のカテゴリに収まります。

- Webスクレイピングツール:ビジネスユーザー向けの定番。Webサイトからデータを取得するためのもので、強化版ブラウザ拡張やクラウドアプリのような存在です。

- APIと連携機能:サイトがAPIを提供しているなら、それを使うのが最善です。APIは整理されていて、壊れにくいのが魅力です。

- バッチ処理・ETLツール:データベースやファイル間で大量データを移動させる用途向けで、ITや分析の現場でよく使われます。

- RPA(ロボティック・プロセス・オートメーション):人間のクリックやキー入力を真似するボット。レガシーシステムには便利ですが、やや扱いにくいこともあります。

- 手動ツール:ExcelのWebインポート、Google Sheetsの関数、ブラウザのアドオンなど。小規模な作業には便利ですが、スケールには向きません。

Webスクレイパーツール:データ抽出をもっと身近に

Webスクレイパーは、多くのビジネスユーザーにとって第一候補です。Webサイトからのデータ収集を自動化し、何時間もかかるクリック作業を数分の成果に変えてくれます。

従来型のWebスクレイパーでは、各項目をひとつずつ指定したり、何を抽出するかルールを設定したりする必要があります。サイトの構造が変われば、また最初からやり直しです。

AI搭載のWebスクレイパー(たとえば Thunderbit)は、さらに一歩先へ進みます。たとえば「このページから商品名と価格を全部取って」と伝えるだけで、AIが残りを判断してくれます。HTMLやXPathと格闘する必要はもうありません。

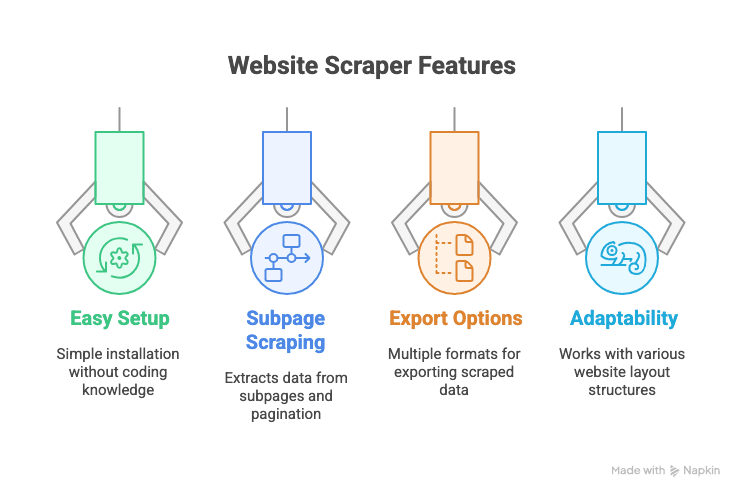

チェックすべき主な機能:

- かんたんな初期設定(コーディング不要)

- サブページ・ページネーションの抽出対応

- 複数の出力先(Excel、Google Sheets、Notionなど)

- さまざまなサイト構成への適応力

Thunderbit:誰でも使えるAI搭載データ抽出

私はSaaSや自動化ツールの開発に長年携わってきましたが、多くのデータ抽出ツールには共通の弱点があると実感しています。技術的すぎる、柔軟性が足りない、あるいは実務の変化についていけないほど遅い——そのどれかです。

そこで私たちは、非技術系のビジネスユーザーのために設計したAIベースのWebスクレイパー、 を作りました。目指したのは、データ抽出を“出前を頼むくらい簡単”にすることです。

Thunderbitの特長はこちら:

- AIによる項目提案:

AI Suggest Fieldsをクリックするだけで、Thunderbitがサイトを読み取り、最適な列を提案し、各項目用のカスタムプロンプトまで生成します。どのセレクターを使うか悩む必要はありません。 - サブページ抽出:各商品ページやプロフィールページの詳細まで必要ですか? Thunderbitが各サブページを巡回し、表を自動で拡張します。

- ページネーション対応:「次へ」ボタンでも無限スクロールでも対応。1ページ目だけでなく、全データを取得できます。

- かんたんエクスポート:Excel、Google Sheets、Notion、Airtableへ直接送信できます。CSVやJSONでのダウンロードも可能です。

- ノーコードで使いやすい:ブラウザが使えれば Thunderbit も使えます。技術知識は不要です。

- クラウド / ブラウザ抽出を選べる:用途に合わせて、クラウドで高速実行することも、ログインが必要なサイトではブラウザ上で実行することもできます。

しかも、価格も手頃にしました。無料プランでは最大6ページまで抽出でき、有料プランは500クレジットで月額15ドルから。小規模チームなら、始めるには十分すぎる内容です。

気になりますか? Thunderbit の Chrome拡張機能をダウンロードして、ぜひ試してみてください。

Thunderbitの実例:現場での活用シーン

ここからは実践編です。Thunderbit が日々どのように使われているのか見てみましょう。

営業:数分でリードを抽出

あなたが営業担当で、業界ディレクトリから見込み客リストを作る役目を任されたとします。名前、メール、電話番号を何時間もかけてコピペする代わりに、次のように進めます。

- Chromeでディレクトリを開く。

- Thunderbit の

AI Suggest Fieldsをクリックする。 - 提案された列(Name、Email、Phone、Company)を確認する。

Scrapeを押す。- 結果を Google Sheets に出力して、すぐに営業活動を始める。

あるユーザーはこう言ってくれました。「200件のリードを10分かからず作れました。以前は半日かかっていたのに!」

EC:競合価格の監視

EC担当者は、競合の価格を常に把握しておく必要があります。Thunderbit なら、次のように簡単です。

- 競合の商品ページを開く。

- 事前作成テンプレートを使うか、AIに項目提案させる(Product Name、Price、Availability など)。

- 毎日チェックするように定期スクレイピングを設定する。

- 価格が変わったら通知を受け取る。手動確認は不要です。

オペレーション:サプライヤーカタログの管理

オペレーションチームは、仕入先カタログを常に最新に保つ必要があります。Thunderbit なら次のことが簡単にできます。

- サプライヤーのWebサイトから商品一覧を抽出する。

- データを Airtable や Notion に出力して在庫管理に使う。

- 定期更新を設定し、常に最新情報で運用する。

データ抽出ツールを選ぶときに見るべきポイント

データ抽出ツールはどれも同じではありません。私なら、次の点を重視します。

- 使いやすさ:非技術系ユーザーでもすぐ始められるか

- 複数ソース対応:Webサイト、PDF、画像、APIなどに対応しているか

- 構造化された出力:見づらいテキストの羅列ではなく、きれいな表で出せるか

- 自動化とスケジューリング:一度設定すれば、あとは自動で動かせるか

- 業務ツールとの連携:Excel、Google Sheets、Notion、Airtable、CRMへ出力できるか

- 拡張性:数件だけでなく、何千件にも対応できるか

- 精度と信頼性:エラーを検知し、変更にも追随できるか

- サブページ・ページネーション対応:隠れた詳細を取りこぼさないか

- AI支援:ツールがこちらを助けてくれるか

そして、サポートとドキュメントの質も軽視できません。つまずいたときに、すぐ助けが得られるかは重要です。

効果的なデータ抽出と分析のベストプラクティス

適切なツールを持つことは、勝負の半分にすぎません。データ抽出を最大限活かすためのコツは次の通りです。

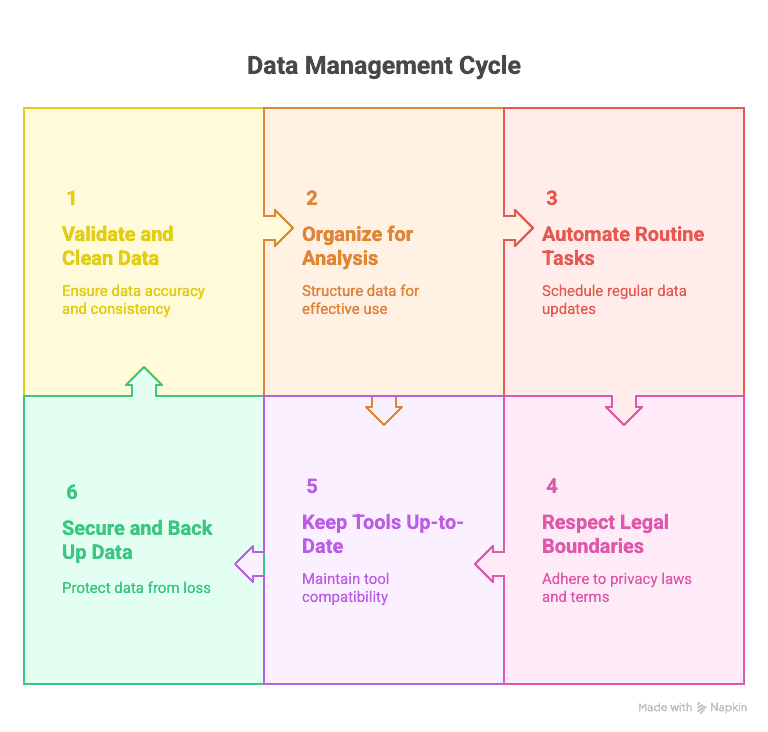

- データの検証とクレンジングを行う:エラー、重複、書式の乱れは必ずチェックしましょう。入力が悪ければ、出力も悪くなります。

- 分析しやすく整理する:見出しをわかりやすくし、形式を統一します。後工程でどう使うかを意識しましょう。

- 定型作業は自動化する:定期的にスクレイピングを実行し、データを常に最新に保ちます。

- 法務とプライバシーの境界を守る:スクレイピング前に、サイトの利用規約や法規制を必ず確認しましょう。

- ツールを最新に保つ:Webサイトは変化します。ツールもそれに追随できるようにしておきましょう。

- データを安全に保管し、バックアップする:せっかく得たインサイトを、ストレージ障害で失わないようにしましょう。

毎回の抽出後にやるべき簡単チェックリスト:数件を目視確認する、重複を削除する、分析ツールに取り込む、次回更新のリマインダーを設定する。

データ抽出の可能性をビジネスで最大限に活かす

ここまでをまとめましょう。データ抽出は、ただの流行語ではありません。情報を扱うすべての人にとって、実務的で変革力のあるツールです。リード獲得、価格追跡、データ整理のどれに取り組む場合でも、適切な抽出ツールがあれば、何時間もかかる面倒な作業を数分のインサイトに変えられます。

そして私の考えをひとつ。これからの主役は垂直特化型AIエージェントです。汎用チャットボットではなく、特定のビジネス課題をピンポイントで解決するツールの時代が来ます。なぜなら、ビジネスに必要なのは、信頼性、再現性、そして大規模でも安定して成果を出せることだからです。汎用AIエージェントはブレストや質問対応には優れていますが、反復的で重要度の高い業務を自動化するなら、その仕事のために作られたツールが必要です。

それが、 で私たちが取り組んでいることです。私たちの使命は、誰でもデータ抽出を使えるようにすること。コード不要、ストレス不要、必要なのは結果だけです。手作業のデータ入力を過去のものにしたいなら、ぜひ Thunderbit を試してみてください。できることの多さに驚くはずです。

さらに深く知りたい方は、 の他の記事もぜひご覧ください。たとえば、 や がおすすめです。

もっと頑張るのではなく、もっと賢く働きましょう。インサイトはすでにそこにあります。あとは、それをつかんで動かすだけです。

追伸:もしデータのコピペを夢に見るようになったら、それは自動化の合図かもしれません。あるいは、ただ休暇が必要なだけかもしれません。どちらにしても、Thunderbit があなたを支えます。

FAQ

1. Thunderbit とは何ですか?

Thunderbit は、コード不要でWebサイトからデータを抽出できるAI搭載のChrome拡張機能です。営業、マーケティング、EC、オペレーションの各チームに最適です。

2. 従来のスクレイパーと何が違うのですか?

- AIが自動で項目を検出

- サブページとページネーションに対応

- 初期設定やコーディングは不要

- Sheets、Excel、Notionなどへ出力可能

3. ログインが必要なページ、PDF、動的ページにも対応できますか?

はい。

- ブラウザモード:ログインページ、PDF、インタラクティブなページ向け

- クラウドモード:公開サイトを高速に抽出

また、テキスト要約や翻訳にも対応しています。