ターミナルを開いてコマンドを1つ打ち込んだだけで、生のWebデータがまるでマトリックスをこじ開けたかのように流れ込んでくる——そんな感覚には、どこか時代を超えた魅力があります。開発者や技術系のパワーユーザーにとって、 はまさにその魔法の杖。目立たないコマンドラインツールですが、クラウドサーバーからスマート冷蔵庫まで、何十億ものデバイスで静かに動いています。しかも2026年になった今でも、ノーコードやAIスクレイピングツールが数多く登場しているにもかかわらず、cURLを使ったウェブスクレイピングは、速度・制御性・スクリプト化のしやすさを重視する人にとって、今なお定番の手段です。

私は長年、自動化ツールを作り、チームのWebデータ活用を支援してきましたが、ページを取得したいとき、APIをデバッグしたいとき、スクレイピングのワークフローを試作したいときには、今でもcURLを使います。このガイドでは、基本から実践的な応用テクニックまでを網羅した cURL ウェブスクレイピングのチュートリアルを、実際のコマンド例、役立つヒント、そしてcURLが強い場面と限界の両方を分かりやすく交えて解説します。もしあなたがコマンドラインに触れたくないビジネスユーザーなら、私たちのAI搭載ウェブスクレイパーである を使えば、「このデータがほしい」から「はい、スプレッドシートです」までをたった2クリックで実現できます。コードは不要です。

私は長年、自動化ツールを作り、チームのWebデータ活用を支援してきましたが、ページを取得したいとき、APIをデバッグしたいとき、スクレイピングのワークフローを試作したいときには、今でもcURLを使います。このガイドでは、基本から実践的な応用テクニックまでを網羅した cURL ウェブスクレイピングのチュートリアルを、実際のコマンド例、役立つヒント、そしてcURLが強い場面と限界の両方を分かりやすく交えて解説します。もしあなたがコマンドラインに触れたくないビジネスユーザーなら、私たちのAI搭載ウェブスクレイパーである を使えば、「このデータがほしい」から「はい、スプレッドシートです」までをたった2クリックで実現できます。コードは不要です。

それでは、なぜ2026年の今でもcURLがウェブスクレイピングに有効なのか、どう使えば効果的なのか、そしてさらに強力なツールに切り替えるべきタイミングはいつなのかを見ていきましょう。

cURLとは? cURLを使ったウェブスクレイピングの基礎

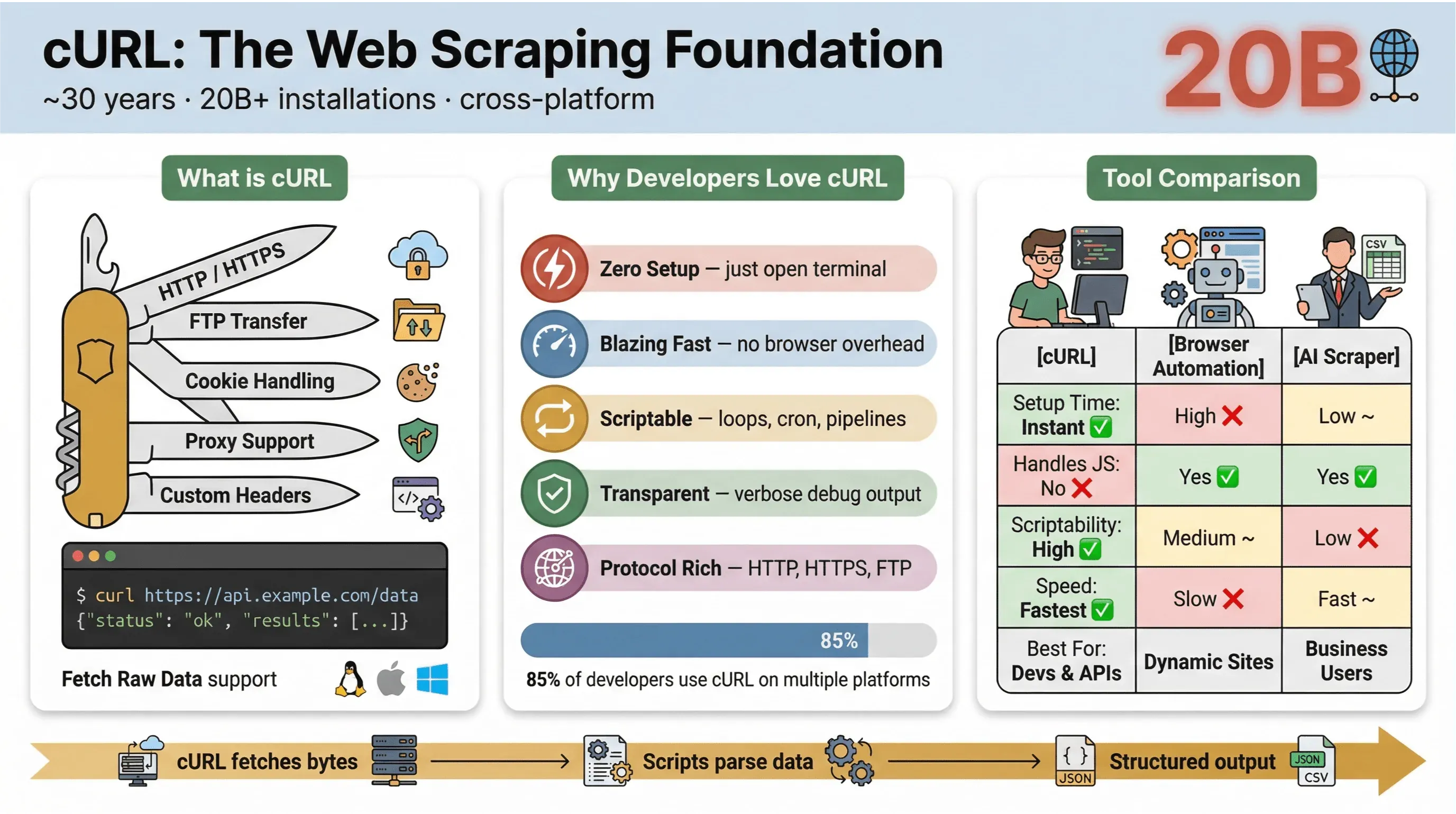

は、URLを使ってデータを転送するためのコマンドラインツール兼ライブラリです。登場からもう30年近く経ちますが(本当です)、LinuxやmacOS、Windows、さらには組み込み機器まで、あらゆる場所に組み込まれています。スクリプトを支え、で静かにデータ転送を担っているのです。Webページの取得、APIのテスト、ファイルのダウンロードなどをさっと実行したことがあるなら、cURLを使っていた可能性は高いでしょう。

cURLがウェブスクレイピングでこれほど人気なのは、次のような理由からです。

cURLがウェブスクレイピングでこれほど人気なのは、次のような理由からです。

- 軽量でクロスプラットフォーム: Linux、macOS、Windows、さらには組み込みデバイスでも動作します。

- 多様なプロトコルに対応: HTTP、HTTPS、FTP などを扱えます。

- スクリプト化しやすい: 自動化、cronジョブ、つなぎ込みコードに最適です。

- ユーザー操作が不要: 非対話型の利用を前提に設計されており、バッチ処理やパイプラインに向いています。

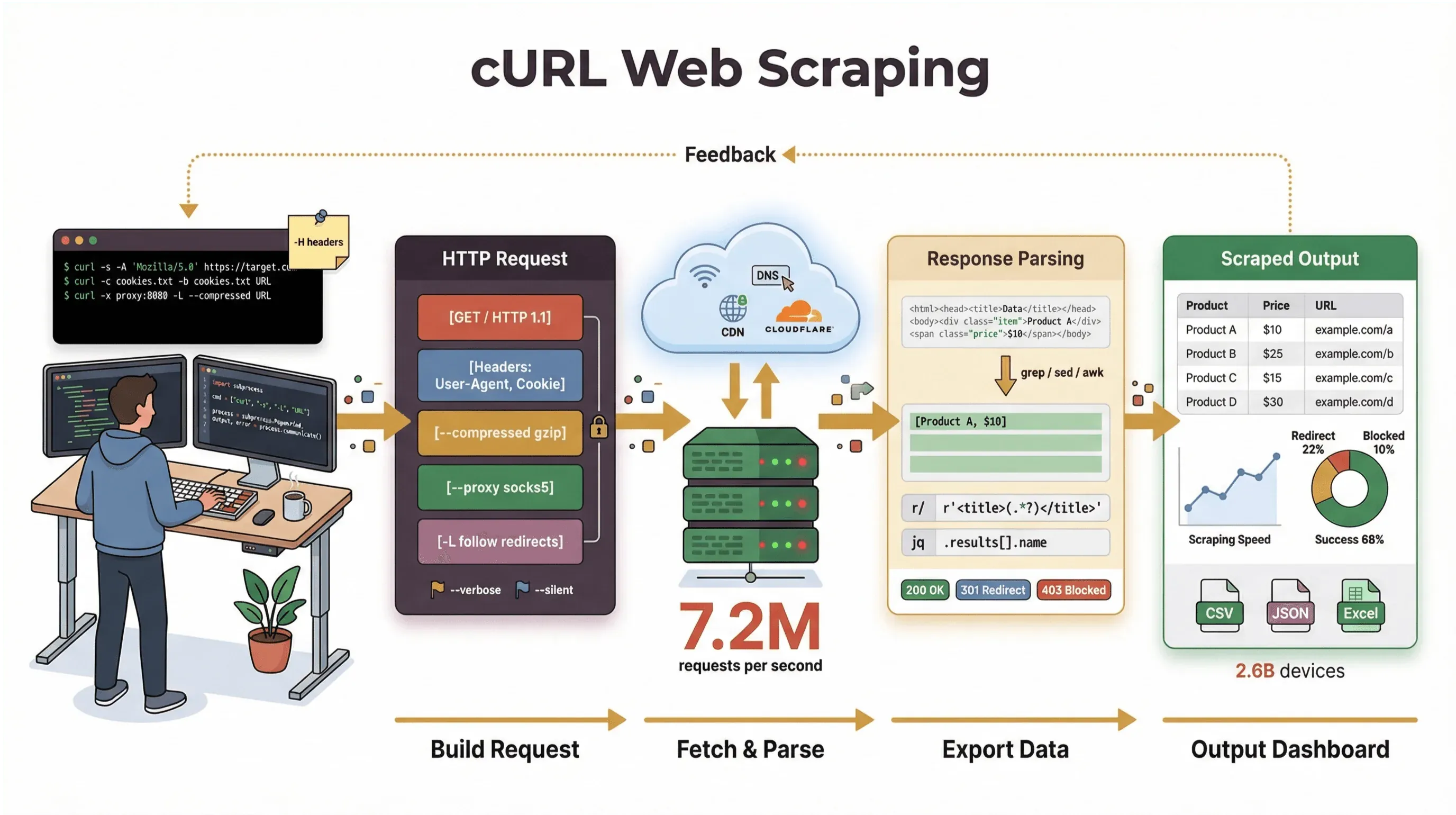

ただし、はっきりさせておきたいのは、cURLの主な役割はHTML、JSON、画像などの生データを取得することだという点です。取得したデータを解析したり、レンダリングしたり、構造化したりする機能はありません。cURLはウェブスクレイピングの「最初の一歩」と考えるとよいでしょう。バイト列は取ってきてくれますが、それを構造化データに変えるには、Pythonスクリプトや grep/sed/awk、あるいはAIウェブスクレイパーのような別のツールが必要です。

公式ドキュメントを見たい場合は、 をご覧ください。

なぜウェブスクレイピングにcURLを使うのか?(cURLウェブスクレイピングチュートリアル)

では、世の中に新しいツールがたくさんある中で、なぜ開発者や技術ユーザーは今もcURLに戻ってくるのでしょうか。cURLの強みは次の通りです。

- セットアップが最小限: インストールも依存関係も不要。ターミナルを開いてすぐ使えます。

- 高速: ブラウザの読み込みを待たずに、すぐデータを取得できます。

- スクリプト化しやすい: URLのループ処理、リクエストの自動化、コマンドの連結が簡単です。

- プロトコルと機能の対応範囲が広い: Cookie、プロキシ、リダイレクト、カスタムヘッダーなどを扱えます。

- 透明性が高い: 詳細出力やデバッグ出力で、何が起きているかを正確に確認できます。

では、回答者の85.7%がcURLのコマンドラインツールを使っていると答え、96.2%がLinux上で利用していると報告しました。Linuxは今もなお、cURLの主要プラットフォームとして圧倒的な存在です。

--- つまり、HTTPリクエスト、手早いデータ取得、トラブルシューティングのためのスイスアーミーナイフのような存在なのです。

cURLと他のスクレイピング手法を簡単に比較すると、次のようになります。

| 機能 | cURL | ブラウザ自動化(例:Selenium) | AIウェブスクレイパー(例:Thunderbit) |

|---|---|---|---|

| セットアップ時間 | 即時 | 高い | 低い |

| スクリプト化しやすさ | 高い | 中程度 | 低い(コード不要) |

| JavaScript対応 | いいえ | はい | はい(Thunderbit: ブラウザ経由) |

| Cookie/セッション対応 | 手動 | 自動 | 自動 |

| データ構造化 | 手動(後で解析) | 手動(後で解析) | AI/テンプレートベース |

| 最適な用途 | 開発者、手早い取得 | 複雑で動的なサイト | ビジネスユーザー、構造化エクスポート |

要するに、cURLは、特に静的ページやAPI、あるいはシンプルなワークフローを自動化したいときに、すばやくスクリプト化してデータを取る用途では無敵です。ただし、複雑なHTMLの解析、JavaScript対応、構造化データのエクスポートが必要になった時点で、より専門的なツールが欲しくなります。

はじめ方:cURLで行う基本的なウェブスクレイピングのコマンド例

それでは実践してみましょう。ここでは、cURLを使った基本的なウェブスクレイピングを、手順に沿って紹介します。

cURLで生のHTMLを取得する

最もシンプルな使い方は、WebページのHTMLを取得することです。

1curl https://books.toscrape.com/このコマンドは、ウェブスクレイピング用の公開デモサイトである のトップページを取得します。ターミナルには生のHTMLが表示され、<title> タグや “In stock.” のような断片が見えるはずです。

出力をファイルに保存する

後で解析するためにHTMLを保存したい場合は、-o フラグを使います。

1curl -o page.html https://books.toscrape.com/これで、完全なHTMLコンテンツを含む page.html ファイルが作成されます。後続の分析や、他のツールでの解析に最適です。

cURLでPOSTリクエストを送る

フォーム送信やAPIとのやり取りが必要ですか? POSTリクエストには -d フラグを使います。ここでは、HTTPテスト用に作られたサイト を例にします。

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"送信したデータをそのまま返すJSONレスポンスが得られます。テストや試作に便利です。

ヘッダーの確認とデバッグ

レスポンスヘッダーを確認したいときや、リクエストをデバッグしたいときもあります。

-

ヘッダーのみ取得(HEADリクエスト):

1curl -I https://books.toscrape.com/ -

本文と一緒にヘッダーも表示:

1curl -i https://httpbin.org/get -

詳細なデバッグ出力:

1curl -v https://books.toscrape.com/

これらのフラグは、内部で何が起きているかを理解するのに役立ちます。トラブルシューティングには欠かせません。

ここで、これらのコマンドを簡単に参照できる表を示します。

| タスク | コマンド例 | 補足 |

|---|---|---|

| HTMLを取得する | curl URL | HTMLをターミナルに出力 |

| ファイルに保存する | curl -o file.html URL | 出力をファイルへ書き込み |

| ヘッダーを確認する | curl -I URL または curl -i URL | -I はHEADのみ、-i は本文と一緒にヘッダーも表示 |

| フォームデータをPOSTする | curl -d "a=1&b=2" URL | フォームエンコードされたデータを送信 |

| リクエスト/レスポンスをデバッグする | curl -v URL | 詳細なリクエスト/レスポンス情報を表示 |

さらに例を見たい場合は、 を参照してください。

一歩進んだ使い方:cURLによる高度なウェブスクレイピング(cURLを使ったウェブスクレイピング)

基本に慣れたら、cURLはより複雑なスクレイピングに役立つ高度な機能もたくさん使えます。

Cookieとセッションの扱い

多くのサイトでは、ログインセッションの維持やユーザー追跡にCookieが必要です。cURLでは、Cookieを保存して次のリクエストで再利用できます。

1# ログイン後にCookieを保存

2curl -c cookies.txt https://example.com/login

3# 続くリクエストでCookieを使用

4curl -b cookies.txt https://example.com/accountこれにより、ブラウザのセッションを再現し、ログイン保護されたページにもアクセスできます(JavaScriptのチャレンジがない場合に限ります)。

User-Agentやカスタムヘッダーを偽装する

サイトによっては、User-Agentやヘッダーに応じて表示内容を変えます。cURLはデフォルトで “curl/VERSION” を名乗るため、ブロックされたり別の内容が返されたりすることがあります。ブラウザを装うには、次のようにします。

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/言語設定のようなカスタムヘッダーも指定できます。

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/これで、実際のブラウザが見るのと同じ内容を取得しやすくなります。

ウェブスクレイピングでプロキシを使う

リクエストをプロキシ経由にしたいですか? 地域テストやIPブロック回避のために使う場合は、-x フラグを指定します。

1curl -x http://proxy.example.org:4321 https://remote.example.org/ただし、プロキシは責任を持って使い、サイトの利用規約を守るようにしてください。

複数ページのスクレイピングを自動化する

商品一覧のページネーションのように、複数ページを取得したい場合は、シンプルなシェルループが使えます。

1for p in $(seq 2 5); do

2 curl -s -o "books-page-$\{p\}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-$\{p\}.html"

4 sleep 1

5doneこの例では、Books to Scrape のカタログの2〜5ページ目を取得し、それぞれ別ファイルに保存します。(1ページ目はトップページです。)

cURLを使ったウェブスクレイピングの限界:知っておくべきこと

cURLは大好きですが、万能ではありません。弱点は次の通りです。

- JavaScriptを実行できない: JavaScriptで内容を描画したり、ボット対策チャレンジを解いたりする必要があるページには対応できません()。

- 手動での解析が必要: 取得できるのは生のHTMLやJSONであり、解析は自分で行う必要があります。多くの場合、追加のスクリプトやツールが要ります。

- セッション管理が限定的: 複雑なログイン、トークン、多段階フォームの扱いはすぐに煩雑になります。

- データ構造化機能がない: Webページを行、表、スプレッドシートに変換する機能はありません。

- ボット検知に弱い: 多くのサイトでは、JavaScript、フィンガープリンティング、CAPTCHAといった高度なボット対策が使われており、cURLだけでは回避できません()。

簡単な比較表はこちらです。

| 制約 | cURLだけの場合 | 最新のスクレイピングツール(例:Thunderbit) |

|---|---|---|

| JavaScript対応 | いいえ | はい |

| データ構造化 | 手動 | 自動(AI/テンプレート) |

| セッション管理 | 手動 | 自動 |

| ボット対策の回避 | 限定的 | 高度(ブラウザベース/AI) |

| 使いやすさ | 技術者向け | 非技術者向け |

静的ページやAPIには、cURLは非常に優秀です。ただし、より動的なサイトや保護の強いサイトを扱うなら、ツールチェーンを次の段階へ進める必要があります。

ThunderbitとcURL:非技術ユーザーに最適なウェブスクレイピングの選択肢

ここで の話をしましょう。Thunderbit は、AI搭載のウェブスクレイパーChrome拡張機能です。営業担当、マーケター、オペレーション担当など、コマンドラインを触らずにWebサイトからExcel、Google Sheets、Notionへデータを取り出したい人のために作られています。

ThunderbitとcURLの比較は次の通りです。

| 機能 | cURL | Thunderbit |

|---|---|---|

| ユーザーインターフェース | コマンドライン | ポイント&クリック(Chrome拡張機能) |

| AIによる項目提案 | いいえ | はい(AIがページを読み取り、列を提案) |

| ページネーション/サブページ対応 | 手動スクリプト | 自動(AIが検出してスクレイピング) |

| データエクスポート | 手動(解析+保存) | Excel、Google Sheets、Notion、Airtableへ直接出力 |

| JavaScript/保護ページ | いいえ | はい(ブラウザベースのスクレイピング) |

| ノーコード不要 | いいえ(スクリプトが必要) | はい(誰でも使える) |

| 無料プラン | 常に無料 | 6ページまで無料(トライアル増量で10ページ) |

Thunderbitでは、拡張機能を開いて「AIで項目を提案」をクリックするだけで、AIが何を抽出すべきかを判断します。表、リスト、商品詳細はもちろん、サブページまで自動で巡回できます。その後は、データをお気に入りの業務ツールへ直接エクスポート。解析も手間も不要です。

Thunderbitは世界中で に利用されており、特に営業、EC、不動産チームのように、素早く構造化データを必要とする人たちから支持されています。

試してみたいですか? できます。

cURLとThunderbitを組み合わせる:柔軟なウェブスクレイピング戦略

技術ユーザーなら、どちらか1つに絞る必要はありません。実際、多くのチームは最大限の柔軟性を得るために、cURLとThunderbitを併用しています。

- cURLで試作する: エンドポイントをすばやくテストし、ヘッダーを確認し、サイトの応答を理解するのに使えます。

- Thunderbitでスケールする: 構造化データが必要なとき、複数ページのスクレイピングが必要なとき、繰り返し使えるワークフローが欲しいときは、Thunderbitのポイント&クリック抽出と直接エクスポートに切り替えましょう。

市場調査向けのワークフロー例を紹介します。

- cURLで数ページを取得し、HTML構造を確認する。

- 欲しいデータ項目(例:商品名、価格、レビュー)を特定する。

- Thunderbitを開き、「AIで項目を提案」をクリックして、AIにスクレイパーを組ませる。

- すべてのページ(サブページやページネーション付き一覧を含む)をスクレイピングし、Google Sheetsへエクスポートする。

- データを分析し、共有し、活用する。手動解析は不要です。

簡単な意思決定表はこちらです。

| シナリオ | cURLを使う | Thunderbitを使う | 両方使う |

|---|---|---|---|

| APIや静的ページをすばやく取得 | ✅ | ||

| スプレッドシート用の構造化データが必要 | ✅ | ||

| ヘッダーやCookieのデバッグ | ✅ | ||

| 動的/JavaScript主体のページをスクレイピング | ✅ | ||

| 繰り返し使えるノーコードのワークフローを作る | ✅ | ||

| 試作してからスケールアップする | ✅ | ✅ | ハイブリッド運用 |

cURLでのウェブスクレイピングでよくある課題と落とし穴

cURLを使いこなす前に、実際にぶつかりやすい課題を見ておきましょう。

- ボット対策: 多くのサイトでは、JavaScriptチャレンジ、CAPTCHA、フィンガープリンティングなどの高度な防御が使われており、cURLでは回避できません()。

- データ品質の問題: HTMLの変更、欠損フィールド、レイアウトの不整合によって、スクリプトが壊れることがあります。

- 保守コスト: サイトが変わるたびに、解析ロジックの更新が必要になります。

- 法務・コンプライアンス上のリスク: スクレイピングを行う前に、必ずサイトの利用規約、robots.txt、関連法規を確認してください。公開データだからといって、自由に使ってよいとは限りません(、)。

- スケーリングの限界: cURLは小規模な処理には優れていますが、大規模スクレイピングでは、プロキシ、レート制限、エラーハンドリングの管理が必要になります。

トラブルシューティングとコンプライアンス遵守のコツ:

- まずは、許可のあるサイトやデモサイト( など)から始める。

- レート制限を尊重し、エンドポイントを叩きすぎない。

- 法的根拠がない限り、個人データのスクレイピングは避ける。

- JavaScriptやCAPTCHAの壁にぶつかったら、Thunderbitのようなブラウザベースのツールへの切り替えを検討する。

ステップ・バイ・ステップ要約:cURLでウェブサイトをスクレイピングする方法

cURLを使ったウェブスクレイピングのための、すぐ使えるチェックリストはこちらです。

- 対象URLを特定する: 静的ページかAPIエンドポイントから始める。

- ページを取得する:

curl URL - 出力をファイルに保存する:

curl -o file.html URL - ヘッダーを確認/デバッグする:

curl -I URL,curl -v URL - POSTデータを送る:

curl -d "a=1&b=2" URL - Cookie/セッションを扱う:

curl -c cookies.txt ...,curl -b cookies.txt ... - カスタムヘッダー/User-Agentを設定する:

curl -A "..." -H "..." URL - リダイレクトに追従する:

curl -L URL - 必要ならプロキシを使う:

curl -x proxy:port URL - 複数ページのスクレイピングを自動化する: シェルループやスクリプトを使う。

- データを解析して構造化する: 必要に応じて追加のツールやスクリプトを使う。

- 構造化されたノーコードのスクレイピングや動的ページにはThunderbitへ切り替える。

結論と重要ポイント:最適なウェブスクレイピングツールの選び方

cURLを使ったウェブスクレイピングは、2026年の技術ユーザーにとって今なお強力なスキルです。特に、手早いデータ取得、試作、自動化に向いています。cURLの速さ、スクリプト化のしやすさ、普及率の高さは、あらゆる開発者のツールボックスに欠かせない存在です。しかし、Webがより動的かつ保護の強いものになり、ビジネスユーザーがコードなしで構造化データを求めるようになるにつれて、 のようなツールが、できることの定義を塗り替えています。

重要ポイント:

- 静的ページ、API、素早い試作にはcURLを使いましょう。特に、完全な制御が必要なときに向いています。

- 構造化データが必要なとき、動的/JavaScript主体のページを扱うとき、ノーコードでビジネス向けのワークフローが欲しいときは、Thunderbit(または同様のAIウェブスクレイパー)に切り替えましょう。

- 最大限の柔軟性を得るには両方を組み合わせましょう。cURLで試作し、Thunderbitで拡張・構造化します。

- いつでも責任あるスクレイピングを。サイトの規約、レート制限、法的な境界線を尊重してください。

ウェブスクレイピングがどれほど簡単になりうるか、気になりませんか? ことで、AIによるデータ抽出をぜひ体験してください。さらに深く知りたい方は、 で、より多くのチュートリアル、ヒント、業界インサイトをご覧ください。こちらの記事もおすすめです。

スクレイピングを楽しんでください。そして、あなたのデータがいつでもきれいで、構造化され、コマンド1つ(あるいはクリック1つ)で手に入るものでありますように。

よくある質問

1. cURLはJavaScriptでレンダリングされたWebページに対応できますか?

いいえ、cURLはJavaScriptを実行できません。サーバーから返された生のHTMLを取得するだけです。ページの内容を描画したり、ボット対策チャレンジを解いたりするのにJavaScriptが必要な場合、cURLではそのデータにアクセスできません。そうしたケースでは、 のようなブラウザベースのツールを使ってください。

2. cURLの出力を直接ファイルに保存するにはどうすればよいですか?

-o フラグを使います:curl -o filename.html URL。これにより、レスポンス本文がターミナルに表示される代わりにファイルへ書き込まれます。

3. ウェブスクレイピングにおけるcURLとThunderbitの違いは何ですか?

cURLは、生のWebデータを取得するためのコマンドラインツールです。技術ユーザーや自動化に向いています。Thunderbitは、どんなWebサイトからでも構造化データを抽出し、動的ページにも対応し、ExcelやGoogle Sheetsのようなツールへ直接エクスポートしたいビジネスユーザー向けに設計されたAI搭載のChrome拡張機能です。コードは不要です。

4. cURLでWebサイトをスクレイピングするのは合法ですか?

公開データのスクレイピングは、近年の判例を踏まえると、米国では一般に合法とされています。ただし、必ずウェブサイトの利用規約、robots.txt、関連法規を確認してください。個人データや保護対象データは許可なく取得せず、レート制限と倫理的なガイドラインも守りましょう(、)。

5. cURLからThunderbitのような高度なツールに切り替えるべきタイミングはいつですか?

動的/JavaScript主体のページをスクレイピングしたいとき、スプレッドシート用の構造化データが欲しいとき、またはノーコードのワークフローを好むときは、Thunderbitの方が適しています。cURLは手早く技術的な作業に使い、Thunderbitはビジネス向けで再利用しやすいデータ抽出に使いましょう。

さらにウェブスクレイピングのコツやチュートリアルを知りたい方は、 や をご覧ください。