画像は至るところにあります。商品ギャラリー、不動産一覧、競合カタログなど、あらゆる場所に出てきます。営業、マーケティング、リサーチに携わっているなら、Webサイトから何十枚、何百枚もの画像を集める必要があったはずです。

500枚の画像を1枚ずつ右クリックして保存したい人はいません。だからこそ、画像スクレイパーツールが必要なのです。

私は、ブラウザ拡張機能からPythonライブラリまで、で10種類を検証しました。用途ごとに、どれが最も使いやすいかを紹介します。

2026年に画像スクレイパーが必要な理由

ビジュアルコンテンツは、見た目が華やかなだけではありません。ビジネスの意思決定に役立つ情報源でもあります。画像付きの投稿は閲覧数が最大うえ、ビジュアルを追加するとSNSのエンゲージメントはまで伸びることがあります。企業が画像をスクレイピングする目的は、競合カタログのトレンド把握といった市場調査から、商品写真の収集などのコンテンツ制作、さらにはラベル付き写真を使うAI学習までさまざまです。

ただし、ここが厄介です。Webサイトはますます複雑になっています。画像が動的に読み込まれたり、無限スクロールの奥に隠れていたり、サブページに散らばっていたりします。手動ダウンロードは遅く、ミスも起きやすく、正直かなり消耗します。しかも、非技術系のチームにとって、独自クローラーを組むのはほぼロケット工学みたいなものです。

そこで登場するのが、最新の画像スクレイパーツールです。面倒な作業を自動化し、複雑なサイトにも対応し、しかも「Excelしか使わない」同僚でも画像を大量に集められます。ウェブスクレイピングソフトウェア市場は急成長しており、と予測されています。さらに、がすでにビジネス分析にウェブスクレイピングを活用しています。要するに、画像スクレイパーを使っていないなら、もう出遅れているということです。

最適な画像スクレイパーツールの選び方

画像スクレイパーはどれも同じではありません。トップ10を選ぶ際に重視したのは次の点です。

- 使いやすさ:非エンジニアでも数分で結果を出せるか。自然言語操作、クリック操作のUI、即時フィードバックは大きな強みです。

- エクスポート形式:画像やURLをExcel、Google Sheets、Notion、またはAPI経由で出力できるか。ビジネスのワークフローでは連携性が重要です。

- カスタマイズ性と柔軟性:ログイン、動的コンテンツ、独自の抽出ロジックに対応できるか。上級者には「保存する」だけでは足りません。

- 自動化とスケジュール実行:設定したら放置できるか。定期実行やクラウド処理は、繰り返し作業の大きな助けになります。

- 拡張性:1万枚の画像でも耐えられるか。小規模案件から大規模案件までこなせる必要があります。

- 価格とコストパフォーマンス:無料プランはあるか。料金は小規模チームに見合うか、それともエンタープライズ向けなのか。

以上を踏まえて、2026年に検討すべき画像スクレイパーツールのトップ10を紹介します。それぞれに強み、クセ、最適な用途があります。

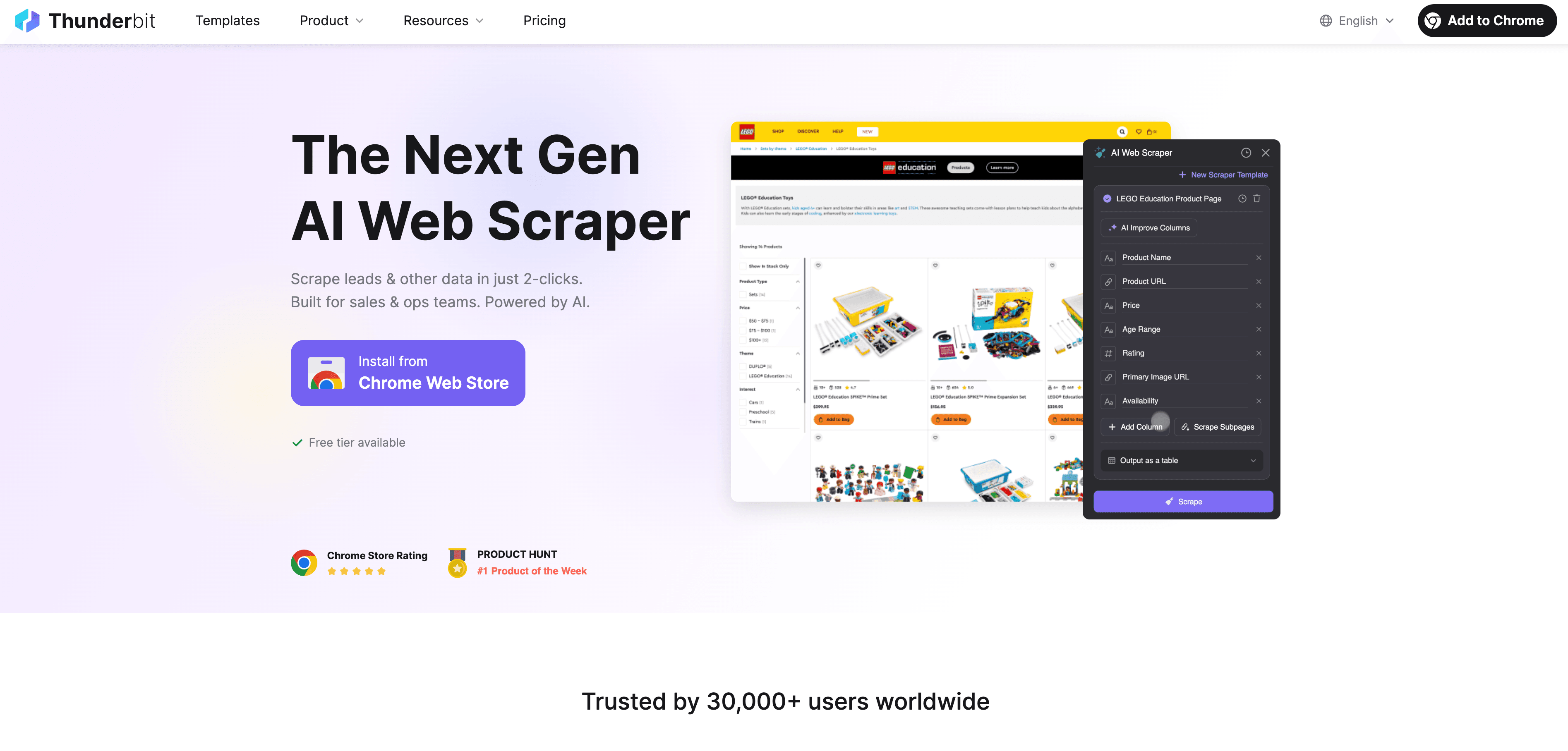

1. Thunderbit

は、非技術系チームや、できるだけ手間をかけずに画像を抽出したい人にとっての第一候補です。共同創業者として少しひいき目はありますが、私たちの使命は、画像スクレイピングをおばあちゃんでもできるくらい簡単にすることでした(競合分析に興味がある前提ですが)。

Thunderbitの強みは何か? とにかくシンプルです。「AIで項目を提案」をクリックし、AIにすべての画像(ほかに必要なデータも)を検出させたら、「スクレイプ」を押すだけ。Thunderbitは自動でサブページを巡回し、無限スクロールにも対応し、画像をExcel、Google Sheets、Airtable、Notionへ直接エクスポートできます。さらに、無料のを使えば、ページ上のすべての画像をワンクリックで抽出できます。設定不要、コード不要です。

主な機能:

- 2クリックで画像抽出(面倒な処理はAIが担当)

- サブページスクレイピング(詳細ページの画像も自動取得)

- 無料の画像/メール/電話番号抽出機能

- Sheets、Notion、Airtable、Excel、CSV、JSONへ即時エクスポート

- 無料プランあり(6ページ、行数無制限)、有料プランは月額15ドルから

- 多言語対応(34言語)

- 保守不要。AIがサイト変更に追従

最適な用途: コーディングや初期設定なしで、高速かつ正確な画像データを求める営業、マーケティング、オペレーションチーム。競合商品のカタログ化、不動産写真の収集、コンテンツライブラリの構築に最適です。

Thunderbitの実力をもっと知りたい方は、をご覧ください。

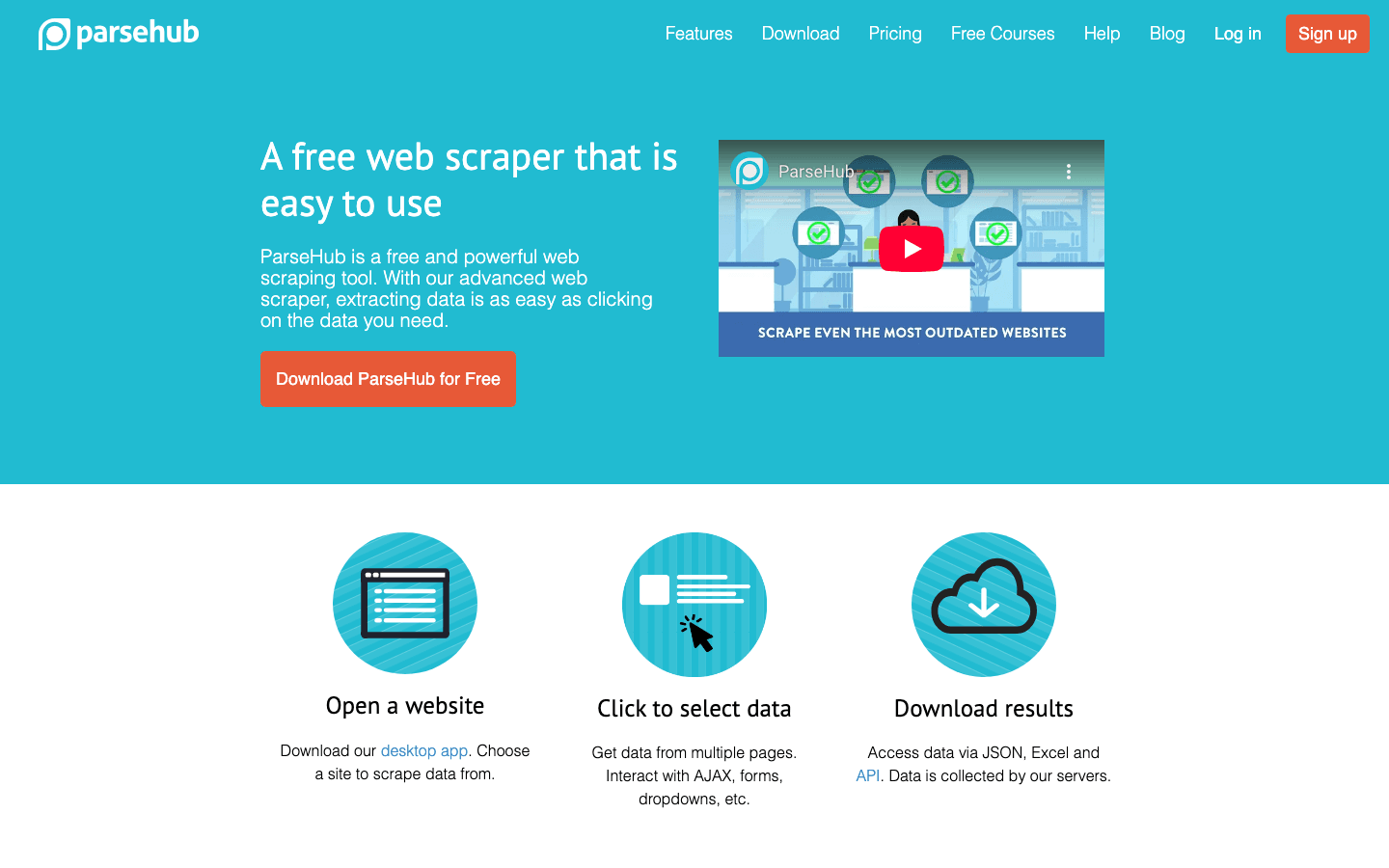

2. ParseHub

は、無限スクロール、AJAXで読み込まれるギャラリー、フィルターやポップアップをクリックして進む必要があるサイトなど、複雑で動的なWebサイトから画像をスクレイピングしたい人向けの強力なツールです。

ParseHubが優れている理由: ビジュアルなワークフローエディタで、コードを書かずに複数ステップのスクレイピングロジックを組めます。条件分岐、ループ、変数まで追加できるので、厄介なサイトにも対応可能です。フォーム操作、ボタンクリック、特定の操作後にだけ表示される画像の抽出もできます。

主な機能:

- 高度なロジックを備えたビジュアルエディタ(条件分岐、ループ)

- JavaScriptが多用された動的コンテンツに対応

- クラウドでのスケジュール実行とAPIアクセス

- ブロック回避のための自動IPローテーション

- CSV、JSONへのエクスポート、Tableau連携

最適な用途: 複雑なサイトを扱い、コードなしで細かく制御したいデータアナリスト、ジャーナリスト、リサーチャー。無料プランは1回あたり最大200ページまでですが、クラウド処理や大量実行が必要な上級者には月額189ドルのプランがおすすめです。

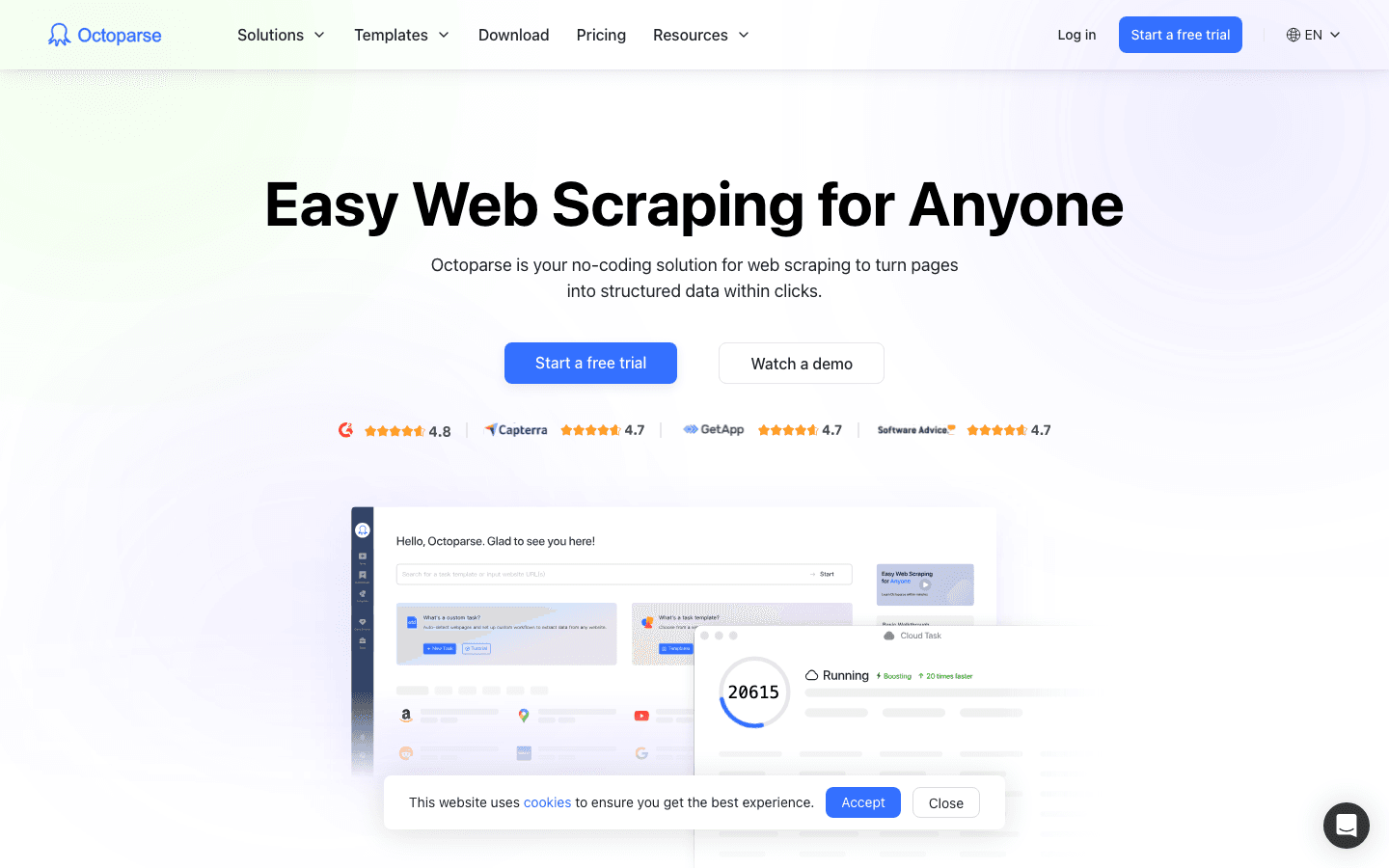

3. Octoparse

は、大量の画像抽出に強いノーコードの定番です。スプレッドシートのようなUIと自動検出機能のおかげで、非技術系ユーザーにも非常に親しみやすいです。

Octoparseが人気な理由: 画像やリストをクリックするだけで、何を抽出すべきかをAIが提案してくれます。ページネーション、無限スクロール、ログイン必須ページの処理にも特に強いです。有料プランではクラウドスクレイピングとスケジュール実行が使え、大きな処理でも自分のPCを塞がずに実行できます。

主な機能:

- ノーコードのクリック操作で設定

- リストと画像を自動検出

- ページネーション、無限スクロール、ログインに対応

- クラウドスクレイピングとスケジュール実行

- CSV、Excel、JSON、データベースへエクスポート

最適な用途: 画像を素早く大量に抽出したいマーケティングチーム、中小企業、コーディング不要で使いたい人。小規模作業向けの無料プランがあり、有料プランは月額119ドルからです。

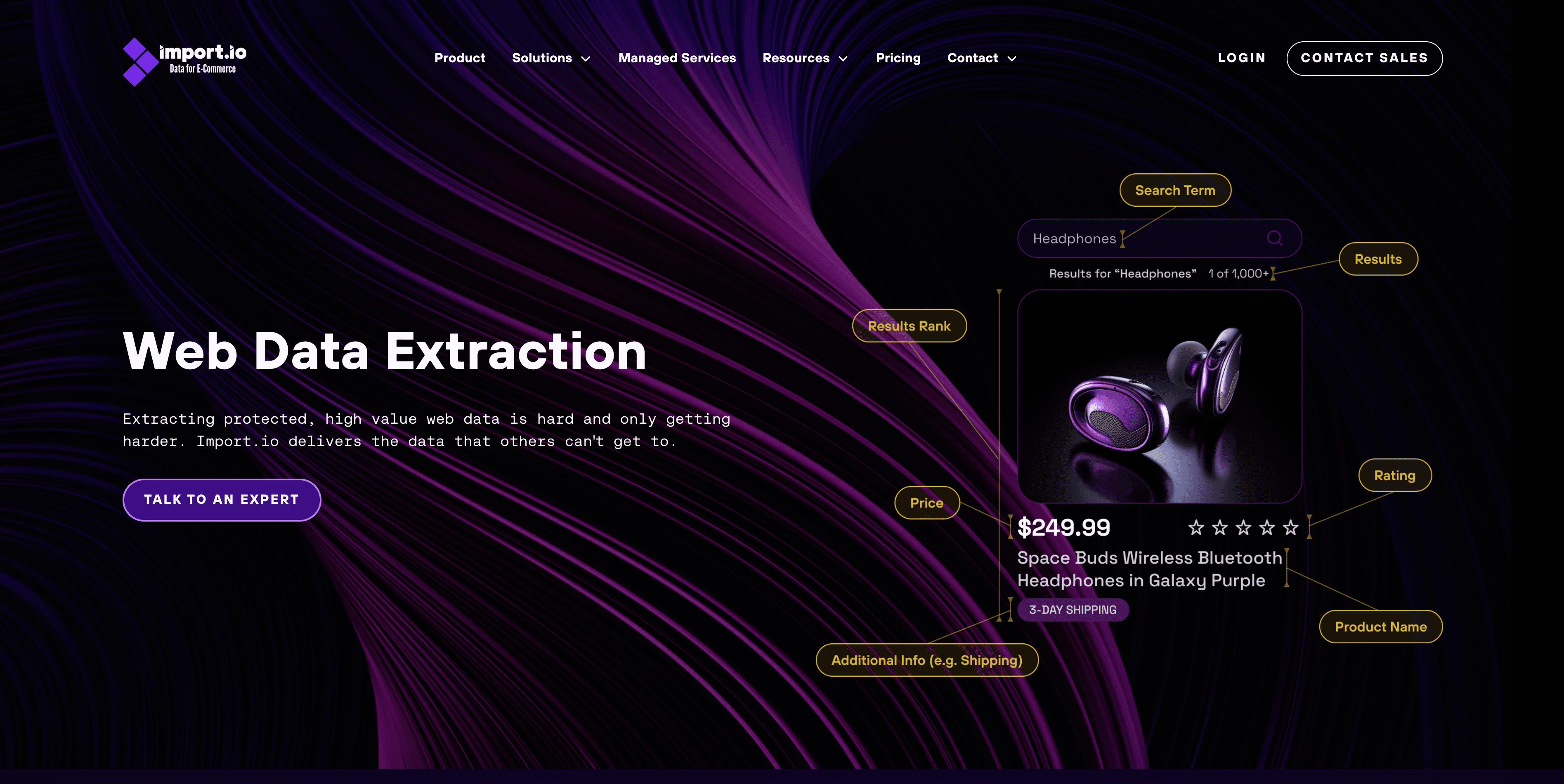

4.

は、エンタープライズ向けのデータ抽出プラットフォームで、強力な画像スクレイパーとしても使えます。対話型インターフェースで、ログイン、フィルタリング、ギャラリー操作などのワークフローを記録し、クラウド上で大規模に実行できます。

の特長: 連携を前提に作られており、抽出した画像やデータをAPIやWebhook経由で分析ダッシュボード、BIツール、データベースへ直接流し込めます。は、保護されたコンテンツや動的コンテンツの処理にも強いです。

主な機能:

- 対話型のワークフロー記録機能

- ログイン、動的コンテンツ、保護ページに対応

- 分析ワークフロー向けのAPI/Webhook連携

- エンタープライズ向けのマネージドサービス

最適な用途: 画像抽出を大きなデータパイプラインの一部として安定運用したい中堅〜大企業。料金は月額299ドル前後からで、無料トライアルもあります。

5. Apify

は、開発者向けの自動化プラットフォームです。すぐに使える「Actors」(事前構築済みスクレイパー)のマーケットプレイスがあり、Node.jsやPythonで自作することもできます。

Apifyが柔軟な理由: InstagramやAmazonのような定番サイト向けのActorを見つけることも、自分でカスタムスクレイパーを作ることもできます。クラウド基盤がスケジュール実行、プロキシ管理、スケール処理を担うため、何千ページもの同時スクレイピングも可能です。

主な機能:

- Actorマーケットプレイス(人気サイト向けの事前構築済みスクレイパー)

- Node.js/Pythonでのカスタムスクリプト

- クラウドでのスケジュール実行と保存

- 堅牢なAPI連携

最適な用途: プログラム可能で拡張性の高いスクレイピングを求める開発者、スタートアップ、データエンジニア。軽い利用向けの無料プランがあり、有料プランは月額49ドルからです。

6. Mozenda

は、画像、ファイル、PDFを含む構造化データ抽出に特化したエンタープライズ級ソリューションです。クリック中心のUIは扱いやすく、真価は自動化、スケジュール実行、チーム管理にあります。

Mozendaがエンタープライズ向けである理由: 信頼性を重視して作られており、堅牢なスケジュール設定、通知、ワークフロー自動化が可能です。Mozendaは複数ソースのデータを統合でき、さまざまな形式でエクスポートできるうえ、機密性の高い案件ではオンプレミス運用にも対応しています。

主な機能:

- ビジュアルなエージェント作成(コーディング不要)

- 複雑なサイト、多階層データ、画像に対応

- スケジュール設定、通知、ワークフロー自動化

- チームコラボレーションとマネージドサービス

最適な用途: 継続的で重要度の高いスクレイピングを必要とする大規模組織やチーム。料金は月額99ドル前後からで、エンタープライズ向けの個別プランもあります。

7. VisualScraper

は、手早い画像スクレイピング向けの軽量で使いやすいツールです。UIはシンプルで、クリックして抽出するだけです。

VisualScraperが便利な理由: 小規模案件や単発プロジェクトに最適です。タスクのスケジュール設定、CSV/JSON/XMLへのエクスポート、メールやFTPでの結果受け取りもできます。大手ツールほど高機能ではありませんが、基本的な用途ならこのシンプルさは非常に魅力的です(しかも価格も手頃で、多くのユーザーは無料で使えます)。

主な機能:

- シンプルなクリック操作のUI

- リアルタイムのデータプレビュー

- スケジュール実行と複数形式へのエクスポート

- 小規模案件向けの無料Windowsアプリ

最適な用途: たまに画像をスクレイピングしたい個人、趣味で使う人、小規模事業者。学習コストをかけずに使えます。

8. WebHarvy

は、パターン検出の賢さで知られるWindows向けのビジュアルスクレイパーです。1枚の画像をクリックすると、ページ上の似た画像をすべて自動で見つけて抽出してくれます。

WebHarvyが賢い理由: 多段階スクレイピングに対応でき、商品詳細ページからギャラリー画像を取得するような作業も可能です。フォーム入力、ボタンクリック、難しいサイト向けのカスタムJavaScript実行もできます。買い切り型なので、毎月の費用がかかりません。

主な機能:

- 高度なパターン認識

- 多段階・ギャラリー画像のスクレイピング

- Excel、CSV、JSON、SQLへエクスポート

- 買い切りライセンス(サブスクなし)

最適な用途: 使いやすさと高度な機能の両方を求める非プログラマー、特にWindowsユーザー。研究者や小規模ビジネスに向いています。

9. Diffbot

は、Webデータ抽出におけるAIの頭脳のような存在です。URLを1つでも100万個でも与えれば、コンピュータービジョンとNLPが主要画像をすべて判別して抽出します。ルールやセレクターは不要です。

Diffbotが独特な理由: APIファーストで、非常に高い拡張性を持ち、サイト変更にも強いです(AIが自動で適応します)。DiffbotのKnowledge Graphを使えば、Web全体の画像や構造化データを横断検索することもできます。

主な機能:

- AI駆動の抽出(設定不要)

- API経由で数百万ページに対応

- 画像URL、メタデータ、タグを返却

- Web全体を対象に検索できるKnowledge Graph

最適な用途: 大量の画像データセットを保守なしで使いたい企業、AI企業、データプロバイダー。月10,000回のAPIコールまで無料で、料金は月額299ドルから。利用にはある程度のコーディングが必要です。

10. Scrapy

は、カスタムWebスクレイピング向けのオープンソースPythonフレームワークです。開発者であれば、Scrapyを使って完全に自由に制御できます。スパイダーを書いて任意のサイトをクロールし、画像を抽出し、好きな形で処理できます。

Scrapyが強力な理由: 標準搭載のImages Pipelineで、画像のダウンロード、サムネイル作成、サイズや形式によるフィルタリングを自動化できます。Scrapyは高速で拡張性が高く、プロキシ、クラウドクロールなどの拡張機能エコシステムも豊富です。

主な機能:

- コードファーストで究極の柔軟性

- 非同期で高速なクロール

- 画像のダウンロードと処理を標準搭載

- 無料かつオープンソース

最適な用途: カスタム要件や大規模処理を必要とする開発者、技術チーム。必要なコストは時間とサーバーリソースだけです。

画像スクレイパーツール比較表

| ツール | 使いやすさ | 出力形式 | 自動化/スケジュール | 最適な用途 | 価格(概算) |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Excel、Sheets、Notion | あり | 非技術系チーム、中小企業 | 無料、月額15ドル〜 |

| ParseHub | ★★★★☆ | CSV、JSON、Tableau | あり(クラウド) | アナリスト、複雑なサイト | 無料、月額189ドル〜 |

| Octoparse | ★★★★☆ | CSV、Excel、JSON | あり(クラウド) | ノーコード利用者、大量抽出 | 無料、月額119ドル〜 |

| Import.io | ★★★★☆ | API、CSV、DB | あり(クラウド) | エンタープライズ、BI連携 | 月額299ドル〜 |

| Apify | ★★★☆☆ | JSON、CSV、API | あり(クラウド) | 開発者、拡張性の高い案件 | 無料、月額49ドル〜 |

| Mozenda | ★★★★☆ | CSV、Excel、API、DB | あり | エンタープライズ、チーム運用 | 月額99ドル〜 |

| VisualScraper | ★★★★☆ | CSV、JSON、XML、メール | あり | 個人、小規模プロジェクト | 無料、月額49ドル〜(クラウド) |

| WebHarvy | ★★★★☆ | Excel、CSV、JSON、SQL | あり | ノーコード利用者、Windowsユーザー | 買い切り99ドル |

| Diffbot | ★★★☆☆ | API(JSON、メタデータ) | あり(API) | エンタープライズ、AI、開発者 | 無料、月額299ドル〜 |

| Scrapy | ★★★☆☆ | 何でも可(カスタムコード) | あり(カスタム) | 開発者、カスタムパイプライン | 無料 |

ビジネスに最適な画像スクレイパーの選び方

簡単な選び方の目安はこちらです。

- 非技術系で、とにかく速さとシンプルさを重視したい? かから始めましょう。

- 複雑で動的なサイトをスクレイピングしたい? やを試してみてください。

- エンタープライズ向けで、連携とサポートが必要? 、、を検討しましょう。

- 開発者で、完全な制御がほしい? かが有力です。

- 小規模案件向けに、無料ですぐ使えるツールが欲しい? が堅実な選択です。

無料トライアルや無料プランはぜひ活用してください。対象サイトで小さく試してみて、自分のワークフローやデータ要件に合うツールを見極めましょう。

まとめ:2026年に最適な画像スクレイパーを見つけよう

Web上の“ビジュアルの宝庫”は、適切な画像スクレイパーさえあれば、すぐに活用できます。商品カタログを作るときも、競合を追跡するときも、次のバズ施策を支えるときも、こうしたツールは何時間もの作業とちょっとしたストレスを減らしてくれます。私からのアドバイスは、まず実際の用途を起点にして、自分のスキルと予算に合うツールを選び、遠慮せずに試してみることです。

画像抽出がどれだけ簡単になるのかを体験したいなら、して、ぜひ使ってみてください。Ctrl+Sを押す手間が、きっと軽くなります。

スクレイピングについてさらに深掘りしたい方は、もご覧ください。

よくある質問

1. 画像スクレイパーツールとは何ですか?どのように動作しますか?

画像スクレイパーツールは、Webサイトから画像(またはそのURL)を抽出する作業を自動化するツールです。多くのツールでは、AI、クリック操作、コードなどで抽出対象を指定し、その後、画像をまとめて収集・エクスポートできます。手作業の時間を大幅に節約できます。

2. コーディングスキルがなくても画像スクレイパーツールは使えますか?

もちろんです。、、のようなツールは、非技術系ユーザー向けに設計されており、自然言語操作やビジュアルUIで使えます。

3. 無料の画像スクレイパーツールと有料ツールの違いは何ですか?

無料ツールは小規模でたまに使う作業には向いていますが、件数、機能、サポートに制限がある場合があります。有料ツールは自動化、クラウド処理、高度な機能が充実しており、ビジネスやエンタープライズ用途に最適です。

4. 画像をExcel、Google Sheets、Notionに出力するにはどうすればいいですか?

多くの最新スクレイパー(など)では、結果をワンクリックでExcel、Sheets、Notion、Airtableへ直接エクスポートできます。ほかにも、CSV/JSONのダウンロードやAPI連携で、独自のワークフローに組み込めるものがあります。

5. どのWebサイトからでも画像をスクレイピングするのは合法ですか?

必ずWebサイトの利用規約と著作権法を守ってください。公開されている画像だけを対象にし、許可なくスクレイピングしたコンテンツを商用利用しないようにしましょう。迷う場合は、法律の専門家に相談するか、社内分析のみに使うのが安全です。

画像抽出をあなたのワークフローで一番簡単な作業にしたいですか? このリストからいくつか試してみて、しっくりくるものを見つけてください。次の大きなプロジェクトは、ほんの少しスクレイピングするだけで始められるかもしれません。

詳しく見る: