ウェブにはデータがあふれています。2025年には、なんとと見込まれています。営業、EC、オペレーション、リサーチに携わっているなら、この混沌を実用的な形に変える大変さはよくご存じでしょう。手作業のコピペ? もうやめましょう。遅いし、ミスも起きやすいし、乾いたペンキを眺めるくらい退屈です。だからこそ、今、AIを使ってウェブデータの抽出を自動化し、これまで数週間かかっていた作業を数分で終わらせています。

私はSaaSと自動化の分野で長年仕事をしてきましたが、適切なAI搭載のウェブスクレイピングツールが生産性を大きく引き上げるのを何度も見てきました。ただ、選択肢が多すぎると、何を基準に自分に合うツールを選べばいいのでしょうか。ここでは、AIを使って効率よくサイトをスクレイピングできる注目の10ツールを、クリック操作中心のChrome拡張から大規模なエンタープライズ向けクラウドプラットフォームまで、分かりやすく整理します。

なぜAIでサイトをスクレイピングするのか? 新しい可能性を開く

従来のウェブスクレイパーは、昔ながらのGPS端末のようなものです。少し道が変わっただけで迷ってしまう、あのタイプです。固定ルールやセレクタに依存しているため、サイトのレイアウトが更新されるたびに壊れてしまいます。一方、AI搭載のスクレイパーは機械学習と自然言語処理を使ってパターンを認識し、変化に適応し、さらには普通の英語で書いた説明だけで何をしたいのかまで理解できます()。

AIがもたらす価値は次のとおりです。

- スピード: AIスクレイパーなら、何週間もかかる手作業の調査を数分の自動抽出に変えられます()。

- 精度: コンピュータービジョンとNLPを使って、たとえば商品名と説明文を見分けるので、データがよりきれいで信頼性も高くなります。

- 耐障害性: サイトが変わってもAIが追従するので、頻繁なメンテナンスは不要です。

- 使いやすさ: 非技術系のユーザーでも、欲しいものを言葉で説明するだけでデータを抽出できるため、リード獲得、価格監視、市場調査といった用途が誰でも使えるようになります。

- コスト削減: チームはと報告しており、手作業も大幅に減らせます。

要するに、AIでサイトをスクレイピングすれば、正規表現の博士号も、すぐ連絡が取れる開発者もなくても、より速く、より信頼できるデータを手に入れられます。

AIでサイトをスクレイピングするための最適なツールをどう選んだか

市場には本当に多くのツールがあるので、上位10製品を選ぶにあたって、次の基準を見ました。

- 使いやすさ: 非コーダーでもすぐに価値を出せるか。ビジュアルUIや自然言語対応はあるか。

- AI機能: フィールド検出、レイアウト変化への適応、自然言語指示の理解にAIを使っているか。

- 機能セット: ページネーション、スケジューリング、プロキシ管理、CAPTCHA解決、出力形式に対応しているか。

- 拡張性: 数ページから数百万ページまで対応できるか。クラウド版はあるか。

- 価格と導入しやすさ: 無料プランはあるか。個人、中小企業、エンタープライズでも手が届くか。

- サポートとコミュニティ: ドキュメントは充実しているか、サポートは迅速か、ユーザーコミュニティは活発か。

- 評判: 実際のユーザーレビュー、導入事例、信頼性の実績があるか。

ブラウザ拡張、デスクトップアプリ、クラウドプラットフォーム、開発者向けフレームワークをバランスよく入れているので、個人起業家でも、データアナリストでも、エンタープライズチームでも、きっと合うものが見つかるはずです。

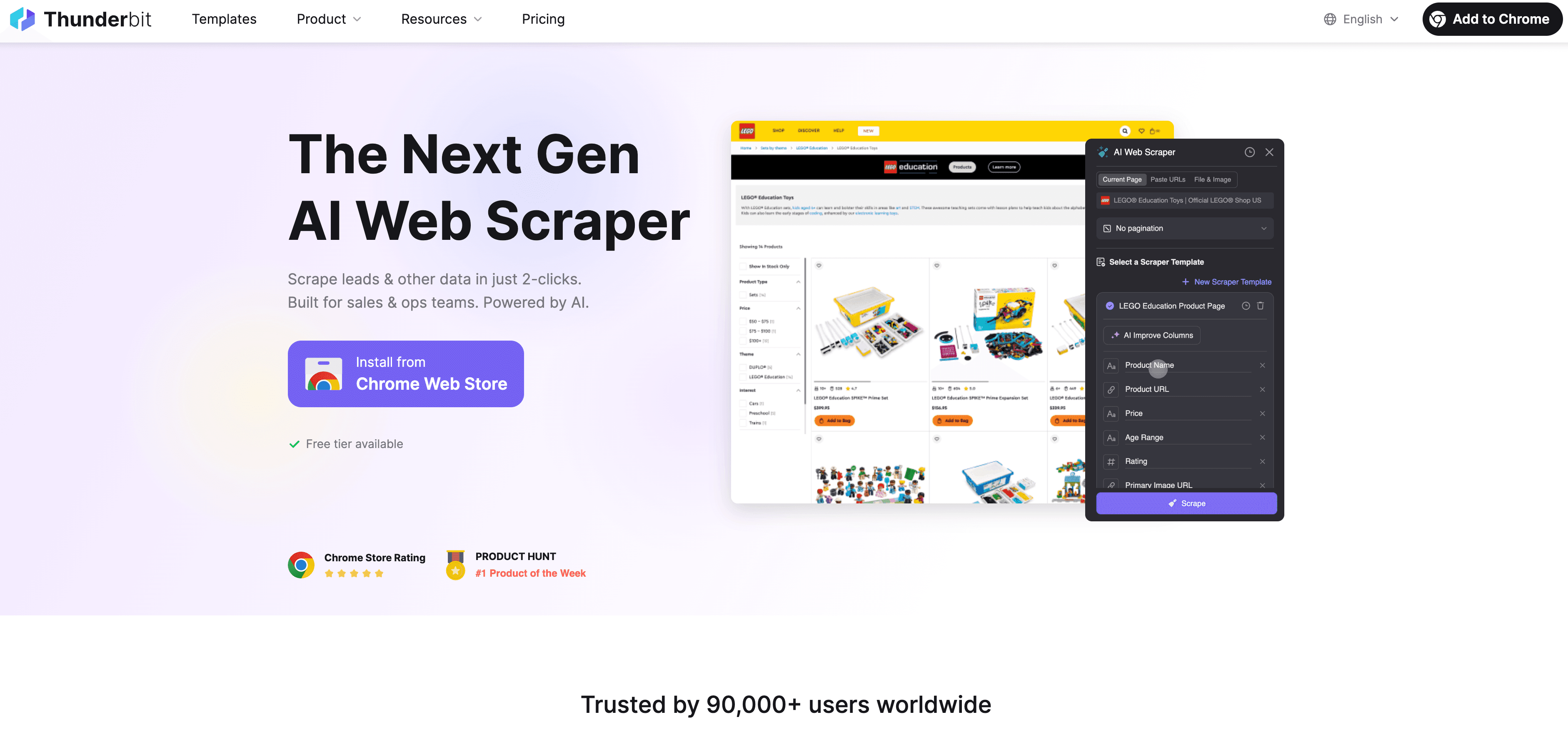

1. Thunderbit

は、AIを使ってサイトを素早くスクレイピングしたいビジネスユーザーに、私が最もおすすめするツールです。Chrome拡張として動作し、ThunderbitはAIアシスタントのようにページを読み取り、PDFや画像であっても、わずか2クリックで構造化データとして出力します。

は、AIを使ってサイトを素早くスクレイピングしたいビジネスユーザーに、私が最もおすすめするツールです。Chrome拡張として動作し、ThunderbitはAIアシスタントのようにページを読み取り、PDFや画像であっても、わずか2クリックで構造化データとして出力します。

Thunderbitの強みは何か?

- 自然言語インターフェース: 「このページから商品名、価格、画像をすべて抽出して」といった形で欲しいものを説明するだけで、あとはThunderbitのAIが処理します。

- AIによる項目提案: ボタンを1回クリックするとAIがページを解析し、抽出に最適な列を提案します。必要に応じて調整するか、そのまま受け入れて「スクレイピング」を押せます。

- サブページ・ページネーションのスクレイピング: Thunderbitは商品詳細などのサブページへのリンクを自動でたどれますし、無限スクロールでもページネーションを処理できます。

- 即時データエクスポート: Excel、Google Sheets、Airtable、Notionへ直接エクスポート可能。追加料金はありません。

- 無料の連絡先抽出: メールアドレス、電話番号、画像の抽出がワンクリックで、完全無料です。

- 定期スクレイピング: 「毎週月曜の午前9時」のように自然言語で定期実行を設定すれば、あとはAIが対応します。

Thunderbitは、複雑でぐちゃぐちゃした非標準のWebページを扱うときに特に強く、ニッチなディレクトリ、不動産一覧、ECの商品ページなど、他のスクレイパーなら泣きたくなるような場面で真価を発揮します。ユーザーレビューでも、そのシンプルさと強力さが一貫して高く評価されており、を獲得しています。

価格: 6〜10ページまで無料。有料プランは500クレジット(ページ)で月額15ドル前後からで、より大きなニーズには上位プランもあります。データエクスポートは常に無料です。

おすすめ対象: 営業、マーケティング、EC運用、そしてコーディングなしで、面倒なくデータを抽出したいすべての人。

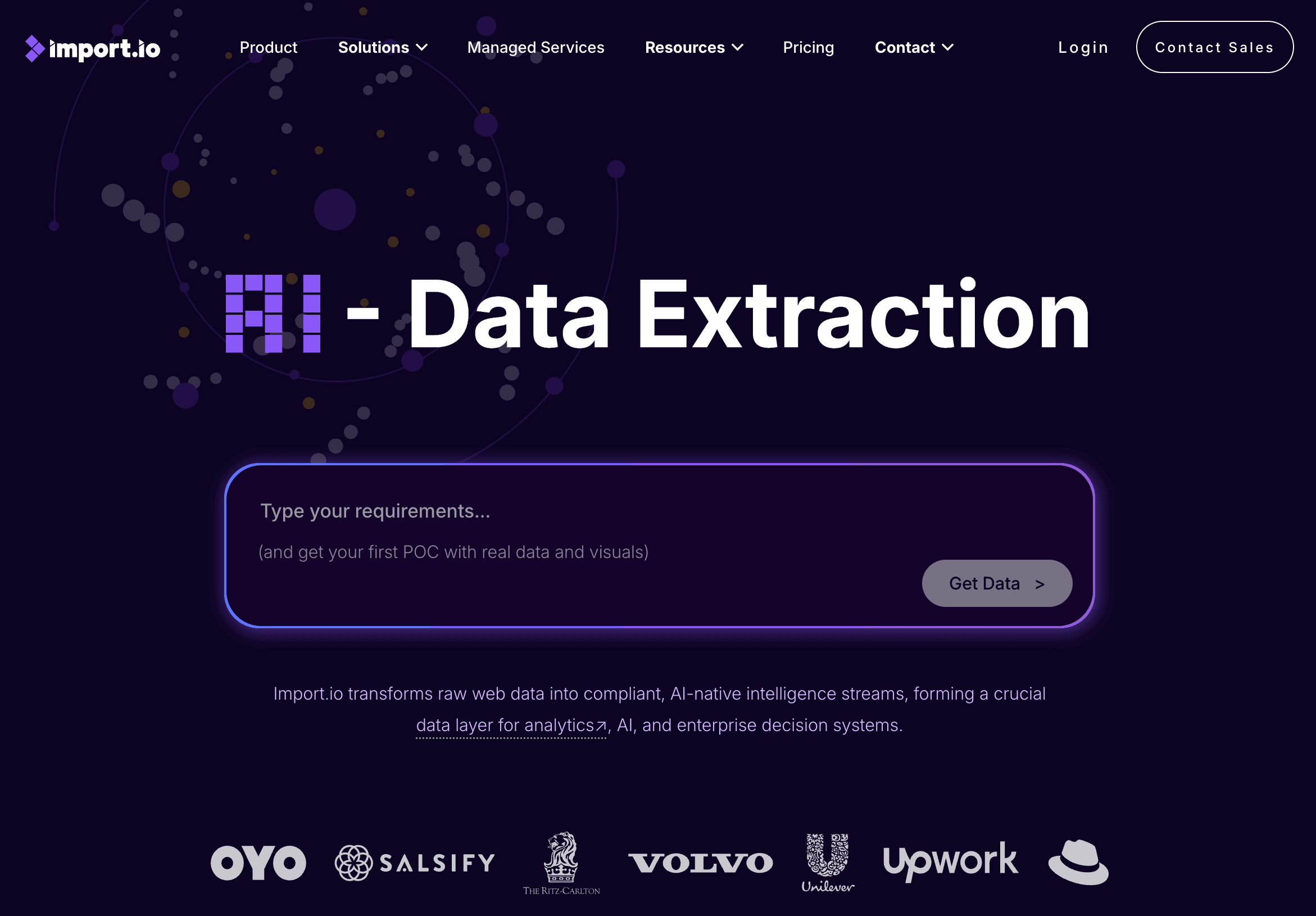

2. import.io

は、UnileverやVolvoのような大手企業にも信頼されている、エンタープライズ向けのAI搭載ウェブスクレイピングプラットフォームです。大規模でミッションクリティカルなデータ抽出向けに設計されています。

は、UnileverやVolvoのような大手企業にも信頼されている、エンタープライズ向けのAI搭載ウェブスクレイピングプラットフォームです。大規模でミッションクリティカルなデータ抽出向けに設計されています。

import.ioを選ぶ理由は?

- AIによる「自己修復」パイプライン: サイトが変わってもimport.ioのAIが自動で適応するため、壊れたスクレイパーに悩まされません。

- プロンプトベースの抽出: 高レベルの指示で抽出を設定でき、細かな部分はAIが判断します。

- 自動コンプライアンス: GDPRやCCPAなどのプライバシー法に対応するフィルターと、カスタマイズ可能なPIIマスキングを標準搭載しています。

- 完全管理型クラウド: プロキシ切り替え、スケジューリング、インフラ運用をすべて任せられます。

- API連携: あらゆるサイトを、分析基盤や業務システム向けのライブAPIに変えられます。

価格: 月額約299ドルから。エンタープライズ向けの個別プランもあります。無料トライアルあり。

おすすめ対象: 信頼性が高く、大規模で、法令順守にも対応したウェブデータパイプラインを必要とする企業やデータチーム。

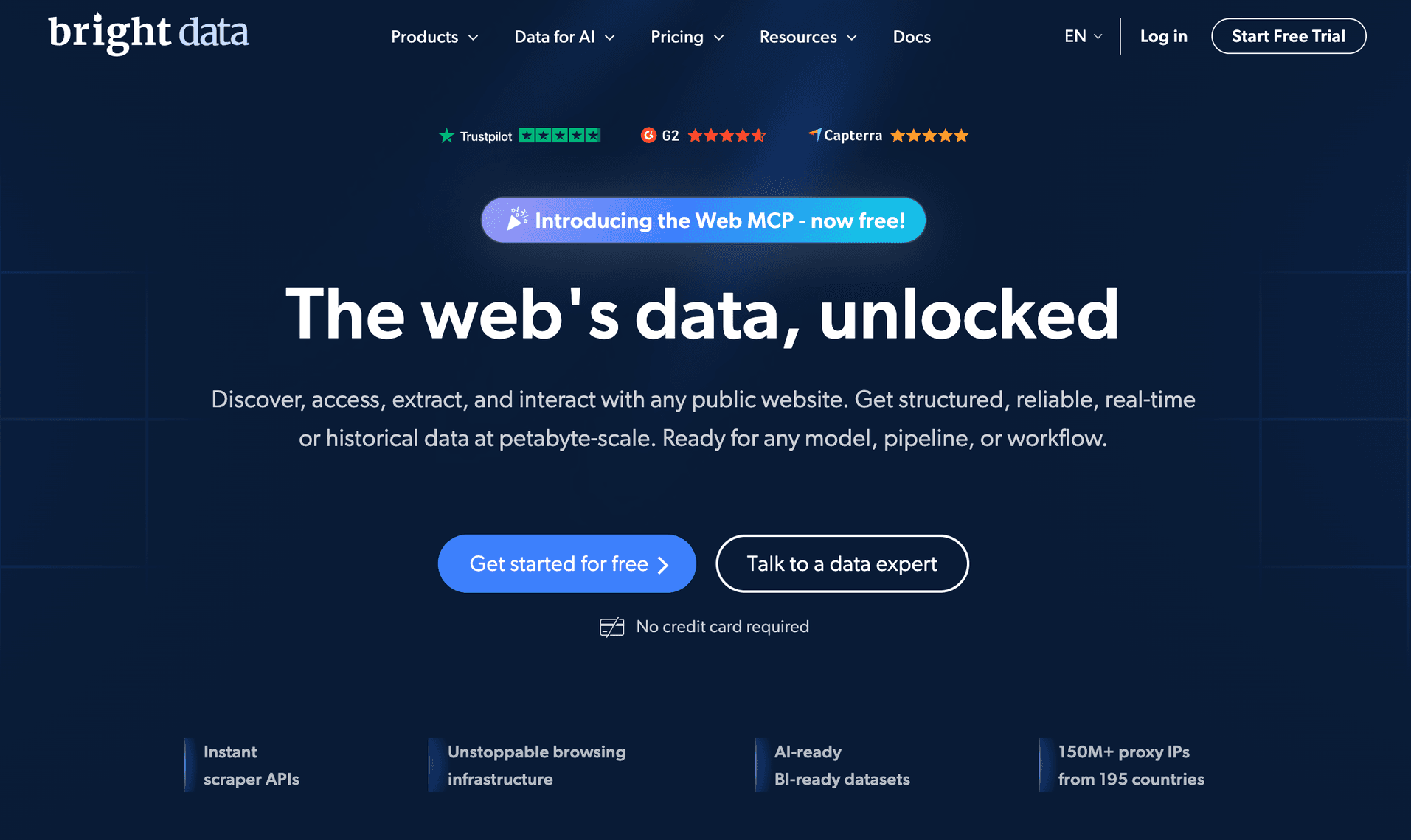

3. Bright Data

は、とにかくスケール重視です。数百万ページをスクレイピングしたい、世界中の価格を監視したい、あるいはAIモデルにデータを供給したいなら、これが最適です。

は、とにかくスケール重視です。数百万ページをスクレイピングしたい、世界中の価格を監視したい、あるいはAIモデルにデータを供給したいなら、これが最適です。

主な機能:

- 1億件超のプロキシネットワーク: residential、mobile、datacenterのIPで、ブロック回避性能は抜群です。

- AI搭載アンブロッカー: CAPTCHAを解決し、ヘッダーをローテーションし、bot対策にもリアルタイムで適応します。

- 事前構築済みスクレイパー: Amazon、LinkedIn、Googleなど120以上の人気サイト向けAPIがあります。

- データセットマーケットプレイス: 大規模な事前収集済みデータセットを購入または利用できます。

- LLM対応データストリーム: リアルタイムのウェブデータをAIシステムへ直接流し込めます。

価格: 従量課金制で、規模が大きくなるほど高額になりやすいです。無料トライアルと一部無料データセットあり。

おすすめ対象: 大規模組織、AIプロジェクト、そして大量で信頼性が高く、法令順守にも対応したウェブデータを必要とする人。

4. ParseHub

は、Windows、Mac、Linuxで使えるデスクトップアプリで、動的なJavaScript中心のサイトでも、ビジュアル操作で簡単にウェブスクレイピングできます。

は、Windows、Mac、Linuxで使えるデスクトップアプリで、動的なJavaScript中心のサイトでも、ビジュアル操作で簡単にウェブスクレイピングできます。

ParseHubが選ばれる理由:

- 機械学習によるパターン検出: 1つ項目をクリックすると、ParseHubが似た要素をすべて自動で見つけます。

- 動的コンテンツに対応: AJAX、無限スクロール、インタラクティブ要素にも対応します。

- ビジュアルなワークフロービルダー: コードなしで複数ステップのスクレイピングフローを組めます。

- クラウドスケジューリング: ジョブをクラウドで実行し、定期タスクをスケジュールできます。

- 柔軟な出力: CSV、Excel、JSON、APIに対応しています。

価格: 5プロジェクトまで無料(1回あたり200ページ)。有料プランは月額189ドルから。

おすすめ対象: 複雑なサイト向けに、強力でクリック操作中心のスクレイパーを求めるアナリスト、リサーチャー、中小企業。

5. Scrapy

は、開発者向けのウェブスクレイピングツールキットです。Pythonベースのオープンソースフレームワークで、拡張性も非常に高いです。

は、開発者向けのウェブスクレイピングツールキットです。Pythonベースのオープンソースフレームワークで、拡張性も非常に高いです。

Scrapyの特長は?

- 究極の柔軟性: カスタムスパイダーを書けば、どんなデータでも、どんな規模でも抽出できます。

- AI連携: Scrapy-LLMのような拡張を使って大規模言語モデル(LLM)でデータを解析したり、NLPを組み込んでより賢い抽出を実現できます。

- 非同期クロール: 大規模ジョブでも非常に高速かつ効率的です。

- オープンなエコシステム: プロキシ、ブラウザ自動化などのプラグインが豊富です。

価格: 無料のオープンソース。必要なのは自分のインフラ費用だけです。

おすすめ対象: 完全な制御と、AIをカスタムスクレイピングワークフローに組み込みたい開発者や技術チーム。

6. Octoparse

は、ビジネスユーザーやチーム向けに設計された、ノーコードのクラウド型ウェブスクレイパーです。

は、ビジネスユーザーやチーム向けに設計された、ノーコードのクラウド型ウェブスクレイパーです。

注目機能:

- AI自動検出: AIがページを解析し、何を抽出すべきか提案します。手動設定は不要です。

- ドラッグ&ドロップ式ワークフロー: ログイン、ページネーション、動的コンテンツにも対応したスクレイパーを、視覚的に構築できます。

- 事前構築済みテンプレート: 人気サイト向けのすぐ使えるテンプレートが数百種類あります。

- クラウドスケジューリング: クラウド上でスクレイピングを実行・予約し、Sheets、Excel、またはAPI経由で出力できます。

- AI正規表現ヘルパー: AIの助けを借りて正規表現パターンを生成できます。

価格: 無料プラン(10タスク)。有料プランは月額約75ドルから。

おすすめ対象: 非コーダー、マーケティングチーム、中小企業で、使いやすいノーコードのスクレイピングソリューションを探している人。

7. WebHarvy

は、賢いパターン検出と買い切りライセンスモデルで知られる、Windows向けデスクトップアプリです。

は、賢いパターン検出と買い切りライセンスモデルで知られる、Windows向けデスクトップアプリです。

WebHarvyを選ぶ理由:

- 自動パターン検出: 1つ項目をクリックすると、WebHarvyがページ上の似たデータをすべて見つけます。

- ビジュアルスクレイピング: 内蔵ブラウザでクリックするだけでデータを選択でき、コードは不要です。

- 画像・メール抽出: 画像のダウンロードやメールアドレスの抽出も簡単です。

- 買い切り購入: 永久ライセンス(129ドルから)で、任意の有料アップデートもあります。

価格: 1ユーザー向けで一回129ドルから。

おすすめ対象: コスト効率が高く、オフラインで使えるスクレイピングツールを求める中小企業、リサーチャー、そしてWindowsユーザー。

8. Apify

は、開発者にも非コーダーにも使われている、ウェブスクレイピングとワークフロー連携のためのクラウド自動化プラットフォームです。

は、開発者にも非コーダーにも使われている、ウェブスクレイピングとワークフロー連携のためのクラウド自動化プラットフォームです。

主な機能:

- Actorsマーケットプレイス: よくあるスクレイピング作業向けの事前構築済みボットが200以上あります。

- カスタムActors: JavaScript/Pythonで独自ボットを作ることも、ビジュアルツールを使うこともできます。

- AI連携: 抽出したデータをLLMに渡したり、AIエージェントからスクレイパーを起動したりできます。

- クラウドスケジューリングと保存: 大規模にジョブを実行し、結果を保存し、APIやワークフローツールと連携できます。

- プロキシとヘッドレスブラウザ対応: 動的サイトやbot対策にも対応できます。

価格: 無料プラン(月5ドル分のクレジット付き)。有料プランは月額49ドルから。

おすすめ対象: スケーラブルで自動化されたスクレイピングを、ワークフロー連携つきで実現したい開発者、スタートアップ、チーム。

9. Diffbot

は、AI搭載のウェブデータ抽出とナレッジグラフの分野でトップクラスです。

は、AI搭載のウェブデータ抽出とナレッジグラフの分野でトップクラスです。

Diffbotの独自性は?

- 完全AI駆動の抽出: 任意のURLをDiffbotのAPIに渡すだけで、構造化JSONが返ってきます。設定は不要です。

- ナレッジグラフ: 100億以上のエンティティ(企業、人、製品、記事)を含む巨大で常時更新されるグラフにアクセスできます。

- コンピュータービジョン + NLP: テキストや画像からデータを抽出し、関係性まで推論します。

- 事実に基づくLLM: 質問すると、ウェブの引用付きで回答が得られます。

価格: 無料の開発者トライアル(月10,000回の呼び出し)。Startupプランは25万クレジットで月額299ドル。

おすすめ対象: どんなページからでもすぐに構造化データを得たい、あるいはすぐに検索できるウェブ知識ベースが欲しい企業、AI企業、研究者。

10. Data Miner

は、Chrome/Edge拡張として、テンプレートベースの素早いスクレイピングを誰でも使えるようにするツールです。

は、Chrome/Edge拡張として、テンプレートベースの素早いスクレイピングを誰でも使えるようにするツールです。

Data Minerの魅力:

- 5万件以上の公開レシピ: 15,000以上のサイト(LinkedIn、Yellow Pages、Amazonなど)をワンクリックでスクレイピングできます。

- クリック操作によるカスタマイズ: 自分専用のスクレイピングレシピを視覚的に作成できます。

- ページネーションと自動化: ブラウザ内で複数ページやURL一覧をスクレイピングできます。

- 直接エクスポート: CSV/Excelへのダウンロードや、Google Sheetsへのアップロードが可能です。

価格: 月500ページまで無料。有料プランは月額約19ドルから。

おすすめ対象: 小〜中規模の作業を、ブラウザベースで素早くこなしたい非技術系ユーザー。

AIを使ってサイトをスクレイピングする上位ツールの比較

10ツールをざっと比較すると、次のようになります。

| ツール | 最適な用途 | AI機能 | 使いやすさ | 拡張性 | 価格 | サポート/コミュニティ |

|---|---|---|---|---|---|---|

| Thunderbit | 非コーダー、ビジネスユーザー | LLMの項目検出、自然言語UI | かなり簡単 | 中(クラウド) | 無料、月15ドル〜 | 迅速なメール対応、開発活発 |

| import.io | エンタープライズ、データチーム | 自己修復、プロンプトAI | 普通 | 非常に高い | 月299ドル〜 | 専任の企業向け対応 |

| Bright Data | 大規模組織、AIプロジェクト | アンブロッカー、1億超のプロキシ | 普通 | 極めて高い | 従量課金 | エンタープライズ、ドキュメント |

| ParseHub | アナリスト、中小企業、動的サイト | MLパターン検出 | 簡単〜普通 | 中〜高 | 無料、月189ドル〜 | ドキュメント、フォーラム |

| Scrapy | 開発者、カスタムワークフロー | LLM/NLPプラグイン | 難しい(コード) | 非常に高い | 無料(OSS) | コミュニティ、ドキュメント |

| Octoparse | 中小企業、非コーダー、チーム | AI自動検出、テンプレート | かなり簡単 | 高(クラウド) | 無料、月75ドル〜 | ライブチャット、チュートリアル |

| WebHarvy | Windowsユーザー、中小企業、研究者 | パターン検出 | かなり簡単 | 中 | 129ドル買い切り | メール、レビュー |

| Apify | 開発者、スタートアップ、自動化 | AI連携、Actors | 普通 | 非常に高い | 無料、月49ドル〜 | ドキュメント、Slack、サポート |

| Diffbot | AI/データサイエンス、企業 | 完全AI抽出、KG | 簡単(API) | 極めて高い | 無料、月299ドル〜 | 専任、アカデミック |

| Data Miner | 非技術系、手早いブラウザ作業 | 5万超のレシピ、パターンAI | かなり簡単 | 低〜中 | 無料、月19ドル〜 | オフィスアワー、レシピ |

あなたに合ったAIウェブスクレイピングツールの選び方

選ぶときの早見表はこちらです。

- 非コーダーで、すぐ終わる作業: Thunderbit、Octoparse、Data Miner、WebHarvy。

- 大規模・エンタープライズ向け: import.io、Bright Data、Diffbot。

- カスタムな開発者ワークフロー: Scrapy、Apify。

- 動的で複雑なサイト: ParseHub、Octoparse、Apify(ブラウザ自動化あり)。

- どのページからでも即座に構造化データが欲しい: Diffbot。

- 買い切り購入がいい(サブスクなし): WebHarvy。

プロのコツ: ツールを組み合わせるのが最も効果的な場合もあります。たとえば、Thunderbitで面倒なデータを素早く整形し、その後WebHarvyのパターン検出でさらに処理すると、スムーズなワークフローになります。

判断の重要ポイント:

- 予算: 無料プランは検証に最適です。エンタープライズ向けツールは高価ですが、拡張性とサポートに優れます。

- 技術スキル: ビジネスユーザーにはノーコード、開発者にはフレームワーク。

- データ量: 小規模ならブラウザツール、大規模ならクラウドプラットフォーム。

- サポート要件: エンタープライズ向けはSLAがあり、その他はコミュニティやメール対応が中心です。

結論:AIでサイトをスクレイピングする未来

AIは、ウェブスクレイピングをニッチな開発者作業から、広く使われるビジネス機能へと変えつつあります。リードリストを作る、価格を監視する、AIモデルにデータを供給する——どんな用途でも、今ではあなたのニーズとスキルに合ったツールがあります。ここで紹介した10のツールは、このエコシステムがどれほど多様で、そして強力になったかをよく示しています。

AIの進化が続くにつれて、ウェブスクレイピングはさらに賢くなるはずです。より自然な言語インターフェース、ウェブ変化への適応力向上、そして業務フローとの深い連携が進むでしょう。私からのアドバイスは、いくつか試してみて、自分のワークフローに合うものを見つけ、必要なら組み合わせることを恐れない、ということです。

最新のAI搭載スクレイピングがどんなものか見てみたいなら、か、で他のガイドもチェックしてみてください。ウェブデータの未来は、もうここにあります。そして、コピペ地獄よりずっと楽しく、ずっと生産的です。

よくある質問

1. 従来のツールではなく、AIでサイトをスクレイピングするべきなのはなぜですか?

AI搭載スクレイパーは、変化するWebレイアウトに適応し、パターンを自動認識し、非技術系ユーザーでも欲しいものを説明するだけでデータを抽出できます。つまり、保守の手間やストレスを減らしながら、より速く、より信頼できるデータ抽出ができます。

2. 非コーダーに最適なAIウェブスクレイピングツールはどれですか?

Thunderbit、Octoparse、Data Miner、WebHarvyは、いずれも非技術系ユーザーに最適です。ビジュアルUI、自然言語対応があり、コーディングスキルは不要です。

3. 大規模またはエンタープライズ向けのウェブスクレイピングに最適なツールは?

import.io、Bright Data、Diffbotは、スケール、信頼性、法令順守を重視して設計されています。数百万ページに対応でき、強力なAPIを備え、エンタープライズ顧客向けの専用サポートもあります。

4. ウェブスクレイピングのワークフローを最適化するために、複数のツールを組み合わせられますか?

もちろんです。多くのチームが、Thunderbitで素早く構造化し、その後WebHarvyでパターン検出を行う、あるいはApifyでワークフロー自動化をするなど、複数ツールを組み合わせています。ツールを組み合わせることで、それぞれの強みを活かせます。

5. これらのAIウェブスクレイピングツールを無料で試す方法はありますか?

はい。ほとんどのツールには無料プランまたはトライアルがあります。Thunderbit、Octoparse、Data Miner、Apifyはいずれも無料プランがあるので、有料契約の前に試せます。

ウェブデータ活用を次のレベルに進める準備はできましたか? いくつか試して、どれだけ時間とメンタルを節約できるか見てみてください。ウェブスクレイピング、自動化、AIについてもっと知りたいなら、をチェックするか、を購読してください。スクレイピングを楽しみましょう!

さらに読む