ネット上にはとんでもない量のデータが転がってるけど、何百件もの商品リストや求人情報を手作業でコピペしたい人なんていないよね。だからこそ、ウェブスクレイピングは営業や業務効率化、EC運営など、いろんなビジネス現場で欠かせないスキルになってるんだ。Pythonはシンプルな書き方と強力なライブラリが揃ってるから、ウェブスクレイパー作りの定番言語。実際、がPythonを使ってて、他の言語を圧倒してるよ。

でも、Pythonでのスクレイピングはパワフルな反面、初心者にはちょっとハードル高く感じることも。動的なサイトやボット対策、複雑なデータ構造なんかは、経験者でも手こずることが多い。そこで今回は、ゼロから始める手順をわかりやすく解説!実際のpythonウェブスクレイパー例を使いながら、AI搭載ツールと組み合わせて、もっと効率よくデータ収集する方法も紹介するよ。リード獲得の自動化、競合価格のチェック、ウェブデータのスプレッドシート化など、すぐ使えるノウハウと実践テクをまとめてみた。

Pythonウェブスクレイピング入門:ゼロからのセットアップ

まずは基本から。ウェブスクレイピングっていうのは、ウェブサイトから必要なデータを自動で集める技術のこと。手作業で情報をコピペする代わりに、スクレイパーがページを巡回してHTMLを解析、欲しい情報(たとえば商品価格や連絡先、レビューなど)を抜き出してくれる。ビジネスユーザーにとっては、営業リードや価格調査、市場分析などのリアルタイムデータを手軽にゲットできるのが大きな魅力だよ()。

ステップ1:Pythonのインストール

まずはPython 3を用意しよう。公式サイト()から最新版をゲット。Windowsならインストーラーを実行して「Add Python to PATH」にチェックを入れるのを忘れずに。Macならでbrew install pythonって打つか、直接ダウンロードでもOK。インストールできたら、ターミナル(またはコマンドプロンプト)で下記を実行:

1python --versionまたは

1python3 --versionPython 3.11.0みたいな表示が出れば準備OK!

ステップ2:仮想環境の作成

仮想環境を使うと、プロジェクトごとに必要なパッケージを管理できて、他のPythonプロジェクトとごちゃごちゃにならない。プロジェクト用のフォルダで下記を実行:

1# macOS/Linuxの場合

2python3 -m venv .venv

3# Windowsの場合

4py -m venv .venv有効化はこんな感じ:

- macOS/Linux:

source .venv/bin/activate - Windows:

.venv\Scripts\activate

これでインストールしたパッケージはこのプロジェクト内だけで使えるよ()。

ステップ3:主要ライブラリのインストール

必要なパッケージはこれ!

- Requests:ウェブページ取得用

- BeautifulSoup (bs4):HTML解析用

- Scrapy:大規模・高機能なスクレイピング用

インストールコマンドはこれ:

1pip install requests beautifulsoup4 scrapy- RequestsはHTTPリクエストを簡単に送れる。

- BeautifulSoupはHTMLからデータを抜き出すのに便利。

- Scrapyは大量ページのクロールやエラー処理、データ出力まで全部できる本格派フレームワーク。

初心者はまずRequests+BeautifulSoupの組み合わせから始めるのがオススメ。大規模案件ならScrapyが活躍!

ステップ4:プロジェクトフォルダの作成

ファイルはちゃんと整理しよう。プロジェクト用のフォルダを作って、その中にスクリプトやデータファイル、仮想環境をまとめておくと後で楽だよ。

pythonウェブスクレイパー例:基本スクリプトと構成

実際にシンプルなスクレイパーを作ってみよう。ウェブページを取得して、解析して、データを抜き出す。下記はを対象にした最小限の例だよ:

1import requests

2from bs4 import BeautifulSoup

3URL = "https://example.com"

4response = requests.get(URL)

5response.raise_for_status() # ステータスが200以外ならエラー

6soup = BeautifulSoup(response.text, "html.parser")

7# 段落タグをすべて取得

8paragraphs = soup.find_all('p')

9for idx, p in enumerate(paragraphs, start=1):

10 print(f"Paragraph {idx}: {p.get_text()}")このスクリプトの流れ

- ライブラリをインポート

requests.getでページ取得- BeautifulSoupでHTML解析

<p>タグを全部抜き出してテキスト表示

よくあるミス

response.status_codeを確認しない(必ず200 OKかチェック)- 要素が見つからず

Noneに対して.get_text()を呼ぶ - 仮想環境を有効化し忘れてimportエラーになる

この「インポート→取得→解析→抽出→出力」の流れがpythonウェブスクレイパー例の基本形!

Pythonでウェブページをスクレイピング:実践ワークフロー

実際のスクレイピング作業の流れを分解してみよう。

1. サイト構造の調査

ブラウザで欲しいデータ部分を右クリックして「検証」を選択。開発者ツールでHTML構造を確認して、ターゲットとなるタグやクラス、IDを探そう()。

2. ページの取得

RequestsでHTMLを取得:

1headers = {"User-Agent": "Mozilla/5.0"}

2response = requests.get(URL, headers=headers)

3response.raise_for_status()User-Agentを指定すると、簡単なボット対策を回避しやすいよ。

3. HTMLの解析

1soup = BeautifulSoup(response.text, "html.parser")4. データの抽出

たとえば、求人情報が<div class="job-card">にまとまってる場合:

1job_cards = soup.find_all('div', class_='job-card')

2for card in job_cards:

3 title = card.find('h2', class_='title').get_text(strip=True)

4 company = card.find('h3', class_='company').get_text(strip=True)

5 print(title, company).find(), .find_all(), .select()(CSSセレクタ)などを使い分けると複雑な抽出もできる!

5. 複数データ(リスト)の処理

商品リストや求人カードなど、複数のコンテナをループで回して必要な項目を抜き出そう。辞書型リストにまとめておくとデータ出力も簡単。

6. トラブルシューティング

- 結果が空の場合はセレクタやクラス名の変更、JavaScriptによる動的生成を疑おう。

response.text[:500]で取得HTMLの冒頭を確認して、想定通りかチェック。

pythonウェブスクレイパー例:データの保存と出力方法

データが取れたら、保存方法を選ぼう。主な選択肢はこれ!

コンソールに出力

動作確認には便利だけど、本格運用には向かない。

CSVファイルに書き出し

1import csv

2data = [

3 {"Name": "Alice", "Age": 25},

4 {"Name": "Bob", "Age": 30},

5]

6with open("output.csv", "w", newline="", encoding="utf-8") as f:

7 writer = csv.DictWriter(f, fieldnames=["Name", "Age"])

8 writer.writeheader()

9 writer.writerows(data)Excelファイルに出力

pandasとopenpyxlが入っていれば:

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_excel("output.xlsx", index=False)データベースに保存

軽い用途ならPython標準のSQLiteが便利:

1import sqlite3

2conn = sqlite3.connect("scraped_data.db")

3cursor = conn.cursor()

4cursor.execute("CREATE TABLE IF NOT EXISTS people (name TEXT, age INTEGER)")

5for row in data:

6 cursor.execute("INSERT INTO people VALUES (?, ?)", (row["Name"], row["Age"]))

7conn.commit()

8conn.close()用途別おすすめ

- CSV:スプレッドシートや共有に最適

- Excel:レポートや複数シート管理に

- データベース:大規模・継続的な案件向け

文字化け防止のため、必ずencoding="utf-8"を指定しよう()。

ThunderbitとPython:スクレイピング作業を加速する最強タッグ

ここで、ビジネスユーザー向けAI搭載Chrome拡張「」を紹介!

ここで、ビジネスユーザー向けAI搭載Chrome拡張「」を紹介!

Thunderbitの特長

- AIによるフィールド自動提案:AIがページを解析して、抜き出すべきデータ項目を自動で提案。HTMLやセレクタの知識は不要。

- 直感的な操作:拡張機能を開いてAIの提案を確認、「スクレイプ」をクリックするだけ。

- サブページ自動巡回:商品詳細やプロフィールページなど、リンク先も自動で巡回してデータを拡充。

- 多彩なエクスポート:CSVやExcelはもちろん、Google Sheets、Notion、Airtableにも直接出力OK()。

ThunderbitとPythonの連携活用例

たとえば、JavaScriptやログインが必要な複雑なECサイトをスクレイピングしたいとき、従来のPythonスクリプトだと苦戦しがち。でもThunderbitならブラウザ上でサクッと対応できる。データをエクスポートした後は、Pythonで分析や自動処理に活用できるよ。

活用シナリオ例

- Thunderbitで動的な商品リスト(画像・価格・レビュー含む)を取得

- CSVでエクスポート

- Pythonでトレンド分析や他データとの統合、アラート自動化などを実施

この組み合わせなら、コーディング経験がなくても高度なスクレイピングが実現できる!

Pythonウェブスクレイパーの精度と安定性を高めるコツ

ウェブスクレイピングは「データを取る」だけじゃなく、「正確に・安定して」取ることが大事。下記のポイントを押さえよう:

1. サイト構造の変化に備える

HTML構造はよく変わるから、セレクタはできるだけユニークなIDや安定したクラス名を使って、脆弱なタグ位置指定は避けよう。

2. エラーハンドリングの実装

リクエストや解析処理はtry/exceptで囲んで、失敗時のリトライやエラー通知をしよう:

1import time

2for attempt in range(3):

3 try:

4 response = requests.get(url, timeout=10)

5 response.raise_for_status()

6 break

7 except Exception as e:

8 if attempt < 2:

9 time.sleep(5)

10 else:

11 print(f"Failed after 3 attempts: {e}")3. User-Agentのローテーションとプロキシ活用

多くのサイトはボットっぽいアクセスをブロックするから、User-Agentをランダム化したり、大量取得時はプロキシも活用しよう()。

4. robots.txtの遵守と倫理的配慮

必ずrobots.txtや利用規約を確認して、公開データだけを対象に。個人情報やサーバーへの過剰負荷はNG()。

5. ログ記録と監視

Pythonのloggingモジュールでエラーや成功を記録。定期実行の場合は失敗やデータゼロ時のアラートも設定しよう。

ThunderbitのAI機能でPythonスクレイピングをさらに効率化

Thunderbitはただのスクレイピングツールじゃなくて、作業全体をもっとスマート&スピーディーにしてくれる。

Thunderbitはただのスクレイピングツールじゃなくて、作業全体をもっとスマート&スピーディーにしてくれる。

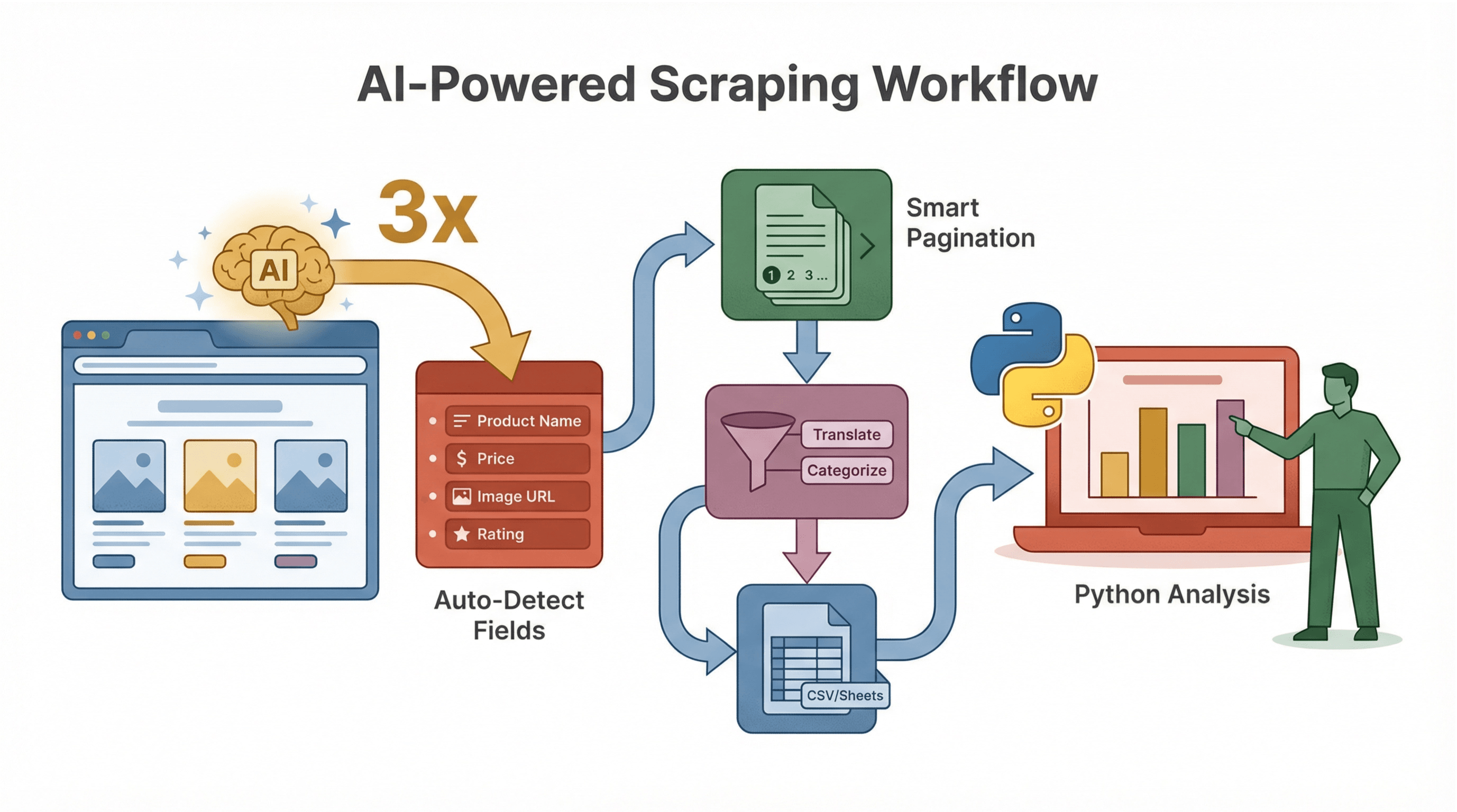

AIによるデータ項目自動提案

ThunderbitのAIは、どのフィールドを抜き出すべきか即座に提案。HTML調査やセレクタ記述の手間が省ける。たとえば商品ページなら「商品名」「価格」「画像URL」などを自動認識。

サブページ・ページネーション対応

詳細ページや複数ページの存在もAIが自動検出して、一括でデータ取得。ECや不動産、リード獲得などにピッタリ。

AIによるデータ加工・クレンジング

翻訳・要約・カテゴリ分けなど、スクレイピング時にAIプロンプトを各フィールドに追加できる。たとえばレビューを「ポジティブ」「ネガティブ」に分類したり、価格から数字だけを抜き出したりもOK。

ワークフロー例

- ThunderbitでAI提案フィールド付きのデータを取得

- CSVやGoogle Sheetsにエクスポート

- Pythonで分析・可視化・自動処理を実施

コーディング未経験のチームでもThunderbitがスクレイピングを担当、Pythonで高度な処理ができる!

pythonウェブスクレイパー例:上級テクニックとよくある課題

さらにレベルアップしたい人向けに、プロっぽいヒントを紹介!

動的コンテンツのスクレイピング

最近のサイトはJavaScriptでデータを動的に表示することが多い。Requests+BeautifulSoupでデータが取れない場合は:

- SeleniumやPlaywright:実際のブラウザを自動操作して、レンダリング後のHTMLを取得

- APIの利用:多くの場合、データはバックグラウンドAPI(JSON形式)で取得されてる。ブラウザのネットワークタブでエンドポイントを探して、直接取得するのが効率的。

ページネーション対応

URLのパラメータ(例:?page=2)を変えてループ処理。またはBeautifulSoupで「次へ」リンクを探して、最後まで巡回しよう。

スケジューリング

Pythonのscheduleライブラリやcronで自動実行もできる。ノーコードで定期実行したいならThunderbitのスケジュール機能も便利!

よくある課題

- CAPTCHA対策:リクエスト間隔を空ける、プロキシ利用、人間による認証を検討

- 文字化け:ファイル書き出し時は必ず

encoding="utf-8"を指定 - IPブロック:プロキシやUser-Agentのランダム化、リクエスト制限の遵守

まとめ&重要ポイント

Pythonでのウェブスクレイピングは、基本を押さえれば誰でも始められる!

- 環境構築と主要ライブラリの導入

- ターゲットサイトの調査とセレクタ設計

- シンプルなスクリプトで取得・解析・抽出

- ビジネス用途に合わせたデータ出力

慣れてきたら、AI搭載ツールと組み合わせて、動的・大規模・複雑な案件にもチャレンジしよう。ThunderbitのAI機能(フィールド提案、サブページ巡回、即時エクスポートなど)は、手作業の手間を大幅に減らして、非エンジニアでも使える!

大事なのは「信頼性」「倫理性」「目的意識」。営業、EC、データ分析など、ウェブスクレイピングで新しいビジネスチャンスを掴もう。まずは小さく始めて、試行錯誤しながらスキルを磨いてみて!

もっと知りたい人はやでAIスクレイピングの実例をチェック!

よくある質問(FAQ)

1. Pythonでウェブスクレイピングを始める一番簡単な方法は?

Python 3をインストールして、RequestsとBeautifulSoupライブラリでウェブページを取得・解析するのが基本。まずはシンプルなサイトから始めて、徐々にレベルアップしよう。

2. JavaScriptでデータが表示されるサイトはどう対応すればいい?

SeleniumやPlaywrightなどのブラウザ自動化ツールを使うか、ブラウザのネットワークタブでAPI通信(JSONなど)を探して直接取得するのが効果的。

3. ビジネス用途でスクレイピングデータを出力する最適な方法は?

CSVは一番汎用的で、ExcelやGoogle Sheetsでも開ける。ExcelやJSON、SQLiteなどのデータベース出力もOK。ThunderbitならGoogle Sheets、Notion、Airtableへの直接エクスポートもできる!

4. スクレイピング時のブロック回避方法は?

User-Agentのローテーション、大量取得時はプロキシ利用、リクエスト間隔の調整、robots.txtの確認を徹底しよう。個人情報や機密データの取得は避けてね。

5. Thunderbitは非エンジニアでも簡単に使えますか?

ThunderbitはAIがデータ項目を自動提案、サブページやページネーションも自動対応。数クリックで構造化データを出力できて、コーディング不要だからビジネスユーザーにもピッタリ!

データ収集を自動化したい人は、を無料で試してみて。AIがあなたのウェブスクレイピングを次のレベルに引き上げてくれるよ。

さらに学ぶ