先週、私は丸一日かけて、ログイン必須のポータルでAIエージェントに仕入先フォームを入力させようとしていました。3時間経ったころには、目の前に「Connection Refused」のエラーが表示され、VPSのメモリは尽き、もう手作業で全部やったほうが早いのでは…と本気で考えていました。

あの体験こそ、OpenClaw のブラウザ自動化を始めるときの“あるある”です。OpenClaw は、ページ移動、データ抽出、フォーム入力、複雑なワークフローの連携まで、平易な英語の指示だけでこなせる強力なツールです。とはいえ、「すごそう」と思う段階から「実際に自分の環境で動く」段階までの間に、多くの人が立ち止まってしまいます。

私はその両側をかなり長く見てきました。Thunderbit の自動化ツールを作る側としても、オープンソースのエコシステムを試す側としてもです。このガイドでは、私自身が欲しかった内容をそのまままとめました。実践的なセットアップ手順、みんながつまずきやすいブラウザモードの選び方、WSL を前提にしない Windows ネイティブの導入方法、bot 対策の生き残り方、実際の出力例、よくあるエラーとその解決策、そして OpenClaw が本当に向いている場面と、やりすぎな場面まで、正直に解説します。

OpenClaw ブラウザ自動化とは?

OpenClaw は、ブラウザを代わりに操作してくれる無料のオープンソース AI エージェントプラットフォームです(MIT ライセンス)。Selenium のスクリプトや Puppeteer のコードを書く代わりに、「このページに行って、商品名と価格を全部抽出して」といった指示を自然な英語で伝えるだけで、AI が操作手順を考えてくれます。ページ上の要素を識別し、番号付きの参照を割り当て、順番に操作していくスナップショット方式を採用しています。

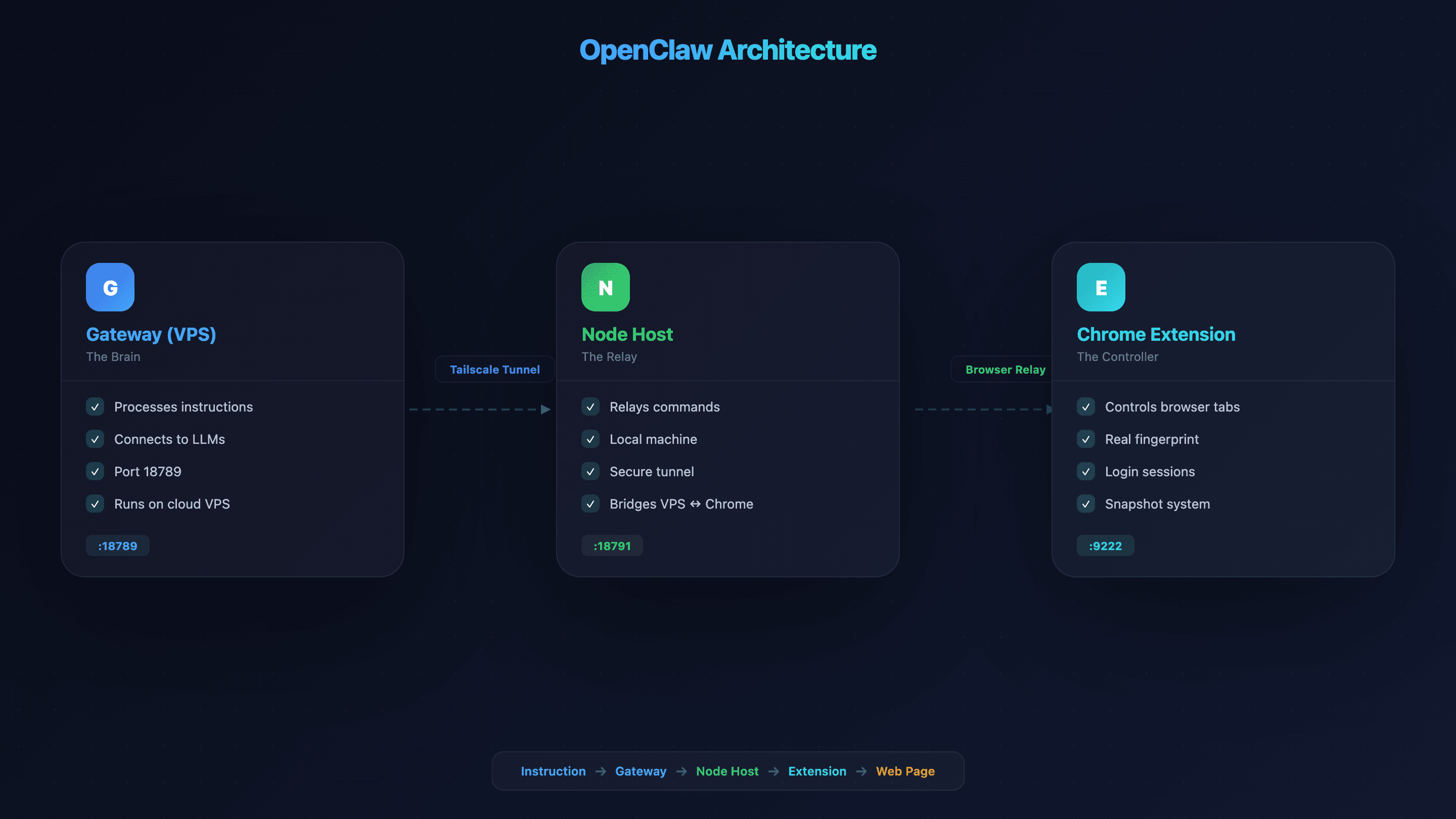

この構成は3つの要素でできているため、単に拡張機能を入れるだけでは終わりません。

- Gateway(VPS/サーバー): 指示を処理し、LLM に接続する「頭脳」。デフォルトではポート 18789 で動作します。

- Node Host(ローカル端末): Gateway からのブラウザ指示を手元の Chrome に中継する仕組み。Tailscale のような安全なトンネル経由で接続します。

- Chrome Extension(Browser Relay): 実際のブラウザ内で、エージェントがタブを直接操作できるようにします。

ほかにも、Control Service(18791)、CDP Relay(18792)、managed browser CDP(、最大100件の並列プロファイル対応)などのポートがあります。

正直、かなり構成要素は多いです。ただ、それぞれの役割がわかるとセットアップの意味が見えてきます。イメージとしてはラジコンカーのようなものです。Gateway がコントローラー、Node Host が電波、Chrome Extension が本体です。

なぜ OpenClaw ブラウザ自動化がビジネスチームに重要なのか

ナレッジワーカーは、価値の高い仕事ではなく、最大で を定型的な管理業務に費やしており、1日あたり1.8時間も情報収集や検索に使っているというデータがあります。Smartsheet の調査では、 が、週の労働時間の4分の1以上を手作業の繰り返しに使っているとされています。単純なデータ入力だけでも、米国企業では従業員1人あたり年間約 のコストがかかると見積もられています。

OpenClaw のブラウザ自動化は、まさにこの課題を解決するためのものです。実際には、次のような業務に直結します。

| ユースケース | OpenClaw ができること | ビジネス上の効果 | |---|---|---| | リード獲得 | ディレクトリや企業ページから連絡先情報を抽出 | 営業案件をより早く積み上げられる | | 競合価格の監視 | 商品ページを毎日巡回し、価格を取得 | 競争情報をリアルタイムで把握できる | | フォーム入力 / データ入力 | CRM、ポータル、申請フォームなどの反復入力を自動化 | 毎週の工数を大幅削減 | | コンテンツ監視 | 競合ブログ、求人ページ、プレスリリースを確認 | 早期に競合の兆候をつかめる | | QA / テスト | Web フローを実行して正常性を確認 | 画面崩れや動作不良を減らせる |

AIエージェント市場は2025年に に達し、2023年の37億ドルからほぼ倍増しています。さらに、 がすでに少なくとも1つの業務でAI自動化を活用しています。もはやニッチな分野ではありません。

Sandbox Chromium、Browser Relay、Chrome Remote Debugging:最適なモードの選び方

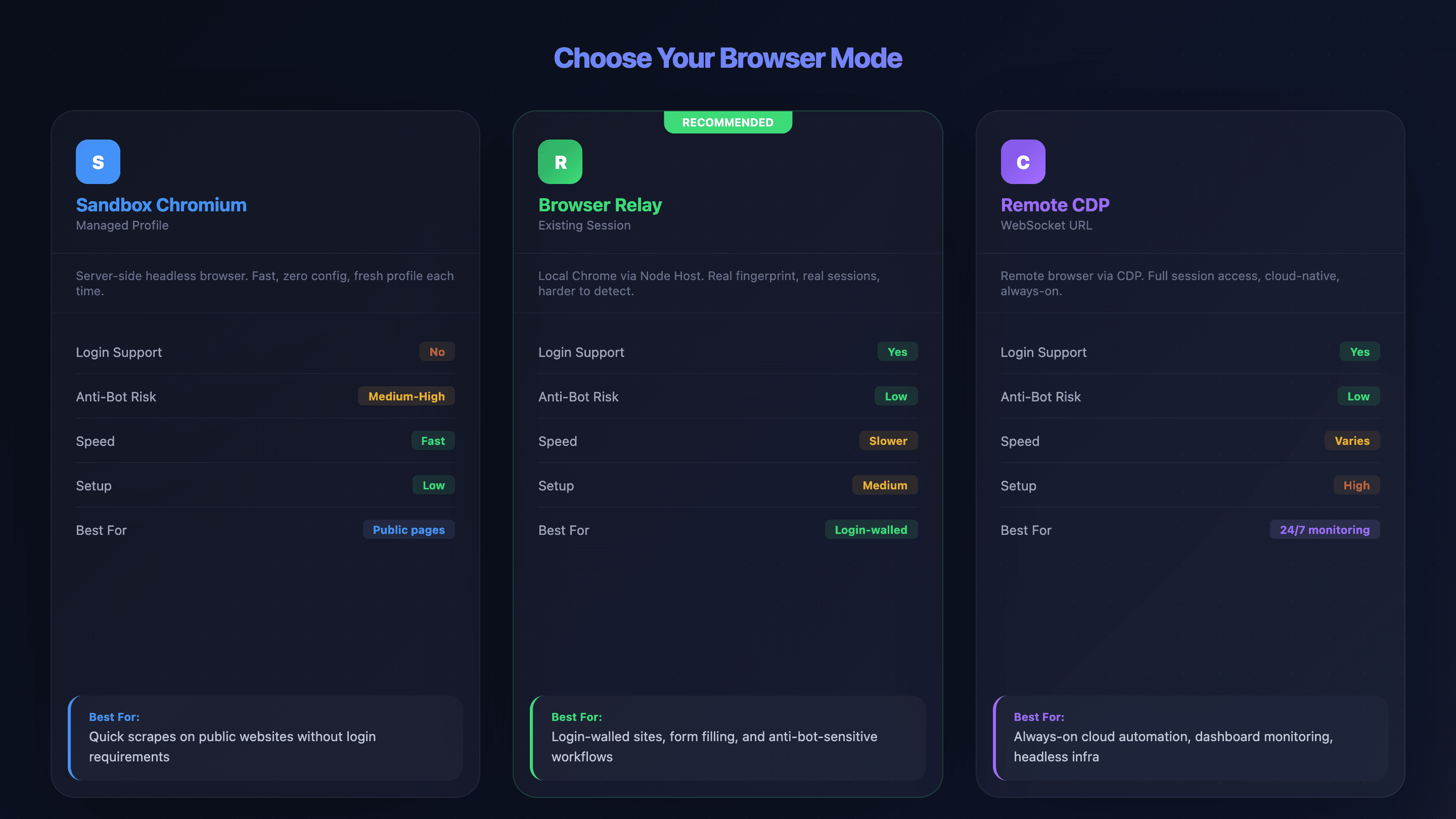

OpenClaw を使い始めた人が最もつまずきやすいのは、実はブラウザモードの選択です。私が見てきた限り、接続トラブルの多くは、最初に別のモードを選んでいれば避けられたものでした。OpenClaw には3つの接続方法があり、それぞれに長所と短所があります。

- Sandbox Chromium(Managed Profile): OpenClaw がサーバー上で独自のヘッドレスブラウザを起動します。ログインセッションは使えませんが、セットアップは軽く、動作も速めです。ただし、bot 対策には見つかりやすくなります。

- Browser Relay(Existing-Session): ローカル端末にある node host が、VPS からの指示を実際の Chrome に中継します。ログインセッションや Cookie が使え、普段使いのブラウザ指紋も引き継ぎます。

- Chrome Remote Debugging(Remote CDP): WebSocket URL 経由でリモートブラウザに接続します。セッションを丸ごと扱えますが、セットアップの難易度は最も高いです。Browserless や Browserbase のようなクラウドサービスにも対応します。

比較表:3つのブラウザモード

| 項目 | Sandbox Chromium | Browser Relay | Remote CDP | |---|---|---|---| | ログイン対応 | ❌ なし(新規プロファイル) | ✅ あり(実セッション) | ✅ あり(認証済み) | | bot 対策リスク | ⚠️ 中〜高 | ✅ 低(実ブラウザの指紋) | ✅ 低(プロバイダー管理) | | 速度 | ✅ 速い | ⚠️ やや遅い(ネットワーク中継) | ⚠️ 環境による | | セットアップ難易度 | 低 | 中 | 高 | | 全機能対応 | ✅ あり(すべて) | ⚠️ 一部制限あり(バッチ不可、ダウンロード介入不可) | プロバイダー次第 | | 向いている用途 | 公開ページ、手早い抽出 | ログイン必須サイト、フォーム入力 | クラウド運用、常時監視 |

判断フロー:どのモードを選ぶべき?

以下の質問を順番に考えてみてください。

- 「ログインが必要ですか?」 — いいえ → Sandbox Chromium。はい → 次へ。

- 「そのサイトは bot 対策がかなり厳しいですか?」 — はい → Browser Relay(実ブラウザの指紋が検知回避に役立ちます)。いいえ → Browser Relay か Remote CDP のどちらでも可。

- 「24時間動かし続けるセッションが必要ですか?(ダッシュボード監視など)」 — はい → クラウドプロバイダー付きの Remote CDP。いいえ → Browser Relay。

実際のケースに当てはめると、

- 公開されている Amazon 商品一覧を抽出する → Sandbox Chromium

- ログイン後の CRM フォームを入力する → Browser Relay

- 社内分析ダッシュボードを24時間監視する → Browserless / Browserbase を使った Remote CDP

この判断を最初に正しく行うだけで、無駄なデバッグ時間をかなり減らせます。本当にそうです。

始める前に

- 難易度: 中級(CLI にある程度慣れている方向け)

- 所要時間: 全体で45〜75分、各ステップは10〜15分ほど

- 必要なもの: VPS(最低2GB RAM、推奨4GB)、Node.js v22.12.0 以上、Tailscale アカウント(無料)、Chrome ブラウザ、そして少しの忍耐

ステップ1: VPS(またはローカル)で OpenClaw を起動する

VPS は OpenClaw の「頭脳」が置かれる場所です。起動方法は2つあります。

選択肢A: ワンクリック VPS ホスティング

OpenClaw があらかじめ設定されたイメージを提供しているプロバイダーがあります。

| プロバイダー | 開始価格 | 備考 | |---|---|---|---| | Hostinger | 月額 $6.99 〜 | 事前設定済みイメージ | | Tencent Cloud Lighthouse | 年額約 $0.08 〜(キャンペーン) | 2コア / 4GB 推奨 | | Hetzner | 月額 $4.09 〜(CX22) | コスパ良好、手動インストール | | DigitalOcean | 月額 $4 〜 | 手動インストール | | Vultr | 月額 $3.50 〜 | 手動インストール |

選択肢B: CLI で手動インストール

1# npm でインストール(Node.js v22.12.0 以上が必要)

2npm install -g openclaw

3# セットアップウィザードを起動

4openclaw onboard

5# Gateway トークンを生成(後で node host に必要なので保存しておく)

6openclaw doctor --generate-gateway-token

7# 設定を検証

8openclaw doctor --fix最低要件: 2GB RAM(1GB だと落ちる可能性あり)、推奨は4GB。ヘッドレスブラウザ1つあたり、アイドル時でも400〜800MBほど消費します。Docker を使うなら shm_size: '2gb' を設定してください。これは安定性にかなり重要です。

この段階で OpenClaw が起動し、Gateway トークンを安全に保管できていればOKです。(私はパスワードマネージャーに入れています。なくさないでください。)

ステップ2: VPS とローカル端末を Tailscale でつなぐ

Tailscale は、VPS と手元の端末の間にプライベートで暗号化されたトンネルを作り、ブラウザへの指示がインターネット上にむき出しにならないようにします。OpenClaw には という経緯もあるので、この手順を飛ばすのはおすすめできません。

1# VPS 側

2curl -fsSL https://tailscale.com/install.sh | sh

3sudo tailscale up --ssh=true

4# VPS の Tailscale IP(100.x.x.x)を控える

5# Gateway を Tailscale ネットワークで待ち受けるよう設定

6openclaw config set gateway.listen "100.x.x.x:18789"ローカル端末には から Tailscale をインストールしてください。両方の端末が同じ Tailscale アカウントを使っている必要があります。

Tailscale 以外を使いたい場合の代替案:

| 項目 | Tailscale | Cloudflare Tunnel | WireGuard | |---|---|---|---| | セットアップ時間 | 5分 | 10〜15分 | 20〜30分 | | コスト | 無料(個人利用) | 無料 | 無料 | | NAT 越え | 自動 | 自動 | 手動 |

ここまでできたら、ローカル端末から VPS の Tailscale IP に ping を返せるはずです。できない場合は、両方の端末が同じ Tailscale アカウントでログインしているか確認してください。

ステップ3: ローカル端末に Node Host を入れる

Node Host は、VPS の Gateway から Chrome にブラウザ指示を中継する役目です。つまり、サーバーとブラウザをつなぐ通訳です。

1# node host パッケージをインストール

2npm install -g @openclaw/node-host

3# ステップ1で作成した gateway トークンを設定

4export OPENCLAW_GATEWAY_TOKEN="your-token-here"

5# VPS の Tailscale IP を指定して node host を起動

6openclaw node install --host 100.x.x.x --port 18789

7# VPS 側から接続を承認

8openclaw node approve <node-id>node が接続され、承認済みになったという表示が出ればOKです。承認が止まる場合は、VPS 側の Gateway プロセスを再起動してください。

ステップ4: OpenClaw の Chrome 拡張機能を入れる

この拡張機能によって、エージェントがブラウザのタブを直接操作できるようになります。Chrome Web Store で「OpenClaw Browser Relay」を検索して入れることもできます。

1# 拡張機能ファイルをインストール

2openclaw browser extension install

3# あるいは手動で:

4# 1. chrome://extensions を開く

5# 2. 右上の「Developer mode」を有効化

6# 3. 「Load unpacked」をクリック → 拡張機能フォルダを選択

7# 4. ツールバーに固定

8# 5. バッジが「ON」と表示されるか確認バッジが「ON」なら準備完了です。もし「OFF」のままなら、下のトラブルシューティングへ進んでください。

ステップ5: 最初の OpenClaw ブラウザ自動化タスクを実行する

対象のタブを開いて、OpenClaw のチャット画面から次のような簡単な指示を試してください。

1https://books.toscrape.com に移動して、ページ内のすべての本のタイトルと価格を抽出して期待される流れ: 指示送信 → エージェントがスナップショット取得(ページ要素を番号付きで認識) → データ抽出 → JSON または CSV で構造化出力が返る

経験上のコツとして、最初はとてもシンプルなプロンプトから始めてください。細かく説明しすぎると、逆にAIが混乱することがあります。まずは短く伝え、必要なら後から補足するほうがうまくいきます。

1ページに20冊ある場合、所要時間は30〜60秒程度が目安です。構造化データが返ってきたら、OpenClaw のブラウザ自動化セットアップは成功です。

Windows での OpenClaw ブラウザ自動化:ネイティブな導入方法

OpenClaw の多くの解説は macOS か Linux を前提にしています。Windows を使っているなら、もう気づいているはずです。あるフォーラム投稿にはこうありました。「概念的にはどれも正しそうだったが、どれも Windows ネイティブ向けには作られていなかった」と。

ここでは、実際に動く方法だけを紹介します。

選択肢A: Windows で Chrome Remote Debugging を使う(推奨のネイティブ方法)

Windows で最も安定しやすい方法です。PowerShell を開いて、remote debugging を有効にした Chrome を起動します。

1& "C:\Program Files\Google\Chrome\Application\chrome.exe" --remote-debugging-port=9222その場所に Chrome がない場合は、次を試してください。

1# 別の場所を確認

2Get-ChildItem "C:\Program Files*\Google\Chrome\Application\chrome.exe" -Recurse

3# あるいは AppData を確認

4& "$env:LOCALAPPDATA\Google\Chrome\Application\chrome.exe" --remote-debugging-port=9222その後、openclaw.json の設定で cdpUrl を ws://localhost:9222 にして、OpenClaw を Remote CDP 経由で接続するように設定します。

選択肢B: Windows のフォールバックとして Docker Desktop を使う

ネイティブな方法でうまくいかない場合、Windows の Docker Desktop で headless Chromium コンテナを動かせます。

1docker run -d --name openclaw-browser -p 9222:9222 --shm-size=2g browserless/chrome

2# OpenClaw 側の設定: cdpUrl: "ws://localhost:9222"ひと手間増えますが、一部のユーザーにとってはより安定します。動くけれど、スマートとは言いにくい方法です。

Windows 特有のエラー一覧

| エラー | 原因 | 解決策(PowerShell) |

|---|---|---|---|

| Port 9222 already in use | 別の DevTools セッションが開いている | Get-Process -Id (Get-NetTCPConnection -LocalPort 9222).OwningProcess | Stop-Process -Force |

| Chrome binary not found | パスが違う | Get-ChildItem "C:\Program Files*\Google\Chrome\Application\chrome.exe" -Recurse |

| Tailscale connection refused | Windows Firewall がブロックしている | New-NetFirewallRule -DisplayName "OpenClaw" -Direction Inbound -LocalPort 18789 -Protocol TCP -Action Allow |

| npm permission errors | 管理者として実行していない | PowerShell を管理者権限で起動するか、nvm-windows を使う |

上のコマンドはすべて PowerShell 用です。bash ではありません。そのままコピー&ペーストしてください。

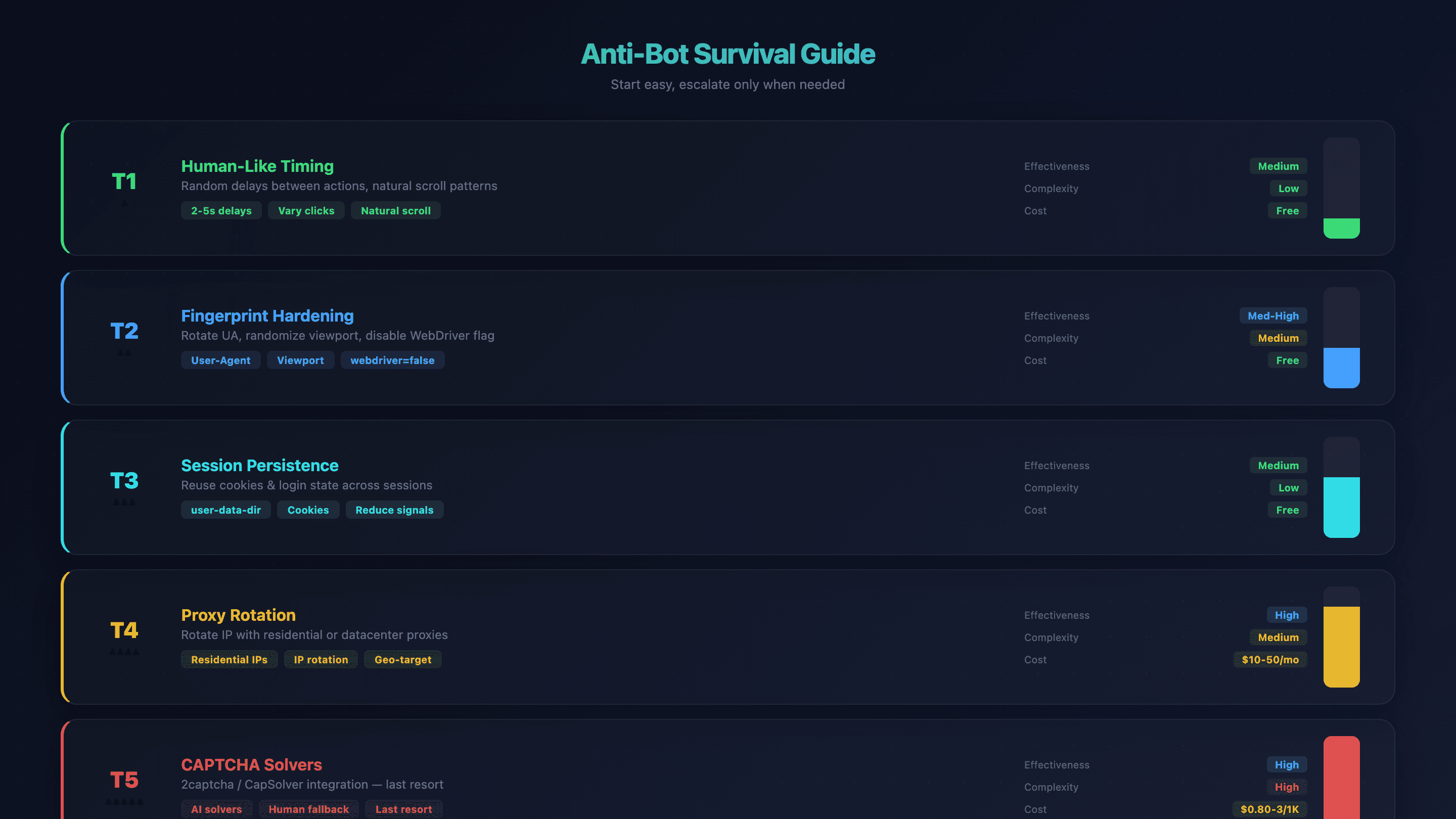

OpenClaw ブラウザ自動化のための bot 対策サバイバルガイド

bot 検知は、OpenClaw ユーザーが最も悩まされるポイントです。OpenClaw の標準 Chromium には 。そのため、WebDriver フラグ、画面サイズ、フォント指紋、IP 評価などでサイトに見抜かれます。私も、数秒でブロックされる様子を何度も見てきました。

ただし、対策には段階があります。まずは簡単な方法から始め、必要になったら次に進めば十分です。

Tier 1: 人間らしい速度と動きにする

プロンプトの中で、操作の間にランダムな待機を入れてください。機械のように連打させるのではなく、「各クリックの間に2〜5秒待つように」と指示します。AI はある程度タイミングをばらつかせますが、明示的に伝えるとさらに自然になります。

効果: 中 | 難易度: 低 | コスト: 無料

Tier 2: 指紋を強化する

User-Agent を変え、viewport サイズをランダム化し、navigator.webdriver フラグを OpenClaw 側で自動的に無効化します(--disable-blink-features=AutomationControlled を利用)。

1# カスタムヘッダーを設定

2openclaw browser set headers --headers-json '{"User-Agent":"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 Chrome/124.0.0.0 Safari/537.36"}'

3# viewport をランダム化

4openclaw browser set viewport 1366 768

5# タイムゾーンとロケールを設定

6openclaw browser set timezone America/New_York

7openclaw browser set locale en-USより強い検知回避が必要な場合、コミュニティでは Camoufox(Firefox ベースのアンチ検知ブラウザで、C++ レベルのフィンガープリント偽装を行うもの)が推奨されています。

効果: 中〜高 | 難易度: 中 | コスト: 無料

Tier 3: セッションを保持する

user-data-dir を使って Cookie やログイン状態をセッション間で維持します。これにより、bot 対策に引っかかりやすい「新規ブラウザ」っぽさを減らせます。

1openclaw config set browser.profiles.persistent.userDataDir "/path/to/chrome-profile"

2openclaw config set browser.profiles.persistent.cdpPort 18802効果: 中 | 難易度: 低 | コスト: 無料

Tier 4: プロキシを切り替える

タイミング調整や指紋調整だけでは足りない場合、IP を切り替えます。住宅回線系のプロキシは検知されにくく、データセンター系は高速で安価です。

1export OPENCLAW_BROWSER_PROXY="http://user:pass@proxy.example.com:8080"注意: ブラウザレベルのプロキシ設定は、現時点ではまだ要望段階です(GitHub Issue #8079)。今は OS レベルまたは環境変数での設定が必要です。

| プロバイダー | Residential | Datacenter | 向いている用途 | |---|---|---|---| | Bright Data | $4–8.40/GB | $0.43–0.60/GB | 企業用途、高品質重視 | | Oxylabs | $6–8/GB | $0.48–5/GB | 大規模スクレイピング | | Decodo (Smartproxy) | $4–5.50/GB | $0.70–5/GB | 中程度の予算 | | IPRoyal | $5–7/GB | -- | 低予算向け | | DataImpulse | $1/GB | -- | 最安重視 |

効果: 高 | 難易度: 中 | コスト: 月額 $10〜50

Tier 5: CAPTCHA 解決サービスを使う

最終手段です。2captcha や CapSolver を組み込みます。

| サービス | reCAPTCHA v2 | Cloudflare Turnstile | 待ち時間 | |---|---|---|---| | 2Captcha | $2.99/1K | $2.99/1K | 15〜45秒(人力) | | CapSolver | $0.80–1.50/1K | $0.80/1K | 0.5〜10秒(AI) |

FlareSolverr(オープンソースの Cloudflare 回避ツール)は、2025〜2026年時点では Cloudflare の対策強化により信頼性が低いとされています。

効果: 高 | 難易度: 高 | コスト: 解決1,000件あたり $0.80〜3

bot 対策まとめ

| 手法 | 効果 | 難易度 | コスト | |---|---|---|---| | 人間らしい速度 | 中 | 低 | 無料 | | 指紋強化 | 中〜高 | 中 | 無料 | | セッション保持 | 中 | 低 | 無料 | | プロキシ切り替え | 高 | 中 | 月額 $10〜50 | | CAPTCHA 解決 | 高 | 高 | 解決1,000件あたり $0.80〜3 |

bot の壁に何度もぶつかって、とにかくデータだけ欲しいなら、 のクラウドスクレイピングは公開サイト向けに bot 対策を標準で処理します。プロキシ設定も、指紋調整も不要です。毎回 AI が管理されたクラウド基盤経由でサイトを読み取る、まったく別のアプローチなので、一般的なデータ抽出なら bot 対策の消耗戦を丸ごと回避できます。

実際の出力:OpenClaw ブラウザ自動化で何ができるのか

45〜75分のセットアップに取りかかる前に、最終的にどんな結果が得られるのか見ておきたいはずです。もっともです。ここでは、3つのワークフロー例と実際の出力を紹介します。

例1: Webスクレイピング — 商品データの抽出

プロンプト: 「https://books.toscrape.com に移動して、ページ内のすべての本のタイトルと価格を抽出して」

出力(最初の5行):

| タイトル | 価格 | |---|---| | A Light in the Attic | £51.77 | | Tipping the Velvet | £53.74 | | Soumission | £50.10 | | Sharp Objects | £47.82 | | Sapiens: A Brief History of Humankind | £54.23 |

経過時間: 1ページ20件で約45秒。ページ送りには「Next ボタンをクリックして5ページ分繰り返して」と追加指示が必要でした。合計で約100件、約3分です。

例2: フォーム自動化 — 複数項目のWebフォーム入力

シナリオ: 会社名、連絡先、製品への関心などを入力する仕入先問い合わせフォーム。

エージェントはフォームのスナップショットを取得し、各入力欄を参照番号で識別して、順番に入力していきます。入力前は空欄、入力後はすべて埋まり、確認メッセージが表示されます。ドロップダウンやチェックボックスもスナップショットで認識し、該当する選択肢を選びます。

経過時間: 6項目のフォームで約30秒。

例3: ページ送り — 複数ページにまたがるスクレイピング

最初の結果: 1ページ目から20件。そこに「Next をクリックして全ページ繰り返して」と指示すると、books.toscrape.com の50ページから合計1,000件を取得できます。エージェントはスナップショットで「Next」ボタンを検出し、ループでクリックします。

経過時間: 1,000件の全データで約12分。

Thunderbit で同じスクレイピングをした場合

同じ books.toscrape.com の例を、 で行うと次の流れになります。

- を入れる(約30秒)

- ページを開く

- 「AI Suggest Fields」をクリック → AI が Title、Price、Availability、Rating を検出

- 「Scrape」をクリック → 20件を抽出

- ページ送りを使う → 全ページを抽出

- Google Sheets に無料でエクスポート

合計時間: ゼロからデータ書き出しまで約3分。VPS も CLI も設定も不要です。

大事なのは、どちらが「より優れているか」ではありません。実際にやりたいことに対して、どちらが合っているかです。

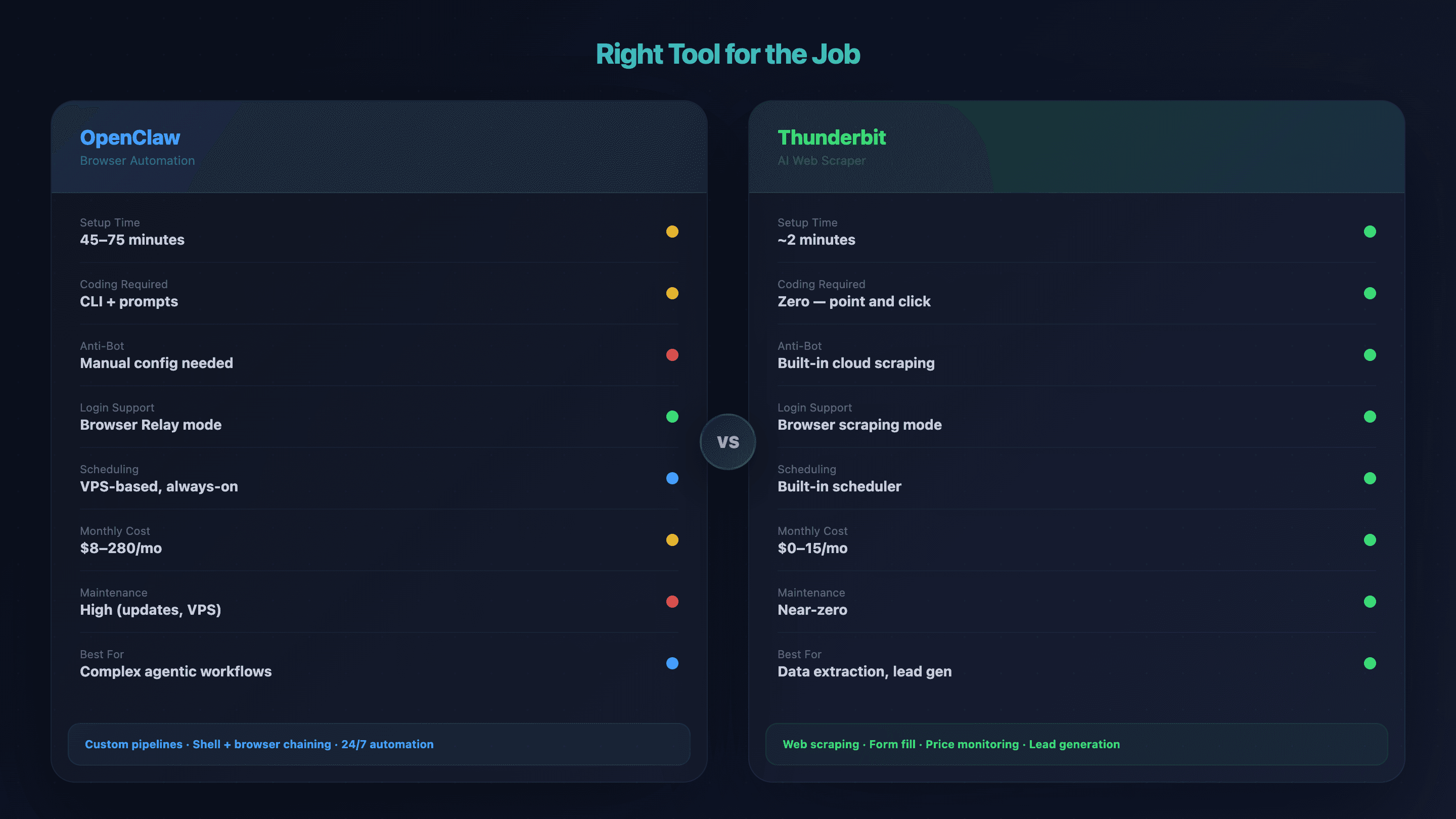

OpenClaw ブラウザ自動化がやりすぎになるケースと、その代替

OpenClaw は、ログイン必須の複雑なワークフロー、ブラウザ操作とシェルコマンドの連携、VPS 上での24時間稼働など、多段階のエージェント型自動化に強いです。ただし、「一覧ページから商品データを抜きたい」「ディレクトリからメールアドレスを取りたい」という目的なら、VPS + Tailscale + node host まで含めた構成は少し大げさかもしれません。

私は、60分以上かけてセットアップしたのに、もっと簡単なツールなら2分で終わる作業に取り組んでいる人を何度も見てきました。これはあまり良い取引ではありません。

目的に合うツール:比較表

| 項目 | OpenClaw Browser Automation | Thunderbit | |---|---|---| | セットアップ時間 | 45〜75分(VPS + Tailscale + node host) | 約2分(Chrome 拡張機能を入れるだけ) | | コーディングの必要性 | CLI + 自然言語プロンプト | なし — 「AI Suggest Fields」→「Scrape」をクリックするだけ | | bot 対策対応 | 手動(プロキシ、指紋設定) | クラウドスクレイピングを標準搭載 | | ログイン壁の処理 | ✅ Browser Relay / リモートデバッグ | ✅ ブラウザスクレイピングモード | | サブページの拡張取得 | ワークフローごとに自作 | 1クリックでサブページ抽出 | | 定期実行 / 24時間稼働 | VPS ベースで常時稼働 | を標準搭載 | | 月額コスト | $8〜14(趣味利用)〜 $110〜280(高負荷) | $0(無料枠)〜 $15/月 | | 保守負担 | 大(更新、VPS、デバッグ) | ほぼなし — AI がレイアウト変更に追従 | | 向いている用途 | 複雑なエージェントワークフロー、独自パイプライン | データ抽出、フォーム入力、リード獲得、価格監視 |

ユースケース別の選び方

- ブラウザ操作、メッセージアプリ、データベースを連携する多段階のエージェントワークフローが必要 → OpenClaw が適しています。

- ターミナルを触らずに、Webサイトのデータ抽出、フォーム入力、価格監視をしたい → のほうが早いです。 すばやいデモは でも確認できます。

- 特定の API エンドポイント向けに軽いスクリプトが欲しい → シンプルな Python の requests スクリプトで十分かもしれません。

チームの誰かに「この作業にはどのツールを使えばいい?」と聞かれたとき、私はいつもこの基準で判断しています。

OpenClaw ブラウザ自動化でよくあるエラーと解決法

このセクションはブックマーク推奨です。症状別に整理してあるので、Ctrl+F で原因を探せます。

「Connection Refused」または Node Host が接続できない

考えられる原因(順番に確認):

- 両方の端末で Tailscale が動いていない → 両方で

tailscale statusを実行 - Gateway が Tailscale ネットワークではなく localhost を見ている →

openclaw config set gateway.listen "100.x.x.x:18789" - IP アドレスの間違い →

tailscale ip -4で確認 - ファイアウォールが 18789 番ポートを遮断している →

sudo ufw allow 18789/tcp(Linux)または Windows Firewall のルールを追加

拡張機能のバッジが「OFF」のまま、またはタブが検出されない

- 拡張機能が Developer mode で読み込まれていない →

chrome://extensionsで Developer mode を有効化し、再読み込み - Node host が起動していない →

openclaw node startで再起動 - Chrome インスタンスが競合している → すべての Chrome を閉じて再起動し、拡張機能を再読み込み

エージェントが空データ、または誤ったデータを返す

- ページがまだ完全に読み込まれていない: 「移動後3秒待ってから抽出して」と指示する。SPA は描画に時間がかかることがあります。

- bot ブロック: 実データではなく CAPTCHA ページを見ていないか確認。Sandbox Chromium から Browser Relay に切り替えます。

- スナップショットが古い: 「新しいスナップショットを取得して」と伝える。ナビゲーション後は参照番号が古くなります。

「Port 9222 Already in Use」

Chrome DevTools や別の自動化ツールがすでにそのポートを使っているときによく起こります。

1# macOS/Linux

2lsof -i :9222 | grep LISTEN

3kill -9 <PID>

4# Windows PowerShell

5Get-Process -Id (Get-NetTCPConnection -LocalPort 9222).OwningProcess | Stop-Process -ForceVPS のメモリが足りなくなる

ヘッドレスブラウザ1つあたり、RAM を 400〜800MB 使います。複数同時に動かすと、小さな VPS は簡単に落ちます。

対策:

- 画像 / CSS / フォントの読み込みを無効化:

openclaw browser network route --abort "**/*.{png,jpg,gif,css,woff2}" - 同時起動数を RAM に合わせて制限する

- Docker 設定で

shm_size: '2gb'を使う - セッション休止を有効化:

OPENCLAW_HIBERNATE_AFTER=300 - 必要に応じて 4GB 以上の VPS にアップグレードする

OpenClaw ブラウザ自動化を安定して動かすコツ

長く運用してきて身についたベストプラクティスをいくつか紹介します。

- データ取得だけが目的なら、画像・CSS・フォントは無効化してください。リソース消費がかなり減り、速度も上がります。

- タスクごとに新しいブラウザを起動せず、同じインスタンスを再利用してください。新規起動は RAM を食い、bot 対策にも引っかかりやすくなります。

- 最初はシンプルなプロンプトから始めるのが基本です。理解がずれたときだけ詳細を足してください。説明しすぎると、助けるどころか混乱を招くことがあります。

- VPS のリソース使用量(CPU、RAM)を監視し、限界に達する前にスケールアップしましょう。深夜2時に落ちた VPS を調べるのは本当に大変です。

- OpenClaw と Chrome 拡張機能は更新を保つべきですが、まずはステージング環境で確認してください。OpenClaw は月に約 リリースされますが、すべてがスムーズとは限りません。

- 毎日・毎週の繰り返し作業(価格チェック、リード抽出など)には、Thunderbit の を使えば、自然な言葉で間隔を設定でき、VPS の保守から完全に解放されます。

倫理面と法的な注意点

短くても重要です。robots.txt を尊重し( で IETF 標準化されています)、リクエストはレート制限し、対象サイトの利用規約を確認し、個人データは GDPR や各種プライバシー法に従って扱ってください。 の判例(2022年)は、公開されているデータのスクレイピング自体が CFAA に違反しないことを示しましたが、何をしてもよいという意味ではありません。自動化を責任を持って使うことは、自分と自社の両方を守ります。このテーマについては、 のガイドも参考にしてください。

まとめ

OpenClaw のブラウザ自動化は、自然言語で制御できる複雑な多段階Webワークフローに非常に強力な選択肢です。重要なポイントは次の5つです。

- 最初にブラウザモードを正しく選ぶこと(Sandbox、Relay、Remote CDP)。これだけでデバッグ時間を大きく節約できます。

- Windows でも使える道はあるものの、Windows 向けのコマンドやファイアウォール、パスの問題には注意が必要です。

- bot 対策は本当に難しいです。まずはタイミング調整や指紋対策など、簡単なものから始め、必要に応じて段階的に強化してください。

- 導入前に出力を確認すること。一覧ページから構造化データを取れれば十分なら、 のようなノーコードツールのほうが、数分で始められ、保守もほぼ不要です。

- 保守コストを見込んでおくこと。OpenClaw は月に約13回リリースされ、VPS の費用も積み上がり、デバッグも運用の一部です。

まずは簡単な方法を試したいなら、 があります。拡張機能を入れてページを1つスクレイピングし、自分の用途に合うかを見てから、VPS を使った本格構成に進むのもよいでしょう。OpenClaw の道を選ぶなら、このガイドをブックマークしておいてください。いずれエラー一覧が必要になります。そして、ブラウザインスタンスの RAM がいつでも足りていますように。

よくある質問

OpenClaw の Sandbox Chromium と Browser Relay の違いは何ですか?

Sandbox Chromium は、サーバー上でヘッドレスブラウザを起動します。速くてセットアップも軽いですが、毎回新しいプロファイルを使うためログインセッションは維持できず、bot 対策にも見つかりやすくなります。Browser Relay は、ローカル端末の実際の Chrome に指示を送るため、ログインが使え、実際のブラウザ指紋も引き継がれ、サイトから自動化と判定されにくいです。代わりに、ネットワーク中継のぶん遅く、機能制限(バッチ処理不可、ダウンロード介入不可)があります。

WSL を使わずに Windows で OpenClaw のブラウザ自動化はできますか?

はい、できますが条件があります。最も安定しやすいネイティブ Windows の方法は、PowerShell から Chrome Remote Debugging を使うことです(chrome.exe --remote-debugging-port=9222)。それでも不安定なら Docker Desktop が代替になります。Windows での Node Host の完全なネイティブ対応にはまだ粗い部分があるため、最新のドキュメントを確認し、ファイアウォールやバイナリのパスの違いに備えてください。このガイドの Windows セクションのコマンドはすべて PowerShell です。bash ではありません。

OpenClaw のブラウザ自動化で CAPTCHA はどう対処しますか?

まずは検知されにくくすることから始めます。人間らしい待機を入れ、ブラウザ指紋を強化し、セッションを保持して「新規ブラウザ」扱いを避けます。それでも CAPTCHA が出るなら、2captcha(解決1,000件あたり $2.99)や CapSolver($0.80〜1.50/1K、AI ベース)のような解決サービスを組み込みます。公開サイトで単にデータが欲しいだけなら、Thunderbit のクラウドスクレイピングならプロキシや CAPTCHA の設定なしで自動的に処理できます。

OpenClaw のブラウザ自動化は無料で使えますか?

OpenClaw 自体はオープンソース(MIT ライセンス)で無料です。ただし、実行にはインフラが必要です。VPS が月額 $4〜15 程度、必要に応じてプロキシ切り替え(月額 $10〜50)や CAPTCHA 解決サービス(解決ごと課金)が追加されます。月額合計は、趣味利用なら $8〜14、高負荷運用なら $110〜280 ほどになります。対して、 なら、インフラ費用なしで基本的なスクレイピングができます。

OpenClaw のエージェントが空結果ばかり返す場合はどうすればいいですか?

確認する順番は3つです。まず、ページが完全に読み込まれていない可能性があります。「移動後3秒待ってから抽出して」と指示してください。次に、bot の壁に当たっている可能性があります。エージェントが本物の内容ではなく CAPTCHA ページを見ているなら、Sandbox Chromium から Browser Relay に切り替えます。最後に、スナップショットが古い可能性があります。ナビゲーション後は「新しいスナップショットを取得して」と伝えてください。どれも当てはまらない場合は、VPS のメモリ使用量を確認してください。ブラウザが落ちても、空結果だけ静かに返すことがあります。