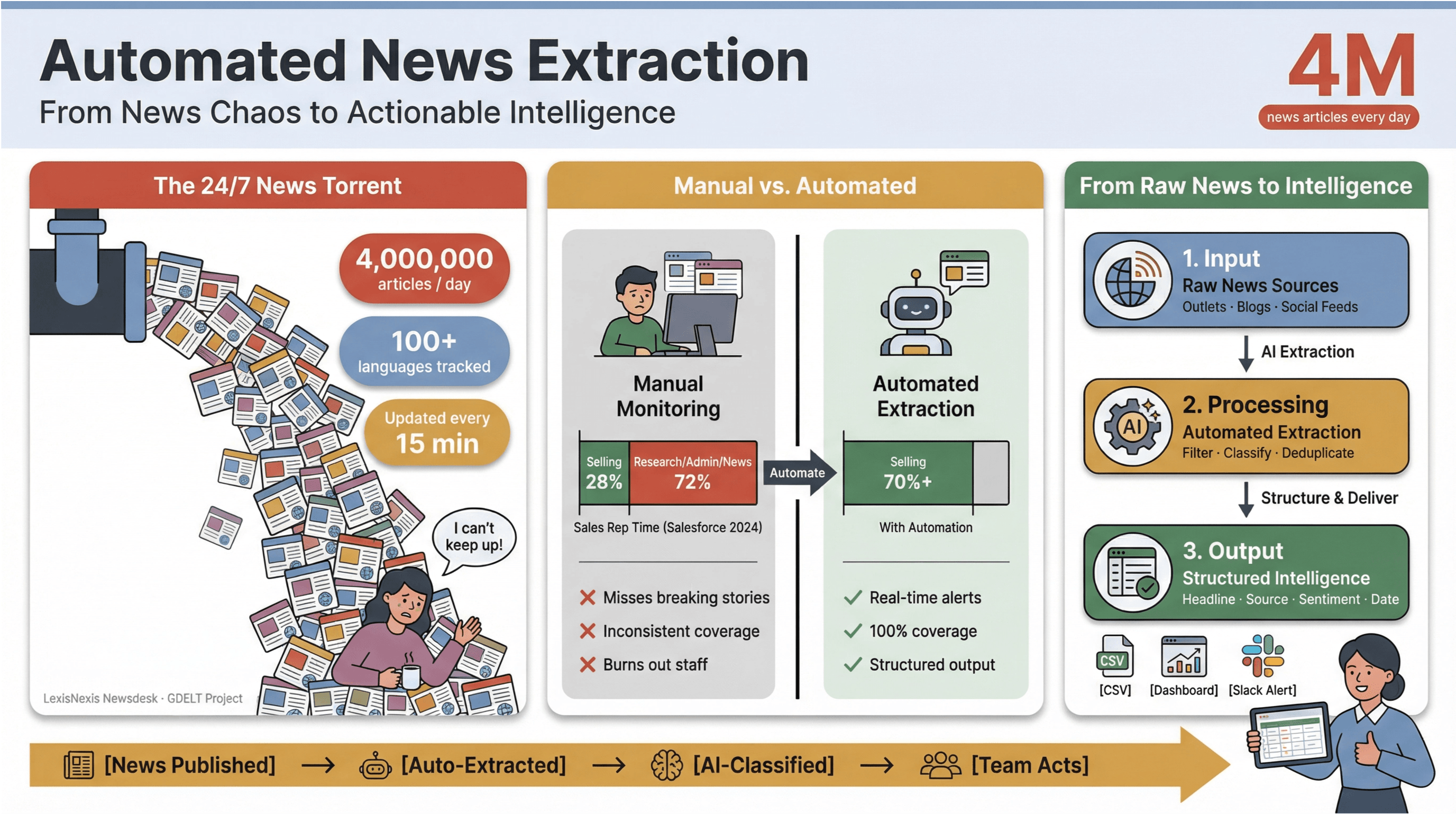

今日のデジタルニュースの流れは、まさに目が回るほどの速さです。毎分、主要メディアからニッチなブログ、ソーシャルフィードに至るまで、何千もの見出しが公開され、更新され、ひそかに修正されています。感覚をつかむために言うと、 は毎日 400万件以上 のニュース記事を取り込み、 は 100以上の言語 のニュースを追跡し、世界中のフィードを 15分ごと に更新しています。メディア、調査、ビジネスインテリジェンスに携わる人にとって、この洪水のような情報を手作業で追いかけるのは、コーヒーカップで沈みゆく船の水をくみ出すようなものです。

ニュースの手動モニタリングが、どれほど時間とリソースを消耗するかは身をもって見てきました。Salesforce によると、営業チームが実際に営業活動に使う時間は週の3分の1にも満たず、 しかありません。残りは調査、事務作業、そしてもちろん、延々とニュースタブを切り替える作業に消えています。だからこそ、自動ニュース抽出は現代のチームにとって秘密兵器になっているのです。24時間365日動き続けるニュースサイクルの混乱を、構造化された実用的なインテリジェンスへと変える唯一の方法だからです。しかも、スタッフを疲弊させたり、重要なニュースを見逃したりする必要はありません。

ここでは、自動ニュース抽出が本当に意味するもの、リアルタイムのニュースデータに関心がある人にとってなぜ必須なのか、そして最適なツールを使って堅牢でコンプライアンスに配慮したワークフローをどう構築するかを見ていきます。 が、非エンジニアの私の母でも驚くほど簡単にこの作業をこなせる理由も含めて紹介します。

自動ニュース抽出:現代のニュースルームに不可欠な理由

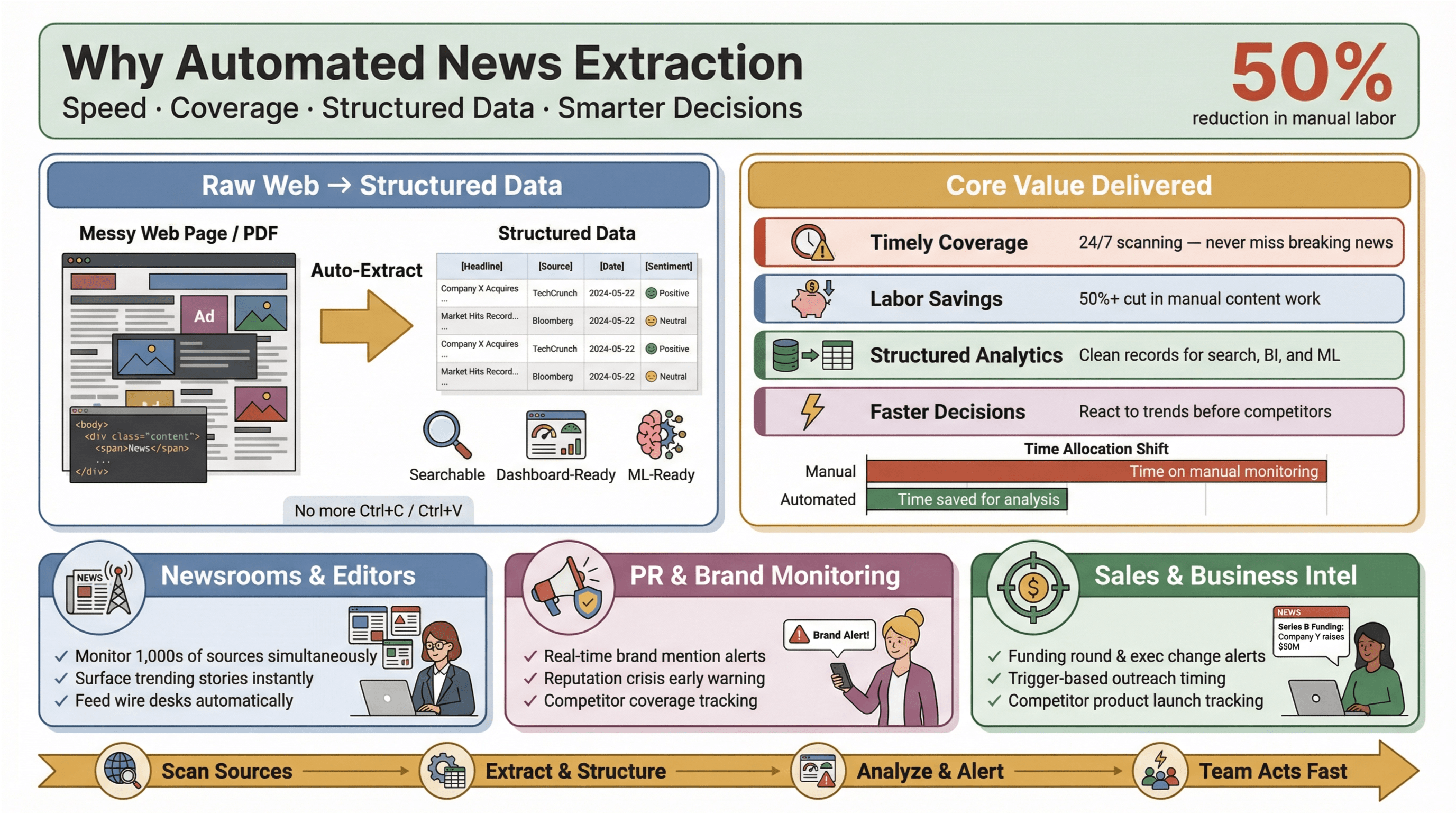

自動ニュース抽出は、その名のとおりです。ソフトウェアを使って ニュースコンテンツを自動収集 し、それを構造化された検索可能なデータに変換することです。雑然としたウェブページやPDFではなく、行と列のデータとして扱えるようにするイメージです。実務では、何百、何千もの情報源を監視し、見出し、タイムスタンプ、著者、本文などの主要項目を抽出して、ダッシュボード、アラート、下流の分析に流し込めます。しかも、Ctrl+C / Ctrl+V に触れる必要はありません。

なぜ重要なのでしょうか。今日のニュース環境では、スピードがすべて だからです。ニュースルームの編集者でも、ブランド言及を追うPR担当者でも、競合の動きを追跡するビジネスアナリストでも、最初に気づけるかどうかが、機会をつかむか後追いになるかの分かれ目になります。自動抽出ツールは、小規模チームでも大きな組織に匹敵する力を発揮することを可能にします。ウェブ全体からリアルタイムのニュースデータを集め、手作業を減らし、最も重要な記事を見つけやすくしてくれます。

なぜ重要なのでしょうか。今日のニュース環境では、スピードがすべて だからです。ニュースルームの編集者でも、ブランド言及を追うPR担当者でも、競合の動きを追跡するビジネスアナリストでも、最初に気づけるかどうかが、機会をつかむか後追いになるかの分かれ目になります。自動抽出ツールは、小規模チームでも大きな組織に匹敵する力を発揮することを可能にします。ウェブ全体からリアルタイムのニュースデータを集め、手作業を減らし、最も重要な記事を見つけやすくしてくれます。

その効果は実際に表れています。調査によると、自動化によってコンテンツ更新にかかる手作業を 少なくとも50% 削減でき、分析や意思決定に使える時間を増やせます。

ニュース業界における自動ニュース抽出のコア価値

では、実務に落とし込みましょう。自動ニュース抽出は、ニュースルームやビジネスチームに何をもたらすのでしょうか。

- タイムリーで網羅的なカバレッジ:誰かがフィードの確認を忘れていたせいで速報を逃す、ということがなくなります。自動ツールは24時間365日ソースをスキャンし、重要な情報を見逃しません。

- 労力とコストの削減:小規模・中規模チームでも、大人数を抱える大企業と同じ数のソースを監視できます。インターンを大量に雇う必要はありません。

- 分析用の構造化データ:非構造化の記事を一件ずつ読み解く代わりに、検索、ダッシュボード、機械学習にすぐ使える、整ったレコードを得られます。

- より速く、より賢い意思決定:リアルタイムのニュースデータがあれば、競合より先に市場の変化、PR危機、新たなトレンドに対応できます。

PR・広報の例を見てみましょう。 や のようなプラットフォームは、リアルタイムのメディアモニタリングを、評判を守り、悪影響のある報道に迅速に対処するために不可欠だと位置づけています。営業では、リアルタイムのニュースアラートが見込み客へのアプローチのための「コンテキストカード」になります。資金調達ラウンド、経営陣の交代、製品発表など、絶好のタイミングで動き出せる材料になるのです。

さまざまな用途に合ったニューススクレイピングツールの選び方

ニューススクレイピングツールはどれも同じではありません。最適な選択肢は、目的、技術的な慣れ、そして関心のあるニュースの種類によって変わります。選定の参考になる枠組みはこちらです。

使いやすさとアクセス性の評価

多くのビジネスユーザーやジャーナリストにとって、使いやすさは譲れません。コード不要で、複雑なセットアップもなく、すぐに使えるツールが必要です。、、 のようなノーコード/ローコードのプラットフォームなら、視覚的にスクレイパーを作れます。クリックして、抽出するだけです。

とくに Thunderbit は、2ステップのプロセス が強みです。欲しい内容を説明すると、AI が抽出項目を提案し、そのまま「スクレイプ」を押すだけ。非技術者でも、数時間ではなく数分でニュースデータのパイプラインを構築できます。

セキュリティとデータプライバシーの考慮

データが強力であるほど、責任も重くなります。ニューススクレイピングツールは機密性の高いコンテンツにアクセスすることが多いため、セキュリティとコンプライアンス を最優先にすべきです。確認したいポイントは以下のとおりです。

- データの暗号化(転送中および保存時)

- 明確なプライバシーポリシー(たとえば Thunderbit は、ユーザーデータを販売せず、選択したスクレイプ対象のコンテンツにのみアクセスすると明記しています)

- きめ細かな権限設定(特にブラウザ拡張機能では、ツールがどのデータにアクセスできるかを必ず確認してください)

- 地域法への準拠(GDPR、CCPA、そしてEUユーザー向けには )

さらに安心したいなら、信頼できるベンダーを選び、拡張機能の権限を確認し、必要最小限のアクセスにとどめましょう。

ニュースの種類と業界ニーズに合わせたツール選定

ツールによって得意分野は異なります。

- 金融: や のようなAPIは、金融ニュース向けにクラスタリング、感情分析、イベント検出を提供します。

- テック・スタートアップ:Thunderbit や Octoparse を使ったカスタムスクレイピングなら、ニッチなブログ、プレスリリース、イベント一覧を狙えます。

- 政治・政策: や のようなライセンス付きデータベースなら、有料ソースやアーカイブにアクセスできます。

APIのないソースを含め、主要メディア、ニッチメディア、海外ソースをまとめて監視する必要があるなら、Thunderbit のような柔軟なAI駆動スクレイパーが最適です。

リアルタイムニュースデータ抽出でThunderbitが持つ独自の強み

では、 が自動ニュース抽出において際立った選択肢である理由を見ていきましょう。とくに、リアルタイムのニュースデータ を技術的なストレスなしで扱いたい場合に最適です。

Thunderbit は、ビジネスユーザー、ジャーナリスト、アナリスト向けに設計された AI搭載のウェブスクレイパーChrome拡張機能 です。どんなサイトからでも、最新かつ構造化されたニュースコンテンツを取得できます。私がこれを愛用している理由は次のとおりです。

- AIによる項目提案:Thunderbit がニュースページを読み取り、見出し、タイムスタンプ、著者、要約など、抽出すべき最適な列を自動提案します。セレクターやテンプレートをいじる必要はありません。

- サブページスクレイピング:見出しだけでなく本文全体が必要ですか? Thunderbit は各ニュースリンクを巡回し、本文、エンティティ、タグを抽出して、ひとつの構造化テーブルにまとめられます。

- 一括エクスポートと即時更新:ニュースデータを Excel、Google Sheets、Airtable、Notion にワンクリックで直接エクスポートできます。もう、延々とコピペしたりCSVをさばいたりする必要はありません。

- 定期スクレイピング:ニュースパイプラインを新鮮に保つために、毎時、毎日、または任意の間隔で定期実行を設定できます。速報、マーケット監視、継続調査に最適です。

- 柔軟性:Thunderbit のAIはレイアウト変更やロングテールのニュースサイトにも適応するため、壊れたスクレイパーの修正に費やす時間を減らし、データ分析により多くの時間を使えます。

と 4.8 星の評価を獲得しており、PRモニタリングから競合インテリジェンスまで、世界中のチームに信頼されています。

AIによる項目検出とサブページスクレイピング

Thunderbit の強力な機能のひとつが、AI駆動の項目検出 です。「AIで項目を提案」をクリックするだけで、ツールがニュースページをスキャンし、タイトル、日付、著者、要約などの重要項目を特定します。たとえば「四半期決算に言及している場合はこの記事を『業績』としてタグ付けする」といったカスタム項目も追加・調整でき、あとは Thunderbit のAIに任せられます。

ニュースでは、サブページスクレイピングが大きな変化をもたらします。ホームページやカテゴリ一覧から見出しを抽出し、Thunderbit に各記事URLを巡回させて本文、エンティティ、さらには画像まで取得できます。これにより、検索、ダッシュボード、下流のAI分析にすぐ使える 完全で情報量の多いニュースレコード が手に入ります。

一括エクスポートと即時更新

Thunderbit を使えば、ニュースデータのエクスポートはとても簡単です。ワンクリックで、構造化されたニュースフィードを Google Sheets、Airtable、Notion に送ることも、CSV/Excel としてダウンロードすることもできます。スプレッドシートやBIツールを日常的に使うチームにとっては、非常に大きな時短になります。

さらに Thunderbit は 定期スクレイピング に対応しているため、毎時、毎日、または独自のスケジュールで実行できます。これにより、ニュースデータを常に最新に保てます。Googleアラートが数日遅れで記事を拾うのを待つ必要はもうありません。

リアルタイムニュースデータソリューションにおける運用上の課題を乗り越える

どんなに優れたツールでも、リアルタイムのニュース抽出には独自の課題があります。よくあるものへの対処法は次のとおりです。

遅延とデータの鮮度を管理する

- ニュースの速度に合わせてスクレイプの頻度を設定する:速報ニュースなら、 に合わせて15〜30分ごとに実行します。更新の遅い分野なら、毎日または毎時でも十分な場合があります。

- 公開時刻と取得時刻の差を監視する:記事が公開されてからシステムが取得するまでの差を追跡します。遅延が大きくなったら、ブロックや速度低下を確認しましょう。

- 「ひそかな修正」を再スクレイプで拾う:ニュース記事は公開後に更新されることがよくあります。24時間後に2回目のスクレイプを行い、訂正や目立たない修正を拾いましょう()。

API制限とソースのばらつきを扱う

- APIの利用上限を尊重する:ニュースAPIを使う場合はレート制限に注意し、リクエストを時間的に分散させ、可能なら結果をキャッシュしてください()。

- 重複排除と正規化を行う:ニュース記事は複数URLで配信されたり、更新されたりします。正規URLを記録し、ハッシュ(例:タイトル+日付)を使って重複を避けましょう()。

- 動的コンテンツに対応する:無限スクロールや遅延読み込みのあるサイトでは、動的レンダリングをサポートするツールを使い、レイアウト変更も監視しましょう()。

AIと機械学習が担う、賢いニュースデータ分析

ニュースを抽出するのは、あくまで第一歩です。本当の価値は そのデータを分析し、行動につなげること にあります。ここでAIと機械学習が力を発揮します。

- エンティティ抽出:NLP を使って、各記事に登場する人物、組織、場所を取り出します()。

- トピック分類:記事をトピック、感情、緊急度ごとに自動タグ付けし、より賢いダッシュボードやアラートを実現します()。

- イベントクラスタリング:各社の重複または関連する記事をまとめ、断片的な見出しの洪水ではなく、大局を把握できるようにします。

- パーソナライズとターゲティング:リアルタイムのニュースデータを使って、オーディエンスをセグメント化し、広告ターゲティングを改善し、コンテンツをおすすめすることで、エンゲージメントとROIを高められます。

たとえばPRチームは、拡散する前の新たな危機をリアルタイム分析で見つけていますし、営業チームは資金調達や役員採用といった「トリガーイベント」で見込み客リストを充実させています。

自動ニュース抽出のベストプラクティスチェックリスト

ニュース抽出パイプラインをスムーズに動かすための、すぐ使えるチェックリストです。

| ベストプラクティス | 重要な理由 | 実装方法 |

|---|---|---|

| 頻繁にスクレイプを実行する | データ遅延を最小化し、速報を逃さない | 更新頻度をニュースの速度に合わせる(例:速報なら15分ごと) |

| AI駆動の抽出を使う | レイアウト変更に適応し、設定時間を短縮 | Thunderbit、Diffbot、Zyte API など |

| 重複排除と正規化を行う | 重複アラートを防ぎ、きれいなデータを保つ | 正規URLを記録し、ハッシュで重複排除する |

| 抽出品質を監視する | 欠損項目、ずれ、失敗を検知する | 完了レコード率、遅延、エラー率を追跡する |

| 法務・コンプライアンスの境界を守る | 法的リスクを避け、信頼を維持する | 公式API/フィードを優先し、利用規約を確認し、個人データを最小化する |

| 構造化形式でエクスポートする | 下流の分析を可能にする | CSV、Excel、Sheets、Notion、Airtable |

| 編集後の再スクレイプを予約する | 公開後の変更を拾う | 24時間後/1週間後に記事を再確認する(GDELTモデル) |

| パイプラインを保護する | 機密データを守る | 暗号化、アクセス制御、信頼できるツール |

堅牢な自動ニュース抽出ワークフローの構築

ニュースデータ用の自分だけの「ブラックボックス」を作る準備はできましたか? 手順は次のとおりです。

- 情報源を特定する:監視したいニュースサイト、ブログ、APIを一覧にします。

- 抽出を設定する:Thunderbit などのツールで項目を定義します(AIで項目を提案すれば、とても簡単です)。

- スクレイプを予約する:速報なら毎時、更新がゆっくりなら毎日、というようにニュースの速度に合わせて頻度を決めます。

- サブページで拡張する:見出しごとに全文を抽出し、本文、エンティティ、タグを取得します。

- 重複排除と正規化を行う:正規URLを記録し、レコードをハッシュ化し、項目を標準化します。

- エクスポートして連携する:構造化データを Excel、Google Sheets、Airtable、Notion に送り、分析に使います。

- 監視して適応する:抽出品質を追跡し、レイアウト変更に注意し、必要に応じて調整します。

- コンプライアンスを守る:利用規約を確認し、robots.txt を尊重し、個人データを最小限に抑えます。

視覚的に表すと、ワークフローはこうなります。

情報源 → 抽出(AI項目) → サブページ拡張 → 重複排除 → エクスポート → 分析/アラート → 監視

結論と重要なポイント

自動ニュース抽出は、もはや「あったら便利」なものではありません。ニュースが分刻みで発生し、変化する世界で一歩先を行きたいなら、必須です。ベストプラクティスを守り、適切なツールを使えば、デジタルニュースの大洪水を、安定して使える構造化インテリジェンスの流れへと変えられます。

重要なポイント:

- オンラインニュースの規模と速度は自動化を必要とします。手作業の監視では到底追いつけません。

- 自動ニュース抽出ツールは、時間とコストを削減し、小規模チームでも大規模組織に匹敵するカバレッジを実現します。

- 適切なツール選びでは、使いやすさ、セキュリティ、柔軟性のバランスが重要です。Thunderbit は、AI駆動のシンプルさとリアルタイムエクスポート機能で際立っています。

- 鮮度、重複排除、コンプライアンス、品質監視を軸にワークフローを組み、信頼できる実用的なニュースデータを確保しましょう。

- AIと機械学習は、より高度なターゲティング、パーソナライズ、意思決定を可能にし、価値をさらに引き上げます。

まだ見出しをコピペしたり、Googleアラートが追いつくのを待っているなら、今こそ次の段階へ進むときです。、自動ニュース抽出がどれほど簡単か体験してください。さらに多くのヒント、ワークフロー、深掘り記事は をご覧ください。

よくある質問

1. 自動ニュース抽出とは何ですか? どのように動作しますか?

自動ニュース抽出とは、ソフトウェアを使ってニュース記事を収集し、分析、検索、アラート用の構造化データ(表やJSONなど)に変換するプロセスです。Thunderbit のようなツールはAIを使って、見出し、タイムスタンプ、著者、本文などの主要項目を特定し、ウェブページやAPIから自動で抽出します。

2. なぜリアルタイムのニュースデータはビジネスにとって重要なのですか?

リアルタイムのニュースデータがあれば、市場の動き、PR危機、競合の動きに素早く対応できます。営業、PR、調査のどの分野でも、最新ニュースを把握していれば、より賢く迅速な意思決定ができ、競争で優位に立てます。

3. Thunderbit は非技術者のニューススクレイピングをどう簡単にしますか?

Thunderbit はシンプルな2ステップのプロセスを提供します。欲しいデータを説明すると、AI が項目を提案してくれます。サブページスクレイピングや Excel / Google Sheets への即時エクスポート機能もあるため、非技術者でも数分で堅牢なニュースデータパイプラインを構築できます。

4. ニューススクレイピングにおける法務・コンプライアンス上の注意点は何ですか?

対象サイトの利用規約を必ず確認し、利用可能なら公式APIやフィードを優先し、robots.txt の指示も守ってください。ログイン必須や有料壁のあるコンテンツを無断でスクレイプするのは避け、プライバシー法に適合するよう個人データの収集は最小限にしましょう。

5. ニュース抽出ワークフローを長期的に信頼できる状態に保つにはどうすればいいですか?

定期的にスクレイプを実行し、抽出品質を監視し、Thunderbit のAI駆動抽出のようにレイアウト変更に適応するツールを使いましょう。レコードを重複排除し、公開から抽出までの遅延を追跡し、失敗や欠損項目に対するアラートを設定すれば、パイプラインを健全で最新の状態に保てます。

さらに詳しく