「データはあっても情報は持てるが、データなしに情報を持つことはできない。」 — *

最近の推計では、インターネット上には15億以上のがあり、毎日およそ200万件の新しい投稿が公開されています。こうした膨大なデータの中には、意思決定に役立つ貴重な洞察が眠っています。ただし、ひとつ大きな課題があります。約は非構造化データで、そのままでは使えず、追加の処理が必要なのです。そこで力を発揮するのがウェブスクレイピングツールです。オンラインのデータを活用したい人にとって、今では欠かせない存在になっています。

ウェブスクレイピングが初めてだと、 や といった言葉に、少し身構えてしまうかもしれません。でも、AI時代の今は、こうしたハードルもずっと越えやすくなりました。今のAI搭載スクレイピングツールなら、深い技術知識がなくても始められます。コードを書かなくても、データを素早く収集・処理できるのです。

最適なウェブスクレイピングツールとソフトウェア

- — 使いやすいAIウェブスクレイパーで、仕上がりも優秀

- — リアルタイム監視と一括データ抽出向け

- — 豊富なアプリ連携を備えたノーコード自動化向け

- — より本格的なビジュアル型ウェブスクレイピング向け

- — IPブロックやボット検知を回避しながら使える強力なノーコードスクレイピング向け

- — 高度なAIデータ抽出APIとナレッジグラフ向け

AIを使ってウェブスクレイピングを試す

ぜひ試してみてください。クリックしながら、操作を見て、ワークフローを実行できます。

ウェブスクレイピングはどのように動くのか?

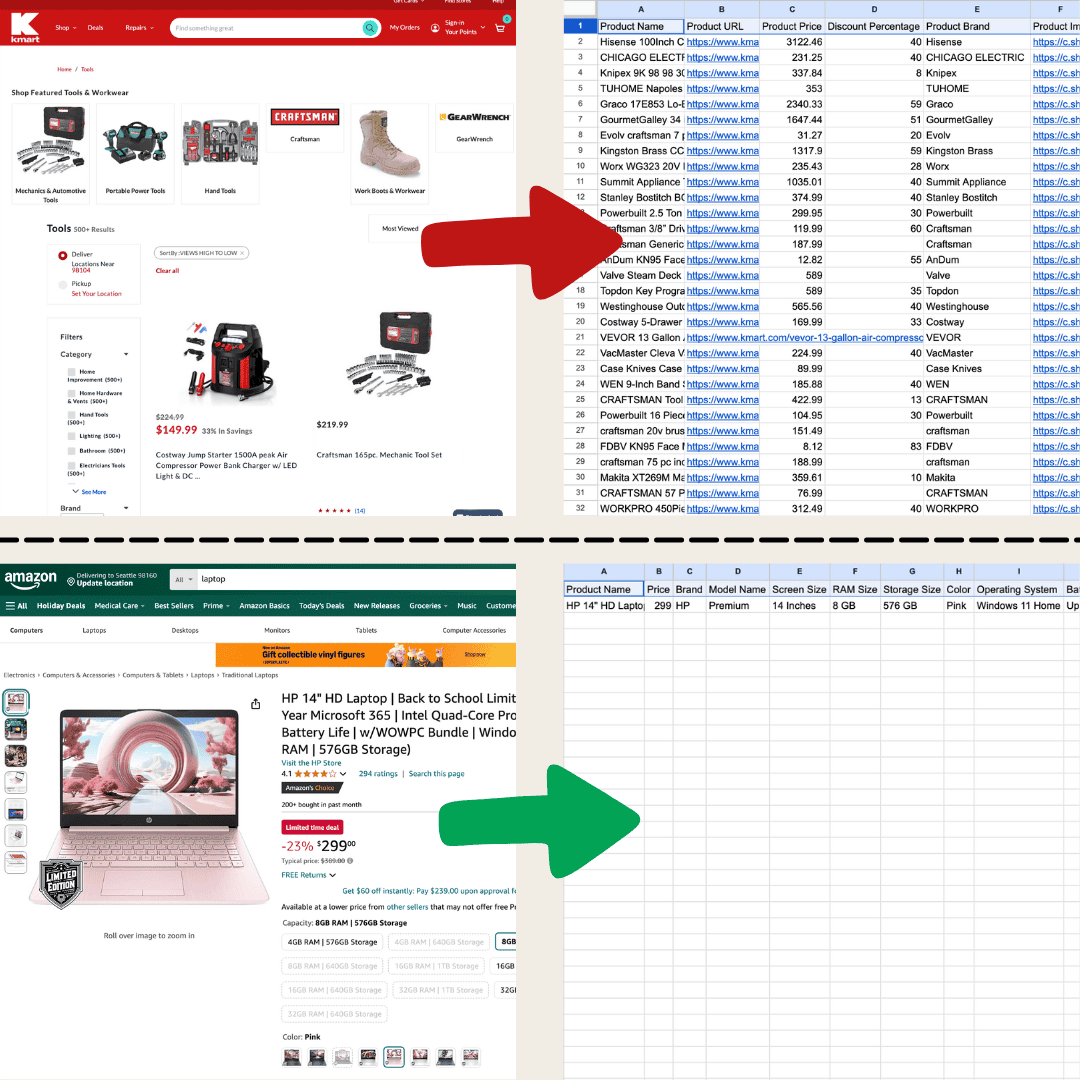

ウェブスクレイピングとは、ウェブサイトからデータを取り出すことです。ツールに一連の指示を与えると、ページ上のテキストや画像など、必要な情報を表形式で抽出してくれます。ECサイトの価格追跡から調査データの収集、ExcelやGoogle スプレッドシートの整理まで、幅広く役立ちます。

これはThunderbitのAIウェブスクレイパーで作成しました。

これはThunderbitのAIウェブスクレイパーで作成しました。

やり方はいくつかあります。いちばん単純なのは手作業でコピー&ペーストする方法ですが、データ量が多いとかなり大変です。そこで多くの人は、従来型のウェブスクレイパー、AIウェブスクレイパー、カスタムコードの3つの方法のどれかを使っています。

従来型のウェブスクレイパーは、ページの構造に基づいて、どのデータを取得するかを細かいルールで指定して動きます。たとえば、特定のHTMLタグから商品名や価格だけを抽出するよう設定できます。ページ構成があまり変わらないサイトには向いていますが、レイアウトが少しでも変わると、スクレイパーを調整し直す必要があります。

従来型スクレイパーは習得に時間がかかり、設定完了までに何十回もクリックすることになるかもしれません。

従来型スクレイパーは習得に時間がかかり、設定完了までに何十回もクリックすることになるかもしれません。

AIウェブスクレイパーは、要するにChatGPTがサイト全体を読み取り、必要に応じて内容を抽出する仕組みです。データ抽出、翻訳、要約を同時にこなせます。自然言語処理を使ってサイト構造を分析・理解するため、サイトの変更にも柔軟に対応しやすいのが特長です。たとえばページの配置が少し変わっても、AIウェブスクレイパーなら書き直しなしで調整できることがあります。そのため、更新頻度が高いサイトや構造が複雑なサイトに向いています。

AIウェブスクレイパーはすぐ始められて、数回のクリックで詳細なデータを取得できます!

AIウェブスクレイパーはすぐ始められて、数回のクリックで詳細なデータを取得できます!

どちらを選ぶべき? それは場合によります。コードをいじるのが苦でない方、あるいは有名サイトから大量のデータを集めたい方には、従来型スクレイパーは非常に効率的です。一方、ウェブスクレイピングが初めての方や、サイトの更新に柔軟に追随できるものが欲しい方には、AIウェブスクレイパーのほうがたいてい有力です。より詳しいケース別の使い分けは、下の表をご覧ください。

| シナリオ | 最適な選択 |

|---|---|

| ディレクトリ、ショッピングサイト、一覧形式のページなどで軽めにスクレイピングしたい場合 | AIウェブスクレイパー |

| ページ内のデータが200行未満で、従来型ウェブスクレイパーでスクレイパーを作るのに時間がかかりすぎる場合 | AIウェブスクレイパー |

| 抽出したデータを別の場所へアップロードするため、特定の形式に整える必要がある場合。たとえば、HubSpotにアップロードする連絡先情報の抽出など。 | AIウェブスクレイパー |

| 数万件規模のAmazon商品ページやZillowの物件一覧のように、大規模に広く使われているサイト | 従来型ウェブスクレイパー |

一目でわかる最適なウェブスクレイピングツールとソフトウェア

| ツール | 料金 | 主な機能 | 長所 | 短所 |

|---|---|---|---|---|

| Thunderbit | 月額9ドルから、無料プランあり | AIウェブスクレイパー、自動検出とデータ整形、複数形式対応、ワンクリックエクスポート、使いやすいUI。 | コード不要、AIサポート、Google スプレッドシートなどのアプリ連携 | 大規模スクレイピングは遅くなることがある、高度な機能は追加費用がかかる場合あり |

| Browse AI | 月額48.75ドルから、無料プランあり | ノーコードUI、リアルタイム監視、一括データ抽出、ワークフロー連携。 | 使いやすい、Google スプレッドシートやZapierと連携可能 | 複雑なページでは追加設定が必要、一括スクレイピングはタイムアウトの原因になることがある |

| Bardeen AI | 月額60ドルから、無料プランあり | ノーコード自動化、130以上のアプリと連携、MagicBoxでタスクをワークフロー化。 | 連携が豊富、ビジネス向けに拡張しやすい | 初心者には学習曲線が急、初期設定に時間がかかる |

| Web Scraper | ローカル利用は無料、クラウドは月額50ドル | ビジュアル型のスクレイピング、動的サイト対応、クラウドスクレイピング。 | 動的サイトでうまく動作する、ローカル利用は無料 | 最適に設定するには技術的な知識が必要、変更時には複雑なテストが必要 |

| Octoparse | 月額119ドルから、無料プランあり | ノーコード操作、スマート自動検出、クラウドスクレイピング、豊富なテンプレートライブラリ。 | 強力な機能で動的サイトに対応しやすい、スクレイピング制限への対策がある | 複雑なサイト構造では設定に時間がかかる、初心者は使い方を覚えるのに時間が必要 |

| Diffbot | 月額299ドルから、無料プランあり | ルール不要のデータ抽出API、自然言語処理API、ナレッジグラフ。 | 強力な抽出機能と高い柔軟性、豊富なAPI連携、エンタープライズ向けに適している | 非技術者には学習時間が必要、APIを呼び出すためのプログラム作成が必要 |

AI時代に最適なウェブスクレイパー

Thunderbitは、コード不要で使える強力かつ使いやすいAIウェブ自動化ツールで、プログラミング経験がないユーザーでも簡単にデータを抽出し、整理できます。 を使えば、Thunderbitの はデータ抽出を大幅に簡単にし、ウェブ要素を手作業で操作したり、ページごとに個別のスクレイパーを用意したりする必要がありません。

主な機能

- AIによる柔軟性: ThunderbitのAIウェブスクレイパーはウェブデータを自動で検出し、整形します。CSSセレクタは不要です。

- 最も簡単なスクレイピング体験: 必要なのは、抽出したいページで「AIで列を提案」をクリックし、そのあと「スクレイプ」をクリックするだけです。それで完了です。

- さまざまなデータ形式に対応: URLや画像をスクレイピングでき、取得したデータは複数の形式で表示できます。

- 自動データ処理: ThunderbitのAIは、要約、分類、指定形式への翻訳など、データをその場で再整形できます。

- 簡単なデータエクスポート: Google スプレッドシート、Airtable、Notionへワンクリックで出力でき、データ管理が楽になります。

- 使いやすいインターフェース: 直感的なUIで、どのレベルのユーザーでも扱いやすくなっています。

料金

Thunderbitには段階的なプランがあり、5,000クレジットの月額9ドルから始まります。最上位は240,000クレジットで199ドルです。また、年額プランでは、クレジットが最初にまとめて付与されます。

長所:

- 強力なAIサポートにより、データ抽出と処理が簡単になります。

- コード不要で、あらゆるスキルレベルのユーザーに使いやすいです。

- ディレクトリやショッピングサイトなど、軽量なスクレイピングに最適です。

- 主要アプリへ直接出力できる高い連携性があります。

短所:

- 大規模データのスクレイピングは、精度を確保するために少し時間がかかることがあります。

- 一部の高度な機能は有料サブスクリプションが必要な場合があります。

もっと知りたいですか? まずはするか、Thunderbitで をご覧ください。

データ監視と一括抽出に最適なウェブスクレイパー

Browse AI

Browse AIは、コードを書かずにデータを抽出・監視できるよう設計された堅牢なノーコードデータスクレイピングツールです。AI機能もありますが、本格的なAIスクレイピングほどではありません。それでも、始めやすくなる点は魅力です。

主な機能

- ノーコードUI: クリック操作だけで独自のワークフローを作成できます。

- リアルタイム監視: ボットでページの変更を追跡し、更新情報を届けます。

- 一括データ抽出: 一度に最大50,000件のデータを処理できます。

- ワークフロー連携: 複数のボットをつないで、より複雑なデータ処理が可能です。

料金

月額48.75ドルからで、2,000クレジットが含まれます。無料プランもあり、基本機能を試すために毎月50クレジットが付与されます。

長所:

- Google スプレッドシートやZapierと連携できます。

- 事前構築済みのボットにより、よくある抽出作業を簡単にこなせます。

短所:

- 複雑なページでは追加設定が必要になることがあります。

- 一括スクレイピングの速度は一定せず、タイムアウトが発生する場合があります。

ワークフロー連携に最適なウェブスクレイパー

Bardeen AI

Bardeen AIは、さまざまなアプリをつなげてワークフローを効率化するためのノーコード自動化ツールです。AIを使って独自の自動化を作成できますが、本格的なAIスクレイピングツールほどの柔軟性はありません。

主な機能

- ノーコード自動化: クリック操作でワークフローを設定できます。

- MagicBox: タスクを自然な言葉で説明すると、Bardeen AIがそれをワークフローに変換します。

- 幅広い連携オプション: Google スプレッドシート、Slack、LinkedInを含む130以上のアプリと連携します。

料金

月額60ドルからで、1,500クレジット(約1,500行分のデータ)が含まれます。無料プランでは、基本機能を試すために毎月100クレジットが使えます。

長所:

- 豊富な連携先があり、さまざまなビジネスニーズに対応できます。

- 柔軟で、規模の大小を問わず導入しやすいです。

短所:

- 新規ユーザーは、プラットフォーム全体を理解するまでに時間がかかる場合があります。

- 初期設定に手間がかかることがあります。

経験者向けの最適なビジュアル型ウェブスクレイパー

Web Scraper

その名のとおり、ツール名は「Web Scraper」です。Web Scraperは、ChromeとFirefoxで使える人気のブラウザ拡張機能で、コードを書かずにデータを抽出できる、ビジュアル型のスクレイピングツールです。ただし、このツールを完全に使いこなすには、上のチュートリアルを見ながら数日かけて学ぶ必要があるかもしれません。頭をあまり使わずにスクレイピングしたいなら、AIウェブスクレイパーを選びましょう。

主な機能

- ビジュアル作成: ウェブ要素をクリックするだけでスクレイピングタスクを設定できます。

- 動的サイト対応: AJAXリクエストやJavaScriptを使う動的サイトにも対応できます。

- クラウドスクレイピング: Web Scraper Cloudでタスクをスケジュールし、定期的にスクレイピングできます。

料金

ローカル利用は無料で、クラウド機能の有料プランは月額50ドルからです。

長所:

- 動的サイトでうまく動作します。

- ローカル利用は無料です。

短所:

- 最適に設定するには技術的な知識が必要です。

- 変更時には複雑なテストが必要です。

IPブロックとボット検知を回避しやすい最適なウェブスクレイパー

Octoparse

Octoparseは、より技術寄りのユーザーがコードなしで特定のウェブデータを収集・監視するための多機能ソフトウェアで、大規模なデータ収集に向いています。Octoparseはユーザーのブラウザに依存せず、クラウドサーバーを使ってデータをスクレイピングします。そのため、IPブロックや一部のサイトのボット検知を回避するさまざまな手法を提供できます。

主な機能

- ノーコード操作: コードを書かずにスクレイピングタスクを作成でき、さまざまな技術レベルのユーザーが使いやすくなっています。

- スマート自動検出: ページ上のデータを自動で検出し、抽出可能な要素をすばやく見つけて、設定を簡単にします。

- クラウドスクレイピング: 24時間365日のクラウドデータスクレイピングに対応し、スケジュール実行もできるため、柔軟にデータを取得できます。

- 豊富なテンプレートライブラリ: 数百種類の事前設定テンプレートがあり、複雑な設定なしで人気サイトのデータにすぐアクセスできます。

料金

Octoparseの料金プランは月額119ドルからで、100タスクが含まれます。基本機能を試せる、月10タスクの無料プランもあります。

長所:

- 強力な機能により、動的サイトのスクレイピングを高い柔軟性でサポートします。

- スクレイピング制限や動的コンテンツの問題に対処するための手段があります。

短所:

- 複雑なサイト構造では、設定に時間がかかることがあります。

- 初心者は使い方を覚えるのに時間が必要です。

高度なAI搭載データ抽出APIに最適なウェブスクレイパー

Diffbot

Diffbotは、AIを使って非構造化のウェブコンテンツを構造化データへ変換する高度なウェブデータ抽出ツールです。強力なAPIとナレッジグラフを備え、Web上の情報の抽出、分析、管理を支援します。さまざまな業界や用途に対応できます。

主な機能

- データ抽出API: Diffbotはルール不要のデータ抽出APIを提供しており、URLを指定するだけで自動抽出できます。サイトごとに個別のルールを設定する必要がありません。

- 自然言語処理API: 非構造化テキストから、構造化されたエンティティ、関係性、感情を抽出し、独自のナレッジグラフ作成を支援します。

- ナレッジグラフ: Diffbotは最大級のナレッジグラフのひとつを持ち、人名や組織情報を含む豊富なエンティティデータをつなげています。

料金

Diffbotの料金プランは月額299ドルからで、250,000クレジット(約250,000回のAPIベースのウェブページ抽出に相当)が含まれます。

長所:

- ルール不要で使える強力な抽出機能があり、柔軟性も高いです。

- 既存システムに組み込みやすい、豊富なAPI連携オプションがあります。

- 大規模なデータスクレイピングに対応しており、エンタープライズ用途に適しています。

短所:

- 技術者でないユーザーは、初期設定にある程度の学習時間が必要です。

- 利用には、APIを呼び出すためのプログラム作成が必要です。

スクレイパーは何に使える?

ウェブスクレイピングが初めてなら、まずはよく使われる用途を知ると始めやすいです。多くの人は、Amazonの商品一覧を取得したり、Zillowから不動産データを集めたり、Google マップから事業者情報を集めたりするためにスクレイパーを使っています。でも、これはまだ入口にすぎません。Thunderbitの を使えば、ほとんどあらゆるウェブサイトからデータを収集でき、日々の作業を効率化して時間を節約できます。調査、価格追跡、データベース構築など、ウェブスクレイピングはインターネットのデータをあなたの仕事に活かす無数の方法を開いてくれます。

よくある質問

-

ウェブスクレイピングは合法ですか?

一般的には合法ですが、ウェブサイトの利用規約とアクセスするデータの性質に従う必要があります。必ず関連ポリシーを確認し、法的ガイドラインを守ってください。

-

ウェブスクレイピングツールを使うのにプログラミングスキルは必要ですか?

ここで紹介したツールの多くはプログラミングスキルを必要としませんが、OctoparseやWeb Scraperのようなツールは、ウェブ構造の基本知識やプログラミング的な考え方があると、よりうまく使えます。

-

無料のウェブスクレイピングツールはありますか?

はい。BeautifulSoup、Scrapy、Web Scraperのような無料ツールがあり、機能を制限した無料プランを提供しているツールもあります。

-

ウェブスクレイピングでよくある課題は何ですか?

よくある課題には、動的コンテンツ、CAPTCHA、IPブロック、複雑なHTML構造への対応があります。高度なツールや手法を使えば、これらの問題に効果的に対処できます。

さらに詳しく読む:

-

手間をかけずにAIを活用しましょう。