ウェブデータの抽出は、今やビジネスチームにとって「できたら便利」なレベルを超えて、競争力を左右する必須スキルになっています。営業やオペレーション、リサーチ、ECなど、どんな分野でも、複雑で日々変化するウェブ上の情報を、整理された実用的なデータに変換するニーズがどんどん高まっています。でも、ウェブの進化(JavaScript中心の“ミニアプリ”や無限スクロール、ボット対策など)が進むにつれ、昔ながらのスクレイピングツールでは太刀打ちできない場面が増えてきました。実際、古いコピペやHTTPリクエスト方式では動的なサイトに全然対応できず、スクリプトが壊れたり、空っぽのスプレッドシートができてしまい、何時間も無駄にしているチームを何度も見てきました。

そこで注目したいのが、playwright スクレイピングです。これは、どんなに複雑なウェブサイトからでも、しっかり効率よくデータを取得できる最新のブラウザ自動化ツールキット。さらに、Playwrightの技術力とのAIによるデータ構造化・エクスポート機能を組み合わせれば、パワフルなだけじゃなく、使っていて楽しいワークフローが実現します(本当に!)。ここからは、playwright スクレイピングを使いこなすコツや、よくある課題の乗り越え方、そしてチームの生産性を一気に上げる方法を紹介します。

Playwright スクレイピングとは?基本を解説

playwright スクレイピングは、Microsoftが開発したブラウザ自動化フレームワーク「Playwright」を使い、実際のウェブブラウザ(Chrome、Firefox、Safariなど)をコードで操作してデータを取得する方法です。単にHTMLを取得するだけじゃなく(JavaScriptで後から読み込まれる情報は従来の方法では取得できません)、Playwrightは本物のブラウザを立ち上げて、人間のようにクリックやスクロール、フォーム入力などの操作を行い、完全に描画されたページからデータを抽出します()。

なぜ重要なのか? 今のウェブサイトの多くは、動的にデータを読み込む仕組みです。初回のページロード後にデータが追加されたり、ユーザー操作が必要だったり、ログインしないと見えない情報もたくさんあります。従来のHTTPベースのスクレイパー(PythonのBeautifulSoupやRequestsなど)は、最初のHTMLしか見えず、JavaScriptで後から表示される情報は取得できません。でもPlaywrightなら、実際のユーザーと同じ画面を見て操作できるので、ブラウザで見えるものは全部取得できます。

playwright スクレイピングが活躍する場面

- JavaScriptやAJAXで動的に読み込まれるコンテンツ

- ログインや複数ステップのナビゲーションが必要なサイト

- 無限スクロールや「もっと見る」ボタン、ポップアップなどのインタラクティブな要素

- 従来のスクレイパーでは空データしか取れないページ

もしスクレイピングで空のスプレッドシートしか得られなかった経験があるなら、Playwrightが救世主になるはずです。

なぜplaywright スクレイピングが現代のデータ抽出に最適なのか

Playwrightはただの自動化ツールじゃなく、他にはない技術的な強みを持っています。

Playwrightはただの自動化ツールじゃなく、他にはない技術的な強みを持っています。

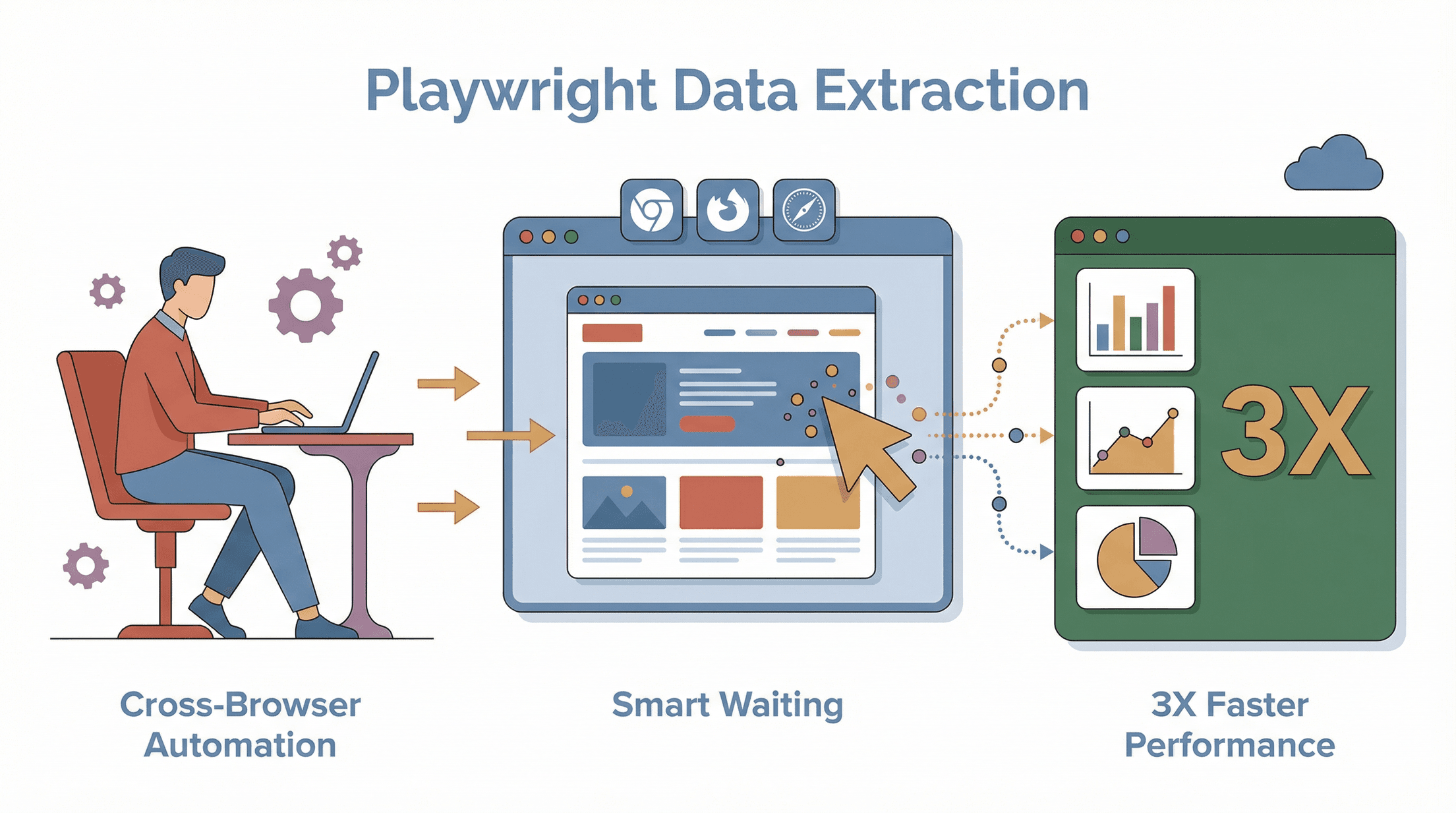

1. クロスブラウザ自動化

Playwrightは**Chromium(Chrome/Edge)、Firefox、WebKit(Safari)**を標準でサポートしています()。つまり、1つのスクリプトで主要なブラウザすべてに対応でき、ブラウザごとに挙動が違うサイトでも安心です。

2. 人間らしい操作の再現

Playwrightは実際のユーザーのような操作(クリック、スクロール、ホバー、フォーム入力、ファイルアップロードなど)を再現できます。これで、操作しないと見えない情報の取得や、簡単なボット対策の回避も可能。デバッグや人間らしさを演出したいときは「ヘッドフルモード」(ブラウザ画面を表示)も使えます。

3. ヘッドレス・ヘッドフル両対応

ヘッドレス(画面非表示で高速・目立たない)とヘッドフル(画面表示でデバッグや一部ボット対策回避に有効)をパラメータ1つで切り替え可能。ヘッドレスブラウザをブロックするサイトにも柔軟に対応できます。

4. 賢い待機・タイミング制御

動的なサイトは非同期でデータを読み込むことが多いですが、Playwrightの自動待機機能なら、データが揃うまでスクリプトが自動で待ってくれます。もう「何秒待つか」を手動で調整する必要はありません()。

5. 並列処理と高パフォーマンス

Playwrightは複数のタブやセッションを同時に操作できるので、大量データの取得もスムーズ。従来の「1ページずつ」方式より圧倒的に効率的です。

6. ボット対策・ステルス機能

Playwrightは実際のブラウザを操作するため、ユーザーエージェントの偽装、プロキシの切り替え、モバイル端末のエミュレートなども可能。適切な設定をすれば、従来のスクレイパーが止まるようなブロックも回避できます()。

つまり、playwright スクレイピングは現代の複雑なウェブから、柔軟かつ確実にデータを抽出できる強力な武器です。

Playwright スクレイピング環境のゼロからの構築方法

Playwrightの導入は意外とシンプル。自動化が初めてでもすぐに始められます。

Node.jsとPlaywrightのインストール

まずNode.js(またはPython。PlaywrightはNode.jsが主流)をからインストールし、ターミナルを開きます。

次に、プロジェクトフォルダを作成:

1mkdir my-playwright-scraper

2cd my-playwright-scraper

3npm init -y

4npm install playwright

5npx playwright installnpm install playwrightでPlaywright本体をインストール。npx playwright installで各種ブラウザエンジン(Chromium, Firefox, WebKit)をダウンロード。

インストール確認用の簡単なスクリプト:

1const { chromium } = require('playwright');

2(async () => {

3 const browser = await chromium.launch();

4 const page = await browser.newPage();

5 await page.goto('https://example.com');

6 console.log(await page.title()); // "Example Domain"と表示されればOK

7 await browser.close();

8})();期待通りのタイトルが表示されれば準備OKです()。

依存関係とプロジェクト構成の管理

小規模なら1ファイルでもOKですが、規模が大きくなったらsrc/フォルダや、スクレイピング処理・データ処理・設定用のモジュールを分けて管理しましょう。認証情報や設定は.envファイルに保存し、スクリプト内に直接書かないのが安全です。

最初のPlaywright スクレイピングスクリプトを書いてみよう

サンプルのECサイトから商品名と価格を取得する例:

1const { chromium } = require('playwright');

2(async () => {

3 const browser = await chromium.launch();

4 const page = await browser.newPage();

5 await page.goto('https://example-ecommerce.com/laptops');

6 await page.waitForSelector('.product-card');

7 const names = await page.$$eval('.product-card .name', els => els.map(el => el.textContent.trim()));

8 const prices = await page.$$eval('.product-card .price', els => els.map(el => el.textContent.trim()));

9 names.forEach((name, i) => {

10 console.log(`$\{name\} - ${prices[i]}`);

11 });

12 await browser.close();

13})();商品カードの読み込みを待ってから、全ての商品名と価格を取得します。ターゲットサイトに合わせてセレクタを調整してください。

トラブルシューティング: セレクタが見つからない、データが空になる場合は、Chrome DevToolsでサイト構造を確認し、正しいセレクタを指定しましょう。

Playwright スクレイピングの実践テクニックとベストプラクティス

環境が整ったら、さらに一歩進んだ使い方をマスターしましょう。

データ要素の特定と抽出

- CSSセレクタ:

page.locator('セレクタ')やpage.$('セレクタ')で要素を指定 - テキスト抽出:

await page.locator('.product-name').allTextContents()で全商品名を配列で取得 - 属性抽出: 画像やリンクは

.getAttribute('src')や.getAttribute('href')で取得 - ロケータのチェーン: ループ内で

item.locator('.price')のようにネスト要素も指定可能

動的コンテンツやページネーションへの対応

- コンテンツ待機:

await page.waitForSelector('.item')でアイテムの読み込みを待つ - 無限スクロール:

await page.evaluate(() => window.scrollBy(0, window.innerHeight));で自動スクロールし、新しいデータを待つ - ページネーション: 「次へ」ボタンをクリックし、ページ遷移を待つループ例:

1let pageNumber = 1;

2while (true) {

3 await page.waitForSelector('.result-item');

4 // データ抽出処理...

5 const nextButton = await page.$('button.next');

6 if (!nextButton) break;

7 await nextButton.click();

8 await page.waitForNavigation();

9 pageNumber++;

10}プロキシ利用とブロック回避

- プロキシ設定: ブラウザ起動時に以下のように指定

1const browser = await chromium.launch({

2 proxy: { server: 'http://YOUR_PROXY:PORT', username: 'USER', password: 'PASS' }

3});()

- ユーザーエージェントのローテーション: セッションごとにUAを変更

- ランダムな遅延: 人間らしい間隔で操作を実行

- ヘッドフルモード: ヘッドレスブラウザをブロックするサイトには画面表示で対応

- ステルスプラグイン: playwright-stealthなどのコミュニティツールで自動化の痕跡を隠す

PlaywrightとThunderbitの連携でデータ抽出の新次元へ

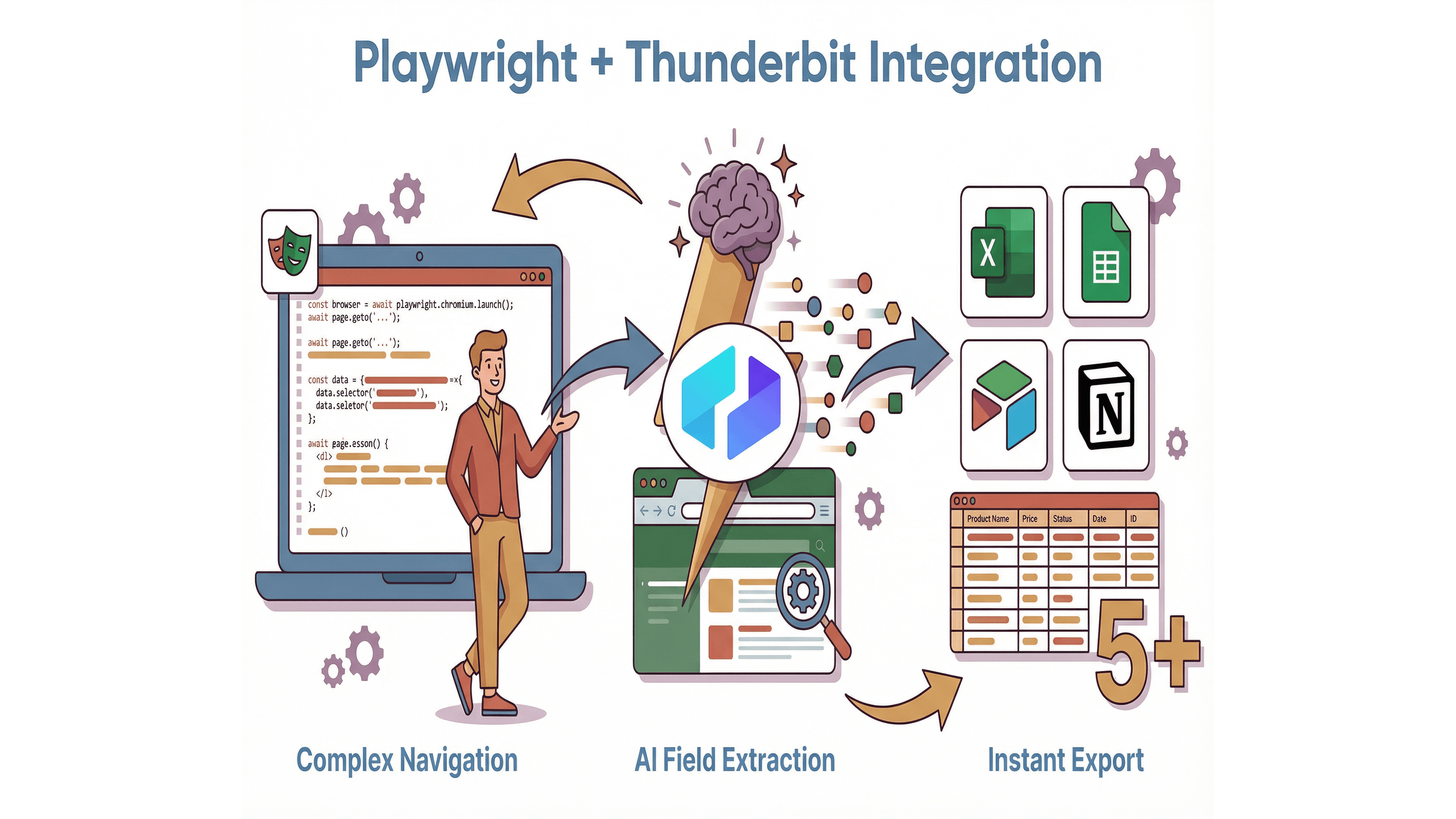

ここからが本番です。Playwrightは複雑なサイトのナビゲーションや操作に強いですが、抽出したデータの構造化やエクスポートはどうでしょう?特に非エンジニアのチームメンバーに渡したい場合、が大活躍します。

ここからが本番です。Playwrightは複雑なサイトのナビゲーションや操作に強いですが、抽出したデータの構造化やエクスポートはどうでしょう?特に非エンジニアのチームメンバーに渡したい場合、が大活躍します。

Playwrightと連携できるThunderbitのAIフィールド提案機能

ThunderbitのAIフィールド提案機能を使えば、どのデータを抽出すべきか一瞬で特定できます。HTMLを手作業で調べたり、フィールド名を推測する必要はありません。を開き、「AIフィールド提案」をクリックするだけで、AIがカラムやデータ型を自動で提案してくれます()。

Playwrightユーザーにとってのメリット

- セットアップが高速化: ThunderbitのAIでフィールドマッピングを事前にプロトタイプ化

- 精度の高い抽出: 提案されたセレクタやフィールド名をPlaywrightスクリプトにコピペするだけでOK

- 非エンジニアも活用可能: ビジネスユーザーはThunderbitでノーコード抽出、開発者はPlaywrightで高度な処理を担当

リアルタイムのデータ整形とエクスポート

Thunderbitはデータを自動でテーブル化し、Excel、Googleスプレッドシート、Airtable、Notionなどに直接エクスポートできます()。CSVの手作業変換やエクスポート用スクリプトは不要です。

ワークフローのコツ: Playwrightで複雑なナビゲーション(ログインや多段階フォーム)を自動化し、描画済みページをThunderbitに渡してAIでフィールド抽出&即エクスポート。Thunderbitのサブページ抽出機能を使えば、リンク先の詳細データも追加コードなしで取得できます。

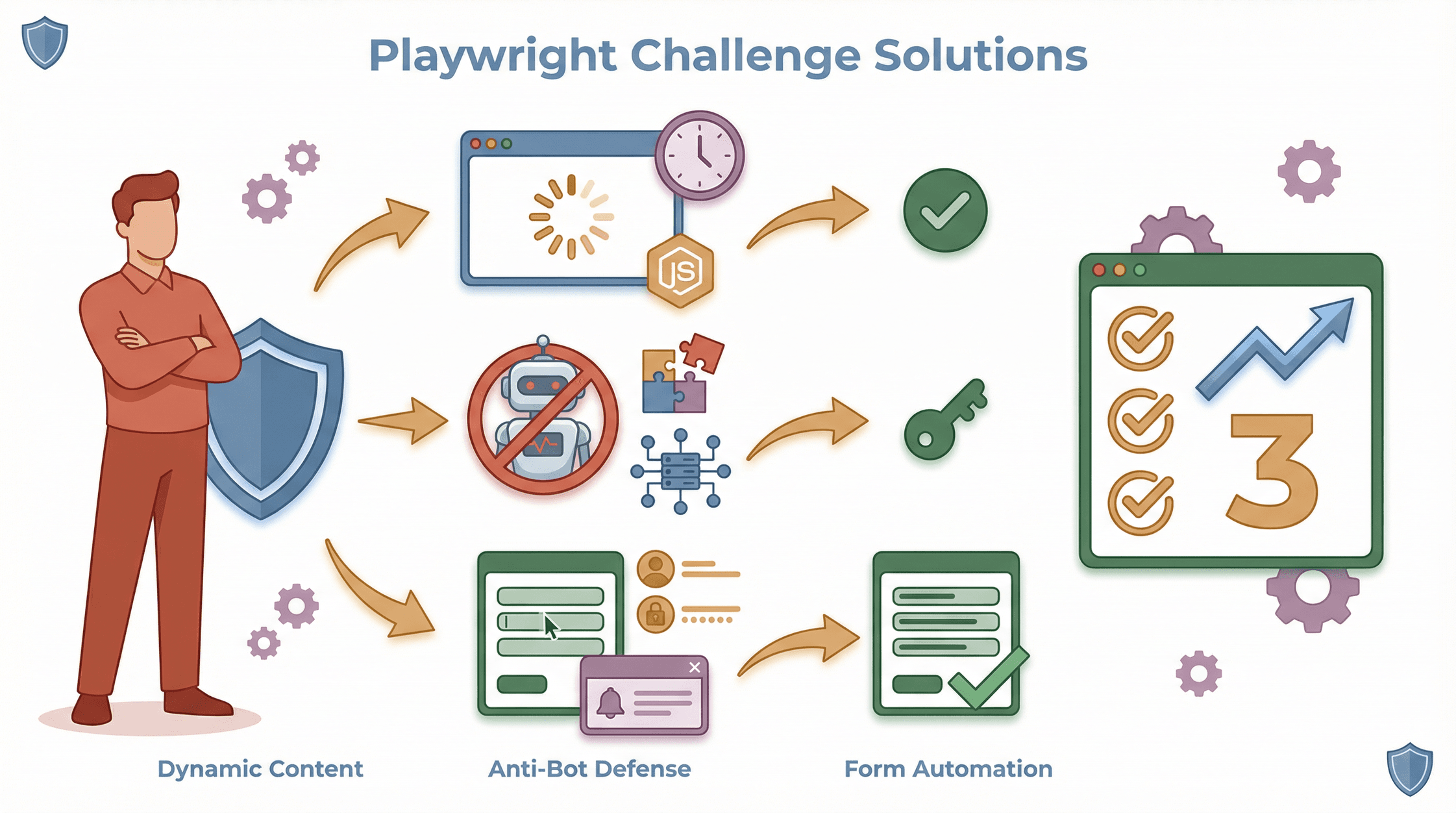

Playwright スクレイピングでよくある課題とその解決策

Playwrightは強力ですが、つまずくポイントもあります。主な対策をまとめました。

Playwrightは強力ですが、つまずくポイントもあります。主な対策をまとめました。

動的コンテンツやJavaScriptレンダリングへの対応

- 正しい要素を待つ: ページ全体のロードではなく、データが入るコンテナ要素を

waitForSelectorで待機 - 無限スクロール対応: スクロールをループし、新しいアイテムが出現するか確認

- ヘッドフルモードでデバッグ: 画面を見ながら、何が表示されていないか確認

ボット対策の突破

- プロキシ・ユーザーエージェントのローテーション: ボットと判定されないように工夫

- 操作のランダム化: スクレイピングパターンやタイミングを変化させる

- CAPTCHA対策: CAPTCHAが出たら一時停止、プロキシ切り替え、または外部サービス連携(倫理的に利用)

複雑なフォームやユーザー操作の自動化

- フォーム入力の自動化:

page.fill()やpage.click()で多段階フォームも対応 - ログイン処理のスクリプト化: ログインフローを自動化し、クッキーを保存して再利用

- ポップアップや新規タブの管理: Playwrightのコンテキスト・ページイベントで複数ウィンドウを制御

実践例:playwright スクレイピングのビジネス活用5選

具体的な活用シーンとサンプルコードを5つ紹介します。

1. EC価格モニタリング

用途: 競合他社の価格や在庫状況を追跡

1await page.goto('https://example-ecommerce.com/laptops');

2await page.waitForSelector('.product-card');

3const products = await page.$$eval('.product-card', cards =>

4 cards.map(card => ({

5 name: card.querySelector('.name').textContent.trim(),

6 price: card.querySelector('.price').textContent.trim()

7 }))

8);

9console.log(products);()

2. 市場調査・トレンド分析

用途: ニュース見出しやフォーラム投稿の集約

1await page.goto('https://tech-news.com/latest');

2await page.waitForSelector('.headline');

3const headlines = await page.$$eval('.headline', els => els.map(el => el.textContent.trim()));

4console.log(headlines);3. 不動産リスティング抽出

用途: 不動産ポータルから物件情報を取得

1from playwright.sync_api import sync_playwright

2with sync_playwright() as p:

3 browser = p.chromium.launch()

4 page = browser.new_page()

5 page.goto("https://realestate.com/city")

6 page.wait_for_selector(".listing")

7 listings = page.query_selector_all(".listing")

8 for listing in listings:

9 price = listing.query_selector(".price").inner_text()

10 beds = listing.query_selector(".beds").inner_text()

11 print(price, beds)

12 browser.close()()

4. 営業リード獲得

用途: ビジネスディレクトリから連絡先情報を抽出

1await page.goto('https://yellowpages.com/search?query=plumbers');

2await page.waitForSelector('.result');

3const leads = await page.$$eval('.result', results =>

4 results.map(res => ({

5 name: res.querySelector('.business-name').textContent.trim(),

6 phone: res.querySelector('.phones').textContent.trim()

7 }))

8);

9console.log(leads);()

5. 競合商品分析

用途: 商品スペックやレビューのベンチマーク

1products = ["ProductA", "ProductB"]

2with sync_playwright() as p:

3 browser = p.chromium.launch()

4 page = browser.new_page()

5 for product in products:

6 page.goto(f"https://competitor.com/products/\{product\}")

7 page.wait_for_selector(".specs")

8 specs = page.query_selector(".specs").inner_text()

9 print(product, specs)

10 browser.close()Playwrightと他ツールの比較:どれが最適?

Playwright、Puppeteer、Seleniumの違いをざっくり比較します(, , ):

| 機能 | Playwright | Puppeteer | Selenium |

|---|---|---|---|

| ブラウザ対応 | Chrome, Firefox, Safari | Chrome(公式) | 主要ブラウザ全て |

| 言語対応 | JS, Python, Java, .NET | JS(Node.js) | 多数(Java, Python, C#等) |

| 速度 | 非常に速い・並列処理可能 | 速い(Chromeのみ) | やや遅い・オーバーヘッド多め |

| 使いやすさ | モダンAPI・自動待機 | Node.js開発者に簡単 | 冗長・設定が多い |

| ステルス/ボット対策 | 良好・プラグイン増加中 | プラグインで対応可 | 弱め・検知されやすい |

| コミュニティ/エコシステム | 急成長中 | Node.js界隈で強い | 巨大だがテスト用途中心 |

結論: 新規のスクレイピングプロジェクトには、クロスブラウザ対応・モダンAPI・高度なボット対策が揃ったPlaywrightが最適です。

まとめ・重要ポイント

playwright スクレイピングを使いこなせば、現代ウェブを構造化データへ変換する力が手に入ります。クロスブラウザ自動化、人間らしい操作、動的コンテンツへの強さで、どんな難しいスクレイピングも現実的なものに。そしてThunderbitのAIフィールド検出や即時エクスポート機能を組み合わせれば、効率的で楽しいワークフローが実現します。

重要ポイント:

- playwright スクレイピングは、従来の手法が通用しない動的・JavaScript主体のサイトに最適

- クロスブラウザ対応、賢い待機、ステルス機能など独自の強みで現代のデータ抽出に最適

- セットアップは簡単で、スマートな待機やプロキシローテーションなどのベストプラクティスで安定運用

- Playwrightとを組み合わせれば、AIによるフィールドマッピング、サブページ抽出、即時エクスポートが可能。ビジネスユーザーも開発者も活用できる

- EC、市場調査、不動産、営業、競合分析など幅広い実用例

データ抽出力を高めたい人は、まずPlaywrightスクリプトを作成し、Thunderbitのでノーコードのデータ構造化・エクスポートも試してみてください。さらに詳しいノウハウやチュートリアルはでチェック!

快適なスクレイピングライフを!セレクタが常に一致し、プロキシがブロックされず、スプレッドシートが自動で埋まりますように。

よくある質問

1. playwright スクレイピングは従来のHTTPベーススクレイパーと何が違う?

Playwrightは実際のブラウザを操作するため、JavaScriptで動的に表示される全てのコンテンツを取得できます。従来のスクレイパーでは見落としがちな最新サイトのデータも正確に抽出可能です。

2. Playwrightはログインや多段階フォームのあるサイトも対応できる?

もちろん可能です。ログイン自動化、フォーム入力、複数ステップの操作、クッキーやセッション管理も自動化できます。

3. Thunderbitはplaywright スクレイピングをどう強化する?

ThunderbitのAIフィールド提案機能で、抽出すべきデータや構造を素早く特定できます。さらに、取得データをExcelやGoogleスプレッドシート、Airtable、Notionへ即エクスポートでき、手作業の整形は不要です。

4. Playwrightでブロックされないためのベストプラクティスは?

プロキシのローテーション、ユーザーエージェントの変更、人間らしい遅延の挿入、ヘッドフルモードの活用などが有効です。サイトの利用規約を守り、サーバーに負荷をかけすぎないよう注意しましょう。

5. playwright スクレイピングは非エンジニアでも使える?

Playwright自体はコードベースですが、ThunderbitのノーコードChrome拡張を組み合わせれば、プログラミング不要で多くのサイトから構造化データを抽出・エクスポートできます。

PlaywrightとThunderbitの連携を体験したい人は、をダウンロードし、で実践ガイドや事例もチェックしてみてください。

さらに詳しく知りたい方へ