こんな光景を想像してください。月曜の朝、コーヒーを片手にメールを開くと、受信トレイにはすでにアラートが次々と届いている。別のAI搭載ツールが機密データ漏えいでニュースになったのです。CEOは回答を求めている。法務チームは警戒態勢。では顧客はどうか?先月展開したあの「スマート」な仕組みで自分たちのデータがどう使われているのか、厳しい質問を投げかけてきます。ようこそ2026年へ。ここでは、AIデータプライバシーは単なる技術課題ではなく、経営会議レベルで、ブランドを左右し、キャリアを押し上げも壊しもする問題です。

現実として、AIは今や営業、マーケティング、不動産、Eコマースまで、ビジネスのあらゆる領域に組み込まれています。しかしAIの導入が急増するほど、リスクも増えます。ここ1年だけでも、AI関連のプライバシー事案は驚くべき**56%増加し、世界中でAI企業を「個人データを守ってくれる」と信頼している人はわずか47%**にとどまっています。その数値はいまも急速に下がっています(、)。SaaSや自動化プラットフォームを何年も作ってきた者として、そして今はの共同創業者として、私は断言できます。最新のAIデータプライバシー統計を理解することは、単なるコンプライアンスのチェック項目ではありません。新しいデジタル時代を生き残れるかどうかの分かれ目なのです。

2026年のAIデータプライバシーの現状:まず押さえるべき事実

回りくどい話は抜きにしましょう。次の役員会や提案の場で使える要点を探しているなら、2026年のAIデータプライバシーで特に重要な統計は次のとおりです。

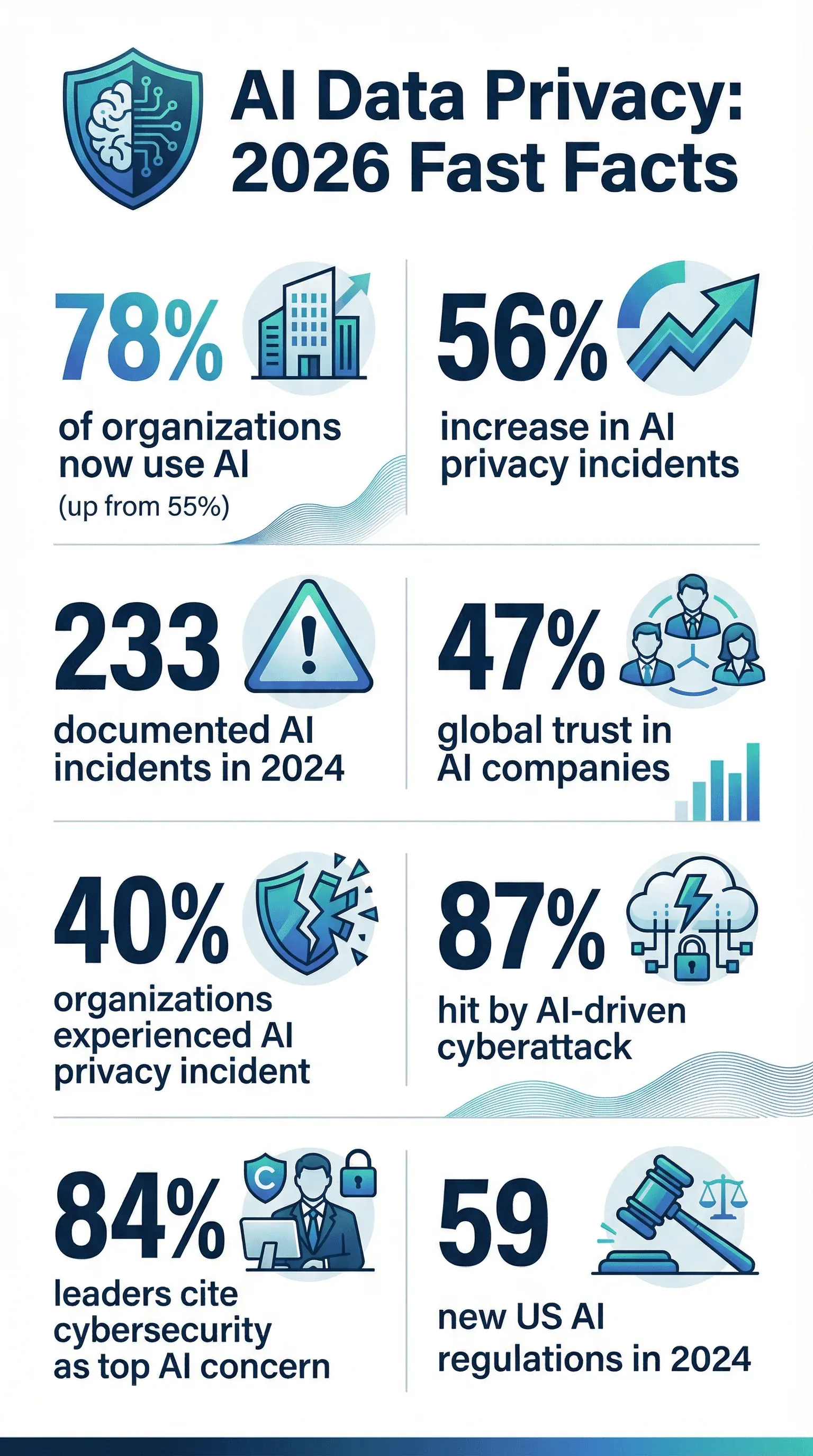

- AIはどこにでもある: 78%の組織が2024年にAIを利用しており、1年前の55%から大きく増加しました()。

- 事案は急増中: 記録されたAIインシデントは2025年に362件となり、2024年の233件から55%増加しました()。

- 漏えいは珍しくない: 40%の組織がすでにAI関連のプライバシー事案を経験しており()、**21%**はこの1年でサイバー攻撃を受けています()。

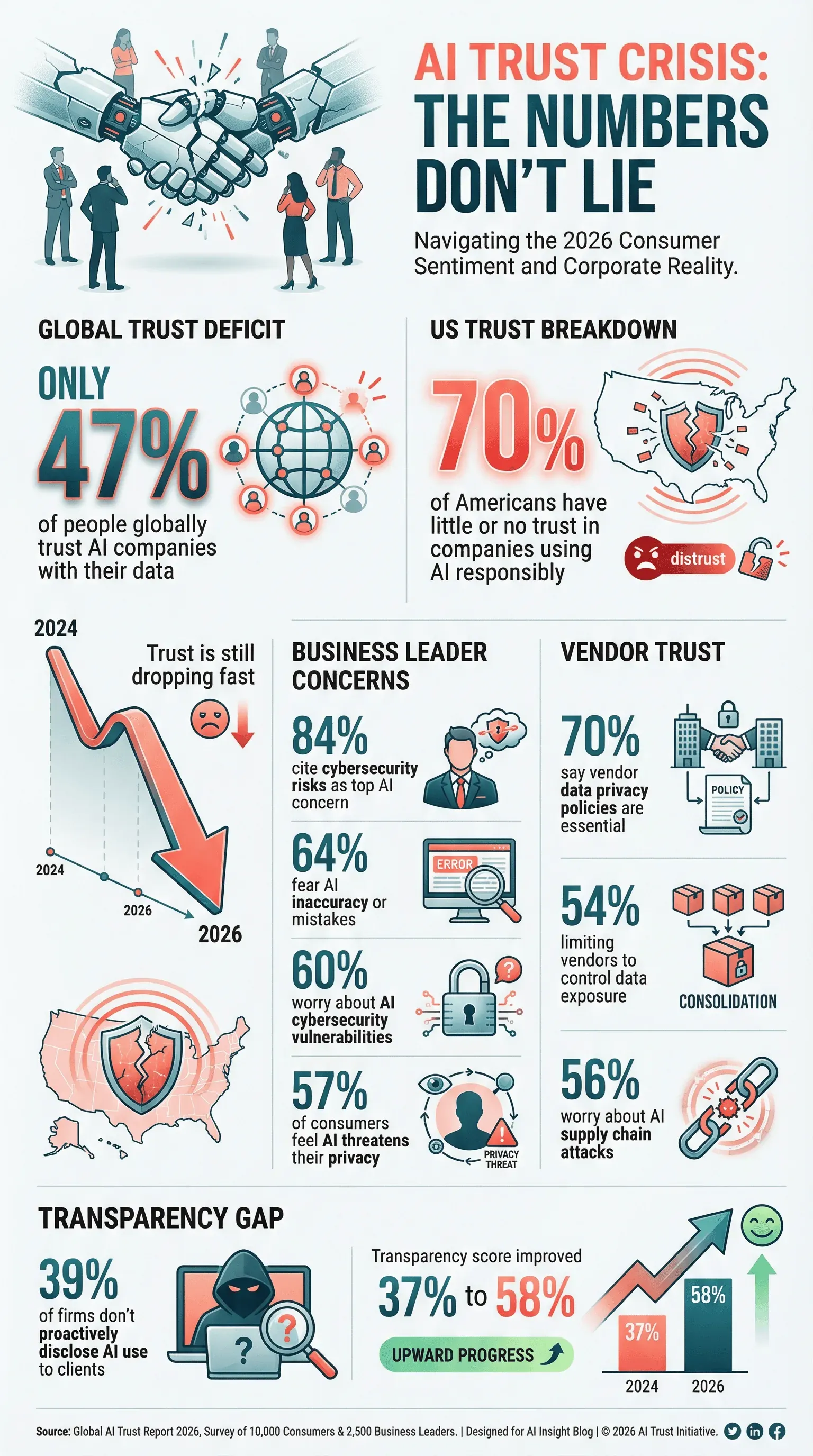

- 信頼は低い: 世界でわずか**47%の人しかAI企業にデータを任せることを信頼しておらず、米国では70%**が企業のAIの責任ある利用に「ほとんど、またはまったく信頼していない」と答えています()。

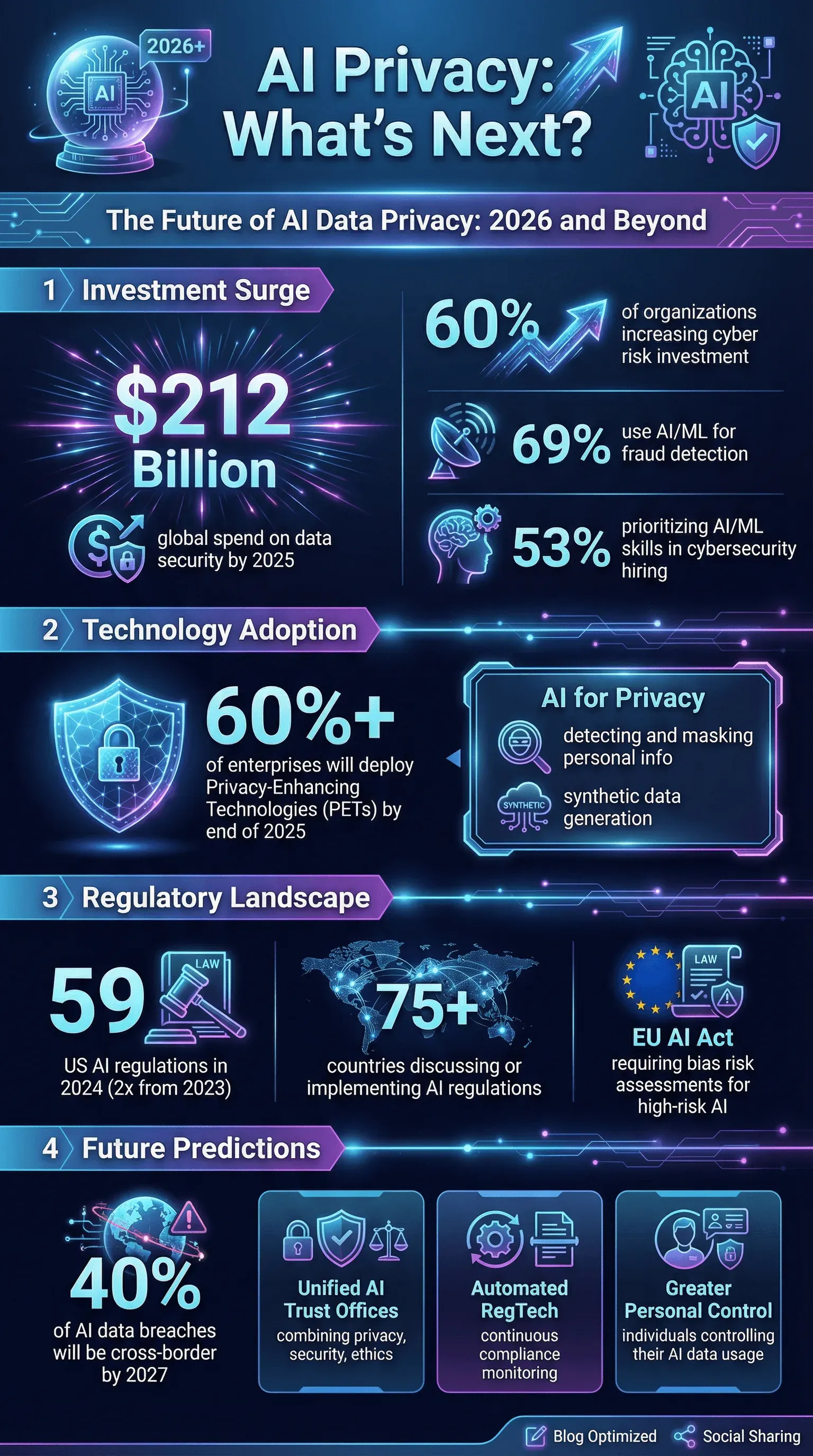

- AIがサイバー投資の最優先: PwCの2026年 Global Digital Trust Insights 調査(3,887人の役員対象)では、今後12か月のサイバー重点項目としてAI投資(36%)が単独で最大でした。これはクラウドセキュリティ(34%)、ネットワークセキュリティ(28%)、データ保護(26%)を上回ります。さらに60%の組織が、地政学リスクの高まりを受けて全体のサイバー投資を増やしています()。

- ベンダー審査は厳格化: 70%の組織が、AIや技術パートナーを選定する際に、ベンダーのデータプライバシーポリシーが必須だと考えています()。

- AI脅威は経営層の懸念事項: 84%のビジネスリーダーが、AI導入における最大の懸念としてサイバーセキュリティリスクを挙げています()。

- 規制は強化中: 米国連邦機関は2024年に59件のAI関連規制を出しており、2023年の2倍以上でした()。

- 正式な方針は遅れ気味: AIガバナンスポリシーを整備している企業は**43%**にすぎず、**77%**は現在それに取り組んでいます(、)。

- AI主導のサイバー攻撃が新常態: 87%の組織が過去1年にAI主導のサイバー攻撃を経験しています()。

これらの数字は単なる豆知識ではありません。データ、コンプライアンス、デジタルトランスフォーメーションを担うすべての人への警鐘です。

なぜAIデータプライバシーがこれまで以上に重要なのか

AIは単なるITのアップグレードではありません。組織がデータを収集し、処理し、意思決定に生かす方法そのものを変えるパラダイムシフトです。従来のソフトウェアと違い、AIシステムは顧客メールから医療記録まで含む、膨大で雑多なデータセットから学習することがよくあります。しかも厄介なのは、AIモデルが情報を「記憶」し、予想外の形で吐き出してしまうことがある点です。ときには、表に出るはずのなかった個人情報まで露出させてしまいます()。

その規模は想像を超えます。1つのAIモデルが数百万件の記録を処理したり、ウェブ全体からデータを取得したりすることがあり、しかもそれが明示的な同意なしに行われる場合もあります。つまり、そのデータを守る責任はこれまで以上に重いのです。さらにAIは数秒で判断を下します(たとえば融資審査や採用選考など)。そのため、偏りや誤りがあれば瞬時に増幅され、プライバシー侵害や人権問題にまで発展しかねません。

「でも、うちはプライバシーポリシーがあるから大丈夫」と思っているなら、考え直したほうがいいでしょう。実際には、AIはデータポイズニング、モデル反転、敵対的攻撃といった新しいリスクを持ち込み、従来の統制では対応しきれないのです。しかもAIのプライバシー失敗による評判へのダメージは容赦ありません。顧客は離れ、規制当局は罰金を科し、ブランドの回復には何年もかかるかもしれません。2026年のAIデータプライバシーは、単なるコンプライアンスではなく、生き残りの問題です。

AIデータプライバシー統計:導入、懸念、コンプライアンス

AI導入はほぼ当たり前に

率直に言うと、AIはもう「新興技術」ではありません。今や主流です。2024年までに78%の組織がAIを使用しており、前年の55%から増えています()。法務や金融のような分野では導入率はさらに高く、2025年には42%の法律事務所がAIツールを使用しており、前年のほぼ2倍でした()。利用の急拡大は、より多くのデータが収集され、分析され、そして時に露出していることを意味します。

プライバシー懸念は高まる一方

大きな力には、大きな責任が伴います。そして、多くの不安も伴います。世界の57%の消費者は、AIがプライバシーに重大な脅威をもたらすと感じています()。米国では、2026年3月のPew Researchの調査で、47%の成人が「米国がAIを適切に規制することにあまり、またはまったく信頼していない」と回答し、米国の成人の半数が、日常生活でAIの利用が増えることで「楽しみよりも不安が大きい」と答えました(「楽しみのほうが大きい」はわずか10%)()。

大きな力には、大きな責任が伴います。そして、多くの不安も伴います。世界の57%の消費者は、AIがプライバシーに重大な脅威をもたらすと感じています()。米国では、2026年3月のPew Researchの調査で、47%の成人が「米国がAIを適切に規制することにあまり、またはまったく信頼していない」と回答し、米国の成人の半数が、日常生活でAIの利用が増えることで「楽しみよりも不安が大きい」と答えました(「楽しみのほうが大きい」はわずか10%)()。

ビジネスリーダーでさえ心配しています。**64%**がAIの不正確さやミスの可能性を懸念し、**60%**はAI関連のサイバーセキュリティ脆弱性を重大な問題として挙げています()。

コンプライアンス:動き続ける標的

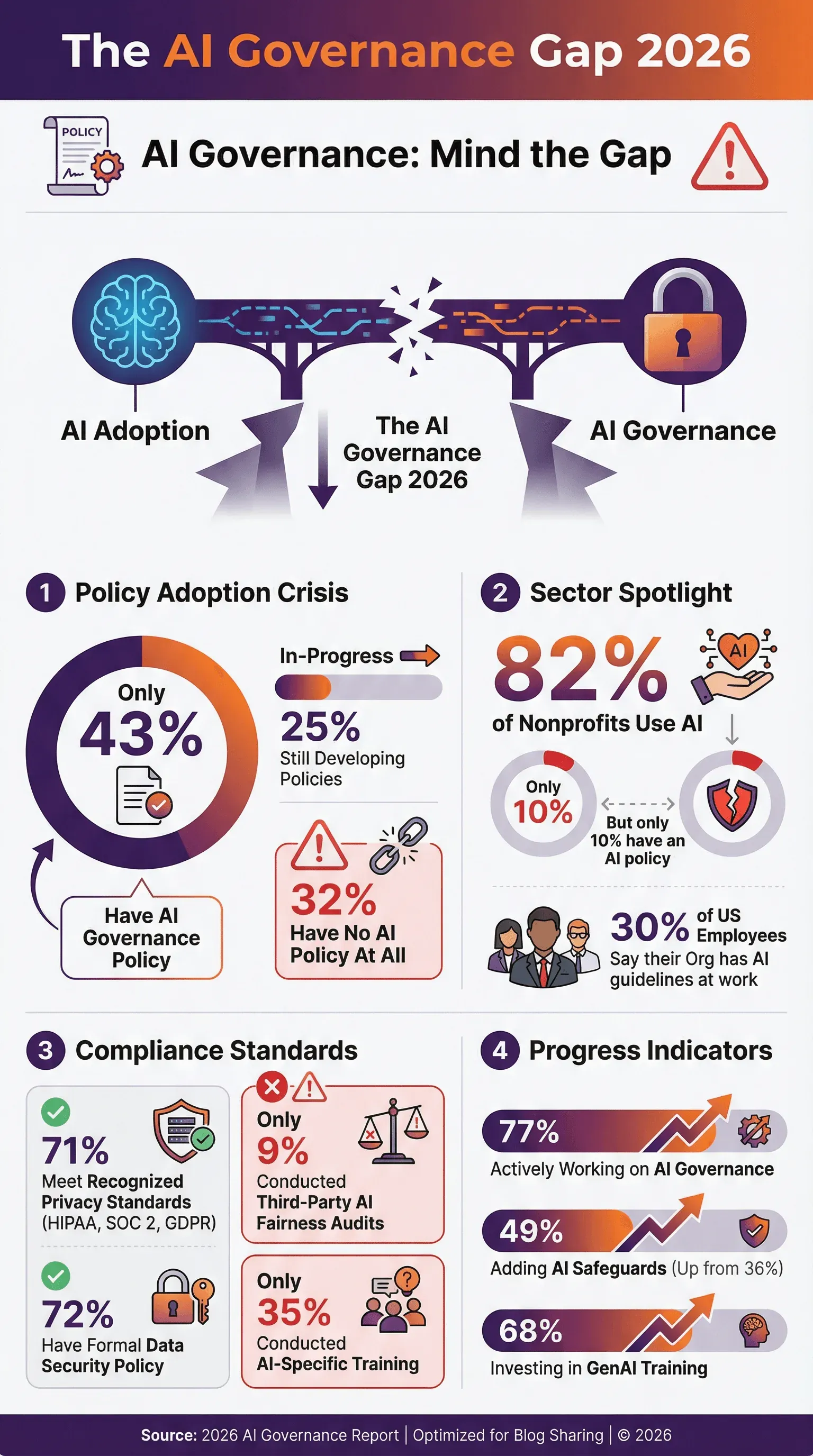

組織は、GDPR、CCPA、HIPAA、SOC 2のような規制への対応に追われていますが、AIはしばしば新たな厄介さを持ち込みます。71%の組織は、認知されたデータプライバシー基準を満たしていると答えています()。**72%は正式なデータセキュリティポリシーを持っています。しかしここで問題なのは、AIガバナンスや倫理に特化したポリシーを持つ企業は半数未満だということです。AIガバナンスポリシーがある組織は43%**にすぎず、さらに25%はまだ策定中です(、)。残りは? ほぼ手探りの状態です。

AIデータプライバシーポリシーの導入

正式なAIデータプライバシーポリシーは、もはや「あれば便利」から「必須」へと急速に変わりつつあります。それでも、数字を見るとまだ大きなギャップがあります。

- 43%の企業しかAIガバナンスポリシーを持っておらず、さらに25%が策定中です()。

- 米国では、職場でのAI利用に関するガイドラインやポリシーがあると答えた従業員は**30%**にすぎません()。

- 非営利団体では、82%がAIを使っている一方で、AIポリシーを持つのは**10%**だけです()。

- 朗報もあります。77%の組織がAIガバナンスの整備に積極的に取り組んでおり、AIを多用する組織ではその割合はほぼ90%に跳ね上がります()。

先行企業は、禁止するAI用途、人によるレビューの義務、フェアネスと透明性へのコミットメントなどを盛り込んでポリシーを更新しています。まだ始めていないなら、漏えいや新法に迫られる前の今が始めどきです。

AIデータプライバシー監査と認証

ポリシーは大切ですが、実際にやっていることを示すのが監査と認証です。

- 71%の企業が、HIPAA、SOC 2、GDPRなどの認知された基準への準拠を報告しています()。

- 健康データについては、**51%**がベンダーにHIPAA準拠を求め、**45%**がエンドツーエンド暗号化を要求しています()。

- AIの公平性やバイアスに焦点を当てた第三者監査を実施した組織は**9%**にとどまりますが、規制が追いつくにつれてこの数は増えると見られています()。

SOC 2、ISO 27001、HITRUSTのような認証は、競争上の差別化要因になりつつあります。ベンダー側なら、顧客から証明を求められる覚悟が必要です。買い手側なら、パートナーが十分な水準にあるか必ず確認しましょう。

AIサイバーセキュリティ:脅威、事案、対応

サーバールームの中の厄介者について話しましょう。AIはサイバー攻撃の標的であるだけでなく、攻撃者の道具にもなっています。その数字は、正直かなり怖いものです。

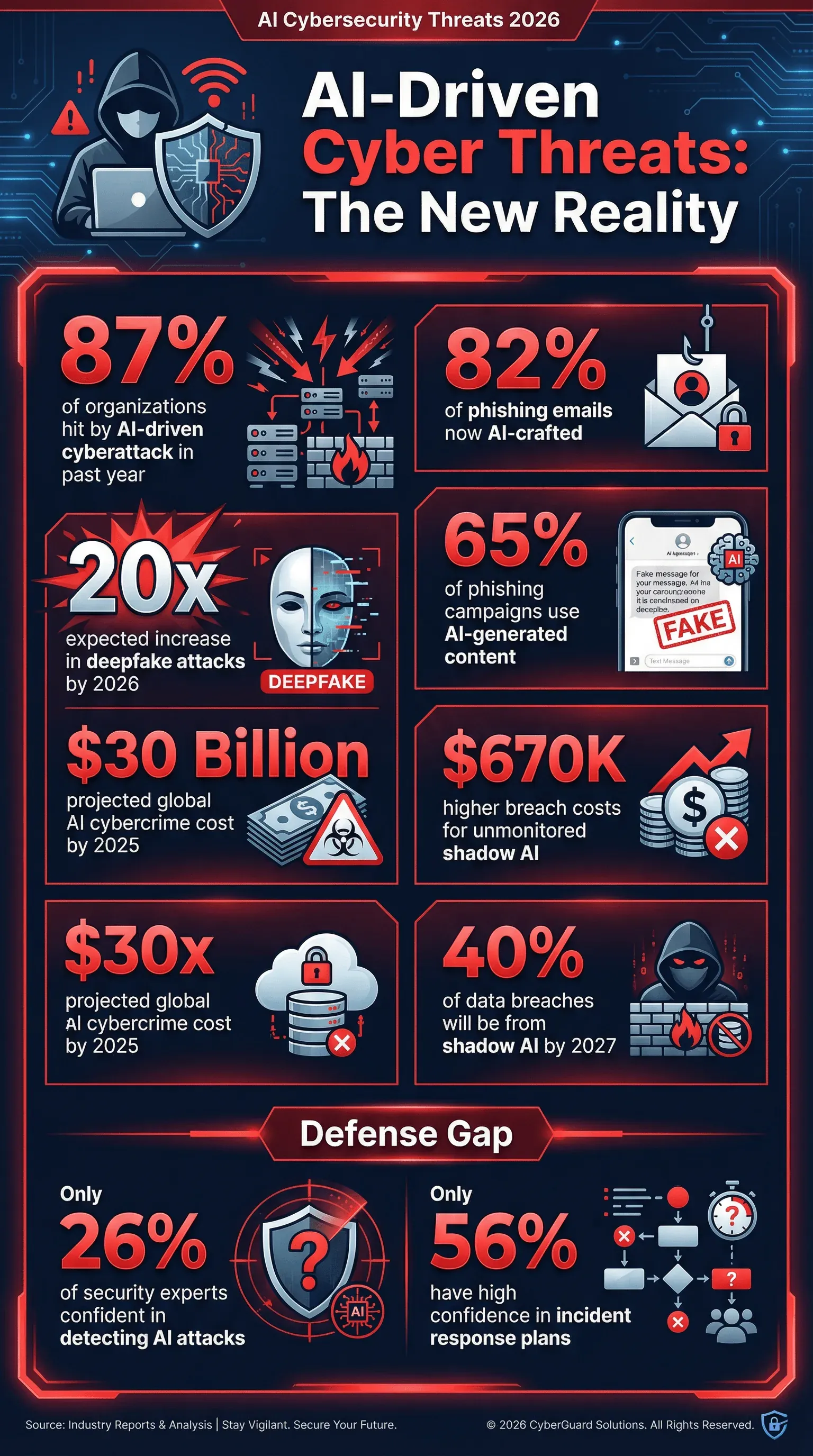

- 87%の組織が過去1年にAI主導のサイバー攻撃を経験しました()。

- **フィッシング攻撃の65%**が、信頼されている通信を模倣するためにAI生成コンテンツを使っています()。

- **フィッシングメールの82%**がAIの助けで作られていると推定されています()。

- ディープフェイク攻撃は2026年までに20倍に増えると見込まれています()。

- シャドーAI(従業員による無断AI利用)は拡大するリスクです。Gartnerは、2027年までに40%のデータ漏えいがAIの不正利用や「シャドーAI」システムの使用に起因すると予測しています()。

さらにCISOを夜眠れなくさせる統計があります。AI主導の攻撃を検知できる自信が高いと答えたセキュリティ専門家は、わずか**26%**です()。世界レベルの手品師を相手にかくれんぼをするようなものです。

AI主導のサイバー攻撃:数字が示すもの

- 87%の組織が、この12か月でAI強化型の攻撃を受けました()。

- フィッシングはより巧妙に: 2025年後半には、82%以上のフィッシングメールがAIで作成されていました()。

- ディープフェイクは爆発的に増加: ディープフェイク音声・動画攻撃は2026年までに20倍になると見込まれています。

- シャドーAIは危険: 2027年までに、40%のデータ漏えいがAIの不正利用または「シャドーAI」によるものになるでしょう()。

- シャドーAIは漏えいコストも押し上げる: シャドーAIが関与した漏えいの平均損失額は463万ドルで、世界平均より約67万ドル高く、顧客PIIの露出率も世界平均53%に対し65%と高い結果でした()。

- 世界的な被害額: AIを用いたサイバー犯罪による損失は、2025年までに300億ドルに達すると予測されています()。

- アクセス制御が不十分: AI関連の漏えいを経験した組織のうち、**97%**が適切なAIアクセス制御を備えていなかったと報告し、**63%**はAIガバナンスポリシーがないか、まだ作成中でした()。

AI生成のメールを使ったフィッシング訓練や、ディープフェイクを想定した防御テストをしていないなら、かなり危ない賭けをしているのと同じです。

AIサイバーセキュリティへの組織投資

朗報もあります。組織はかつてないほどAIサイバーセキュリティに投資しています。

- 60%の組織がサイバーリスク軽減への投資を増やしており、その推進力の1つがAIです()。

- **69%**が不正検知と防止にAIまたは機械学習を使っています()。

- **53%**がサイバーセキュリティ採用でAI・MLスキルを優先しています()。

- データセキュリティとリスク管理への世界支出は、2025年までに2,120億ドルに達すると予測されています()。

それでもギャップはあります。AIインシデント対応を「優秀」と評価した組織の割合は、導入が進む一方で**2024年の28%から2025年の18%**へ低下しました()。2024年の一部調査で示された56%という自信度は、実際の備えをやや過大評価しています。

AIデータガバナンス:教育、監督、バイアス軽減

どれだけ技術が整っていても、人とプロセスが追いついていなければ、まだ危険です。

- 35%の組織しか、プライバシー、セキュリティ、倫理についてチーム向けのAI特化研修を実施していません()。

- 68%の企業が、従業員向けの生成AI研修に投資しています()。

- **30%**が、AIの安全対策として人間の監督に依存しています()。

- 独立監査をAIの公平性評価に使っているのは、わずか**9%**です()。

- **49%**がAIガバナンスの安全策を追加中で、前年の36%から増加しています。

バイアスも大きなプライバシー問題です。人種、性別、その他の属性に基づいて個人データを違うように扱うAIは、不平等なプライバシー侵害や法的トラブルにつながる可能性があります。46%の役員は、公平性を含む責任あるAIの実現を、自社のAI投資における最重要目標の1つとしています()。しかし、バイアスの測定と軽減は、ほとんどの組織にとってまだ道半ばです。

AIのバイアスと公平性:プライバシーへの影響

- バイアスや安全性の問題を含むAI関連事案は、年々急増しています()。

- 一部企業では、バイアス軽減の取り組み後、求人候補者推薦における性別格差が25%縮小しました。

- 規制圧力も高まっています。EUのGDPRと今後施行されるAI Actでは、「高リスク」AIシステムに対してバイアスリスク評価が求められる見込みです。

AIのバイアスをテストしていないなら、悪いPRだけでなく、訴訟や失注のリスクも抱えていることになります。

ベンダーとエコシステムのリスク:集約と第三者リスク

どの会社も孤立してはいません。多くの企業は、ベンダー、クラウド事業者、パートナーの網の上に成り立っており、そのどれもがプライバシーリスクを持ち込み得ます。

- 54%の企業が、コスト管理とデータ露出の最小化のためにベンダー数を絞っています()。

- 70%の企業が、技術ベンダーを審査する際にデータプライバシーポリシーを必須と考えています。

- **56%**がAI主導のサプライチェーン攻撃を懸念しています()。

流れとしては、ベンダーを集約し、より強いプライバシー管理を求め、パートナーを自社のセキュリティ境界の延長として扱うことです。

規制と顧客からの圧力:AIデータプライバシーにおける透明性と開示

規制当局と顧客は、ますます厳しい目を向けています。2024年の米国では59件のAI関連規制措置があり、前年の2倍以上でした。世界では少なくとも75か国がAI規制を議論または導入しています()。

- 透明性が新しい標準: 顧客はAI利用の開示を求めていますが、39%の企業はAIの利用について顧客に自発的に知らせていないと認めています()。

- 監査対応は必須: HIPAA、SOC 2、AIツール一覧、データ処理管理など、コンプライアンスの証拠を示せるようにしておきましょう。

- 基盤モデル開発者の透明性は実際には低下している。 StanfordのFoundation Model Transparency Indexは、100点満点中の平均が2024年の58点から2025年の40点に下がりました。最先端ラボの多くが、訓練データ、計算資源、リスクについて前年より少なくしか開示していません()。

監査や、厳しい顧客アンケートに備えられていないなら、2026年に対応できる状態ではありません。

AIデータプライバシーの未来:予測と新たなトレンド

これから先、私が見ている展望と、専門家が指摘していることは次のとおりです。

- プライバシーが競争優位に: AIが安全で、プライバシー保護に優れ、倫理的であることを証明できる企業が顧客を獲得していきます()。

- 統合ガバナンス: プライバシー、セキュリティ、倫理を1つの組織にまとめた「AI Trust」部門が登場しそうです。

- プライバシー強化技術(PETs): 2025年末までに60%以上の企業がPETsを導入する計画です()。

- 自動化されたコンプライアンス: AI向けRegTechが必須になり、AIシステムを継続監視してコンプライアンス問題を検知するツールが重要になります。

- 国境をまたぐデータ課題: 2027年までに、**AI関連データ漏えいの40%**は越境データの不正利用から発生すると見られています()。

- 個人の管理権限の拡大: 人々が自分のデータがAIでどう使われるかを管理できるツールが増えていくでしょう。

- プライバシーのためのAI: AIは個人情報の検出・マスキング、合成データの生成などに使われるようになります。

- インシデント対応とレジリエンス: 組織は予防だけでなく回復力へと軸足を移し、AI関連インシデント向け保険の導入や、データポイズニングやモデル破損からの復旧訓練も行うようになります。

自動化とAIに強いこだわりを持ち、そしてデータプライバシーには健全なレベルの警戒心を抱いている私としては、今後10年の勝者は、プライバシーとセキュリティを後付けではなく中核機能として扱う企業だと確信しています。

重要ポイント:2026年のAIデータプライバシー統計があなたの組織に意味すること

最後に、すぐ行動できるポイントで締めくくりましょう。来年のニュースで「こうなってはいけない」と語られる側には、誰もなりたくありません。

- AIデータプライバシーを戦略の中核に据える。 後付けではなく、最初から組み込んでください。

- 包括的なAIリスク評価を行う。 自社のAIシステム、データフロー、リスクポイントを把握しましょう。

- AI特化の教育とガバナンスに投資する。 チームを弱点にしないことです。

- AIを前提に技術的防御を強化する。 AIにはAIで対抗し、高度な監視・検知ツールを導入しましょう。

- ベンダー管理を徹底する。 ベンダーを集約し、精査し、コンプライアンスの証拠を求めてください。

- 透明性を受け入れる。 いつ、どのようにAIを使っているのかを、顧客やユーザーに先に伝えましょう。

- プライバシー強化技術を導入する。 可能な限り、匿名化、暗号化、データ最小化を行ってください。

- 最悪に備える。 AIインシデント対応計画を作り、定期的に訓練しましょう。

- 進化する法規制と基準を常に追う。 規制環境は急速に変わっています。出遅れないようにしましょう。

- 信頼を北極星にする。 2026年以降、信頼こそが最も価値ある資産です。

参照できる出典とさらに読む

もっと深く知りたい、あるいは次のプレゼンに使える統計が必要ですか? このまとめで参考にした主な情報源はこちらです。

- )

AI、自動化、データプライバシーについてさらに知りたい方は、をご覧いただくか、とに関するガイドもぜひご覧ください。