ビジネスの現場では「データは新しい石油」とよく言われるけど、もし今もウェブサイトから手作業でコピペしているなら、それはまるでスプーンで油田を掘っているようなものだよね。今のデータ社会では、チームが1日にし、オフィスワーカーは週にのが現実。これじゃ、単純作業に追われてヘトヘトになるのも当然だよね。

だからこそ、Pythonでウェブスクレイピングのやり方を身につけるのは、営業やオペレーション、リサーチ部門にとって超強力な武器になるんだ。Pythonのウェブスクレイピングツールを使えば、何時間もかかる作業が数行のコードで一瞬で終わる。もし「コードはちょっと苦手…」って人でも、みたいなAI搭載ツールを使えば、数クリックで同じことができちゃう。初心者から上級者まで、Pythonでウェブサイトをスクレイピングする「なぜ・何を・やり方」を一緒に見ていこう(Thunderbitを使えば、さらに効率アップ間違いなし!)。

なぜPythonでウェブサイトをスクレイピング?

ウェブスクレイピングといえば、やっぱりPythonが定番。その理由はめちゃくちゃシンプル。Pythonは流行ってるだけじゃなくて、使いやすさ・拡張性・サポート体制、全部そろってる。

Pythonが選ばれる理由:

- 学びやすくて使いやすい: Pythonの文法はすごくシンプルで直感的。プログラミング初心者でも、すぐにウェブデータ取得のスクリプトが書ける。

- ライブラリが豊富: 、、、など、用途に合わせて選べる強力なライブラリが揃ってる。静的HTMLの解析からブラウザ操作まで幅広く対応。

- コミュニティとドキュメントが充実: 困ったときはStack Overflowとかでサクッと解決策が見つかるし、ドキュメントも豊富だから初心者でも安心。

- 連携が柔軟: Pythonは他のツールとも相性バッチリ。AI搭載のと組み合わせて高度なデータ抽出もできるし、取得データの自動処理や分析、機械学習への応用も簡単。

JavaScriptやRなど他の言語と比べても、Pythonは学習コストが低くて、ウェブスクレイピングに最適なサポート体制が整ってる。業界のプロも「Pythonはウェブスクレイピング界のスイスアーミーナイフ」と言うくらい、万能で信頼できる存在だよ。

基本を押さえよう:Pythonでウェブサイトをスクレイピングする流れ

Pythonでウェブスクレイピングをやるときの基本的な流れを分かりやすく分解してみるね。1ページだけ取得する場合も、サイト全体をクロールする場合も、基本のステップは同じ。

| ステップ | 内容 | Pythonライブラリ例 |

|---|---|---|

| 1. Webリクエスト送信 | 対象ページのHTMLを取得 | requests.get() |

| 2. HTML解析 | ページ構造を解析 | BeautifulSoup() |

| 3. データ抽出 | 必要な情報(例:タイトルや価格)を取得 | soup.find_all() |

| 4. データ保存・出力 | CSVやExcel、データベースに保存 | csv、pandas、openpyxl |

一見シンプルだけど、実際にはページネーションや動的コンテンツ、頻繁なレイアウト変更など、思わぬ壁にぶつかることも。そんなときはThunderbitの「2クリックスクレイピング」やAIによるフィールド自動検出がめちゃくちゃ役立つよ。

Pythonで使える主なスクレイピングライブラリ

Pythonには、いろんな用途に対応できるウェブスクレイピング用ライブラリが揃ってる。代表的なものをサクッと紹介するね。

BeautifulSoup:手軽にHTML解析

は、静的なHTML解析にピッタリな初心者向けライブラリ。

- 強み: シンプルで直感的。小規模なプロジェクトに最適。

- 弱み: 複数ページのクロールやJavaScript対応は苦手。

- 活用例: 静的なECサイトの商品リスト抽出など。

Scrapy:大規模クロールに最適なフレームワーク

は、本格的なウェブスクレイピングに使える強力なフレームワーク。

- 強み: 高速・スケーラブル。ページネーションやサブページも自動で処理。

- 弱み: 学習コストがやや高く、初期設定も必要。

- 活用例: 大規模ECサイトの全カテゴリ・商品データ取得など。

Selenium:動的コンテンツや操作が必要なときに

は、JavaScriptで動くサイトやログイン・ボタンクリックなどの操作が必要なときに大活躍。

- 強み: ブラウザ自動操作が可能。動的コンテンツにも対応。

- 弱み: 他のツールより動作が重く、処理速度も遅め。

- 活用例: ログインが必要なダッシュボードやインタラクティブなサイトのデータ取得。

Requests:Webページ取得の基本

は、HTTPリクエスト送信の定番ライブラリ。BeautifulSoupとセットで使うことが多いよ。

- 強み: 使いやすく、Cookieやセッション管理も簡単。

- 弱み: JavaScriptのレンダリングは不可。

- 活用例: BeautifulSoupで解析するためのHTMLダウンロード。

作業効率を最大化:ThunderbitとPythonでウェブスクレイピング

ここでちょっと裏話。Python好きの自分でも、毎回コードを書くのは正直めんどくさいときがある。そんなときに便利なのが。AI搭載のChrome拡張機能で、誰でもノーコードでウェブスクレイピングができる。

Thunderbitは、スピード重視のビジネスユーザー向けに設計されてる。AIフィールド提案やサブページスクレイピング、ExcelやGoogle Sheetsへの即時エクスポートなど、Pythonスクリプトとデータアナリストの両方の役割をこなしてくれる。

Thunderbitの2クリックスクレイピング vs. Python手動コーディング

従来のPythonによるスクレイピングとThunderbitの違いを比べてみよう:

| 作業内容 | Pythonスクリプトの場合 | Thunderbit AIウェブスクレイパーの場合 |

|---|---|---|

| 環境構築 | Python・pip・ライブラリをインストール | Chrome拡張機能をインストール |

| ページ構造の確認 | ブラウザ開発者ツールでセレクタを調査 | 「AIフィールド提案」をクリック |

| 抽出コードの作成 | Pythonコードを記述・デバッグ | 「スクレイピング」ボタンをクリック |

| ページネーション対応 | ループ処理やURL管理を自作 | UIで「ページネーション」を有効化 |

| データ出力 | コードでCSV/Excelに書き出し | 「Google Sheets/Excel/Notion/Airtableにエクスポート」をクリック |

| メンテナンス | サイト変更時にコード修正が必要 | AIが自動で対応 |

Thunderbitなら、ほとんどのウェブサイトから2クリックでデータ取得が可能。コードもテンプレートも不要で、手間いらず。もっと高度な自動化や定期実行が必要なときは、Pythonと組み合わせてThunderbitの出力を活用できるよ。

ThunderbitとPythonスクリプトの連携

さらに応用すると、PythonでThunderbitのウェブスクレイピングを制御・スケジューリングすることもできる。例えば:

- Thunderbitを定期的に自動起動(例:毎日の価格チェック)

- pandasやscikit-learnでエクスポートデータを加工・分析

- Thunderbitで取得したデータと他のデータソースを組み合わせて分析や機械学習に活用

このハイブリッドな使い方なら、Thunderbitの手軽さとPythonの柔軟性・拡張性の両方を活かせるよ。

ステップバイステップ:Pythonでウェブサイトをスクレイピングするやり方

それじゃ、Pythonでウェブスクレイピングを始めるための基本手順を見ていこう。

ステップ1:Python環境の準備

まずはPythonがインストールされているか確認しよう。やの利用がおすすめ。

1# pipがなければインストール

2python -m ensurepip --upgrade

3# 仮想環境の作成(推奨)

4python -m venv myenv

5source myenv/bin/activate # Windowsの場合: myenv\Scripts\activate

6# 必要なライブラリをインストール

7pip install requests beautifulsoup4 pandasステップ2:WebページのHTMLを取得

Requestsライブラリで対象ページのHTMLをダウンロードしよう。

1import requests

2url = 'https://example.com/products'

3response = requests.get(url)

4if response.status_code == 200:

5 html = response.text

6else:

7 print("ページ取得に失敗:", response.status_code)トラブルシューティング: 403や404エラーが出る場合は、ボット対策やヘッダー・クッキーの設定を見直してみて。

ステップ3:HTML解析とデータ抽出

BeautifulSoupでHTMLを解析して、必要なデータを取り出そう。

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html, 'html.parser')

3products = soup.find_all('div', class_='product-item')

4data = []

5for product in products:

6 name = product.find('h2').get_text(strip=True)

7 price = product.find('span', class_='price').get_text(strip=True)

8 data.append({'name': name, 'price': price})ポイント: ブラウザの「要素を検証」機能で、適切なHTMLタグやクラス名を調べておくとスムーズ。

ステップ4:データの保存・エクスポート

取得したデータをCSVファイルに出力すれば、共有や分析もラクラク。

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv('products.csv', index=False)Thunderbitを使う場合は、「Google Sheetsにエクスポート」や「CSVでダウンロード」をクリックするだけでOK。

応用編:PythonとThunderbitで自動化・大規模スクレイピング

基本をマスターしたら、さらに自動化やスケールアップもできるよ:

- ページネーション対応: Pythonならページ番号や「次へ」リンクをループ処理。ThunderbitならAIが自動でページ送り。

- サブページのデータ取得: Pythonでリンクをたどるコードを書くか、Thunderbitのサブページスクレイピング機能で自動的にデータを拡充。

- 定期実行: Pythonの

scheduleライブラリやThunderbitのスケジューラーで、毎日・毎週など定期的にスクレイピング。 - 複数データソースの統合: 複数サイトから取得したデータを統合し、競合調査や市場分析に活用。

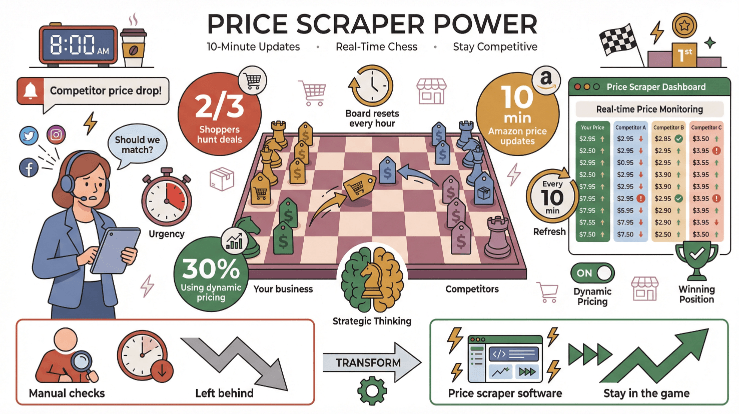

実例: あるECチームはThunderbitで10サイトの競合価格を毎日自動取得し、Google Sheetsにエクスポート。これで、夜遅くまでスプレッドシートと格闘することが激減したんだ。

データ倫理とプライバシー:Pythonで安全・適切にスクレイピングするために

大きな力には大きな責任がつきもの。以下のポイントを守って、法令や倫理をしっかり意識しよう:

- robots.txtや利用規約の遵守: サイトがスクレイピングOKか必ず確認。不明な場合は事前に問い合わせを。

- リクエストの制限: サーバーに負荷をかけないよう、適切な間隔でリクエストを送ろう。

- 個人情報の回避: 許可なく個人情報や機密データを取得しない。GDPRなどのデータ保護法も守ろう。

- スクレイパーの明示: User-Agentを設定して、取得目的を明確に。

- 削除依頼への対応: データセットからの削除依頼があれば速やかに対応。

Thunderbitは、リクエスト速度の自動調整やログイン対応、データ整理機能など、ユーザーが適切にウェブスクレイピングできるようサポートしてる。詳しくはもチェックしてみて。

データ活用:スクレイピングデータで分析・機械学習を実現

スクレイピングで集めたデータは、活用してこそ価値が出る。PythonやThunderbitを使えば:

- データのクレンジング・整形: pandasで重複除去や表記揺れ修正、フォーマット統一などができる。

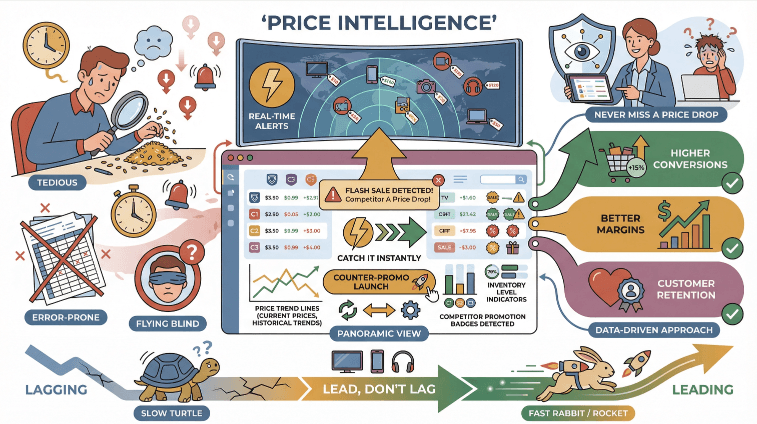

- トレンド分析: 競合価格の推移やレビューの感情分析、市場動向の把握などに活用。

- 機械学習モデルの構築: scikit-learnで価格予測や顧客セグメント分析、感情分類モデルを作成。

- レポート自動化: リアルタイムデータをもとにダッシュボードやアラートを自動生成。

事例: あるプロダクトチームは数千件のカスタマーレビューをPythonでクレンジングし、ThunderbitのAIで感情タグ付け。これで商品改善やマーケティング施策に直結するインサイトをゲットできたよ。

まとめ・ポイント

最後にポイントをおさらいしよう:

- Pythonはウェブスクレイピングに最適な言語。シンプルな文法、強力なライブラリ、活発なコミュニティが魅力。

- Thunderbitなら誰でも簡単にウェブスクレイピング。AI搭載・ノーコードで、フィールド検出やサブページ取得も自動化。

- PythonとThunderbitの組み合わせで高度な自動化も実現。定期実行やデータ処理、業務フローへの統合も自在。

- 常に適切な方法でウェブスクレイピングを。サイトの規約やプライバシー法、倫理基準を守ろう。

- データをビジネスの武器に。分析・レポート・機械学習など、取得データを最大限活用しよう。

データ活用を次のレベルに引き上げたいなら、Pythonでのウェブスクレイピングにぜひチャレンジしてみて。コード不要で始めたい人は、もおすすめ。さらに詳しいノウハウやチュートリアルはでチェックしてみてね。

よくある質問(FAQ)

1. Pythonでのウェブスクレイピングは合法?

ウェブスクレイピングは、サイトの利用規約やrobots.txt、データ保護法を守ればOK。個人情報や機密データの無断取得はNG。

2. コードが書けなくても簡単にウェブスクレイピングできる?

なら、ノーコード&AI搭載のChrome拡張機能で、どんなウェブサイトでも2クリックでデータ取得できるよ。

3. 動的なウェブサイトにはどのPythonライブラリが最適?

JavaScriptで動くサイトや操作が必要な場合はが便利。静的ページならやで十分。

4. ウェブスクレイピング作業を自動化するには?

Pythonならcronやscheduleライブラリで定期実行が可能。Thunderbitにも定期ウェブスクレイピング機能があるよ。

5. サイトのレイアウトが変わったらどうすればいい?

従来のPythonスクリプトはサイト変更で動かなくなることも。ThunderbitのAIなら自動で対応し、メンテナンスの手間を大幅に削減できる。Pythonの場合はセレクタや解析ロジックの修正が必要。

快適なウェブスクレイピングライフを!データがいつもきれいで、構造化されて、すぐに活用できる状態でありますように。

さらに詳しく知りたい方へ