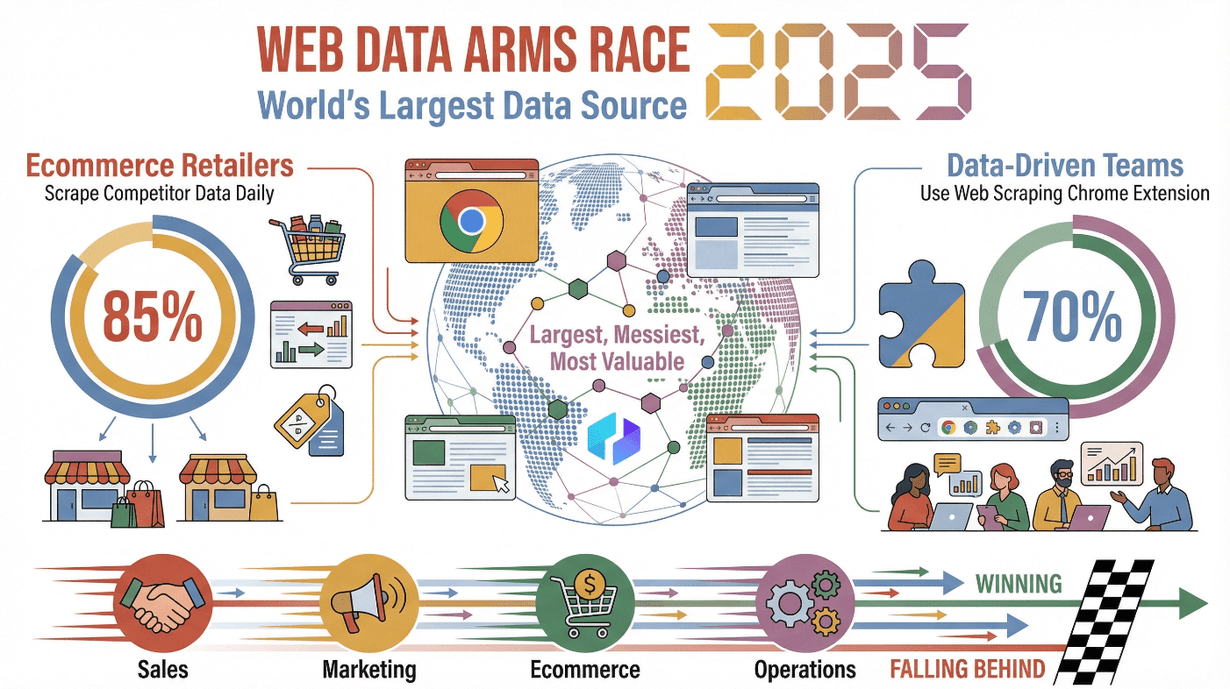

今やウェブは単なる猫動画やミームの宝庫じゃなく、世界最大級で一番カオス、しかも超価値あるデータの山場です。2025年の今、ビジネス現場ではデータ争奪戦が本格化中。、さらにしてるのが現実。営業、マーケ、EC、オペレーション…どの分野でも「必要なデータをいかに早く、正しい形で手に入れるか」が勝負の分かれ目になってるんだよね。

でも、現実はそんなに甘くない。ウェブサイトって基本、人間が見るために作られてて、データを抜き出しやすいようにはできてない。情報はバラバラだし、動的だし、スプレッドシート向きじゃない。そこで頼りになるのがウェブスクレイピングツール。ごちゃごちゃなウェブ情報を、使いやすい構造化データに一発変換してくれる。SaaSや自動化の現場で色んなツールを使ってきた経験から言うと、「自分に合ったツール選びが、作業時間の大幅短縮や精度アップ、そして新しい発見につながる」ってことは間違いない。

でも、現実はそんなに甘くない。ウェブサイトって基本、人間が見るために作られてて、データを抜き出しやすいようにはできてない。情報はバラバラだし、動的だし、スプレッドシート向きじゃない。そこで頼りになるのがウェブスクレイピングツール。ごちゃごちゃなウェブ情報を、使いやすい構造化データに一発変換してくれる。SaaSや自動化の現場で色んなツールを使ってきた経験から言うと、「自分に合ったツール選びが、作業時間の大幅短縮や精度アップ、そして新しい発見につながる」ってことは間違いない。

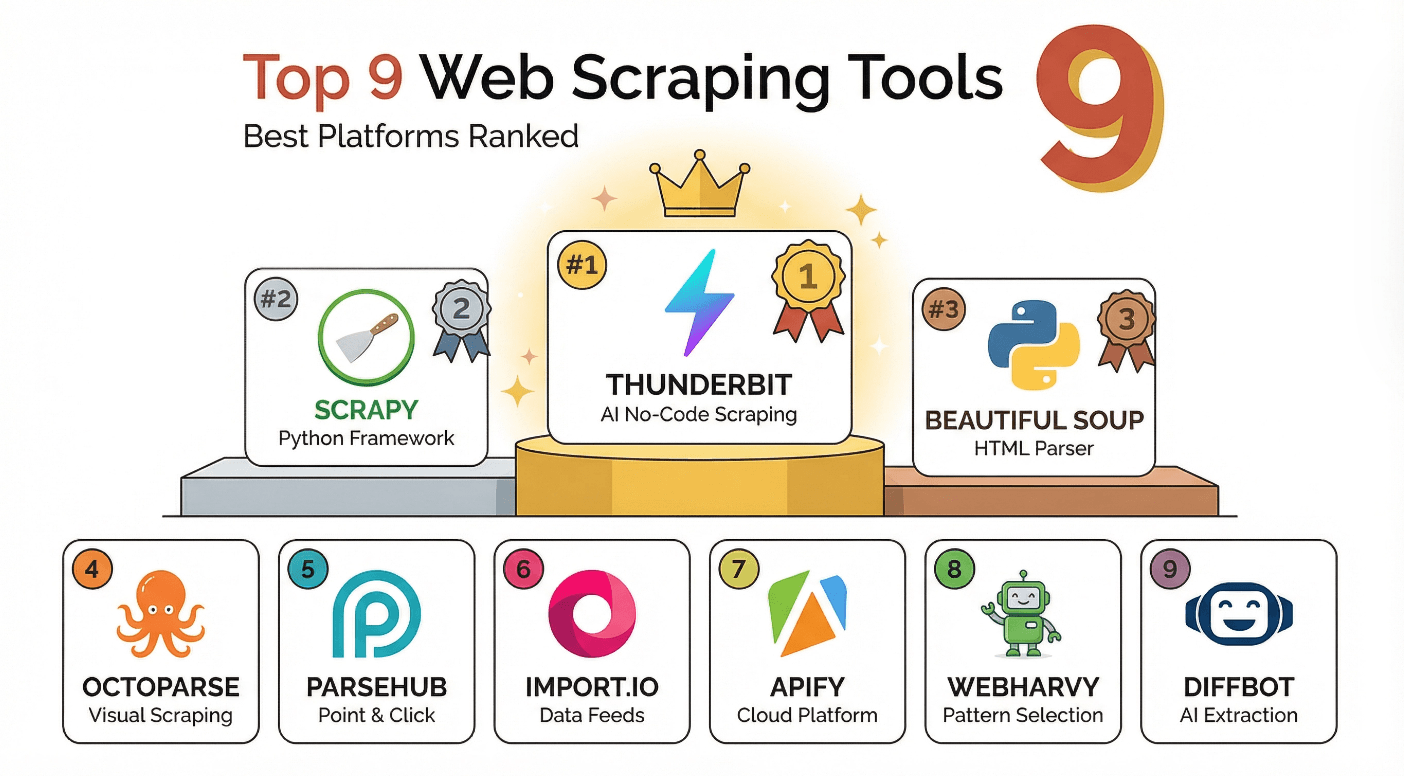

じゃあ、2025年に本当に使う価値があるウェブスクレイピングツールってどれ?AI搭載のChrome拡張から、開発者向けのオープンソースまで、厳選した9つを紹介するよ。

なぜウェブスクレイピングツールが現代ビジネスに欠かせないのか

ウェブスクレイピングツールは、営業力アップ、マーケティング精度の底上げ、業務効率化の裏方として活躍する“秘密兵器”。その理由はこんな感じ:

- リード獲得: 営業チームはディレクトリやLinkedIn、レビューサイトからターゲットリストを自動で作成。

- 競合分析: マーケやEC担当は、競合の価格や新商品、広告出稿状況をリアルタイムでウォッチ。

- 市場調査: アナリストやリサーチャーは、レビューやニュース、ユーザーの声をまとめてトレンドを先取り。

- 価格モニタリング: 小売やブランドは、何百ものサイトで価格や在庫を自動追跡して競争力をキープ()。

- コンテンツ集約: オペレーション部門は求人、不動産、サプライヤーカタログなどからデータを一括取得して業務効率化。

ウェブスクレイピングツールがビジネス成果をどう後押しするか、ざっくりまとめるとこんな感じ:

| ビジネス用途 | 手作業の課題 | スクレイピングでの解決 |

|---|---|---|

| リード獲得 | 複数サイトからのコピペ | 自動抽出&一括エクスポート |

| 価格モニタリング | 毎日の手動チェック | 定期スクレイピング&即時アラート |

| 市場調査 | 膨大なレビューの読破 | 構造化データで一括集約 |

| コンテンツ集約 | 複数サイトのデータ統合 | Excel/Sheetsへの統一出力 |

| 競合分析 | 情報が遅く不完全 | リアルタイムで網羅的なインサイト |

実際、最新のスクレイピングツールを導入した企業はし、してるよ。

ベストウェブスクレイピングツールの選び方

ウェブスクレイピングツールって全部同じじゃない。ノーコードでサクッと使いたいビジネスユーザー向けもあれば、ガッツリ開発したいエンジニア向けもある。今回の選定ポイントはこんな感じ:

- 使いやすさ: コーディング不要で直感的に使える?

- 拡張性: 数百〜数百万ページの処理や自動化・スケジューリングができる?

- データ出力: Excel、Google Sheets、Airtable、Notion、API連携など多彩なエクスポート先に対応?

- サポート・コミュニティ: ドキュメントやチュートリアル、サポート体制がしっかりしてる?

- 価格・コスパ: 無料プランや料金体系が分かりやすい?

- 独自機能: AI抽出、サブページ対応、API連携、ビジュアルワークフローなど強みがある?

さらに、それぞれのツールがどんなビジネスシーンに合うかも整理してるから、自分のニーズやスキルに合ったものを見つけてみて。

1. Thunderbit

は、AI搭載で手軽にウェブスクレイピングを始めたいビジネスユーザーにぴったりなChrome拡張。営業・マーケ・EC・オペレーションなど、正確で構造化されたデータをサクッと手に入れたい現場に最適。

Thunderbitのポイントは「シンプルさ」と「パワフルさ」:

- AIによるフィールド提案: 「AIフィールド提案」ボタンでページを自動解析、名前・価格・メールなどのカラムを自動生成。各項目の抽出プロンプトも自動作成。

- サブページ抽出: 商品やプロフィールなど詳細ページもAIが自動巡回してテーブルを充実。面倒な設定は不要。

- 即時エクスポート: Excel、Google Sheets、Airtable、Notionへワンクリックで出力。エクスポートはいつでも無料。

- 定期スクレイピング: 「毎日価格チェック」など自然言語でスケジュール設定して自動化OK。

- 無料のメール・電話番号・画像抽出: 連絡先や画像もワンクリックで取得。

- AIオートフィル: AIがウェブフォームを自動入力。ルーチン作業の効率化に最適。

Thunderbitはしてて、は最大6ページ(トライアルで10ページ)までスクレイピングOK。有料プランは月15ドルからで、チーム規模問わず導入しやすい価格帯。

使い方はやで詳しく解説中。

2. Scrapy

は、開発者向けのオープンソースフレームワーク。Pythonで柔軟なクローラー(スパイダー)を作れて、大規模なデータ収集や処理も余裕。

Scrapyがエンジニアに人気な理由:

- 高機能フレームワーク: 複雑な多階層クロールやカスタムパイプライン、API連携もサポート。

- 大規模対応: 複数ページの同時処理や並列リクエストで大規模案件もOK()。

- 拡張性: プロキシやユーザーエージェント、JavaScriptレンダリング(Splash連携)も柔軟に追加可能。

- 活発なコミュニティ: チュートリアルやプラグインが豊富で、上級者向けのサポートも充実。

Pythonスキルがあって、大規模なデータ収集やパイプライン連携、再利用可能なワークフローを作りたいチームにおすすめ。オープンソース&無料だけど、環境構築や保守は自分でやる必要あり。

3. Beautiful Soup

は、HTMLやXMLの解析に特化したPythonライブラリ。静的なウェブページからサクッとデータを抜きたい初心者におすすめ。

Beautiful Soupの魅力:

- 初心者にやさしい: 学習コストが低く、チュートリアルも豊富()。

- 柔軟な解析: 崩れたHTMLや複雑な構造も簡単に処理。

- 小規模案件に最適: 単発スクリプトや学習用途、ちょっとしたデータ取得に便利。

ただし、大規模や動的サイトには不向きで、JavaScriptの処理はできない。requestsやSeleniumと組み合わせるか、より高度なScrapyへのステップアップも検討しよう。

4. Octoparse

は、ノーコードで使えるウェブスクレイピングツール。個人から大企業まで幅広く使われてて、直感的な操作で複雑なサイトからもデータ抽出できる。

Octoparseが選ばれる理由:

- コーディング不要: ビジュアルワークフロー、ドラッグ&ドロップ、テンプレートも充実。

- クラウド&ローカル対応: デスクトップでもクラウドでも実行できて、大規模案件も高速処理。

- 動的コンテンツ対応: 「もっと見る」や無限スクロール、AJAXサイトもOK。

- 多彩な出力: CSV、Excel、JSON、HTML、データベース連携も可能()。

無料プランは小規模案件向け。有料プランは月75ドルからで、本格的な市場調査や競合分析、ノーコードで結果を出したい人に人気。

5. ParseHub

は、JavaScriptが多用された動的サイトにも強いビジュアル型スクレイピングツール。クリックやループ、条件分岐など柔軟な抽出ができる。

ParseHubの特長:

- ビジュアル選択: クリックで要素選択、リストのループや階層ページも簡単設定。

- 動的コンテンツ対応: JavaScriptで生成されるデータやドロップダウン、クリック操作も自動化。

- 柔軟な出力: CSV、Excel、JSON、DropboxやAmazon S3連携も()。

- 無料プラン: 5プロジェクト・1回200ページまで。有料プランでさらに拡張。

コード不要で柔軟性を求める中級者におすすめ。ECや求人、不動産サイトのデータ取得にも人気。

6. Import.io

は、エンタープライズ向けの大規模データ抽出&可視化プラットフォーム。直感的な操作性と強力なサポート、分析機能が魅力。

Import.ioの強み:

- ポイント&クリック抽出: コーディング不要で欲しいデータを選択。

- データ可視化: 内蔵ツールで分析・グラフ化・共有も簡単。

- エンタープライズ機能: コンプライアンスやマネージドサービス、大量データ対応。

- 多彩な出力・連携: CSV、Excel、Google Sheets、BIツール連携も()。

価格は企業向けにカスタマイズされてて、大規模データや高度な分析が必要な組織に最適。

7. Apify

は、スケーラブルなウェブ自動化・データ抽出プラットフォーム。開発者向けに「アクター」と呼ばれるスクリプトを作って共有できる。

Apifyが選ばれる理由:

- アクターマーケットプレイス: 200以上のプリセットスクレイパーや独自開発も可能(JavaScript/Python対応)。

- APIファースト: 取得データをワークフローやアプリに直接連携。

- クラウド実行: 大規模処理や定期実行もダッシュボードで一元管理()。

- 柔軟な料金体系: 小規模は無料、大規模は従量課金。

自動化や大規模データ連携を目指す技術者チームにおすすめ。

8. WebHarvy

は、ウェブページ上のデータパターンを自動検出するポイント&クリック型ツール。XPathやCSSセレクタ不要で、ノーコード派に人気。

WebHarvyの主な機能:

- 自動パターン検出: 欲しいデータをクリックするだけで、類似要素を自動抽出()。

- AJAX/JavaScript対応: 動的コンテンツや画像、キーワード抽出もOK。

- 多彩な出力: Excel、CSV、XML、JSON、SQL形式でダウンロード。

- 買い切りライセンス: 一度購入すれば永続利用(1年間のアップデート・サポート付き)。

小規模ビジネスや研究者、個人事業主におすすめ。ビジュアル操作で手軽にデータ取得したい人に最適。

9. Diffbot

は、AIと機械学習・画像認識を活用した次世代型データ抽出サービス。あらゆる公開ウェブページを自動で構造化データに変換。

Diffbotの特長:

- AI抽出: ページ内のエンティティや関係性、事実を自動で特定・抽出()。

- ナレッジグラフ: 人物・企業・商品など膨大なデータベースを常時更新。

- API連携: 取得データをアプリや分析ワークフローに統合()。

- エンタープライズ対応: MicrosoftやAdobe、Hubspotなど大手企業も導入。

価格はスタートアップ向けで月299ドルから。API従量課金もあり、リサーチや大規模データサイエンス、AI精度が求められる現場に最適。

ウェブスクレイピングツール比較表

9つのツールを一覧で比較したよ:

| ツール | 最適な用途 | ノーコード | AI搭載 | API/開発者向け | サブページ抽出 | エクスポート形式 | 価格(初期) |

|---|---|---|---|---|---|---|---|

| Thunderbit | ビジネスユーザー | Yes | Yes | No | Yes | Excel, CSV, Sheets, Notion, Airtable | 無料(6ページ)、$15/月 |

| Scrapy | 開発者 | No | No | Yes | Yes (カスタム) | CSV, JSON, XML, DB | 無料、オープンソース |

| Beautiful Soup | 初心者・開発者 | No | No | Yes | No | Python経由でカスタム | 無料、オープンソース |

| Octoparse | ノーコード・チーム | Yes | No | 一部 | Yes | CSV, Excel, JSON, DB | 無料、$75/月 |

| ParseHub | ビジュアル・動的サイト | Yes | No | 一部 | Yes | CSV, Excel, JSON, S3, Dropbox | 無料、$189/年 |

| Import.io | 企業・分析 | Yes | No | Yes | Yes | CSV, Excel, Sheets, BIツール | カスタム、企業向け |

| Apify | 開発・自動化 | No | No | Yes | Yes | CSV, JSON, Sheets, API | 無料、従量課金 |

| WebHarvy | ノーコード・中小企業 | Yes | No | No | Yes | Excel, CSV, XML, JSON, SQL | $139/年(買い切り) |

| Diffbot | AI・リサーチ・企業 | No | Yes | Yes | Yes (AIクローラー) | JSON, ナレッジグラフAPI | $299/月 |

自分に合ったウェブスクレイピングツールの選び方

どのツールを選ぶか迷ったら、こんな感じで考えてみて:

- ノーコード・ビジネスユーザー向け: Thunderbit、Octoparse、ParseHub、WebHarvy

- 開発・自動化重視: Scrapy、Beautiful Soup、Apify

- エンタープライズ・AI活用: Import.io、Diffbot

- 動的・JavaScript多用サイト: ParseHub、Octoparse、Apify

- 即時・構造化エクスポート: Thunderbit、Import.io

まずは自分の目的やスキルレベルをはっきりさせよう。AI搭載で手間なく即時エクスポートしたいならが最適。カスタムクローラーや高度な自動化ならScrapyやApify、大規模・AI活用ならImport.ioやDiffbotが強い。

多くのツールが無料トライアルを用意してるから、実際に試して自分のワークフローに合うものを見つけてみて。

よくある質問

1. ウェブスクレイピングツールって何?なんで必要なの?

ウェブスクレイピングツールは、ウェブサイトからデータを抜き出して、スプレッドシートやデータベースなど構造化形式に変換してくれるソフト。リード獲得、価格調査、市場分析など、手作業より圧倒的に効率的&正確にデータ収集できる。

2. ウェブスクレイピングは合法?

公開されてるデータを、サイトの利用規約を守って取得する限りは合法。個人情報や機密データの無断取得はNG。必ず現地の法規制もチェックしよう。

3. ノーコードで使えるおすすめツールは?

Thunderbit、Octoparse、ParseHub、WebHarvyはエンジニアじゃなくても使いやすい。特にThunderbitはAIによるフィールド提案や、Excel・Google Sheets・Notion・Airtableへの即時エクスポートが強み。

4. 動的・JavaScript多用サイトも抽出できる?

できる!ParseHub、Octoparse、Apifyは動的コンテンツやAJAX、「もっと見る」ページにも対応。ThunderbitのAIも多くの最新レイアウトに適応。

5. 自分に合ったウェブスクレイピングツールの選び方は?

技術スキル、データ量、出力形式、予算を考えよう。ノーコード派はThunderbitやOctoparse、開発者はScrapyやApify、大規模データやAI活用ならImport.ioやDiffbotがおすすめ。多くのツールが無料トライアルを用意してるから、いくつか試して最適なものを選ぼう。

ウェブを次のビジネスチャンスに変えてみない?するか、でさらに詳しいガイドや活用法をチェックしてみて。ハッピー・スクレイピング!

さらに詳しく知りたい人はコチラ