前の四半期、うちのオペレーションチームは競合データをスプレッドシートにひたすらコピペするだけで、週40時間も溶かしていました。ところが今の四半期は、同じ作業がたった20分で片付きます。

何が変わったのか?答えは自動ウェブスクレイピングツール。昔は「それ、エンジニアの仕事でしょ」って感じだったのに、今は営業やマーケの担当でも、ランチ休憩の間にサクッと設定できるところまで来ています。

私は長年SaaSと自動化ツールを作ってきました(そして、そう、の共同創業者でもあります)。2026年のツール群は過去最高レベルで、AIネイティブ、壊れにくい(自己修復っぽい)、しかも非エンジニアでも「これなら使える」と思えるものがちゃんと揃っています。

この記事では、私が実際に触ってチェックした10個を、用途と必要スキル別に比較しながら紹介します。

なぜ自動ウェブスクレイピングツールがビジネスユーザーに重要なのか

ぶっちゃけ、Webサイトからデータを手でコピペする時代はもう終わりです(反復作業で手首を痛めたり、虚無に浸るのが趣味なら止めませんが)。自動ウェブスクレイピングツールは、規模を問わず多くの企業にとって「ないと困る」存在になりました。実際、とも言われていて、ウェブスクレイピングはそのど真ん中を支えています。

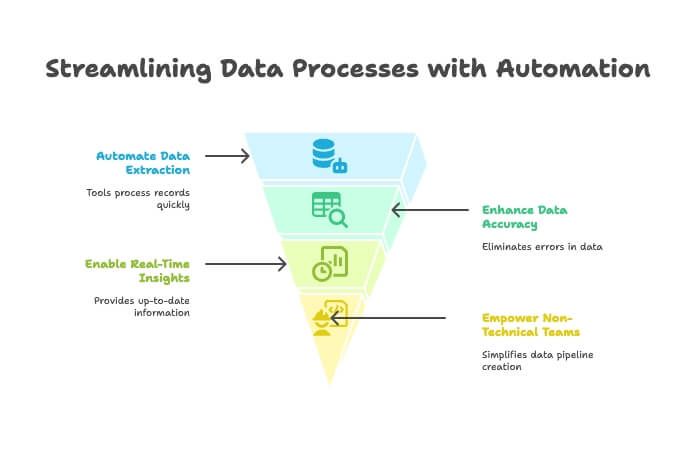

これらのツールがちゃんと価値を出す理由は、こんな感じです。

- 時間短縮&手作業の削減: 自動スクレイパーなら数千件のレコードを数分で処理でき、チームはもっと価値の高い仕事に集中できます。あるユーザーは、データ収集を自動化して「何百時間も節約できた」と報告しています()。

- データ精度の向上: 入力ミスや抜け漏れがガクッと減ります。自動抽出により、よりクリーンで信頼できるデータになります。

- 意思決定の高速化: リアルタイムでデータを取れるので、競合監視・価格追跡・リードリスト作成を、月次のインターン報告待ちにせず回せます。

- 非エンジニアでも運用可能: ノーコードやAI駆動のツールのおかげで、「XPathってヨガのポーズ?」みたいな人でもWebデータのパイプラインを作れるようになりました()。

さらに、とも言われ、約80%は「それがないと組織が効率よく回らない」と回答しています。2026年、データ収集を自動化していないなら、利益もインサイトも取りこぼしている可能性がかなり高いです。

ベストな自動ウェブスクレイピングツールの選び方(選定基準)

ウェブスクレイピングソフト市場はで、ツール選びは「靴屋に行ったら1万足あって詰む」みたいになりがち。なので私は、次の観点で絞り込みました。

- 使いやすさ: 非開発者でもすぐ始められる?学習コストが重すぎない?

- AI機能: データ項目の自動検出、動的サイト対応、自然言語での指示などができる?

- エクスポート&連携: Excel、Google Sheets、Airtable、Notion、CRMへどれだけスムーズに渡せる?

- 価格: 無料トライアルはある?個人や小規模チームでも現実的?それともエンタープライズ専用?

- スケーラビリティ: 単発の小規模案件から、スケジュール実行の大規模抽出までいける?

- 想定ユーザー: ビジネス向け?開発者向け?両方?

- 独自の強み: 他と比べて何が刺さる?

「とにかくスプレッドシートが欲しい」から「インターネット全体をクロールしたい」まで、スキル別に揃えました。じゃあ、いきましょう。

1. Thunderbit:誰でも使えるAI搭載ウェブスクレイパー

まずは、私が一番よく知っているツールから。というのも、私たちのチームが、長年ビジネスユーザーが抱えてきた「それな…」っていう痛みを潰すために作ったからです。は、よくある「ドラッグ&ドロップ」や「セレクタを自分で書く」タイプのスクレイパーとは別物。欲しいものを言葉で伝えるだけで、あとはAIが面倒を全部引き受けてくれる“データアシスタント”です。コード不要、XPathいじり不要、泣かない。

Thunderbitがトップに来る理由

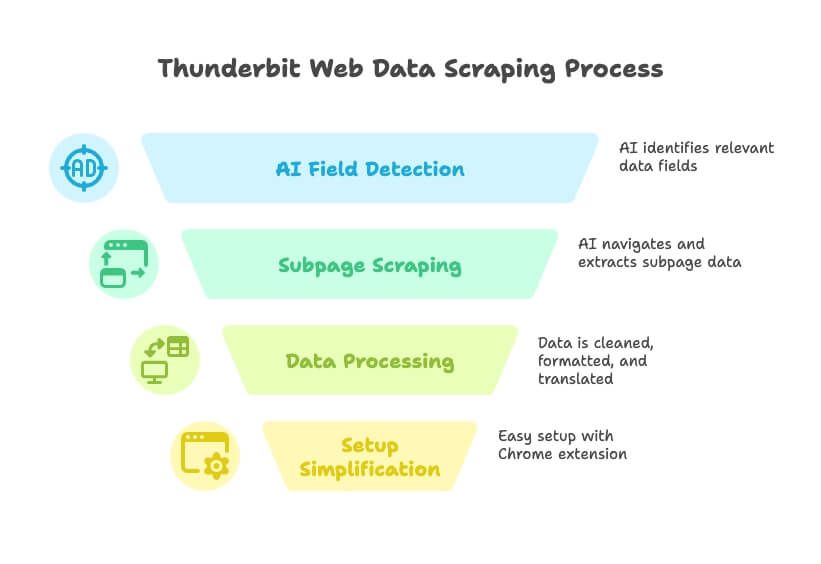

Thunderbitは、私が見てきた中で一番「どんなWebサイトでもデータベース化する」に近い体験です。流れはこんな感じ。

- 自然言語で指示: 「このディレクトリから会社名・メール・電話番号を全部欲しい」みたいに言うだけで、AIが項目を特定します。

- AI Suggest Fields: ワンクリックでページを読み取り、抽出に最適な列(カラム)を提案。試行錯誤が一気に減ります。

- サブページ&多階層スクレイピング: 一覧から詳細ページに入って追加情報を取って、表に追記することもできます。

- データの整形・翻訳・分類: ただ抜くだけじゃなく、整形、フォーマット、翻訳、カテゴリ分けまでスクレイピング中に実行できます。

- 面倒な初期設定なし: を入れて「AI Suggest Fields」を押すだけ。1分以内にスタートできます。

- 無料トライアル&低価格: 無料枠も太め(最大6ページまで無料)。有料は月9ドルから。私の1週間のコーヒー代より安いです。

Thunderbitは、スピード重視でデータが必要な営業・マーケ・オペレーション向けに作られています。コーディング不要、プラグイン不要、研修不要。言うことを聞いて、文句も言わない“データ担当インターン”がブラウザにいる、みたいな感覚です。

Thunderbitの注目ポイント

- AI駆動のスクレイピング: ページ構造を理解し、レイアウト変更にも追従。ページネーションやサブページも自動で処理します()。

- 即時エクスポート: Excel、Google Sheets、Airtable、Notionへ直接送信、またはCSV/JSONでダウンロード。

- クラウド/ローカル実行: 速度と規模重視ならクラウド、ログイン状態やセッションが必要ならブラウザ内で実行。

- スケジュールスクレイピング: 定期実行でデータを常に最新に。価格監視やリード更新に最適。

- メンテ不要: サイト変更にAIが適応するため、壊れたスクレレイパーの修正に追われにくい()。

どんな人向け? 「このデータが欲しい」→「はい、スプレッドシートです」までを数分で終わらせたい人、特に非エンジニアにドンピシャです。と4.9★評価で、面倒より成果を取りにいくビジネスチームの定番になりつつあります。

動きを見たいなら、や、もチェックしてみてください。

2. Clay:自動データエンリッチメント×スクレイピング

Clayはグロースチーム向けの“なんでも屋”みたいな存在です。単なるスクレイパーじゃなく、50以上のライブデータソース(Apollo、LinkedIn、Crunchbaseなど)につながる自動化スプレッドシートで、内蔵AIでリードの補完、アウトリーチ文面作成、見込み度スコアリングまでやれます。

- ワークフロー自動化: 1行=リード、1列=データ取得やアクションのトリガー。会社リストをスクレイピング→LinkedInで補完→パーソナライズメール送信、まで一気通貫。

- AI連携: GPT-4でアイスブレイク文、プロフィール要約などを生成。

- 連携: HubSpot、Salesforce、Gmail、Slackなどにネイティブ接続。

- 価格: プロ向けは月99ドル前後から。軽い用途向けの無料トライアルあり。

おすすめ: アウトバウンド営業、グロースハッカー、マーケ担当で、スクレイピング+補完+アウトリーチを1つにまとめたい人。かなり強力ですが、自動化ツールに慣れていないと学習コストはそれなりにあります()。

3. Bardeen:ブラウザ上で完結する自動化向けウェブスクレイパー

Bardeenは、Chrome拡張で動く“ブラウザロボ”みたいなツール。データ抽出だけじゃなく、Web上の反復作業をまとめて自動化できます。

- ノーコード自動化: スクレイピング、フォーム入力、アプリ間データ移動などに使える500以上の「Playbooks」。

- AIコマンドビルダー: やりたいことを自然文で書くと、Bardeenがワークフローを組み立てます。

- 連携: Notion、Trello、Slack、Salesforceなど100以上のアプリ。

- 価格: 軽い用途は無料(毎月100オートメーションクレジット)。チーム向け有料は月99ドルから。

おすすめ: 複数アプリをまたいで、スクレイピング後のフォローアップまで自動化したいパワーユーザー/GTMチーム。柔軟性は高い一方で、初心者にはちょっと難しく感じることもあります()。

4. Bright Data:エンタープライズ向け自動ウェブスクレイピングツール

Bright Data(旧Luminati)は、ウェブスクレイピング界の“重機”枠。グローバルプロキシ網、上級API、1日数千ページ規模のクロールなど、とにかく大規模運用に強いです。

- エンタープライズ規模: 1億超のIP、Web Scraper IDE、ボット対策回避のWeb Unlockerなど。

- 高いカスタマイズ性: 複雑で大規模な抽出を高い信頼性で構築可能。

- 価格: Web Scraper IDEは月499ドルから。小規模向けのマイクロパッケージもあり。

おすすめ: 大企業、データアグリゲーター、上級者。毎日大量にクロールし、IPブロック回避が重要ならBright Dataが向いています()。

5. Octoparse:中級者向けのビジュアル型ウェブスクレイパー

Octoparseは、ポイント&クリックで作れる人気のノーコードツール。プログラミングなしで「そこそこ強い」スクレイパーが欲しい人に合います。

- ドラッグ&ドロップUI: 要素をクリックして抽出定義。ログイン、ページネーションなどにも対応。

- テンプレート: Amazon、Twitterなど主要サイト向けに500以上のテンプレ。

- クラウドスクレイピング: サーバー実行、スケジュール、IPローテーション。

- 価格: 無料プランあり(制限あり)。有料は月119ドルから。

おすすめ: 非エンジニアやデータ分析担当で、コードなしで実用的なスクレイパーが欲しい人。価格監視、商品一覧、調査用途に強いです()。

6. :企業向けデータ抽出プラットフォーム

は老舗のウェブスクレイピングサービスで、今は本格的なデータ抽出プラットフォームへ進化しています。

- ポイント&クリック抽出: ログイン、ドロップダウン、インタラクティブ要素にも対応。

- クラウド型: 大量URLの並列処理、スケジュール実行、API提供。

- エンタープライズ志向: 価格監視、市場調査、機械学習用データセット作成などで利用。

- 価格: Starter月199ドル、Standard月599ドル、Advanced月1,099ドル。

おすすめ: 中〜大規模企業のデータチームで、保守された信頼性の高い仕組みが必要な場合。趣味用途にはオーバースペックですが、ビジネス規模では頼れる存在です()。

7. Parsehub:ビジュアルエディタで柔軟に作れるウェブスクレイパー

Parsehubはデスクトップアプリ(Windows/Mac/Linux)で、サイトをクリックしながらスクレイパーを組み立てられます。

- ビジュアルワークフロー: 要素選択、抽出ルール設定、ログイン、ドロップダウン、無限スクロールに対応。

- クラウド機能: クラウド実行、スケジュール、APIアクセス。

- 価格: 小規模向け無料枠あり。有料は月149ドルから。

おすすめ: 研究者、小規模事業者、個人で、ブラウザ拡張よりも手元でしっかり制御したいけど自作コードまでは不要な人()。

8. Common Crawl:AI・研究向けのオープンWebデータ

Common Crawlは一般的な“ツール”というより、毎月更新される巨大なWebクロールデータのオープンデータセットです。

- 規模: 約400TB、数十億ページ規模。

- 無料&オープン: 自前でクローラーを回す必要がありません。

- 技術力が必要: ビッグデータ基盤やエンジニアリング力がないと、抽出・整形が大変です。

おすすめ: AIモデル構築や大規模研究をやるデータサイエンティスト/エンジニア。一般的なWebテキストや長期アーカイブが欲しいなら、まさに宝の山です()。

9. Crawly:スタートアップ向けの軽量自動ウェブスクレイピング

Crawly(Diffbot)はクラウド型のAIクローラーで、数百万サイトからデータを収集し、構造化して返します。パースルールを細かく書かなくても動くのが特徴です。

- AI抽出: マシンビジョンとNLPでコンテンツを識別・抽出。

- APIアクセス: 収集データをクエリし、分析基盤やDBに統合。

- 価格: エンタープライズ向け(要問い合わせ)。

おすすめ: ある程度技術力があり、大規模かつ賢い抽出を自前実装なしで実現したいスタートアップ/チーム()。

10. Apify:マーケットプレイスが強い開発者向けウェブスクレイパー

Apifyはクラウドプラットフォームで、自作スクレイパー(Actors)を作ることも、コミュニティ製の既成スクレイパーを使うこともできます。

- 開発者の自由度: JavaScript/Python、ヘッドレスChrome、プロキシ管理、スケジュール実行に対応。

- マーケットプレイス: よくあるサイト向けの既成スクレイパーが豊富。

- 価格: 無料枠(毎月5ドル分クレジット)。有料は月49ドルから。

おすすめ: フルコントロールとスケールが欲しい開発者/技術寄りアナリスト。非エンジニアでも既成Actorsで一般的な用途はこなせます()。

自動ウェブスクレイピングツール比較表

| ツール | 使いやすさ | AI機能 | 価格(開始) | 対象ユーザー | 独自の強み |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | 自然言語、AI Suggest Fields、サブページスクレイピング | $9/月 | 非エンジニアのビジネスユーザー | 2クリックで開始、ノーコード、即時エクスポート、無料トライアル |

| Clay | ★★★★☆ | AIエンリッチメント、GPT-4 | $99/月 | グロース/セールスオペレーション | 自動化スプレッドシート、補完、アウトリーチ |

| Bardeen | ★★★★☆ | AIコマンドビルダー | $99/月 | パワーユーザー、GTMチーム | ブラウザRPA、500+プレイブック、深い連携 |

| Bright Data | ★★☆☆☆ | プロキシローテーション、アンチボットAI | $499/月 | エンタープライズ、開発者 | 規模、信頼性、グローバルプロキシ |

| Octoparse | ★★★★☆ | ビジュアルAI検出 | $119/月 | アナリスト、非エンジニア | ドラッグ&ドロップ、テンプレ、クラウド実行 |

| Import.io | ★★★☆☆ | インタラクティブ抽出 | $199/月 | エンタープライズ、データチーム | 並列処理、スケジュール、API、サポート |

| Parsehub | ★★★★☆ | ビジュアルワークフロー | $149/月 | 研究者、中小企業 | デスクトップアプリ、動的サイト対応 |

| Common Crawl | ★☆☆☆☆ | 該当なし(データセットのみ) | 無料 | データサイエンティスト、エンジニア | 超大規模オープンデータ、Web規模アーカイブ |

| Crawly | ★★☆☆☆ | AI抽出 | カスタム/エンタープライズ | スタートアップ、技術チーム | AI駆動、パースルール不要、APIアクセス |

| Apify | ★★★★☆ | Actorマーケットプレイス | $49/月 | 開発者、技術アナリスト | 自作+マーケット、クラウド自動化、柔軟性 |

自分に合うウェブスクレイパーの選び方

最適な自動ウェブスクレイピングツールは、チーム規模・技術力・目的で変わります。ざっくり指針を出すなら、こんな感じです。

- 非エンジニア(営業・マーケ・Ops)向け: が鉄板。ノーコードで準備もほぼ不要、結果が早い。リード獲得、価格監視、短期のデータ案件に向いています。

- 自動化を徹底したいチーム向け: ClayとBardeenは、スクレイピングに加えて補完・アウトリーチ・業務自動化までまとめたい場合に強いです。

- エンタープライズ&開発者向け: Bright Data、、Apifyは、大規模で高度にカスタマイズしたい案件に向きます。

- 研究者&アナリスト向け: OctoparseとParsehubは、コードなしで強力な機能を使えるビジュアル型です。

- AI/データサイエンス用途: Common CrawlとCrawlyは、巨大データやAI抽出でモデル構築・学習に向きます。

自分に問いかけてみてください。「数分で始めたい」のか、「企業向けのカスタム基盤を作りたい」のか。迷うなら、まず無料トライアルから触るのがいちばん確実です(だいたいのツールが用意しています)。

Thunderbitならではの価値:ビジネスデータのためのAIアシスタント

この中でもThunderbitは、ウェブスクレイピングとデータ変換において、文字通り「AIアシスタント」として機能する数少ない存在です。単にデータを抜くだけじゃなく、散らかったWebサイトを、技術的なハードルなしで“使えるインサイト”に変えることにフォーカスしています。

- 自然言語インターフェース: 欲しいものを普通の言葉で伝えるだけ。

- 一連の流れを自動化: 抽出→整形→翻訳→エクスポートまでカバー。

- 高速な検証に最適: 新市場の検証、リードリスト作成、競合監視などを、最速・低コストで始められます。

ブラウザにデータアナリストが常駐しているようなものです。昇給も休暇も要求しません。

まとめ:最適な自動ウェブスクレイピングツールで、賢く始めよう

2026年のスクレイピング環境は、2年前とは別世界です。自己修復型のAIスクレイパー、LLMネイティブなパイプライン、本当に使えるノーコードツールが、当たり前を塗り替えました。個人起業家でも、少人数の営業チームでも、エンタープライズのデータサイエンティストでも、このリストには必ずハマる選択肢があります。大事なのは、自分たちのワークフローとスキルに合うプラットフォームを選び、コードと格闘する時間を減らしてインサイトを増やすことです。

手作業のコピペを卒業して、もっとスマートに始めたいなら、して、ウェブスクレイピングがどれだけラクになるか体感してみてください。もちろん、目的に合わせて上の選択肢を検討するのも全然アリです。いずれにせよ、データドリブンなビジネスの未来は「自動化できる人」に味方します。

もっと知りたいなら、で解説記事、チュートリアル、Webデータ活用のコツをチェックしてみてください。スクレイピングがうまくいって、データがいつも綺麗で、スクレイパーが壊れませんように(もし壊れても、AIに投げちゃいましょう)。

よくある質問(FAQs)

1. 2026年にビジネスユーザーにとって自動ウェブスクレイピングツールが重要な理由は?

自動ウェブスクレイピングツールはデータ収集を効率化し、時間短縮と手作業削減に直結します。入力ミスを減らして精度を上げ、リアルタイムの意思決定を支え、非エンジニアでもコードなしでWebデータを活用できるようにします。営業・マーケ・オペレーションにとって、いまや必須の基盤です。

2. Thunderbitは他のウェブスクレイピングツールと何が違う?

Thunderbitは、欲しいデータを自然な英語(または文章)で伝えるだけでAIが項目を自動検出します。サブページやページネーションにも対応し、ExcelやAirtableなどへ即時エクスポート可能。非エンジニア向けに設計され、データ整形やスケジュールスクレイピングなどの強力機能を低価格で提供します。

3. 大規模なエンタープライズ案件に最適なツールは?

Bright Dataとがエンタープライズ用途に適しています。プロキシローテーション、ボット対策回避、大規模並列処理、APIアクセスなどを備え、数千ページ規模を安定して処理したい組織に向きます。

4. スクレイピングと自動化・アウトリーチを組み合わせられるツールはある?

あります。ClayとBardeenは、Webデータの取得だけでなくワークフローに組み込めます。Clayはリード補完とアウトリーチ自動化に強く、BardeenはAI駆動のプレイブックでブラウザ作業や業務フローを自動化できます。

5. 技術知識がまったくない人に最適な選択肢は?

非エンジニアにはThunderbitが最有力です。自然言語での指示、AIによるセットアップ、使いやすさが揃っており、コーディングも複雑な設定も不要。ビジネスユーザーが、技術的な負担なく素早く確実にデータを得るのに最適です。