ウェブ上にはデータがあふれています。2026年には、その混沌をビジネスの価値に変える競争が、これまで以上に激しくなっています。私は、営業、EC、オペレーションの各チームが、何時間もかかっていた気の遠くなるようなコピペ作業を自動化し、業務の流れを一変させるのを見てきました。今やウェブデータスクレイピングソフトを使っていないなら、単に出遅れているだけではありません。おそらく、競合がすでに2杯目のコーヒーを飲んでいるあいだも、あなたはまだスプレッドシートの牢獄に閉じ込められているはずです。

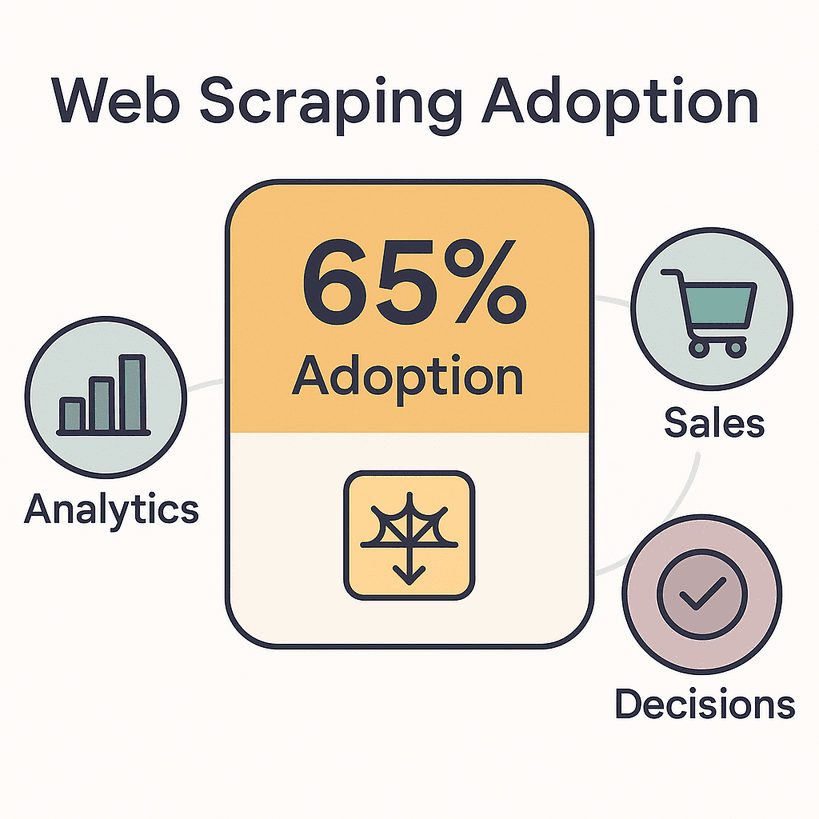

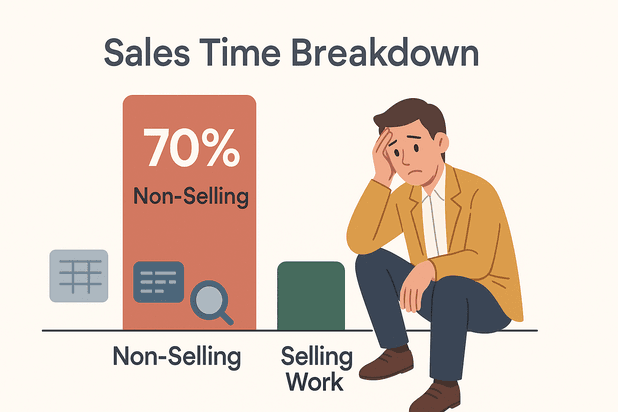

現実はこうです。のは、分析、営業、意思決定のためです。世界のウェブデータ抽出市場はすでにの規模があり、2030年までには倍増すると予測されています。営業担当者は、データ入力やリサーチのような販売以外の業務に、勤務時間の最大を費やしています。本来なら、その時間は商談のクロージングに使えるはずです。少なくとも、昼休みをゆっくり取ることはできるでしょう。

では、2026年に最適なウェブデータスクレイピングソフトはどれでしょうか。私は、あらゆる規模・技術レベルのチームの働き方を変えている上位5つのツールを徹底的に調べました。コードを書かずにクリックだけで使いたい人にも、究極の柔軟性を求める開発者にも、ぴったりのものが見つかるはずです。

最適なウェブデータスクレイピングソフトの条件とは?

率直に言って、すべてのウェブスクレイパーが同じではありません。2026年のベストなウェブデータスクレイピングソフトは、Pythonで夢を見る人だけでなく、誰でも素早く・確実に・手軽にデータ抽出できる点で際立っています。

私が重視するポイント(そしてビジネスユーザーが特に気にするポイント)は次のとおりです。

- 使いやすさ: 技術に詳しくない人でも数分でスクレイピングを始められるか。多くのチームには、ノーコードかつAI駆動の操作画面が必須です。

- データソースの柔軟性: ウェブページ、PDF、画像、そして無限スクロールやAJAXのような動的コンテンツに対応できるか。対応ソースが多いほど良いです。

- 自動化とスケジューリング: 定期実行、ページネーション対応、サブページ移動の自動化ができるか。「設定したらあとは放置」と「設定したうえで付きっきり」は大違いです。

- 連携とエクスポート: Excel、Google Sheets、Notion、Airtable、またはAPI経由で直接出力できるか。手作業が少ないほど、チームは喜びます。

- 必要な技術力: 本当にノーコードなのか、それとも正規表現を復習する必要があるのか。優れたツールは、ノーコード利用者にも上級ユーザーにも対応します。

- 拡張性: 数百〜数千ページのスクレイピングでも問題なく処理できるか。

- サポートとコミュニティ: 充実したドキュメント、素早いサポート、活発なユーザーコミュニティがあるか。

これらは単なる「あれば便利」な条件ではありません。何時間も節約できるツールと、何日も浪費させるツールを分ける基準です。2026年には、になる中、適切なスクレイパーを選ぶことは競争優位になります。

では、上位5つを見ていきましょう。

2026年版 ベストなウェブデータスクレイピングソフト5選

- - ノーコード、AI搭載、複数ソース対応のスクレイピング

- - エンタープライズ向けの統合データパイプライン

- - オープンソースで開発者主導の柔軟性

- - スケジューリング対応のビジュアル・ノーコードスクレイピング

- - 日常業務向けの使いやすいデータ抽出

1. Thunderbit: いちばん簡単なAI搭載ウェブデータスクレイピングソフト

は、コードを1行も書かずにウェブデータをスクレイピングしたい人に、私が真っ先におすすめするツールです。はい、少し贔屓しているのは認めます。なぜなら、私はこの製品の開発に関わったからです。それでも聞いてください。Thunderbitは、頭痛の種ではなく成果を求めるビジネスユーザーのために作られています。

Thunderbitが際立つ理由は?

- AIフィールド提案: 「AIフィールド提案」をクリックするだけで、ThunderbitのAIがページを読み取り、抽出すべき項目を提案し、スクレイパーを自動で設定します。セレクターもテンプレートも不要、面倒な作業はありません。

- 複数ソース対応のスクレイピング: ウェブページだけでなく、PDFや画像もスクレイピングできます。Thunderbitは、テキスト、リンク、メールアドレス、電話番号、画像を、わずか2クリックで抽出できます。

- サブページとページネーションの自動化: すべての商品ページやプロフィールページの詳細を取得したいですか? Thunderbitのサブページスクレイピングはリンクをたどり、追加情報を取得して、表にまとめてくれます。無限スクロールやページネーションも難なく処理します。

- 一括スクレイピングと定期実行: URLの一覧を貼り付け、定期ジョブを設定すれば、あとはThunderbitが重い作業をこなします。日次の価格監視でも、週次のリード更新でも同じです。

- 即時エクスポート: Excel、Google Sheets、Airtable、Notion、CSV、JSONへ直接出力できます。もう延々とコピペする必要はありません。

- カスタムAIプロンプト: スクレイピングしながら分類、翻訳、ラベル付けをしたいですか? カスタム指示を追加すれば、ThunderbitのAIが処理してくれます。

- クラウドモードとブラウザモード: 高速なクラウド実行(1回あたり50ページ)か、ログインが必要なサイト向けのローカル実行を選べます。

Thunderbitは、営業チームから不動産エージェント、個人運営のECショップまで、世界中でに信頼されています。無料プランでは最大6ページまで(トライアルブーストで10ページまで)スクレイピングでき、料金は使った分だけです。出力1行ごとに1クレジットを消費します。

私が気に入っている理由: Thunderbitは、非技術者が「このデータが必要だ」から「はい、スプレッドシートです」まで5分以内でたどり着ける、私が見た中で唯一のツールです。UIは本当に使いやすく設計されており(私たちはそこに徹底的にこだわりました)、AIがサイトの変更にも追従するので、壊れたスクレイパーを何度も直す必要がありません。

こんな人に最適: 営業、EC、オペレーション、そして保守不要のノーコードAIスクレイピングを求める人。

さらに詳しいガイドは、をご覧ください。

2. Import.io: エンタープライズ向けウェブデータスクレイピングと連携

は、大規模なウェブデータを必要とし、それをビジネスシステムに直接つなぎ込みたい企業向けの、まさに重量級チャンピオンです。

Import.ioの強みは?

- エンタープライズ対応のパイプライン: Import.ioは単なるスクレイパーではなく、本格的なウェブデータ連携プラットフォームです。継続的で自動化されたフィードを備えた「データ・アズ・ア・サービス」と考えると分かりやすいでしょう。

- 自己修復型AI: ウェブサイトが変更されても、Import.ioのAIが自動でフィールドを再マッピングしようとするため、パイプラインが突然壊れにくくなっています。

- 堅牢な自動化: 毎時、毎日、または任意の間隔でスクレイピングをスケジュールできます。何か問題が起きた場合やデータが不自然な場合はアラートを受け取れます。

- 対話型ワークフロー: ログイン、フォーム入力、複数ステップのナビゲーションがあるサイトにも対応します。Import.ioは複雑な操作手順の記録と再生が可能です。

- コンプライアンスとガバナンス: PIIの自動検出、マスキング、監査ログに対応しており、規制の厳しい業界では非常に重要です。

- APIと連携: Google Sheets、Excel、Tableau、Power BI、データベース、またはAPI経由で自社アプリへ直接データを送れます。

Import.ioは、Unilever、Volvo、RedHatのようなブランドにも信頼されています。数千のECサイトにまたがる価格監視、市場調査、あるいは新鮮なウェブデータをAI/MLモデルに供給する用途でよく使われています。

価格: Import.ioはプレミアムなソリューションで、セルフサービスプランは月額299ドル前後から始まります。無料トライアルはありますが、長期の無料プランはありません。ウェブデータが事業の生命線なら、十分に投資対効果はあります。

こんな人に最適: 信頼性、拡張性、コンプライアンス、深い連携を必要とする企業やデータ重視の組織。

3. Scrapy: 開発者向けのオープンソースウェブスクレイピングフレームワーク

は、究極の柔軟性と制御を求める開発者のための、オープンソースの強力なツールです。あなたやチームがPythonで開発できるなら、Scrapyはウェブスクレイピング界のスイスアーミーナイフです。

開発者にScrapyが好まれる理由:

- 完全なカスタマイズ: スパイダー(スクリプト)を作成して、クロール、解析、データ処理を思いどおりに実装できます。複数ページの流れ、独自ロジック、複雑なデータクレンジングにも対応できます。

- 非同期で高速: Scrapyのアーキテクチャは速度と拡張性のために設計されています。毎分数百ページ、分散クロールなら数百万ページ規模でも処理可能です。

- 拡張性が高い: プロキシ、ヘッドレスブラウザ(Splash/Playwright)、各種連携のためのプラグインやミドルウェアが豊富です。

- 無料かつオープンソース: ライセンス費用は不要です。自前のハードウェアでもクラウドでも動かせ、必要に応じて大規模化できます。

- コミュニティの支援: GitHubスターは55,000超、ユーザー層も非常に厚いです。つまずいても、すでに誰かが解決している可能性が高いでしょう。

注意点: ScrapyにはPythonのスキルとコマンドライン操作への慣れが必要です。クリック操作のUIはありません。コードファーストの領域です。ただし、カスタムプロジェクト、AI学習用データ、大規模クロールでは、これに勝るものはありません。

こんな人に最適: 社内開発者を抱える組織、カスタムデータパイプライン、大規模で複雑なスクレイピング要件。

4. Octoparse: ビジュアル操作で簡単に使えるウェブデータスクレイピング

は、強力なスクレイピングをビジュアルなクリック操作で使いたい非エンジニアの間で人気です。

Octoparseが人気の理由:

- ビジュアルなワークフロービルダー: 内蔵ブラウザで要素をクリックすると、Octoparseがパターンを自動検出します。コードは不要で、クリックして抽出するだけです。

- 動的コンテンツに対応: AJAX、無限スクロール、ログイン保護されたサイトもスクレイピングできます。クリック、スクロール、フォーム送信もシミュレート可能です。

- クラウドスクレイピングとスケジューリング: タスクをクラウドで実行し(高速で並列化)、常に最新データを取得するための定期ジョブを設定できます。

- 事前作成テンプレート: Amazon、Twitter、Zillowなど人気サイト向けのテンプレートが数百種類あり、すぐにスクレイピングを始められます。

- エクスポートとAPI: 結果をCSV、Excel、JSONとしてダウンロードするか、API経由でデータを取得できます。Google Sheetsやデータベースとの連携も可能です。

Octoparseはよく「初心者でも驚くほど使いやすい」と評されます。無料プランには制限がありますが、有料プラン(月額83ドル前後から)ではクラウド実行、スケジューリング、さらなる高速化が利用できます。

こんな人に最適: 技術者でないユーザー、マーケター、リサーチャー、そして定期的で自動化されたデータ収集をコードなしで行いたい小規模チーム。

5. ParseHub: 日常業務向けの使いやすいデータ抽出

もまた人気のノーコードツールで、特に日常的なデータ作業を自動化したい中小企業やフリーランスに向いています。

ParseHubの魅力:

- クリック操作のシンプルさ: ブラウザ表示上の要素をクリックしてデータを選択します。ワークフローは視覚的に作成でき、コーディングは不要です。

- JSや動的サイトに対応: JavaScriptの多いページ、無限スクロール、複数ステップのナビゲーションもスクレイピングできます。

- クラウド実行とローカル実行: デスクトップでもクラウドでもスクレイピングできます。定期ジョブの設定や、上位プランでのAPI経由の結果取得も可能です。

- エクスポート方法: CSV、Excel、JSONとしてダウンロード可能。自動化のためのAPIアクセスもあります。

- クロスプラットフォーム: Windows、Mac、Linuxで利用できます。

ParseHubの無料プランには制限がありますが(1回あたり200ページまで)、有料プラン(月額189ドル前後から)では、より高い性能、速度、APIアクセスが利用できます。

こんな人に最適: シンプルなスクレイピングニーズがあり、信頼できるビジュアルツールを求める中小企業、フリーランス、チーム。

比較表: 主要なウェブデータスクレイピングソフトをひと目で比較

| ツール | 使いやすさ | データソース | 自動化とスケジューリング | 連携とエクスポート | 技術スキル | 価格 |

|---|---|---|---|---|---|---|

| Thunderbit | ノーコード、AI駆動 | ウェブ、PDF、画像 | サブページ、ページネーション、定期実行、一括処理 | Excel、Sheets、Notion、Airtable、CSV、JSON | 不要 | フリーミアム(行ごと課金) |

| Import.io | クリック操作のUI | ウェブ(静的/動的、ログインあり) | 自己修復、定期実行、アラート | API、BIツール、Sheets、Excel、DB | 低〜中 | 月額299ドル以上 |

| Scrapy | コード必須 | ウェブ、API、(アドオン経由でJS対応) | コードによる完全自動化 | 何でも可(コード経由) | Python開発者 | 無料(オープンソース) |

| Octoparse | ビジュアル、ノーコード | ウェブ(動的、ログインあり) | クラウド実行、テンプレート | CSV、Excel、JSON、API | 不要 | 月額83ドル以上 |

| ParseHub | ビジュアル、ノーコード | ウェブ(JS、動的) | クラウド/ローカル、定期実行 | CSV、Excel、JSON、API | 不要 | 月額189ドル以上 |

ビジネスに最適なウェブデータスクレイピングソフトの選び方

どのツールが自分に合うかわからない? そんな方のための早見表はこちらです。

- 技術に詳しくない人、すぐに成果が欲しい人: か を選びましょう。Thunderbitは、即時で使えるAI搭載スクレイピングと複数ソース対応(ウェブ、PDF、画像)で抜群です。Octoparseは、ビジュアルで定期実行できるスクレイピングに最適です。

- エンタープライズ連携、コンプライアンス、拡張性が必要: が最有力です。継続的で信頼性の高いデータパイプラインと深い連携を前提に作られています。

- 開発者、カスタム案件、大規模クロール: を選ぶべきです。Pythonのスキルは必要ですが、無制限の柔軟性が得られます。

- 中小企業、フリーランス、日常業務: は、クリック操作のスクレイピングと中程度の自動化に向いた、堅実で使いやすい選択肢です。

適切なツールを選ぶコツ:

- チームの技術レベルとデータ要件に合ったツールを選ぶ。

- スクレイピングしたいサイトの複雑さを考える(動的コンテンツ? ログイン必須?)。

- データの使い道を考える。Sheetsへの直接出力が必要か、それとも深いAPI連携が必要か。

- まずは無料トライアルやフリーミアムプランで実際の業務を試す。

- 充実したサポートとドキュメントの価値を軽視しない。

まとめ: 最適なウェブデータスクレイピングソフトでビジネス価値を引き出す

ウェブデータは、2026年のより賢いビジネス判断を支える燃料です。適切なウェブデータスクレイピングソフトがあれば、リードリストの作成、競合監視、分析基盤へのデータ投入など、さまざまな場面で時間を節約し、ミスを減らし、チームに本当の優位性をもたらします。

要点をまとめると、

- Thunderbit は、ビジネスユーザー向けの最も簡単なAI搭載ノーコードスクレイパーです。

- Import.io は、継続的で統合されたデータパイプライン向けのエンタープライズソリューションです。

- Scrapy は、完全な制御を求める開発者向けのオープンソースツールキットです。

- Octoparse と ParseHub は、ビジュアルでノーコードのスクレイピングを誰でも使える形にします。

これらのツールの多くには無料トライアルやフリーミアムプランがあります。ぜひ試してみてください。面倒な作業は自動化し、新しい洞察を手に入れ、本当に重要なことにチームの力を集中させましょう。

スクレイピングを楽しんでください。そして、あなたのデータがいつも新鮮で、構造化され、すぐに行動に移せる状態でありますように。

よくある質問

1. ウェブデータスクレイピングソフトは何に使うのですか?

ウェブデータスクレイピングソフトは、ウェブサイト、PDF、画像から情報を抽出する作業を自動化します。リード獲得、価格監視、市場調査、コンテンツ集約などに使われます。

2. ウェブデータスクレイピングは合法ですか?

公開されているデータを収集し、サイトの利用規約とプライバシー法を守るのであれば、ウェブスクレイピングは合法です。必ずサイトのポリシーを確認し、責任を持ってデータを扱ってください。

3. ウェブデータスクレイピングソフトを使うのにコーディング知識は必要ですか?

必ずしも必要ではありません。Thunderbit、Octoparse、ParseHubのようなツールは、ノーコード利用者向けに設計されています。より複雑またはカスタムの案件では、Scrapyのような開発者向けツールが必要になることがあります。

4. 抽出したデータをExcelやGoogle Sheetsに出力するにはどうすればよいですか?

最近の多くのスクレイパー(Thunderbit、Octoparse、ParseHub)は、ワンクリックでExcel、Google Sheets、CSVに出力でき、NotionやAirtableとの直接連携にも対応しています。

5. ウェブデータスクレイピングソフトは動的サイトやログインにも対応できますか?

はい。Import.io、Octoparse、ParseHubのような上位ツールは、動的コンテンツ(AJAX、無限スクロール)やログイン保護されたサイトにも対応できます。Thunderbitも、動的ページやサブページからのスクレイピングをサポートしています。

最新のウェブスクレイピングがどのようなものか見てみたいですか? するか、で、AI搭載データ抽出のヒント、チュートリアル、深掘り記事をご覧ください。