Trustpilotにはがあり、127万社以上の企業が掲載されています。ところが、そのデータを抽出するために作られたスクレイパーの多くは、何か月も前にすでに動かなくなっています。最近レビューを取得しようとした方なら、悪名高い「10ページ目のログイン壁」にぶつかり、ツールがエラーしか返さないのを見たことがあるはずです。

ここ数週間、2026年でも安定してTrustpilotのレビューデータを抽出できるツールを、実際に試し、調査し、比較してきました。状況はかなり変わっています。Trustpilotのボット対策はより厳しくなり、Next.jsベースのフロントエンドはデプロイのたびに変わるクラス名を生成し、そして最も重要なのは、未認証アクセスがレビュー10ページ目で遮断されるようになったことです。2025年後半のが、その不満を見事に言い当てています。「ストアのアクターはどれも動かない」

では、実際に使えるのはどれでしょうか。私は、ログイン壁への対応、ボット対策、メンテナンスの手間、そしてマーケターと開発者の実務ニーズへの適合度を基準に、5つのツールを評価しました。

2026年にTrustpilotレビューのスクレイピングが見た目以上に難しい理由

Trustpilotは、単純なHTTPリクエストを投げてBeautifulSoupで解析するだけの静的サイトではありません。Next.jsで構築された、現代的な動的レンダリングのプラットフォームであり、この1年で防御はかなり強化されています。

実際に立ちはだかるものは次の通りです。

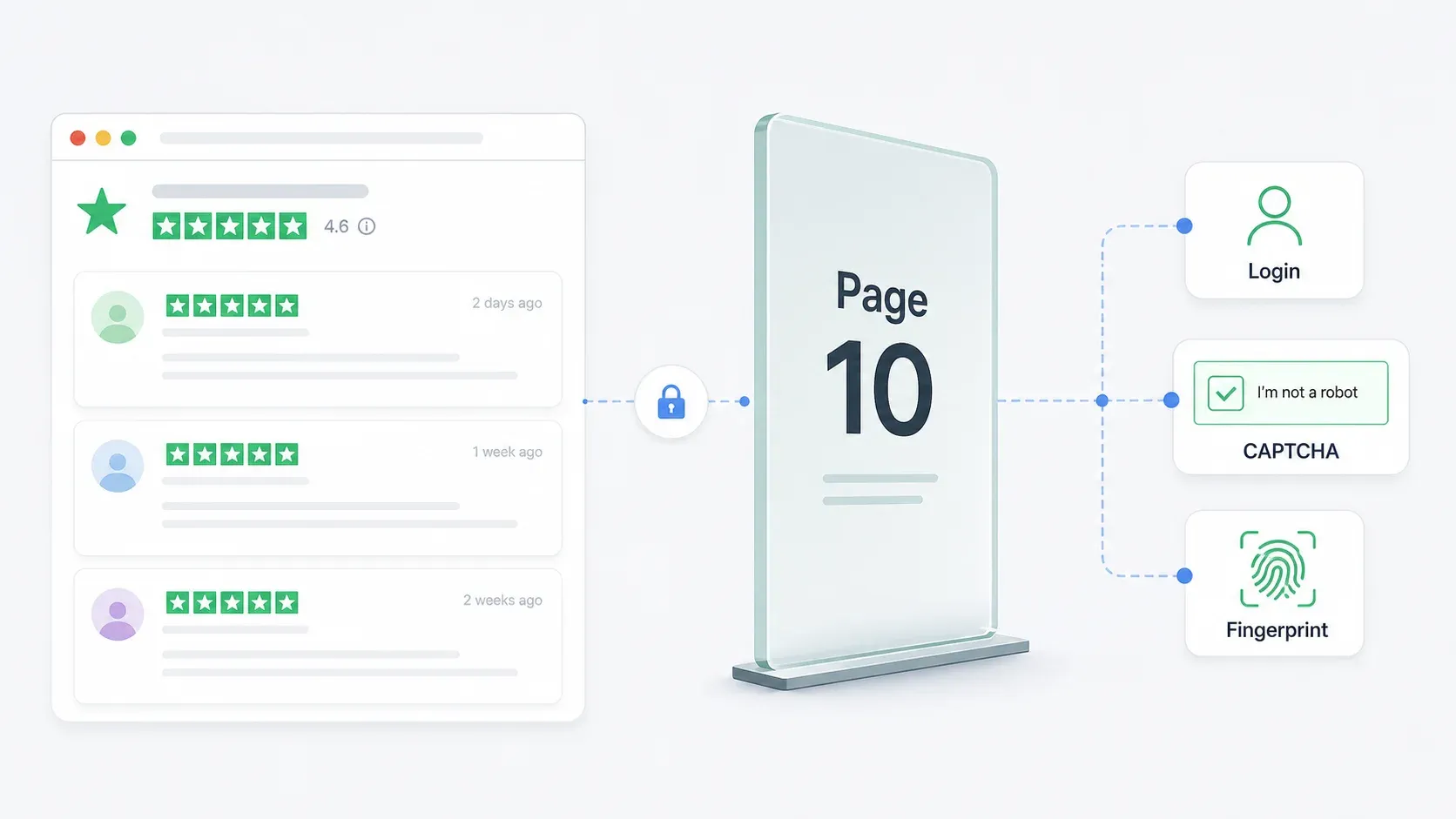

10ページ目のログイン壁。 これが最大の難所です。でも、Trustpilotはレビューの最初の10ページまでしか表示せず、その後はログインを求めることが確認されています。たとえばレビューが2,000件ある企業(1ページ20件なら約100ページ)では、認証済みセッションがなければデータの90%が取得できません。

ボット対策。 TrustpilotはreCAPTCHA、セッション単位のブロック、CDNレベルのリクエストフィルタリング、ブラウザフィンガープリントを使っています。でも、サイトが「reCAPTCHAで保護されている」こと、そしてデバイスや操作シグナルを収集していることが明記されています。

動的なCSSクラス名。 TrustpilotはNext.jsとCSSモジュールを使っているため、styles_reviewCardInner__EwDq2のようなクラス名はビルド時に生成され、Trustpilotが更新を配信するたびに変わります。でも、これらのセレクタをそのまま使っています。つまり、そのコードはTrustpilotが次にフロントエンドを更新した時点で壊れるということです。

DOM構造の変更。 クラス名だけでなく、実際のHTML階層も変わり得ます。要素の入れ子構造が変わったり、新しいラッパーが追加されたり、ページネーションのコンポーネントが組み替えられたりします。

CSSセレクタに依存するスクレイパーは、ApifyのActorでも、Octoparseのワークフローでも、自作のPythonスクリプトでも、Trustpilotでは構造的に壊れやすいです。動く時は動きますが、動かなくなる時は突然です。そしてその「動かなくなる時」は、何か月後ではなく、数週間後であることがよくあります。

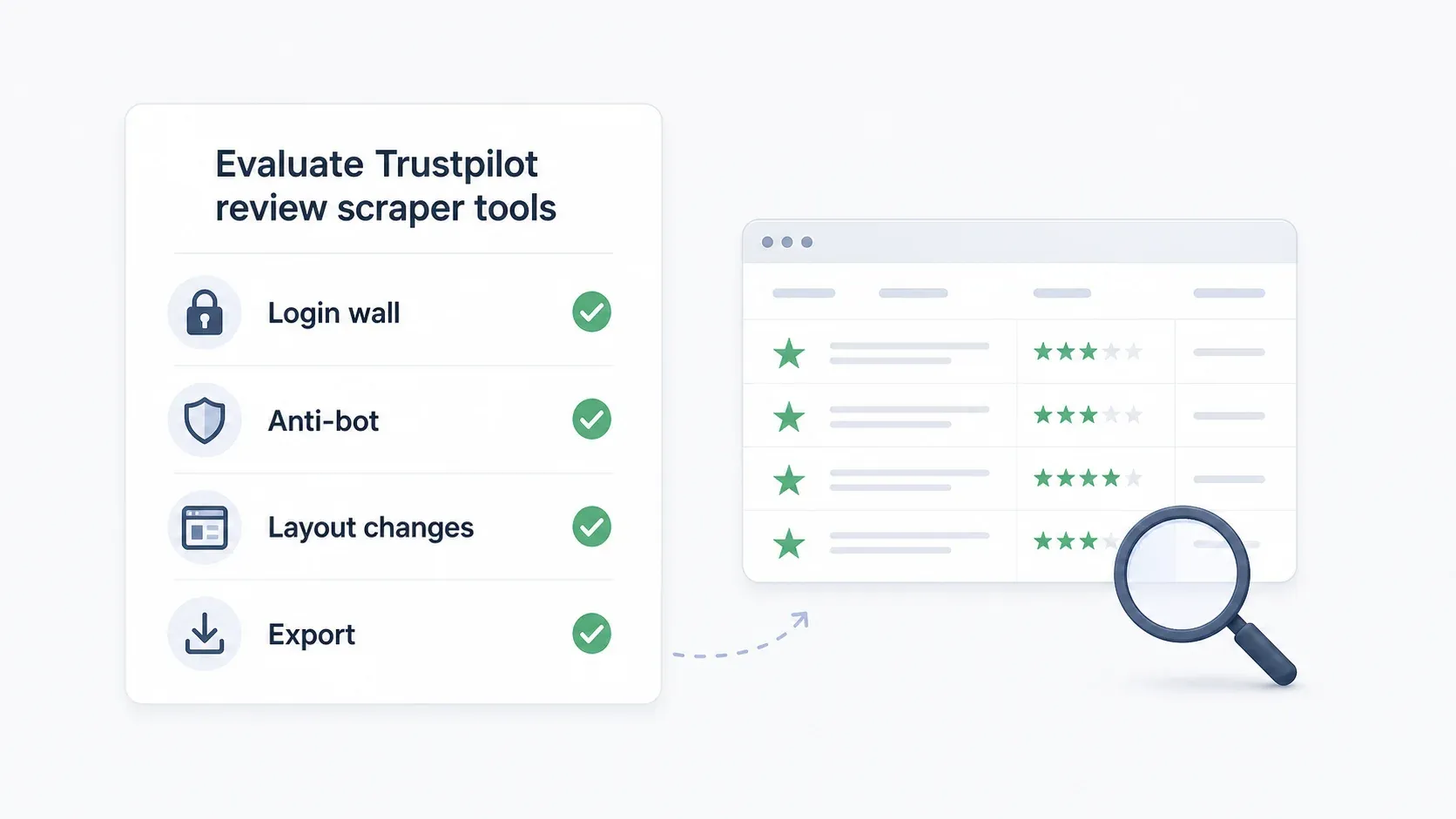

最適なTrustpilotレビュー用スクレイパーを選ぶ際に重視したこと

今回は、よくある「Webページをスクレイピングできるか」という基準では評価していません。このリストにあるツールは、どれも単純なHTMLページならデータを抽出できます。

本当に問うべきなのは、2026年のTrustpilot特有の癖に対応できるかどうかです。

特に重視したのは次の点です。

| 基準 | Trustpilotで重要な理由 |

|---|---|

| ログイン壁への対応(10ページ目以降) | ほとんどの企業は200件をはるかに超えるレビューを持っています。10ページ制限があると、過去データの大半を取りこぼします。 |

| ボット対策の回避方法 | reCAPTCHA、セッションブロック、CDNフィルタリングは、素朴なスクレイパーをすぐに止めます。 |

| セレクタ耐性 / 保守性 | 生成されたCSSクラスは、セレクタ依存ツールを頻繁に壊します。自己修復できますか? |

| ページネーション対応 | レビューは何百ページにも及びます。手動で1ページずつ取るのは現実的ではありません。 |

| ノーコードかコード必須か | マーケターにはクリック操作が必要で、開発者は完全な制御を求めます。 |

| 価格 / 無料枠 | 予算を意識するチームには、導入前の見通しが必要です。 |

| エクスポート先 | ビジネスユーザーには、生のJSONだけでなくGoogle Sheets、Airtable、Notionが必要です。 |

ログイン壁は、まさに決定打です。

10ページ目を越えられない、少なくとも認証済みアクセスへの明確な道筋を示せないツールは、2026年のTrustpilotスクレイパーとしては実用的ではありません。

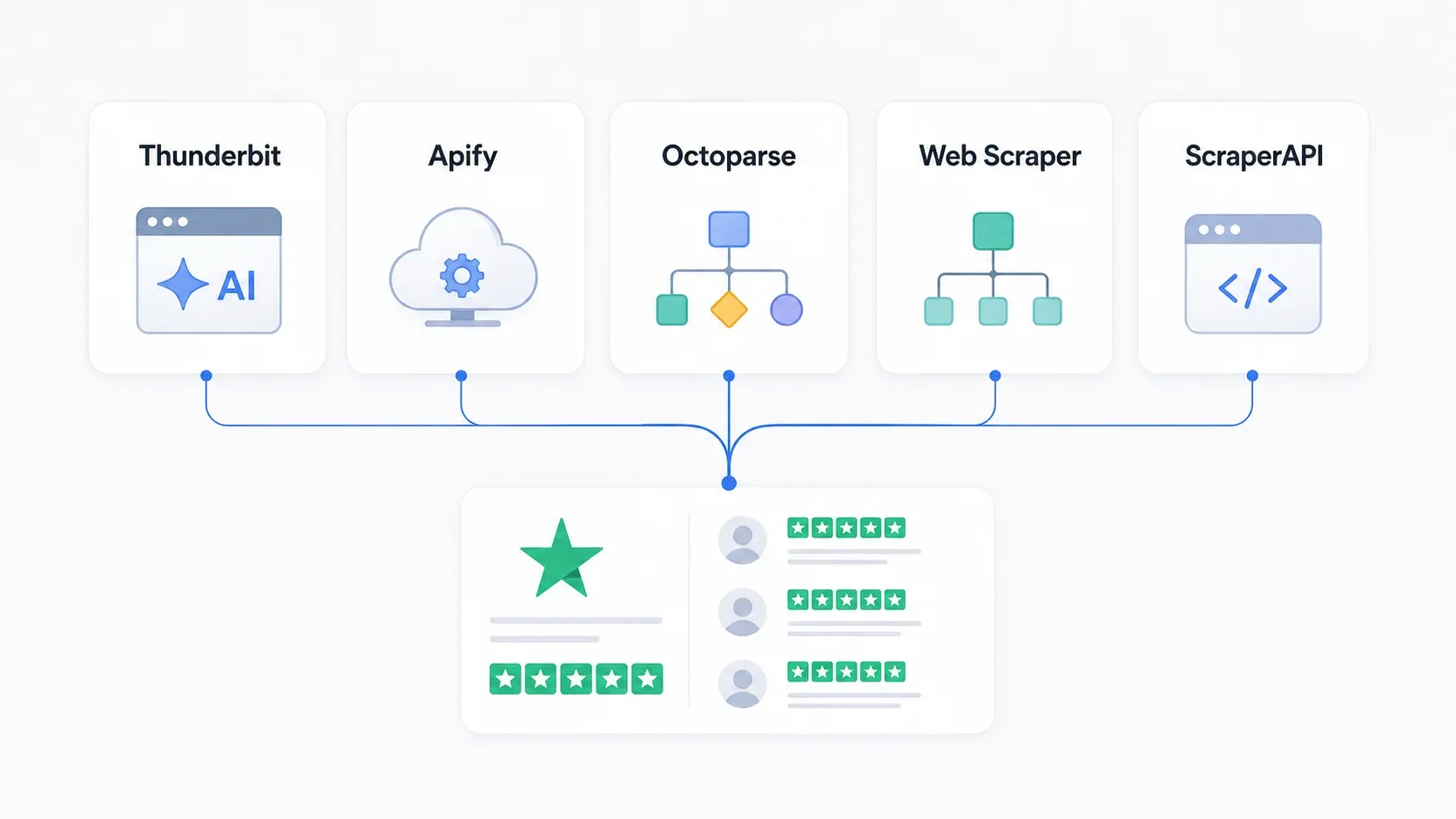

一目でわかるベストなTrustpilotレビュー用スクレイパー

比較の全体像はこちらです。

| ツール | スキルレベル | ログイン壁への対応 | ボット対策 | ページネーション | 無料枠 | エクスポート先 |

|---|---|---|---|---|---|---|

| Thunderbit | ノーコード | ブラウザモード(ログイン済みのChromeセッションを利用) | AIによる意味解析でレイアウト変更に適応 | 自動検出、複数ページ対応 | 月6ページまで無料 | Excel、Sheets、Airtable、Notion、CSV、JSON |

| Apify | ローコード | Actor依存。10ページ超ではCookie設定が必要なものもある | 内蔵プロキシローテーション、Actorごとに異なる | Actorごとに設定可能 | 月5ドル分の無料プラットフォームクレジット | JSON、CSV、Excel、XML、RSS |

| Octoparse | ノーコード(ビジュアル) | 手動でCookie / セッション設定が必要 | IPローテーション、住宅プロキシ、CAPTCHA解決(有料) | クリック / スクロールのワークフロー | 無料プラン + 14日間のプレミアム試用 | CSV、Excel、JSON、HTML、XML、データベース |

| Web Scraper | ノーコード(サイトマップ) | 制限あり。公式ガイドでもレビュー10ページ制限を記載 | 有料プランでクラウド + プロキシ対応 | 設定可能。JSクリック推奨 | Chrome拡張は無料 | CSV、XLSX |

| ScraperAPI | 開発者向け(Python) | コードレベルでセッション / Cookie管理が必要 | 4,000万超の住宅プロキシ、JSレンダリング、CAPTCHA対応 | コードベース | 7日間試用、5,000 APIクレジット | 開発者が定義(CSV、JSONなど) |

1. Thunderbit

は、コードを書かずにWebサイトから構造化データを取得したいビジネスチーム向けに作られた、AI搭載のChrome拡張機能です。Trustpilot向けには、があり、レビュアー名、評価、レビュータイトル、本文、日付、企業からの返信を2クリックで取得できます。

私は社内の人間なので少し肩入れしていますが、それでもThunderbitをこう設計した理由は、まさにTrustpilotのスクレイピングが難しいからです。ThunderbitのAIはCSSセレクタに頼らず、ページを意味的に読み取ります。Trustpilotがクラス名を変えたりDOMを組み替えたりしても、Thunderbitは要素の意味を見ているので対応できます。HTML上の場所そのものではなく、何が書かれているかを理解しているからです。

Thunderbitが10ページ目のログイン壁をどう処理するか

ここで効いてくるのがブラウザモードです。Thunderbitは、すでにTrustpilotにログインしているのと同じChromeブラウザの中で動作します。ブラウザスクレイピングモードに切り替えると、拡張機能は認証済みセッションで表示可能なページを読み取ります。プロキシの面倒な設定も、Cookieの注入も、Playwrightのセッションプールも不要です。

実際の流れはこうです。ChromeでTrustpilotにログインし、取得したいレビューページを開き、「AIで項目を提案」をクリックしてから「スクレイプ」を押します。あとは自動でページネーションされ、ブラウザセッションでアクセスできるページを最後まで処理します。

ThunderbitがTrustpilotの変更で壊れない理由

でも明確に比較していますが、従来型のスクレイパーはレイアウトが変わると壊れ、CSSセレクタの更新が必要になります。Thunderbitは、特定のCSSに依存せずコンテンツを理解する意味解析型AIを使っており、動的コンテンツを扱い、自動ページネーションも管理します。

ScraperAPIのチュートリアルコードは、styles_reviewCardInner__EwDq2のようなクラス名で解析しています。このセレクタは、Trustpilotが次に更新を配信した瞬間に壊れるでしょう。ThunderbitのAIは「このページのレビュー本文はどこか?」と尋ねます。特定のdivクラスの中身は何か、とは聞きません。

Trustpilotスクレイピング向けの主な機能

- AIで項目を提案:手動設定なしで、レビュー項目(名前、評価、日付、タイトル、本文、企業返信)を自動検出

- 2クリックのワークフロー:AIで項目を提案 → スクレイプ。それだけです

- ログイン必須ページ向けのブラウザモード:認証済みChromeセッション内で動作し、10ページ目以降にも対応

- 自動ページネーション:手作業なしで複数ページのレビューを処理

- サブページスクレイピング:各レビュアーのプロフィールに移動して拡張データを取得可能

- 定期スクレイピング:評判モニタリングのために週次・月次のレビュー監視を設定可能

- エクスポート:Google Sheets、Airtable、Notion、CSV、JSONにすべて無料で対応

価格

- 無料プラン:月6ページまで、クレジットカード不要

- クレジット制:1クレジット = 1出力行

- 有料プラン:で月額約9ドルから

こんな方に最適:コードに触れずにTrustpilotレビューを扱いたいマーケティングチーム、オペレーションチーム、ビジネスユーザー。しかも、数週間ごとに壊れるスクレイパーの保守はしたくない方。

2. Apify

は、あらかじめ作られた「Actor」のマーケットプレイスを持つクラウド型スクレイピングプラットフォームです。Actorとは、他のユーザーやApifyチームが作成したスクレイピングテンプレートのことです。Trustpilot向けにも、コミュニティ管理のActorが複数あり、信頼性はまちまちです。

Apifyのトレードオフは強力ではあるものの、断片化している点です。うまく動くActorもあれば、廃止されたものもあります。10ページ目以降でCookieが必要なものもあります。Redditで見かける「ストアのActorはどれも動かない」という不満は誇張ではなく、Trustpilotの変更がいかに早くActor固有のロジックを壊すかを反映しています。

Trustpilot用Actorと既知の制限

には、いくつかのTrustpilot用Actorがあります。少なくとも1つ(開発者「burbn」によるもの)は、10ページを超えるにはCookie入力が必要だと明記しています。ほかにも、評価が0.0だったり、ユーザー数が非常に少なかったり、更新日が極めて最近だったりするものがあり、保守が継続中で信頼性がばらつくことを示しています。

廃止されたActorも注目に値します。ある古いActorは、Trustpilotの埋め込み__NEXT_DATA__ JSONを直接読み取る方式でした。DOM解析より高速な巧妙な方法でしたが、それでもTrustpilotがデータ構造を変えた時点で壊れました。

ログイン壁とボット対策への対応

- ログイン壁:選ぶActor次第です。10ページ目以降にCookie注入をサポートするものもあれば、そうでないものもあります。

- ボット対策:Apifyのプラットフォームにはプロキシローテーションと、計算単位ベースのインフラが含まれます。住宅プロキシはから利用できます。

- 保守:Actorが壊れたら、メンテナが直すのを待つか、別のActorに切り替えるか、専用のプライベートActorを依頼することになります。

価格

- 無料プラン:月5ドル分の前払い利用枠、クレジットカード不要

- Starter:月9ドル + 従量課金

- Scale:月99ドル + 従量課金

- エクスポート:JSON、CSV、Excel、XML、RSS(Actor依存)

こんな方に最適:複数のActorを見比べ、Cookieを設定し、壊れた時に自力で切り分けできる技術寄りのユーザー。放置運用を求めるチームには向きません。

3. Octoparse

は、視覚的なクリック操作でワークフローを組めるデスクトップ型のノーコードスクレイパーです。Thunderbitの2クリックの手軽さと、ScraperAPIの開発者向け自由度の中間に位置します。コードは不要ですが、ワークフロー自体は作成・保守していく必要があります。

OctoparseでTrustpilotをスクレイピングする設定

ワークフローは比較的シンプルですが、手動作業が必要です。

- Trustpilotの企業レビューURLを貼り付ける

- レビュー要素(タイトル、本体、評価、日付、レビュアー名)を視覚的に選択する

- 次ページボタンを使ってページネーションのループを定義する

- 待機時間を設定する(reCAPTCHA回避のため2〜5秒推奨)

- 小規模ならローカル、大規模ならクラウドで実行する

この設定は、ツールに慣れている人なら10〜15分ほどでできます。難点は、OctoparseがDOM要素に紐づく視覚セレクタを使うため、Trustpilotがページ構造を変えるたびにワークフローを更新する必要があることです。

ログイン壁とボット対策への対応

- ログイン壁:手動でのログイン / Cookie / セッション設定が必要。自動では処理されません。

- ボット対策:には、IPローテーション、住宅プロキシ(3ドル/GB)、自動CAPTCHA解決(1,000件あたり1〜1.5ドル)が含まれます。

- 保守:中程度。Trustpilotがフロントエンドを更新したら、ワークフローの作り直しや調整が必要になると考えてください。

価格

- 無料プラン:永久無料、10タスク、1デバイス、ローカル抽出、月最大50,000行

- Standard:月69ドル(年払い)

- Professional:月149ドル

- 14日間のプレミアム試用:クラウド抽出、スケジューリング、API、テンプレートを含む

- エクスポート:Excel、CSV、JSON、HTML、XML。上位プランではデータベースとGoogle Sheetsにも対応

こんな方に最適:視覚的にワークフローを管理したい、初期設定に時間がかかっても気にしない、ページ変更時の保守も苦にならないユーザー。2クリックのツールより柔軟で、Pythonを書くほど複雑ではないものを求めるチームに向いています。

4. Web Scraper

は、サイトマップベースのアプローチでスクレイピングを行うChrome拡張とクラウドプラットフォームです。Trustpilot向けの強みは、で、企業名、カテゴリ、住所、評価、レビュー数、TrustScore、WebサイトURLといった企業レベルのデータを抽出できる点です。

レビューのスクレイピングに関しては、Web Scraperには明確に押さえておくべき制限があります。

既製テンプレート vs. カスタム設定

マーケットプレイスのテンプレートは、Trustpilot内のカテゴリを横断して企業プロフィールを集める用途にはよく機能します。カスタムのレビュー抽出では、Sitemap Wizardを使ってChrome拡張内で視覚的にスクレイパーを組み立てられます。

では、URLベースのページネーションよりもJavaScriptクリックによるページ送りを推奨しています。Trustpilotはページ間で内容を動的に並べ替えることがあり、結果のズレが起きるためです。

ログイン壁とボット対策への対応

ここは率直に言うべきところです。Web Scraperの公式ガイドでは、Trustpilotはレビューの最初の10ページまでしか表示せず、その後はログインを求めると明記されています。ガイドではこれを既知の制限として扱っており、回避策は提示していません。

- ログイン壁:対応は限定的。レビュー10ページ制限は公式ガイドでも明記されています。

- ボット対策:クラウドプランにはプロキシ対応が含まれ、ガイドでは2〜5秒の遅延と同時実行数の抑制が推奨されています。

- ページネーション:設定は可能ですが、未認証アクセスでは実質的に最初の10ページに制限されます。

価格

- 無料Chrome拡張:ローカルスクレイピング、機能制限あり

- Project:月50ドル(5,000 URLクレジット)

- Professional:月100ドル(20,000 URLクレジット)

- Scale:月200ドルから(条件付きでURLクレジット無制限)

- 7日間の無料試用:有料クラウドプランで利用可能

- エクスポート:CSV、XLSX

こんな方に最適:Trustpilotの企業プロフィールをスクレイピングするための既製テンプレートが欲しい方、または最初の10ページのレビューだけで十分な方。レビュー数の多い企業の全履歴が必要なら、最適な選択ではありません。

5. ScraperAPI

は、開発者向けのスクレイピング基盤です。クリック操作型のツールではなく、パース処理のコードを書く一方で、ボット対策を引き受けるプロキシ / レンダリング層です。では、JSレンダリング、CAPTCHA対応、4,000万超のプロキシをうたっています。

抽出ロジックを完全に自分で制御したいPython開発者なら、ScraperAPIは土台を提供してくれます。

ただし、保守責任もそのままあなたのものです。

ScraperAPIでカスタムTrustpilotスクレイパーを作る

では、Python + BeautifulSoupのワークフローが紹介されています。

1import requests

2from bs4 import BeautifulSoup

3payload = {

4 "api_key": "YOUR_API_KEY",

5 "url": "https://www.trustpilot.com/review/example.com",

6 "render": "true",

7 "keep_headers": "true",

8}

9html = requests.get("https://api.scraperapi.com", params=payload).text

10soup = BeautifulSoup(html, "html.parser")完成版コードではpages_to_scrape = 10が設定されており、公開ページの制限を事実上認めています。10ページ目以降では、開発者が認証済みセッション、Cookie、トークンを自分で管理する必要があります。

ログイン壁とボット対策への対応

- ログイン壁:コードレベルでのセッション / Cookie管理が必要です。ScraperAPIがプロキシとレンダリングを処理し、認証ロジックはあなたが担当します。

- ボット対策:自動IPローテーション付きの住宅プロキシプール、

render=trueによるJSレンダリング、スマートなプロキシローテーションを通じたCAPTCHA対応。で利用可能です。 - 保守:Trustpilotがクラス名を変更したら(これは定期的に起こります)、解析コードを更新する必要があります。チュートリアルの

styles_reviewCardInner__EwDq2セレクタは、すでに時限爆弾のようなものです。

価格

- 7日間試用:、クレジットカード不要

- Hobby:月49ドル(100,000 APIクレジット)

- Startup:月149ドル(1,000,000クレジット)

- Business:月299ドル(3,000,000クレジット)

- エクスポート:コードが生成するものすべて(通常はCSV、JSON、データベース書き込み)

こんな方に最適:完全なカスタマイズを望み、自前の解析スクリプトを保守でき、セッション管理、ページネーションロジック、データ構造をプログラムで制御したい開発者。非技術ユーザー向けではありません。

Trustpilotのスクレイパーが壊れ続ける理由(そして壊れにくいものの選び方)

Trustpilot用スクレイパーを選ぶうえで、最も見落とされがちな要素です。重要なのは「今日、このツールは動くか」ではありません。「3週間後も動くか」です。

Trustpilotでは、スクレイパーが繰り返し壊れる理由が4つあります。

-

生成されるCSSクラスの変更。 Next.jsのCSSモジュールは、

styles_reviewCardInner__EwDq2のようなクラス名を生成します。これらはフロントエンドをデプロイするたびに変わります。これらのクラスを対象にしたスクレイパーは壊れます。 -

DOM構造の変更。 TrustpilotはHTML階層を組み替えることができます。レビューカードの入れ子構造が変わったり、ラッパー要素が変わったり、メタデータの位置がずれたりします。

-

ボット対策の発動条件の変更。 reCAPTCHAのしきい値は変わります。セッショントークンのローテーションはより厳しくなります。CDNのフィルタリングルールも更新されます。

-

認証 / セッションの変更。 10ページ目のログイン壁は2025年後半に導入された(あるいはより厳格に適用された)ものです。将来的に、さらに別のアクセス制限がいつ出てもおかしくありません。

根本的な違いは、セレクタベースか意味ベースかです。

-

セレクタベースのツール(ApifyのActor、Octoparseのワークフロー、ScraperAPIのスクリプト、Web Scraperのサイトマップ)は、「この正確なCSSパスにある要素を見つけて」と考えます。パスが変わると、静かに失敗するか、空データを返します。

-

意味 / AIベースのツール(Thunderbit)は、「このページのレビュー本文、評価、日付を見つけて」と考えます。AIはページ要素をアドレスではなく意味で解釈します。レイアウトが変わっても、意味が変わらない限り壊れません。

私のおすすめは次の通りです。

- 保守を一切したくない? → AIベース(Thunderbit)

- 多少の保守は許容、クラウド自動化が欲しい? → Apify(Actor選定と監視が前提)

- 視覚的に制御したい、保守は中程度ならOK? → Octoparse

- テンプレート中心で、対象範囲が限定的? → Web Scraper

- 完全に自分で制御したい? → ScraperAPI

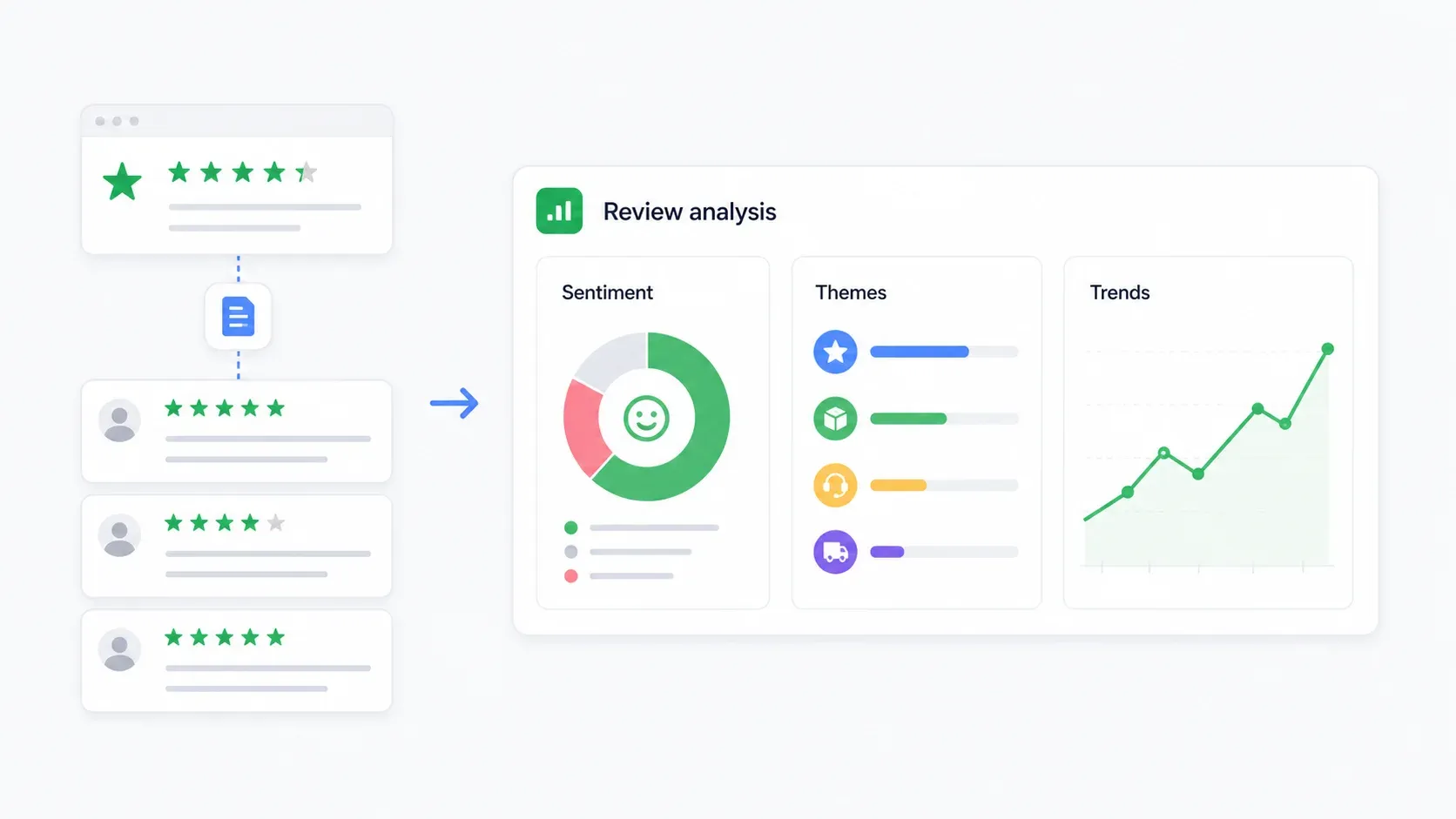

スクレイピングしたTrustpilotレビューをどう活用するか

レビューを抽出するのは第一歩にすぎません。フォーラムでいつも見かける問いがあります。「データは取れた。次に何をすればいい?」

感情分析

最もシンプルな方法は、レビューをGoogle Sheetsに書き出し、ChatGPT、Claude、またはSheetsのAI関数を使って、各レビューをポジティブ、ニュートラル、ネガティブに分類することです。そこに、苦情カテゴリ、緊急度、推奨アクション優先度の列を追加します。

大規模データなら、CSVをChatGPTにアップロードして次のように依頼できます。「これらのレビューを感情別に分類し、代表的な引用付きで上位5つの不満テーマを特定してください。」

競合モニタリング

Thunderbitの定期スクレイピングを使えば、競合レビューを毎週または毎月取得できます。次の指標を追跡しましょう。

- 平均評価の推移

- 1つ星・2つ星レビューの割合

- レビュー件数の変化(増えているか、減っているか)

- よくある不満テーマ

- 企業返信の率と速度

評価と日付でピボットテーブルを作ったシンプルなGoogle Sheetsダッシュボードでも、自動更新される競合インテリジェンスの流れを作れます。

テーマ抽出

レビューを次のような共通カテゴリにまとめます。配送、カスタマーサポート、返金、製品品質、請求、アプリの使いやすさ、価格 / 価値、そして不正懸念です。出力は、テーマ、件数、平均評価、代表的な引用、推奨アクションを示す表にするとよいでしょう。

これはワードクラウドよりはるかに実用的です。何が満足や不満の原因になっているのかが、はっきりわかります。

大量の複数企業分析

カテゴリ単位の調査では、同じTrustpilotカテゴリ内の複数企業を横断してレビューをスクレイピングします。レビュー件数、評価、星の分布、テーマの多さを、市場セグメント全体で比較してください。企業一覧の発見にはWeb Scraperのテンプレートが便利ですが、レビュー単位のサンプリングはThunderbitまたはScraperAPIで対応できます。

Trustpilotスクレイピングに関する法的・倫理的な考慮事項

私は弁護士ではありませんし、これは法的助言でもありません。ただし、コンプライアンスの現実は無視できません。

Trustpilotの利用規約は明確です。では、Trustpilotが提供または明示的に承認した以外の手段によるコンテンツへのアクセスや収集を禁じており、明示的な許可なしでのテキストマイニング、データマイニング、Webスクレイピングを特に禁止しています。

リスクの目安は次の通りです。

- 低リスク:自社レビューを社内分析のためにエクスポートする場合。特にTrustpilotの公式ビジネスツールやAPIを使う場合。

- 中リスク:市場調査目的で公開されている競合ページを低頻度でスクレイピングする場合。ただし利用規約とプライバシー義務の対象です。

- 高リスク:認証壁のある10ページ目以降を取得する、技術的制御を回避する、レビューデータを再配布する、スクレイピングしたレビューをAIモデルの学習に使う場合。

GDPR上の考慮:レビュアー名、プロフィールリンク、レビュー本文、所在地情報は、EUのプライバシー法上、個人データに該当し得ます。実務上の対策としては、必要な項目だけを収集する、社内分析ではレビュアー名をハッシュ化する、保存期間を設定する、生のレビュー本文を大規模に再公開しない、などが挙げられます。

公開データと認証済みデータ:誰でも見られるページ(最初の10レビューページ)をスクレイピングすることと、認証壁の裏にあるデータを取ることには、法的にも倫理的にも大きな違いがあります。公開データのみで動くツールは、ログイン認証が必要なツールよりコンプライアンスリスクが低いです。

これはツール選びの重要な判断材料です。Thunderbitのブラウザモードは、自分のセッションで見えているページに対して動作するので、独自に認証を回避するわけではありません。ScraperAPIは開発者に完全な自由を与える一方で、セッション管理の適法性に関する責任もすべて開発者が負います。

どのTrustpilotレビュー用スクレイパーを選ぶべきか

ペルソナ別の判断基準は次の通りです。

- コードなしでレビューが欲しい非技術系マーケター? → Thunderbit。2クリックで、あとはAIに任せ、Sheets / Notion / Airtableへエクスポート。

- 設定やデバッグに慣れたローコードユーザー? → Apify。Actorを選び、10ページ目以降のCookieを設定し、壊れないか監視。

- ワークフローを自分で組みたいビジュアル派? → Octoparse。クリック操作で設定できるが、Trustpilot変更時の保守は必要。

- 企業レベルのデータ、または最初の10ページだけで十分? → Web Scraper。企業プロフィール向けの強力な既製テンプレートがあります。

- 完全にカスタマイズしたい開発者? → ScraperAPI。解析ロジック、セッション管理、データパイプラインを自分で持つ。

保守の少なさを最優先するなら、Thunderbit(ほぼ保守不要)からScraperAPI(すべて自分で保守)まで、明確な差があります。予算面では、このリストのすべてに無料の入口があります。いきなり契約する前に、まずそこから試すのがおすすめです。

まとめ

Trustpilotのレビューデータは、競合分析、評判モニタリング、顧客インサイトにとって本当に価値があります。

しかし2026年にそれを安定して取得するには、10ページ目のログイン壁を越え、DOMの変更に適応し、ボット対策を毎回手作業でいじらずに処理できるツールが必要です。

多くのビジネスユーザーにとって、は最も手間の少ない選択肢です。2クリック、AIによる項目検出、認証済みページ向けのブラウザモード、そしてTrustpilotのフロントエンドが変わっても保守不要です。こともでき、月6ページまでクレジットカードは不要です。

完全な制御を求める開発者には、ScraperAPIが基盤を提供します。その中間にいる人には、Apify、Octoparse、Web Scraperがそれぞれ特定のニーズを満たします。重要なのは、ツールを自分の技術レベル、保守の許容度、コンプライアンス要件に合わせることです。

ThunderbitがTrustpilotをどう扱うかを実際に見たい方は、をご覧ください。また、やについて、基本から知りたい方にはこちらのガイドが役立ちます。

FAQ

1. Trustpilotのレビューは10ページ目以降もスクレイピングできますか?

はい、ただし認証済みの経路が必要です。Trustpilotは未認証アクセスを最初の10レビューページ以降でブロックします。Thunderbitのブラウザモードはログイン済みのChromeセッション内で動くため、自分が見られるページにアクセスできます。ScraperAPIではコードレベルでのセッション / Cookie管理が必要です。ApifyのActorはCookie設定が必要です。Octoparseは手動でのログイン / Cookie設定が必要です。Web Scraperの公式ドキュメントでも、10ページ制限があることを認めており、組み込みの回避策はありません。

2. Trustpilotレビューのスクレイピングは合法ですか?

Trustpilotの利用規約では、明示的な許可なしの自動データ収集が禁じられています。法的リスクは手法と用途で異なります。自社の公開レビューを取得することは、競合の認証壁を回避して取得するよりもリスクが低いです。EUのレビューデータにはGDPRが適用されます。これは法的助言ではありません。大規模または商用のスクレイピング案件では、弁護士に相談してください。

3. Trustpilotからどのようなデータを抽出できますか?

一般的な項目には、レビュアー名、星評価、レビュータイトル、レビュー本文、投稿日、体験日、購入確認ステータス、レビュアー所在地、企業返信本文、会社名、TrustScore、総レビュー数、星分布、レビューURLなどがあります。

4. Trustpilotのスクレイパーはどれくらいの頻度で壊れますか?

セレクタベースのツール(ApifyのActor、Octoparseのワークフロー、自作Pythonスクリプト)は、TrustpilotがCSSクラスやDOM構造を変えるたびに壊れる可能性があります。これは月に何度も起こり得ます。ThunderbitのようなAI意味解析型ツールは、特定のセレクタではなくページの意味を解釈するため、自動的に適応します。ただし、10ページ目のログイン壁のような大きなアクセス制御変更には、どのツールも完全には無傷ではありません。

5. Trustpilotレビューを無料でスクレイピングできますか?

このリストのツールはすべて無料の入口があります。Thunderbitは月6ページ無料、ScraperAPIは7日間で5,000クレジットの試用枠、Web Scraperはローカル利用向けの無料Chrome拡張、Octoparseは永久無料プラン(10タスク、月50,000行)、Apifyは月5ドル分の無料プラットフォームクレジットがあります。小規模なサンプリングやテストなら、どれも支払いなしで使えます。

詳しく知る