ウェブの進化スピードって、僕のコーヒー消費量なんて比じゃないくらい速いんだよね。本当に、ここ数年でウェブデータの抽出は一部のマニアだけのものじゃなくなって、ビジネスインテリジェンスやAI学習、業務自動化の土台として当たり前になってきた。市場の動きをキャッチしたり、次世代LLMの学習データを集めたり、競合の価格を調べたり…リアルタイムで構造化されたウェブデータの需要は今まで以上に高まってる。その中心にいるのがPython。エコシステムが豊富で、直感的な文法だから、Pythonはウェブスクレイピングの定番言語として、ちょっとした自動化から大規模クローラーまで幅広く使われてるんだ。

でも、ここが肝心。python ウェブスクレイピング パッケージの選び方ひとつで、プロジェクトの運命が決まることも珍しくない。間違ったツールを選んで、ボット対策に何日も悩まされたり、複雑なHTMLを手作業で解析して時間を無駄にしたり…。SaaSや自動化、AI分野で長年やってきてを開発してきた僕が、2026年に本気でおすすめしたいPython スクレイピング ライブラリ おすすめ12選を厳選したよ。それぞれの強みや特徴、どんな用途に向いてるかも解説するから、次のデータ収集にぴったりのツールを見つけてみて。

なぜpython ウェブスクレイピング パッケージ選びが大事なのか

実際、すべてのスクレイピング案件が同じ難易度ってわけじゃない。静的なページから商品価格を数件取るだけのときもあれば、JavaScriptだらけのクセ強サイトを相手にすることもある。ちゃんとしたパッケージを選べば、作業時間がグッと短くなるし、エラーも減るし、ボットブロックやHTML崩れみたいなトラブルも避けやすくなる。

Pythonがウェブスクレイピングで人気なのは伊達じゃない。requestsやurllib3みたいなライブラリはされてて、主要なスクレイピングツールの多くがPythonを第一言語にしてる。でも、パワフルな分、選び方を間違えると「ダイヤルアップ並みに遅い」プロジェクトに悩まされることも。最適なツールを選べば、コーヒーが冷める前にきれいなデータが手に入るよ。

Python スクレイピング ライブラリ おすすめの選定基準

パッケージ選びは適当に決めてない。以下のポイントでしっかり評価してる:

- パフォーマンス・並列処理:大量ページをサクサク取れるか?

- 使いやすさ:初心者でも扱いやすい?それとも上級者向け?

- HTML解析力:壊れたマークアップやXPath/CSSセレクタ対応、データ抽出のしやすさ

- 動的コンテンツ対応:JavaScriptメインのサイトもいける?

- コミュニティ・ドキュメント:利用者が多くて情報が充実してる?

- 最適な用途:簡単なスクリプト向け?大規模クローラー向け?

さらに、実際の開発者の声や最新ベンチマーク、自分の現場経験も加味してる。それじゃ、注目のパッケージを見ていこう!

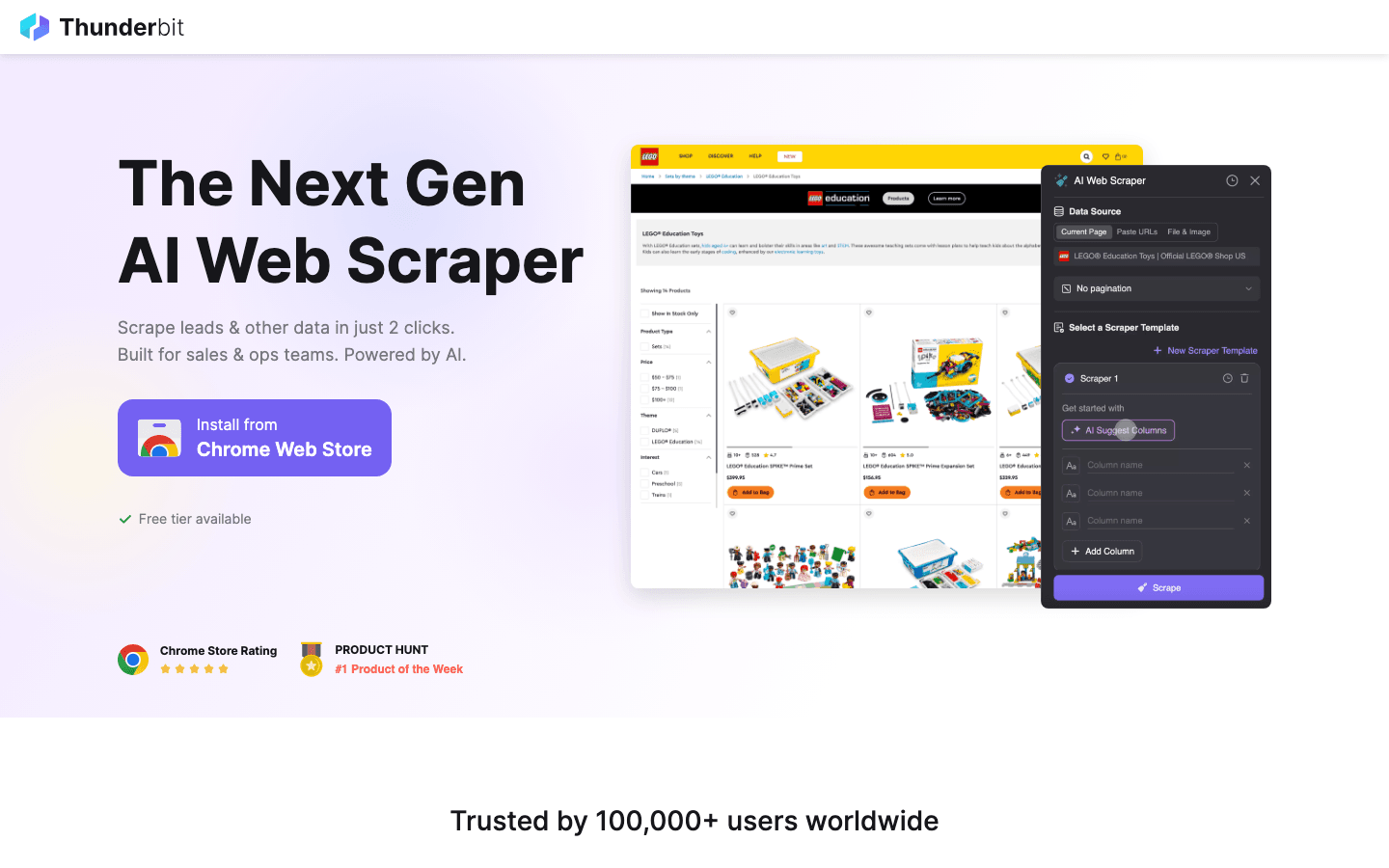

1. Thunderbit

は、従来のPythonライブラリとは一味違う、AI搭載のChrome拡張。Python開発者がスピード・精度・AIの力を活かしてスクレイピングしたいときにピッタリ。最大の特徴は、自然言語で指示するだけでAIが必要なデータを抽出してくれて、フィールド提案やサブページ遷移、ページネーション、ExcelやGoogle Sheets、Notion、Airtableへのエクスポートまで自動でやってくれるところ。

は、従来のPythonライブラリとは一味違う、AI搭載のChrome拡張。Python開発者がスピード・精度・AIの力を活かしてスクレイピングしたいときにピッタリ。最大の特徴は、自然言語で指示するだけでAIが必要なデータを抽出してくれて、フィールド提案やサブページ遷移、ページネーション、ExcelやGoogle Sheets、Notion、Airtableへのエクスポートまで自動でやってくれるところ。

Thunderbitは、複雑で非構造的なデータ(たとえばごちゃごちゃしたディレクトリや商品リスト、HTMLが「抽象アート」状態のサイト)を扱うときの救世主。AIフィールド提案機能で最適なカラムを自動で提案してくれるし、サブページスクレイピングで詳細ページも自動巡回してデータを充実させてくれる。ボット対策に悩みがちな人も、ブラウザベースやクラウドスクレイピング機能で安心。

Pythonユーザーには、リード獲得や市場調査、プロトタイピングで特に人気。出力データはPythonのデータパイプラインにそのまま使えるし、API連携で自動化もOK。コードを書く手間を減らして、分析に集中したい人におすすめの新定番。

主な特徴:

- AIによるフィールド提案・データ抽出

- サブページ・ページネーション・PDF/画像にも対応

- CSV、Excel、Google Sheets、Notion、Airtableにエクスポート可能

- コーディング不要——非エンジニアからPython上級者までスピーディに使える

- 無料プランあり、有料プランは用途に応じて拡張

おすすめ用途: リード獲得、市場調査、プロトタイピング、複雑・非構造データのスクレイピング

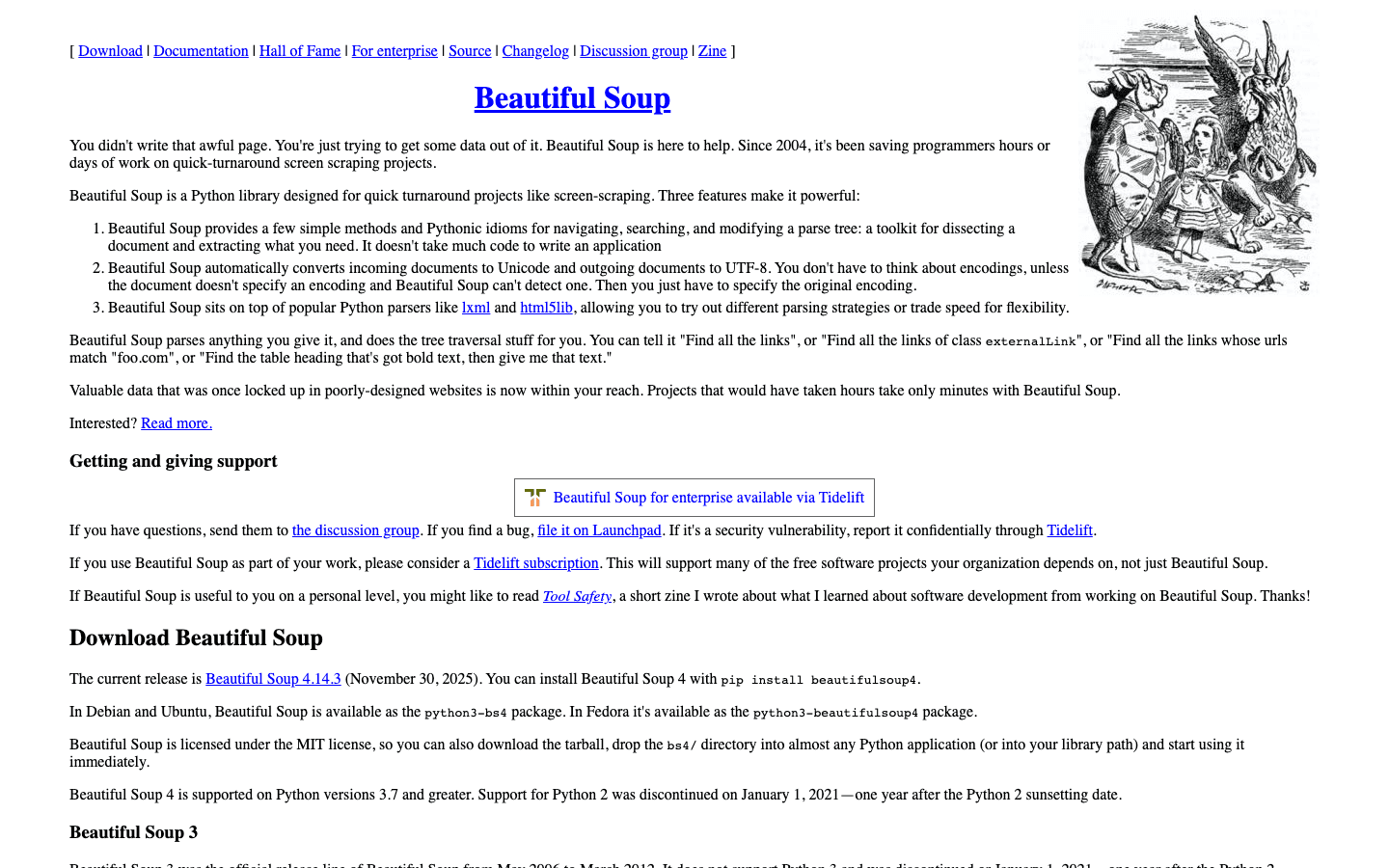

2. Beautiful Soup

は、PythonでHTML解析するならまずこれ!っていう定番ライブラリ。静的なウェブページからデータを抜きたい初心者に特におすすめ。Beautiful Soupは、崩れたHTML(いわゆる“タグスープ”)の解析が得意で、ルール無視のサイトでもしっかりデータを取れる。

は、PythonでHTML解析するならまずこれ!っていう定番ライブラリ。静的なウェブページからデータを抜きたい初心者に特におすすめ。Beautiful Soupは、崩れたHTML(いわゆる“タグスープ”)の解析が得意で、ルール無視のサイトでもしっかりデータを取れる。

APIは直感的で、.find()や.select(), .textみたいな分かりやすいメソッドが揃ってる。requestsと組み合わせて使うのが一般的。パーサーもlxml(高速)やhtml5lib(互換性重視)など選べる。ドキュメントも豊富で、コミュニティもめちゃくちゃ大きい。

主な特徴:

- 直感的でPythonらしいAPI(HTML/XMLナビゲーション)

- 壊れたマークアップにも強い

- 複数パーサー対応で速度・互換性を選べる

- 大規模なコミュニティと豊富なチュートリアル

おすすめ用途: 簡単なスクリプト、静的ページのスクレイピング、初心者の学習用

3. Scrapy

は、大規模な自動クローリングに特化したフレームワーク。数百・数千ページのスクレイピングや、パイプライン管理、定期実行が必要なときに最適。Twistedエンジン上で動作して、非同期クロールやデータクリーニング用パイプライン、JSON/CSV/DBへのエクスポート機能もバッチリ。

は、大規模な自動クローリングに特化したフレームワーク。数百・数千ページのスクレイピングや、パイプライン管理、定期実行が必要なときに最適。Twistedエンジン上で動作して、非同期クロールやデータクリーニング用パイプライン、JSON/CSV/DBへのエクスポート機能もバッチリ。

拡張性も高くて、プロキシやキャッシュ、JavaScriptレンダリング(SplashやSelenium連携)もできる。Beautiful Soupより学習コストは高めだけど、本格的な大規模データ収集には欠かせない存在。

主な特徴:

- 非同期・高性能なクロール

- データクリーニング・保存用パイプライン内蔵

- 多様なフォーマットへのエクスポート

- 活発なコミュニティと豊富なプラグイン

おすすめ用途: 大規模・定期的なスクレイピング、データパイプライン構築、スピード・信頼性重視の案件

4. Selenium

は、JavaScriptメインやインタラクティブなサイトのスクレイピングに欠かせないツール。実際のブラウザ(ChromeやFirefoxなど)を自動操作して、クリックやスクロール、フォーム送信などユーザー操作を再現できる。JavaScript実行後にしか出てこないデータも、Seleniumならしっかり取れる。

は、JavaScriptメインやインタラクティブなサイトのスクレイピングに欠かせないツール。実際のブラウザ(ChromeやFirefoxなど)を自動操作して、クリックやスクロール、フォーム送信などユーザー操作を再現できる。JavaScript実行後にしか出てこないデータも、Seleniumならしっかり取れる。

デメリットは、動作が遅くてリソース消費が大きいこと。1ページごとにブラウザを立ち上げるから、大量ページの処理には向かないけど、「他のツールじゃ無理」な場面で頼りになる。

主な特徴:

- 実ブラウザ自動化(Chrome, Firefox, Edge等対応)

- JavaScript描画やインタラクティブ要素も取得可能

- ヘッドレスモード対応で高速化も可能

- 大規模なコミュニティと豊富なドキュメント

おすすめ用途: 動的・JavaScriptメインのサイト、ログインフロー自動化、CAPTCHAや複雑な操作が必要な場合

5. PyQuery

は、jQueryっぽい記法でHTML解析できるPythonライブラリ。JavaScriptでjQueryを使ったことがある人には特に馴染みやすい。高速な

は、jQueryっぽい記法でHTML解析できるPythonライブラリ。JavaScriptでjQueryを使ったことがある人には特に馴染みやすい。高速なlxmlパーサーを使って、$('div.classname')みたいなCSSセレクタで要素を抽出できる。

プロトタイピングや、簡潔で読みやすいコードを書きたい開発者におすすめ。Beautiful Soupより複雑なクエリも高速に処理できて、非同期ツールやSeleniumとの連携も簡単。

主な特徴:

- jQueryライクなセレクタ・記法

- lxmlバックエンドで高速解析

- JavaScriptからの移行にも最適

- チェーン記法で簡潔なクエリ

おすすめ用途: プロトタイピング、jQueryファン、HTML解析を短いコードで済ませたい場合

6. LXML

は、Pythonで最速のHTML/XML解析を誇るライブラリ。C言語の

は、Pythonで最速のHTML/XML解析を誇るライブラリ。C言語のlibxml2とlibxsltをベースにしてて、パフォーマンスとXPath/CSSセレクタの強力なサポートが魅力。大規模なドキュメントや複雑なクエリが必要なときに最適。

単体でも、Beautiful SoupやPyQueryのパーサーとしても使える。APIはちょっと上級者向けだけど、速度と柔軟性を求めるなら最有力。

主な特徴:

- Pythonで最速のパーシング

- XPath・CSSセレクタ完全対応

- 大規模・複雑なドキュメントも効率的に処理

- 他ライブラリのパーサーとしても利用可能

おすすめ用途: 高速解析、大規模スクレイピング、高度なクエリが必要な案件

7. Requests

は、PythonでHTTPリクエストを送るときの定番ライブラリ。シンプルで直感的なAPIで、

は、PythonでHTTPリクエストを送るときの定番ライブラリ。シンプルで直感的なAPIで、requests.get(url)だけでページ取得ができる。クッキーやセッション、JSONデコードも標準で対応。

同期処理(リクエストごとに待機)だけど、簡単なスクリプトや小規模スクレイピングには最適。Beautiful Soupやlxmlと組み合わせて使うのが一般的。

主な特徴:

- シンプルでPythonらしいHTTPリクエストAPI

- クッキー・セッション・リダイレクト対応

- 解析ライブラリとの連携が簡単

- 圧倒的なコミュニティとドキュメント

おすすめ用途: 簡単なスクリプト、静的ページの取得、初心者の入門用

8. MechanicalSoup

は、フォーム入力や複数ページのログインフローなど、簡単なブラウザ操作を自動化できる軽量ライブラリ。

は、フォーム入力や複数ページのログインフローなど、簡単なブラウザ操作を自動化できる軽量ライブラリ。requestsとBeautiful Soupをラップしてて、Seleniumより高速・省リソースで、JavaScript依存が少ないサイトに最適。

ログインやフォーム送信、数ページの遷移など、動的要素が少ないサイトの自動化におすすめ。

主な特徴:

- フォーム入力・ページ遷移の自動化

- Requests・Beautiful Soupベースで軽量・高速

- ブラウザ起動不要で手軽

- 適度なインタラクションに最適

おすすめ用途: ログインやフォーム送信が必要なサイト、簡単な自動化、Seleniumのオーバーヘッドを避けたい場合

9. Aiohttp

は、非同期で高速なウェブリクエストを実現するライブラリ。大量ページを一気に取得したいとき、aiohttpなら並列リクエストで処理時間を大幅短縮できる。あるベンチマークでは、50ページの取得が同期処理の16秒に対し、aiohttpではわずか3秒で完了()。

は、非同期で高速なウェブリクエストを実現するライブラリ。大量ページを一気に取得したいとき、aiohttpなら並列リクエストで処理時間を大幅短縮できる。あるベンチマークでは、50ページの取得が同期処理の16秒に対し、aiohttpではわずか3秒で完了()。

async defやawaitの記述が必要だけど、大規模案件ではその価値あり。

主な特徴:

- 非同期HTTPクライアント/サーバーフレームワーク

- セッション・クッキー・HTTP/2対応

- 並列リクエストで圧倒的な高速化

- 非同期解析ライブラリとの連携も可能

おすすめ用途: 高速・大規模スクレイピング、API収集、非同期プログラミングに慣れてる人

10. Twisted

は、Scrapyの基盤になってるイベント駆動型ネットワークエンジン。スクレイピング専用じゃないけど、上級者はTwistedを直接使って独自クローラーや非HTTPプロトコル対応、超並列スパイダーの構築もできる。

は、Scrapyの基盤になってるイベント駆動型ネットワークエンジン。スクレイピング専用じゃないけど、上級者はTwistedを直接使って独自クローラーや非HTTPプロトコル対応、超並列スパイダーの構築もできる。

パワフルだけど学習コストは高め。フレームワーク自作や特殊用途に向いてる。

主な特徴:

- HTTP/WebSocket/SSHなど多様なネットワーク対応

- SSL・並列処理・独自プロトコルもサポート

- Scrapyの非同期エンジンの基盤

- 高度なカスタマイズが可能

おすすめ用途: 独自プロトコル対応、スクレイピングフレームワーク自作、上級者向け

11. Grab

は、HTTPリクエスト・解析・自動化・プロキシローテーション・CAPTCHA対応などを一体化したオールインワンのスクレイピングツールキット。Scrapyに似てるけど、もっと手軽に使える設計で、プロキシ・キャッシュ・非同期スパイダーも標準搭載。

は、HTTPリクエスト・解析・自動化・プロキシローテーション・CAPTCHA対応などを一体化したオールインワンのスクレイピングツールキット。Scrapyに似てるけど、もっと手軽に使える設計で、プロキシ・キャッシュ・非同期スパイダーも標準搭載。

特に注目はGrab:Spiderシステムで、マルチカールによる数千リクエストの並列処理が可能。Scrapyよりセットアップが簡単なオールインワンを求める人におすすめ。

主な特徴:

- プロキシ・ユーザーエージェントローテーション・キャッシュ標準対応

- 非同期スパイダーで高並列処理

- XPath解析・モジュール構造

- 大規模スクレイピングの実績あり

おすすめ用途: オールインワン案件、プロキシ・CAPTCHA多用時、Scrapyより手軽に使いたい場合

12. Urllib3

は、Requestsなど多くのPythonクライアントの基盤になってる低レベルHTTPエンジン。コネクションプーリングやスレッドセーフ、リトライ、HTTP接続の細かな制御ができる。多くの開発者は間接的に使ってるけど、パフォーマンス重視や上位ライブラリ開発時には最適。

は、Requestsなど多くのPythonクライアントの基盤になってる低レベルHTTPエンジン。コネクションプーリングやスレッドセーフ、リトライ、HTTP接続の細かな制御ができる。多くの開発者は間接的に使ってるけど、パフォーマンス重視や上位ライブラリ開発時には最適。

初心者向けじゃないけど、信頼性と実績は抜群。

主な特徴:

- コネクションプーリング・スレッドセーフ

- HTTP接続の細かな制御

- 多くのライブラリの基盤として利用

- 繰り返しリクエスト時の高パフォーマンス

おすすめ用途: カスタムHTTPクライアント、マルチスレッドクローラー、Python HTTPスタック上での開発

比較表:Python スクレイピング ライブラリ おすすめ一覧

| パッケージ | 使いやすさ | パフォーマンス | 動的コンテンツ | 解析力 | コミュニティ/ドキュメント | 最適な用途 |

|---|---|---|---|---|---|---|

| Thunderbit | ★★★★☆ (GUI/AI) | 高速 (クラウド/ローカル) | あり (AI対応) | 自動フィールド・サブページ | 拡大中 (AIトレンド) | リード獲得、市場調査、ノーコードユーザー |

| Beautiful Soup | ★★★★★ (簡単) | 中程度 | なし | HTML/XML, 寛容 | 非常に大きい | 静的ページ、初心者 |

| Scrapy | ★★☆☆☆ (難しめ) | ★★★★★ (非常に高い) | プラグインのみ | CSS/XPath, パイプライン | 大規模・活発 | 大規模・定期的なスクレイピング |

| Selenium | ★★☆☆☆ (中程度) | ★☆☆☆☆ (遅い) | あり (フル) | DOM全体, JS | 成熟 | JS主体・インタラクティブサイト |

| PyQuery | ★★★★☆ (jQuery風) | 高速 (lxml) | なし* | jQueryセレクタ | 中規模 | プロトタイピング、jQuery開発者 |

| LXML | ★★★☆☆ (上級者向け) | ★★★★★ (最速) | なし | XPath/CSS, XML | 中規模 | 大規模ドキュメント、高度なクエリ |

| Requests | ★★★★★ (非常に簡単) | ★★☆☆☆ (同期) | なし | HTTP, JSON | 非常に大きい | 簡単なスクリプト、静的ページ |

| MechanicalSoup | ★★★★☆ (簡単) | ★★☆☆☆ (同期) | なし | フォーム・ナビゲーション | 小規模 | ログインフロー、フォーム自動化 |

| Aiohttp | ★★☆☆☆ (非同期) | ★★★★★ (並列) | なし | 非同期HTTP | 大規模 (非同期) | 高速・並列スクレイピング |

| Twisted | ★☆☆☆☆ (複雑) | ★★★★★ (カスタム) | なし | ネットワーク・プロトコル | ニッチ | カスタムフレームワーク、上級者 |

| Grab | ★★★☆☆ (モジュール型) | ★★★★☆ (非同期) | なし | プロキシ・XPath | 小規模 | オールインワン、プロキシ/CAPTCHA多用 |

| Urllib3 | ★★★★☆ (低レベル) | ★★★★☆ (プール) | なし | HTTP, プーリング | 非常に大きい | カスタムクライアント、マルチスレッドクローラー |

*PyQueryはSeleniumと組み合わせて動的サイトにも対応可能。

目的別:最適なpython ウェブスクレイピング パッケージの選び方

どのパッケージを選ぶか迷ったら、こんな感じで選ぶといいよ:

- 静的ページ・小規模・初心者:Requests + Beautiful Soupから始めよう

- 大規模・定期的・本番運用:ScrapyかGrab(オールインワン希望ならGrab)

- JavaScriptメイン・インタラクティブサイト:Selenium(もしくはAI搭載・ノーコード希望ならThunderbit)

- 高速・並列スクレイピング:Aiohttp(非同期に慣れてる人向け)

- フォーム自動化・ログインフロー:MechanicalSoup(簡単なサイト)、Selenium(複雑なJSサイト)

- 高度な解析・大規模ドキュメント:LXMLかPyQuery

- カスタムネットワーク・プロトコル:Twisted

- プロトタイピング・リード獲得・非構造データ:Thunderbit

もちろん、これらのツールを組み合わせて使うのもアリ。たとえば、Seleniumでページをレンダリングして、HTMLをBeautiful SoupやPyQueryで解析するなど、効率的なワークフローも作れる。

まとめ:最適なPythonツールでウェブスクレイピングを加速しよう

2026年のウェブスクレイピングは、今まで以上にパワフルで重要な技術になってる。最適なpython ウェブスクレイピング パッケージを選べば、ウェブのカオスをビジネスや研究、次のアイデアに活かせるクリーンなデータに変えられる。経験豊富な開発者も、これから始める人も、このリストの中にきっと自分に合ったツールが見つかるはず。

AI搭載・ノーコードのスクレイピングを体験したい人は、。さらに最新のノウハウやチュートリアルを知りたい人は、もチェックしてみて。

快適なスクレイピングライフを!セレクタがいつもヒットして、プロキシが切れず、データがコードみたいに美しくなりますように。

よくある質問(FAQ)

1. 初心者におすすめのpython ウェブスクレイピング パッケージは?

多くの初心者には、との組み合わせが一番手軽。直感的なAPIと豊富なチュートリアルがあって、静的ページのスクレイピングに最適。

2. PythonでJavaScriptメインのウェブサイトをスクレイピングするには?

で実ブラウザを自動化するか、のAI搭載ノーコードスクレイピングを使えば動的コンテンツも取れる。大規模案件ならScrapyとSplashやSeleniumの組み合わせもアリ。

3. 大規模・高速スクレイピングに最適なパッケージは?

は大規模・非同期クロールに最適。さらに速度重視・非同期プログラミングに慣れてるなら、もおすすめ。

4. これらのパッケージを組み合わせて使える?

もちろんOK。多くの開発者は、RequestsやSeleniumでページ取得後、Beautiful Soupやlxml、PyQueryで解析してる。ThunderbitのエクスポートデータもPythonスクリプトで活用できる。

5. ThunderbitはPythonライブラリ?それとも独立したツール?

ThunderbitはAI搭載のChrome拡張&プラットフォームで、従来のPythonライブラリとはちょっと違う。でも、出力(CSV, Excel, Sheets, Notion, Airtable)はPythonのデータパイプラインにそのまま組み込めるから、Python開発者にも強力なパートナーになるよ。

ウェブスクレイピングの最新情報をキャッチしたい人は、やもぜひチェックしてみて。

さらに詳しく知りたい人へ