現在、インターネットトラフィックのほぼ半分はボットによるものです。その多くが、リンク、データ、URLを大規模に収集しています。まだ手作業でやっているなら、もう遅れを取っています。

私は、AI搭載のChrome拡張からPythonライブラリまで、12種類のリンク抽出ツールを実際に試し、数千件のURLをすばやく抽出したい場面で本当に使えるのはどれかを検証しました。

その結果を共有します。

なぜリンク抽出ツールが重要なのか

率直に言えば、Webにはデータがあふれており、企業はその混沌を実用的なインサイトに変えようと競争しています。とは、今や次のようなチームにとって必須のツールです。

- リード獲得:営業チームはディレクトリやLinkedInから会社プロフィールのリンクを数分で集め、そのURLを使って連絡先情報を抽出できます。延々とクリックする作業はもう不要です。

- コンテンツ集約とSEO強化:マーケターはブログ内の全記事URLを収集したり、競合の被リンクを監視したり、サイト構造を監査してリンク切れを見つけたりできます。

- 競合監視と市場調査:オペレーションチームは、新製品、価格ページ、プレスリリースへのリンクを自動収集し、手間をかけずに競合の動きを追えます。

- ワークフロー自動化と時間短縮:最新のリンクスクレイパーは、大量URLの処理、サブページのクロール、CSV、Excel、Google Sheets、Notionなどの形式での書き出しに対応しています。つまり、コピペ地獄や散らかったテキストファイルの整理から解放されます。

ことを考えると、手作業は現実的ではありません。適切なリンク抽出ツールがあれば、疲れ知らずで、リンクを見落とさず、コーヒーブレイクも求めない超高性能アシスタントを持つようなものです。

最適なリンク抽出ツールの選び方

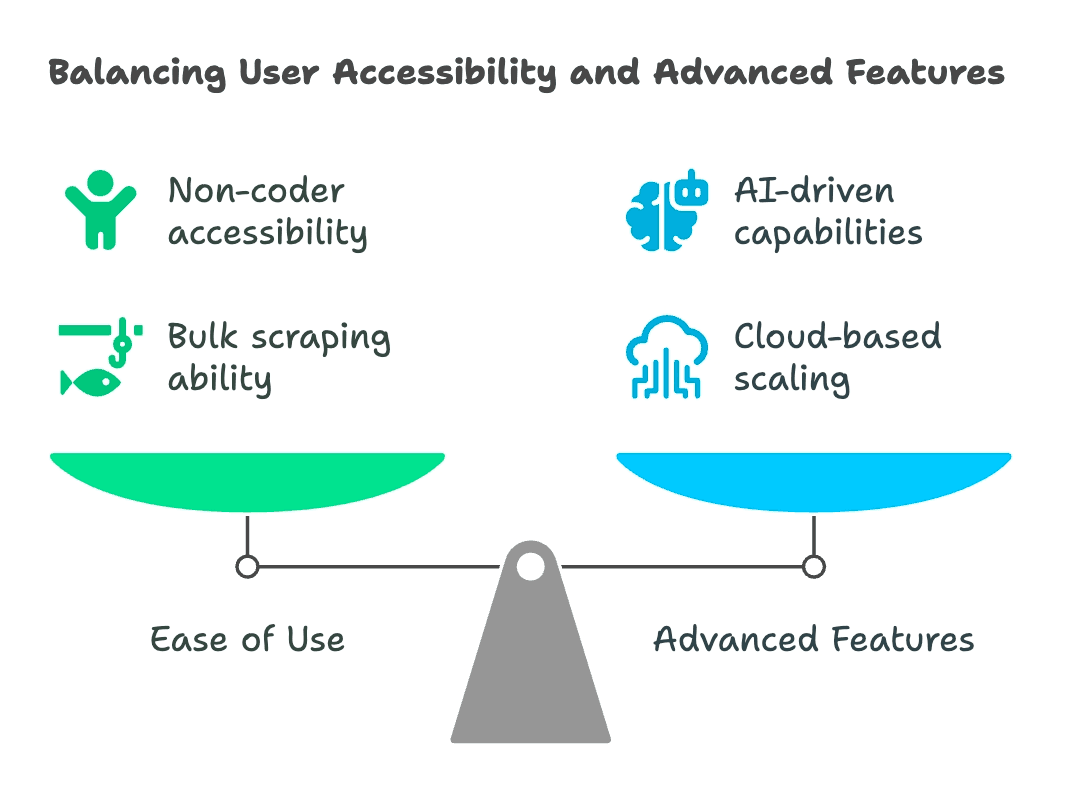

ツールが多すぎると、どのリンク抽出ツールを選ぶべきかは、テックカンファレンスでのスピードデートのように感じられるかもしれません。誰もが「自分こそ本命」と言いますが、実際に期待どおりなのはごく一部です。そこで、私は次の基準で上位12個に絞りました。

- 使いやすさ:正規表現の博士号がなくても、非エンジニアが使えますか?ノーコードやローコードのソリューションは高評価です。

- 一括処理と多層スクレイピング:一度に数百URLを処理できますか?サブページをクロールし、リンクを自動でたどれますか?

- 書き出しと連携:CSV、Excel、Google Sheets、Notion、Airtable、またはAPI経由で出力できますか?手作業が少ないほど良いです。

- 利用者タイプと柔軟性:ビジネスユーザー向け、アナリスト向け、それとも開発者向けですか?誰にでも使えるツールもあれば、特定用途に特化したものもあります。

- 高度な機能:AIによる認識、スケジューリング、クラウドでの大規模実行、データクレンジング、よくあるサイト向けテンプレートなどです。

- 価格と拡張性:無料プラン、従量課金、エンタープライズ向けか。費用に見合う内容かを見ました。

ブラウザ拡張からエンタープライズ向けプラットフォームまで幅広く紹介しているので、個人起業家でもFortune 500のデータチームでも、きっと合うものが見つかるはずです。

Thunderbit:ビジネスユーザーに最適なスマートなリンク抽出ツール

まずは本命から。 は、私が最初におすすめするリンク抽出ツールです。もちろん、私が開発に関わったからというだけではありません。Thunderbitは、成果を素早く出したいビジネスユーザー向けに設計されたです。

Thunderbitの何が優れているのか。まるで、ちゃんと話を聞いてくれるAIインターンがいるようなものです。「このページから商品リンクと価格を全部取って」と自然な言葉で伝えれば、あとはThunderbitのAIが処理します。セレクタをいじったり、スクリプトを書いたりする必要はありません。

それだけでは終わりません。

- 大量URL対応:1件のURLでも数百件のリストでも貼り付ければ、Thunderbitがまとめて処理します。

- サブページ移動:一覧ページからリンクを抽出し、各詳細ページを訪れてさらにURLを取りたいですか?Thunderbitの多層スクレイピングが対応します。

- 構造化エクスポート:リンクを抽出したら、項目名を変更し、分類し、Google Sheets、Notion、Airtable、Excel、CSVへ直接書き出せます。後処理の面倒はもうありません。

Thunderbitは、営業チーム、不動産エージェント、個人運営のECショップなど、世界中で3万人以上のユーザーに利用されています。しかももあり(最大6ページ、トライアル特典で10ページまで抽出可能)、リスクなく試せます。

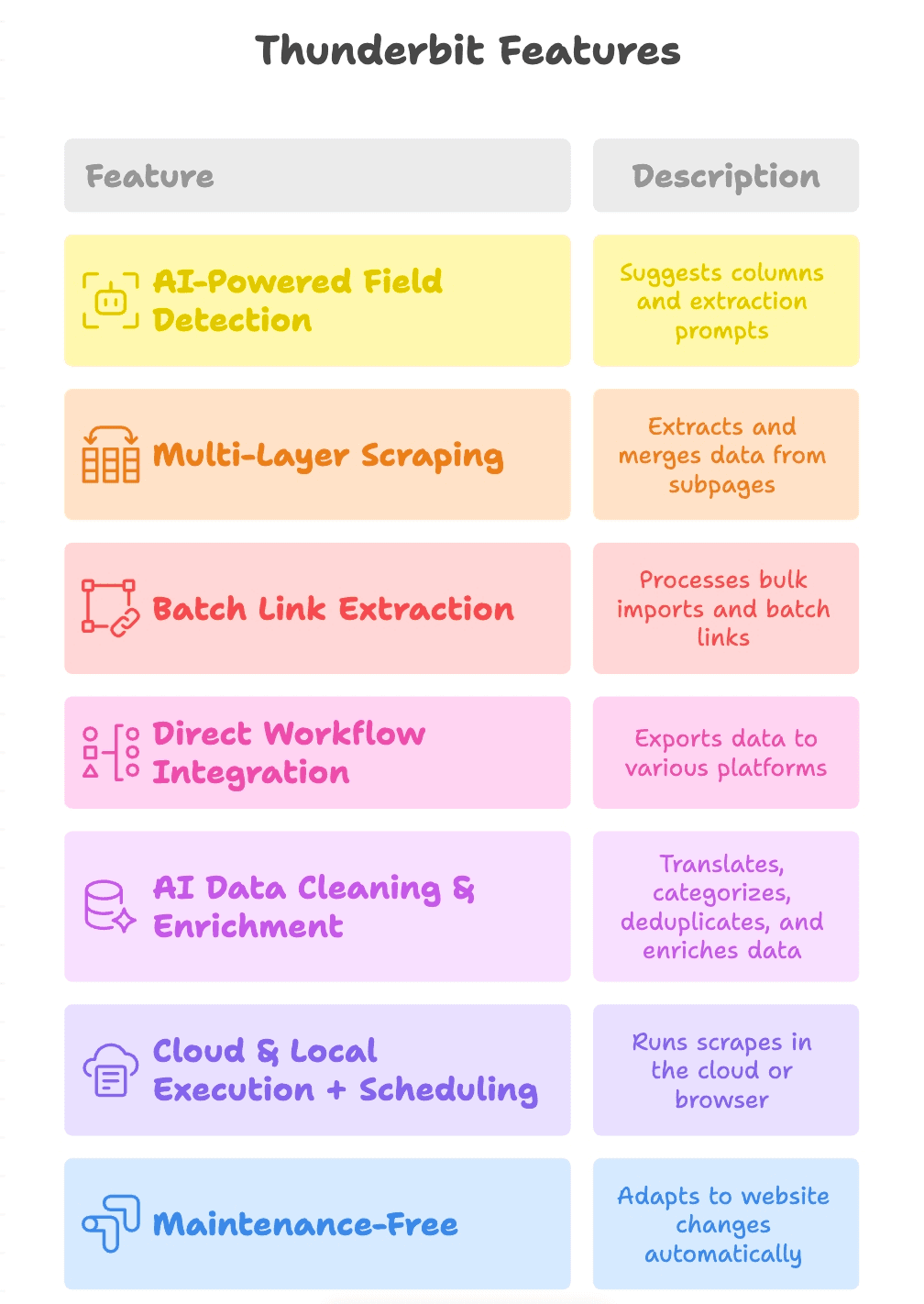

Thunderbitの注目機能

Thunderbitを本当に際立たせている点を見ていきましょう。

- AIによる項目検出:「AIで項目を提案」をクリックするだけで、Thunderbitがページを読み取り、「商品リンク」「PDFのURL」「連絡先メール」などの列を提案し、各項目の抽出プロンプトまで作成します。

- 多層スクレイピング:Thunderbitは、メインページからサブページ(商品詳細ページやPDFダウンロードなど)へリンクをたどり、さらにリンクを抽出して、すべてを1つの表にまとめられます。

- 一括リンク抽出:1ページでも1,000ページでも、Thunderbitなら一括インポートとバッチ処理を簡単にこなせます。

- そのまま使えるワークフロー連携:結果はGoogle Sheets、Notion、Airtableに書き出すか、CSV/Excelでダウンロードできます。データはチームが必要とする場所にそのまま届きます。

- AIによるデータ整形と補強:Thunderbitは抽出しながら翻訳、分類、重複排除、さらにはデータの補強まで行えます。生データのままではなく、すぐ使える状態で出力されます。

- クラウドとローカル実行+スケジューリング:高速処理ならクラウドで、ログインが必要なサイトならブラウザ内で実行できます。定期実行を設定して、データを常に最新に保てます。

- 保守不要:ThunderbitのAIはWebサイトの変更に適応するので、壊れたスクレイパーの修正に時間を取られず、結果を出すことに集中できます。

Octoparse:誰でも使えるノーコードのリンクスクレイパー

は、ノーコード抽出ツールの定番です。Windows/Mac対応のデスクトップアプリで、視覚的なクリック操作ベースのインターフェースを備えています。ページを読み込み、欲しいリンクをクリックすれば、あとはOctoparseが処理してくれます。

- 初心者向け:コーディングは不要です。クリックして、抽出して、終わりです。

- ページネーションと動的コンテンツに対応:「次へ」ボタンのクリック、スクロール、サイトへのログインにも対応できます。

- クラウド抽出とスケジューリング:有料プランならクラウド実行や定期タスクの設定が可能です。

- 出力オプション:CSV、Excel、JSONでのダウンロードや、データベースへの送信ができます。

無料プランは小規模案件には十分寛容で、最大10タスク、月5万行まで使えますが、より大きな用途では有料プラン(月約75ドルから)が必要になります。

Apify:カスタムワークフロー向けの柔軟なURLエクストラクター

は、Webスクレイピングの万能ツールです。事前構築済みの「アクター」(抽出ツール)のマーケットプレイスに加え、JavaScriptやPythonで独自スクリプトを作成することもできます。

- 事前構築とカスタマイズ性:コミュニティ製アクターを一般的な作業に使うことも、自分専用のワークフローを作ることもできます。

- 一括・定期抽出:URLをキューに入れ、並列で実行し、定期的な抽出も設定できます。

- APIファースト:JSON、CSV、Excel、Google Sheetsへ書き出し、データパイプラインと連携できます。

- 従量課金:毎月の無料クレジットの後は、利用量に応じた課金です。

Apifyは、柔軟性と拡張性を求める準技術者チームや開発者に最適です。

Bright Data URL Scraper:エンタープライズ向けの本格的なリンク抽出

は、大規模抽出を必要とする企業向けに作られています。同社のData Collectorには、高負荷ジョブ向けのプリセットURL Scraperが用意されています。

- 圧倒的な大規模処理:数千、数百万ページの抽出に対応し、ブロック回避のための堅牢なプロキシ基盤を備えています。

- プリセットテンプレート:EC、SNS、不動産など向けの完成済みスクレイパーが利用できます。

- エンタープライズ機能:コンプライアンス対応ツール、専門家サポート、高度なブロック対策。

- 価格:10万ページ読み込みで約350ドルから。明らかに大企業向けです。

スタートアップにはやや過剰かもしれませんが、ミッションクリティカルな大量抽出にはBright Dataが非常に強力です。

WebHarvy:クリック操作で使える視覚的リンクエクストラクター

は、内蔵ブラウザ上のリンクをクリックするだけで抽出できるWindows向けデスクトップアプリです。

- とにかく簡単:リンクをクリックすると、WebHarvyが類似要素をすべてハイライトして抽出対象にします。

- 正規表現に対応:よくある作業向けのパターンが内蔵されており、コーディングは不要です。

- Excel、CSV、JSON、XML、SQLへ出力:慣れた形式でデータを扱いたいビジネスユーザーに最適です。

- 買い切りライセンス:一度支払えばずっと使えます。

小規模ビジネス、研究者、あるいはコーディングなしで手早くリンクを取得したい人にぴったりです。

Web Scraper(Chrome拡張):ブラウザ内で手軽にリンク抽出

は、ブラウザをスクレイパーに変える無料のオープンソースツールです。

- サイトマップを定義:どう移動し、何を抽出するかを指定できます。

- ページネーションと多層クロールに対応:カテゴリ、サブカテゴリ、詳細ページをクロールできます。

- CSV/XLSXへ出力:ブラウザから直接データをダウンロードできます。

- コミュニティテンプレート:人気サイト向けの共有サイトマップが豊富です。

ちょっとした単発作業や、予算の限られた学生、小規模チームに最適です。

ScraperAPI:開発者向けの拡張性の高いリンクスクレイパー

は、プロキシ、ブロック、CAPTCHAを気にせずWebページを大規模取得したい開発者向けです。

- API駆動:URLを送ると、HTMLまたは抽出済みデータが返ってきます。

- 大規模処理とボット対策に対応:プロキシローテーション、JSレンダリング、CAPTCHA解決を標準搭載。

- コードと連携:Python、Node.js、その他任意の言語で利用できます。

- 価格:無料枠(約1,000 API呼び出し)の後は、リクエストごとの課金です。

独自クローラーや、大規模でも確実かつ高速に処理したいときに向いています。

ParseHub:高度な選択機能を備えた視覚的リンクスクレイパー

は、Windows、Mac、Linux対応のデスクトップアプリで、視覚的にスクレイピングプロジェクトを構築できます。

- 高度な選択と移動:動的要素や非表示要素からでも、クリック、ループ、条件付き抽出が可能です。

- ネストしたページに対応:カテゴリをクロールし、詳細ページへ進み、さらにリンクを抽出できます。

- CSV、Excel、JSONへ出力:有料プランではクラウド実行とAPI利用も可能です。

- 無料プラン:5プロジェクト、1回あたり最大200ページまで利用できます。

コードなしでパワーを求めるマーケターやリサーチャーに人気です。

Scrapy:開発者向けのPythonリンクエクストラクター

は、完全な制御を求めるPython開発者にとっての定番です。

- コード中心:カスタムスパイダーを作成し、あらゆる規模でリンクをクロール・抽出できます。

- 分散クロールに対応:効率的で非同期、かつ高いカスタマイズ性があります。

- CSV、JSON、XML、データベースへ出力:出力形式は自分で管理できます。

- オープンソースで無料:ただし、実行環境は自分で管理する必要があります。

Pythonに慣れているなら、Scrapyは非常に強力です。

Diffbot:構造化データ向けのAI搭載リンクスクレイパー

は、Webスクレイピングの「AIの頭脳」です。ページを解析し、リンクを含む構造化データを手作業のセットアップなしで返します。

- 自動コンテンツ認識:URLを渡すと、記事、商品、リンクなどの構造化データが返ってきます。

- CrawlbotとKnowledge Graph:サイト全体をクロールしたり、巨大なWebインデックスを検索したりできます。

- API駆動:BIツールやデータパイプラインと連携できます。

- エンタープライズ価格:月額約299ドルからですが、価格に見合う価値があります。

スクレイパー管理なしで、きれいに整った構造化データが欲しい企業に最適です。

Cheerio:Node.js向けの軽量リンクスクレイパー

は、Node.js向けの高速なjQuery風HTMLパーサーです。

- 超高速:HTMLをミリ秒単位で解析します。

- 親しみやすい構文:jQueryを知っていれば、Cheerioもすぐに使えます。

- 静的ページに最適:JSのレンダリングはしませんが、サーバー生成コンテンツにはぴったりです。

- オープンソースで無料:リクエストにはaxiosやfetchと組み合わせて使えます。

速度とシンプルさを重視するカスタムスクリプト開発者に向いています。

Puppeteer:高度なリンク抽出のためのブラウザ自動化ツール

は、ヘッドレスモードでChromeを操作するためのNode.jsライブラリです。

- 完全なブラウザ自動化:ページ読み込み、クリック、スクロール、操作を実ユーザーのように行えます。

- 動的コンテンツとログインに対応:JavaScriptが多いサイトや複雑なワークフローに最適です。

- 細かな制御:要素の待機、スクリーンショット取得、ネットワークリクエストの傍受ができます。

- オープンソースで無料:ただし、リソース消費が大きく、軽量ツールより遅めです。

基本的なスクレイパーでは対応しづらいサイトからリンクを抽出したいときに使いましょう。

一目でわかる比較:どのリンク抽出ツールが合うのか?

12ツールを簡単に比較すると、次のとおりです。

| ツール | 最適な用途 | 大量処理・サブページ対応 | データ出力オプション | 価格 |

|---|---|---|---|---|

| Thunderbit | 非エンジニア、ビジネス | あり(AI、多層) | Excel、CSV、Sheets、Notion、Airtable | 無料トライアル、月額約9ドルから |

| Octoparse | ノーコードユーザー、アナリスト | あり | CSV、Excel、JSON、クラウドストレージ | 無料プラン、月額約75ドルから |

| Apify | 準技術者、開発者 | あり | CSV、JSON、API経由のSheets | 無料クレジット、従量課金 |

| Bright Data | エンタープライズ | あり(大量処理) | CSV、JSON、API経由のNDJSON | 約350ドル/10万ページ |

| WebHarvy | 非エンジニア、デスクトップ | あり | Excel、CSV、JSON、XML、SQL | 有料ライセンス |

| Web Scraper Extension | 誰でも、手早く・無料で | あり | CSV、XLSX | 無料、オープンソース |

| ScraperAPI | 開発者、API利用者 | あり | JSON(API経由のHTML) | 無料1,000リクエスト、有料プランあり |

| ParseHub | 非エンジニア、高度な用途 | あり | CSV、Excel、JSON、API | 無料5プロジェクト、有料プランあり |

| Scrapy | 開発者、Python | あり | CSV、JSON、XML、DB | 無料、オープンソース |

| Diffbot | エンタープライズ、AI | あり(AIクロール) | JSON(API経由の構造化データ) | 月額約299ドル〜 |

| Cheerio | 開発者、Node.js | あり(カスタムコード) | カスタム(JSONなど) | 無料、オープンソース |

| Puppeteer | 開発者、複雑なサイト | あり(完全自動化) | カスタム(スクリプト出力) | 無料、オープンソース |

ビジネスに合うリンクスクレイパーの選び方

では、どう選べばよいのでしょうか。私の早見表はこちらです。

- コーディングスキルがない? Thunderbit、Octoparse、ParseHub、WebHarvy、またはWeb Scraper拡張機能から始めましょう。

- カスタムワークフローが必要? Apify、ScraperAPI、Cheerioは開発者に最適です。

- エンタープライズ規模? Bright DataやDiffbotが向いています。

- PythonまたはNode.js開発者? Scrapy(Python)かCheerio/Puppeteer(Node.js)なら、完全に制御できます。

- SheetsやNotionへ直接書き出したい? Thunderbitが最有力です。

技術的な慣れ、データ量、連携要件に合わせてツールを選びましょう。多くは無料トライアルを用意しているので、気軽に試してみてください。

2026年のリンク抽出でThunderbitが持つ独自の価値

改めて、Thunderbitが本当に違う理由を振り返りましょう。

- AIによるシンプルさ:やりたいことを普通の英語で説明するだけで、あとはThunderbitのAIが処理します。

- 多層スクレイピング:メインページからリンクを抽出し、サブページへ進み、さらにURLを取得する——そのすべてを1つの流れで完結できます。

- 一括インポートとバッチ処理:数百URLを貼り付けて一括抽出し、構造化データをすぐに書き出せます。

- ワークフロー連携:Google Sheets、Notion、Airtableへ直接出力するか、CSV/Excelでダウンロードできます。

- 保守ゼロ:ThunderbitのAIはWebサイトの変更に適応するので、壊れたスクレイパーを延々と直す必要がありません。

Thunderbitは、「ただデータを取る」ことと「実際に使えるデータを得る」ことの間をつなぎます。昔、手作業のデータ業務に埋もれていた頃に欲しかったツールです。

まとめ:リンクをより賢く抽出して、仕事を前に進めよう

Webデータはビジネス成長の燃料です。そして、適切なリンク抽出ツールはそのエンジンです。リードリストの作成、競合監視、調査の自動化など、どんな用途でも、あなたのニーズとスキルに合うツールがここにはあります。

最新のリンク抽出がどんなものか見たいなら、。数クリックでどれだけできるか、きっと驚くはずです。Thunderbitが完璧に合わない場合でも、この一覧の他のツールをいくつか試してみてください。面倒な作業を自動化し、本当に重要なことに集中するには、今がこれまでで最適なタイミングです。

楽しいスクレイピングを。リンクがいつもきれいで、構造化され、すぐ使える状態でありますように。Webスクレイピングをさらに深く学びたい方は、で、ほかのガイドやヒントもぜひご覧ください。

FAQ

1. なぜリンク抽出ツールは必須なのですか?

インターネットトラフィックのほぼ半分がボットによるもので、企業も積極的にデータを収集している今、リンク抽出ツールはWebの混沌を実用的なインサイトに変えるために不可欠です。リード獲得、コンテンツ集約、SEO監査、競合監視といった作業を自動化し、大幅な時間と労力を節約できます。

2. ほかのリンク抽出ツールと比べてThunderbitの強みは何ですか?

ThunderbitはAIで抽出を簡単にします。やりたいことを平易な言葉で伝えるだけで、残りはすべて処理してくれます。大量URL入力、多層スクレイピング、スマートな項目検出、Google SheetsやNotionへのシームレスな書き出しに対応しており、技術的な手間をかけずに強力な結果を求める非エンジニアやビジネスユーザーに最適です。

3. 開発者やカスタムワークフロー向けのリンク抽出ツールはありますか?

はい。Apify、ScraperAPI、Cheerio、Puppeteer、Scrapyのようなツールは開発者向けです。スクリプト作成、API連携、複雑な抽出、超大規模ジョブ、高度な自動化に対応する柔軟性があります。

4. コーディング経験がないユーザーに最適なツールはどれですか?

Thunderbit、Octoparse、ParseHub、WebHarvy、そしてWeb ScraperのChrome拡張機能は、非技術者に最適です。視覚的なインターフェース、事前構築済みテンプレート、AI機能により、誰でもリンク抽出を始めやすくなっています。

5. 自分に合ったリンク抽出ツールはどう選べばよいですか?

技術スキル、データ量、書き出しの要件を考慮してください。非エンジニアはThunderbitやOctoparseのようなツールが向いていますし、開発者はScrapyやPuppeteerを好むかもしれません。エンタープライズでは、Bright DataやDiffbotが大規模運用に適しています。まずは無料トライアルで、自分に最も合うものを試すのがおすすめです。