前四半期、当社のオペレーションチームは、競合データをスプレッドシートにコピペする作業に週40時間も使っていました。今四半期は、20分です。

違いは何か? 自動化されたウェブスクレイパーです。これらは、開発者だけのものから、営業担当やマーケターならランチのついでにセットアップできるものへと進化しました。

私は長年にわたりSaaSや自動化ツールを開発してきました(そう、の共同創業者でもあります)。2026年のツール群はこれまでで最も充実しており、AIネイティブで自己修復型、しかも非技術者にも本当に使いやすいのが特徴です。

ここでは、用途とスキルレベル別に、実際に触って評価した10個をご紹介します。

ビジネスユーザーにとって自動ウェブスクレイパーが重要な理由

率直に言って、ウェブサイトからデータを手作業でコピー&ペーストする時代は終わりました(反復性運動障害と実存的不安が好きなら別ですが)。自動ウェブスクレイパーは、あらゆる規模の企業にとって必須のツールになっています。実際、し、ウェブスクレイピングはその戦略の重要な一部です。

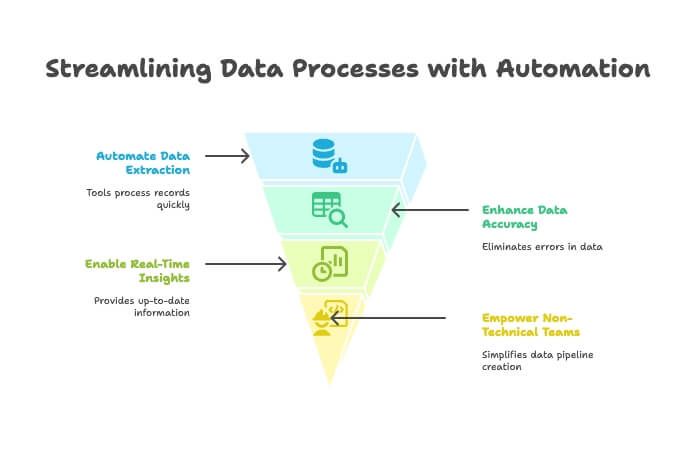

これらのツールが価値を持つ理由は次のとおりです。

- 時間を節約し、手作業を減らせる: 自動スクレイパーは数千件のレコードを数分で処理でき、チームをより価値の高い仕事に集中させられます。あるユーザーは、データ収集を自動化することで「数百時間」を節約できたと報告しています()。

- データ精度が向上する: টাইポや入力漏れがなくなります。自動抽出により、よりクリーンで信頼性の高いデータが得られます。

- 迅速な意思決定を支援する: リアルタイムのデータ取得により、月次のインターン報告を待たずに、競合の監視、価格追跡、リードリスト作成ができます。

- 非技術チームでも使える: ノーコードやAI駆動のツールのおかげで、今では「XPathってヨガのポーズでしょ?」と思っている人でもウェブデータのパイプラインを構築できます()。

のも当然で、約80%が「これなしでは組織は効果的に運営できない」と回答しています。2026年にデータ収集を自動化していないなら、収益もインサイトも取りこぼしている可能性が高いでしょう。

最適な自動ウェブスクレイパーの選び方

ウェブスクレイピングソフトウェア市場はされており、最適なツールを選ぶのは、1万足の中から靴を探すようなものです。そこで、私は次の基準で絞り込みました。

- 使いやすさ: 非開発者でもすぐ始められるか? 学習コストは高すぎないか?

- AI機能: AIでデータ項目を自動検出し、動的サイトに対応し、要件を平易な英語で伝えられるか?

- データ出力と連携: Excel、Google Sheets、Airtable、Notion、CRMへどれだけ簡単に取り込めるか?

- 価格: 無料トライアルはあるか? 有料プランは個人や小規模チームでも手が届くか、それとも企業向けのみか?

- 拡張性: 小規模な単発作業から、大規模で定期的な抽出まで対応できるか?

- 対象ユーザー: ビジネスユーザー向けか、開発者向けか、両方か?

- 独自の強み: 何が他と差別化されているのか?

ここでは、「とりあえずスプレッドシートが欲しい」人から「インターネット全体をクロールしたい」人まで、あらゆるスキルレベル向けのツールを含めています。さっそく見ていきましょう。

1. Thunderbit: 誰でも使えるAI搭載ウェブスクレイパー

まずは、私が最もよく知っているツールから紹介します。というのも、私のチームと私は、長年ビジネスユーザーが直面してきたまさにその悩みを解決するためにこれを作ったからです。は、よくある「ドラッグ&ドロップ型」や「自分でセレクタを書く」タイプのスクレイパーではありません。欲しいものを説明するだけで、あとはAIが重労働を引き受けてくれるデータアシスタントです。コード不要、XPathの調整不要、面倒もありません。

Thunderbitが最上位に来る理由

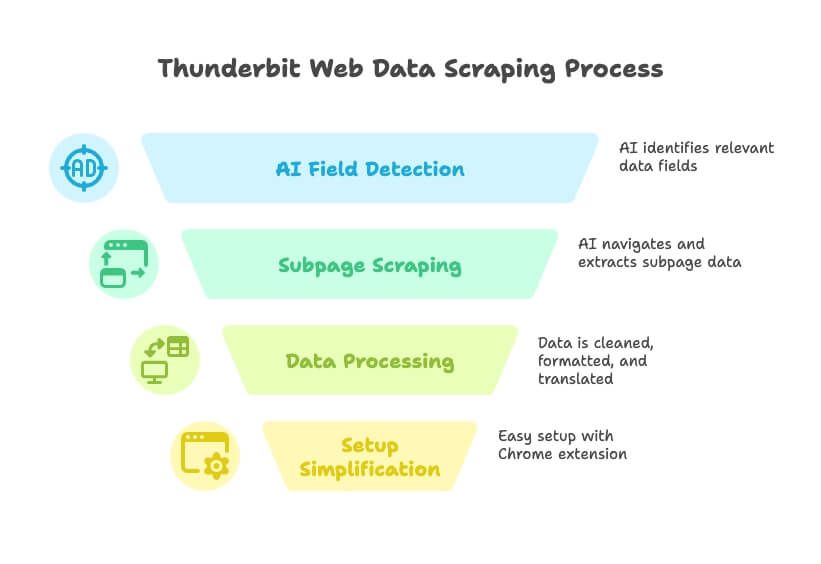

Thunderbitは、私が見てきた中で「どんなウェブサイトでもデータベース化する」に最も近い存在です。仕組みは次のとおりです。

- 自然言語で操作できる: 必要なデータをThunderbitに伝えるだけです(「このディレクトリから会社名、メールアドレス、電話番号を全部欲しい」など)。するとAIが関連する項目を自動検出します。

- AIによる項目提案: 1クリックでThunderbitがページを読み取り、抽出すべき最適な列を提案します。もう推測や試行錯誤は不要です。

- サブページ&多層スクレイピング: 各一覧の詳細ページから情報を取得したい? Thunderbitならページをたどって追加情報を取得し、表に追記できます。

- データのクレンジング、翻訳、分類: Thunderbitは生データを取るだけではありません。スクレイピングしながら、整形、翻訳、さらには分類までできます。

- セットアップが簡単: を入れて、「AIで項目を提案」をクリックするだけ。1分以内にスクレイピングを始められます。

- 無料トライアル&低価格: 太っ腹な無料枠(最大6ページまで無料)に加え、有料プランは月額9ドルから。私が1週間でコーヒーに使う金額より安いです。

Thunderbitは、迅速にデータが必要な営業、マーケティング、オペレーションチーム向けに作られています。コーディング不要、プラグイン不要、トレーニング不要。まるで、ちゃんと話を聞いて文句を言わないデータインターンがいるようなものです。

Thunderbitの際立った機能

- AI駆動のスクレイピング: AIがページ構造を理解し、レイアウト変更に適応し、ページネーションやサブページも自動で処理します()。

- 即時データ出力: 結果をExcel、Google Sheets、Airtable、Notionへ直接送信したり、CSV/JSONとしてダウンロードしたりできます。

- クラウド実行とローカル実行: 高速かつ大規模に処理したい場合はクラウドで、ログイン中のセッションを使いたい場合はブラウザで実行できます。

- 定期スクレイピング: 繰り返し実行するジョブを設定してデータを常に最新に保てます。価格監視や定期的なリード更新に最適です。

- 保守不要: ThunderbitのAIはウェブサイトの変更に適応するため、壊れたスクレイパーを直す時間を大幅に減らせます()。

こんな人におすすめ: 「このデータが欲しい」から「はい、スプレッドシートです」までを数分で実現したい人、特に非技術者です。と4.9★の評価を獲得しているThunderbitは、今や手間ではなく成果を求めるビジネスチームの定番になりつつあります。

動作を見てみたい方は、や、をぜひご覧ください。

2. Clay: データ拡充とウェブスクレイピングを統合した自動化ツール

Clayは、成長チーム向けのスイスアーミーナイフのような存在です。単なるウェブスクレイパーではなく、Apollo、LinkedIn、Crunchbaseなど50以上のライブデータソースと連携する自動化スプレッドシートで、組み込みAIを使ってリードを拡充し、営業メールを作成し、見込み客をスコアリングします。

- ワークフロー自動化: 各行がリード、各列がデータ取得やアクションのトリガーになります。会社リストをスクレイピングし、LinkedInプロフィールで拡充し、パーソナライズメールを送る? Clayならできます。

- AI統合: GPT-4を使ってアイスブレイク用の文面作成、プロフィール要約などを行えます。

- 連携: HubSpot、Salesforce、Gmail、Slackなどとネイティブ連携します。

- 価格: プロ向けプランは月額99ドル前後からで、軽めの利用には無料トライアルがあります。

最適な用途: アウトバウンド営業、グロースハック、マーケター向け。スクレイピング、データ拡充、アウトリーチを1か所でまとめて行いたいカスタムリードパイプラインの構築に向いています。強力ですが、自動化ツールが初めてだと学習コストはあります()。

3. Bardeen: ワークフロー自動化向けのブラウザベースウェブスクレイパー

Bardeenは、Chrome拡張機能からデータを取得し、繰り返しのWeb作業を自動化してくれるブラウザロボットのようなものです。

- ノーコード自動化: スクレイピング、フォーム入力、アプリ間のデータ移動などに使える500以上の「Playbook」があります。

- AIコマンドビルダー: 平易な英語で作業内容を伝えるだけで、Bardeenがワークフローを組み立てます。

- 連携: Notion、Trello、Slack、Salesforce、その他100以上のアプリと連携します。

- 価格: 軽めの利用なら無料(毎月100自動化クレジット)、チーム向けの有料プランは月額99ドルからです。

最適な用途: 複数アプリにまたがるスクレイピングと後続アクションを自動化したいパワーユーザーやGTMチーム向けです。柔軟性は高い一方、初心者にはやや学習曲線が急に感じられるかもしれません()。

4. Bright Data: 企業向けの自動ウェブスクレイピングツール

Bright Data(旧Luminati)は、ウェブスクレイピング界の重機です。グローバルなプロキシネットワーク、高度なAPI、1日に数千ページをクロールできる能力を備えています。

- 企業規模に対応: 1億以上のIP、Web Scraper IDE、ボット対策を回避するWeb Unlockerを提供します。

- カスタマイズ可能: 高い信頼性で、複雑かつ大規模な抽出を構築できます。

- 価格: Web Scraper IDEは月額499ドルからで、より小規模な「micro」パッケージも用意されています。

最適な用途: 大企業、データアグリゲーター、高度なユーザー向け。毎日数千ページをクロールし、IPブロックを避ける必要があるなら、Bright Dataはそのために作られています()。

5. Octoparse: 中級者向けのビジュアル型ウェブスクレイパー

Octoparseは、視覚的なポイント&クリック操作で使える人気のノーコードツールです。プログラミングなしで高機能を使いたい人に最適です。

- ドラッグ&ドロップUI: 要素をクリックして抽出対象を定義し、ログイン、ページネーションなどに対応できます。

- テンプレート: Amazon、Twitterなど一般的なサイト向けの既製テンプレートが500以上あります。

- クラウドスクレイピング: Octoparseのサーバー上でジョブを実行し、抽出をスケジュールし、IPローテーションも使えます。

- 価格: 制限付きの無料プランがあり、有料プランは月額119ドルからです。

最適な用途: コードを書かずに高性能なスクレイパーを使いたい、非プログラマーやデータアナリスト向けです。価格監視、商品一覧、リサーチ案件に向いています()。

6. : ビジネス向けデータスクレイピングプラットフォーム

は、ウェブスクレイピングの老舗のひとつで、現在は本格的なデータ抽出プラットフォームへと進化しています。

- ポイント&クリック抽出: ログイン、ドロップダウン、インタラクティブ要素に対応します。

- クラウドベース: 数千のURLを同時に処理し、抽出をスケジュールし、APIにアクセスできます。

- 企業向け: 価格監視、市場調査、機械学習用データセットの構築に使われています。

- 価格: Starterは月額199ドル、Standardは月額599ドル、Advancedは月額1,099ドルです。

最適な用途: 大規模案件に対して信頼性が高く、保守されたソリューションを必要とする中堅〜大企業やデータチーム向けです。趣味レベルのプロジェクトにはやや大げさかもしれませんが、ビジネス規模の要件には非常に強力です()。

7. Parsehub: ビジュアルエディタ付きの柔軟なウェブスクレイパー

Parsehubは、デスクトップアプリ(Windows、Mac、Linux)で、ウェブサイトの画面をクリックしながらスクレイパーを構築できるツールです。

- ビジュアルワークフロー: 要素を選択し、抽出ルールを設定し、ログイン、ドロップダウン、無限スクロールに対応できます。

- クラウド機能: クラウドでスクレイプを実行し、ジョブをスケジュールし、APIも利用できます。

- 価格: 小規模ジョブ向けの無料枠があり、有料プランは月額149ドルからです。

最適な用途: ブラウザ拡張機能以上の制御は欲しいが、自作スクレイパーをコードで書くほどではない研究者、中小企業、個人向けです()。

8. Common Crawl: AIと研究のためのオープンなウェブデータ

Common Crawlは、従来の意味でのツールではありません。毎月更新される、巨大なオープンウェブクロールデータセットです。

- 規模: 約400TBのウェブデータで、数十億ページをカバーしています。

- 無料かつオープン: 自分でクローラーを動かす必要はありません。

- 技術スキルが必要: データを絞り込み、解析するにはビッグデータツールとある程度のエンジニアリング知識が必要です。

最適な用途: AIモデルの構築や大規模研究を行うデータサイエンティスト、エンジニア向けです。一般的なウェブテキストや長期アーカイブが必要なら、まさに宝の山です()。

9. Crawly: スタートアップ向けの軽量自動ウェブスクレイピングツール

Crawly(Diffbot製)は、クラウドベースのAI搭載クローラーで、数百万のウェブサイトからデータを取得し、構造化された結果を返します。解析ルールは不要です。

- AI抽出: コンピュータービジョンとNLPを使ってコンテンツを識別・抽出します。

- APIアクセス: 収集したデータを問い合わせたり、分析基盤やデータベースと連携したりできます。

- 価格: 企業向け価格。詳細は問い合わせが必要です。

最適な用途: 自社でスクレイパーを作らずに、大規模でインテリジェントなウェブデータ抽出を必要とする、ある程度技術に強いスタートアップやチーム向けです()。

10. Apify: マーケットプレイス付きの開発者向けウェブスクレイパー

Apifyは、自作スクレイパー(「Actor」)を構築できるクラウドプラットフォームであり、あらかじめ用意されたコミュニティ製スクレイパーのライブラリも利用できます。

- 開発者向けの柔軟性: JavaScript/Pythonベースのスクレイピング、ヘッドレスChrome、プロキシ管理、スケジューリングをサポートします。

- マーケットプレイス: よくあるサイト向けの既製スクレイパーが豊富にそろっています。

- 価格: 月5ドル分のクレジットが含まれる無料枠があり、有料プランは月額49ドルからです。

最適な用途: 完全な制御と拡張性を求める開発者や技術に強いアナリスト向けです。非エンジニアでも、よくある作業には既製のActorを使えます()。

自動ウェブスクレイピングツール比較表

| ツール | 使いやすさ | AI機能 | 価格(開始時) | 対象ユーザー | 独自の強み |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | 自然言語、AIで項目提案、サブページスクレイピング | 月額9ドル | 非技術系のビジネスユーザー | 2クリックで設定、コード不要、即時出力、無料トライアル |

| Clay | ★★★★☆ | AIによるデータ拡充、GPT-4 | 月額99ドル | グロース/営業オペレーション | 自動化スプレッドシート、データ拡充、アウトリーチ |

| Bardeen | ★★★★☆ | AIコマンドビルダー | 月額99ドル | パワーユーザー、GTMチーム | ブラウザRPA、500以上のPlaybook、深い連携 |

| Bright Data | ★★☆☆☆ | プロキシローテーション、ボット対策AI | 月額499ドル | 企業、開発者 | 大規模処理、信頼性、グローバルプロキシ |

| Octoparse | ★★★★☆ | ビジュアルAI検出 | 月額119ドル | アナリスト、ノーコーダー | ドラッグ&ドロップ、テンプレート、クラウドスクレイピング |

| Import.io | ★★★☆☆ | インタラクティブ抽出 | 月額199ドル | 企業、データチーム | 同時処理、スケジューリング、API、サポート |

| Parsehub | ★★★★☆ | ビジュアルワークフロー | 月額149ドル | 研究者、中小企業 | デスクトップアプリ、動的サイト対応 |

| Common Crawl | ★☆☆☆☆ | なし(データセットのみ) | 無料 | データサイエンティスト、エンジニア | 巨大なオープンデータセット、ウェブ規模のアーカイブ |

| Crawly | ★★☆☆☆ | AI抽出 | カスタム/企業向け | スタートアップ、技術チーム | AI搭載、解析ルール不要、APIアクセス |

| Apify | ★★★★☆ | Actorマーケットプレイス | 月額49ドル | 開発者、技術系アナリスト | 構築/マーケットプレイス、クラウド自動化、柔軟性 |

ニーズに合ったウェブスクレイパーの選び方

最適な自動ウェブスクレイピングツールは、チームの規模、技術力、ビジネス目標によって変わります。簡単に整理すると、次のとおりです。

- 非技術者向け(営業、マーケティング、オペレーション): がおすすめです。あなた向けに作られており、コードもセットアップも不要で、すぐに結果が得られます。リード獲得、価格監視、簡単なデータ案件に最適です。

- 自動化を重視するチーム向け: スクレイピングとデータ拡充、アウトリーチ、ワークフロー自動化を組み合わせたいなら、ClayとBardeenが光ります。

- 企業や開発者向け: Bright Data、、Apifyは、大規模で高度にカスタマイズ可能なプロジェクトに最適です。

- 研究者やアナリスト向け: OctoparseとParsehubは、コーディング不要で使えるビジュアルUIと強力な機能を提供します。

- AIとデータサイエンス向け: Common CrawlとCrawlyは、大規模データセットとAI搭載抽出を提供し、モデル構築や学習に向いています。

自問してみてください。数分で始めたいのか、それとも企業向けのカスタムソリューションを作りたいのか? 迷うなら、まずは無料トライアルから始めましょう。ほとんどのツールに用意されています。

Thunderbitの独自価値: ビジネスデータのためのAIアシスタント

これらのツールの中でも、Thunderbitはウェブスクレイピングとデータ変換のための「AIアシスタント」として本当に機能する、唯一の存在です。単にデータを取得するだけではなく、雑然としたウェブサイトを、技術的なハードルゼロで、クリーンで構造化されたインサイトへと変えることに価値があります。

- 自然言語インターフェース: 欲しいものを平易な日本語で説明するだけで、あとはThunderbitが処理します。

- 完全なワークフロー自動化: 抽出からクレンジング、翻訳、出力まで、Thunderbitが全工程をカバーします。

- 素早い検証に最適: 新規市場の検証、リードリストの作成、競合監視が必要ですか? Thunderbitは最速かつ低コストの出発点です。

まるで、ブラウザにデータアナリストが組み込まれているようなものです。昇給を求めず、休暇も取らないアナリストです。

結論: 適切な自動ウェブスクレイピングツールで、より賢く始めよう

2026年のスクレイピング環境は、2年前とは別物です。自己修復するAIスクレイパー、LLMネイティブのパイプライン、本当に使いやすいノーコードツールがゲームを変えました。ひとり起業家でも、少数精鋭の営業チームでも、企業のデータサイエンティストでも、この一覧の中にあなたに合うツールがあります。大切なのは、ワークフローとスキルに合ったプラットフォームを選び、コードとの格闘をやめて、インサイトを引き出し始めることです。

手作業のコピペをやめて、より賢く始めたいなら、して、ウェブスクレイピングの簡単さを体感してください。あるいは、上の選択肢を目標に応じて比較してみてもいいでしょう。どちらにせよ、データドリブンなビジネスの未来は、自動化する人のものです。

もっと詳しく知りたいですか? で、深掘り解説、チュートリアル、ウェブデータを最大限活用するためのヒントをご覧ください。楽しくスクレイピングしましょう。そして、データは常にクリーンで、スクレイパーは決して壊れないように(もし壊れても、AIに任せましょう)。

よくある質問

1. 2026年において、なぜ自動ウェブスクレイピングツールがビジネスユーザーにとって重要なのですか?

自動ウェブスクレイピングツールはデータ収集を効率化し、時間を節約し、手作業を減らします。データ精度を高め、リアルタイムの意思決定を支援し、非技術チームでもコードを書かずにウェブデータを抽出・活用できるようにします。今では、営業、マーケティング、オペレーションの各業務にとって不可欠です。

2. Thunderbitは他のウェブスクレイピングツールと何が違うのですか?

Thunderbitは、欲しいデータを平易な日本語で説明できるようAIを活用しています。データ項目を自動検出し、サブページやページネーションにも対応し、結果をExcelやAirtableなどへ即座に出力できます。非技術者向けに設計されており、データのクレンジングや定期スクレイピングといった強力な機能を低価格で提供します。

3. 大規模な企業向けスクレイピング案件には、どのツールが最適ですか?

Bright Dataとが企業利用に最適です。プロキシローテーション、ボット対策、大規模同時処理、APIアクセスなどの機能があり、数千ページを信頼性高く、大規模に処理する必要がある組織に向いています。

4. スクレイピングと自動化、アウトリーチを組み合わせられるツールはありますか?

はい。ClayやBardeenのようなツールは、ウェブデータを取得するだけでなく、ワークフローに組み込めます。Clayはリードを拡充してアウトリーチを自動化し、BardeenはAI駆動のPlaybookを使ってブラウザベースの作業やワークフローを自動化できます。

5. 技術的なバックグラウンドがないユーザーに最適な選択肢は何ですか?

Thunderbitは、自然言語インターフェース、AI駆動のセットアップ、使いやすさの面で非技術者に最適です。コーディングもセットアップも不要で、技術的な複雑さなしに素早く信頼できるデータが必要なビジネスユーザーに向いています。