2015年当時、スクレイピングといえば、開発者にPythonスクリプトを書いてもらうか、週末を使ってXPathを覚えるか、そのどちらかでした。2026年の今なら、「商品名と価格を全部取って」と入力するだけで、あとはAIがやってくれます。

この変化は、一気に起きました。現在ではがウェブスクレイピングを活用しています。市場規模はに達し、2030年までに倍増する見通しです。

この流れを後押ししている最大の要因は、AIウェブクローラーです。レイアウト変更にも適応でき、HTMLタグだけでなくページ内容そのものを理解し、しかもコードを書いたことのない人でも使えます。

私はここ数か月で15製品を試しました。そこで見えてきたことを、ここでまとめます。もちろん、共同創業者であるThunderbitがなぜ1位になったのかも、率直にお伝えします。

なぜAIがWebページのスクレイピングを変えるのか:新時代のWebスクレイパーツール

正直に言うと、従来のウェブスクレイピングは一般的なビジネスユーザー向けには作られていませんでした。コードやセレクターを扱い、次にサイトのレイアウトが変わってもスクリプトが壊れないことを祈る。そんな世界です。しかしAIとLLMは、その常識をひっくり返しました。

仕組みはこんな感じです。

- 自然言語で指示できる: コードを触る代わりに、欲しいものをAIに伝えるだけです。のようなツールは、平易な英語の指示を解釈して抽出設定まで行ってくれます()。

- 適応学習: AIスクレイパーはWebサイトのできるので、保守の手間が減ります。

- 動的コンテンツへの対応: 最近のサイトはJavaScriptや無限スクロールが当たり前です。AI搭載ツールはこうした要素も操作できるため、従来型スクレイパーでは取り逃しがちなデータも取得できます。

- AIパースによる構造化出力: LLMベースのスクレイパーはページ内容を実際にし、きれいに構造化されたデータとして出力します。

- 自動のボット対策回避: AIスクレイパーはし、プロキシやヘッドレスブラウザを使ってIPブロックを避けられます。

- 統合されたデータワークフロー: 優れたツールはデータを取ってくるだけではありません。Google Sheets、Airtable、Notionなどへワンクリックでエクスポートし、必要な場所まで届けます()。

その結果、ウェブスクレイピングは、もはやクリック操作ベース、あるいはチャット感覚の体験になりました。開発者だけでなく、営業、マーケティング、オペレーション担当者も、直接ウェブデータを活用できるようになっています。

2026年に注目すべきAIウェブクローラー15選

まずはThunderbitから、上位15製品を見ていきましょう。それぞれの主な機能、対象ユーザー、価格、そして何が優れているのかを整理します。もちろん、どこが強みで、どこはそうでもないのかも、率直にお伝えします。

1. Thunderbit:誰でも使えるAIウェブスクレイパー

少しひいき目が入っているのは認めますが、Thunderbitは私が何年も前に欲しかったAIウェブスクレイパーです。このリストで1位にした理由は、次の通りです。

- 自然言語で抽出できる: Thunderbitとは“会話”する感覚です。欲しいデータを「このページの商品名と価格をすべて抽出して」のように伝えるだけで、あとはAIが処理します()。コードもセレクターも不要で、ストレスもありません。

- サブページ・多階層クロール: Thunderbitはできます。たとえば、商品一覧を取得したあと、各商品ページに入って詳細を取る、といった処理を一気に行えます。

- 即座に構造化出力: AIがし、適切な項目の提案、形式の正規化、テキストの要約や分類まで行います。

- 幅広いソースに対応: ThunderbitはHTML専用ではありません。内蔵のOCRとビジョンAIを使って、PDFや画像からも抽出できます()。

- 業務ツールとの連携: Google Sheets、Airtable、Notion、Excelへワンクリックでエクスポートできます()。スクレイピングをスケジュールし、データをそのままチームの業務フローへ流し込めます。

- テンプレートを事前搭載: Amazon、LinkedIn、Zillowなどのサイト向けに、Thunderbitはを提供しており、ワンクリックでデータを抽出できます。

- 使いやすく、導入しやすい: 直感的なアシスタントを備えたクリック操作中心のUIで、ユーザーは数分で使い始められると評価しています。

Thunderbitは、Accenture、Grammarly、Pumaなどのチームを含むから信頼されています。営業チームはこれを使ってし、不動産エージェントは物件一覧を集約し、マーケターは競合を監視しています。しかも、コードは一行も書いていません。

価格: があります(月100ステップまで抽出可能)。有料プランは月額14.99ドルから。上位プランでも、個人や小規模チームにとって十分手頃です。

Thunderbitは、私が見てきた中で“ウェブをデータベースに変える”に最も近い存在です。そして、エンジニアだけでなく、誰でも使えるように作られています。

2. Crawl4AI

対象ユーザー: カスタムパイプラインを構築する開発者や技術チーム。

Crawl4AIは、速度と大規模クロールに最適化されたオープンソースのPythonベースフレームワークで、に設計されています。非常に高速で、動的コンテンツ向けのヘッドレスブラウザをサポートし、抽出データをAIワークフローに流し込みやすい形に整えられます。

- 最適: 強力で自由度の高いクロールエンジンが必要な開発者。

- 価格: 無料(MITライセンス)。自分でホストして運用する必要があります。

3. ScrapeGraphAI

対象ユーザー: AIエージェントや複雑なデータパイプラインを構築する開発者やアナリスト。

ScrapeGraphAIは、プロンプト駆動のオープンソースPythonライブラリで、LLMを使ってWebサイトを構造化データの“グラフ”に変換します。「最初の5ページから商品名、価格、評価をすべて抽出して」のようなプロンプトを書けば、スクレイピングのワークフローを組み立ててくれます()。

- 最適: 柔軟でプロンプトベースのスクレイピングを求める技術者。

- 価格: オープンソースライブラリは無料。クラウドAPIは月額20ドルから。

4. Firecrawl

対象ユーザー: AIエージェントや大規模データパイプラインを構築する開発者。

Firecrawlは、サイト全体を“LLM対応”データに変換する、AI中心のクロールプラットフォーム兼APIです()。MarkdownまたはJSONで出力し、動的コンテンツに対応し、LangChainやLlamaIndexのようなフレームワークとも連携できます。

- 最適: ライブのWebデータをAIモデルに流し込みたい開発者。

- 価格: オープンソースのコアは無料。クラウドプランは月額19ドルから。

5. Browse AI

対象ユーザー: ビジネスユーザー、グロースハッカー、アナリスト。

Browse AIは、を備えたノーコードプラットフォームです。欲しいデータをクリックして“ロボット”を訓練すると、AIがそのパターンを一般化して次回以降のスクレイピングに活かします。ログイン処理、無限スクロール、サイト変更の監視にも対応します。

- 最適: データ収集と監視を自動化したい非エンジニア。

- 価格: 無料プラン(月50クレジット)。有料プランは月額19ドルから。

6. LLM Scraper

対象ユーザー: パースをAIに任せたい開発者。

LLM ScraperはオープンソースのJavaScript/TypeScriptライブラリで、し、LLMに任せて任意のWebページからそのデータを抽出できます。Playwright上に構築されており、複数のLLMプロバイダーに対応し、再利用可能なコードを生成することもできます。

- 最適: LLMを使って任意のWebページを構造化データに変えたい開発者。

- 価格: 無料(MITライセンス)。

7. Reader(Jina Reader)

対象ユーザー: LLMアプリ、チャットボット、要約ツールを構築する開発者。

Jina Readerは、Webページ(さらにPDFや画像まで)からし、LLM対応のMarkdownまたはJSONを返すAPIです。独自のAIモデルで動作し、画像にキャプションを付けることもできます。

- 最適: LLMやQ&Aシステム向けに、読みやすいクリーンなコンテンツを取得したい場合。

- 価格: 無料API(基本利用はキー不要)。

8. Bright Data

対象ユーザー: 大規模運用、コンプライアンス、信頼性を求める企業やプロユーザー。

Bright Dataは、巨大なプロキシネットワークとを備えた、Webデータ業界の大手です。既製スクレイパー、汎用Web Scraper API、そして“LLM対応”データフィードを提供しています。

- 最適: 大規模で安定したWebデータが必要な組織。

- 価格: 従量課金のプレミアム。無料トライアルあり。

9. Octoparse

対象ユーザー: 非技術者から中級者。

Octoparseは、とAIによる自動検出機能を備えた、定評あるノーコードツールです。ログイン、無限スクロールに対応し、さまざまな形式でデータをエクスポートできます。

- 最適: アナリスト、中小企業の経営者、研究者。

- 価格: 無料プランあり。有料プランは月額119ドルから。

10. Apify

対象ユーザー: カスタムスクレイピングや自動化が必要な開発者や技術チーム。

Apifyは、スクレイピングスクリプト("actors")を実行するためのクラウドプラットフォームで、も提供しています。拡張性が高く、AIとの連携やプロキシ管理にも対応します。

- 最適: カスタムスクリプトをクラウドで実行したい開発者。

- 価格: 無料プランあり。従量課金の有料プランは月額49ドルから。

11. Zyte(Scrapy Cloud)

対象ユーザー: エンタープライズ級のスクレイピングが必要な開発者や企業。

ZyteはScrapyの開発元で、クラウドプラットフォームとを提供しています。スケジューリング、プロキシ、大規模案件を処理できます。

- 最適: 長期のスクレイピング案件を運用する開発チーム。

- 価格: 無料トライアルから、個別見積もりのエンタープライズプランまで。

12. Webscraper.io

対象ユーザー: 初心者、ジャーナリスト、研究者。

は、クリック操作でデータを抽出できるです。シンプルで、ローカル利用は無料。大規模な作業向けにはクラウドサービスも用意されています。

- 最適: すぐ終わる単発のスクレイピング作業。

- 価格: 拡張機能は無料。クラウドプランは月額約50ドルから。

13. ParseHub

対象ユーザー: 基本ツール以上の機能を求める非技術者。

ParseHubはデスクトップアプリで、地図やフォームを含む動的コンテンツをスクレイピングできるビジュアルワークフローを備えています。プロジェクトはクラウドで実行でき、APIも提供されています。

- 最適: デジタルマーケター、アナリスト、ジャーナリスト。

- 価格: 無料プラン(1回200ページ)。有料プランは月額189ドルから。

14. Diffbot

対象ユーザー: 大規模な構造化Webデータを必要とする企業やAI企業。

DiffbotはコンピュータービジョンとNLPを使って、任意のWebページからし、記事、商品、巨大なナレッジグラフ向けのAPIを提供しています。

- 最適: 市場インテリジェンス、金融、AI学習データ。

- 価格: プレミアム。月額約299ドルから。

15. DataMiner

対象ユーザー: 非技術者、特に営業、マーケティング、ジャーナリズム分野。

DataMinerは、手早くクリック操作でWebデータを抽出できるです。あらかじめ用意された「レシピ」のライブラリがあり、Google Sheetsへ直接エクスポートできます。

- 最適: 表やリストをスプレッドシートに出力するような素早い作業。

- 価格: 無料プラン(1日500ページ)。Proは月額約19ドルから。

上位AIウェブスクレイパーツールの比較:どれがあなたに合うか?

以下は、選定の参考になる簡易比較です。

| ツール | AI/LLMの活用 | 使いやすさ | 出力/連携 | 最適な用途 | 価格 |

|---|---|---|---|---|---|

| Thunderbit | 自然言語UI。AIが項目を提案 | 最も簡単(ノーコードチャット) | Sheets、Airtable、Notionへ出力 | 非技術系チーム | 無料プランあり。Proは約30ドル/月 |

| Crawl4AI | AI対応クロール。LLM連携可 | 難しい(Pythonで記述) | ライブラリ/CLI。コードで連携 | 高速なAIデータパイプラインが必要な開発者 | 無料 |

| ScrapeGraphAI | LLMプロンプトでスクレイピングパイプライン | 中程度(ある程度のコーディングまたはAPI利用) | API/SDK。JSON出力 | AIエージェントを作る開発者/アナリスト | 無料OSS。APIは月20ドル〜 |

| Firecrawl | LLM対応のMarkdown/JSONへクロール | 中程度(API/SDK利用) | Py、NodeなどのSDK。LangChain連携 | ライブWebデータをAIに統合したい開発者 | 無料+有料クラウド |

| Browse AI | AI支援のクリック操作型 | 簡単(ノーコード) | 7,000以上のアプリ連携(Zapier) | Web監視を自動化したい非技術者 | 無料50回。有料は月19ドル〜 |

| LLM Scraper | LLMでページをスキーマにパース | 難しい(TS/JSで記述) | コードライブラリ。JSON出力 | AIにパースを任せたい開発者 | 無料(自分のLLM APIを使用) |

| Reader (Jina) | AIモデルがテキスト/JSONを抽出 | 簡単(シンプルなAPI呼び出し) | REST APIがMarkdown/JSONを返す | Web検索/コンテンツをLLMに追加する開発者 | 無料API |

| Bright Data | AI強化スクレイピングAPI。大規模プロキシ網 | 難しい(API、技術者向け) | API/SDK。データストリームまたはデータセット | エンタープライズ規模 | 従量課金 |

| Octoparse | AIによるリスト自動検出 | 中程度(ノーコードアプリ) | CSV/Excel、結果用API | 中級ユーザー | 無料制限あり。有料は59〜166ドル/月 |

| Apify | 一部AI機能(Actors、AIチュートリアル) | 難しい(コードでスクリプト作成) | 高機能API。LangChainと連携 | クラウドでカスタムスクレイピングしたい開発者 | 無料プラン。従量課金 |

| Zyte (Scrapy) | MLベースの自動抽出。Scrapyフレームワーク | 難しい(Pythonで記述) | API、Scrapy Cloud UI。JSON/CSV | 開発チーム、長期案件 | 個別価格設定 |

| Webscraper.io | AIなし(手動テンプレート) | 簡単(ブラウザ拡張) | CSVダウンロード、Cloud API | 初心者、短時間の単発スクレイピング | 拡張機能は無料。Cloudは約50ドル/月 |

| ParseHub | 明示的なLLMなし。ビジュアルビルダー | 中程度(ノーコードアプリ) | JSON/CSV。クラウド実行用API | 複雑なサイトをスクレイピングする非開発者 | 200ページ無料。有料は189ドル/月〜 |

| Diffbot | どのページでも使えるAIビジョン/NLP。ナレッジグラフ | 簡単(API呼び出しのみ) | API(Article/Prod/...)+Knowledge Graph検索 | エンタープライズ、構造化Webデータ | 月299ドル前後から |

| DataMiner | LLMなし。コミュニティレシピ | 最も簡単(ブラウザUI) | Excel/CSV出力。Google Sheets | スプレッドシートに出したい非技術者 | 無料制限あり。Proは約19ドル/月 |

ツールのカテゴリ:開発者向けの高機能ツールから、ビジネス向けのWebスクレイパーまで

この一覧を整理するために、いくつかのカテゴリに分けてみましょう。

1. 開発者向け・オープンソースの高機能ツール

- 例: Crawl4AI、LLM Scraper、Apify、Zyte/Scrapy、Firecrawl

- 強み: 高い柔軟性、拡張性、カスタマイズ性。独自のパイプライン構築やAIモデルとの連携に最適です。

- 注意点: コーディングスキルと、ある程度の設定が必要です。

- 用途: カスタムデータパイプラインの構築、複雑なサイトのスクレイピング、社内システムとの連携。

2. AI統合型のスクレイピングエージェント

- 例: Thunderbit、ScrapeGraphAI、Firecrawl、Reader(Jina)、LLM Scraper

- 強み: スクレイピングとデータ理解の間にあるギャップを埋めてくれます。自然言語インターフェースで使いやすいのも魅力です。

- 注意点: まだ発展途上の製品もあり、細かな制御には向かない場合があります。

- 用途: すぐに答えやデータセットが欲しいとき、自律エージェントの構築、ライブデータをLLMに流し込む用途。

3. ノーコード/ローコードのビジネス向けスクレイパー

- 例: Thunderbit、Browse AI、Octoparse、ParseHub、、DataMiner

- 強み: 使いやすく、ほとんどコード不要です。日常的な業務に向いています。

- 注意点: 非常に複雑なサイトや超大規模処理では苦戦することがあります。

- 用途: リード獲得、競合モニタリング、調査プロジェクト、単発のデータ抽出。

4. エンタープライズ向けデータプラットフォームとサービス

- 例: Bright Data、Diffbot、Zyte

- 強み: フルスタックのソリューション、マネージドサービス、コンプライアンス、大規模運用での信頼性。

- 注意点: コストが高く、導入にも時間がかかります。

- 用途: 大規模で常時稼働のデータパイプライン、市場インテリジェンス、AI学習データ。

Webページのスクレイピング要件に合ったAIウェブクローラーの選び方

自分に合うツールを選ぶのは、迷いやすいものです。そこで、私のステップごとの選び方を紹介します。

- 目的とデータ要件を明確にする: どのサイトから、どんなデータが必要ですか? 頻度は? 量は? 取得後に何をしますか?

- 技術力を見極める: コーディング不要なら、Thunderbit、Browse AI、Octoparseを試しましょう。少しスクリプトを書けるならLLM ScraperやDataMiner。開発に強いならCrawl4AI、Apify、Zyteです。

- 頻度と規模を考える: 単発なら無料ツールで十分です。定期実行ならスケジューリング機能を重視しましょう。大規模ならエンタープライズ向けやオープンソースのスケール運用が向いています。

- 予算と価格モデル: 無料プランは検証に最適です。サブスク型か従量課金型かは、用途次第です。

- 試用とPoC: 実データでいくつか試しましょう。ほとんどのツールに無料枠があります。

- 保守とサポート: サイトが変わったとき、誰が修正しますか? AI付きノーコードツールなら軽微な変更を自動修正することもありますが、オープンソースは自分かコミュニティ頼みです。

- 用途別にツールを当てはめる: 営業チームのリード抽出ならThunderbitかBrowse AI。研究者がツイートを集めるならDataMinerか。AIモデルがニュース記事を必要とするならJina ReaderかZyte。比較サイトを作るならApifyかZyte。

- 代替案を用意する: 特定のサイトでは、1つのツールがうまく動かないことがあります。バックアップを持っておきましょう。

“正しい”ツールとは、必要なデータを最小限の手間と予算内で取得できるものです。場合によっては、複数ツールの組み合わせになることもあります。

Thunderbit vs. 従来型Webスクレイパーツール:何が違うのか?

Thunderbitがなぜ違うのか、具体的に見てみましょう。

- 自然言語インターフェース: コードも、クリック操作の細かい手順も不要です。欲しいものを伝えるだけで済みます()。

- 設定不要+テンプレート提案: Thunderbitはページネーションやサブページを自動検出し、よくあるサイト向けのテンプレートまで提案します()。

- AIによるデータクレンジングと拡張: スクレイピングしながら、要約、分類、翻訳、データ拡張までできます()。

- 保守の手間が少ない: ThunderbitのAIはサイトの小さな変更に強く、壊れにくい設計です。

- 業務ツール連携: Google Sheets、Airtable、Notionへ直接エクスポートできるので、CSVの面倒な扱いは不要です()。

- 価値を出すまでが速い: アイデアからデータ取得まで、数日ではなく数分で進められます。

- 学習コスト: Webを閲覧して、必要なことを説明できるなら、Thunderbitは使えます。

- 柔軟性: Webサイト、PDF、画像など、同じツールでまとめて扱えます。

Thunderbitは単なるスクレイパーではありません。営業、マーケティング、EC、不動産など、どんな業務フローにも組み込めるデータアシスタントです。

AIウェブスクレイパーツールを使う際のWebページスクレイピングのベストプラクティス

AIウェブスクレイパーを最大限活用するためのコツをまとめます。

- 必要なデータを明確にする: どの項目が欲しいのか、何ページ分必要か、どんな形式が必要かをはっきりさせましょう。

- AIの提案を活用する: フィールド検出やAI提案を使って、自分では見落としそうな重要データを拾いましょう()。

- 小さく始めて検証する: 少量のサンプルでテストし、出力を確認し、必要に応じて調整します。

- 動的コンテンツに対応する: ページネーション、無限スクロールなど、動的要素に対応しているか確認しましょう。

- サイトのポリシーを尊重する: robots.txtを確認し、機微なデータのスクレイピングは避け、レート制限を守りましょう。

- 自動化のために連携する: エクスポート機能やWebhookを使って、抽出したデータをそのまま業務フローへ接続します。

- データ品質を保つ: データを目視確認し、後処理を行い、エラーを監視しましょう。

- プロンプトは簡潔に: AI駆動ツールでは、明確で具体的な指示ほど良い結果につながります。

- コミュニティから学ぶ: フォーラムやコミュニティで、コツやトラブル解決法を学びましょう。

- 最新情報を追う: AIツールは進化が速いので、新機能や改善を定期的に確認しましょう。

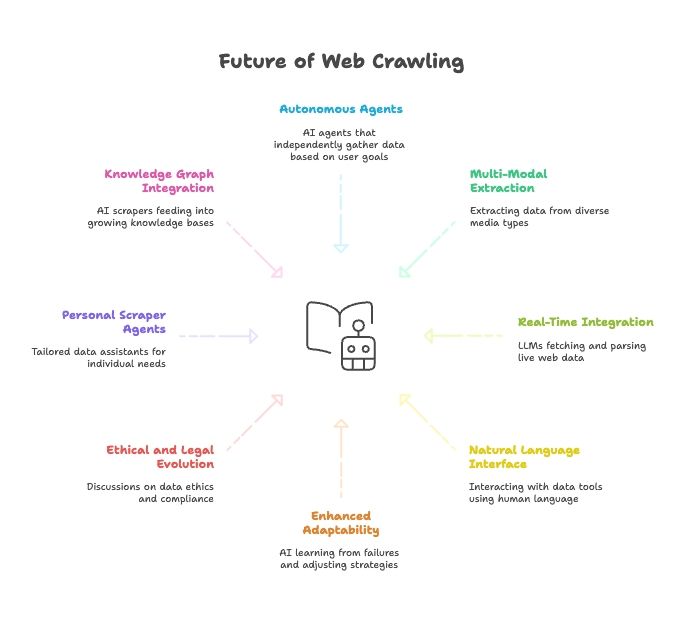

Webスクレイピングの未来:AI、LLM、そして自然言語型Webスクレイピングエージェントの台頭

今後を見ると、AIとウェブスクレイピングの融合はますます加速していきます。

- 完全自律型のスクレイピングエージェント: 近いうちに、AIエージェントへ最終目標を伝えるだけで、データの取り方を自分で考えてくれるようになります。

- マルチモーダルなデータ抽出: スクレイパーはテキスト、画像、PDF、さらには動画からもデータを取り出すようになります。

- AIモデルとのリアルタイム連携: LLMには、ライブWebデータを取得してパースする標準モジュールが組み込まれていくでしょう。

- すべてが自然言語化: データツールを人と話すのと同じ感覚で扱えるようになり、データ収集や変換が誰にでも使いやすくなります。

- 適応力の向上: AIスクレイパーは失敗から学び、戦略を自動で調整するようになります。

- 倫理と法規制の進化: データ倫理、コンプライアンス、公正利用をめぐる議論はさらに増えるはずです。

- 個人向けスクレイピングエージェント: ニュース、求人情報などを自分向けに集めてくれる、パーソナルデータアシスタントを想像してみてください。

- ナレッジグラフとの統合: AIスクレイパーは成長し続ける知識ベースへ継続的にデータを供給し、より賢いAIを支えます。

要するに、Webスクレイピングの未来はAIの未来と切り離せません。ツールは日々、より賢く、より自律的で、より使いやすくなっています。

まとめ:適切なAIウェブクローラーでビジネス価値を引き出す

AIのおかげで、Webスクレイピングはニッチな技術スキルから、ビジネスの中核能力へと変わりました。ここで紹介した15のツールは、開発者向けの高機能ツールから、ビジネスに優しいアシスタントまで、2026年に可能なベストを示しています。

本当の秘訣は何か。それは、適切なツールを選ぶことで、Webデータから得られる価値を大きく高められることです。非技術チームにとって、ThunderbitはWebを構造化された分析可能なデータベースへ変える最も簡単な方法です。コードも手間も不要で、得られるのは結果だけです。

リード収集、競合監視、次世代AIモデルへのデータ供給など、目的が何であっても、まずは要件を整理し、いくつか試し、自分に合うものを見つけてください。そして、今すぐWebスクレイピングの未来を体験したいなら、。必要なインサイトは、プロンプトひとつで手に入ります。

もっと知りたい方は、深掘り解説、チュートリアル、AI搭載データ抽出の最新情報がまとまったもぜひご覧ください。

参考記事:

FAQ

1. AIウェブクローラーとは何ですか?従来のWebスクレイパーとどう違いますか?

AIウェブクローラーは、自然言語処理と機械学習を使ってWebデータを理解し、抽出し、構造化します。手動でのコーディングやXPathセレクターを必要とする従来型スクレイパーとは異なり、AIツールは動的コンテンツに対応し、レイアウト変更にも適応し、平易な英語の指示を解釈できます。

2. ThunderbitのようなAIウェブスクレイピングツールは誰が使うべきですか?

Thunderbitは、非技術者にも技術者にも向けて作られています。営業、マーケティング、オペレーション、リサーチ、ECの担当者が、コードを書かずにWebサイト、PDF、画像から構造化データを抽出したいときに最適です。

3. Thunderbitが他のAIウェブクローラーと比べて優れている点は何ですか?

Thunderbitは、自然言語インターフェース、多階層クロール、自動データ構造化、OCR対応、Google SheetsやAirtableなどへのシームレスなエクスポートを備えています。さらに、AIによる項目提案や、人気サイト向けの事前構築テンプレートも含まれています。

4. 2026年に無料で使えるAIウェブスクレイピングの選択肢はありますか?

はい。Thunderbit、Browse AI、DataMinerのように、制限付きで無料プランを提供するツールは多くあります。開発者向けには、Crawl4AIやScrapeGraphAIのようなオープンソース製品が、技術的なセットアップは必要ですが、無料でフル機能を使えます。

5. 自分の用途に合ったAIウェブクローラーはどう選べばよいですか?

まず、データの目的、技術力、予算、規模の要件を整理しましょう。ノーコードで使いやすいものが欲しいなら、ThunderbitやBrowse AIが有力です。大規模運用やカスタム要件があるなら、ApifyやBright Dataのようなツールがより適しています。