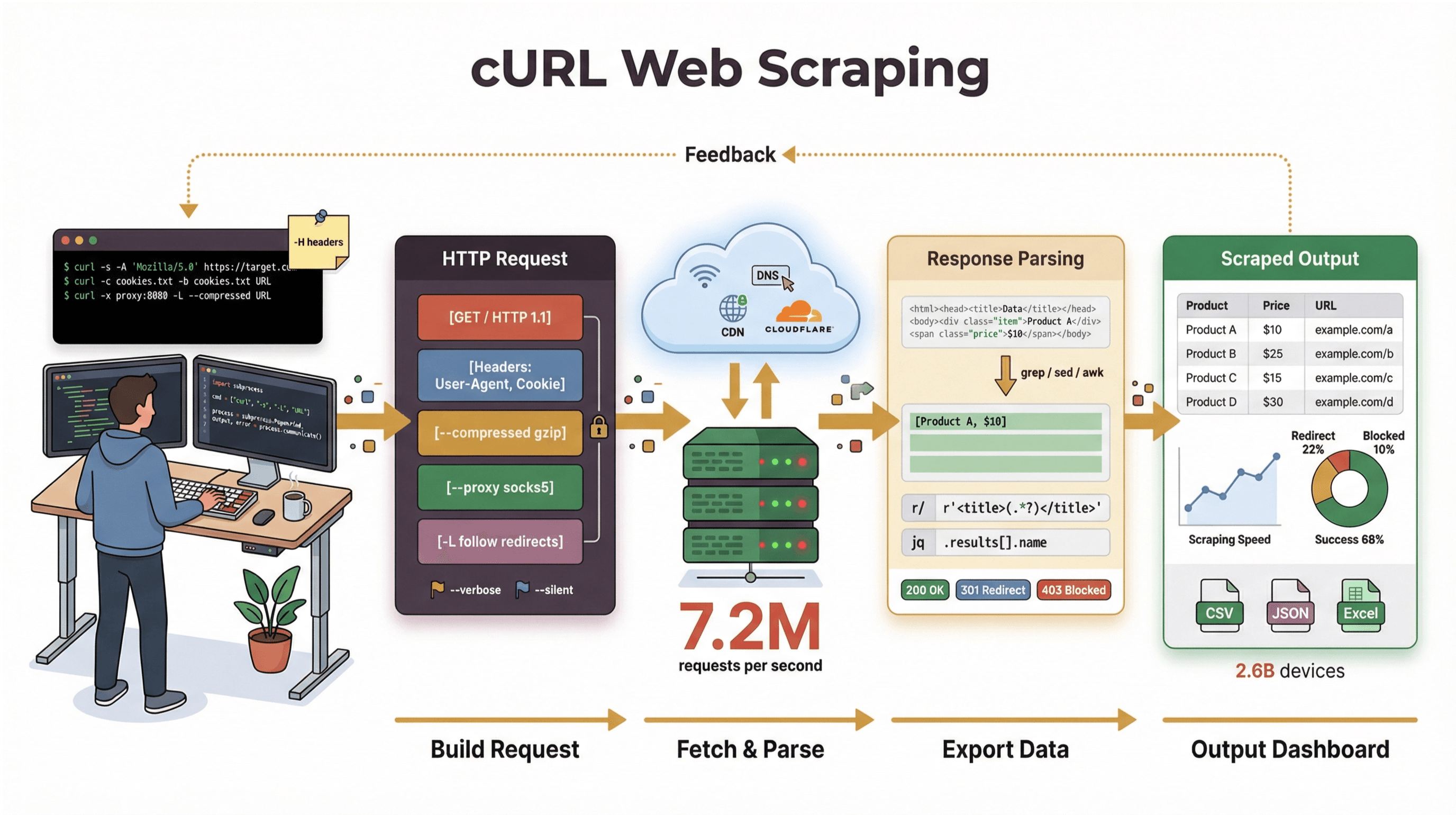

टर्मिनल खोलना, एक कमांड टाइप करना और देखते-ही-देखते कच्चा वेब डेटा बहते देखना—इसमें एक अलग ही “क्लासिक” मज़ा है, जैसे आपने Matrix का दरवाज़ा खोल दिया हो। डेवलपर्स और टेक-सेवी पावर यूज़र्स के लिए वही जादुई छड़ी है—एक सादा-सा कमांड-लाइन टूल जो चुपचाप अरबों डिवाइसों पर चलता है, क्लाउड सर्वर से लेकर आपके स्मार्ट फ्रिज तक। और 2026 में भी, जब चारों तरफ चमकदार नो-कोड और AI स्क्रैपिंग टूल्स हैं, तब भी web-scraping-with-curl उन लोगों की पहली पसंद बना रहता है जिन्हें स्पीड, कंट्रोल और स्क्रिप्टिंग की आज़ादी चाहिए। यहाँ “लोकल” तरीके से कहें तो: 빠르고, 깔끔하고, 내 맘대로।

मैंने सालों तक ऑटोमेशन टूल्स बनाए हैं और टीमों को वेब डेटा संभालने में मदद की है—और आज भी जब मुझे कोई पेज जल्दी से खींचना हो, API डिबग करनी हो, या स्क्रैपिंग वर्कफ़्लो का प्रोटोटाइप बनाना हो, तो मैं cURL ही उठाता हूँ। इस गाइड में मैं आपको curl web scraping tutorial के जरिए बेसिक्स से लेकर प्रो-लेवल ट्रिक्स तक सब दिखाऊँगा—रियल कमांड उदाहरणों, काम की टिप्स, और एक ईमानदार नज़र के साथ कि cURL कहाँ चमकता है (और कहाँ इसकी सीमा आ जाती है)। और अगर आप बिज़नेस यूज़र हैं जो कमांड लाइन से दूर रहना पसंद करते हैं, तो मैं बताऊँगा कि कैसे —हमारा AI-पावर्ड web scraper—आपको “मुझे ये डेटा चाहिए” से “ये रही मेरी स्प्रेडशीट” तक सिर्फ दो क्लिक में पहुँचा देता है—बिना कोड के। 딱 두 번 क्लिक, 끝.

मैंने सालों तक ऑटोमेशन टूल्स बनाए हैं और टीमों को वेब डेटा संभालने में मदद की है—और आज भी जब मुझे कोई पेज जल्दी से खींचना हो, API डिबग करनी हो, या स्क्रैपिंग वर्कफ़्लो का प्रोटोटाइप बनाना हो, तो मैं cURL ही उठाता हूँ। इस गाइड में मैं आपको curl web scraping tutorial के जरिए बेसिक्स से लेकर प्रो-लेवल ट्रिक्स तक सब दिखाऊँगा—रियल कमांड उदाहरणों, काम की टिप्स, और एक ईमानदार नज़र के साथ कि cURL कहाँ चमकता है (और कहाँ इसकी सीमा आ जाती है)। और अगर आप बिज़नेस यूज़र हैं जो कमांड लाइन से दूर रहना पसंद करते हैं, तो मैं बताऊँगा कि कैसे —हमारा AI-पावर्ड web scraper—आपको “मुझे ये डेटा चाहिए” से “ये रही मेरी स्प्रेडशीट” तक सिर्फ दो क्लिक में पहुँचा देता है—बिना कोड के। 딱 두 번 क्लिक, 끝.

चलिए शुरू करते हैं और देखते हैं कि 2025 में भी वेब स्क्रैपिंग के लिए cURL क्यों काम का है, इसे सही तरीके से कैसे इस्तेमाल करें, और कब आपको इससे भी ज़्यादा ताकतवर विकल्प चुनना चाहिए।

cURL क्या है? web-scraping-with-curl की बुनियाद

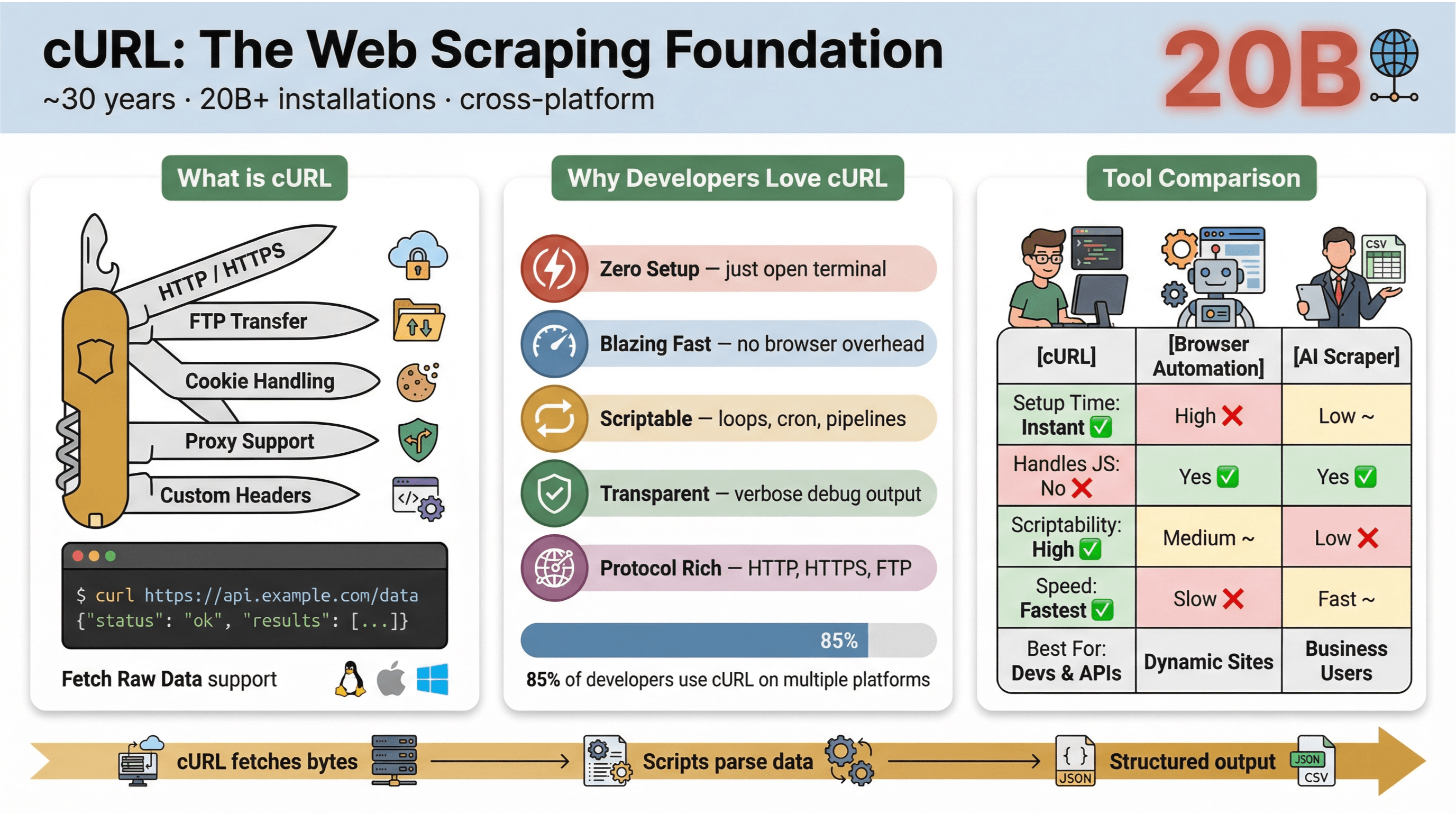

सीधे शब्दों में, एक कमांड-लाइन टूल और लाइब्रेरी है जो URL के जरिए डेटा ट्रांसफर करने के लिए बनाई गई है। यह लगभग 30 साल से मौजूद है (हाँ, सच में) और हर जगह मिलती है—ऑपरेटिंग सिस्टम्स में बिल्ट-इन, स्क्रिप्ट्स को पावर देती हुई, और में बैकग्राउंड में डेटा ट्रांसफर संभालती हुई। अगर आपने कभी किसी वेब पेज को जल्दी से फेच करने, API टेस्ट करने या फाइल डाउनलोड करने के लिए कमांड चलाई है, तो बहुत संभव है कि आपने cURL इस्तेमाल की हो। 한국 में कहें तो: “기본템”।

वेब स्क्रैपिंग में cURL को इतना लोकप्रिय बनाने वाली बातें:

वेब स्क्रैपिंग में cURL को इतना लोकप्रिय बनाने वाली बातें:

- हल्का और हर प्लेटफ़ॉर्म पर चलने वाला: Linux, macOS, Windows, यहाँ तक कि एम्बेडेड डिवाइसों पर भी।

- कई प्रोटोकॉल सपोर्ट: HTTP, HTTPS, FTP वगैरह।

- स्क्रिप्टिंग के लिए बढ़िया: ऑटोमेशन, cron jobs और “ग्लू कोड” के लिए परफेक्ट।

- यूज़र इंटरैक्शन की ज़रूरत नहीं: नॉन-इंटरैक्टिव यूज़ के लिए डिज़ाइन—बैच जॉब्स और पाइपलाइन्स में शानदार। 완전 자동화 각.

लेकिन एक बात साफ है: cURL का मुख्य काम कच्चा डेटा लाना है—HTML, JSON, इमेज, जो भी हो। यह डेटा को आपके लिए parse, render या structured नहीं करता। cURL को वेब स्क्रैपिंग का “पहला माइल” समझिए: यह bytes ले आता है, लेकिन उसे structured जानकारी में बदलने के लिए आपको दूसरे टूल्स चाहिए (जैसे Python स्क्रिप्ट्स, grep/sed/awk, या कोई AI web scraper)। यानी “가져오기는 cURL, 정리는 다른 도구”.

ऑफिशियल डॉक्यूमेंटेशन देखना हो तो देखें।

वेब स्क्रैपिंग के लिए cURL क्यों इस्तेमाल करें? (curl web scraping tutorial)

इतने नए टूल्स के बावजूद डेवलपर्स और टेक्निकल यूज़र्स बार-बार cURL पर क्यों लौटते हैं? वजहें साफ हैं:

- लगभग ज़ीरो सेटअप: न इंस्टॉल, न डिपेंडेंसी—टर्मिनल खोलिए और चल पड़िए। 바로 실행.

- तेज़: ब्राउज़र लोड होने का इंतज़ार किए बिना तुरंत डेटा फेच। 속도 미쳤다.

- स्क्रिप्टिंग-फ्रेंडली: URLs पर लूप चलाना, रिक्वेस्ट ऑटोमेट करना, कमांड्स चेन करना आसान।

- फीचर्स की भरमार: cookies, proxies, redirects, custom headers—सब संभाल सकता है।

- पूरी पारदर्शिता: verbose/debug आउटपुट से दिखता है कि अंदर क्या हो रहा है। 디버깅 맛집.

में 85% से ज़्यादा लोगों ने बताया कि वे cURL कमांड-लाइन टूल इस्तेमाल करते हैं, और लगभग सभी ने कहा कि वे इसे कई प्लेटफ़ॉर्म्स पर चलाते हैं। HTTP requests, quick data pulls और troubleshooting के लिए यह आज भी Swiss Army knife है।

cURL बनाम दूसरे स्क्रैपिंग तरीकों की एक झटपट तुलना:

| Feature | cURL | Browser Automation (e.g., Selenium) | AI Web Scraper (e.g., Thunderbit) |

|---|---|---|---|

| Setup Time | Instant | High | Low |

| Scriptability | High | Medium | Low (no code needed) |

| Handles JavaScript | No | Yes | Yes (Thunderbit: via browser) |

| Cookie/Session Support | Manual | Automatic | Automatic |

| Data Structuring | Manual (parse later) | Manual (parse later) | AI/Template-based |

| Best For | Devs, quick pulls | Complex, dynamic sites | Business users, structured export |

निष्कर्ष: static pages, APIs या छोटे-छोटे ऑटोमेशन के लिए cURL बेजोड़ है। लेकिन जैसे ही आपको complex HTML parse करना हो, JavaScript संभालना हो, या structured export चाहिए—आपको कोई स्पेशलाइज़्ड टूल चाहिए होगा। 한마디로: “가볍게는 cURL, 제대로는 전용툴”.

शुरुआत करें: cURL वेब स्क्रैपिंग के बेसिक कमांड उदाहरण

अब प्रैक्टिकल करते हैं। नीचे cURL से बेसिक वेब स्क्रैपिंग टास्क्स करने का तरीका स्टेप-बाय-स्टेप है।

cURL से Raw HTML फेच करना

सबसे सिंपल केस: किसी वेब पेज का HTML निकालना।

1curl https://books.toscrape.com/यह कमांड का होमपेज फेच करती है—यह वेब स्क्रैपिंग के लिए पब्लिक डेमो साइट है। टर्मिनल में आपको raw HTML दिखेगा—<title> जैसे टैग्स या “In stock” जैसे टेक्स्ट स्निपेट्स ढूँढिए। 여기서부터 “긁기” 시작.

आउटपुट को फाइल में सेव करना

HTML को बाद में parse करना है? -o फ्लैग इस्तेमाल करें:

1curl -o page.html https://books.toscrape.com/अब आपके पास page.html नाम की फाइल होगी जिसमें पूरा HTML कंटेंट होगा—आगे किसी टूल से analysis/parse करने के लिए बढ़िया। 저장해두면 마음 편함.

cURL से POST रिक्वेस्ट भेजना

फॉर्म सबमिट करना है या API से इंटरैक्ट करना है? POST के लिए -d फ्लैग काम आता है। (HTTP टेस्टिंग के लिए बनी साइट) का उदाहरण:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"रिस्पॉन्स में JSON मिलेगा जो आपका सबमिट किया हुआ डेटा echo करेगा—टेस्टिंग और प्रोटोटाइपिंग के लिए शानदार। 테스트는 이런 게 국룰.

Headers देखना और Debug करना

कई बार आपको response headers देखने होते हैं या request debug करनी होती है:

-

सिर्फ headers (HEAD request):

1curl -I https://books.toscrape.com/ -

body के साथ headers भी:

1curl -i https://httpbin.org/get -

Verbose/debug आउटपुट:

1curl -v https://books.toscrape.com/

ये flags अंदर की पूरी कहानी दिखाते हैं—troubleshooting के लिए जरूरी। 디테일하게 까보는 맛.

इन कमांड्स का quick reference:

| Task | Command Example | Notes |

|---|---|---|

| Fetch HTML | curl URL | Outputs HTML to terminal |

| Save to file | curl -o file.html URL | Writes output to file |

| Inspect headers | curl -I URL or curl -i URL | -I for HEAD only, -i includes headers with body |

| POST form data | curl -d "a=1&b=2" URL | Sends form-encoded data |

| Debug request/response | curl -v URL | Shows detailed request/response info |

और उदाहरणों के लिए देखें।

अगला स्तर: cURL के साथ एडवांस्ड वेब स्क्रैपिंग (web-scraping-with-curl)

बेसिक्स के बाद cURL में कई एडवांस फीचर्स हैं जो मुश्किल स्क्रैपिंग टास्क्स में मदद करते हैं।

Cookies और Sessions संभालना

कई साइट्स login session बनाए रखने या tracking के लिए cookies मांगती हैं। cURL में आप cookies सेव करके दोबारा इस्तेमाल कर सकते हैं:

1# Store cookies after login

2curl -c cookies.txt https://example.com/login

3# Use cookies for subsequent requests

4curl -b cookies.txt https://example.com/accountइससे आप ब्राउज़र जैसी session behavior mimic कर सकते हैं और login के पीछे वाले पेज एक्सेस कर सकते हैं (जब तक JavaScript challenge न हो)। 세션 유지, 이게 핵심.

User-Agent spoof करना और Custom Headers

कुछ वेबसाइटें User-Agent/headers के आधार पर अलग कंटेंट देती हैं। डिफ़ॉल्ट रूप से cURL खुद को “curl/VERSION” बताता है, जिससे block या alternate content मिल सकता है। ब्राउज़र जैसा दिखाने के लिए:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/आप custom headers भी सेट कर सकते हैं, जैसे language preference:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/इससे अक्सर वही कंटेंट मिलता है जो असली ब्राउज़र में दिखता है। “브라우저인 척” 하는 거지.

Web Scraping के लिए Proxies

Geo-testing करना है या IP bans से बचने के लिए proxy चाहिए? -x फ्लैग इस्तेमाल करें:

1curl -x http://proxy.example.org:4321 https://remote.example.org/ध्यान रहे: proxies का इस्तेमाल जिम्मेदारी से करें और साइट की terms of service का पालन करें। 무리하면 바로 차단.

Multi-Page Scraping ऑटोमेट करना

Paginated listings जैसी कई पेजों वाली चीज़ें स्क्रैप करनी हैं? एक simple shell loop काफी है:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-${p}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-${p}.html"

4 sleep 1

5doneयह Books to Scrape कैटलॉग के पेज 2 से 5 तक डाउनलोड करके अलग-अलग फाइलों में सेव कर देता है। (पेज 1 होमपेज है।) 반복 작업은 이렇게 자동화가 꿀.

web-scraping-with-curl की सीमाएँ: क्या जानना जरूरी है

cURL जितना पसंदीदा है, उतना ही सच यह भी है कि यह हर समस्या का हल नहीं। इसकी मुख्य सीमाएँ:

- JavaScript नहीं चलता: cURL उन पेजों पर काम नहीं करता जहाँ कंटेंट render करने या anti-bot challenges हल करने के लिए JavaScript जरूरी हो (). JS 없으면 답 없음.

- Parsing आपको खुद करनी होगी: raw HTML/JSON मिलेगा, लेकिन structured डेटा निकालने के लिए अलग स्क्रिप्ट/टूल चाहिए।

- Complex sessions में झंझट: tokens, multi-step forms, complicated logins जल्दी messy हो जाते हैं। 점점 귀찮아짐.

- Structured output नहीं: cURL वेब पेज को rows/tables/spreadsheet में नहीं बदलता।

- Anti-bot detection के सामने कमजोर: आजकल कई साइट्स advanced defenses (JavaScript, fingerprinting, CAPTCHA) लगाती हैं जिन्हें cURL bypass नहीं कर पाता (). 막히면 막힘.

एक त्वरित तुलना:

| Limitation | cURL Alone | Modern Scraping Tools (e.g., Thunderbit) |

|---|---|---|

| JavaScript Support | No | Yes |

| Data Structuring | Manual | Automatic (AI/Template) |

| Session Handling | Manual | Automatic |

| Anti-Bot Bypass | Limited | Advanced (browser-based/AI) |

| Ease of Use | Technical | Non-technical |

Static pages और APIs के लिए cURL शानदार है। Dynamic या protected साइट्स के लिए आपको आगे के टूल्स चाहिए होंगे। 여기서부터는 “도구빨”도 필요.

Non-Technical Users के लिए Thunderbit बनाम cURL: कौन सा बेहतर?

अब बात करते हैं की—हमारा AI-पावर्ड web scraper Chrome Extension। अगर आप sales, marketing या operations में हैं और बस वेबसाइट से डेटा निकालकर Excel, Google Sheets या Notion में डालना चाहते हैं—कमांड लाइन छुए बिना—तो Thunderbit आपके लिए बना है। 클릭 몇 번으로 끝나는 스타일, 완전 편함.

Thunderbit और cURL की तुलना:

| Feature | cURL | Thunderbit |

|---|---|---|

| User Interface | Command line | Point-and-click (Chrome Extension) |

| AI Field Suggestion | No | Yes (AI reads page, suggests columns) |

| Handles Pagination/Subpages | Manual scripting | Automatic (AI detects and scrapes) |

| Data Export | Manual (parse + save) | Direct to Excel, Google Sheets, Notion, Airtable |

| JavaScript/Protected Pages | No | Yes (browser-based scraping) |

| No-Code Required | No (requires scripting) | Yes (anyone can use) |

| Free Tier | Always free | Free for up to 6 pages (10 with trial boost) |

Thunderbit में आप extension खोलते हैं, “AI Suggest Fields” पर क्लिक करते हैं, और AI खुद तय कर देता है कि कौन-कौन से कॉलम निकालने हैं। आप tables, lists, product details स्क्रैप कर सकते हैं, और subpages भी ऑटोमैटिक विज़िट करवा सकते हैं। फिर डेटा सीधे अपने पसंदीदा बिज़नेस टूल्स में export—ना parsing, ना सिरदर्द। 진짜 “노가다” 줄여줌.

Thunderbit पर दुनिया भर में भरोसा करते हैं, और यह खासकर sales, ecommerce और real estate टीमों में लोकप्रिय है जिन्हें जल्दी structured डेटा चाहिए।

ट्राई करना है? ।

cURL और Thunderbit को साथ मिलाकर इस्तेमाल करें: लचीली स्क्रैपिंग रणनीतियाँ

अगर आप टेक्निकल यूज़र हैं, तो एक ही टूल चुनने की मजबूरी नहीं। कई टीमें maximum flexibility के लिए cURL और Thunderbit दोनों साथ इस्तेमाल करती हैं:

- cURL से प्रोटोटाइप: endpoints जल्दी टेस्ट करें, headers देखें, और साइट का response समझें। 빠르게 감 잡기.

- Thunderbit से स्केल: जब structured डेटा, multi-page scraping या repeatable workflow चाहिए, तो Thunderbit पर शिफ्ट करें—point-and-click extraction और direct exports के साथ। 본격적으로 뽑기.

Market research का एक sample workflow:

- cURL से कुछ पेज फेच करें और HTML structure देखें।

- जिन fields की जरूरत है उन्हें पहचानें (जैसे product names, prices, reviews)।

- Thunderbit खोलें, “AI Suggest Fields” क्लिक करें, AI को scraper सेटअप करने दें।

- सभी पेज (subpages/pagination सहित) स्क्रैप करें और Google Sheets में export करें।

- डेटा analyze करें, शेयर करें, और action लें—manual parsing के बिना। 깔끔하게 끝.

Decision table:

| Scenario | Use cURL | Use Thunderbit | Use Both |

|---|---|---|---|

| Quick API or static page fetch | ✅ | ||

| Need structured data in a spreadsheet | ✅ | ||

| Debugging headers/cookies | ✅ | ||

| Scraping dynamic/JS-heavy pages | ✅ | ||

| Building a repeatable, no-code workflow | ✅ | ||

| Prototyping, then scaling up | ✅ | ✅ | Hybrid workflow |

cURL के साथ वेब स्क्रैपिंग में आम चुनौतियाँ और गलतियाँ

cURL से “धड़ाधड़” स्क्रैपिंग शुरू करने से पहले, कुछ real-world चुनौतियाँ जान लें:

- Anti-bot सिस्टम्स: JavaScript challenges, CAPTCHAs, fingerprinting जैसी defenses को cURL bypass नहीं कर पाता (). 요즘 방어가 빡셈.

- डेटा क्वालिटी समस्याएँ: HTML बदलते ही fields गायब हो सकते हैं या layout बदल सकता है—स्क्रिप्ट टूट जाती है।

- मेंटेनेंस का बोझ: साइट में बदलाव आते ही parsing logic अपडेट करनी पड़ती है। 유지보수 지옥 가능.

- कानूनी/कम्प्लायंस रिस्क: स्क्रैप करने से पहले terms of service, robots.txt और लागू कानून जरूर देखें। पब्लिक डेटा होने का मतलब यह नहीं कि उसे किसी भी तरह इस्तेमाल किया जा सकता है (, ).

- स्केलिंग लिमिट्स: छोटे कामों में cURL बढ़िया है, लेकिन बड़े स्केल पर proxies, rate limits और error handling आपको खुद मैनेज करनी होगी। 스케일은 결국 설계 싸움.

Troubleshooting और compliance के लिए टिप्स:

- शुरुआत permissioned या demo साइट्स से करें (जैसे )।

- rate limits का सम्मान करें—endpoints पर लोड न डालें।

- personal data तब तक न स्क्रैप करें जब तक आपके पास वैध आधार न हो।

- अगर JavaScript/CAPTCHA दीवार आ जाए, तो Thunderbit जैसे browser-based टूल पर स्विच करें। 막히면 갈아타는 게 정답.

स्टेप-बाय-स्टेप सारांश: cURL से वेबसाइट स्क्रैप कैसे करें

web-scraping-with-curl के लिए quick checklist:

- Target URL(s) तय करें: static page या API endpoint से शुरू करें।

- पेज फेच करें:

curl URL - आउटपुट फाइल में सेव करें:

curl -o file.html URL - Headers/debug देखें:

curl -I URL,curl -v URL - POST डेटा भेजें:

curl -d "a=1&b=2" URL - Cookies/sessions संभालें:

curl -c cookies.txt ...,curl -b cookies.txt ... - Custom headers/User-Agent सेट करें:

curl -A "..." -H "..." URL - Redirects follow करें:

curl -L URL - Proxy इस्तेमाल करें (जरूरत हो तो):

curl -x proxy:port URL - Multi-page scraping ऑटोमेट करें: shell loops या scripts से।

- डेटा parse और structure करें: जरूरत के हिसाब से दूसरे टूल्स/स्क्रिप्ट्स जोड़ें।

- Structured, no-code scraping या dynamic pages के लिए Thunderbit पर जाएँ। 상황 맞게 선택하면 됨.

निष्कर्ष और मुख्य बातें: सही वेब स्क्रैपिंग टूल कैसे चुनें

2026 में भी web-scraping-with-curl टेक्निकल यूज़र्स के लिए एक दमदार स्किल है—खासकर quick data pulls, prototyping और automation के लिए। cURL की स्पीड, स्क्रिप्टिंग क्षमता और हर जगह उपलब्धता इसे हर डेवलपर के टूलबॉक्स का जरूरी हिस्सा बनाती है। लेकिन जैसे-जैसे वेब ज्यादा dynamic और protected हो रहा है, और बिज़नेस यूज़र्स बिना कोड के structured डेटा चाहते हैं, वैसे-वैसे जैसे टूल्स नई संभावनाएँ खोल रहे हैं। 결국 “목적”이 도구를 정함.

Key takeaways:

- static pages, APIs और quick prototyping के लिए cURL चुनें—जब आपको पूरा कंट्रोल चाहिए। 컨트롤은 cURL.

- structured डेटा, dynamic/JavaScript-heavy pages, या no-code बिज़नेस वर्कफ़्लो के लिए Thunderbit (या इसी तरह के AI web scrapers) बेहतर हैं। 편하게 뽑으려면 Thunderbit.

- दोनों को मिलाकर इस्तेमाल करें: cURL से प्रोटोटाइप, Thunderbit से स्केल और structure। 하이브리드가 실전.

- जिम्मेदारी से स्क्रैप करें—terms, rate limits और कानूनी सीमाओं का सम्मान करें। 매너가 실력.

देखना चाहते हैं कि वेब स्क्रैपिंग कितनी आसान हो सकती है? और AI-पावर्ड डेटा extraction खुद अनुभव करें। और अगर आप और गहराई में जाना चाहते हैं, तो ज्यादा ट्यूटोरियल्स, टिप्स और इंडस्ट्री इनसाइट्स के लिए देखें। आपको ये भी पसंद आ सकते हैं:

स्क्रैपिंग मुबारक—और आपकी डेटा हमेशा साफ, structured, और बस एक कमांड (या क्लिक) दूर रहे। 화이팅.

FAQs

1. क्या cURL JavaScript से render होने वाले वेब पेज संभाल सकता है?

नहीं, cURL JavaScript execute नहीं कर सकता। यह सर्वर से जैसा raw HTML आता है, वैसा ही फेच करता है। अगर किसी पेज को कंटेंट दिखाने या anti-bot challenges हल करने के लिए JavaScript चाहिए, तो cURL डेटा तक नहीं पहुँच पाएगा। ऐसे मामलों में जैसे browser-based टूल इस्तेमाल करें। JS면 브라우저 기반이 답.

2. cURL का आउटपुट सीधे फाइल में कैसे सेव करें?

-o फ्लैग इस्तेमाल करें: curl -o filename.html URL। इससे response body टर्मिनल में दिखने के बजाय फाइल में लिखी जाती है। 저장은 -o로 끝.

3. वेब स्क्रैपिंग में cURL और Thunderbit में क्या फर्क है?

cURL एक कमांड-लाइन टूल है जो raw वेब डेटा फेच करता है—टेक्निकल यूज़र्स और ऑटोमेशन के लिए बढ़िया। Thunderbit एक AI-पावर्ड Chrome Extension है जो बिज़नेस यूज़र्स के लिए बनाया गया है—यह किसी भी वेबसाइट से structured डेटा निकाल सकता है, dynamic pages संभाल सकता है, और Excel/Google Sheets जैसे टूल्स में सीधे export कर देता है—बिना कोड के। 한쪽은 “가져오기”, दूसरी तरफ “가져와서 정리까지”.

4. क्या cURL से वेबसाइट स्क्रैप करना कानूनी है?

हालिया कोर्ट फैसलों के बाद U.S. में पब्लिक डेटा स्क्रैप करना आम तौर पर कानूनी माना जाता है, लेकिन फिर भी वेबसाइट की terms of service, robots.txt और लागू कानून जरूर जाँचें। बिना अनुमति personal या protected डेटा स्क्रैप करने से बचें, और rate limits व ethical guidelines का पालन करें (, ). 합법/약관 체크는 필수.

5. मुझे cURL से Thunderbit जैसे advanced टूल पर कब स्विच करना चाहिए?

अगर आपको dynamic/JavaScript-heavy pages स्क्रैप करने हैं, स्प्रेडशीट में structured डेटा चाहिए, या आप no-code वर्कफ़्लो चाहते हैं, तो Thunderbit बेहतर विकल्प है। cURL को quick, टेक्निकल टास्क्स के लिए रखें; Thunderbit को बिज़नेस-फ्रेंडली, repeatable डेटा extraction के लिए इस्तेमाल करें। 막히거나 “정리까지” 필요하면 스위치.

और वेब स्क्रैपिंग टिप्स/ट्यूटोरियल्स के लिए देखें या हमारा विज़िट करें।