अगर आपने कभी B2B लीड लिस्ट बनाने, competitor analysis करने, या बस अपने CRM को अपडेट रखने की कोशिश की है, तो आप LinkedIn की असली वैल्यू जानते होंगे। लेकिन सच कहें तो profile info को manually copy करना बेहद उबाऊ काम है, और LinkedIn के अपने tools भी अक्सर वह डेटा नहीं देते जिसकी आपको सच में ज़रूरत होती है। इसी वजह से 2026 में पहले से कहीं ज़्यादा sales और operations teams Python से LinkedIn scrape करना की तरफ देख रही हैं—घंटों की tedious clicking को कुछ code lines और prospects से भरी spreadsheet में बदलते हुए।

लेकिन एक बड़ी चुनौती है: अब LinkedIn business data का Fort Knox बन चुका है। 1.3 billion से ज़्यादा members और 310 million monthly active users () के साथ, यह B2B leads का सबसे बड़ा source है—और bots तथा scrapers के खिलाफ सबसे ज़्यादा सुरक्षित भी। दरअसल, केवल 2025 में LinkedIn ने 30 million से ज़्यादा accounts को scraping या automation के लिए restricted कर दिया (). तो 2026 में Python की मदद से LinkedIn data कैसे निकाला जाए—और अपना account digital jail में भेजे बिना? आइए इसे setup से लेकर safe scraping, data cleaning, और Thunderbit जैसे tools से workflow को turbocharge करने तक, step by step समझते हैं।

Python से LinkedIn scrape करना का मतलब क्या है?

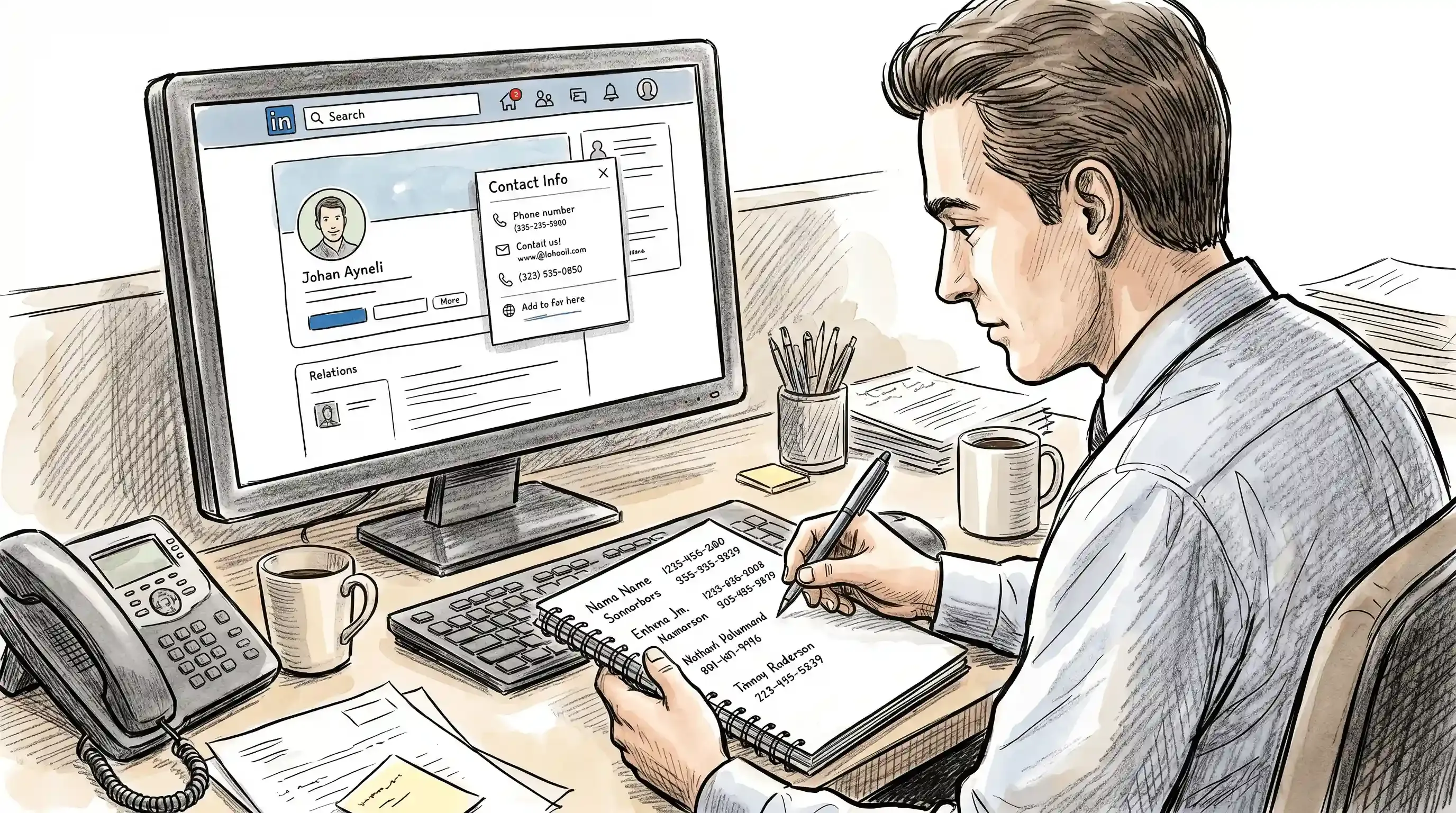

जब हम Python से LinkedIn scraping की बात करते हैं, तो असल में हम Python scripts और libraries की मदद से LinkedIn web pages से data collect करने की प्रक्रिया को automate करने की बात कर रहे होते हैं। नाम, job title, या company info को एक-एक करके copy-paste करने के बजाय, आप ऐसा script लिखते हैं जो पूरा काम संभाले—profiles खोलना, ज़रूरी fields निकालना, और उन्हें structured format में save करना।

Manual data collection वैसा है जैसे एक-एक सेब तोड़ना। Python के साथ LinkedIn data extraction ऐसा है जैसे पूरे पेड़ को हिला देना और सारे सेब एक टोकरी में इकट्ठा कर लेना। यहाँ के core target keywords—linkedin data extraction python, python linkedin scraper, और LinkedIn scraping को automate करना—सभी एक ही idea की तरफ इशारा करते हैं: code की मदद से LinkedIn data को बड़े पैमाने पर, तेज़ी से और (उम्मीद है) इंसानों से भी ज़्यादा सुरक्षित तरीके से इकट्ठा करना।

LinkedIn scraping के business use cases:

- Sales outreach के लिए targeted lead lists बनाना

- CRM records को ताज़ा job titles और companies से enrich करना

- Competitor hiring trends या executive moves पर नज़र रखना

- Market research के लिए industry networks map करना

- Analysis के लिए company posts या job listings इकट्ठा करना

संक्षेप में, अगर आपको structured LinkedIn data चाहिए और weekend “Connect” button दबाते हुए नहीं बिताना, तो Python आपका साथी है।

LinkedIn scraping को automate करना क्यों? प्रमुख Business Use Cases

साफ़ कहें तो LinkedIn सिर्फ़ एक social network नहीं है—यह modern B2B sales और marketing की रीढ़ है। यही वजह है कि 2026 में teams LinkedIn scraping को automate करने के पीछे पड़ी हैं:

- Lead Generation: और 62% कहते हैं कि इससे सच में leads मिलती हैं। LinkedIn, Facebook और Twitter को मिलाकर मिलने वाले leads से 277% ज़्यादा leads देता है।

- Market & Competitor Research: LinkedIn ही ऐसा platform है जहाँ आप real-time org charts, hiring trends, और company news बड़े scale पर देख सकते हैं।

- CRM Enrichment: Automation के बिना CRM को updated रखना मुश्किल काम है। LinkedIn scraping से आप titles, companies, और contact info bulk में अपडेट कर सकते हैं।

- Content & Event Analysis: जानना है कि आपके niche में कौन पोस्ट कर रहा है, बोल रहा है, या hiring कर रहा है? LinkedIn scraping आपको वह data देता है।

यहाँ सबसे common use cases की एक quick table है:

| टीम | Use Case | मिलने वाला मूल्य |

|---|---|---|

| Sales | Lead list बनाना, outreach की तैयारी | ज़्यादा meetings, बेहतर conversion |

| Marketing | Audience research, content curation | बेहतर targeting, ज़्यादा engagement |

| Operations | CRM enrichment, org mapping | साफ़ data, कम manual entry |

| Recruiting | Talent sourcing, competitor tracking | तेज़ hiring, smarter pipelines |

और ROI? Prospecting के लिए AI-driven automation इस्तेमाल करने वाली teams के अनुसार हर दिन 2–3 घंटे की बचत होती है (), और TripMaster जैसी companies ने LinkedIn-based lead gen से 650% ROI देखा है (). यह सिर्फ़ time-saving नहीं—यह pipeline को कई गुना बढ़ाने वाला काम है।

Python बनाम अन्य LinkedIn Scraping Solutions: क्या जानना ज़रूरी है

तो Python क्यों चुनें, browser extension या SaaS tool के बजाय? चलिए ईमानदारी से तुलना करते हैं:

Manual Copy-Paste

- फायदे: कोई setup नहीं, कोई risk नहीं (जब तक carpal tunnel न हो जाए)

- नुकसान: धीमा, error-prone, scale करना लगभग असंभव

Browser Extensions (जैसे PhantomBuster, Evaboot)

- फायदे: आसान setup, coding की ज़रूरत नहीं, छोटे jobs के लिए ठीक

- नुकसान: सीमित scale, ban का जोखिम, अक्सर Sales Navigator की ज़रूरत, monthly fees

SaaS APIs (जैसे Bright Data, Apify)

- फायदे: बड़ा scale, कम maintenance, provider compliance संभालता है

- नुकसान: volume पर महँगा, कभी-कभी धीमा या cached data, flexibility कम

Python Scripts

- फायदे: सबसे ज़्यादा flexibility, scale पर सबसे कम per-row cost, real-time data

- नुकसान: technical skill चाहिए, ban risk सबसे ज़्यादा, ongoing maintenance

यहाँ side-by-side comparison है:

| पहलू | DIY Python | Browser Extension | SaaS API |

|---|---|---|---|

| Setup time | Days–weeks | Minutes | Hours |

| Technical skill | High | Low | Medium |

| Cost (10K rows) | ~$200 (proxies) | $50–300 | $300–500 |

| Scale ceiling | High | Low–Medium | High |

| Ban risk | सबसे ज़्यादा | High | सबसे कम |

| Data freshness | Real-time | Real-time | Cached |

| Maintenance | चलती रहती है | Low | None |

| Compliance | User-owned risk | User-owned risk | Provider-owned |

निष्कर्ष: अगर आप technical हैं और पूरा control चाहते हैं, तो Python का मुकाबला नहीं। लेकिन ज़्यादातर business users के लिए जैसे tools LinkedIn data पाने का कहीं तेज़ और सुरक्षित रास्ता देते हैं—खासकर जब LinkedIn की defenses हर साल और कड़ी होती जा रही हैं।

शुरुआत कैसे करें: अपना Python LinkedIn Scraper सेटअप करना

तैयार हैं शुरुआत करने के लिए? 2026 में LinkedIn scraping के लिए अपना Python environment ऐसे सेट करें:

1. Python और ज़रूरी Libraries Install करें

- सबसे अच्छी compatibility के लिए Python 3.10+ recommended है।

- Core libraries:

- Playwright (browser automation का नया standard)

- Selenium (अब भी popular, लेकिन धीमा और detect करना आसान)

- Beautiful Soup (HTML parsing के लिए)

- Requests (simple HTTP requests के लिए; LinkedIn पर सीमित उपयोग)

- pandas (data cleaning/export के लिए)

pip से install करें:

1pip install playwright selenium beautifulsoup4 pandasPlaywright के लिए browser binaries भी install करने होंगे:

1playwright install2. Browser Drivers सेट करें

- Playwright अपने drivers खुद manage करता है।

- Selenium को या चाहिए।

- सुनिश्चित करें कि browser और driver version match करते हों।

3. Login के लिए तैयारी करें

- आपको LinkedIn account चाहिए (बेहतर होगा कि पुराना हो और उसमें real activity हो)।

- ज़्यादातर scripts के लिए, आप या तो:

- login flow को automate करेंगे (CAPTCHA का risk)

- या अपना

li_atsession cookie inject करेंगे (तेज़, लेकिन फिर भी risky)

4. LinkedIn की Terms का सम्मान करें

चेतावनी: अपने account से भी LinkedIn scrape करना उनकी User Agreement का उल्लंघन है। कानूनी स्थिति जटिल है (hiQ v. LinkedIn case देखें), और LinkedIn enforcement में अब बहुत सख्त है। इन scripts का इस्तेमाल केवल educational या internal research के लिए करें, और scraped data को कभी बेचें या public तौर पर distribute न करें।

LinkedIn की Restrictions को समझना: 2026 में Account Ban का Risk कैसे कम करें

अब मामला थोड़ा कठिन हो जाता है। 2026 में LinkedIn की anti-bot defenses मज़ाक नहीं हैं। उन्होंने पूरे-के-पूरे businesses बंद कर दिए हैं (Proxycurl को याद करें) और केवल 2025 में 30 million से ज़्यादा accounts restrict किए (). तो बिना नुकसान के scrape कैसे करें?

मुख्य जोखिम

- Rate Limits: बिना login वाले users को लगभग 50 profile views per day per IP मिलते हैं। Logged-in accounts CAPTCHA या ban से पहले कुछ सौ तक कर सकते हैं ().

- CAPTCHAs: खासकर तेज़ profile views या login के बाद बार-बार आते हैं।

- Account Restrictions: LinkedIn suspicious activity पर account lock, restrict या permanently ban कर सकता है।

जोखिम कम करने की proven strategies

- Mobile या Aged Residential Proxies इस्तेमाल करें: LinkedIn पर mobile proxies का 85% survival rate है, residential का 50%, और datacenter IPs का लगभग zero ().

- Delays Randomize करें: fixed

time.sleep(5)न लगाएँ। 2–8 seconds के बीच random delays रखें। - Accounts को Warm Up करें: नए account से सीधे 100 profiles न खोलें। धीरे शुरू करें और real user behavior जैसा व्यवहार करें।

- Business Hours में Scrape करें: अपने account के timezone से मिलते-जुलते समय में करें।

- हर Session में User Agents Rotate करें: लेकिन session के बीच में न बदलें—LinkedIn इसे पकड़ लेता है।

- Natural Scrolling करें: browser automation से scroll करें ताकि lazy-loaded content trigger हो।

- हर Account के लिए अलग IP रखें: एक proxy के पीछे multiple accounts कभी न चलाएँ।

- Early Warnings पर नज़र रखें: 429 errors,

/authwallredirects, या empty profile bodies बताती हैं कि ban करीब है।

Pro tip: सबसे अच्छे stealth plugins (Playwright Stealth, undetected-chromedriver) भी सिर्फ़ surface-level fingerprints को patch करते हैं। LinkedIn की detection इससे कहीं गहरी है—इसलिए overconfident न हों।

LinkedIn data extraction python के लिए सही Python Libraries चुनना

2026 में Python scraping landscape पहले से कहीं साफ़ है। मुख्य libraries की तुलना देखें:

| Library | Static HTML | JS-rendered | Login flows | Speed | Best for |

|---|---|---|---|---|---|

| Requests + BS4 | ✅ | ❌ | ❌ | सबसे तेज़ | छोटे, public-only pages |

| Selenium 4.x | ✅ | ✅ | ✅ | धीमा | Legacy, broad browser support |

| Playwright (Python) | ✅ | ✅ | ✅ | तेज़ | 2026 में LinkedIn के लिए default |

| Scrapy | ✅ | With plugin | With effort | Fast | High-volume structured crawls |

LinkedIn के लिए Playwright क्यों बेहतर है:

- Selenium की तुलना में 12% तेज़ page loads और 15% कम memory usage ()

- LinkedIn की asynchronous loading को बिना manual hacks के संभालता है

- Parallel scraping के लिए native tab management

- Basic fingerprint evasion के लिए official stealth plugin

Beginner tip: अगर आप अभी शुरुआत कर रहे हैं, तो Playwright सबसे अच्छा विकल्प है। Selenium अभी भी legacy projects के लिए उपयोगी है, लेकिन यह धीमा है और detect करना आसान है।

Step-by-Step: आपका पहला Python LinkedIn scraper Script

आइए Selenium (beginners के लिए) और Playwright (production के लिए) का एक basic example देखें। याद रखें: ये scripts केवल educational use के लिए हैं।

Example 1: Minimal Selenium Login और Profile Scrape

1from selenium import webdriver

2from selenium.webdriver.common.by import By

3from selenium.webdriver.common.keys import Keys

4import time, random

5driver = webdriver.Chrome()

6driver.get("https://www.linkedin.com/login")

7driver.find_element(By.ID, "username").send_keys("you@example.com")

8driver.find_element(By.ID, "password").send_keys("yourpassword" + Keys.RETURN)

9time.sleep(random.uniform(3, 6)) # randomized delay

10# Visit a profile

11driver.get("https://www.linkedin.com/in/some-profile/")

12time.sleep(random.uniform(4, 8))

13# Scroll to trigger lazy-load

14driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

15# Extract data (simplified)

16name = driver.find_element(By.CSS_SELECTOR, "h1").text

17print("Name:", name)

18driver.quit()नोट: Production में, हर बार login करने के बजाय अपना li_at cookie inject करना बेहतर रहेगा (CAPTCHA से बचने के लिए)।

Example 2: Playwright Async Scraper (2026 के लिए recommended)

1import asyncio

2from linkedin_scraper import BrowserManager, PersonScraper

3async def main():

4 async with BrowserManager() as browser:

5 await browser.load_session("session.json") # stores your login session

6 scraper = PersonScraper(browser.page)

7 person = await scraper.scrape("https://linkedin.com/in/username")

8 print(person.name, person.experiences)

9asyncio.run(main())()

Anti-ban measures कहाँ डालें:

- अपने browser manager में mobile proxies इस्तेमाल करें

- actions के बीच random delays रखें

- एक बार में सब कुछ नहीं, छोटे batches में scrape करें

Warning: LinkedIn जब भी अपना DOM update करता है (जो हर कुछ हफ्तों में होता है), कोई भी selector-based scraper टूट सकता है। अपनी scripts को maintain करने के लिए तैयार रहें।

Python से LinkedIn Data को साफ़ और format करना

Scraping तो सिर्फ़ आधा काम है। LinkedIn data अक्सर messy होता है—duplicate names, inconsistent job titles, और weird Unicode characters सोचिए। इसे साफ़ कैसे करें:

1. Table Wrangling के लिए pandas का इस्तेमाल करें

1import pandas as pd

2df = pd.read_csv("linkedin_raw.csv")

3df = df.drop_duplicates(subset=["email", "phone"]) # Exact dedupe

4df["name"] = df["name"].str.lower().str.strip()2. Company Names के लिए Fuzzy Matching

1from rapidfuzz import fuzz

2def is_similar(a, b):

3 return fuzz.ratio(a, b) > 90

4# Example: "Acme Corp" vs "ACME Corporation"3. Phone Numbers और Emails Normalize करें

1import phonenumbers

2from email_validator import validate_email, EmailNotValidError

3# Phone normalization

4num = phonenumbers.parse("+1 415-555-1234", None)

5print(phonenumbers.format_number(num, phonenumbers.PhoneNumberFormat.E164))

6# Email validation

7try:

8 v = validate_email("someone@example.com")

9 print(v.email)

10except EmailNotValidError as e:

11 print("Invalid email:", e)4. Excel, Google Sheets, या CRM में Export करें

- Excel:

df.to_excel("cleaned_data.xlsx") - Google Sheets:

gspreadlibrary का इस्तेमाल करें - Airtable:

pyairtableका इस्तेमाल करें - Salesforce/HubSpot: उनके संबंधित Python API clients का उपयोग करें

Pro tip: CRM में import करने से पहले data को हमेशा साफ़ और deduplicate करें। एक ही prospect को दो बार call करना sales rep के मूड को तुरंत खराब कर देता है।

Thunderbit के साथ LinkedIn scraping को automate करना की Efficiency बढ़ाएँ

अब बात करते हैं आपकी ज़िंदगी को और आसान बनाने की। मुझे Python पसंद है, लेकिन LinkedIn scrapers maintain करना एक never-ending whack-a-mole game जैसा है। इसी वजह से, Thunderbit में हमने एक बनाया है, जो LinkedIn data extraction की परेशानी कम करता है।

Thunderbit क्यों?

- 2-Click Scraping: बस “AI Suggest Fields” पर क्लिक करें और Thunderbit page पढ़कर columns suggest करता है और data extract कर देता है—ना code, ना selectors, ना headaches.

- Subpage Scraping: पहले search results page scrape करें, फिर Thunderbit को हर profile पर जाकर आपकी table को automatically enrich करने दें।

- Instant Templates: LinkedIn, Amazon, Google Maps, और अन्य के लिए पहले से तैयार—कुछ ही seconds में शुरू करें।

- Free Export: Data को Excel, Google Sheets, Airtable, Notion में भेजें या CSV/JSON के रूप में download करें।

- AI Autofill: Form-filling और repetitive workflows automate करें—sales ops और CRM admins के लिए शानदार।

- Cloud या Browser Scraping: अपने use case और login needs के हिसाब से mode चुनें।

- No Maintenance: Thunderbit की AI LinkedIn layout changes के साथ adapt हो जाती है, इसलिए आपको बार-बार टूटे हुए scripts ठीक नहीं करने पड़ते।

Thunderbit पर दुनिया भर के 100,000 से ज़्यादा users भरोसा करते हैं और Chrome Web Store पर इसकी 4.4★ rating है (). ज़्यादातर business users के लिए, यह LinkedIn data निकालने का सबसे तेज़ और सुरक्षित तरीका है—अपने account या मानसिक शांति को जोखिम में डाले बिना।

Advanced Tips: LinkedIn Scraping Workflows को Scale और automate करना

अगर आप pro level पर जाना चाहते हैं, तो LinkedIn scraping को scale करने का तरीका यह है:

1. Scripts को Schedule करना

- साधारण jobs के लिए cron (Linux/Mac) या Task Scheduler (Windows)

- Python-native scheduling और retries के लिए APScheduler या Prefect 3

- enterprise-grade orchestration के लिए Airflow

2. Cloud Deployment

- AWS Lambda (container में Playwright के साथ)

- GCP Cloud Run

- आसान Playwright hosting के लिए Railway / Fly.io / Render

- scraping-specific cloud workflows के लिए Apify

3. Monitoring और Drift Detection

- error tracking के लिए Sentry

- 429 errors या DOM changes में spikes के लिए custom alerts

- LinkedIn layout बदलने पर पकड़ने के लिए hash-based diffing

4. CRM Integration

- साफ़ data को automatically push करने के लिए Salesforce, HubSpot, Notion, या Airtable APIs का इस्तेमाल करें

- एक pipeline बनाएं: Scheduler → Scraper → pandas clean/dedupe → Enrichment → CRM push → Alerts

5. Compliance बनाए रखना

- एक account पर दिन में कुछ सौ profiles से ज़्यादा कभी न scrape करें

- proxies और user agents rotate करें

- ban के शुरुआती संकेतों पर नज़र रखें और दिखते ही scripts रोक दें

Pro tip: इतने automation के बावजूद LinkedIn नियम बदल सकता है और बदलता भी है। हमेशा backup plan रखें—और सबसे महत्वपूर्ण workflows के लिए Thunderbit इस्तेमाल करने पर विचार करें।

निष्कर्ष और मुख्य बातें

2026 में Python से LinkedIn scraping पहले से कहीं ज़्यादा शक्तिशाली भी है और जोखिम भरा भी। याद रखने वाली बातें:

- LinkedIn #1 B2B data source है—लेकिन scrapers के खिलाफ सबसे सख्ती से सुरक्षित भी।

- Python LinkedIn data extraction के लिए maximum flexibility देता है, लेकिन ban risk और ongoing maintenance भी साथ लाता है।

- Playwright अब LinkedIn scraping का gold standard है—Selenium से तेज़ और ज़्यादा reliable।

- Ban risk कम करने की कुंजी proxies, delays, और real user behavior की नकल है—mobile proxies का survival 85%, residential का 50%, datacenter का 0%।

- Data cleaning बेहद ज़रूरी है—CRM में import करने से पहले pandas, fuzzy matching, और validation libraries इस्तेमाल करें।

- Thunderbit एक सुरक्षित और तेज़ विकल्प देता है—AI-powered scraping, subpage enrichment, instant export, और बिना code के।

- Scale करना मतलब हर चीज़ को automate करना है—scheduling से लेकर monitoring और CRM integration तक।

और सबसे ज़रूरी बात: ethical और responsible तरीके से scrape करें। LinkedIn की legal team अपनी sense of humor के लिए मशहूर नहीं है।

अगर आप LinkedIn की बदलती defenses से लड़ते-लड़ते थक गए हैं, तो . यह वह tool है जिसकी मुझे शुरुआत में ज़रूरत थी—और यह शायद आपको (और आपके LinkedIn account को) बहुत परेशानी से बचा सकता है।

और गहराई में जाना चाहते हैं? web scraping, automation, और sales ops best practices पर और guides के लिए देखें।

FAQs

1. क्या 2026 में Python से LinkedIn scrape करना legal है?

कानूनी स्थिति जटिल है। hiQ v. LinkedIn case में public data scraping को CFAA violation नहीं माना गया, लेकिन LinkedIn अपनी User Agreement लागू कर सकता है और करता भी है, जिसमें scraping प्रतिबंधित है। 2025 में LinkedIn ने Proxycurl बंद किया और scraping के लिए 30 million से ज़्यादा accounts restrict किए। इन scripts का उपयोग हमेशा internal या educational purposes के लिए करें, और scraped data को कभी बेचें या public रूप से distribute न करें।

2. LinkedIn scraping automate करने का सबसे सुरक्षित तरीका क्या है?

पुराने accounts, mobile proxies (85% survival rate), randomized delays, और business hours में scraping का उपयोग करें। Datacenter IPs कभी न इस्तेमाल करें, और शुरुआती ban संकेतों पर नज़र रखें। ज़्यादातर business users के लिए जैसे tools DIY Python scripts की तुलना में बहुत कम risk वाला विकल्प देते हैं।

3. 2026 में LinkedIn scraping के लिए कौन-सी Python library सबसे अच्छी है?

Playwright अब default choice है—यह तेज़ है, ज़्यादा reliable है, और Selenium की तुलना में LinkedIn के dynamic content को बेहतर संभालता है। Simple public pages के लिए Requests + Beautiful Soup अभी भी काम करता है, लेकिन login या JavaScript वाली किसी भी चीज़ के लिए Playwright इस्तेमाल करें।

4. Scraping के बाद LinkedIn data को कैसे clean और format करें?

Table wrangling और deduplication के लिए pandas, fuzzy matching के लिए RapidFuzz, contact info के लिए phonenumbers और email-validator, और अपने Python libraries के ज़रिए Excel, Google Sheets, या CRM में export करें।

5. Thunderbit LinkedIn data extraction को कैसे बेहतर बनाता है?

Thunderbit AI की मदद से fields suggest करता है, subpage scraping संभालता है, और data को सीधे आपके पसंदीदा tools में export करता है—कोई code नहीं चाहिए। यह LinkedIn के frequent layout changes के साथ adapt हो जाता है, जिससे maintenance और ban risk कम होता है। ऊपर से, इसे आज़माना free है और दुनिया भर के 100,000 से ज़्यादा users इस पर भरोसा करते हैं।

बिना झंझट LinkedIn scraping को काम करते देखना चाहते हैं? और सिर्फ़ दो clicks में data extract करना शुरू करें। आपकी sales team (और आपका LinkedIn account) आपका धन्यवाद करेंगे।

और जानें