Airbnb 220+ देशों में होस्ट करता है — और मार्केट डेटा के लिए कोई सार्वजनिक API एक्सेस नहीं देता। अगर आपको प्राइसिंग इंटेलिजेंस, प्रतियोगी बेंचमार्क, या रिसर्च डेटासेट चाहिए, तो स्क्रैपिंग लगभग आपका एकमात्र विकल्प है।

दिक्कत यह है कि आधुनिक वेब पर Airbnb सबसे मुश्किल साइटों में से एक है जिसे स्क्रैप करना होता है। यह Akamai Bot Manager से संचालित एक कस्टम WAF चलाता है, React के साथ सारी चीज़ें क्लाइंट-साइड पर रेंडर करता है, और CSS class names को वैसे ही बदलता रहता है जैसे कोई घबराया हुआ ताला बनाने वाला चाबी बदलता रहे। मैंने Airbnb scraping के लिए अलग-अलग तरीकों को काफ़ी समय तक टेस्ट किया है — हल्की HTTP libraries से लेकर full browser automation और no-code AI tools तक — और हकीकत यह है कि कोई भी एक तरीका हर use case के लिए पूरी तरह परफेक्ट नहीं होता।

यह गाइड पाँचों व्यावहारिक तरीकों को रियल कोड, ईमानदार tradeoffs, और अपने IP को बेवजह ब्लॉक होने से बचाने के practical tips के साथ समझाती है। चाहे आप Python developer हों, data analyst हों, या बस एक spreadsheet चाहने वाले real estate investor — आपके लिए यहाँ एक रास्ता है।

Airbnb क्यों स्क्रैप करें? असली दुनिया के उपयोग

कोई भी nested HTML पार्स करने के रोमांच के लिए Airbnb स्क्रैप नहीं करता। लोगों के अपने खास प्रोजेक्ट और business goals होते हैं — सबसे आम छह ये हैं:

| उपयोग का मामला | आप क्या स्क्रैप कर रहे हैं | यह कौन करता है |

|---|---|---|

| डायनामिक प्राइसिंग रणनीति | एक निश्चित radius में प्रतियोगियों की प्रति-रात दरें | होस्ट, प्रॉपर्टी मैनेजर |

| निवेश विश्लेषण | occupancy के संकेतक (review frequency, calendar availability), ADR, RevPAR | रियल एस्टेट निवेशक |

| क्लीनिंग फ़ीस बेंचमार्किंग | अलग-अलग property types के लिए cleaning fees (औसत सीमा $81–$335 in major US cities) | होस्ट, प्राइसिंग कंसल्टेंट |

| रिव्यू sentiment analysis | NLP/sentiment scoring के लिए गेस्ट रिव्यू | डेटा वैज्ञानिक, हॉस्पिटैलिटी टीमें |

| शैक्षणिक शोध | हाउसिंग पॉलिसी, पर्यटन, शहरी अर्थशास्त्र के लिए मार्केट-स्तरीय डेटासेट | शोधकर्ता (1,021 Airbnb-संबंधित academic papers में से 48.7% ने स्क्रैप किए गए डेटा का इस्तेमाल किया) |

| प्रतियोगी ट्रैकिंग | नई लिस्टिंग, कीमतों में बदलाव, समय के साथ उपलब्धता | STR ऑपरेटर, मार्केट विश्लेषक |

कीमत मॉनिटरिंग या प्रतियोगी ट्रैकिंग जैसे ongoing use cases के लिए scheduled या automated scraping खास तौर पर उपयोगी होता है — आपको ताज़ा डेटा चाहिए, सिर्फ़ एक बार की snapshot नहीं।

शॉर्ट-टर्म रेंटल मार्केट पारंपरिक होटलों से तेज़ी से बढ़ रहा है: STR demand जबकि होटल demand में 0.3% की गिरावट आई। अगर आप इस क्षेत्र में हैं, तो डेटा ही आपकी बढ़त है।

Airbnb को स्क्रैप करना इतना मुश्किल क्यों है

कोड की एक भी line लिखने से पहले यह समझना मददगार होता है कि Airbnb को स्क्रैपिंग difficulty में क्यों माना जाता है। तीन समस्याएँ एक-दूसरे के ऊपर जुड़ जाती हैं।

Airbnb की एंटी-बॉट सुरक्षा

Airbnb एक custom WAF के साथ का इस्तेमाल करता है, जो enterprise-grade bot detection system है और हर request को कई dimensions पर एक साथ score करता है। यह सिर्फ़ rate limiting नहीं है — यह AI-driven fingerprinting है।

जोखिम स्तर के हिसाब से detection stack:

- TLS Fingerprinting (उच्च): Python की

requestslibrary की TLS handshake signature अलग होती है, जो किसी असली browser से मेल नहीं खाती। Akamai JA3/JA4 methods से cipher suites, extensions, और ALPN order का विश्लेषण करता है। साधारणrequestsprotected sites पर लगभग देता है, जबकि browser TLS fingerprints को spoof करने वाली libraries 92% तक पहुँचती हैं। - JavaScript Execution (उच्च): Akamai client-side scripts चलाता है जो “sensor data” — device properties, hardware capabilities, OS details — इकट्ठा करते हैं। इससे

_abckcookie बनती है। यह JavaScript चलाए बिना requests block हो जाती हैं। - Browser Fingerprinting (उच्च): Canvas, WebGL, और font analysis automation tools को पकड़ते हैं। Headless browsers में

navigator.webdriverflags, missing plugins, और inconsistent hardware values दिखते हैं। - HTTP Header Analysis (उच्च):

Sec-Fetch-*headers की कमी Airbnb पर 403 blocks का एक है। - IP Reputation (मध्यम): Datacenter IPs तुरंत block हो जाते हैं। बड़े पैमाने पर residential proxies ज़रूरी हैं।

- Behavioral Analysis (मध्यम): बहुत नियमित timing, mouse movement नहीं, scrolling नहीं — ये सब साफ़ संकेत हैं।

जब block होते हैं, तो आपको यह दिख सकता है: 403 Forbidden (fingerprint failure), 429 Too Many Requests (rate limit), 503 Service Unavailable (Akamai challenge page), या CAPTCHA page।

Airbnb के dynamic, JavaScript-heavy पेज

Airbnb पर सामान्य requests.get() एक React shell लौटाता है जिसमें placeholder HTML होता है — असली listing data नहीं। जैसा : “साधारण HTTP requests बस काम नहीं करतीं, और सही proxies और असली JavaScript rendering के बिना आप Airbnb को स्क्रैप नहीं कर रहे, आप placeholders को स्क्रैप कर रहे हैं।”

असल डेटा client-side पर internal GraphQL API calls के ज़रिए लाया जाता है (/api/v3/StaysSearch search results के लिए, /api/v3/PdpPlatformSections listing details के लिए)। इसका मतलब है कि ज़्यादातर useful data के लिए या तो full browser चाहिए या API interception।

DOM लगातार बदलता रहता है

Airbnb CSS-in-JS का इस्तेमाल करता है, जिसमें hashed class names हर deployment के साथ बदल जाते हैं। दर्ज उदाहरणों में _tyxjp1, lxq01kf, atm_mk_h2mmj6, t1jojoys, और _8s3ctt शामिल हैं। जैसा बताता है: “ये classes स्थिर रहने के लिए नहीं बनाई गई हैं और कभी भी बदल सकती हैं, अक्सर बिना page में किसी दृश्य बदलाव के।”

डेवलपर समुदाय ने इस समस्या को काफ़ी विस्तार से दर्ज किया है। कि “CSS classes हर समय बदलती रहती हैं, और उन पर निर्भर रहना आपके scraper को तोड़ने का तेज़ तरीका है।” DEV Community पर एक अनुभवी developer ने इसे अच्छी तरह समेटा: “ऐसा scraper जो 50% धीमा चले लेकिन कभी न टूटे, उस तेज़ scraper से अनंत गुना ज़्यादा मूल्यवान है जो हर हफ़्ते मर जाता है।”

उद्योग के अनुमान बताते हैं कि क्योंकि DOM shifts, fingerprinting updates, या endpoint throttling होती रहती हैं।

अपना तरीका चुनें: Airbnb स्क्रैप करने के 5 रास्ते

कोड शुरू करने से पहले, यह रहा तुलना-सार। हर तरीके के असली tradeoffs हैं — कोई भी एक सर्वव्यापी “best” तरीका नहीं है।

| तरीका | सेटअप मेहनत | गति | एंटी-बॉट सहनशीलता | मेंटेनेंस | किसके लिए सबसे अच्छा |

|---|---|---|---|---|---|

Pure HTTP (requests / pyairbnb) | कम | तेज़ | मध्यम (API changes के लिए नाज़ुक) | मध्यम | त्वरित रिसर्च, छोटे डेटासेट |

| Browser automation (Selenium) | अधिक | धीमा | मध्यम | अधिक (DOM breakage) | डायनामिक कंटेंट, तारीख-आधारित pricing |

| Browser automation (Playwright) | मध्यम | मध्यम | मध्यम-उच्च | मध्यम | Selenium का आधुनिक विकल्प |

| Scraping API (ScrapingBee, Bright Data) | कम | तेज़ | उच्च (proxy rotation built-in) | कम | बड़े पैमाने पर scraping, production use |

| No-code (Thunderbit) | बहुत कम | तेज़ | उच्च (AI layout changes के अनुसार खुद को ढालता है) | नहीं के बराबर | non-developers, one-off analysis |

इस लेख का बाकी हिस्सा Python तरीकों को step by step समझाता है, और आखिर में उन लोगों के लिए एक no-code section है जो code से पूरी तरह बचना चाहते हैं।

चरण-दर-चरण: Requests का उपयोग करके Python से Airbnb स्क्रैप करें (HTTP-First तरीका)

यह हल्का और तेज़-शुरुआत वाला विकल्प है — browser की ज़रूरत नहीं, chromedriver की झंझट नहीं। tradeoff यह है कि यह कुछ डेटा के लिए काम करता है, सबके लिए नहीं।

अपना Python environment सेट करना

एक project folder बनाएँ और virtual environment सेट करें:

1mkdir airbnb-scraper && cd airbnb-scraper

2python -m venv venv

3source venv/bin/activate # Windows: venv\Scripts\activate

4pip install requests beautifulsoup4 pandas pyairbnbpyairbnb एक हल्की library है (, आख़िरी release फ़रवरी 2026) जो Airbnb के internal StaysSearch GraphQL API को intercept करती है। यह HTML को बिल्कुल स्क्रैप नहीं करती, इसलिए CSS class changes से काफ़ी हद तक सुरक्षित रहती है। एकल-maintainer मॉडल risk factor है, लेकिन इसे सक्रिय रूप से अपडेट किया जाता है।

विकल्प A: त्वरित search results के लिए pyairbnb का उपयोग

संरचित Airbnb डेटा पाने का सबसे तेज़ रास्ता:

1import pyairbnb

2import pandas as pd

3# स्थान और तारीखों के आधार पर खोजें

4results = pyairbnb.search_all(

5 query="Austin, TX",

6 checkin="2025-08-01",

7 checkout="2025-08-03",

8 adults=2,

9 currency="USD"

10)

11# DataFrame में बदलें

12df = pd.DataFrame(results)

13print(df[['name', 'price', 'rating', 'reviewsCount', 'url']].head())

14df.to_csv("airbnb_austin.csv", index=False)pyairbnb get_details(), get_price(), get_reviews(), get_calendar(), और get_listings_from_user() को भी सपोर्ट करता है। सभी functions proxy URL parameter को rotation के लिए स्वीकार करते हैं।

विकल्प B: BeautifulSoup के साथ मैन्युअल HTTP requests

अगर आप किसी third-party library पर निर्भर नहीं रहना चाहते, तो सीधे requests भेज सकते हैं। स्पष्ट चेतावनी: साधारण requests TLS fingerprinting के कारण जल्दी block हो जाती है। curl_cffi (जो browser TLS fingerprints को spoof करता है) का उपयोग सफलता दर को काफ़ी बढ़ा देता है।

1from curl_cffi import requests as cffi_requests

2from bs4 import BeautifulSoup

3import json

4url = "https://www.airbnb.com/s/Austin--TX/homes?checkin=2025-08-01&checkout=2025-08-03&adults=2"

5headers = {

6 "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/131.0.0.0 Safari/537.36",

7 "Accept-Language": "en-US,en;q=0.9",

8 "Sec-Fetch-Dest": "document",

9 "Sec-Fetch-Mode": "navigate",

10 "Sec-Fetch-Site": "none",

11 "Sec-Fetch-User": "?1",

12}

13response = cffi_requests.get(url, headers=headers, impersonate="chrome131")

14soup = BeautifulSoup(response.text, "html.parser")Schema.org microdata से डेटा निकालना

Airbnb HTML markup में सीधे schema.org microdata एम्बेड करता है — और ये semantic tags CSS class selectors की तुलना में होते हैं। itemprop="itemListElement" containers देखें:

1listings = soup.find_all("div", itemprop="itemListElement")

2data = []

3for listing in listings:

4 name_tag = listing.find("meta", itemprop="name")

5 url_tag = listing.find("meta", itemprop="url")

6 position_tag = listing.find("meta", itemprop="position")

7 data.append({

8 "name": name_tag["content"] if name_tag else None,

9 "url": url_tag["content"] if url_tag else None,

10 "position": position_tag["content"] if position_tag else None,

11 })

12df = pd.DataFrame(data)

13df.to_csv("airbnb_listings.csv", index=False)सीमा यह है कि schema.org tags से आपको listing names, URLs, और positions मिलती हैं — लेकिन prices, ratings, या amenities नहीं। ज़्यादा समृद्ध डेटा के लिए browser automation या API interception चाहिए।

चरण-दर-चरण: Selenium या Playwright से Python में Airbnb स्क्रैप करें

जब आपको dynamic content चाहिए — तारीख पर निर्भर pricing, "Show more" बटन के पीछे छिपी amenities, पूरा review text — तब browser automation सही tool है।

Browser automation का उपयोग कब करें

- ऐसे पेज जहाँ actual pricing दिखाने के लिए date selection ज़रूरी हो

- interactive elements के पीछे छिपी amenities और reviews

- कोई भी डेटा जो सिर्फ़ JavaScript execution के बाद लोड होता है

- जब आपको page के साथ interact करना हो (scrolling, clicking)

Selenium बनाम Playwright: ज़्यादातर मामलों में Playwright जीत चुका है

Playwright ने पसंदीदा browser automation tool के रूप में Selenium को पीछे छोड़ दिया है। यह तेज़ है, built-in async support देता है, browser binaries auto-install करता है, और modern web apps को बेहतर संभालता है। Selenium की — जहाँ ChromeDriver, Chrome updates से पीछे रह जाता है — अब भी लगातार सिरदर्द बनी हुई है।

फिर भी, Selenium के tutorials और StackOverflow answers का ecosystem बड़ा है — इसलिए वही इस्तेमाल करें जिसमें आप सहज हों।

Playwright सेट करना

1pip install playwright playwright-stealth

2playwright install chromiumAirbnb पर जाना और listings निकालना

1import asyncio

2from playwright.async_api import async_playwright

3from playwright_stealth import stealth_async

4import json

5async def scrape_airbnb():

6 async with async_playwright() as p:

7 browser = await p.chromium.launch(headless=False) # headless=True ज़्यादा जोखिम भरा है

8 context = await browser.new_context(

9 viewport={"width": 1920, "height": 1080},

10 user_agent="Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/131.0.0.0 Safari/537.36"

11 )

12 page = await context.new_page()

13 await stealth_async(page)

14 url = "https://www.airbnb.com/s/Austin--TX/homes?checkin=2025-08-01&checkout=2025-08-03&adults=2"

15 await page.goto(url, wait_until="networkidle")

16 # class names की तुलना में अधिक स्थिर data-testid से listing cards आने तक प्रतीक्षा करें

17 await page.wait_for_selector('[data-testid="card-container"]', timeout=15000)

18 # listing data निकालें

19 listings = await page.query_selector_all('[data-testid="card-container"]')

20 results = []

21 for listing in listings:

22 title_el = await listing.query_selector('[data-testid="listing-card-title"]')

23 subtitle_el = await listing.query_selector('[data-testid="listing-card-subtitle"]')

24 title = await title_el.inner_text() if title_el else None

25 subtitle = await subtitle_el.inner_text() if subtitle_el else None

26 results.append({"title": title, "subtitle": subtitle})

27 await browser.close()

28 return results

29data = asyncio.run(scrape_airbnb())GraphQL API को intercept करना (सबसे भरोसेमंद DIY तरीका)

DOM elements पार्स करने के बजाय जो लगातार टूटते रहते हैं, आप Airbnb के internal API calls को intercept कर सकते हैं। इससे साफ़, संरचित JSON मिलता है:

1api_responses = []

2async def handle_response(response):

3 if "StaysSearch" in response.url:

4 try:

5 data = await response.json()

6 api_responses.append(data)

7 except:

8 pass

9page.on("response", handle_response)

10await page.goto(url, wait_until="networkidle")

11# API response पार्स करें

12if api_responses:

13 search_results = api_responses[0]["data"]["presentation"]["staysSearch"]["results"]["searchResults"]

14 for result in search_results:

15 listing = result.get("listing", {})

16 pricing = result.get("pricingQuote", {})

17 print(f"{listing.get('name')} — {pricing.get('price', {}).get('total')}")StaysSearch response में id, name, roomTypeCategory, bedrooms, bathrooms, personCapacity, avgRating, reviewsCount, isSuperhost, और full pricing breakdowns शामिल होते हैं। यही डेटा Airbnb का frontend पेज रेंडर करने के लिए इस्तेमाल करता है।

Pagination को संभालना

Airbnb लगभग 18 listings प्रति पेज दिखाता है और items_offset URL parameter का उपयोग करता है। अधिकतम लगभग 17 pages (~300 listings per search) होते हैं।

1import time

2import random

3base_url = "https://www.airbnb.com/s/Austin--TX/homes?checkin=2025-08-01&checkout=2025-08-03&adults=2"

4all_results = []

5for page_num in range(17): # अधिकतम ~17 पेज

6 offset = page_num * 18

7 paginated_url = f"{base_url}&items_offset={offset}"

8 # ... ऊपर की तरह navigate और scrape करें ...

9 time.sleep(random.uniform(3, 7)) # पेजों के बीच यादृच्छिक देरीPython से Airbnb की pricing कैसे स्क्रैप करें (तारीख-निर्भर price समस्या का समाधान)

यह वह हिस्सा है जिसे ज़्यादातर tutorials छोड़ देते हैं — और pricing analysis के लिए सबसे महत्वपूर्ण भी यही है।

तारीखों के बिना Airbnb कीमतें क्यों नहीं दिखतीं

लगभग 90% समय, Airbnb वास्तविक price दिखाने से पहले check-in/check-out dates मांगता है। तारीखों के बिना, आपको एक धुंधली “price per night” range (या कभी-कभी कोई price नहीं) मिलती है। जैसा : “अगर कोई listing price नहीं दिखाती (उदाहरण के लिए, अगर Airbnb आपसे dates या guest count समायोजित करने को कह रहा हो), तो function बस None लौटाती है।”

अच्छी खबर: अप्रैल 2025 तक Airbnb अब । पहले “Display Total Price” toggle उपलब्ध था — लगभग 1.7 करोड़ मेहमानों ने इसे default बनने से पहले इस्तेमाल किया था।

URL parameters के ज़रिए dates पास करना

अपने search URL में हमेशा checkin और checkout शामिल करें:

1https://www.airbnb.com/s/Austin--TX/homes?checkin=2025-08-01&checkout=2025-08-03&adults=2यह Airbnb को page और API responses में असली per-night और total pricing लौटाने के लिए प्रेरित करता है।

pricing analysis के लिए date ranges पर iteration

उन hosts और investors के लिए जिन्हें seasons के across pricing data चाहिए:

1from datetime import datetime, timedelta

2start_date = datetime(2025, 7, 1)

3end_date = datetime(2025, 12, 31)

4stay_length = 2 # रातें

5current = start_date

6date_ranges = []

7while current + timedelta(days=stay_length) <= end_date:

8 checkin = current.strftime("%Y-%m-%d")

9 checkout = (current + timedelta(days=stay_length)).strftime("%Y-%m-%d")

10 date_ranges.append((checkin, checkout))

11 current += timedelta(days=7) # साप्ताहिक अंतराल

12for checkin, checkout in date_ranges:

13 url = f"https://www.airbnb.com/s/Austin--TX/homes?checkin={checkin}&checkout={checkout}&adults=2"

14 # ... pricing data स्क्रैप करें ...

15 time.sleep(random.uniform(5, 10)) # समय के मामले में शालीन रहेंGraphQL API response से pricing पार्स करते समय pricingQuote object देखें, जिसमें price.total, price.priceItems (cleaning fee, service fee जैसे अलग-अलग line items), और rate.amount (nightly rate) होते हैं।

अपनी Python Airbnb scraper को वेबसाइट redesigns से बचाना

यह वह maintenance हिस्सा है जिसे कोई लिखना नहीं चाहता — लेकिन यह किसी भी Airbnb scraping project का शायद सबसे महत्वपूर्ण भाग है।

नाज़ुक बनाम मज़बूत selectors

| Selector रणनीति | टूटने का जोखिम | कोड मेहनत | उदाहरण |

|---|---|---|---|

CSS class names (जैसे .t1jojoys) | 🔴 उच्च — अक्सर बदलती हैं | कम | soup.select('.t1jojoys') |

data-testid attributes | 🟡 मध्यम — अधिक स्थिर | कम | soup.select('[data-testid="listing-card-title"]') |

| HTML में Schema.org microdata | 🟢 कम — संरचनात्मक मानक | मध्यम | soup.find("meta", itemprop="name") |

| GraphQL API interception | 🟢 कम — संरचित JSON | मध्यम | response.json()["data"]["presentation"] |

| AI-based extraction (Thunderbit) | 🟢 शून्य — अपने आप ढल जाता है | नहीं के बराबर | 2-click UI, कोई code नहीं |

data-testid attributes का उपयोग

वर्तमान में Airbnb पर documented data-testid values में card-container, listing-card-title, listing-card-subtitle, और listing-card-name शामिल हैं। ये Airbnb के internal testing framework से जुड़े होते हैं, visual styling से नहीं, इसलिए CSS classes की तुलना में कम बार बदलते हैं। फिर भी ये बदल सकते हैं — बस कम बार।

1# class-based selectors की तुलना में अधिक मज़बूत

2title = await page.query_selector('[data-testid="listing-card-title"]')Schema.org microdata का उपयोग

Airbnb HTML markup में सीधे itemprop attributes इस्तेमाल करता है। ये web standards का पालन करते हैं और visual CSS classes की तुलना में बहुत कम बदलते हैं:

1# schema.org markup का उपयोग करके सभी listing items निकालें

2listings = soup.find_all("div", itemprop="itemListElement")

3for listing in listings:

4 name = listing.find("meta", itemprop="name")["content"]

5 url = listing.find("meta", itemprop="url")["content"]GraphQL API को intercept करना

सबसे भरोसेमंद DIY तरीका। Airbnb का internal API साफ़ JSON लौटाता है, जिसे frontend consume करने के लिए structured किया गया है। response format DOM की तुलना में कम बार बदलता है, क्योंकि frontend team भी उसी पर निर्भर करती है।

AI-based extraction से maintenance लगभग खत्म क्यों हो जाता है

सबसे अच्छे selector strategies भी आखिरकार टूट जाते हैं। data-testid values का नाम बदल सकता है। API response structures versioned हो सकते हैं। जो तरीका maintenance को सचमुच खत्म करता है, वह है AI से हर बार पेज को fresh पढ़ना — बिल्कुल hardcoded selectors नहीं। नीचे Thunderbit section में और है।

Airbnb स्क्रैप करते समय block होने से कैसे बचें

अनुभव और समुदाय की सहमति से मिली practical tips।

Proxies घुमाएँ (Residential अनिवार्य है)

Datacenter IPs Airbnb तुरंत block कर देता है। किसी भी meaningful scale पर residential proxies चाहिए। प्रदर्शन और pricing के हिसाब से शीर्ष providers:

| Provider | कीमत (प्रति GB) | Success Rate | नोट्स |

|---|---|---|---|

| Decodo (पहले Smartproxy) | 100GB पर लगभग $2.20/GB | 99.68% | सबसे तेज़ मापा गया (0.54s response) |

| Bright Data | 100GB पर लगभग $5.04/GB | 99%+ | सबसे बड़ा pool, सबसे ज़्यादा features |

| Oxylabs | 100GB पर लगभग $4/GB | 99%+ | e-commerce के लिए मज़बूत |

एक अनुभवी developer से मिली एक अहम rotation insight: “हर request पर IP बदलना असल में एक red flag है। असली users session के दौरान वही IP रखते हैं।” सिफ़ारिश है 5–10 मिनट की sticky sessions, और हर 20–30 requests पर rotation।

1proxies = {

2 "http": "http://user:pass@residential-proxy:port",

3 "https": "http://user:pass@residential-proxy:port",

4}

5response = cffi_requests.get(url, headers=headers, proxies=proxies, impersonate="chrome131")अपने requests की गति कम रखें

सुरक्षित thresholds पर समुदाय की सहमति:

- प्रति घंटे अधिकतम pages: ≤100 (~1.6/मिनट)

- requests के बीच देरी: 3–10 सेकंड (यादृच्छिक, बेहतर है Gaussian distribution)

- session breaks: हर 20 requests पर 30–60 सेकंड का विराम

- उत्तम scraping window: ऑफ-पीक घंटे (~स्थानीय समय के अनुसार 2 बजे सुबह)

- 429 errors पर: jitter के साथ exponential backoff

1import random

2import time

3delay = random.gauss(5, 1.5) # औसत 5 सेकंड, standard deviation 1.5

4delay = max(2, min(delay, 10)) # 2-10 सेकंड के बीच सीमित करें

5time.sleep(delay)पूरे और consistent headers इस्तेमाल करें

Sec-Fetch-* headers की कमी 403 blocks का एक है। हर header आपस में consistent होना चाहिए — अगर आपका User-Agent कहता है Chrome 131 on Windows, तो बाकी सभी headers को भी उसी पहचान से मेल खाना चाहिए।

1headers = {

2 "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/131.0.0.0 Safari/537.36",

3 "Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8",

4 "Accept-Language": "en-US,en;q=0.9",

5 "Accept-Encoding": "gzip, deflate, br",

6 "Sec-Fetch-Dest": "document",

7 "Sec-Fetch-Mode": "navigate",

8 "Sec-Fetch-Site": "none",

9 "Sec-Fetch-User": "?1",

10 "Sec-CH-UA": '"Google Chrome";v="131", "Chromium";v="131", "Not_A Brand";v="24"',

11 "Sec-CH-UA-Platform": '"Windows"',

12}Headless browsers का सावधानी से उपयोग करें

Playwright के लिए playwright-stealth package लगभग 17 evasion modules (navigator.webdriver, plugins, languages, WebGL) पैच करता है। लेकिन आधुनिक anti-bot systems 12 की तुलना में 40+ properties जाँचते हैं जिन्हें यह पैच करता है। non-headless mode (headless=False) में चलाना सुरक्षित है, लेकिन धीमा।

Selenium के लिए undetected-chromedriver ChromeDriver binary को patch करके automation indicators हटाता है, लेकिन headless mode अब भी अस्थिर रहता है।

बड़े पैमाने पर scraping के लिए scraping API पर विचार करें

अगर आप हज़ारों पेज स्क्रैप कर रहे हैं, तो scraping API आपके लिए proxy rotation, CAPTCHA solving, और JS rendering संभाल लेती है। में Bright Data ने प्रति listing 48 fields के साथ 99% success हासिल किया। tradeoff लागत है — ScrapingBee का stealth proxy mode खपत करता है, इसलिए $49/month plan से केवल ~3,333 stealth requests मिलती हैं।

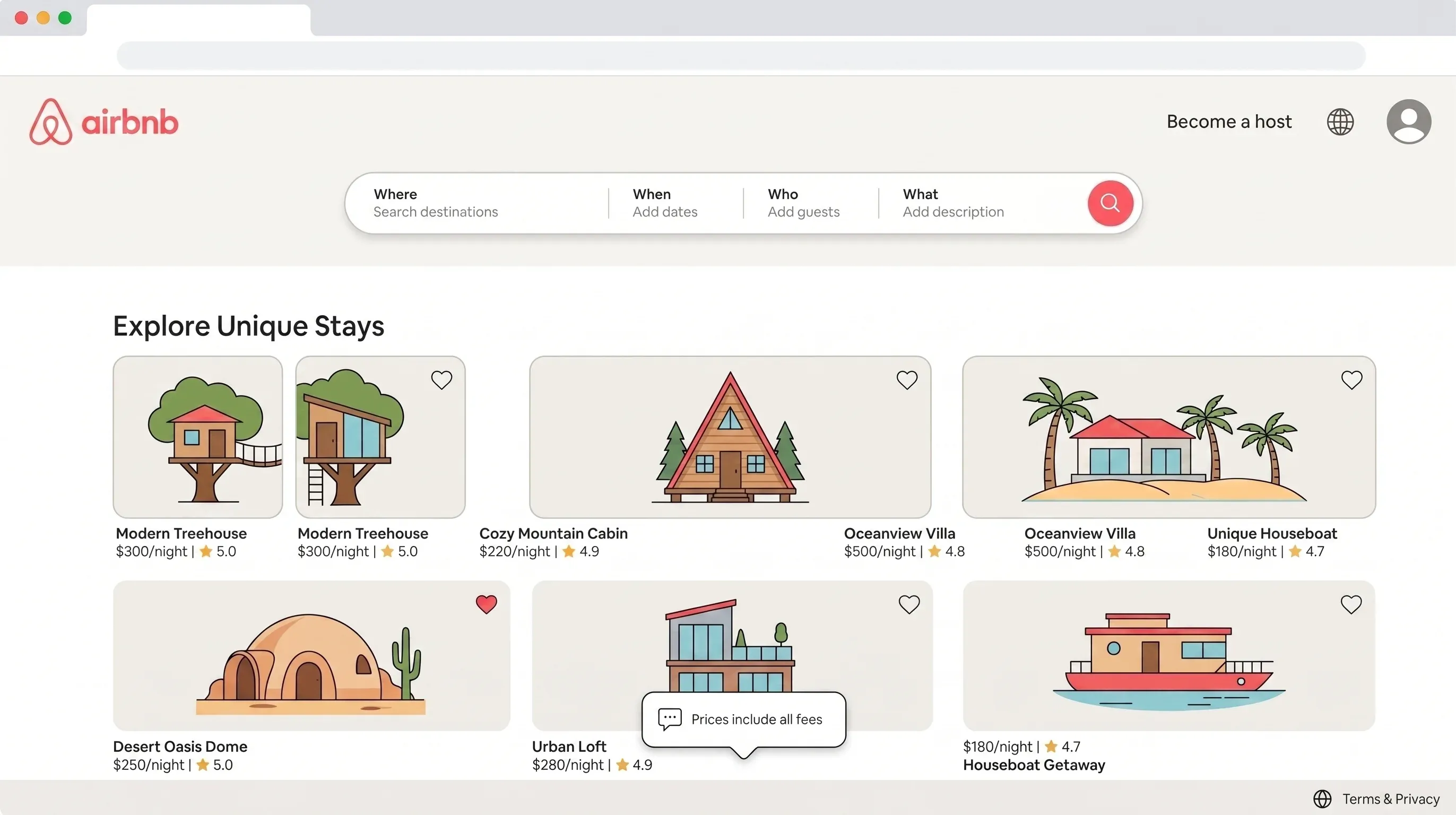

Python के बिना Airbnb स्क्रैप करें: Thunderbit के साथ No-Code विकल्प

Airbnb स्क्रैप करने वाला हर व्यक्ति developer नहीं होता। होस्ट pricing comps चाहते हैं। निवेशक market data चाहते हैं। विश्लेषक spreadsheet चाहते हैं। अगर आपने Python वाले हिस्से पढ़कर सोचा, “यह तो मेरी ज़रूरत से ज़्यादा maintenance है,” तो यह हिस्सा आपके लिए है।

Thunderbit कुछ ही clicks में Airbnb कैसे स्क्रैप करता है

एक AI web scraper है जो के रूप में चलता है। प्रक्रिया यह है:

- Chrome Web Store से extension इंस्टॉल करें

- Airbnb search results page पर जाएँ — सटीक pricing के लिए URL में dates शामिल करें (जैसे

?checkin=2025-08-01&checkout=2025-08-03) - “AI Suggest Fields” पर क्लिक करें — Thunderbit पेज को स्कैन करके listing name, price, rating, location, और URL जैसे columns अपने आप पहचानता है

- “Scrape” पर क्लिक करें — डेटा structured table में भर जाता है

- “Scrape Subpages” का उपयोग करें ताकि हर listing detail page पर जाकर amenities, reviews, host info, और full pricing breakdown निकाले जा सकें — बिना किसी अतिरिक्त configuration के

- Export करें Google Sheets, Excel, Airtable, या Notion में

यहाँ subpage scraping feature बहुत मायने रखता है। Python तरीकों में detail pages scrape करने के लिए अलग parsing logic लिखना, reviews के भीतर pagination संभालना, और parallel requests मैनेज करनी पड़ती है। Thunderbit में यह बस एक click में हो जाता है।

Thunderbit Airbnb scraping की तीन सबसे बड़ी समस्याएँ कैसे हल करता है

ऊपर बताई गई तीन समस्याएँ — anti-bot defenses, JavaScript rendering, और DOM breakage — यही हैं जो Python scrapers को maintenance-heavy बनाती हैं। Thunderbit इन तीनों को संभालता है:

- IP blocking की चिंता नहीं: Thunderbit का Cloud Scraping mode अंदर ही proxy rotation संभालता है

- Selector टूटने की समस्या नहीं: AI हर बार पेज को fresh पढ़ता है — बनाए रखने के लिए कोई CSS selectors नहीं, Airbnb redesign करे तो code update करने की ज़रूरत नहीं

- Setup की झंझट नहीं: न Selenium drivers, न Python environment, न dependency conflicts

- Scheduled scraping: ongoing price monitoring के लिए समय-अंतराल को प्राकृतिक भाषा में बताइए — dynamic pricing और competitor tracking use cases के लिए बढ़िया

कब Python इस्तेमाल करें और कब Thunderbit

यह या तो-या नहीं है — यह इस पर निर्भर करता है कि आपको क्या चाहिए:

| ज़रूरत | Python | Thunderbit |

|---|---|---|

| scraping logic पर पूरा नियंत्रण | ✅ हाँ | ❌ नहीं |

| बिना coding skills के काम करता है | ❌ नहीं | ✅ हाँ |

| DOM changes को अपने आप संभालता है | ❌ नहीं | ✅ हाँ (AI-based) |

| Subpage scraping (detail pages) | जटिल setup | 1-click |

| Scheduled/recurring scraping | कस्टम cron job | बिल्ट-इन scheduler |

| Sheets/Excel/Airtable में export | मैन्युअल code | बिल्ट-इन |

| Data pipelines में integration | ✅ हाँ | सीमित |

| बड़े पैमाने पर लागत (10K+ pages) | Server + proxy costs | Thunderbit pricing |

अगर आपको code-level control, custom logic, या किसी मौजूदा data pipeline में integration चाहिए, तो Python इस्तेमाल करें। अगर बिना maintenance के तेज़ डेटा चाहिए, तो Thunderbit व्यावहारिक विकल्प है।

Airbnb scraping के कानूनी और नैतिक सुझाव

इसे संक्षेप और practical रख रहा हूँ — मैं वकील नहीं हूँ, और यह legal advice नहीं है।

कानून मोटे तौर पर क्या कहता है:

- निर्णय ने स्थापित किया कि authentication के बिना सार्वजनिक वेबसाइट डेटा स्क्रैप करना CFAA का उल्लंघन नहीं है

- (जनवरी 2024): एक न्यायाधीश ने फैसला दिया कि Terms of Service, logged-off scrapers पर बाध्यकारी नहीं होते

- मामला (2025) एक नई theory लाता है कि CAPTCHA और rate limits को बायपास करना DMCA anti-circumvention प्रावधानों का उल्लंघन हो सकता है — यह अब तक अनपरीक्षित है, लेकिन ध्यान देने योग्य है

Airbnb क्या कहता है: उनके स्पष्ट रूप से automated data collection पर रोक लगाते हैं। हालांकि, Airbnb ने कभी सार्वजनिक रूप से किसी scraper पर मुकदमा नहीं किया। 11+ वर्षों से बिना कानूनी चुनौती के चल रहा है, भले ही Airbnb उसे “garbage” कहता रहा हो।

व्यावहारिक दिशानिर्देश:

- केवल सार्वजनिक रूप से उपलब्ध डेटा ही स्क्रैप करें (login walls को bypass न करें)

robots.txtदिशानिर्देशों का सम्मान करें- आक्रामक request rates से servers पर बोझ न डालें

- GDPR/CCPA के तहत personal data को सावधानी से संभालें

- व्यावसायिक use cases के लिए legal counsel से सलाह लें

निष्कर्ष और मुख्य बातें

Airbnb scraping “जल्दी और अस्थायी” से लेकर “production-grade” तक फैला हुआ है। मुख्य बातें:

- URL में हमेशा dates पास करें (

checkinऔरcheckoutparameters) — इनके बिना pricing data बेकार है - CSS class names पर निर्भर न रहें। इसके बजाय

data-testidattributes, schema.org microdata, या GraphQL API interception का उपयोग करें - बड़े पैमाने पर residential proxies अनिवार्य हैं। Datacenter IPs तुरंत block हो जाते हैं

- Requests की गति कम रखें — 3–10 सेकंड की यादृच्छिक देरी, sticky sessions, और errors पर exponential backoff

- बिना maintenance scraping के लिए, जैसे AI-based tools selector breakage को पूरी तरह खत्म कर देते हैं — वही समस्या जो Python scrapers को महँगा बनाती है

- अपने tool को अपने project से मिलाइए। त्वरित research?

pyairbnb. डायनामिक pricing analysis? API interception के साथ Playwright. बिना code के ongoing monitoring? Thunderbit. Production scale? Scraping API.

No-code रास्ता आज़माने के लिए, — आप इसे लगभग दो मिनट में कुछ Airbnb search pages पर टेस्ट कर सकते हैं। Python तरीके के लिए, इस लेख के सभी code patterns आपके खास use case के अनुसार ढाले जा सकते हैं।

वेब scraping approaches और tools पर और जानकारी के लिए, हमारे गाइड देखें: , , और । आप पर tutorials भी देख सकते हैं।

अक्सर पूछे जाने वाले प्रश्न

क्या Airbnb scraping के लिए आपको block कर सकता है?

हाँ। Airbnb Akamai Bot Manager का उपयोग करता है, जिसमें TLS fingerprinting, JavaScript challenges, browser fingerprinting, और IP reputation scoring शामिल हैं। पहचान होने पर आपको 403, 429, या CAPTCHA responses मिलेंगे। Proxy rotation, यथार्थवादी headers, और request throttling जोखिम कम करते हैं, लेकिन बड़े पैमाने पर detection से पूरी तरह बचने का कोई गारंटीकृत तरीका नहीं है।

क्या Airbnb को स्क्रैप करना कानूनी है?

सार्वजनिक रूप से उपलब्ध डेटा स्क्रैप करना आम तौर पर US case law (hiQ v. LinkedIn, Meta v. Bright Data) के तहत स्वीकार्य है, लेकिन Airbnb की Terms of Service इसे स्पष्ट रूप से निषिद्ध करती हैं। कानूनी स्थिति क्षेत्राधिकार के अनुसार बदलती है, और उभरती हुई DMCA anti-circumvention theory (Reddit v. Perplexity) anti-bot measures को bypass करने वाले scrapers को प्रभावित कर सकती है। व्यावसायिक उपयोग के लिए legal counsel से सलाह लें।

Airbnb से कौन-सा डेटा स्क्रैप किया जा सकता है?

Search results से: listing name, price (तारीखों के साथ), rating, review count, location, property type, और URL। Detail pages से: पूरा description, amenities, host info, सभी reviews, photos, calendar availability, cleaning fees, और pricing breakdowns। गहराई इस पर निर्भर करती है कि आप सिर्फ़ search pages scrape करते हैं या individual listing pages भी देखते हैं।

क्या Python से Airbnb स्क्रैप करने के लिए proxies की ज़रूरत है?

कुछ पेजों के लिए शायद बिना proxies के काम चल जाए। 20–30 requests से आगे के लिए residential proxy rotation की काफ़ी सिफ़ारिश की जाती है। Datacenter IPs तुरंत block हो जाते हैं। समुदाय की सहमति के अनुसार एक IP से प्रति घंटे अधिकतम ~100 pages और requests के बीच 3–10 सेकंड की random delays रखनी चाहिए।

बिना coding के Airbnb स्क्रैप करने का सबसे आसान तरीका क्या है?

आपको AI-powered field detection के साथ Airbnb search results और listing detail pages स्क्रैप करने देता है — न selectors सेट करने की ज़रूरत, न code लिखने की। यह subpage scraping (amenities, reviews, और host info के लिए) संभालता है, Google Sheets, Excel, Airtable, या Notion में export करता है, और ongoing price monitoring के लिए scheduled scraping भी देता है।

और जानें