पिछले हफ्ते मैंने पूरा एक दोपहर एक AI एजेंट को लॉगिन-प्रोटेक्टेड पोर्टल पर सप्लायर फॉर्म भरवाने की कोशिश में बिता दी। तीसरे घंटे तक, मैं "Connection Refused" एरर देख रहा था, मेरा VPS मेमोरी खत्म कर चुका था, और मैं सचमुच सोच रहा था कि क्यों न यह काम खुद ही कर लिया जाए।

असल में, यही OpenClaw browser automation की पूरी शुरुआती कहानी है। यह टूल पेज नेविगेट कर सकता है, डेटा स्क्रैप कर सकता है, फॉर्म भर सकता है, और plain English निर्देशों के साथ जटिल workflows जोड़ सकता है — वाकई दमदार। लेकिन "ये तो कमाल है" और "ये मेरे सिस्टम पर सच में चल भी रहा है" के बीच का फासला ही वह जगह है जहाँ ज़्यादातर लोग अटक जाते हैं।

मैंने इस फासले के दोनों तरफ़ काफी समय बिताया है — Thunderbit पर automation tools बनाते हुए भी, और open-source ecosystem की capability को परखते हुए भी। यह गाइड वही है जो काश मुझे पहले मिल गई होती: असली setup walkthrough, browser mode चुनने की उलझन, Windows के लिए native रास्ता (क्योंकि WSL को ज़रूरी नहीं होना चाहिए), anti-bot से बचने की रणनीति, असली output examples, आम errors और उनके practical fixes, और एक ईमानदार assessment कि OpenClaw कब सही टूल है — और कब यह जरूरत से ज़्यादा हो जाता है।

OpenClaw Browser Automation क्या है?

OpenClaw एक free, open-source AI agent platform (MIT license) है जो आपकी ओर से browser को नियंत्रित कर सकता है। Selenium scripts या Puppeteer code लिखने के बजाय, आप plain English में बताते हैं कि क्या करना है — जैसे, "इस पेज पर जाओ और सभी product names और prices निकालो" — और AI खुद तय करता है कि उसे कैसे करना है। यह numbered snapshot system का उपयोग करता है, जिसमें agent पेज elements की पहचान करता है, reference numbers देता है, और step by step उनसे interact करता है।

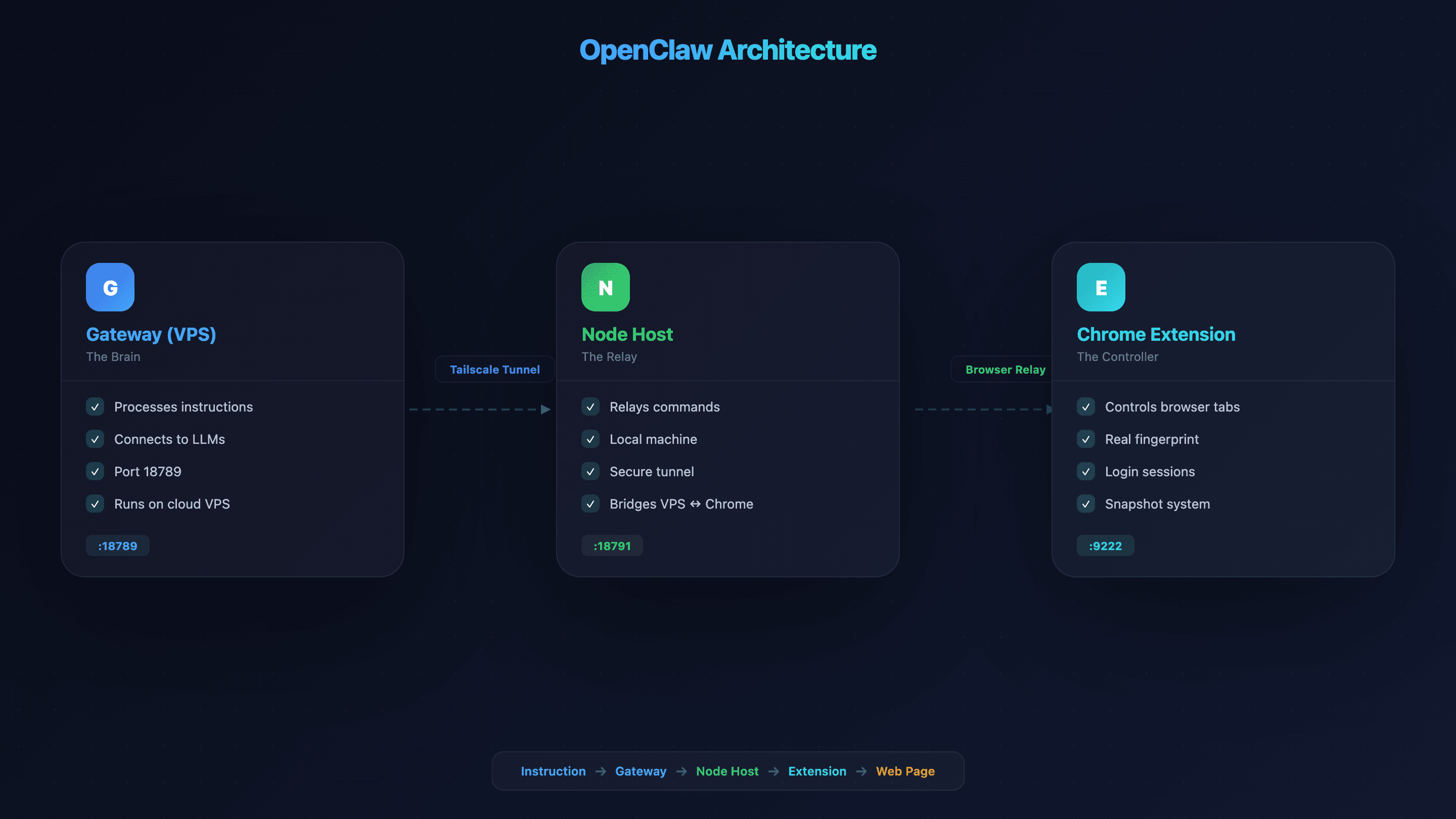

इसका architecture तीन हिस्सों में बँटा है — इसलिए setup सिर्फ़ एक extension install करने जितना आसान नहीं है:

- Gateway (VPS/server): यह "brain" है जो आपके निर्देशों को process करता है और LLMs से जुड़ता है। डिफ़ॉल्ट रूप से port 18789 पर चलता है।

- Node Host (local machine): यह एक relay है जो Gateway को आपके local Chrome तक browser instructions भेजने देता है। Tailscale जैसे secure tunnel के ज़रिए connected रहता है।

- Chrome Extension (Browser Relay): agent को आपके असली browser में tabs पर direct control देता है।

Additional ports में Control Service (18791), CDP Relay (18792), और managed browser CDP (, जो 100 parallel profiles तक support करता है) शामिल हैं।

हाँ, parts काफ़ी ज़्यादा हैं। लेकिन एक बार समझ आ जाए कि हर हिस्सा क्या करता है, तो setup समझ में आने लगता है। इसे remote-control कार की तरह सोचिए: Gateway controller है, Node Host radio signal है, और Chrome Extension खुद कार है।

Business Teams के लिए OpenClaw Browser Automation क्यों ज़रूरी है

Knowledge workers अपने समय का up to में खर्च कर देते हैं, high-value काम के बजाय — इसमें रोज़ाना 1.8 घंटे सिर्फ़ जानकारी खोजने और इकट्ठा करने में लगते हैं। Smartsheet के मुताबिक अपने weekly hours का कम-से-कम एक चौथाई हिस्सा manual, repetitive tasks में लगाते हैं। सिर्फ़ manual data entry ही US companies को सालाना प्रति employee लगभग का नुकसान कराती है।

यही समस्या OpenClaw browser automation हल करने के लिए बना है। व्यवहार में, यह कई business workflows से जुड़ता है:

| Use Case | OpenClaw क्या करता है | Business Outcome | |---|---|---| | Lead generation | directories और company pages से contact info निकालता है | sales pipeline तेज़ी से भरती है | | Competitor price monitoring | product pages पर रोज़ाना जाकर pricing निकालता है | real-time competitive intel मिलती है | | Form filling / data entry | बार-बार भरे जाने वाले web forms (CRM, portals, applications) भरता है | हर हफ्ते घंटों की बचत | | Content monitoring | competitor blogs, job boards, press releases चेक करता है | competition के early signals मिलते हैं | | QA / testing | web flows चलाकर verify करता है कि वे ठीक काम कर रहे हैं | broken user experiences कम होती हैं |

AI agent market 2025 में तक पहुँच चुका है, जो 2023 के $3.7 billion से लगभग दोगुना है, और अब कम-से-कम एक function में AI automation इस्तेमाल कर रही हैं। अब यह कोई niche category नहीं रही।

Sandbox Chromium vs. Browser Relay vs. Chrome Remote Debugging: सही Mode कैसे चुनें

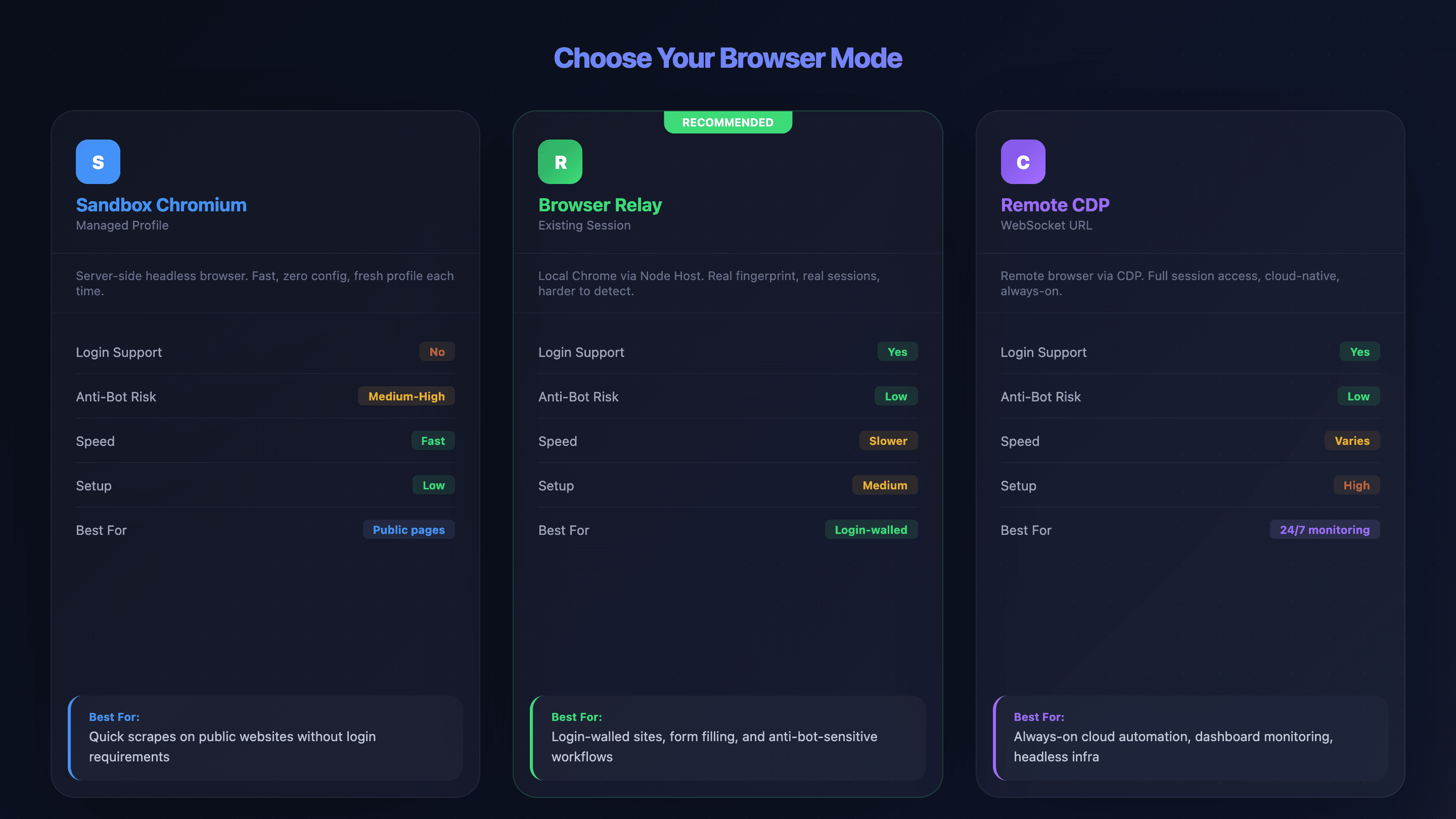

मेरे अनुभव में, नए OpenClaw users के लिए सबसे बड़ा frustration गलत browser mode चुनना होता है। मैंने लोगों को ऐसे connection issues debug करते हुए घंटों बर्बाद करते देखा है, जिन्हें upfront सही mode चुनकर टाला जा सकता था। OpenClaw connect करने के तीन तरीके देता है, और तीनों के अपने tradeoffs हैं:

- Sandbox Chromium (Managed Profile): OpenClaw server पर अपना headless browser चलाता है। Login sessions नहीं होते, तेज़ है, setup भी कम है — लेकिन anti-bot systems को ज़्यादा आसानी से दिख सकता है।

- Browser Relay (Existing-Session): आपके local machine पर node host VPS से instructions लेकर आपके actual Chrome browser तक पहुँचाता है। Login sessions और cookies support करता है, और आपके real browser fingerprint को inherit करता है।

- Chrome Remote Debugging (Remote CDP): WebSocket URL के ज़रिए remote browsers से जुड़ता है। Full session access देता है, लेकिन setup सबसे complex है। Browserless या Browserbase जैसे cloud providers के साथ काम करता है।

Comparison Table: तीनों Browser Modes की तुलना

| Factor | Sandbox Chromium | Browser Relay | Remote CDP | |---|---|---|---| | Login support | ❌ नहीं (fresh profile) | ✅ हाँ (real sessions) | ✅ हाँ (pre-authenticated) | | Anti-bot risk | ⚠️ Medium-High | ✅ Low (real fingerprint) | ✅ Low (provider-managed) | | Speed | ✅ Fast | ⚠️ Slower (network relay) | ⚠️ बदलती रहती है | | Setup complexity | Low | Medium | High | | Full feature support | ✅ हाँ (all features) | ⚠️ सीमित (batch नहीं, download intercept नहीं) | provider पर निर्भर | | Best for | Public pages, quick scrapes | Login-walled sites, form filling | Cloud infra, always-on monitoring |

Decision Flowchart: कौन सा Mode चुनें?

इन सवालों को इसी क्रम में पूछिए:

- "क्या आपको login करना पड़ेगा?" — नहीं → Sandbox Chromium। हाँ → अगला सवाल।

- "क्या site पर anti-bot protection बहुत strong है?" — हाँ → Browser Relay (आपका real browser fingerprint detection कम करता है)। नहीं → Browser Relay या Remote CDP, कोई भी।

- "क्या आपको persistent, हमेशा चलने वाला session चाहिए (जैसे dashboard 24/7 monitor करना)?" — हाँ → cloud provider के साथ Remote CDP। नहीं → Browser Relay।

Real scenario mapping:

- Public Amazon listings scrape करना → Sandbox Chromium

- Login के पीछे CRM form भरना → Browser Relay

- Internal analytics dashboard को 24/7 monitor करना → Browserless/Browserbase के साथ Remote CDP

यह decision सही कर लिया तो आप अपने बहुत से debugging hours बचा लेंगे। सच में।

शुरू करने से पहले

- Difficulty: Intermediate (CLI comfort required)

- Time Required: Full setup के लिए 45–75 minutes; हर step के लिए 10–15 minutes

- What You'll Need: एक VPS (कम-से-कम 2GB RAM, 4GB recommended), Node.js v22.12.0+, Tailscale account (free), Chrome browser, और थोड़ा धैर्य

Step 1: VPS पर OpenClaw चलाएँ (या Local रूप से)

VPS वह जगह है जहाँ OpenClaw का "brain" रहता है। इसे चलाने के दो रास्ते हैं:

Option A: One-click VPS hosting

कई providers pre-configured OpenClaw images देते हैं:

| Provider | Starting Price | Notes | |---|---|---| | Hostinger | From $6.99/mo | Pre-configured image | | Tencent Cloud Lighthouse | From ~$0.08/year (promo) | 2-core/4GB recommended | | Hetzner | From $4.09/mo (CX22) | Best value; manual install | | DigitalOcean | From $4/mo | Manual install | | Vultr | From $3.50/mo | Manual install |

Option B: Manual CLI install

1# npm से install करें (Node.js v22.12.0+ चाहिए)

2npm install -g openclaw

3# onboarding wizard चलाएँ

4openclaw onboard

5# gateway token बनाइए (इसे संभाल कर रखें — node host के लिए चाहिए होगा)

6openclaw doctor --generate-gateway-token

7# configuration validate करें

8openclaw doctor --fixMinimum specs: 2GB RAM (1GB पर crash हो सकता है), 4GB recommended। हर headless browser instance idle होने पर 400–800 MB खपत करता है। अगर आप Docker इस्तेमाल कर रहे हैं, तो shm_size: '2gb' सेट करें — stability के लिए यह बेहद ज़रूरी है।

इस step के बाद, OpenClaw चल रहा होना चाहिए और एक Gateway token सुरक्षित जगह पर सेव होना चाहिए। (मैं अपना password manager में रखता हूँ। इसे खोएँ मत।)

Step 2: VPS और Local Machine को जोड़ने के लिए Tailscale सेटअप करें

Tailscale आपके VPS और local device के बीच एक private, encrypted tunnel बनाता है ताकि browser instructions public internet पर exposed न हों। चूँकि शुरुआती 2026 में OpenClaw पर बताई गई थीं, इसलिए यह step skip करना अच्छा विचार नहीं है।

1# VPS पर

2curl -fsSL https://tailscale.com/install.sh | sh

3sudo tailscale up --ssh=true

4# VPS का Tailscale IP नोट करें (100.x.x.x)

5# Gateway को Tailscale network पर listen करने के लिए configure करें

6openclaw config set gateway.listen "100.x.x.x:18789"अपने local machine पर से Tailscale install करें। दोनों devices को एक ही Tailscale account इस्तेमाल करना होगा।

अगर Tailscale पसंद नहीं है तो alternatives:

| Factor | Tailscale | Cloudflare Tunnel | WireGuard | |---|---|---|---| | Setup time | 5 min | 10–15 min | 20–30 min | | Cost | Free (personal) | Free | Free | | NAT traversal | Automatic | Automatic | Manual |

अब आपको अपने local machine से VPS Tailscale IP ping करने में सक्षम होना चाहिए। अगर नहीं, तो जाँचें कि दोनों devices एक ही Tailscale account पर हैं या नहीं।

Step 3: अपने Local Device पर Node Host install करें

Node Host VPS Gateway से browser instructions लेकर आपके local Chrome तक पहुँचाता है — यानी server और browser के बीच translator।

1# node host package install करें

2npm install -g @openclaw/node-host

3# Step 1 वाला gateway token सेट करें

4export OPENCLAW_GATEWAY_TOKEN="your-token-here"

5# node host start करें, अपने VPS Tailscale IP को point करते हुए

6openclaw node install --host 100.x.x.x --port 18789

7# VPS side से connection approve करें

8openclaw node approve <node-id>आपको confirmation दिखना चाहिए कि node connected और approved है। अगर approval step अटक जाए, तो VPS पर Gateway process restart करें।

Step 4: OpenClaw Chrome Extension install करें

यह extension agent को browser tabs पर direct control देता है। आप इसे Chrome Web Store से "OpenClaw Browser Relay" खोजकर भी ले सकते हैं।

1# extension files install करें

2openclaw browser extension install

3# या manually:

4# 1. chrome://extensions खोलें

5# 2. "Developer mode" enable करें (top-right toggle)

6# 3. "Load unpacked" पर click करें → extension directory चुनें

7# 4. toolbar में pin करें

8# 5. confirm करें कि badge "ON" दिखा रहा हैअगर badge "ON" दिख रहा है, तो setup सही है। अगर यह "OFF" पर ही है, तो नीचे troubleshooting section पर जाएँ।

Step 5: अपना पहला OpenClaw Browser Automation Task चलाएँ

एक target tab खोलें, फिर OpenClaw chat interface से कुछ आसान ट्राई करें:

1https://books.toscrape.com पर जाएँ और पेज पर मौजूद हर book का title और price निकालेंExpected flow: Instruction भेजी जाती है → agent snapshot लेता है (numbered references के साथ page elements पहचानता है) → data निकालता है → structured output JSON या CSV के रूप में लौटता है।

अनुभव से एक सलाह: शुरू में बहुत simple prompt दें। ज़रूरत से ज़्यादा detail देना AI को उलझा सकता है — extra detail तभी जोड़ें जब agent पहली instruction को गलत समझे।

पहले page पर 20 books के लिए लगभग 30–60 seconds लग सकते हैं। Structured data वापस आ गई? आपका OpenClaw browser automation setup काम कर रहा है।

Windows पर OpenClaw Browser Automation: Native Setup Path

ज़्यादातर OpenClaw guides macOS या Linux मानकर चलती हैं। अगर आप Windows पर हैं, तो यह बात आपने पहले ही महसूस कर ली होगी। एक forum user ने सही कहा था: "बहुत से solutions conceptually sound लगते थे, लेकिन कोई भी native Windows के लिए बना नहीं था।"

असल में जो काम करता है, वह यह है।

Option A: Windows पर Chrome Remote Debugging (Recommended Native Path)

Windows के लिए सबसे भरोसेमंद native तरीका। PowerShell खोलें और remote debugging के साथ Chrome लॉन्च करें:

1& "C:\Program Files\Google\Chrome\Application\chrome.exe" --remote-debugging-port=9222अगर Chrome उस path पर नहीं है, तो यह आज़माएँ:

1# alternate locations जाँचें

2Get-ChildItem "C:\Program Files*\Google\Chrome\Application\chrome.exe" -Recurse

3# या AppData देखें

4& "$env:LOCALAPPDATA\Google\Chrome\Application\chrome.exe" --remote-debugging-port=9222फिर अपनी openclaw.json config में cdpUrl को ws://localhost:9222 set करके OpenClaw को Remote CDP के ज़रिए connect करें।

Option B: Windows fallback के रूप में Docker Desktop

अगर native रास्ता दिक्कत दे, तो Windows पर Docker Desktop एक headless Chromium container चला सकता है:

1docker run -d --name openclaw-browser -p 9222:9222 --shm-size=2g browserless/chrome

2# OpenClaw को यहाँ point करें: cdpUrl: "ws://localhost:9222"यह एक और layer जोड़ता है, लेकिन कुछ users के लिए ज़्यादा stable होता है। चलता है, पर elegant नहीं है।

Windows-Specific Error Catalog

| Error | Cause | Fix (PowerShell) |

|---|---|---|

| Port 9222 already in use | कोई और DevTools session खुला है | Get-Process -Id (Get-NetTCPConnection -LocalPort 9222).OwningProcess | Stop-Process -Force |

| Chrome binary not found | गलत path | Get-ChildItem "C:\Program Files*\Google\Chrome\Application\chrome.exe" -Recurse |

| Tailscale connection refused | Windows Firewall blocking | New-NetFirewallRule -DisplayName "OpenClaw" -Direction Inbound -LocalPort 18789 -Protocol TCP -Action Allow |

| npm permission errors | Admin के रूप में नहीं चला रहे | PowerShell को Administrator के रूप में चलाएँ, या nvm-windows उपयोग करें |

ऊपर दिए गए हर command PowerShell के हैं, bash नहीं। सीधे copy-paste करें।

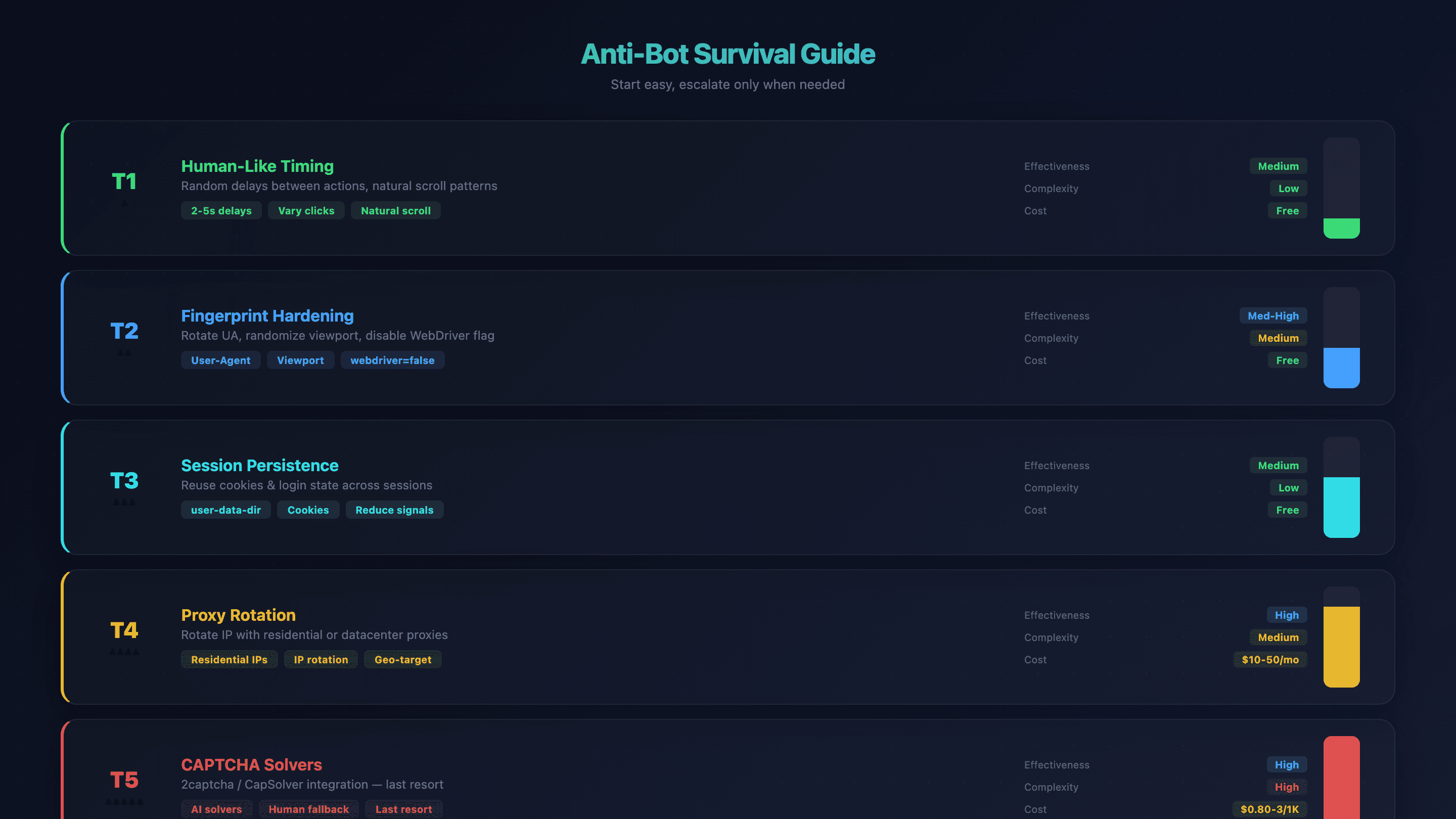

OpenClaw Browser Automation के लिए Anti-Bot Survival Guide

Bot detection, OpenClaw browser automation users के लिए सबसे बड़ी परेशानी है। OpenClaw के default Chromium में — sites इसे WebDriver flag, screen dimensions, font fingerprinting, और IP reputation से पकड़ लेती हैं। मैंने agents को कुछ websites पर seconds के भीतर block होते देखा है।

लेकिन इससे निपटने का एक layered तरीका है। सबसे आसान fix से शुरू करें, और ज़रूरत पड़ने पर ही आगे बढ़ें।

Tier 1: Human-Like Timing और Behavior

अपने prompts में actions के बीच random delays जोड़ें। मशीन की स्पीड से clicks करने के बजाय agent को बताइए: "हर click के बीच 2–5 seconds रुकें।" AI कुछ हद तक timing naturally बदलता है, लेकिन explicit निर्देश मदद करते हैं।

Effectiveness: Medium | Complexity: Low | Cost: Free

Tier 2: Fingerprint Hardening

User-agent strings rotate करें, viewport size randomize करें, और OpenClaw को navigator.webdriver flag auto-disable करने दें (via --disable-blink-features=AutomationControlled)।

1# custom headers सेट करें

2openclaw browser set headers --headers-json '{"User-Agent":"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 Chrome/124.0.0.0 Safari/537.36"}'

3# viewport randomize करें

4openclaw browser set viewport 1366 768

5# timezone और locale सेट करें

6openclaw browser set timezone America/New_York

7openclaw browser set locale en-USऔर भी गहराई से anti-detection के लिए, community Camoufox की सलाह देती है — यह Firefox-based anti-detect browser है जिसमें C++ engine-level fingerprint spoofing है।

Effectiveness: Medium-High | Complexity: Medium | Cost: Free

Tier 3: Session Persistence

user-data-dir का उपयोग करके sessions के बीच cookies और login state बनाए रखें। इससे fresh browser जैसे signals कम होते हैं, जो anti-bot systems को trigger करते हैं।

1openclaw config set browser.profiles.persistent.userDataDir "/path/to/chrome-profile"

2openclaw config set browser.profiles.persistent.cdpPort 18802Effectiveness: Medium | Complexity: Low | Cost: Free

Tier 4: Proxy Rotation

जब timing और fingerprinting काफी न हों, तो अपनी IP address rotate करें। Residential proxies को detect करना मुश्किल होता है; datacenter proxies तेज़ और सस्ते होते हैं।

1export OPENCLAW_BROWSER_PROXY="http://user:pass@proxy.example.com:8080"ध्यान दें: browser-level proxy configuration अभी भी एक feature request है (GitHub Issue #8079)। फिलहाल proxies को OS या environment level पर set करना पड़ता है।

| Provider | Residential | Datacenter | Best For | |---|---|---|---| | Bright Data | $4–8.40/GB | $0.43–0.60/GB | Enterprise, highest quality | | Oxylabs | $6–8/GB | $0.48–5/GB | Large-scale scraping | | Decodo (Smartproxy) | $4–5.50/GB | $0.70–5/GB | Mid-range budgets | | IPRoyal | $5–7/GB | -- | Budget-friendly | | DataImpulse | $1/GB | -- | Lowest cost |

Effectiveness: High | Complexity: Medium | Cost: $10–50/mo

Tier 5: CAPTCHA Solvers

आख़िरी उपाय। 2captcha या CapSolver जैसी सेवाएँ integrate करें।

| Service | reCAPTCHA v2 | Cloudflare Turnstile | Latency | |---|---|---|---| | 2Captcha | $2.99/1K | $2.99/1K | 15–45s (human solvers) | | CapSolver | $0.80–1.50/1K | $0.80/1K | 0.5–10s (AI) | | FlareSolverr (open-source Cloudflare bypass) को 2025–2026 में unreliable माना गया है, क्योंकि Cloudflare की defenses लगातार मजबूत होती जा रही हैं।

Effectiveness: High | Complexity: High | Cost: $0.80–3/1K solves

Anti-Bot Summary Table

| Technique | Effectiveness | Complexity | Cost | |---|---|---|---| | Human-like timing | Medium | Low | Free | | Fingerprint hardening | Medium-High | Medium | Free | | Session persistence | Medium | Low | Free | | Proxy rotation | High | Medium | $10–50/mo | | CAPTCHA solvers | High | High | $0.80–3/1K solves |

जो users बार-बार anti-bot walls से टकराते हैं और बस data चाहिए, उनके लिए का cloud scraping public websites पर anti-bot को out of the box संभाल लेता है — न proxy config, न fingerprint tuning। यह मूल रूप से एक अलग approach है (managed cloud infrastructure के ज़रिए AI हर बार site पढ़ता है), जो standard data extraction tasks के लिए anti-bot arms race को ही bypass कर देता है।

असल Output: OpenClaw Browser Automation वास्तव में क्या बनाता है

45–75 मिनट setup में लगाने से पहले शायद आप देखना चाहेंगे कि end result कैसा दिखता है। बिल्कुल ठीक — यहाँ तीन workflow examples हैं, वास्तविक output के साथ।

Example 1: Web Scraping — Product Data निकालना

Prompt: "https://books.toscrape.com पर जाएँ और पेज पर मौजूद हर book का title और price निकालें"

Output (पहले 5 rows):

| Title | Price | |---|---| | A Light in the Attic | £51.77 | | Tipping the Velvet | £53.74 | | Soumission | £50.10 | | Sharp Objects | £47.82 | | Sapiens: A Brief History of Humankind | £54.23 |

Time elapsed: ~45 seconds for 20 rows (single page). Pagination के लिए बाद में निर्देश देना पड़ा: "Next button पर क्लिक करो और 5 pages तक यही दोहराओ।" Total: ~100 rows in about 3 minutes.

Example 2: Form Automation — Multi-Field Web Form भरना

Scenario: company name, contact info, और product interest के साथ supplier inquiry form भरना।

Agent form का snapshot लेता है, हर field को reference number से पहचानता है, और उन्हें क्रम से भर देता है। Before: खाली form fields। After: सभी fields भर चुके होते हैं, confirmation message दिखता है। कोई dropdown menu या checkbox भी snapshot system से handle हो जाता है — agent options "देखता" है और सही choice चुनता है।

Time elapsed: ~30 seconds for a 6-field form.

Example 3: Pagination — कई Pages पर Scraping

Initial result: page 1 से 20 rows। "click Next and repeat for all pages" कहने के बाद: books.toscrape.com पर 50 pages में 1,000 rows। Agent snapshot के ज़रिए "Next" button पहचानता है और loop में क्लिक करता है।

Time elapsed: ~12 minutes for the full 1,000-row dataset.

Side-by-Side: वही Scraping Task Thunderbit में

books.toscrape.com के उसी example में, के साथ workflow कुछ ऐसा दिखता है:

- install करें (~30 seconds)

- पेज पर जाएँ

- "AI Suggest Fields" पर click करें → AI Title, Price, Availability, Rating detect करता है

- "Scrape" पर click करें → 20 rows निकल आती हैं

- pagination controls इस्तेमाल करें → सारे pages scrape हो जाते हैं

- Google Sheets में export करें (free)

Total time: zero से exported data तक लगभग 3 मिनट, बिना VPS, बिना CLI, बिना configuration।

बात यह नहीं है कि एक tool हमेशा "बेहतर" है। सही tool इस बात पर निर्भर करता है कि आप वास्तव में करना क्या चाहते हैं।

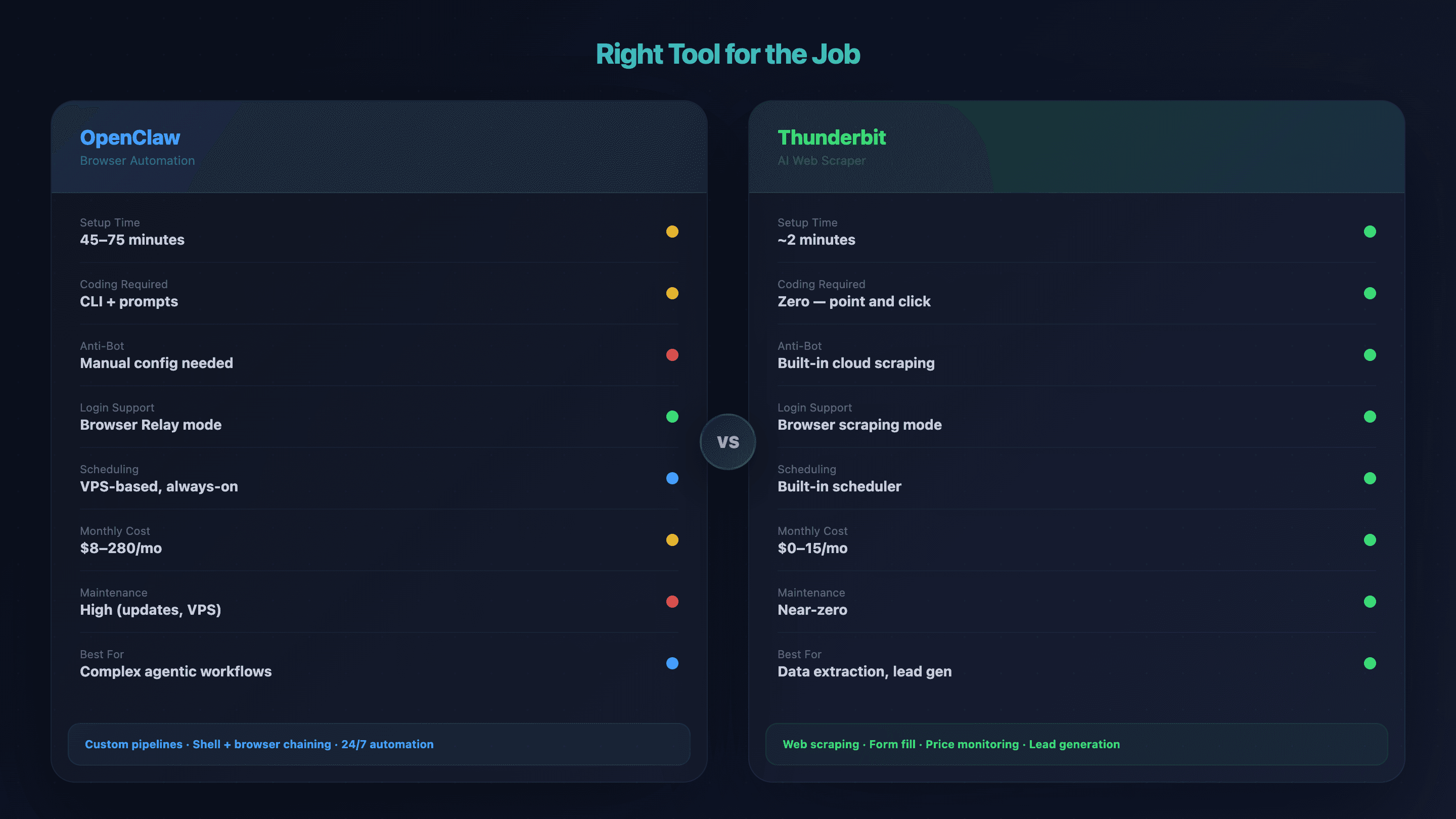

जब OpenClaw Browser Automation जरूरत से ज़्यादा हो जाता है (और तब क्या उपयोग करें)

OpenClaw complex, multi-step, agentic automation में शानदार है — login-walled workflows, browser actions को shell commands के साथ जोड़ना, VPS पर 24/7 चलाना। लेकिन अगर लक्ष्य सिर्फ़ "listing page से product data निकालना" या "directory से emails लेना" है, तो पूरा VPS + Tailscale + node host stack शायद जरूरत से ज़्यादा बनावट है।

मैंने लोगों को ऐसा task करने के लिए 60+ मिनट setup में लगाते देखा है, जिसे एक simpler tool से 2 मिनट में किया जा सकता था। यह अच्छा trade नहीं है।

Right Tool for the Job: Comparison Table

| Factor | OpenClaw Browser Automation | Thunderbit | |---|---|---| | Setup time | 45–75 min (VPS + Tailscale + node host) | ~2 min (Chrome extension install) | | Coding required | CLI + natural language prompts | Zero — "AI Suggest Fields" → "Scrape" क्लिक करें | | Anti-bot handling | Manual (proxy, fingerprint config) | Built-in cloud scraping | | Login-wall navigation | ✅ Browser Relay / remote debug | ✅ Browser scraping mode | | Subpage enrichment | हर workflow के लिए custom scripting | 1-click subpage scraping | | Scheduled / 24×7 runs | VPS-based, always-on | Built-in | | Monthly cost | $8–14 (hobby) to $110–280 (heavy use) | $0 (free tier) to $15/mo | | Maintenance burden | High (updates, VPS, debugging) | लगभग शून्य — AI layout changes के साथ adapt कर लेता है | | Best for | Complex agentic workflows, custom pipelines | Data extraction, form fill, lead gen, price monitoring |

Use-Case Routing

- आपको multi-step agentic workflows चाहिए जो browser actions को shell commands, messaging apps, और databases के साथ जोड़ते हों → OpenClaw सही विकल्प है।

- आपको websites से data scrape करना है, forms भरने हैं, या prices monitor करनी हैं बिना terminal छुए → आपको तेज़ी से वहाँ पहुँचा देगा। आप quick demos के लिए भी देख सकते हैं।

- आपको किसी एक specific API endpoint के लिए lightweight script चाहिए → simple Python script with requests ही काफ़ी हो सकती है।

जब मेरी टीम में कोई पूछता है, "इस काम के लिए कौन सा tool लेना चाहिए?" — मैं सच में इसी framework का इस्तेमाल करता हूँ।

आम OpenClaw Browser Automation Errors और उनके Fix

इस section को bookmark कर लीजिए। इसे symptom के हिसाब से organize किया गया है ताकि आप Ctrl+F करके fix ढूँढ़ सकें।

"Connection Refused" या Node Host Connect नहीं हो रहा

Likely causes (इस क्रम में जाँचें):

- दोनों devices पर Tailscale चल नहीं रहा → दोनों पर

tailscale statusचलाएँ - Gateway अभी भी localhost पर listen कर रहा है, Tailscale network पर नहीं →

openclaw config set gateway.listen "100.x.x.x:18789" - IP address गलत है →

tailscale ip -4से double-check करें - Firewall port 18789 block कर रहा है →

sudo ufw allow 18789/tcp(Linux) या Windows Firewall rule जोड़ें

Extension Badge "OFF" पर ही रहता है या Tab detect नहीं होती

- Extension Developer mode में load नहीं हुई →

chrome://extensions→ Developer mode enable करें → reload करें - Node host चल नहीं रहा →

openclaw node startसे restart करें - Chrome instance conflict → Chrome की सारी instances बंद करें, दोबारा launch करें, और extension reload करें

Agent Empty या गलत Data लौटाता है

- Page पूरी तरह load नहीं हुई: agent को बताइए कि "extract करने से पहले navigating के बाद 3 seconds wait करो।" कई SPA को render होने में time लगता है।

- Anti-bot block: जाँचें कि real content के बजाय CAPTCHA page तो नहीं दिख रहा। Sandbox Chromium से Browser Relay पर switch करें।

- Stale snapshot: agent से कहें कि "new snapshot लो" — navigation के बाद reference numbers पुरानी हो जाती हैं।

"Port 9222 Already in Use"

आम तौर पर तब होता है जब Chrome DevTools या कोई दूसरा automation tool पहले से उस port का इस्तेमाल कर रहा हो।

1# macOS/Linux

2lsof -i :9222 | grep LISTEN

3kill -9 <PID>

4# Windows PowerShell

5Get-Process -Id (Get-NetTCPConnection -LocalPort 9222).OwningProcess | Stop-Process -ForceVPS की Memory खत्म हो जाती है

हर headless browser instance 400–800 MB RAM लेता है। कई instances एक साथ चलाने से छोटा VPS crash हो सकता है।

Fixes:

- Image/CSS/font loading बंद करें:

openclaw browser network route --abort "**/*.{png,jpg,gif,css,woff2}" - Concurrent instances को RAM की capacity के अनुसार सीमित करें

- Docker configurations में

shm_size: '2gb'सेट करें - Session hibernation enable करें:

OPENCLAW_HIBERNATE_AFTER=300 - अगर और headroom चाहिए तो 4GB+ RAM वाला VPS लें

अपने OpenClaw Browser Automation को Smoothly चलाए रखने के टिप्स

इन setups को लंबे समय तक चलाते हुए मैंने कुछ best practices सीखी हैं:

- Data-only scraping tasks के लिए images, stylesheets, और fonts बंद करें। इससे resource usage काफी कम होती है और गति बढ़ती है।

- हर task के लिए नया browser लॉन्च करने के बजाय browser instances reuse करें। Fresh instances महँगी RAM लेते हैं और anti-bot signals भी बढ़ाते हैं।

- Simple prompts से शुरू करें। Detail सिर्फ़ तब जोड़ें जब agent गलत समझे। ज़्यादा detail मदद से ज़्यादा उलझन पैदा कर सकती है।

- VPS resource usage (CPU, RAM) पर नज़र रखें और limits से पहले scale up करें। रात 2 बजे crash हुआ VPS debug करना कोई मज़ेदार काम नहीं है।

- OpenClaw और Chrome extension को updated रखें — लेकिन पहले staging environment में updates test करें। OpenClaw लगभग भेजता है, और वे सभी smooth नहीं होतीं।

- Ongoing, repeating tasks (daily price checks, weekly lead pulls) के लिए Thunderbit का आपको plain language में intervals set करने देता है और VPS maintenance से पूरी तरह मुक्त कर देता है।

Ethical और Legal Considerations

संक्षेप में, लेकिन बहुत महत्वपूर्ण। robots.txt का सम्मान करें (IETF standard के रूप में में formalized), requests की rate limit रखें, target sites के terms of service देखें, और personal data को GDPR/privacy laws के अनुसार handle करें। precedent (2022) ने यह स्थापित किया कि publicly accessible data को scrape करना CFAA का उल्लंघन नहीं है, लेकिन इसका मतलब यह नहीं कि सब कुछ allowed है। Automation को ज़िम्मेदारी से इस्तेमाल करना आपको और आपके business दोनों को सुरक्षित रखता है। इस विषय पर और जानकारी के लिए हमारा वाला guide देखें।

निष्कर्ष

OpenClaw browser automation जटिल, multi-step web workflows के लिए एक शक्तिशाली विकल्प है, जिसे natural language से नियंत्रित किया जाता है। सबसे ज़रूरी बातें यह हैं:

- शुरुआत में सही browser mode चुनें (Sandbox, Relay, Remote CDP) — यही एक decision आपके कई debugging hours बचा सकता है।

- Windows users के लिए workable path मौजूद है, लेकिन आपको Windows-specific commands follow करनी होंगी और firewall/path issues पर ध्यान रखना होगा।

- Anti-bot handling एक असली चुनौती है — सबसे आसान techniques (timing, fingerprinting) से शुरू करें और जरूरत के अनुसार ही आगे बढ़ें।

- Commit करने से पहले output देख लें। अगर listing page से structured data ही चाहिए, तो जैसा no-code tool आपको minutes में, बिना maintenance के, वहाँ पहुँचा देता है।

- Maintenance के लिए budget रखें। OpenClaw लगभग 13 releases प्रति month देता है, VPS लागत जुड़ती रहती है, और debugging इस setup का हिस्सा है।

अगर आप पहले आसान रास्ता आज़माना चाहते हैं, तो available है — extension install करें, एक page scrape करें, और देखें कि क्या यह आपके use case के लिए पर्याप्त है, full VPS setup में निवेश करने से पहले। अगर आप फिर भी OpenClaw route चुनते हैं, तो इस guide को bookmark कर लें। Error catalog की आपको eventually ज़रूरत पड़ेगी — और उम्मीद है आपके browser instances को हमेशा पर्याप्त RAM मिले।

FAQs

OpenClaw Sandbox Chromium और Browser Relay में क्या अंतर है?

Sandbox Chromium server पर एक headless browser चलाता है — यह तेज़ है और setup कम माँगता है, लेकिन हर बार fresh profile बनाता है (login sessions नहीं होते) और anti-bot systems को ज़्यादा आसानी से दिख सकता है। Browser Relay आपके local machine पर चल रहे असली Chrome browser तक instructions भेजता है, इसलिए यह logins support करता है, आपका real browser fingerprint inherit करता है, और sites के लिए automation को पहचानना मुश्किल बनाता है। Tradeoff यह है कि network relay के कारण यह धीमा होता है और कुछ feature limitations भी होती हैं (batch actions नहीं, download intercept नहीं)।

क्या मैं WSL के बिना Windows पर OpenClaw browser automation चला सकता हूँ?

हाँ, लेकिन कुछ caveats के साथ। सबसे भरोसेमंद native Windows path PowerShell के ज़रिए Chrome Remote Debugging है (chrome.exe --remote-debugging-port=9222)। अगर यह reliable न हो, तो Docker Desktop fallback है। Windows पर full native Node Host support में अभी rough edges हो सकते हैं — current docs देखें और firewall blocks तथा binary path differences जैसे Windows-specific issues के लिए तैयार रहें। इस guide के Windows section के हर command PowerShell हैं, bash नहीं।

OpenClaw browser automation में CAPTCHAs को कैसे handle करें?

पहले detection risk कम करें: human-like timing जोड़ें, browser fingerprint harden करें, और fresh-browser signals से बचने के लिए session persistence इस्तेमाल करें। अगर CAPTCHAs फिर भी आते रहें, तो 2captcha ($2.99/1K solves) या CapSolver ($0.80–1.50/1K, AI-powered) जैसी solver service integrate करें। Public websites के लिए जहाँ आपको सिर्फ़ data चाहिए, Thunderbit का cloud scraping बिना किसी proxy या CAPTCHA configuration के anti-bot को automatically संभाल लेता है।

क्या OpenClaw browser automation free है?

OpenClaw खुद open-source (MIT license) है और free है। लेकिन इसे चलाने के लिए infrastructure चाहिए — $4–15/month का VPS, और optional services जैसे proxy rotation ($10–50/month) या CAPTCHA solvers (solve के हिसाब से pay)। Total monthly cost hobby use के लिए लगभग $8–14 से लेकर heavy automation workloads के लिए $110–280 तक जा सकती है। तुलना में, basic scraping को बिना infrastructure cost के cover करता है।

अगर मेरा OpenClaw agent बार-बार empty results लौटा रहा है तो मैं क्या करूँ?

क्रम में तीन चीज़ें जाँचें: पहला, page पूरी तरह load न हुई हो — agent को कहें "extract करने से पहले navigating के बाद 3 seconds wait करो।" दूसरा, anti-bot wall हो सकती है — अगर agent real content की जगह CAPTCHA page "देख" रहा है, तो Sandbox Chromium से Browser Relay पर switch करें। तीसरा, snapshot references stale हो सकती हैं — किसी भी navigation के बाद agent से कहें "new snapshot लो।" अगर इनमें से कुछ भी काम न करे, तो VPS memory usage देखें — crash हुआ browser instance अक्सर silently empty results देता है।