ईमानदारी से कहूँ तो: जब मैंने पहली बार किसी बड़ी वेबसाइट से हर URL निकालने की कोशिश की, तो मैंने सोचा, “इसमें कितना ही मुश्किल हो सकता है?” कुछ घंटे बाद भी मैं अनगिनत पेजों पर क्लिक कर रहा था, लिंक स्प्रेडशीट में कॉपी-पेस्ट कर रहा था, और अपने जीवन के फैसलों पर सवाल उठा रहा था। अगर आपने कभी किसी वेबसाइट के सभी पेज ढूँढ़ने की कोशिश की है—चाहे कंटेंट ऑडिट के लिए, लीड सूची के लिए, या प्रतिस्पर्धी शोध के लिए—तो आप इस दर्द को जानते होंगे। यह थकाऊ है, इसमें गलतियाँ होने की संभावना रहती है, और सच कहूँ तो, आपके समय और मेहनत की बर्बादी है।

लेकिन अच्छी खबर यह है: अब आपको यह सब पुराने तरीके से करने की ज़रूरत नहीं है। जैसे AI-संचालित टूल बिज़नेस यूज़र्स के लिए खेल बदल रहे हैं, और अब किसी डोमेन के सभी URL ढूँढ़ना दिनों में नहीं, मिनटों में संभव हो गया है। वास्तव में, AI-आधारित वेब स्क्रैपिंग टूल इस्तेमाल करने वाली कंपनियाँ डेटा कलेक्शन कार्यों में रिपोर्ट करती हैं, और कुछ मामलों में मैन्युअल तरीकों की तुलना में लगता है। यह सिर्फ एक आँकड़ा नहीं है—यह आपके जीवन के घंटे (या दिन) वापस मिलना है।

तो आइए समझते हैं कि किसी वेबसाइट के सभी पेज ढूँढ़ना इतना मुश्किल क्यों है, GPT या Claude जैसे सामान्य AI मॉडल इसमें खास मदद क्यों नहीं कर पाते, और Thunderbit जैसे विशेष AI एजेंट इस काम को कैसे बेहद आसान बना देते हैं। और हाँ, मैं आपको बिल्कुल सटीक चरणों में दिखाऊँगा कि बिना कोडिंग के भी ज़रूरी हर URL कैसे निकाला जाए।

किसी डोमेन के सभी URL ढूँढ़ना इतना चुनौतीपूर्ण क्यों है

सच यह है: वेबसाइटें इस तरह नहीं बनाई जातीं कि वे आपको अपने सारे पेजों की एक साफ-सुथरी सूची थमा दें। वे विज़िटर्स के लिए बनाई जाती हैं, न कि उन लोगों के लिए जो एक साथ वेबसाइट के सभी पेज ढूँढ़ना चाहते हैं। यह काम इतना सिरदर्द क्यों है, इसकी वजहें ये हैं:

- मैन्युअल कॉपी-पेस्ट का कहर: हर मेन्यू, हर लिस्ट, हर डायरेक्टरी पर क्लिक करना, URL एक-एक करके कॉपी करना—यह कार्पल टनल और आधे पेज छूट जाने का पक्का नुस्खा है।

- पेजिनेशन और इनफिनिट स्क्रॉल: कई साइटें कंटेंट को कई पेजों में बाँटती हैं या आप जैसे-जैसे स्क्रॉल करते हैं, और नतीजे लोड करती हैं। अगर “Next” बटन छूट गया या आपने पर्याप्त स्क्रॉल नहीं किया, तो पूरे सेक्शन गायब हो जाएँगे।

- असंगत पेज संरचनाएँ: कुछ पेज लिंक एक फ़ॉर्मेट में दिखाते हैं, जबकि दूसरे अलग लेआउट इस्तेमाल करते हैं। सबको ट्रैक करना बहुत मुश्किल हो जाता है।

- छिपे हुए या अनलिंक्ड पेज: हर पेज मुख्य नेविगेशन से जुड़ा नहीं होता। कुछ पेज बहुत अंदर छिपे रहते हैं, और सिर्फ साइटमैप या इंटरनल सर्च से मिलते हैं।

- मानवीय भूल: जितने ज़्यादा पेज कॉपी करने होंगे, उतनी ही ज़्यादा गलतियाँ होंगी—डुप्लिकेट URL, टाइपो, या कुछ पेज छूट जाना।

और अगर आप ऐसी साइट पर काम कर रहे हैं जिसमें सैकड़ों या हज़ारों पेज हैं? फिर तो बात ही खत्म। मैन्युअल एक्सट्रैक्शन स्केल नहीं करता। जैसा एक डेटा टीम ने कहा था, साधारण मामलों से आगे ।

“वेबसाइट के सभी पेज ढूँढ़ना” का मतलब क्या है?

समाधानों पर जाने से पहले, आइए साफ़ कर लें कि हम असल में क्या खोज रहे हैं।

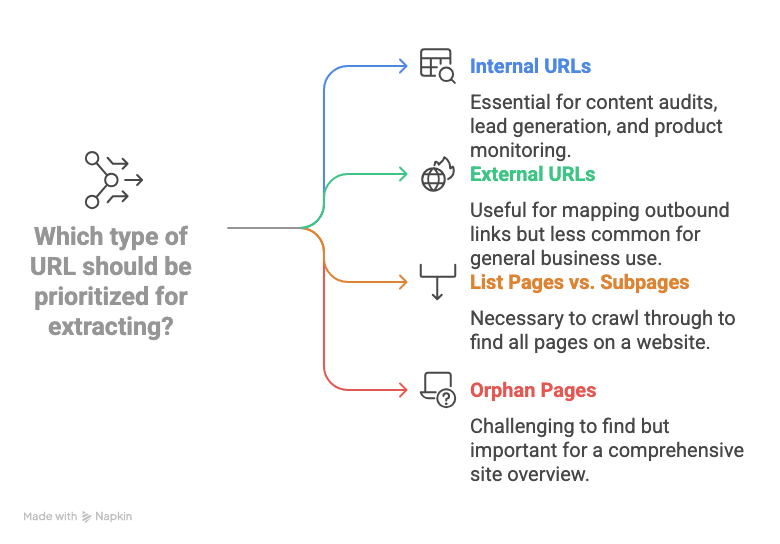

- आंतरिक URL: ये वे लिंक हैं जो उसी डोमेन के पेजों की ओर जाते हैं (जैसे /about-us या /products/widget-123)। ज़्यादातर बिज़नेस उपयोग मामलों—कंटेंट ऑडिट, लीड जनरेशन, प्रोडक्ट मॉनिटरिंग—में आंतरिक URL ही मुख्य लक्ष्य होते हैं।

- बाहरी URL: वे लिंक जो दूसरी वेबसाइटों पर जाते हैं। आम तौर पर, जब तक आप आउटबाउंड लिंक मैप नहीं कर रहे, इनकी ज़रूरत नहीं होती।

- लिस्ट पेज बनाम सबपेज: कई साइटों में “हब” या “लिस्ट” पेज होते हैं (जैसे: कैटेगरी पेज, ब्लॉग आर्काइव, डायरेक्टरी), जो डिटेल पेजों (जैसे प्रोडक्ट या प्रोफ़ाइल पेज) की ओर लिंक करते हैं। सच में वेबसाइट के सभी पेज ढूँढ़ने के लिए आपको इन सूचियों को क्रॉल करके हर सबपेज तक पहुँचना होगा।

- अनाथ पेज: ये वे पेज हैं जो कहीं से स्पष्ट रूप से लिंक नहीं होते। कभी-कभी ये साइटमैप या इंटरनल सर्च से मिल जाते हैं, लेकिन इन्हें आसानी से मिस किया जा सकता है।

तो जब हम किसी डोमेन के सभी URL ढूँढ़ने की बात करते हैं, तो हमारा मतलब होता है: होमपेज से लेकर सबसे गहरे प्रोडक्ट या लेख तक हर आंतरिक पेज URL निकालना, और आदर्श रूप से उसे किसी ऐसे फ़ॉर्मेट में पाना जिसे आप इस्तेमाल कर सकें, जैसे स्प्रेडशीट।

किसी डोमेन के सभी URL ढूँढ़ने के पारंपरिक तरीके

इसे करने के कुछ पुराने तरीके हैं, लेकिन हर एक के साथ अपनी अलग परेशानियाँ आती हैं:

मैन्युअल कॉपी-पेस्ट और ब्राउज़र टूल्स

यह “बलपूर्वक” वाला तरीका है: हर लिंक पर क्लिक करें, हर URL कॉपी करें, स्प्रेडशीट में पेस्ट करें, और उम्मीद करें कि कुछ छूट न जाए। कुछ लोग मौजूदा पेज के सारे लिंक निकालने के लिए ब्राउज़र एक्सटेंशन इस्तेमाल करते हैं, लेकिन फिर भी आपको हर पेज के लिए यह दोहराना पड़ता है, और पेजिनेशन या छिपे सेक्शन आपके अपने हाल पर छोड़ दिए जाते हैं। पाँच-पेज वाली साइट के लिए यह ठीक है—उससे बड़ी चीज़ के लिए नहीं।

साइट सर्च और साइटमैप का उपयोग

- Google का site: सर्च: Google में

site:yourdomain.comटाइप करें, और आपको इंडेक्स हुए कई पेज दिखेंगे। लेकिन Google सिर्फ वही दिखाता है जिसे उसने इंडेक्स किया है (अक्सर लगभग 1,000 परिणामों तक सीमित), इसलिए नए, छिपे हुए, या कम गुणवत्ता वाले पेज छूट जाते हैं। भी मानते हैं कि यह पूरी तरह से पर्याप्त समाधान नहीं है। - XML साइटमैप: कई साइटों में

/sitemap.xmlहोता है जो महत्वपूर्ण URL सूचीबद्ध करता है। बढ़िया—अगर साइटमैप अपडेटेड हो और हर पेज शामिल करता हो। लेकिन हर साइट में ऐसा नहीं होता, और कुछ अपनी साइटमैप को कई फ़ाइलों में बाँट देते हैं। अनाथ पेज अक्सर इसमें नहीं आते।

तकनीकी क्रॉलर और स्क्रिप्ट्स

- SEO टूल्स (जैसे Screaming Frog): ये किसी सर्च इंजन की तरह साइट को क्रॉल करते हैं और URL की सूची निकालते हैं। ये शक्तिशाली हैं, लेकिन इनके लिए सेटअप, कॉन्फ़िगरेशन, और बड़े साइटों के लिए कभी-कभी पेड लाइसेंस चाहिए होता है।

- Python स्क्रिप्ट्स (जैसे Scrapy): डेवलपर्स URL क्रॉल और एक्सट्रैक्ट करने के लिए स्क्रिप्ट लिख सकते हैं। लेकिन सच कहें तो: अगर आप कोड में सहज नहीं हैं, तो यह शुरू से ही आपके लिए नहीं है। ऊपर से, साइट का लेआउट बदलते ही स्क्रिप्ट टूट जाती हैं, इसलिए आपको हमेशा अपडेट करते रहना पड़ता है।

निष्कर्ष: पारंपरिक तरीके या तो बहुत मैन्युअल हैं, या अधूरे, या ज़्यादातर बिज़नेस यूज़र्स के लिए बहुत तकनीकी। इसी वजह से इतने लोग बीच में ही हार मान लेते हैं।

सामान्य AI मॉडल URL एक्सट्रैक्शन को पूरी तरह ऑटोमेट क्यों नहीं कर पाते

शायद आप सोच रहे होंगे, “क्या मैं बस ChatGPT या Claude से कहकर वेबसाइट के सारे पेज नहीं ढूँढ़वा सकता?” काश इतना आसान होता। असलियत यह है:

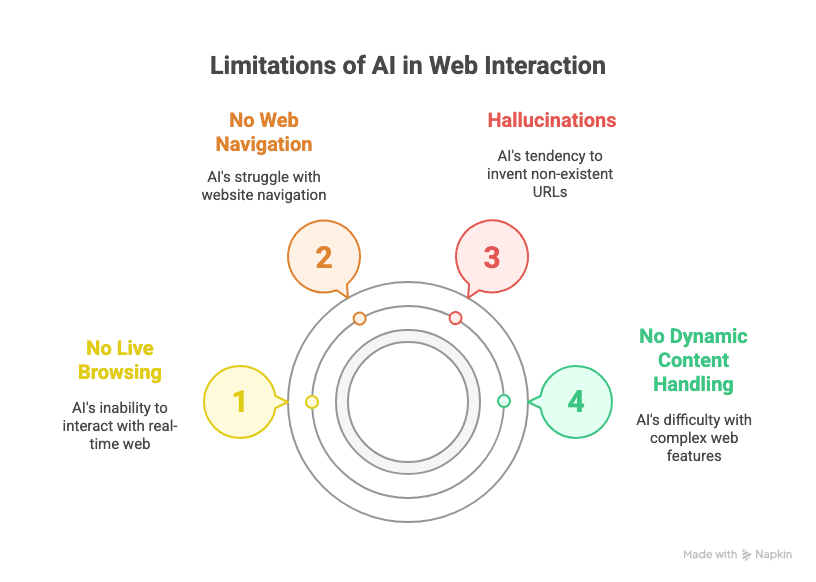

- लाइव ब्राउज़िंग नहीं: GPT या Claude जैसे सामान्य AI मॉडल वास्तविक समय में वेब ब्राउज़ नहीं कर सकते। वे वेबसाइट की वर्तमान स्थिति को “देख” नहीं रहे होते—वे सिर्फ अपने प्रशिक्षण डेटा या आपके पेस्ट किए हुए कंटेंट पर काम करते हैं।

- वेब नेविगेशन नहीं: प्लगइन्स या ब्राउज़िंग सक्षम होने पर भी, LLMs को “Next” क्लिक करना, इनफिनिट स्क्रॉल संभालना, या साइट के हर लिंक को व्यवस्थित रूप से फॉलो करना नहीं आता।

- गलत कल्पनाएँ (Hallucinations): किसी सामान्य AI से डोमेन के सारे URL पूछें, तो वह अक्सर ऐसे लिंक बना देगा जो सुनने में सही लगते हैं लेकिन असल में मौजूद नहीं होते। (मैंने इसे /about-us जैसे पेज गढ़ते हुए देखा है, जबकि साइट पर कभी ऐसा पेज था ही नहीं।)

- डायनामिक कंटेंट संभालना नहीं: JavaScript से कंटेंट लोड करने वाली, लॉगिन माँगने वाली, या जटिल नेविगेशन इस्तेमाल करने वाली साइटें सामान्य LLMs की पहुँच से बाहर होती हैं।

जैसा कि कहती है: “अगर आप सैकड़ों या हज़ारों पेज स्क्रैप करना चाहते हैं… तो ChatGPT अकेले कम पड़ जाता है।” आपको ऐसे टूल की ज़रूरत है जो इस काम के लिए ही बनाया गया हो।

वर्टिकल AI एजेंट ही भविष्य हैं (और यह क्यों मायने रखता है)

यहीं मेरा SaaS और ऑटोमेशन का अनुभव काम आता है: वर्टिकल AI एजेंट—ऐसे AI टूल जो किसी विशिष्ट डोमेन, जैसे वेब डेटा एक्सट्रैक्शन, के लिए बनाए गए हों—ही बिज़नेस कार्यों के लिए भरोसेमंद, स्केलेबल परिणाम देने का रास्ता हैं। क्यों?

- सामान्य LLMs लेखन या सर्च के लिए अच्छे हैं, लेकिन वे “हैलुसिनेशन” की ओर झुकते हैं और बहु-चरणीय, दोहराए जाने वाले वर्कफ़्लो को उस स्थिरता के साथ नहीं संभाल पाते जिसकी बिज़नेस को ज़रूरत होती है।

- एंटरप्राइज़ SaaS टूल्स को बहुत सारे दोहराए जाने वाले, संरचित कार्य ऑटोमेट करने होते हैं। यहीं वर्टिकल AI एजेंट चमकते हैं—वे एक काम को बहुत अच्छे से करने के लिए बने होते हैं, कम से कम गलतियों के साथ।

- उद्योगों में इसके उदाहरण भरे पड़े हैं: वेब डेटा एक्सट्रैक्शन के लिए Thunderbit, सॉफ़्टवेयर डेवलपमेंट के लिए Devin AI, सेल्स ऑटोमेशन के लिए Alta, शिक्षा के लिए Infinity Learn का IL VISTA, HR के लिए Rippling, कानूनी काम के लिए Harvey… और भी बहुत कुछ।

संक्षेप में: अगर आप किसी वेबसाइट के सभी पेज भरोसेमंद तरीके से ढूँढ़ना चाहते हैं, तो आपको इसी काम के लिए बना वर्टिकल AI एजेंट चाहिए—not एक सामान्य चैटबॉट।

Thunderbit से मिलिए: सबके लिए AI-संचालित URL एक्सट्रैक्शन

यहीं काम आता है। एक AI वेब स्क्रैपर Chrome Extension के रूप में, Thunderbit बिज़नेस यूज़र्स के लिए बनाया गया है—कोई कोडिंग नहीं, कोई तकनीकी सेटअप नहीं, बस नतीजे। इसे अलग क्या बनाता है:

- प्राकृतिक भाषा इंटरफ़ेस: बस बताइए आपको क्या चाहिए (“इस साइट पर सभी पेज URL सूचीबद्ध करो”), और Thunderbit का AI समझ जाता है कि इसे कैसे निकाला जाए।

- AI Suggest Fields: Thunderbit पेज स्कैन करता है और अपने-आप कॉलम नाम सुझाता है (जैसे “Page URL”)—CSS selectors या XPath से झंझट नहीं।

- पेजिनेशन और इनफिनिट स्क्रॉल संभालता है: Thunderbit अपने-आप “Next” क्लिक कर सकता है या नीचे स्क्रॉल कर सकता है, ताकि कोई पेज छूटे नहीं।

- सबपेज नेविगेशन: और गहराई में जाना है? Thunderbit लिंक को सबपेज तक फॉलो करके वहाँ से भी डेटा खींच सकता है।

- संरचित एक्सपोर्ट: अपने नतीजे सीधे Google Sheets, Excel, Notion, Airtable, या CSV में एक्सपोर्ट करें—वो भी फ्री और एक क्लिक में।

- कोडिंग की ज़रूरत नहीं: अगर आप किसी वेबसाइट को ब्राउज़ कर सकते हैं, तो Thunderbit भी इस्तेमाल कर सकते हैं। इतना सरल है।

और क्योंकि Thunderbit एक वर्टिकल AI एजेंट है, यह स्थिरता और दोहराव के लिए बना है—उन बिज़नेस यूज़र्स के लिए बिल्कुल सही जिन्हें बार-बार वही काम ऑटोमेट करना होता है।

चरण-दर-चरण: Thunderbit से किसी डोमेन के सभी URL कैसे ढूँढ़ें

देखना चाहते हैं यह कैसे काम करता है? यहाँ एक गैर-तकनीकी वॉकथ्रू है, जिससे आप ज़रूरी हर URL निकाल सकते हैं।

1. Thunderbit Chrome Extension इंस्टॉल करें

सबसे पहले: । यह Chrome, Edge, Brave, और अन्य Chromium ब्राउज़रों पर काम करता है। आसान पहुँच के लिए इसे अपने टूलबार में पिन कर लें।

2. अपनी टार्गेट लिस्ट या डायरेक्टरी पेज खोलें

उस वेबसाइट पर जाएँ जिससे आप URL निकालना चाहते हैं। यह होमपेज, साइटमैप, डायरेक्टरी, या कोई भी लिस्ट पेज हो सकता है जो उन पेजों की ओर लिंक करता हो जिनमें आपकी रुचि है।

3. Thunderbit लॉन्च करें और अपने फ़ील्ड सेट करें

एक्सटेंशन खोलने के लिए Thunderbit आइकन पर क्लिक करें। एक नया स्क्रैपर टेम्पलेट शुरू करें। यहीं असली जादू होता है:

- “AI Suggest Fields” पर क्लिक करें। Thunderbit का AI पेज स्कैन करेगा और कॉलम सुझाएगा—“Page URL”, “Link”, या इसी तरह का कोई नाम देखें।

- अगर आपको बिल्कुल वही फ़ील्ड न दिखे जो चाहिए, तो बस “Page URL” (या जो सबसे उपयुक्त लगे) नाम का एक कॉलम जोड़ दें। Thunderbit का AI इन शब्दों को पहचानने के लिए प्रशिक्षित है और उन्हें सही डेटा से मैप कर देगा।

4. पेजिनेशन या स्क्रॉलिंग सक्षम करें (अगर ज़रूरत हो)

अगर आपके टार्गेट पेज पर कई पेज हैं (जैसे “Page 1, 2, 3…” या “Load more” बटन), तो Thunderbit में पेजिनेशन सक्षम करें:

- “Next” बटन वाली साइटों के लिए “Click Pagination” मोड चुनें, या जैसे-जैसे आप स्क्रॉल करें कंटेंट लोड करने वाली साइटों के लिए “Infinite Scroll”।

- Thunderbit आपको “Next” बटन या स्क्रॉल क्षेत्र चुनने के लिए कहेगा—बस उस पर क्लिक करें, और बाकी काम AI कर देगा।

5. स्क्रैपिंग शुरू करें और परिणाम जाँचें

“Scrape” बटन दबाएँ। Thunderbit सभी पेजों पर क्रॉल करेगा और जो भी URL मिलेगा, उसे इकट्ठा करेगा। परिणाम आपको एक्सटेंशन में एक टेबल के रूप में दिखेंगे। बड़े साइटों के लिए इसमें कुछ मिनट लग सकते हैं, लेकिन यह हाथ से करने की तुलना में फिर भी कहीं तेज़ है।

6. अपने URL की सूची एक्सपोर्ट करें

स्क्रैप पूरा होने पर, Export पर क्लिक करें। आप अपना डेटा सीधे यहाँ भेज सकते हैं:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

एक्सपोर्ट फ्री हैं और आपका सारा फ़ॉर्मेटिंग बनाए रखते हैं। अब कॉपी-पेस्ट की झंझट नहीं।

URL एक्सट्रैक्शन के अन्य समाधानों की तुलना में Thunderbit

| तरीका | इस्तेमाल में आसानी | सटीकता और कवरेज | स्केलेबिलिटी | एक्सपोर्ट विकल्प |

|---|---|---|---|---|

| मैन्युअल कॉपी-पेस्ट | कष्टदायक | कम (छूटना आसान) | नहीं के बराबर | मैन्युअल (Excel आदि) |

| ब्राउज़र लिंक एक्सट्रैक्टर | 1 पेज के लिए ठीक | मध्यम | कमज़ोर | मैन्युअल |

Google site: सर्च | आसान | मध्यम (पूर्ण नहीं) | लगभग 1,000 तक सीमित | मैन्युअल |

| XML साइटमैप | आसान (अगर मौजूद हो) | अच्छा (अगर अपडेटेड हो) | अच्छा | मैन्युअल/स्क्रिप्ट |

| SEO टूल्स (Screaming Frog) | तकनीकी | उच्च | उच्च (पेड) | CSV, Excel |

| Python स्क्रिप्ट्स (Scrapy आदि) | बहुत तकनीकी | उच्च | उच्च | कस्टम |

| Thunderbit | बहुत आसान | बहुत उच्च | उच्च | Google Sheets, CSV, आदि |

Thunderbit आपको एक प्रोफेशनल क्रॉलर जैसी सटीकता और स्केल देता है, साथ में ब्राउज़र एक्सटेंशन जैसी आसानी भी। कोई कोड नहीं, कोई सेटअप नहीं, बस नतीजे।

बोनस: Thunderbit से सिर्फ URLs से ज़्यादा निकालें

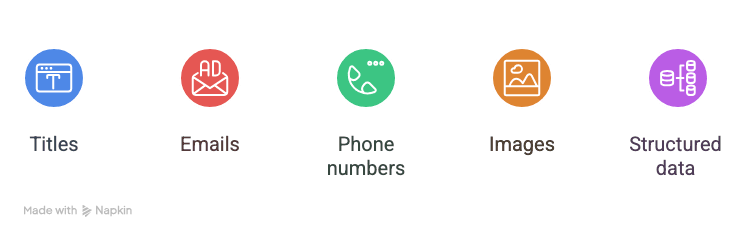

अब बात और दिलचस्प हो जाती है। Thunderbit सिर्फ URLs के लिए नहीं है—आप इससे ये भी निकाल सकते हैं:

- शीर्षक

- ईमेल

- फ़ोन नंबर

- चित्र

- पेज पर मौजूद कोई भी संरचित डेटा

उदाहरण के लिए, अगर आप लीड सूची बना रहे हैं, तो Thunderbit हर डायरेक्टरी एंट्री से प्रोफ़ाइल URL, नाम, ईमेल, और फ़ोन नंबर एक ही पास में निकाल सकता है। अगर आप प्रोडक्ट ऑडिट कर रहे हैं, तो आप प्रोडक्ट URL, नाम, कीमत, और स्टॉक स्थिति निकाल सकते हैं। Thunderbit भी सपोर्ट करता है, इसलिए यह हर लिंक पर जाकर वहाँ से डिटेल्स निकाल सकता है।

और हाँ, Thunderbit के ईमेल और फ़ोन एक्सट्रैक्टर बिल्कुल मुफ़्त हैं। सेल्स और मार्केटिंग टीमों के लिए यह बड़ी बात है।

मुख्य निष्कर्ष: AI से वेबसाइट के सभी पेज कैसे ढूँढ़ें

चलिए दोहराते हैं:

- मैन्युअल या सामान्य टूल्स से किसी डोमेन के सभी URL निकालना कठिन है।

- GPT जैसे सामान्य AI मॉडल वेब नेविगेशन, पेजिनेशन, या डायनामिक कंटेंट को संभाल नहीं सकते।

- Thunderbit जैसे वर्टिकल AI एजेंट वेब डेटा एक्सट्रैक्शन के लिए विशेष रूप से बनाए गए हैं—स्थिर, दोहराए जाने योग्य, और बिज़नेस यूज़र्स के लिए आसान।

- Thunderbit इसे सरल बनाता है: एक्सटेंशन इंस्टॉल करें, फ़ील्ड सुझाने के लिए AI का उपयोग करें, पेजिनेशन सक्षम करें, स्क्रैप करें, और एक्सपोर्ट करें। कोई कोड नहीं, कोई झंझट नहीं।

- आप सिर्फ URLs से ज़्यादा निकाल सकते हैं: शीर्षक, ईमेल, फ़ोन नंबर, और बहुत कुछ—लीड जनरेशन, ऑडिट, या रिसर्च के लिए बिल्कुल सही।

अगर आप लिंक कॉपी-पेस्ट करके थक चुके हैं या तकनीकी क्रॉलर्स से जूझते-जूझते परेशान हो गए हैं, तो । इसमें एक मुफ़्त टियर है, ताकि आप खुद देख सकें कि आप कितना समय (और मानसिक शांति) बचा पाएँगे।

और अगर आप जानना चाहते हैं कि Thunderbit और क्या-क्या कर सकता है—जैसे , , या —तो और गाइड्स व टिप्स के लिए देखें।

क्या आप मैन्युअल डेटा इकट्ठा करने से अपना समय वापस पाना चाहते हैं? वेब डेटा एक्सट्रैक्शन का भविष्य वर्टिकल AI एजेंट हैं—और Thunderbit इस दिशा में आगे है। इसे आज़माइए, और अपना अगला ऑडिट, लीड सूची, या रिसर्च प्रोजेक्ट अब तक का सबसे आसान बनाइए।

और पढ़ें

P.S. अगर कभी आपका मन 1,000 URL हाथ से कॉपी-पेस्ट करने का करे, तो बस याद रखिए: अब इसके लिए AI मौजूद है। आपकी कलाईयाँ (और आपका बॉस) आपका शुक्रिया अदा करेंगे।