타깃 세일즈 리스트를 만들거나, 새로운 시장을 조사하거나, 경쟁사를 벤치마킹해 본 적이 있다면 구글 맵스가 얼마나 큰 보물창고인지 잘 아실 거예요. 그런데 핵심은 매달 15억 건이 넘는 “near me” 검색이 일어나고, 지역 검색 사용자의 76%가 24시간 이내에 실제 매장을 방문한다는 점입니다(). 즉, 최신 위치 기반 비즈니스 데이터에 대한 수요는 그 어느 때보다 높아요.

영업, 마케팅, 운영 어느 쪽이든, 구글 맵스에서 구조화된 데이터를 추출하면 차가운 콜드콜과 반응이 좋은 웜 리드의 차이를 만들 수 있어요.

저는 SaaS와 자동화 분야에서 오랫동안 일해 왔고, 팀들이 파이썬(그리고 이제는 같은 AI 기반 도구)을 활용해 구글 맵스를 전략 자산으로 바꾸는 모습을 직접 봐 왔어요.

이 가이드에서는 2026년에 파이썬으로 구글 맵스 데이터를 수집하는 방법을 코드, 규정 준수 팁, 노코드 솔루션과의 비교까지 포함해 단계별로 자세히 설명해 드릴게요. 파이썬 고수든, 실행 가능한 데이터를 가장 빨리 얻고 싶든, 제대로 찾아오셨습니다.

파이썬으로 구글 맵스 수집한다는 건 무슨 뜻일까요?

기본부터 시작해 볼게요. 파이썬으로 구글 맵스를 수집한다는 것은 이름, 주소, 평점, 리뷰, 전화번호, 좌표 같은 비즈니스 정보를 프로그램으로 추출해서 분석, 필터링, 내보내기할 수 있게 만드는 것을 뜻해요.

이 작업에는 크게 두 가지 방법이 있어요.

- Google Maps Places API: 공식 라이선스 방식이에요. API 키로 Google 서버에 요청하면 구조화된 JSON 데이터를 받을 수 있습니다. 안정적이고 예측 가능하며, 대체로 규정을 준수하지만 할당량과 비용이 있어요.

- HTML 웹 스크래핑: Playwright나 Selenium 같은 도구로 브라우저를 자동화해 구글 맵스를 열고 검색한 뒤, 렌더링된 페이지를 파싱하는 방식이에요. 더 유연하지만 취약해요. Google은 사이트 구조를 자주 바꾸고, HTML 스크래핑은 Google 약관을 위반할 수 있습니다.

일반적으로 추출할 수 있는 데이터 항목:

- 비즈니스 이름

- 카테고리/유형

- 전체 주소(도시, 주, 우편번호, 국가 포함)

- 위도와 경도

- 전화번호

- 웹사이트 URL

- 평점과 리뷰 수

- 가격대

- 비즈니스 상태(영업 중/종료)

- 영업시간

- Place ID(Google의 고유 식별자)

- Google Maps URL

왜 중요할까요? 이 항목들은 리드 생성부터 영업권역 계획, 경쟁사 벤치마킹, 시장 조사까지 거의 모든 작업의 기반이 되기 때문이에요. 중요한 건 비즈니스 목표에 맞는 데이터를 정확히 타깃하는 것이지, 무작정 긁어오는 게 아니에요.

영업과 마케팅 팀이 파이썬으로 구글 맵스 데이터를 추출하는 이유

좀 더 실용적으로 볼게요. 2026년에 왜 이렇게 많은 영업·마케팅 팀이 구글 맵스 데이터에 집중할까요?

- 리드 생성: 지역 비즈니스 목록을 접점 정보와 평점까지 포함해 초정밀로 만들어 아웃리치 캠페인에 활용할 수 있어요.

- 영업권역 계획: 실제 비즈니스 밀도와 유형을 바탕으로 영업 구역, 배송 구역, 서비스 지역을 설계할 수 있어요.

- 경쟁사 모니터링: 경쟁사의 위치, 평점, 리뷰를 시간에 따라 추적해 트렌드와 기회를 파악할 수 있어요.

- 시장 조사: 비즈니스 카테고리, 영업시간, 리뷰 감성을 분석해 시장 진출 전략에 반영할 수 있어요.

- 입지 선정: 부동산과 리테일 분야에서는 주변 편의시설, 유동 인구, 경쟁 상황을 기준으로 후보 입지를 평가할 수 있어요.

실제 효과: 에 따르면 영업 조직의 92%가 AI/데이터 투자를 확대할 계획이며, 타깃화된 지역 데이터를 사용하는 팀은 일반적인 콜드 리스트에 의존하는 팀보다 전환율이 최대 8배 높다고 해요(). 또 한 프랜차이즈 리드 생성 연구에서는 Google Maps 기반 리드 리스트에 1달러를 쓸 때마다 15달러의 신규 매출이 발생했다고 합니다.

비즈니스 목표와 Google Maps 필드 매핑:

| 비즈니스 목표 | 필요한 Google Maps 필드 |

|---|---|

| 지역 리드 리스트 | 이름, 주소, 전화번호, 웹사이트, 카테고리 |

| 영업권역 계획 | 이름, 위도/경도, business_status, opening_hours |

| 경쟁사 벤치마킹 | 이름, 평점, userRatingCount, priceLevel, reviews |

| 입지 선정 | 카테고리, 위도/경도, 리뷰 밀도, openingDate |

| 감성/메뉴 인텔리전스 | reviews, editorialSummary, photos, types |

| 이메일/전화 아웃리치 | nationalPhoneNumber, websiteUri(이후 필요 시 추가 보강) |

파이썬 구글 맵스 스크래퍼 설정하기: 도구와 준비 사항

스크래핑을 시작하기 전에 파이썬 환경을 설정하고 필요한 도구를 준비해야 해요. 2026년에 필요한 것은 다음과 같습니다.

1. 파이썬과 필요한 라이브러리 설치하기

권장 파이썬 버전: 3.10 이상.

핵심 라이브러리 설치:

1pip install \

2 requests==2.33.1 httpx==0.28.1 \

3 beautifulsoup4==4.14.3 lxml==6.0.3 \

4 pandas==2.3.3 \

5 selenium==4.43.0 playwright==1.58.0 \

6 googlemaps==4.10.0 google-maps-places==0.8.0 \

7 schedule==1.2.2 APScheduler==3.11.2 \

8 python-dotenv==1.2.2 tenacity==9.1.4

9playwright install chromium각 라이브러리의 역할:

requests,httpx: HTTP 요청(API 호출)beautifulsoup4,lxml: HTML 파싱(웹 스크래핑용)pandas: 데이터 정리, 분석, 내보내기selenium,playwright: 브라우저 자동화(HTML 스크래핑용)googlemaps,google-maps-places: Google Maps API 클라이언트schedule,APScheduler: 작업 스케줄링python-dotenv:.env파일에서 API 키를 안전하게 불러오기tenacity: 에러 처리를 위한 재시도 로직

2. Google Maps API 키 받기(API 기반 스크래핑용)

- 로 이동합니다.

- 프로젝트를 만들거나 선택합니다.

- 결제를 활성화합니다. 무료 티어만 써도 필요해요.

- APIs & Services > Library에서 “Places API (New)”를 활성화합니다.

- Credentials > Create Credentials > API Key로 이동합니다.

- 보안을 위해 키를 특정 API와 IP로 제한합니다.

- API 키는

.env파일에 저장하세요(코드에 절대 커밋하지 마세요):

1GOOGLE_MAPS_API_KEY=your_actual_api_key_here참고: 2025년 3월 기준으로 Google은 더 이상 월 200달러의 보편적 무료 크레딧을 제공하지 않아요. 대신 각 API 티어별로 월별 무료 기준치가 제공됩니다().

파이썬으로 Google Maps에서 데이터 추출하는 방법: 단계별 가이드

이제 두 가지 주요 접근 방식인 API 기반과 HTML 스크래핑을 나눠서 살펴볼게요. 본인 상황에 맞는 방법을 고르면 됩니다.

방법 1: Google Maps Places API 사용하기(권장)

1단계: 필요한 라이브러리 설치 및 불러오기

1import os

2import httpx

3import pandas as pd

4from dotenv import load_dotenv2단계: API 키를 안전하게 불러오기

1load_dotenv()

2API_KEY = os.environ["GOOGLE_MAPS_API_KEY"]3단계: 검색 쿼리 만들기

조건에 맞는 비즈니스를 찾기 위해 Text Search 엔드포인트를 사용합니다.

1URL = "https://places.googleapis.com/v1/places:searchText"

2FIELD_MASK = ",".join([

3 "places.id", "places.displayName", "places.formattedAddress",

4 "places.location", "places.rating", "places.userRatingCount",

5 "places.priceLevel", "places.types",

6 "places.nationalPhoneNumber", "places.websiteUri",

7 "nextPageToken",

8])4단계: API 요청 보내기

1def text_search(query, lat, lng, radius=3000, min_rating=4.0):

2 body = {

3 "textQuery": query,

4 "minRating": min_rating, # 서버 측 필터

5 "includedType": "restaurant",

6 "openNow": False,

7 "pageSize": 20,

8 "locationBias": {

9 "circle": {

10 "center": {"latitude": lat, "longitude": lng},

11 "radius": radius,

12 }

13 },

14 }

15 headers = {

16 "Content-Type": "application/json",

17 "X-Goog-Api-Key": API_KEY,

18 "X-Goog-FieldMask": FIELD_MASK, # 항상 설정하세요!

19 }

20 r = httpx.post(URL, json=body, headers=headers, timeout=30)

21 r.raise_for_status()

22 return r.json()5단계: 페이지네이션 처리 및 결과 수집하기

1def collect_all_results(query, lat, lng, radius=3000, min_rating=4.0):

2 results = []

3 next_page_token = None

4 while True:

5 data = text_search(query, lat, lng, radius, min_rating)

6 places = data.get('places', [])

7 results.extend(places)

8 next_page_token = data.get('nextPageToken')

9 if not next_page_token:

10 break

11 return results6단계: Pandas로 데이터 내보내기

1df = pd.DataFrame(collect_all_results("브루클린의 커피숍", 40.6782, -73.9442))

2df.to_csv("brooklyn_coffee_shops.csv", index=False)팁:

- 비용을 제어하려면

X-Goog-FieldMask헤더를 항상 설정하세요. 리뷰나 사진을 요청하면 1,000건당 요금이 $5에서 $25로 올라갈 수 있어요(). minRating,includedType,locationBias같은 서버 측 필터를 사용해 불필요한 결과에 크레딧을 낭비하지 마세요.- 중복 제거와 추후 업데이트를 위해

place_id값을 캐시해 두세요.

방법 2: Google Maps HTML 웹 스크래핑하기(학습용/일회성 용도)

경고: Google Maps는 싱글 페이지 앱이에요. 반드시 브라우저 자동화(Playwright 또는 Selenium)를 사용해야 하며, HTML 스크래핑은 Google 약관을 위반할 수 있어요. 운영용이 아니라 연구용으로만 사용하세요.

1단계: Playwright 설치 및 브라우저 실행하기

1from playwright.sync_api import sync_playwright

2import time, re

3def scrape_maps(query, max_results=100):

4 with sync_playwright() as pw:

5 browser = pw.chromium.launch(headless=True)

6 ctx = browser.new_context(

7 user_agent="Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/124.0.0.0 Safari/537.36",

8 locale="en-US",

9 )

10 page = ctx.new_page()

11 page.goto("https://www.google.com/maps", timeout=60_000)

12 page.fill("#searchboxinput", query)

13 page.click('button[aria-label="Search"]')

14 page.wait_for_selector('div[role="feed"]')

15 feed = page.locator('div[role="feed"]')

16 prev = 0

17 while True:

18 feed.evaluate("el => el.scrollBy(0, el.scrollHeight)")

19 time.sleep(2)

20 count = page.locator('div[role="feed"] > div > div[jsaction]').count()

21 if count == prev or count >= max_results:

22 break

23 prev = count

24 if page.locator("text=You've reached the end of the list").count():

25 break

26 rows = []

27 cards = page.locator('div[role="feed"] > div > div[jsaction]')

28 for i in range(cards.count()):

29 c = cards.nth(i)

30 name = c.locator("div.fontHeadlineSmall").inner_text() if c.locator("div.fontHeadlineSmall").count() else ""

31 rating_el = c.locator('span[role="img"]').first

32 raw = rating_el.get_attribute("aria-label") if rating_el.count() else ""

33 m = re.search(r"([\d.]+)\s+stars?\s+([\d,]+)\s+Reviews", raw or "")

34 rating = float(m.group(1)) if m else None

35 reviews = int(m.group(2).replace(",", "")) if m else None

36 rows.append({"name": name, "rating": rating, "reviews": reviews})

37 browser.close()

38 return rows팁:

- Google은 몇 주마다 CSS 클래스를 무작위로 바꾸기 때문에 이 코드는 정기적으로 수정이 필요할 수 있어요.

- 차단 위험을 줄이려면 사람처럼 보이는 지연 시간을 사용하고 너무 빠르게 스크래핑하지 마세요.

- CAPTCHA나 Google의 SearchGuard 시스템을 우회하려고 시도하지 마세요. 법적 위험에 노출될 수 있어요.

무작정 긁지 말고, 필요한 데이터만 정확히 타깃하는 방법

모든 걸 다 긁는 건 시간 낭비와 비대한 데이터셋으로 가는 지름길이에요. 진짜 필요한 데이터만 타깃하는 방법은 다음과 같습니다.

- 타깃 URL 목록 만들기: 구글 맵스 자체 검색 필터(카테고리, 위치, 평점, 현재 영업 중)를 사용해 결과를 좁힌 뒤 스크래핑하세요.

- 구문 일치 활용하기: 정확한 비즈니스 유형이나 키워드로 검색하세요(예: “오스틴의 비건 베이커리”).

- 위치 필터 사용하기: 도시, 동네, 또는 좌표와 반경까지 지정해 정확도를 높이세요.

- 서버 측 필터(API): API 요청 본문에서

minRating,includedType,locationBias를 사용하세요. - 클라이언트 측 필터(Python): 스크래핑 후 pandas로 평점 4.0 이상, 리뷰 50개 초과, 특정 카테고리만 남기도록 필터링하세요.

예시: 맨해튼의 레스토랑 중 평점 4.0 이상만 필터링하기

1df = pd.DataFrame(results)

2filtered = df[(df['rating'] >= 4.0) & (df['types'].apply(lambda x: 'restaurant' in x))]

3filtered.to_csv("manhattan_top_restaurants.csv", index=False)Python 라이브러리로 Google Maps 데이터를 정리하고 내보내기

데이터를 수집했다면 이제 팀에서 쓸 수 있도록 정리, 분석, 내보내기를 해야 해요.

Pandas로 데이터 정리하고 구조화하기

1import pandas as pd

2df = pd.read_json("brooklyn_restaurants.json")

3df = (

4 df.dropna(subset=["name", "address"])

5 .drop_duplicates(subset=["place_id"])

6 .assign(

7 name=lambda d: d["name"].str.strip(),

8 phone=lambda d: d["phone"].astype(str)

9 .str.replace(r"\D", "", regex=True)

10 .str.replace(r"^1?(\d\{10\})$", r"+1\1", regex=True),

11 rating=lambda d: pd.to_numeric(d["rating"], errors="coerce"),

12 user_ratings_total=lambda d: pd.to_numeric(

13 d["user_ratings_total"], errors="coerce"

14 ).fillna(0).astype("int32"),

15 )

16)데이터 분석과 요약하기

예시: 동네별 평균 평점

1by_neighborhood = (

2 df.groupby("neighborhood", as_index=False)

3 .agg(avg_rating=("rating", "mean"),

4 n_places=("place_id", "nunique"),

5 median_reviews=("user_ratings_total", "median"))

6 .sort_values("avg_rating", ascending=False)

7)Excel 또는 CSV로 내보내기

1df.to_csv("brooklyn_top.csv", index=False)

2df.to_excel("brooklyn_top.xlsx", index=False, sheet_name="Top Rated")데이터가 큰가요? 속도와 용량 효율을 위해 Parquet 형식을 사용하세요.

1df.to_parquet("brooklyn_top.parquet", compression="zstd")Thunderbit: Python 구글 맵스 스크래퍼의 AI 기반 대안

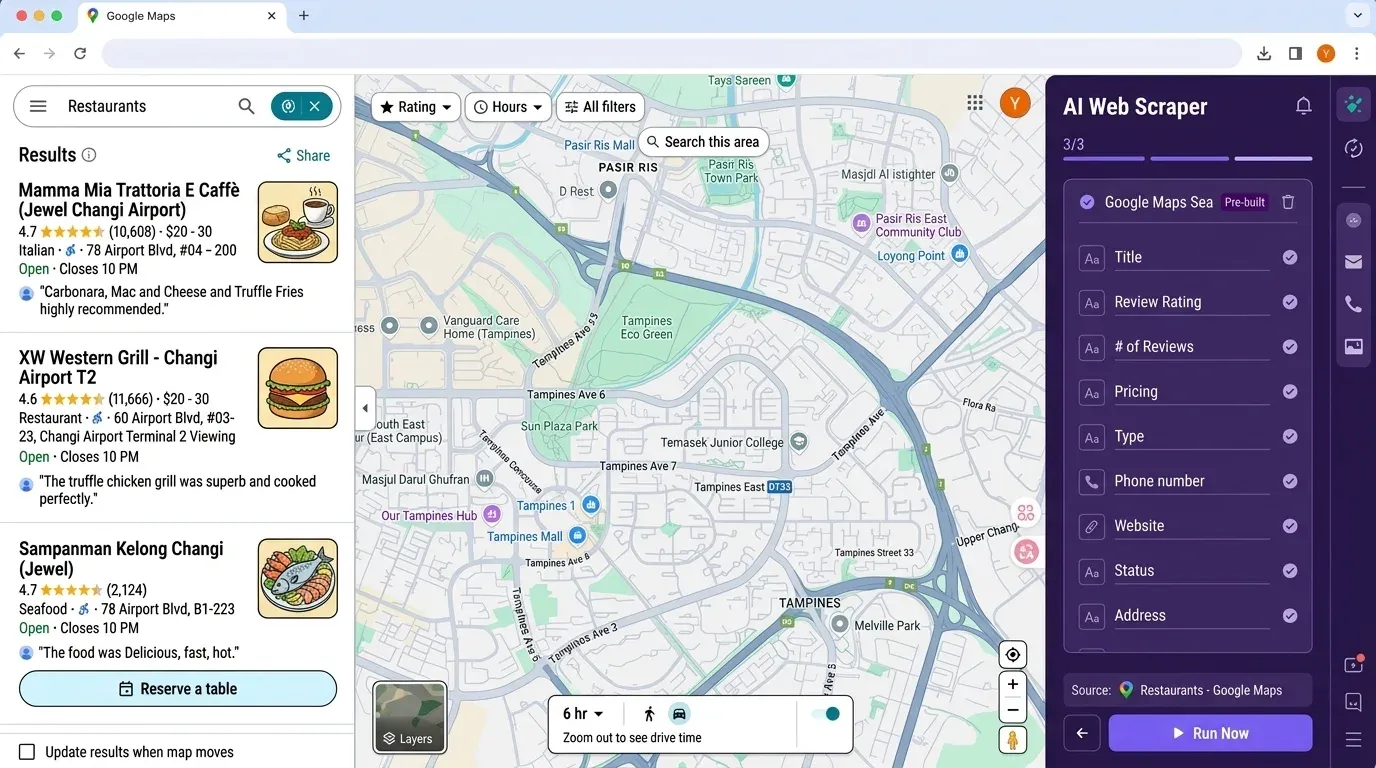

여기서 “간단한 리드 리스트 하나 만드는데 설정이 너무 많네”라고 생각하셨다면, 혼자가 아니에요. 그래서 저희는 을 만들었습니다. Google Maps 데이터를 포함해 다양한 웹 데이터를 클릭 몇 번으로 쉽게 추출할 수 있는 AI 기반 노코드 웹 스크래퍼예요.

왜 Thunderbit일까요?

- 코딩이나 API 키가 필요 없어요: 을 열고 구글 맵스로 이동한 뒤 “AI 필드 추천”을 클릭하면 됩니다.

- AI 필드 감지: Thunderbit의 AI가 페이지를 읽고 이름, 주소, 평점, 전화번호, 웹사이트 등 적절한 열을 제안해 줘요.

- 서브페이지 스크래핑: 각 비즈니스 웹사이트의 정보까지 표에 추가하고 싶으신가요? Thunderbit이 각 서브페이지를 방문해 추가 정보를 자동으로 가져올 수 있어요.

- Excel, Google Sheets, Airtable, Notion으로 내보내기: 더 이상 pandas를 붙잡고 씨름할 필요 없이 “내보내기”만 누르면 팀이 바로 쓸 수 있어요.

- 예약 스크래핑: 경쟁사를 모니터링하거나 리드 리스트를 자동으로 갱신하는 반복 작업을 설정할 수 있어요.

- 유지보수 제로: Thunderbit의 AI는 사이트 변화에 적응하므로, 깨진 스크립트를 계속 고칠 필요가 없어요.

Thunderbit vs Python 워크플로:

| 단계 | Python 스크래퍼 | Thunderbit |

|---|---|---|

| 도구 설치 | 30~60분(Python, pip, 라이브러리) | 2분(Chrome 확장 프로그램) |

| API 키 설정 | 10~30분(Cloud Console) | 필요 없음 |

| 필드 선택 | 수동 코드, 필드 마스크 | AI 필드 추천(1번 클릭) |

| 데이터 추출 | 스크립트 작성/실행, 오류 처리 | “스크래핑” 클릭 |

| 내보내기 | pandas로 CSV/Excel | Excel/Sheets/Notion으로 내보내기 |

| 유지보수 | 사이트 변경 시 수동 업데이트 | AI가 자동 적응 |

보너스: Thunderbit은 전 세계 가 신뢰하고 있으며, 무료 플랜으로는 최대 6페이지(체험 보너스 포함 시 10페이지)까지 무료로 스크래핑할 수 있어요.

규정 준수 지키기: Google Maps 이용약관과 스크래핑 윤리

이 부분은 많은 파이썬 튜토리얼이 위험할 정도로 최신 정보를 반영하지 못하는 지점이에요. 2026년 기준으로 알아야 할 내용은 다음과 같습니다.

- Google Maps Platform ToS §3.2.3는 공식 API 외의 방식으로 데이터를 스크래핑, 캐싱, 내보내기 하는 것을 엄격히 금지합니다(). 단 하나의 예외는 위도/경도 값은 최대 30일 동안 캐시할 수 있고, Place ID는 무기한 저장할 수 있다는 점이에요.

- API 사용자는 계약에 구속됩니다: API 키를 사용한다면, 공개 데이터만 다루더라도 Google 약관에 동의한 셈이에요.

- **기술적 장벽 우회(CAPTCHA, SearchGuard)**는 이제 잠재적인 DMCA §1201 위반이 될 수 있으며, 형사 처벌로 이어질 수 있어요().

- GDPR 및 개인정보 보호법: Google Maps에서 이메일, 전화번호, 리뷰어 이름 같은 개인 데이터를 수집한다면 합법적 근거가 있어야 하고 삭제 요청에도 응해야 합니다. 프랑스 CNIL은 2024년에 LinkedIn 연락처를 스크래핑한 KASPR에 20만 유로의 벌금을 부과했어요().

- 모범 사례:

- 가능하면 기본적으로 Places API를 사용하세요.

- 요청 속도를 제한하세요(API는 ≤10 QPS, HTML 스크래핑은 초당 1~2 요청).

- CAPTCHA나 기술적 차단을 우회하지 마세요.

- 스크래핑한 개인 데이터를 재배포하지 마세요.

- 옵트아웃 및 삭제 요청을 존중하세요.

- 항상 현지 법규를 검토하세요. GDPR, CCPA 등은 실제로 집행되고 있어요.

핵심: 규정 준수가 걱정된다면 API를 사용하고 수집하는 데이터를 최소화하세요. 대부분의 비즈니스 사용자에게는 Thunderbit 같은 노코드 도구가 위험을 줄여 줍니다(API 키도 없고, 재배포도 없어요).

Python으로 Google Maps 스크래핑을 예약하고 자동화하기

주간 경쟁사 모니터링이나 월간 리드 리스트 갱신처럼 데이터를 항상 최신으로 유지해야 한다면 자동화가 답이에요.

schedule로 간단히 예약하기

1import schedule, time

2from my_scraper import run_job

3schedule.every().day.at("03:00").do(run_job, query="브루클린의 레스토랑")

4schedule.every(6).hours.do(run_job, query="맨해튼의 커피숍")

5while True:

6 schedule.run_pending()

7 time.sleep(30)APScheduler로 운영 환경 수준의 예약하기

1from apscheduler.schedulers.background import BackgroundScheduler

2from apscheduler.triggers.cron import CronTrigger

3sched = BackgroundScheduler(timezone="America/New_York")

4sched.add_job(

5 run_job,

6 CronTrigger(hour=3, minute=15, jitter=600), # 오전 3:15 ± 10분

7 kwargs={"query": "브루클린의 레스토랑"},

8 id="brooklyn_daily",

9 max_instances=1,

10 coalesce=True,

11 misfire_grace_time=3600,

12)

13sched.start()안전한 자동화를 위한 팁

- 예측 가능한 패턴을 피하려면 일정에 무작위 지터를 추가하세요.

- HTML 스크래핑은 초당 1~2 요청을 넘기지 마세요.

- API를 사용할 때는 할당량을 모니터링하고 결제 알림을 설정하세요.

- 오류를 항상 기록하고, 실패한 요청은 “dead-letter” 파일로 따로 관리하세요.

Thunderbit 보너스: Thunderbit에서는 UI에서 바로 반복 스크래핑을 예약할 수 있어요. 코드도, cron 작업도, 서버 설정도 필요 없습니다.

핵심 요약: 효율적이고 타깃이 정확하며 규정을 준수하는 Google Maps 데이터 추출

핵심만 정리해 볼게요.

- Google Maps는 비즈니스 위치 데이터의 1순위 소스예요. 리드 생성부터 시장 조사까지 거의 모든 작업을 뒷받침합니다.

- 파이썬 스크래핑은 유연성과 제어력을 제공하지만, 특히 Google의 봇 차단과 법 집행이 강화되는 지금은 설정, 유지보수, 규정 준수 부담이 커요.

- API 기반 추출은 대부분의 팀에게 가장 안전하고 확장성 높은 방법이에요. 비용 관리를 위해 필드 마스크와 서버 측 필터를 꼭 사용하세요.

- HTML 스크래핑은 취약하고 위험해요. 일회성 조사에만 사용하고, 기술적 장벽은 절대 우회하지 마세요.

- 데이터를 정확히 타깃하세요: 구문 일치, 위치 필터, pandas 워크플로를 활용해 필요한 것만 추출하세요.

- Thunderbit은 비개발자에게 가장 빠른 길이에요. AI 기반, 설정 불필요, 즉시 내보내기, 내장 예약 기능까지 갖추고 있습니다.

- 규정 준수는 중요해요: 법적 문제를 피하려면 Google 약관, 개인정보 보호법, 요청 속도를 지켜야 합니다.

더 많은 튜토리얼과 팁은 와 에서 확인해 보세요.

자주 묻는 질문

1. 2026년에 파이썬으로 Google Maps 데이터를 스크래핑하는 건 합법인가요?

공식 API를 통한 Google Maps 스크래핑은 Google 약관 내에서 허용되며, 할당량을 지키고 제한된 데이터를 재배포하지 않는다면 가능합니다. 반면 Google Maps의 HTML 스크래핑은 Google ToS에서 명시적으로 금지하며, 특히 기술적 장벽을 우회하거나 동의 없이 개인 데이터를 수집하면 법적 위험이 큽니다. 항상 현지 법(GDPR, CCPA 등)을 확인하고 규정 준수 모범 사례를 따르세요.

2. Google Maps API와 HTML 웹 스크래핑의 차이는 무엇인가요?

API는 안정적이고 라이선스가 있으며 데이터 추출용으로 설계되었지만, API 키가 필요하고 할당량과 비용의 제약이 있습니다. HTML 스크래핑은 브라우저 자동화를 사용해 렌더링된 페이지에서 데이터를 추출하지만, 사이트 변경에 취약하고 약관 위반 소지가 있으며 법적 위험도 더 커요. 대부분의 비즈니스 용도에는 API가 권장됩니다.

3. 2026년에 파이썬으로 Google Maps 데이터를 추출하는 비용은 얼마나 드나요?

Google Places API 요금은 1,000건당 과금되며, 요청하는 필드에 따라 $5(Essentials)에서 $25(Enterprise+Atmosphere)까지 달라집니다. 월별 무료 기준치도 있지만(Essentials 10,000건, Pro 5,000건, Enterprise 1,000건), 대규모 스크래핑은 금세 비용이 쌓일 수 있어요. 비용 관리를 위해 필드 마스크와 서버 측 필터를 항상 사용하세요.

4. Thunderbit은 파이썬 기반 Google Maps 스크래퍼와 어떻게 다른가요?

Thunderbit은 코딩, API 키, 유지보수 없이 Google Maps 데이터와 더 많은 웹 데이터를 추출할 수 있는 노코드 AI 기반 웹 스크래퍼예요. Excel, Google Sheets, Airtable, Notion으로 빠르고 안정적으로 내보내고 싶은 영업·마케팅 팀에 특히 잘 맞습니다. 맞춤 로직이 필요한 기술 사용자라면 파이썬이 더 유연하지만, 그만큼 설정과 규정 준수 관리가 더 필요해요.

5. 반복적인 Google Maps 데이터 추출을 자동화하려면 어떻게 하나요?

파이썬에서는 schedule이나 APScheduler 같은 스케줄링 라이브러리를 사용해 스크래퍼를 정해진 간격(매일, 매주 등)으로 실행할 수 있습니다. 탐지 위험을 줄이기 위해 무작위 지터를 추가하고 API 할당량을 모니터링하세요. Thunderbit에서는 UI에서 바로 반복 스크래핑을 예약할 수 있어 코드나 서버 설정이 필요하지 않습니다.

Google Maps를 영업과 마케팅의 초능력으로 바꿀 준비가 되셨나요? 파이썬 애호가든, 가장 빠른 노코드 해법을 찾는 분이든, 2026년에는 필요한 도구가 이미 준비되어 있어요. 지금 바로 을 사용해 즉시 AI 기반 스크래핑을 시작하거나, 직접 API로 깊이 들어가 보세요. 어떤 방법을 택하든, 리드 리스트는 신선하게, 내보내는 데이터는 깔끔하게, 캠페인은 전환 가능성이 높은 지역 잠재고객으로 가득하길 바랍니다. 즐거운 스크래핑 되세요!

더 알아보기