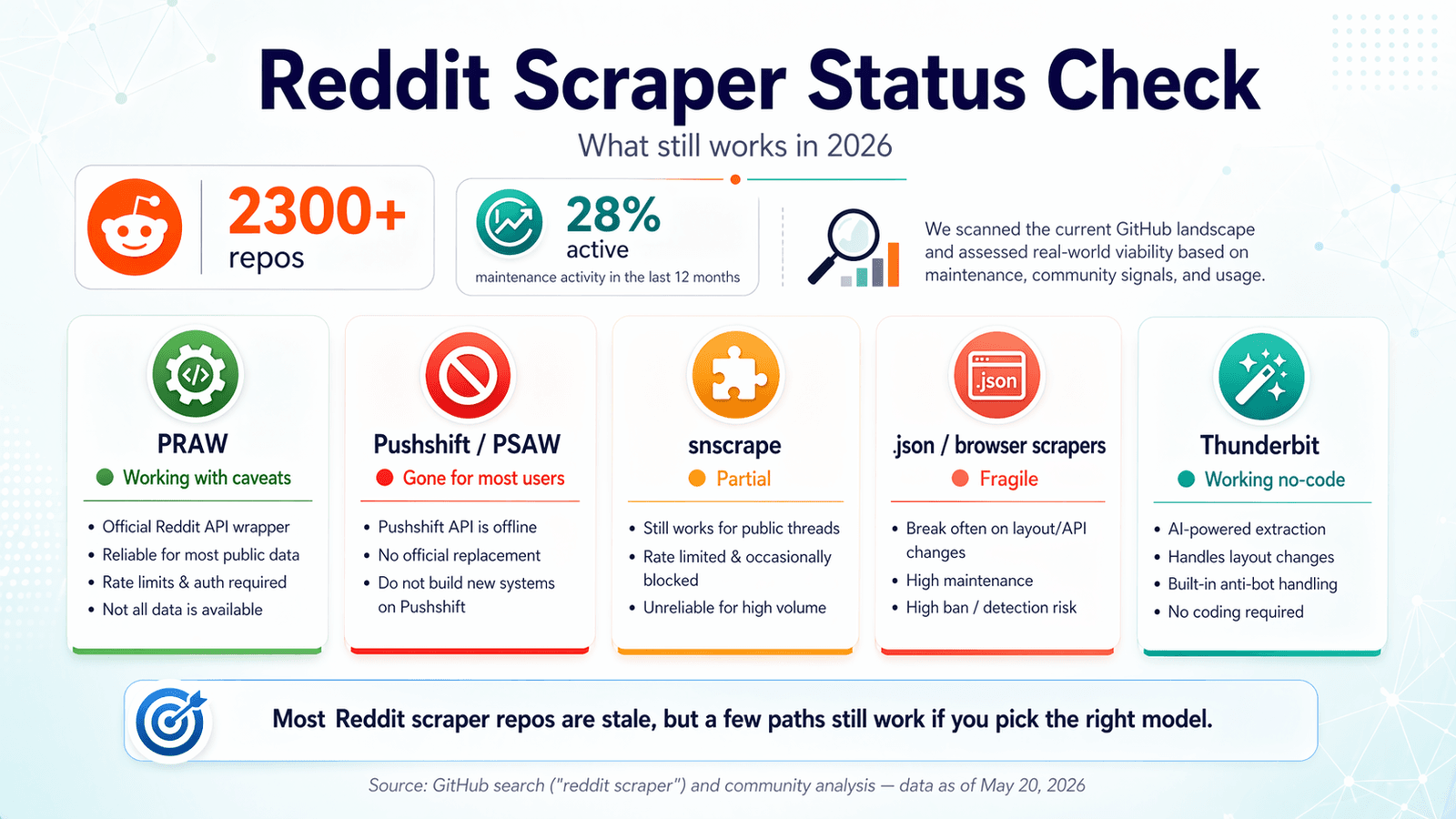

지금 GitHub에는 가 올라와 있어요. 겉으로 보면 선택지가 엄청 많아 보이죠. 하지만 함정이 있습니다. 지난 12개월 동안 실제로 유지보수된 곳은 약 28%뿐이에요. 지난 몇 주 동안 저는 이 저장소들을 하나씩 살펴보고, 엔드포인트를 테스트하고, 이슈 큐를 읽고, Reddit의 정책 업데이트까지 대조해 봤습니다. 목표는 분명했어요. 저장소를 클론해 놓고 OAuth와 씨름하다가, 한밤중이 되어서야 2024년에 이미 조용히 망가졌다는 사실을 알아차리는 일을 막아드리는 것. 2026년의 Reddit scraper GitHub 환경은 좋은 의도와 몇몇 정말 쓸 만한 도구가 섞인 묘지에 가깝습니다. 이 가이드는 지금도 작동하는 것, 이미 망가진 것, 아예 코드를 건너뛰어야 할 때, 그리고 점점 더 엄격해지는 Reddit의 집행을 어떻게 피해야 하는지까지 다룹니다. 지름길을 찾고 계시다면, 이 바로 이런 문제를 위해 우리가 만든 노코드 옵션입니다. 다만 코드 기반 해결책이 여전히 더 나은 경우도 있다는 점은 솔직하게 말씀드릴게요.

Reddit Scraper GitHub 저장소란 무엇이고, 왜 이렇게 많이 망가졌을까?

"reddit scraper github" 저장소는 보통 Reddit에서 게시물, 댓글, 사용자 데이터, 미디어를 자동으로 가져오는 오픈소스 Python(때로는 JavaScript) 프로젝트예요. 대체로 네 가지 계열로 나뉩니다.

- API 래퍼(예: PRAW): Reddit의 공식 API를 사용하며 OAuth가 필요하고 Reddit의 규칙을 따릅니다.

- Pushshift/PSAW 기반 도구: 과거 Reddit 데이터를 얻기 위해 Pushshift의 거대한 아카이브를 활용하던 방식입니다.

- 공개

.json엔드포인트 스크래퍼: Reddit URL 뒤에.json을 붙이거나 인증 없이 공개 엔드포인트를 호출합니다. - 브라우저 기반 스크래퍼: Playwright, Selenium 또는 브라우저 확장 프로그램을 사용해 Reddit 페이지를 불러오고 렌더링된 콘텐츠를 추출합니다.

그렇다면 왜 이렇게 많이 망가졌을까요? 이유는 세 가지입니다.

- 2023년 중반 Reddit의 API 요금 정책 개편. 무료 API 제한이 OAuth 사용 시 분당 로 낮아졌습니다. 상업적 사용량이 많으면 이제 API 호출 1,000건당 0.24달러가 듭니다. 많은 저장소는 사실상 무제한에 가까운 API 접근을 전제로 만들어졌는데, 그 시대는 끝났습니다.

- Pushshift의 공개 접근이 차단됨. Pushshift는 역사적 Reddit 연구의 핵심 기반이었습니다. Reddit이 이를 제한하면서 "과거 데이터 스크래퍼" 저장소의 상당수가 주요 데이터 소스를 잃었습니다. 일부 README는 아직도 도구가 살아 있는 것처럼 보이게 하지만, 일반 사용자에게는 이미 아래쪽 의존성이 사라진 상태입니다.

- Reddit의 정책과 집행이 모두 강화됨. 2024년 robots.txt 업데이트, 2025년 , 그리고 2026년 3월의 는 모두 Reddit이 더 이상 대량 스크래핑을 무해한 배경 소음으로 보지 않는다는 신호입니다. 심지어 했습니다.

결론적으로 "reddit scraper github"를 검색하면 수백 개의 결과가 나오지만, 마지막 커밋 날짜와 열린 이슈 수는 전혀 다른 이야기를 들려줍니다.

2026 Reddit Scraper GitHub 상태 점검: 지금도 무엇이 작동하나?

경쟁 글 대부분은 2023년이나 2024년에 쓰인 뒤 한 번도 업데이트되지 않았습니다. 포럼 사용자들은 1년 전엔 작동하던 저장소에서 계속 에러를 겪고 있어요. 한 사용자의 하소연, "Reddit API 제한 오류가 계속 납니다.\ 이걸 어떻게 넘기죠?"는 사실 2026년 Reddit scraper 경험을 한 문장으로 압축한 말입니다.

저는 2026년 4월 기준으로 최신 상태를 직접 점검했습니다. 결과는 이렇습니다.

PRAW: 공식 Python 래퍼

상태: ✅ 여전히 작동함, 단 주의사항 있음.

(Python Reddit API Wrapper)는 여전히 Reddit 스크래핑을 위한 가장 믿을 만한 오픈소스 기반입니다. 활발히 유지보수되고 있고, 스타 수는 4,099개, 마지막 푸시는 2026년 4월 20일, 열린 이슈는 6개뿐이며, 가 올라와 있습니다(2024년 10월 출시).

장점: 공식 도구이고 문서화가 잘 되어 있으며, Reddit API의 복잡성을 상당 부분 감춰줍니다.

2026년의 한계:

- 더 엄격한 OAuth 요구사항. 승인된 사용 사례 설명이 포함된 Reddit 앱을 등록해야 합니다.

- 2024년 이후 낮아진 속도 제한(OAuth 사용 시 분당 100회, 미사용 시 10회).

- 하드한 약 1,000개 게시물 목록 제한은 그대로입니다. r/redditdev와 Stack Overflow의 커뮤니티 스레드도 고 확인해 줍니다.

API의 울타리 안에서 쓸 수만 있다면 PRAW가 가장 안전한 선택입니다.

다만 이제는 자유롭게 대량 수집하는 도구는 아닙니다.

공식 API 경로를 실전에서 어떻게 쓰는지 보고 싶다면, 아래 튜토리얼이 이 섹션과 잘 맞습니다.

Pushshift / PSAW: 암전된 아카이브

상태: ❌ 공개 접근 불가.

는 과거 Reddit 데이터를 가장 쉽게 가져오던 Pushshift용 Python 래퍼였습니다. 하지만 2026년 현재 이 저장소는 아카이브되었고, README에는 문자 그대로 "THIS REPOSITORY IS STALE"라고 적혀 있습니다. 최근 열린 이슈도 "Pushshift.io에 연결할 수 없음"이나 "코드가 작동하지 않음. 아마 pushshift api 때문인 듯." 같은 제목이 달려 있습니다.

학술 접근은 특정 경로를 통해 여전히 가능할 수도 있지만, 지금 "reddit scraper github"를 찾는 일반 사용자에게 Pushshift/PSAW는 현실적인 선택지가 아닙니다. 깊은 과거 Reddit 데이터가 필요하다면 승인된 학술 데이터 접근이나 라이선스 경로를 찾아야 합니다.

snscrape(=Reddit 모듈): 부분적이고 신뢰하기 어려움

상태: ⚠️ 부분적 — 간헐적 오류, 사실상 유지보수 중단.

는 스타 수가 5,337개지만, 마지막 푸시는 2023년 11월 15일이었습니다. README에는 아직도 Reddit 스크래핑이 "via Pushshift"로 지원된다고 적혀 있습니다. 열린 Reddit 관련 이슈에는 "Error reddit scraping", "Reddit scraper가 2022-11-03 이전 제출물을 반환하지 않음" 같은 제목이 보이지만, 최근의 의미 있는 수정 활동은 없습니다.

일부 환경에서는 소규모 일회성 수집에 쓸 수 있지만, 운영용이나 반복 수집에는 믿기 어렵습니다. 레거시로 보는 편이 맞습니다.

Playwright와 .json 엔드포인트 스크래퍼: 때로는 통하는 우회책

상태: ✅ 작동함, 하지만 취약함.

아이디어는 단순합니다. 헤드리스 브라우저(Playwright, Puppeteer)로 Reddit 페이지를 불러와 렌더링된 콘텐츠를 스크래핑하거나, Reddit URL에 .json을 붙여 공식 API 없이 구조화된 데이터를 가져오는 방식입니다.

장점: API 키가 필요 없고, 1k 게시물 제한을 우회할 수 있으며, 렌더링된 콘텐츠에 접근할 수 있습니다.

단점: Reddit이 프론트엔드 레이아웃이나 JSON 구조를 바꾸면 깨집니다. 봇 방지 조치에 걸릴 수도 있고, 기술적인 설정도 더 필요합니다. 제 이번 달 테스트에서는 공개 Reddit .json 엔드포인트로 직접 요청했을 때 403 응답이 돌아왔습니다. 모든 환경이 차단된다는 뜻은 아니지만, 이제 .json 지름길을 "그냥 되겠지"라고 가정하면 안 된다는 의미입니다.

같은 저장소는 이런 현실을 솔직하게 적어둡니다. README에는 "로테이팅 프록시와 함께 사용하세요. 아니면 Reddit이 IP 차단 선물을 줄 수도 있습니다."라고 경고합니다. 2026년 4월의 상황을 한 문장으로 요약한 셈이죠.

브라우저 자동화 우회 경로를 평가하고 있다면, 아래 Playwright 튜토리얼이 이 섹션의 좋은 동반 자료입니다.

Thunderbit: AI 기반 브라우저 스크래핑(노코드, API 키 불필요)

상태: ✅ 작동함 — 페이지 변경에 자동으로 적응.

은 근본적으로 다른 방식을 씁니다. 으로, AI가 Reddit 페이지를 읽고 데이터 필드(게시물 제목, 작성자, 업보트, 시각, URL 등)를 제안한 뒤, 두 번의 클릭으로 구조화된 데이터를 추출합니다. OAuth 설정도, API 키 등록도, Python 환경도, 의존성 관리도 필요 없습니다. AI가 매번 페이지를 새로 읽기 때문에, Reddit이 레이아웃을 바꿔도 조용히 깨지는 대신 자동으로 적응합니다.

CSV, Google Sheets, Airtable, Notion으로 무료 내보내기를 지원합니다. 페이지네이션과 하위 페이지 스크래핑도 처리합니다(예: 서브레딧 목록을 스크래핑한 뒤 각 게시물을 방문해 댓글을 가져오기). GitHub 저장소를 직접 관리하지 않고 Reddit 데이터를 얻고 싶은 분들에게는 가장 부담이 적은 경로입니다.

(완전한 공개를 위해 말씀드리면, Thunderbit은 우리가 만들었기 때문에 제게 편향이 있는 건 맞습니다. 그래도 이 글 후반부에서는 코드 기반 솔루션이 언제 더 나은지도 분명히 말씀드릴게요.)

나란히 보는 상태 요약 표

| 도구 / 범주 | 2026년 4월에도 작동하나요? | API 키 필요? | 비고 |

|---|---|---|---|

| PRAW | ✅ 예, 단 주의 필요 | 예(OAuth) | 가장 잘 유지보수되는 오픈소스 기반. 속도 제한과 1k 게시물 제한의 영향을 받음. |

| Pushshift / PSAW | ❌ 아니요(대부분 사용자 기준) | 해당 없음 | 공개 접근 종료. 저장소 아카이브됨. |

| snscrape(=Reddit 모듈) | ⚠️ 부분적 / 신뢰 어려움 | 아니요 | 아직도 Reddit을 "via Pushshift"로 문서화함. 2023년 이후 유지보수 정체. |

| .json / 공개 엔드포인트 스크래퍼 | ⚠️ 부분적 | 아니요 | 작동할 수는 있지만, 직접 요청이 점점 차단되는 중. 프록시 의존. |

| Playwright / 브라우저 스크래퍼 | ✅ 예, 하지만 취약함 | 보통 아니요 | 가장 실용적인 비공식 우회책. 페이지 변경과 봇 방지 체크가 여전히 변수. |

| Thunderbit | ✅ 예 | 아니요 | AI/브라우저 워크플로. OAuth 없음, 셀렉터 없음. 비개발자에게 최적. |

속도 제한, 1k 게시물 한도, 그리고 실제로 도움이 되는 것

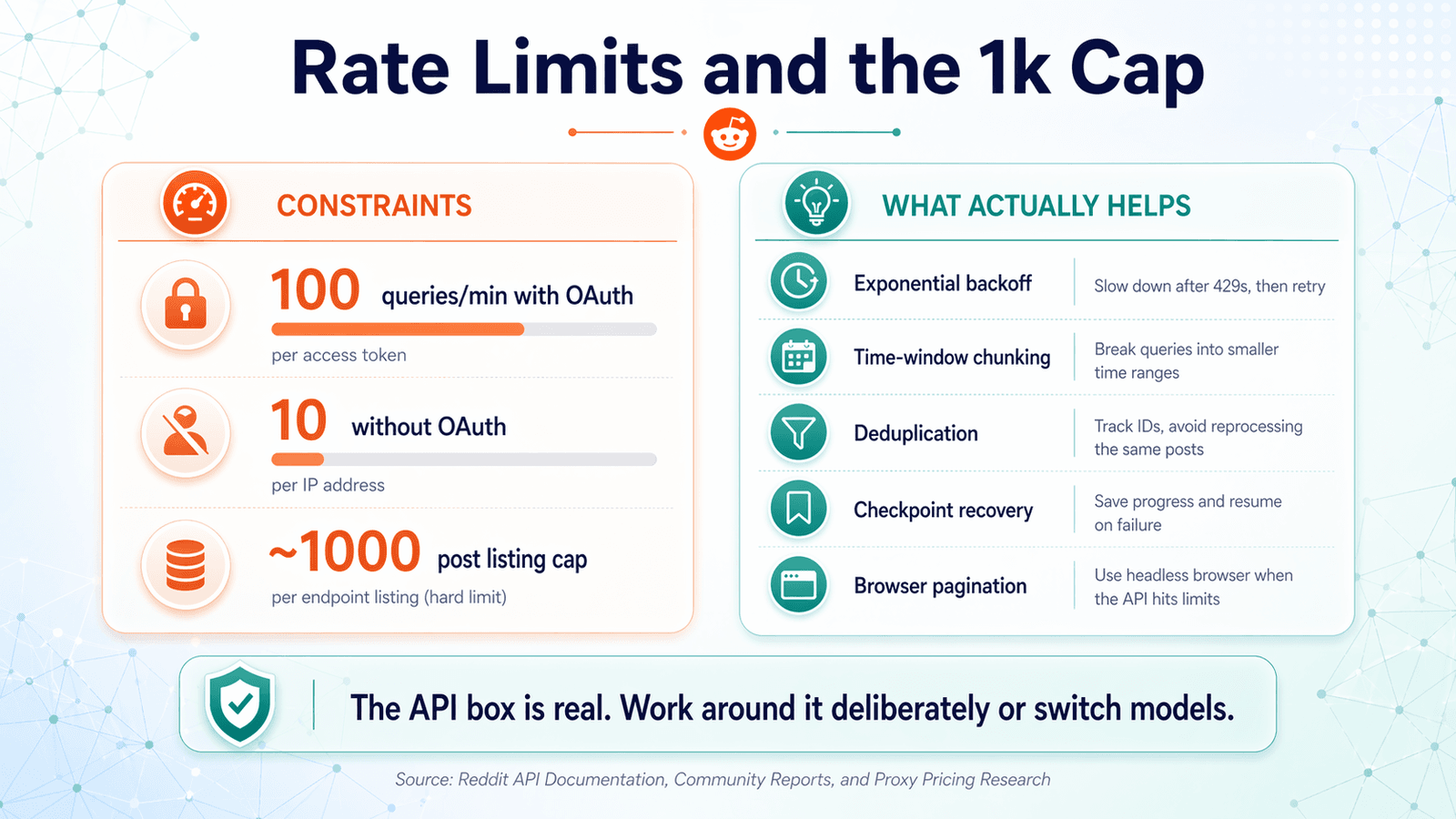

Reddit scraper GitHub 프로젝트를 쓰는 사람이라면 누구나 겪는 가장 큰 고통이 바로 이것입니다. 포럼 스레드는 불만으로 가득합니다. "속도 제한 때문에 실행이 중간에 죽는 게 지겹다", "왜 1,000개 정도밖에 안 나오지?" 핵심 제약은 Reddit API의 속도 제한(분당 요청 수)과 약 1,000개 게시물 목록 한도(API가 각 목록 엔드포인트에서 최근 약 1,000개 게시물만 반환)입니다.

속도 제한 관리 모범 사례

Reddit의 현재 공개 기준은 입니다. 실제로는 이렇게 대응하세요.

- 지수 백오프. 속도 제한 응답을 받으면 잠시 기다렸다가, 재시도할 때마다 대기 시간을 더 길게 잡습니다(1초, 2초, 4초, 8초…). 엔드포인트를 무작정 두들기지 마세요.

X-Ratelimit-Remaining헤더를 읽기. Reddit API 응답에는 남은 요청 수와 윈도우 리셋 시점을 알려주는 헤더가 포함됩니다. 감으로 하지 말고 이 값들을 기준으로 속도를 조절하세요.- 로테이팅 사용자 에이전트. 일부 저장소는 탐지를 피하기 위해 이를 권장합니다. 도움이 될 수는 있지만 윤리적으로 사용하세요. 이미 받은 차단을 피하려는 용도로 쓰면 안 됩니다.

- 모든 것을 로그로 남기기. API 응답, 속도 제한 헤더, 오류를 전부 기록하세요. 스크래퍼가 새벽 2시에 죽었을 때 로그는 최고의 친구입니다.

1,000개 게시물 천장 넘기기

API의 약 1,000개 항목 목록 제한을 넘는 가장 그럴듯한 우회책은 시간 구간 분할입니다.

before와after타임스탬프 파라미터로 한 구간을 조회합니다.- 창을 앞으로(또는 뒤로) 이동합니다.

- 반복합니다.

- 게시물 ID 기준으로 중복 제거합니다.

이건 우아하진 않지만, 목록 엔드포인트에서 무한한 과거를 한 번의 요청 루프로 가져올 수 있다고 가장하는 것보다는 정직합니다. 정말 오래된 데이터를 원한다면 승인된 학술 접근이나 라이선스 경로가 필요합니다. Pushshift는 더 이상 기본 해답이 아닙니다.

브라우저 기반 스크래핑(Playwright 또는 Thunderbit)은 페이지에 렌더링된 내용을 긁어오기 때문에 이 제한을 아예 우회합니다. API가 반환하는 값이 아니라 화면에 보이는 내용을 가져오기 때문이죠. Thunderbit의 페이지네이션 기능을 쓰면 원하는 만큼 페이지를 넘기며 데이터를 수집할 수 있습니다.

중복 제거와 오류 복구

대부분의 Reddit scraper GitHub 저장소는 기본적으로 중복 제거와 오류 복구를 제공하지 않습니다. 사용자들도 "중복 제거도 없고, 오류 후 속도 제한 회피도 없고, 파일이 이미 다운로드됐는지 확인도 없다"고 직접 불평합니다. 이렇게 하세요.

- 중복 제거: 각 게시물의 ID(또는 ID + 콘텐츠)를 해시로 만듭니다. 확인한 해시는 간단한 SQLite DB나 평범한 텍스트 파일에 저장하세요. 삽입 전에 이미 존재하는지 확인합니다. 특히 시간 창을 분할하거나 실패한 작업을 다시 실행할 때 중요합니다.

- 오류 복구: N개 레코드마다 체크포인트 파일에 진행 상황을 저장하세요. 실행이 실패하면 처음부터 다시 시작하지 말고 마지막 체크포인트부터 재개합니다. 이렇게 하면 3시간짜리 작업이 2시간 만에 죽는 상황을 1시간 재개 작업으로 바꿀 수 있습니다.

각 접근 방식이 이런 제약을 어떻게 다루는가

| 접근 방식 | 속도 제한 처리 | 1k개 초과 게시물? | 자동 중복 제거? | 오류 복구? |

|---|---|---|---|---|

| PRAW(원시 사용) | 수동(대기/재시도) | ❌(API 한도) | ❌ | ❌ |

| PRAW + 시간 구간 분할 | 수동 | ✅(우회 가능) | ❌ | ❌(직접 추가해야 함) |

| Playwright .json 스크래핑 | 해당 없음(API 미사용) | ✅ | ❌ | ❌ |

| Thunderbit(브라우저 스크래핑) | 내장됨(AI 페이싱) | ✅(페이지네이션) | 해당 없음(시각적 검토) | 내장됨 |

Reddit Scraper GitHub 저장소가 정답이 아닐 때: 노코드 경로

대부분의 Reddit scraper GitHub 글은 Python에 익숙하다고 가정합니다. 하지만 Reddit 스크래핑 솔루션을 찾는 사람들 중 상당수는 마케터, 세일즈 담당자, 연구자, 혹은 매일 Python을 쓰지 않는 1인 창업자입니다. 이들에게 GitHub 저장소는 숨은 비용을 늘립니다.

- OAuth 자격 증명과 Reddit 개발자 앱 설정

- Python 가상환경과 의존성 충돌 관리

- PRAW 내부 구조가 바뀔 때마다 이해하기 힘든 오류 메시지 디버깅

- Reddit이 사용 사례 승인을 안 해주면 API 키가 무효화될 가능성 처리

- Reddit이 뭔가를 바꿀 때마다 스크립트 유지보수

이건 가상이 아닙니다. 은 스타 2,563개, 열린 이슈 107개를 갖고 있습니다. 최근 보고에는 "설치가 너무 어렵다", "PRAW 모듈 오류", "인증조차 되지 않는 예외 발생" 같은 내용이 포함됩니다.

이런 경우 GitHub 저장소를 쓰세요...

- 커스텀 스크래핑 로직이 필요할 때(예: 특정 댓글 트리 순회, 맞춤 NLP 파이프라인 연동).

- 기존 Python 데이터 파이프라인에 통합해야 할 때.

- 데이터베이스나 데이터 웨어하우스 같은 커스텀 저장소로 매우 큰 규모를 수집해야 할 때.

- 코드를 유지보수하고 변경 사항을 처리하는 데 익숙할 때.

이런 경우 노코드 도구를 쓰세요...

- Reddit 데이터를 빨리, 즉 설정에 몇 시간 쓰지 않고 몇 분 안에 얻고 싶을 때.

- API 키, OAuth 앱, Python 환경을 관리하고 싶지 않을 때.

- 바로 쓰기 위해 스프레드시트, Notion, Airtable로 곧장 내보내고 싶을 때.

- Reddit 레이아웃이 바뀔 때 도구가 자동으로 적응하길 원할 때.

Thunderbit는 노코드 영역에 정확히 들어맞습니다. 사용자는 를 AI가 제안한 필드로 2번의 클릭만에 스크래핑하고, CSV/Google Sheets/Airtable/Notion으로 무료 내보내기를 하며, 코드를 한 줄도 쓰지 않고 페이지네이션을 처리할 수 있습니다. 브라우저 기반 스크래핑이므로 OAuth 설정도, API 키 등록도 필요 없습니다.

빠른 사용법: Thunderbit로 Reddit 스크래핑하기(단계별)

- 을 설치합니다.

- 스크래핑하려는 Reddit 페이지로 이동합니다(서브레딧, 검색 결과, 사용자 프로필).

- "AI 필드 제안"을 클릭합니다. Thunderbit이 페이지를 읽고 게시물 제목, 작성자, 업보트, 시각, URL 같은 열을 제안합니다.

- 필요하면 필드를 조정한 뒤 "스크래핑"을 클릭합니다.

- 데이터 테이블을 검토합니다. 원하면 "하위 페이지 스크래핑"을 클릭해 각 게시물을 방문하고 댓글이나 추가 정보를 가져옵니다.

- 내보내기를 원하는 곳으로 합니다: Google Sheets, Excel, Airtable, Notion, CSV, JSON.

2분이면 됩니다. 코드 한 줄도 필요 없습니다. 실제 동작을 보고 싶다면 을 확인해 보세요.

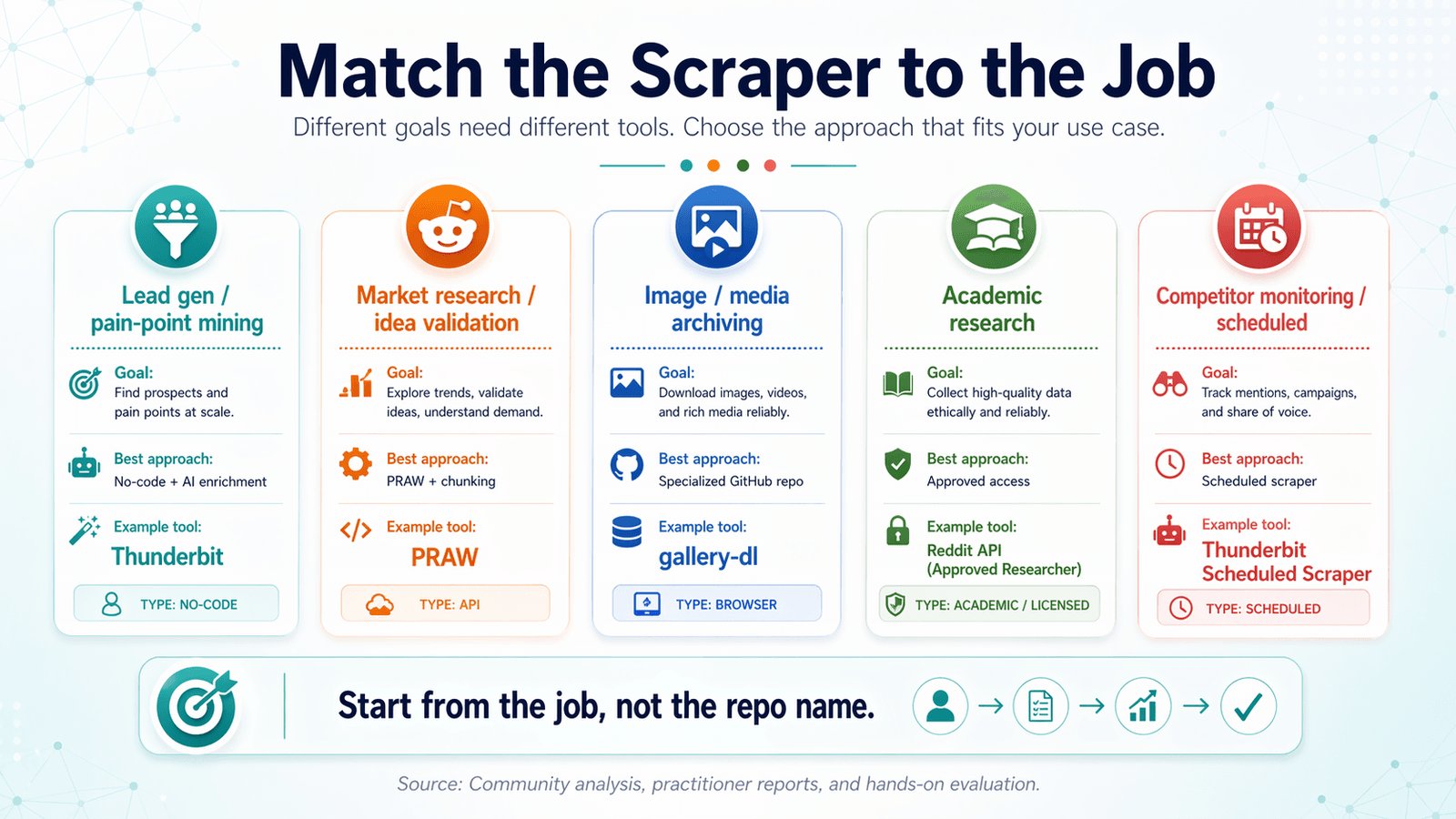

작업에 맞게 Reddit Scraper를 고르기: 사용 사례 결정 매트릭스

대부분의 Reddit scraper GitHub 글은 도구 중심으로 정리합니다. 그건 거꾸로예요.

목표부터 정하고, 그다음 거기에 맞는 도구를 고르세요.

리드 생성과 페인 포인트 발굴

필요한 것: 키워드 필터링이 된 게시물 + 댓글, AI 태깅/라벨링, CRM용 포맷으로 내보내기.

가장 좋은 접근: AI 보강이 가능한 노코드 스크래퍼.

추천 도구: (AI 라벨링 + Google Sheets/Airtable로 내보내 CRM에 가져오기).

예시 워크플로: 특정 페인 포인트를 언급한 게시물을 찾기 위해 서브레딧을 스크래핑합니다. Thunderbit의 Field AI Prompt로 감성을 분류하거나 주제를 태깅합니다. 이후 영업팀의 Airtable 또는 Google Sheet로 내보냅니다.

시장 조사와 아이디어 검증

필요한 것: 대량의 게시물 제목 + 점수, 서브레딧 단위 추세 데이터.

가장 좋은 접근: 볼륨은 시간 구간 분할이 있는 PRAW, 혹은 빠른 추출은 Thunderbit.

예시: 지난 90일 동안 r/SaaS나 r/startups를 스크래핑해 트렌딩 주제와 업보트 패턴을 확인합니다.

이미지 및 미디어 보관

필요한 것: 미디어 URL, 중복 제거, 예약 실행.

가장 좋은 접근: 특화된 GitHub 저장소(예: ) + cron 작업.

참고: 같은 이미지가 여러 서브레딧에 중복 게시되는 일이 흔하므로 중복 제거가 중요합니다.

학술 연구와 과거 데이터

필요한 것: 과거 데이터, 전체 댓글 트리, 대규모 데이터셋.

가장 좋은 접근: 승인된 학술 접근 또는 라이선스 데이터 경로. Pushshift는 더 이상 일반적인 해답이 아닙니다.

현실 점검: 2026년에는 Pushshift 제한과 Reddit의 강화된 데이터 정책 때문에 가장 어려운 사용 사례입니다.

경쟁사 모니터링과 예약 스크래핑

필요한 것: 정해진 간격으로 반복 수집, 변경 감지.

가장 좋은 접근: Thunderbit의 (시간 간격을 자연어로 설명하고, URL을 넣고, Schedule 클릭) 또는 코드 사용자라면 cron + 스크립트.

사용 사례 결정 매트릭스 표

| 사용 사례 | 필요한 것 | 가장 좋은 접근 | 예시 도구 |

|---|---|---|---|

| 리드 생성 / 페인 포인트 발굴 | 게시물 + 댓글, 키워드 필터링, AI 태깅 | 노코드 스크래퍼 + AI 보강 | Thunderbit |

| 시장 조사 / 아이디어 검증 | 대량의 게시물 제목 + 점수, 서브레딧 데이터 | PRAW + 시간 구간 분할 또는 Thunderbit | PRAW 또는 Thunderbit |

| 이미지/미디어 보관 | 미디어 URL, 중복 제거, 예약 실행 | 특화 GitHub 저장소 + cron | bulk-downloader-for-reddit |

| 학술 연구 | 과거 데이터, 전체 댓글 트리 | 승인된 학술 접근 또는 Playwright | Pushshift 학술 API(접근 가능할 경우) |

| 경쟁사 모니터링 / 예약 수집 | 반복 스크래핑, 변경 감지 | Scheduled Scraper | Thunderbit Scheduled Scraper 또는 cron |

커밋하기 전에 Reddit Scraper GitHub 저장소를 평가하는 법

저장소를 클론하고 디버깅을 시작하기 전에, 이 5분 점검을 해보세요. 몇 시간을 아껴줍니다.

5분 저장소 건강 점검

- 마지막 커밋 날짜. 6개월이 넘었으면 조심하세요. Reddit의 API는 자주 바뀝니다.

- 열린 이슈 대비 닫힌 이슈 비율. 답변되지 않은 이슈가 많으면 위험 신호입니다. 최근 이슈에 인증 실패, 403, Pushshift 장애가 있는지 보세요.

- LICENSE 파일. 존재하는지 확인하세요. 라이선스가 없으면 법적으로 모호합니다(아래에서 더 설명).

- 의존성. 필요한 라이브러리가 최신인가요? 더 이상 쓰이지 않는 패키지를 사용하나요? 2022년 버전으로 고정된

requirements.txt는 경고 신호입니다. - README 품질. 설정 과정을 명확히 설명하나요? 사용 예시가 있나요? 문서가 부실하면 그만큼 디버깅 시간이 늘어납니다.

- 스타 수 vs 포크 수 vs 최근 활동. 스타는 많지만 최근 활동이 적다면, 한때 인기 있었지만 지금은 방치된 프로젝트일 수 있습니다. 스타 수만 보지 말고

pushed_at날짜와 비교하세요.

간단한 예: 는 스타가 364개라 얼핏 보면 믿을 만해 보입니다. 하지만 저장소는 아카이브되어 있고 README에는 "THIS REPOSITORY IS STALE"라고 적혀 있습니다.

스타만으로는 이야기가 끝나지 않습니다.

Reddit Scraper GitHub 설정을 최대한 활용하는 팁

코드 경로를 택하기로 했다면, 두통을 줄이는 방법은 이렇습니다.

항상 가상환경을 사용하세요

가상환경은 스크래퍼의 의존성을 격리해 다른 Python 프로젝트와 충돌하지 않게 해줍니다. 명령은 하나면 됩니다. python -m venv venv를 실행하고, 무엇이든 설치하기 전에 활성화하세요. 기본적인 위생이지만, "module not found"라는 제목의 GitHub 이슈를 너무 많이 봐서 꼭 다시 말할 가치가 있습니다.

자격 증명은 안전하게 보관하세요

Reddit API client ID나 secret을 스크립트에 하드코딩하지 마세요. 환경 변수나 .env 파일을 사용하고, .env를 .gitignore에 추가하세요. 실수로 자격 증명을 GitHub에 푸시했다면 즉시 교체하세요. 봇들은 노출된 API 키를 계속 스캔합니다.

모든 것을 로그로 남기세요

API 응답, 속도 제한 헤더, 오류를 모두 기록하세요. 무언가가 깨졌을 때 로그가 있으면 "정확히 무슨 일이 일어났는지 안다"와 "왜 멈췄는지 전혀 모르겠다"의 차이가 생깁니다.

예약과 자동화는 신중하게 하세요

반복 수집을 돌린다면 cron(Linux/Mac)이나 작업 스케줄러(Windows)를 쓰되, 실패를 감시하세요. 2주 동안 조용히 실패한 cron 작업은 자동화가 없는 것보다 더 나쁩니다.

대안으로, Thunderbit의 는 간격을 자연어로 설명만 하면 되며, cron 문법이 필요 없습니다.

Reddit 스크래핑의 법적·윤리적 모범 사례

이건 대충 넣은 면책 문구가 아닙니다. Reddit은 2023년 API 변경 이후 약관 집행을 강하게 해왔고, 개인 데이터 스크래핑은 실제 법적 위험을 동반합니다.

정말 중요한 것만 보겠습니다.

Reddit 이용 약관: 실제로 뭐라고 쓰여 있나

Reddit의 (2026년 3월 31일까지 개정)은, 약관이나 별도 계약에서 허용하지 않는 한 자동화 수단으로 서비스의 데이터를 접근, 검색, 수집하는 것을 명시적으로 금지합니다. 와 는 더 자세히 설명합니다. Reddit은 개발자 사용을 모니터링하고 감사할 수 있으며, 접근을 변경하거나 중단할 수 있고, 과도하거나 남용적인 사용에는 영구 차단을 할 수 있습니다. 상업적 사용은 일반적으로 명시적 승인이 필요합니다.

2026년 3월의 는 더 나아갑니다. API를 통해 Reddit 데이터에 접근하기 전에 승인이 필요하고, 승인되지 않은 상업화와 AI/데이터 마이닝 용도는 금지되며, 집행에는 토큰 취소, 앱 또는 계정 정지, 연관된 봇이나 도메인 정지까지 포함될 수 있습니다.

robots.txt 준수

Reddit의 현재 는 꽤 엄격합니다.

1User-agent: *

2Disallow: /즉, 모든 자동화 사용자 에이전트에 대해 전면 금지입니다. 또한 도 참조합니다. 옛날 웹 스크래핑 관행에서 일부 개발자가 아직도 당연하게 가정하는 느슨한 robots.txt 패턴보다 훨씬 강한 제한입니다.

모범 사례: 도구가 자동으로 검사하지 않더라도 스크래핑 전에 항상 robots.txt를 확인하세요.

개인 데이터와 프라이버시(GDPR/CCPA)

사용자 이름, 게시물 기록, 또는 개인 식별 정보(PII)를 스크래핑한다면 (EU)와 CCPA(캘리포니아)가 적용될 수 있습니다. 모범 사례는 저장 전에 개인 데이터를 익명화하거나 집계하는 것입니다. 법적 근거 없이 개별 사용자의 프로필을 만들지 마세요.

GitHub 저장소 라이선스: 만들기 전에 확인하세요

많은 Reddit scraper GitHub 저장소는 MIT나 Apache 같은 관대한 라이선스를 쓰지만, 아예 LICENSE 파일이 없는 곳도 있습니다. 법적으로는 "모든 권리 보유"를 뜻합니다. 포크하거나 수정하거나 기반으로 새로 만들기 전에 항상 LICENSE 파일을 확인하세요. 스타가 아무리 많아도 라이선스가 없으면 법적으로 애매합니다.

2025~2026년의 집행은 실제입니다

Reddit의 집행은 2023년에 멈추지 않았습니다. Reddit은 2025년에 Anthropic을 상대로 Reddit 콘텐츠의 무단 스크래핑/사용을 주장하며 고소했고, 2025년 후반에는 Reddit v. SerpApi도 추진했습니다. 이는 Reddit이 단순한 기술적 차단이 아니라 법적 집행도 실제로 진행할 의지가 있다는 신호입니다.

2026년에 맞는 Reddit Scraper GitHub 접근법 고르기

Reddit scraper GitHub 환경은 2023년 이후 크게 바뀌었습니다. 대부분의 저장소는 구식입니다. 속도 제한과 1k 게시물 제한은 현실적인 제약입니다. 일반 사용자에게 Pushshift는 사라졌습니다. 그리고 Reddit의 정책 체계는 그 어느 때보다 명확하고 강하게 집행되고 있습니다.

짧게 정리하면:

- PRAW는 여전히 가장 신뢰할 만한 오픈소스 기반입니다. Reddit의 API 제한을 받아들이고 커스텀 로직을 만들고 싶다면요.

- Pushshift/PSAW는 더 이상 범용 해답이 아닙니다.

- snscrape의 Reddit 모듈은 레거시이며 신뢰하기 어렵습니다.

- .json과 공개 엔드포인트 스크래퍼는 취약하고 2026년에는 자주 차단됩니다.

- 브라우저 기반 도구는 Playwright 저장소이든 같은 노코드 옵션이든, 많은 사용자, 특히 비개발자에게 가장 실용적인 경로입니다.

도구가 아니라 사용 사례부터 시작하세요. 어떤 GitHub 프로젝트든 커밋하기 전에 5분 저장소 건강 점검을 하세요.

설정은 건너뛰고 몇 분 안에 Reddit 스크래핑을 시작하고 싶다면, .

자주 묻는 질문

2026년 GitHub에서 가장 좋은 오픈소스 Reddit 스크래퍼는 무엇인가요?

는 활발한 유지보수와 좋은 문서 덕분에 여전히 가장 신뢰할 만한 API 래퍼입니다. 는 PRAW 위에 만들어진, 유지보수되는 신뢰할 만한 CLI 도구입니다. Playwright 기반 스크래퍼는 비API 스크래핑에 유용하고, snscrape의 Reddit 모듈은 부분적으로는 작동하지만 대체로 유지보수가 중단되었습니다. 어떤 저장소를 쓰기 전에도 마지막 커밋 날짜와 열린 이슈를 꼭 확인하세요. GitHub의 대부분은 이미 구식입니다.

Reddit 스크래핑은 합법인가요?

공개 데이터 스크래핑은 법적 회색지대에 있지만, Reddit 자체 약관은 엄격합니다. , , , , 모두 무단 대량 스크래핑을 강하게 제한합니다. 스크래핑한 데이터의 상업적 재배포는 Reddit의 명시적 허가가 필요할 수 있습니다. 개인 데이터를 스크래핑한다면 GDPR과 CCPA도 적용될 수 있습니다.

Reddit API 속도 제한을 어떻게 넘기나요?

지수 백오프를 사용하고, X-Ratelimit-Remaining 헤더를 모니터링하며, 시간 구간 분할을 고려해 제한 안에서 작업하세요. 브라우저 기반 스크래핑(Playwright 또는 )은 렌더링된 페이지를 긁기 때문에 API 속도 제한을 우회하지만, 페이지 로딩 속도나 봇 방지 조치 같은 다른 고려사항이 있습니다. 속도 제한을 완전히 없애는 마법 같은 방법은 없습니다. 서버 측에서 강제되기 때문입니다.

API 키 없이 Reddit을 스크래핑할 수 있나요?

네. Playwright 기반 스크래퍼와 .json URL 트릭은 API 키가 필요 없습니다. 도 브라우저를 통해 스크래핑하므로 API 키가 필요 없습니다. 다만 .json 엔드포인트는 점점 더 자주 차단되고 있으며(2026년 4월 기준 많은 환경에서 403 반환), 브라우저 기반 스크래핑은 API 호출보다 느리고 리소스도 더 많이 씁니다.

Reddit 스크래핑에서 Pushshift는 어떻게 됐나요?

2023년부터 Reddit의 데이터 라이선싱 변경이 시작되면서 Pushshift의 공개 API 접근은 제거되었습니다. 래퍼는 아카이브되었고 구식입니다. 제한된 학술 접근은 일부 승인 경로를 통해 가능할 수 있지만, 오늘날 "reddit scraper github"를 찾는 대부분의 사용자에게 Pushshift는 더 이상 현실적인 선택지가 아닙니다. 깊은 과거 Reddit 데이터가 필요하다면 Reddit이 승인한 학술 또는 라이선스 데이터 경로를 찾아보세요.

더 알아보기