웹에는 방대한 양의 데이터가 있지만, 상품 목록이나 채용 공고를 사람이 하나씩 복사해 정리하는 방식은 오래 유지하기 어렵습니다. 그래서 웹 스크래핑은 영업, 운영, 이커머스, 리서치 업무에서 중요한 실무 역량이 됐습니다. 파이썬은 비교적 읽기 쉬운 문법과 풍부한 라이브러리 덕분에 웹 스크래퍼 개발에 가장 널리 쓰이는 언어 중 하나이며, 실제로 이 파이썬을 사용한다는 조사도 있습니다.

다만 처음 시작할 때는 환경 설정, HTML 구조 파악, 동적 페이지 처리, 차단 대응처럼 생각보다 많은 요소를 함께 다뤄야 합니다. 이 글에서는 처음부터 따라 할 수 있는 파이썬 웹 스크래퍼 예제를 바탕으로, 기본 코드 구조와 데이터 저장 방식, 그리고 를 활용해 더 효율적으로 웹 데이터를 수집하는 방법까지 차례대로 설명합니다.

파이썬 웹 스크래핑 기초: 환경 세팅부터 차근차근

먼저 웹 스크래핑은 웹사이트에서 원하는 정보를 자동으로 수집하는 작업을 뜻합니다. 사람이 직접 복사하지 않아도 스크래퍼가 페이지에 접속해 HTML을 읽고, 상품 가격, 연락처, 리뷰 같은 필요한 데이터만 추출합니다. 비즈니스에서는 실시간 리드 확보, 가격 모니터링, 시장 조사 같은 업무에 바로 활용할 수 있습니다. ()

1단계: 먼저 Python 실행 환경부터 준비하기

먼저 Python 3이 필요합니다. 에서 최신 버전을 받아 설치하세요. 윈도우라면 설치할 때 "Add Python to PATH" 옵션을 켜 두는 편이 좋습니다. Mac은 로 brew install python 명령어를 쓰거나 직접 다운로드하면 됩니다. 설치 후 터미널(또는 명령 프롬프트)에서 아래처럼 버전을 확인해보세요:

1python --version또는

1python3 --version버전 정보가 정상적으로 보이면 준비가 끝난 것입니다.

2단계: 프로젝트용 가상 환경 만들기

가상 환경은 프로젝트별로 라이브러리를 따로 관리해서 충돌을 막아줍니다. 프로젝트 폴더에서 아래 명령어를 실행하세요:

1# macOS/Linux

2python3 -m venv .venv

3# Windows

4py -m venv .venv가상 환경 활성화 명령은 운영체제에 따라 아래와 같습니다.

- macOS/Linux:

source .venv/bin/activate - Windows:

.venv\Scripts\activate

이제 설치하는 모든 패키지는 이 프로젝트 안에서만 적용됩니다. ()

3단계: 기본 라이브러리 먼저 설치하기

아래 패키지가 기본적으로 필요합니다.

- Requests: 웹페이지 요청 처리

- BeautifulSoup (bs4): HTML 파싱

- Scrapy: 대규모 크롤링용 프레임워크

설치 명령은 다음과 같습니다.

1pip install requests beautifulsoup4 scrapy- Requests는 HTTP 요청을 간단하게 처리할 수 있게 해줍니다.

- BeautifulSoup은 HTML에서 원하는 요소를 찾고 값을 추출하기 쉽게 만들어줍니다.

- Scrapy는 많은 페이지를 수집할 때 필요한 에러 처리와 데이터 내보내기까지 함께 지원하는 프레임워크입니다.

처음에는 Requests와 BeautifulSoup 조합이 가장 쉽고, 대규모 작업이 필요할 때 Scrapy를 써보세요.

4단계: 프로젝트 폴더 구조 정리하기

파일을 체계적으로 관리하세요! 프로젝트 폴더를 만들고, 그 안에 스크립트, 데이터 파일, 가상 환경을 정리해두면 나중에 훨씬 편합니다.

파이썬 웹 스크래퍼 예제: 기본 코드 구조

이제 간단한 스크래퍼를 만들어보겠습니다. 아래 코드는 웹페이지를 불러오고, 파싱해서 데이터를 추출하는 가장 기본적인 예제입니다. 연습용 예제 사이트를 대상으로 전체 흐름만 먼저 익힌다고 생각하면 됩니다.

1import requests

2from bs4 import BeautifulSoup

3URL = "https://example.com"

4response = requests.get(URL)

5response.raise_for_status() # 200 OK가 아니면 에러 발생

6soup = BeautifulSoup(response.text, "html.parser")

7# 모든 p 태그 찾기

8paragraphs = soup.find_all('p')

9for idx, p in enumerate(paragraphs, start=1):

10 print(f"Paragraph {idx}: {p.get_text()}")코드의 흐름은 다음과 같습니다.

- 라이브러리 임포트

requests.get으로 웹페이지 요청- BeautifulSoup으로 HTML 파싱

- 모든

<p>태그를 찾아 텍스트를 출력

자주 하는 실수:

response.status_code를 확인하지 않음 (반드시 200 OK 확인)- 요소가 없을 때

.get_text()를 호출해 에러 발생 - 가상 환경을 활성화하지 않아 임포트 에러 발생

이런 구조(임포트 → 요청 → 파싱 → 추출 → 출력)가 대부분의 파이썬 스크래퍼의 기본 뼈대입니다.

파이썬으로 웹페이지 스크래핑: 단계별 실전 절차

실제 업무에서는 다음 순서로 진행하는 경우가 많습니다.

1. 웹사이트 구조 파악

브라우저에서 원하는 데이터를 우클릭해서 “검사”를 눌러보세요. 개발자 도구에서 HTML 구조를 확인하고, 고유한 태그, 클래스, ID 등을 찾아 타겟 데이터를 식별합니다. ()

2. 페이지 요청

Requests로 HTML을 받아옵니다:

1headers = {"User-Agent": "Mozilla/5.0"}

2response = requests.get(URL, headers=headers)

3response.raise_for_status()User-Agent를 추가하면 단순한 차단 규칙에 걸릴 가능성을 낮출 수 있습니다.

3. HTML 파싱

1soup = BeautifulSoup(response.text, "html.parser")4. 데이터 위치 파악 및 추출

예를 들어, 각 채용공고가 <div class="job-card">에 있다면:

1job_cards = soup.find_all('div', class_='job-card')

2for card in job_cards:

3 title = card.find('h2', class_='title').get_text(strip=True)

4 company = card.find('h3', class_='company').get_text(strip=True)

5 print(title, company).find(), .find_all(), .select() 등 다양한 방법으로 원하는 요소를 찾을 수 있습니다.

5단계: 목록형 데이터를 반복 처리하기

상품 목록, 채용공고 등 여러 개의 컨테이너를 반복문으로 돌며 필요한 필드를 추출하고, 리스트나 딕셔너리로 저장하세요.

6. 문제 해결

- 결과가 비어 있다면 셀렉터가 잘못됐거나, 데이터가 자바스크립트로 로드되는지 확인하세요.

response.text[:500]을 출력해 HTML이 제대로 받아졌는지 확인하세요.

파이썬 웹 스크래퍼 예제: 데이터 저장 및 내보내기

데이터를 수집했다면 저장이 필요하겠죠. 대표적인 방법은 다음과 같습니다:

콘솔에 출력

간단한 테스트에는 좋지만, 실제 프로젝트에는 부적합합니다.

CSV 형식으로 결과 저장하기

1import csv

2data = [

3 {"Name": "Alice", "Age": 25},

4 {"Name": "Bob", "Age": 30},

5]

6with open("output.csv", "w", newline="", encoding="utf-8") as f:

7 writer = csv.DictWriter(f, fieldnames=["Name", "Age"])

8 writer.writeheader()

9 writer.writerows(data)엑셀 파일로 내보내기

pandas와 openpyxl이 설치되어 있다면:

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_excel("output.xlsx", index=False)데이터베이스에 저장

간단한 용도라면 파이썬 내장 SQLite를 활용할 수 있습니다:

1import sqlite3

2conn = sqlite3.connect("scraped_data.db")

3cursor = conn.cursor()

4cursor.execute("CREATE TABLE IF NOT EXISTS people (name TEXT, age INTEGER)")

5for row in data:

6 cursor.execute("INSERT INTO people VALUES (?, ?)", (row["Name"], row["Age"]))

7conn.commit()

8conn.close()언제 어떤 방식을 쓸까?

- CSV: 스프레드시트, 공유에 최적

- 엑셀: 포맷팅된 보고서, 여러 시트 필요할 때

- 데이터베이스: 대용량, 반복 작업에 적합

파일 저장 시 encoding="utf-8"을 꼭 지정해 한글 등 특수문자 깨짐을 방지하세요. ()

Thunderbit와 파이썬: 스크래핑 워크플로우 혁신하기

이제 을 소개할게요. Thunderbit은 AI 기반 웹 스크래퍼 크롬 확장 프로그램으로, 비즈니스 사용자를 위한 웹 데이터 수집 방식을 완전히 바꿔놓고 있습니다.

이제 을 소개할게요. Thunderbit은 AI 기반 웹 스크래퍼 크롬 확장 프로그램으로, 비즈니스 사용자를 위한 웹 데이터 수집 방식을 완전히 바꿔놓고 있습니다.

Thunderbit만의 차별점은?

- AI 필드 추천: Thunderbit의 AI가 페이지를 분석해서 어떤 데이터 컬럼을 추출할지 자동으로 제안해줍니다. HTML 구조를 일일이 분석하거나 셀렉터를 직접 작성할 필요가 없어요.

- 포인트 앤 클릭 방식: 확장 프로그램을 열고, AI가 추천한 필드를 확인한 뒤 “스크래핑” 버튼만 누르면 끝!

- 서브페이지 자동 추출: 상품 상세, 프로필 등 하위 페이지까지 자동으로 방문해 추가 정보를 수집할 수 있습니다.

- 다양한 내보내기: CSV, 엑셀 다운로드는 물론, Google Sheets, Notion, Airtable로 바로 내보낼 수 있습니다. ()

Thunderbit와 파이썬의 시너지

예를 들어, 자바스크립트로 동작하거나 로그인 등 복잡한 절차가 필요한 이커머스 사이트를 스크래핑한다고 가정해봅시다. 전통적인 파이썬 스크립트로는 어려울 수 있지만, Thunderbit은 브라우저에서 직접 동작하기 때문에 이런 사이트도 손쉽게 처리할 수 있습니다. 데이터를 추출한 뒤에는 CSV로 내보내 파이썬에서 추가 분석, 리포트, 자동화에 활용할 수 있습니다.

활용 예시:

- Thunderbit으로 동적 사이트에서 상품 목록(이미지, 가격, 리뷰 등 포함) 스크래핑

- CSV로 내보내기

- 파이썬으로 트렌드 분석, 데이터 병합, 알림 자동화 등 후처리

이렇게 하면 코딩 실력과 상관없이 복잡한 스크래핑도 손쉽게 해결할 수 있습니다.

파이썬 웹 스크래퍼의 정확성과 안정성 높이기

웹 스크래핑은 단순히 데이터를 긁어오는 게 아니라, 정확한 데이터를 지속적으로 수집하는 게 중요합니다. 다음 팁을 참고하세요:

1. 웹사이트 구조 변경 대응

사이트의 HTML 구조는 자주 바뀔 수 있습니다. 셀렉터는 최대한 고유한 ID나 변하지 않는 클래스명을 사용해 작성하세요.

2단계: 예외 상황까지 고려한 요청 처리 넣기

요청 및 파싱 코드를 try/except로 감싸 예외 상황에 대비하세요:

1import time

2for attempt in range(3):

3 try:

4 response = requests.get(url, timeout=10)

5 response.raise_for_status()

6 break

7 except Exception as e:

8 if attempt < 2:

9 time.sleep(5)

10 else:

11 print(f"3회 시도 후 실패: {e}")3. User-Agent 랜덤화 및 프록시 사용

많은 사이트가 봇으로 의심되는 요청을 차단합니다. User-Agent를 무작위로 바꾸고, 대량 스크래핑 시에는 프록시를 활용해 IP 차단을 피하세요. ()

4. robots.txt 준수 및 윤리적 스크래핑

항상 사이트의 robots.txt와 이용약관을 확인하세요. 공개 데이터만 수집하고, 개인정보는 피하며, 서버에 과도한 부하를 주지 않도록 주의하세요. ()

5단계: 로그 기록과 실행 상태 모니터링하기

파이썬의 logging 모듈로 에러와 성공 내역을 기록하세요. 스케줄러로 주기적으로 실행한다면, 실패나 결과 없음 등의 상황에 알림을 설정하는 것이 좋습니다.

Thunderbit의 AI 기능으로 파이썬 웹 스크래핑 업그레이드

Thunderbit은 단순한 스크래핑을 넘어, 전체 과정을 더 똑똑하고 빠르게 만들어줍니다.

Thunderbit은 단순한 스크래핑을 넘어, 전체 과정을 더 똑똑하고 빠르게 만들어줍니다.

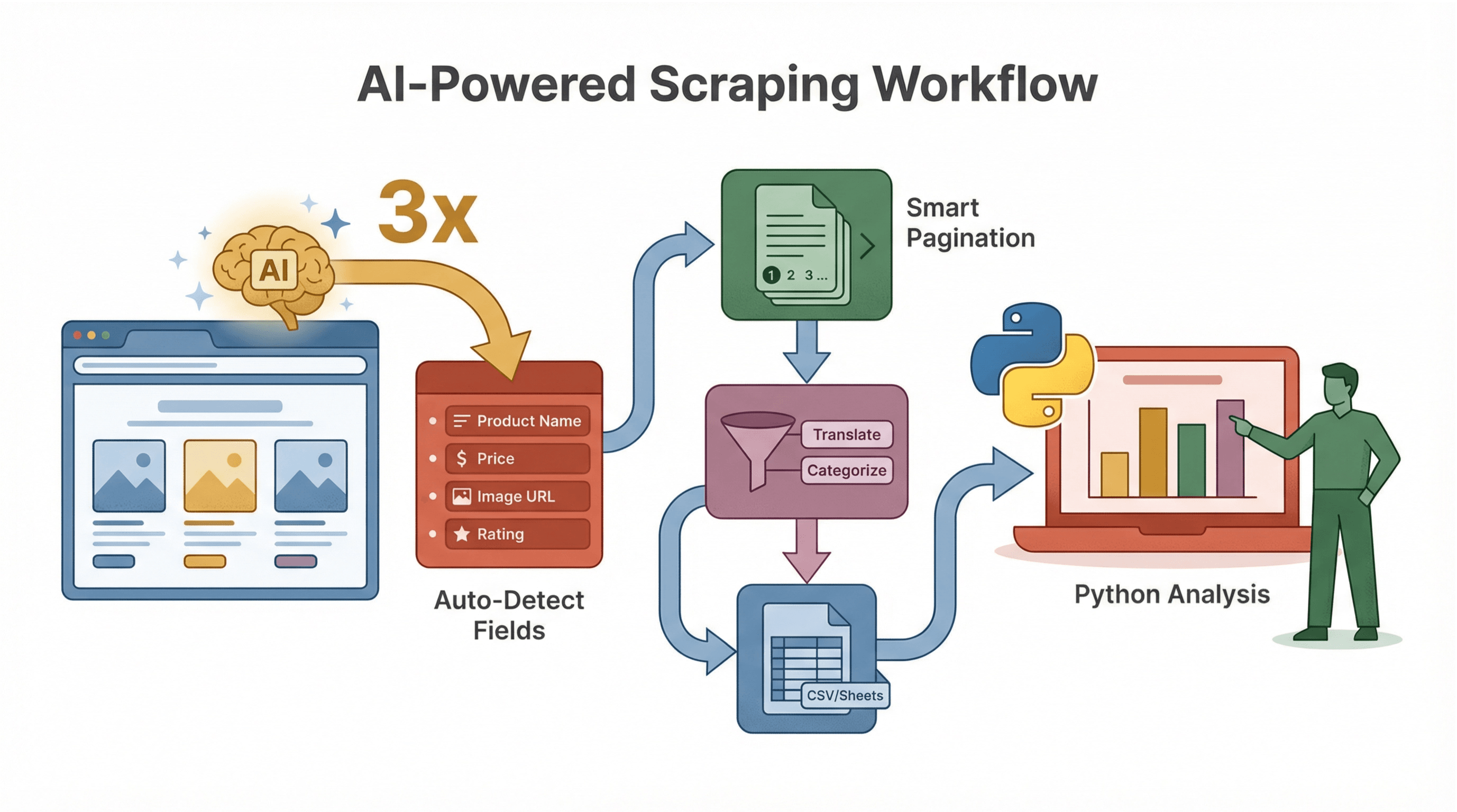

AI 기반 데이터 스키마 추천

Thunderbit의 AI는 어떤 필드를 추출할지 즉시 제안해줍니다. 예를 들어 상품 페이지라면 “상품명”, “가격”, “이미지 URL” 등을 자동으로 인식합니다.

서브페이지 및 페이지네이션 자동 처리

상세 페이지나 여러 결과 페이지가 있을 때도 Thunderbit의 AI가 이를 감지해 모두 스크래핑합니다. 이커머스, 부동산, 리드 수집 등에서 매우 유용합니다.

AI 데이터 정제 및 가공

스크래핑과 동시에 번역, 요약, 분류 등 AI 프롬프트를 각 필드에 추가할 수 있습니다. 예를 들어 리뷰를 “긍정/부정”으로 분류하거나, 가격 문자열에서 숫자만 추출하는 것도 가능합니다.

워크플로우 예시

- Thunderbit으로 데이터 구조화 및 AI 필드 추천 활용

- CSV 또는 Google Sheets로 내보내기

- 파이썬으로 분석, 시각화, 후속 자동화 작업 진행

코딩을 모르는 팀원도 Thunderbit으로 스크래핑을 맡기고, 파이썬으로 고급 분석을 할 수 있어 협업에 최적입니다.

파이썬 웹 스크래퍼 예제: 고급 팁 & 자주 발생하는 문제

한 단계 더 성장하고 싶다면 아래 팁을 참고하세요:

동적 콘텐츠 스크래핑

요즘 웹사이트는 자바스크립트로 데이터를 불러오는 경우가 많아요. Requests + BeautifulSoup으로 데이터가 비거나 일부만 나올 때는:

- Selenium 또는 Playwright: 실제 브라우저를 자동화해 페이지를 렌더링한 뒤 HTML을 추출

- API 확인: 네트워크 탭에서 백그라운드로 호출되는 API(주로 JSON 반환)를 찾아 직접 요청하면 훨씬 쉽습니다!

페이지네이션 처리

URL 파라미터(예: ?page=2)를 바꿔가며 반복하거나, BeautifulSoup으로 “다음” 링크를 찾아 더 이상 페이지가 없을 때까지 반복하세요.

스케줄링 자동화

파이썬의 schedule 라이브러리나 크론(cron)으로 스크래퍼를 자동 실행할 수 있습니다. Thunderbit의 내장 스케줄러를 활용하면 코딩 없이도 가능합니다.

자주 발생하는 문제

- CAPTCHA: 요청 속도를 늦추거나, 프록시 사용, 또는 사람이 직접 인증하는 방식 필요

- 인코딩 문제: 파일 저장 시 항상

encoding="utf-8"지정 - IP 차단: 프록시 회전, User-Agent 랜덤화, 요청 속도 제한 준수

마무리: 실전에 바로 적용할 핵심 정리

파이썬으로 웹 스크래핑을 마스터하는 일, 생각보다 어렵지 않습니다. 다음 순서로 시작해보세요:

- 환경과 필수 라이브러리 세팅

- 타겟 사이트 구조 분석 및 셀렉터 설계

- 간단한 스크립트로 데이터 요청, 파싱, 추출

- 비즈니스 목적에 맞는 포맷(CSV, 엑셀 등)으로 결과 내보내기

실력이 쌓이면, 같은 AI 기반 도구와 파이썬을 결합해 복잡하거나 대용량, 동적 사이트까지 손쉽게 처리할 수 있습니다. Thunderbit의 AI 필드 추천, 서브페이지 자동 추출, 즉시 내보내기 기능은 수작업 시간을 크게 줄여주고, 비개발자도 쉽게 활용할 수 있습니다.

기억하세요: 최고의 스크래퍼는 신뢰성, 윤리성, 그리고 명확한 목표를 갖고 설계되어야 합니다. 영업, 이커머스, 데이터 분석 등 어떤 분야든 웹 스크래핑은 새로운 인사이트의 문을 열어줍니다. 작게 시작해, 반복하며, 계속 배워나가세요.

더 깊이 배우고 싶다면 에서 다양한 가이드를 확인하거나, 으로 AI 기반 스크래핑을 직접 체험해보세요.

자주 묻는 질문: 처음 시작할 때 많이 나오는 5가지

1. 파이썬으로 웹 스크래핑을 가장 쉽게 시작하는 방법은?

Python 3을 설치한 뒤, Requests와 BeautifulSoup 라이브러리로 간단한 웹페이지부터 시도해보세요. 쉬운 사이트부터 시작해 점차 복잡한 사이트로 확장하면 됩니다.

2. 자바스크립트로 데이터가 로드되는 사이트는 어떻게 처리하나요?

Selenium이나 Playwright 같은 브라우저 자동화 도구를 사용하거나, 브라우저의 네트워크 탭에서 JSON 등 구조화된 데이터를 반환하는 API를 찾아 활용하세요.

3. 비즈니스에 적합한 데이터 내보내기 방식은?

CSV는 엑셀, 구글 시트 등 어디서나 열 수 있어 가장 범용적입니다. 엑셀, JSON, SQLite 등 다양한 포맷도 활용할 수 있고, Thunderbit은 Google Sheets, Notion, Airtable로 바로 내보내기도 지원합니다.

4. 스크래핑 시 차단을 피하려면 어떻게 해야 하나요?

User-Agent를 바꿔가며 사용하고, 대량 스크래핑 시 프록시를 활용하세요. 요청 속도를 조절하고, robots.txt를 꼭 확인하세요. 개인정보나 민감한 데이터는 수집하지 않는 것이 원칙입니다.

5. Thunderbit는 비개발자에게 어떻게 도움이 되나요?

Thunderbit은 AI가 데이터 필드를 추천하고, 서브페이지·페이지네이션도 자동 처리하며, 클릭 몇 번만으로 구조화된 데이터를 내보낼 수 있습니다. 코딩 없이도 빠르고 신뢰성 있게 웹 데이터를 수집할 수 있어 비즈니스 사용자에게 최적입니다.

데이터 수집을 자동화하고 싶으신가요? 을 무료로 체험해보고, AI가 이끄는 웹 스크래핑의 새로운 차원을 경험해보세요.

더 알아보기