비즈니스 현장에서는 "데이터는 21세기의 석유"라는 말이 익숙하죠. 그런데 아직도 웹사이트에서 복사하고 붙여넣기를 반복하고 있다면, 마치 숟가락으로 석유를 퍼내는 것과 다를 게 없습니다. 요즘처럼 데이터가 핵심인 시대에, 팀원들은 하루 평균 이나 정보를 찾는 데 쓰고, 사무직 직원들은 매주 작업을 반복한다고 하니, 지칠 만도 하죠.

그래서 파이썬으로 웹사이트를 스크래핑하는 방법을 익히면 영업, 운영, 리서치팀 모두에게 게임 체인저가 될 수 있습니다. 파이썬 웹 스크래퍼를 활용하면 몇 시간씩 걸리던 일이 몇 줄의 코드로 뚝딱 끝나죠. 저처럼 코딩이 귀찮은 분들은 같은 AI 기반 툴로 클릭 몇 번이면 충분합니다. 데이터 초보자든 전문가든, 파이썬 웹사이트 스크래핑의 필요성과 실전 방법, 그리고 Thunderbit로 더 쉽게 일하는 팁까지 함께 알아볼게요.

왜 파이썬으로 웹사이트를 스크래핑할까?

웹 스크래핑 분야에서 파이썬이 가장 많이 쓰이는 데는 다 이유가 있습니다. 단순히 인기 있는 언어라서가 아니라, 필요한 기능을 모두 갖춘 만능툴이기 때문이죠.

파이썬이 사랑받는 이유는 이렇습니다:

- 배우기 쉽고 사용이 편함: 파이썬은 문법이 직관적이라 처음 접하는 사람도 금방 익힐 수 있어요.

- 다양한 라이브러리: , , , 등, 정적 HTML 파싱부터 브라우저 자동화까지 상황에 맞게 쓸 수 있는 도구가 많아요.

- 활발한 커뮤니티와 문서: 막히는 부분이 생기면 Stack Overflow 등에서 이미 답을 찾을 수 있고, 공식 문서도 잘 정리되어 있어 참고하기 쉽습니다.

- 확장성: 파이썬은 다른 툴과도 잘 연동돼요. 같은 AI 플랫폼과 결합해 데이터 추출을 강화하거나, 추출한 데이터를 자동화·분석·머신러닝에 활용할 수 있죠.

JavaScript나 R 등 다른 언어와 비교해도 파이썬은 진입장벽이 낮고, 웹 스크래핑에 특화된 지원이 많아 실무에서 널리 쓰입니다. 한 업계 전문가의 말처럼, "파이썬은 웹 스크래핑계의 스위스 군용 칼"이죠.

기본 개념: 파이썬으로 웹사이트 스크래핑하는 흐름

파이썬으로 웹 스크래핑을 할 때의 기본 흐름은 이렇습니다. 한 페이지만 추출하든, 전체 사이트를 크롤링하든, 기본 단계는 비슷해요.

| 단계 | 진행 내용 | Python 라이브러리 예시 |

|---|---|---|

| 1. 웹 요청 보내기 | 대상 페이지의 HTML 가져오기 | requests.get() |

| 2. HTML 파싱 | 페이지 구조 분석 | BeautifulSoup() |

| 3. 데이터 추출 | 필요한 정보 추출 (예: 제목, 가격 등) | soup.find_all() |

| 4. 데이터 저장/내보내기 | 결과를 CSV, Excel, 데이터베이스로 저장 | csv, pandas, openpyxl |

겉보기엔 간단하지만, 실제로는 페이지네이션, 동적 콘텐츠, 자주 바뀌는 사이트 구조 등으로 인해 복잡해질 수 있습니다. 이런 부분을 Thunderbit 같은 도구가 "2번 클릭"과 AI 필드 자동 인식으로 쉽게 해결해줍니다.

웹 스크래핑에 꼭 필요한 파이썬 라이브러리

파이썬에는 다양한 스크래핑 라이브러리가 있습니다. 대표적인 것들을 소개할게요.

BeautifulSoup: 쉽고 빠른 HTML 파싱

은 초보자에게 가장 친숙한 라이브러리입니다. 정적 HTML을 간단하게 파싱하고 데이터를 추출할 수 있어요.

- 장점: 사용법이 쉽고, 소규모 프로젝트에 딱입니다.

- 단점: 여러 페이지 크롤링이나 JavaScript 기반 사이트에는 한계가 있어요.

- 활용 예시: 정적 이커머스 페이지에서 상품 목록 추출

Scrapy: 대규모 크롤링에 강력한 프레임워크

는 대규모 웹 크롤링에 특화된 프레임워크입니다. 여러 페이지를 따라가며 대량의 데이터를 효율적으로 수집할 수 있죠.

- 장점: 빠르고 확장성이 뛰어나며, 복잡한 워크플로우(페이지네이션, 하위 페이지 등) 지원

- 단점: 진입장벽이 다소 높고, 설정이 필요합니다.

- 활용 예시: 대형 쇼핑몰의 모든 카테고리와 상품 정보 수집

Selenium: 동적 콘텐츠와 상호작용 처리

은 JavaScript로 동작하거나 로그인, 버튼 클릭 등 사용자 상호작용이 필요한 사이트에 적합합니다.

- 장점: 브라우저를 자동화해 동적 콘텐츠도 추출 가능

- 단점: 속도가 느리고, 리소스 소모가 큽니다.

- 활용 예시: 로그인 후에만 볼 수 있는 대시보드 데이터 추출

Requests: 웹페이지 요청의 기본

는 HTTP 요청을 보내는 데 가장 널리 쓰이는 라이브러리입니다. BeautifulSoup과 함께 간단한 스크래핑에 자주 활용돼요.

- 장점: 사용법이 간단하고, 쿠키·세션 관리가 편리합니다.

- 단점: JavaScript 렌더링은 불가합니다.

- 활용 예시: HTML을 다운로드해 BeautifulSoup으로 파싱

Thunderbit와 파이썬을 함께 써서 워크플로우 가속화하기

저도 파이썬을 좋아하지만, 모든 스크래핑 작업을 직접 코딩하고 싶진 않아요. 이럴 때 가 정말 유용합니다. Thunderbit는 AI 기반 크롬 확장 프로그램으로, 누구나 손쉽게 웹 데이터를 추출할 수 있어요.

Thunderbit는 빠른 결과가 필요한 비즈니스 사용자를 위해 설계됐어요. AI 필드 추천, 하위 페이지 스크래핑, Excel/Google Sheets로 바로 내보내기 등 다양한 기능을 제공합니다. 파이썬 스크립트와 데이터 분석가의 역할을 한 번에 해내는 셈이죠.

Thunderbit 2번 클릭 스크래핑 vs. 파이썬 수동 코딩 비교

전통적인 파이썬 방식과 Thunderbit의 접근법을 비교해보면 다음과 같습니다.

| 작업 | Python 스크립트 방식 | Thunderbit AI 웹 스크래퍼 방식 |

|---|---|---|

| 환경 설정 | Python, pip, 라이브러리 설치 | 크롬 확장 프로그램 설치 |

| 페이지 구조 확인 | 브라우저 개발자 도구로 셀렉터 작성 | “AI 필드 추천” 클릭 |

| 추출 코드 작성 | Python 코드 작성 및 디버깅 | “스크래핑” 클릭 |

| 페이지네이션 처리 | 반복문 작성, URL 관리 | UI에서 “페이지네이션” 활성화 |

| 데이터 내보내기 | 코드로 CSV/Excel 저장 | “Sheets/Excel/Notion/Airtable로 내보내기” 클릭 |

| 유지보수 | 사이트 변경 시 코드 수정 | AI가 자동으로 적응 |

Thunderbit를 쓰면 거의 모든 웹사이트에서 클릭 두 번이면 데이터를 추출할 수 있습니다. 복잡한 작업이 필요하다면, 파이썬으로 Thunderbit 결과를 자동화·스케줄링·후처리할 수도 있어요.

Thunderbit와 파이썬 스크립트 연동하기

Thunderbit와 파이썬을 함께 쓰면 자동화가 훨씬 강력해집니다. 예를 들어 파이썬으로:

- Thunderbit를 정해진 시간마다 실행(예: 매일 가격 모니터링)

- pandas나 scikit-learn으로 내보낸 데이터 전처리 및 분석

- Thunderbit로 추출한 데이터와 다른 소스 결합해 심층 분석

이렇게 하면 Thunderbit의 빠르고 쉬운 추출력과 파이썬의 유연한 자동화·분석 기능을 모두 누릴 수 있습니다.

단계별 가이드: 파이썬으로 웹사이트 스크래핑하기

이제 직접 따라해볼 시간입니다. 파이썬으로 웹사이트를 스크래핑하는 초보자용 예시를 소개할게요.

1단계: 파이썬 환경 준비

먼저 파이썬이 설치되어 있는지 확인하세요. 나 로 환경을 관리하는 걸 추천합니다.

1# pip 설치 (필요시)

2python -m ensurepip --upgrade

3# 가상환경 생성 (권장)

4python -m venv myenv

5source myenv/bin/activate # Windows: myenv\Scripts\activate

6# 필요한 라이브러리 설치

7pip install requests beautifulsoup4 pandas2단계: 웹페이지 내용 가져오기

Requests 라이브러리로 대상 페이지의 HTML을 다운로드합니다.

1import requests

2url = 'https://example.com/products'

3response = requests.get(url)

4if response.status_code == 200:

5 html = response.text

6else:

7 print("페이지를 불러오지 못했습니다:", response.status_code)문제 해결: 403 또는 404 오류가 뜨면, 사이트가 봇을 막거나 헤더/쿠키가 필요한지 확인하세요.

3단계: HTML 파싱 및 데이터 추출

BeautifulSoup으로 HTML을 파싱하고 원하는 데이터를 뽑아냅니다.

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html, 'html.parser')

3products = soup.find_all('div', class_='product-item')

4data = []

5for product in products:

6 name = product.find('h2').get_text(strip=True)

7 price = product.find('span', class_='price').get_text(strip=True)

8 data.append({'name': name, 'price': price})팁: 브라우저의 “요소 검사” 기능으로 적절한 태그와 클래스를 찾으세요.

4단계: 데이터 저장 및 내보내기

결과를 CSV 파일로 저장해 공유하거나 분석에 활용하세요.

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv('products.csv', index=False)Thunderbit를 사용한다면, “Google Sheets로 내보내기”나 “CSV로 다운로드” 버튼만 누르면 끝입니다.

한 단계 더: 파이썬 & Thunderbit로 자동화 및 확장하기

기본기를 익혔다면, 이제 스크래핑 작업을 자동화·확장할 수 있습니다.

- 페이지네이션 처리: 파이썬에서는 반복문으로 페이지를 순회, Thunderbit에서는 페이지네이션 기능을 켜면 AI가 자동 처리

- 하위 페이지 추출: 파이썬으로 링크를 따라가거나, Thunderbit의 하위 페이지 스크래핑으로 데이터 자동 확장

- 정기 스케줄링: 파이썬의

schedule라이브러리나 Thunderbit의 내장 스케줄러로 주기적 실행(예: 매일 가격 모니터링) - 데이터 소스 통합: 여러 사이트에서 추출한 데이터를 합쳐 심층 분석(경쟁사 추적, 시장 조사 등)

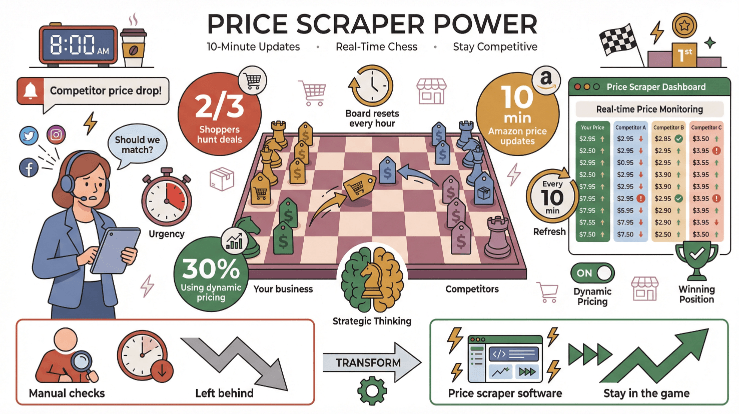

실제 사례: 한 이커머스팀은 Thunderbit로 10개 사이트의 경쟁사 가격을 매일 모니터링하고, 데이터를 Google Sheets로 내보내 실시간 분석했습니다. 그 결과, 과 야근 없는 업무 환경을 만들었어요.

데이터 윤리와 프라이버시: 파이썬으로 책임 있게 스크래핑하기

강력한 스크래핑 능력에는 책임이 따릅니다. 다음을 꼭 지켜주세요.

- robots.txt와 이용약관 준수: 사이트가 스크래핑을 허용하는지 확인하고, 불확실하면 문의하세요.

- 요청 제한: 서버에 과부하를 주지 않도록 요청 속도를 조절하세요.

- 개인정보 수집 금지: 동의 없이 민감한 정보는 수집하지 마세요. GDPR 등 데이터 보호법을 꼭 지켜야 합니다.

- 스크래퍼 식별: user-agent를 명확히 설정하고, 목적을 투명하게 밝히세요.

- 삭제 요청 준수: 데이터셋에서 삭제 요청이 오면 신속히 반영하세요.

Thunderbit는 속도 제한, 로그인 기반 스크래핑 지원, 데이터 정제 기능 등 책임 있는 데이터 수집을 돕는 기능을 제공합니다. 자세한 내용은 도 참고하세요.

데이터에서 인사이트로: 분석과 머신러닝에 활용하기

스크래핑한 데이터는 시작일 뿐입니다. 파이썬과 Thunderbit로 이렇게 활용할 수 있어요.

- 데이터 정제 및 포맷: pandas로 중복 제거, 오타 수정, 포맷 통일 등 데이터 클린업

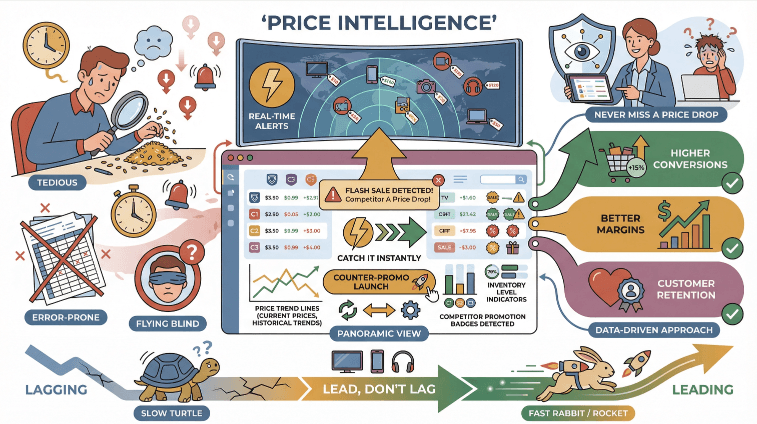

- 트렌드 분석: 경쟁사 가격 추적, 리뷰 감정 분석, 시장 변화 포착 등

- 머신러닝 모델 구축: scikit-learn으로 감정 분석, 가격 예측, 고객 세분화 등 모델 학습

- 리포트 자동화: 실시간 웹 데이터 기반 대시보드·알림 생성

예시: 한 제품팀은 수천 개의 고객 리뷰를 스크래핑해 파이썬으로 정제하고, Thunderbit의 AI로 감정 태깅을 진행했습니다. 그 결과, 제품 개선과 마케팅 전략에 바로 적용할 수 있는 인사이트를 얻었어요.

결론 및 핵심 요약

정리하자면,

- 파이썬은 웹 스크래핑에 최적화된 언어로, 배우기 쉽고 강력한 라이브러리와 커뮤니티를 갖추고 있습니다.

- Thunderbit는 누구나 쉽게 웹 스크래핑할 수 있도록 AI 기반의 무코드 도구를 제공합니다.

- 파이썬과 Thunderbit를 결합하면 고급 자동화가 가능하며, 업무 프로세스와 연동해 데이터 활용도를 극대화할 수 있습니다.

- 항상 책임 있게 스크래핑하세요: 사이트 정책, 개인정보 보호법, 윤리 기준을 꼭 지켜야 합니다.

- 데이터를 비즈니스 자산으로: 추출한 데이터를 분석, 리포트, 머신러닝 등에 적극적으로 활용하세요.

이제 데이터 역량을 한 단계 높이고 싶으신가요? 파이썬으로 웹사이트를 직접 스크래핑해보거나, 코딩이 부담스럽다면 을 사용해보세요. 더 많은 팁과 튜토리얼은 에서 확인할 수 있습니다.

자주 묻는 질문(FAQ)

1. 파이썬으로 웹 스크래핑하는 게 합법인가요?

웹사이트의 이용약관, robots.txt, 데이터 보호법을 준수하면 합법적으로 스크래핑할 수 있습니다. 동의 없이 개인정보나 민감한 정보를 수집하지 마세요.

2. 코딩을 몰라도 웹사이트 데이터를 쉽게 추출할 수 있나요?

는 코딩 없이 클릭 두 번만으로 웹사이트 데이터를 추출할 수 있는 AI 기반 크롬 확장 프로그램을 제공합니다.

3. 동적 웹사이트에는 어떤 파이썬 라이브러리를 써야 하나요?

JavaScript 렌더링이나 사용자 상호작용이 필요한 사이트는 을, 정적 페이지는 과 로 충분합니다.

4. 웹 스크래핑 작업을 자동화하려면 어떻게 해야 하나요?

파이썬에서는 cron이나 schedule 라이브러리로, Thunderbit에서는 내장 스케줄러로 반복 작업을 자동화할 수 있습니다.

5. 웹사이트 구조가 바뀌면 어떻게 해야 하나요?

파이썬 스크립트는 사이트 구조가 바뀌면 수정이 필요합니다. Thunderbit는 AI가 자동으로 적응해 유지보수 부담을 줄여줍니다.

즐거운 스크래핑 하세요! 항상 깔끔하고 구조화된 데이터로 업무에 힘을 더해보세요.

더 알아보기