正直に言うと、最初に大きなサイトからすべてのURLを抜き出そうとしたとき、私は「どれだけ大変なんだろう?」と思っていました。ところが数時間後も、延々とページをクリックし続け、リンクをスプレッドシートにコピペし続け、しまいには自分の人生の選択まで疑い始めていたのです。もしあなたも、コンテンツ監査、リードリスト作成、競合調査のためにウェブサイト内のすべてのページを見つける作業をしたことがあるなら、その苦労はよく分かるはずです。面倒で、ミスが起きやすく、率直に言って、あなたの時間と才能を無駄にしてしまいます。

でも、いいニュースがあります。もう、そんな大変なやり方を続ける必要はありません。 のようなAI搭載ツールが、ビジネスユーザー向けの常識を変えつつあり、ドメイン内のすべてのURLを見つける作業を、数日ではなく数分で実現できるようにしています。実際、AI駆動のウェブスクレイピングツールを使う企業は、データ収集業務でを報告しており、手作業と比べてを実現しているケースもあります。これは単なる数字ではありません。あなたの時間を、何時間、何日も取り戻せるということです。

そこで今回は、ウェブサイト内のすべてのページを見つけるのがなぜ難しいのか、GPT や Claude のような汎用AIモデルではなぜ本当に役に立たないのか、そして Thunderbit のような特化型AIエージェントがどうやってこの作業を驚くほど簡単にするのかを掘り下げます。しかも、コーディングができなくても、必要なすべてのURLを抜き出す具体的な手順までご案内します。

ドメイン内のすべてのURLを見つけるのが難しい理由

現実として、ウェブサイトは自分の中にあるすべてのページを、きれいな一覧で渡してくれるようには設計されていません。訪問者向けには作られていますが、ウェブサイト内のすべてのページを一気に見つけたい人向けではないのです。では、なぜこんなに厄介なのでしょうか。

- 手作業のコピペ地獄: すべてのメニュー、一覧、ディレクトリをクリックして、URLを1つずつコピーするのは、腱鞘炎まっしぐらですし、ページの半分を見落とす原因にもなります。

- ページネーションと無限スクロール: 多くのサイトは内容を複数ページに分けたり、スクロールに応じて追加読み込みしたりします。「次へ」を見逃したり、十分に下までスクロールしなかったりすると、セクションごと丸ごと抜け落ちます。

- ページ構造の不統一: あるページはリンクを1つの形式で並べ、別のページはまったく違うレイアウトを使っています。これを追いかけるのは悪夢です。

- 隠れページや孤立ページ: すべてのページがメインナビゲーションからリンクされているわけではありません。サイトマップやサイト内検索でしかたどれない、奥深くに埋もれたページもあります。

- 人為的ミス: コピーするページ数が増えるほど、重複URLやタイポ、単純な取りこぼしが起きやすくなります。

しかも、数百、数千ページあるサイトが相手なら、もう手作業は論外です。あるデータチームが言うように、些細なケースを超えたらのです。

「ウェブサイト内のすべてのページを見つける」とは何を意味するのか?

解決策に入る前に、まず何を目指しているのかをはっきりさせましょう。

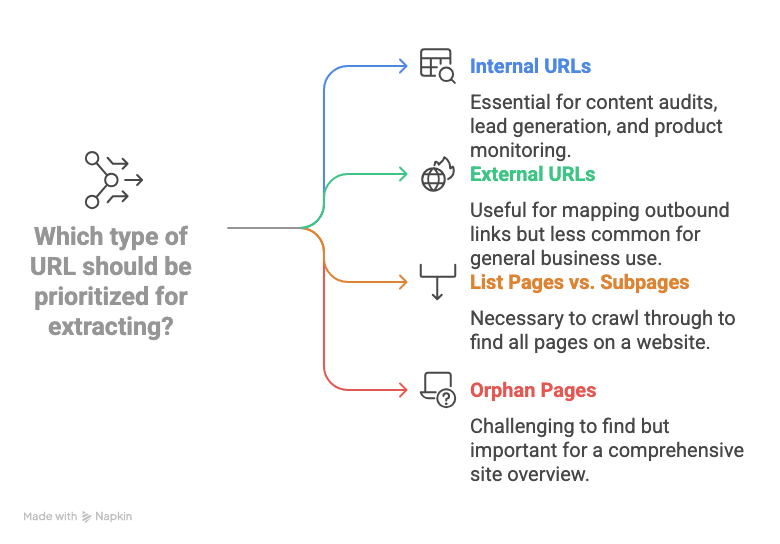

- 内部URL: 同じドメイン内のページを指すリンクです(/about-us や /products/widget-123 など)。コンテンツ監査、リード獲得、製品監視といった多くのビジネス用途では、内部URLが主な対象です。

- 外部URL: 他のウェブサイトに向かうリンクです。通常、外部リンクの一覧化をしたい場合を除き、必要ありません。

- 一覧ページと下層ページ: 多くのサイトには、カテゴリページ、ブログアーカイブ、ディレクトリのような「ハブ」または「一覧」ページがあり、そこから商品ページやプロフィールページなどの詳細ページへリンクしています。真にウェブサイト内のすべてのページを見つけるには、こうした一覧をたどって、そこからリンクされている各下層ページを拾っていく必要があります。

- 孤立ページ: どこからも明確にはリンクされていないページです。サイトマップや内部検索で見つかることもありますが、見落としやすいページです。

つまり、ドメイン内のすべてのURLを見つけるというのは、ホームページから最深部の記事や商品ページまで、すべての内部ページURLを、できればスプレッドシートのような使いやすい形式で集めることを意味します。

ドメイン内のすべてのURLを見つける従来の方法

昔ながらの方法はいくつかありますが、それぞれに独自の悩みがあります。

手作業のコピペとブラウザツール

これは「力技」のやり方です。すべてのリンクをクリックし、すべてのURLをコピーして、スプレッドシートに貼り付け、何も見落としていないことを祈るだけです。ブラウザ拡張機能で現在のページのリンクをまとめて取得する人もいますが、それでもページごとに繰り返す必要がありますし、ページネーションや隠れセクションの対応は自分でやるしかありません。5ページ程度のサイトならまだしも、それ以上では厳しいでしょう。

サイト内検索とサイトマップを使う

- Google の site: 検索: Google に

site:yourdomain.comと入力すると、インデックス済みのページがいくつか表示されます。ただし Google が表示するのはインデックス済みのものだけで、通常は約1,000件程度で頭打ちになります。そのため、新しいページ、隠れページ、質の低いページは漏れてしまいます。でも、これは完全な解決策ではないと認めています。 - XML サイトマップ: 多くのサイトには /sitemap.xml があり、重要なURLが一覧化されています。サイトマップが最新で、すべてのページを含んでいれば便利です。ただし、そもそもサイトマップがないサイトもありますし、複数ファイルに分かれていることもあります。孤立ページは含まれないことが多いです。

技術的なクローラーとスクリプト

- SEOツール(Screaming Frog など): 検索エンジンのようにサイトを巡回してURL一覧を出してくれます。強力ですが、設定や構成が必要で、大規模サイトでは有料ライセンスが必要になることもあります。

- Python スクリプト(Scrapy など): 開発者なら、URLを巡回・抽出するスクリプトを書けます。でも正直、コードに慣れていないなら、ここで脱落です。さらに、サイトのレイアウトが変わるとスクリプトは壊れるので、ずっと追いかけ続けることになります。

要するに: 従来の方法は、手作業すぎるか、網羅性が足りないか、技術的すぎるかのどれかで、多くのビジネスユーザーには向いていません。途中であきらめる人が多いのも、そのためです。

なぜ汎用AIモデルではURL抽出を完全自動化できないのか

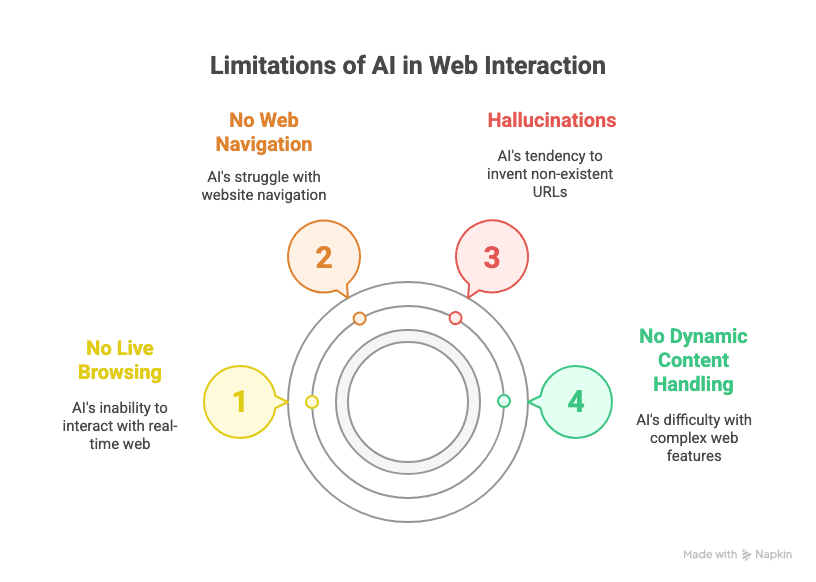

「ChatGPT や Claude にウェブサイト内のすべてのページを探してもらえばいいのでは?」と思うかもしれません。私もそうだったら良かったのですが、現実は違います。

- ライブで閲覧できない: GPT や Claude のような汎用AIモデルは、実際にリアルタイムでウェブを巡回できません。ウェブサイトの今の状態を「見る」わけではなく、学習データか、あなたが貼り付けた情報に基づいて動いているだけです。

- ウェブ操作ができない: プラグインやブラウズ機能があっても、LLM は「次へ」をクリックしたり、無限スクロールを扱ったり、サイト内のすべてのリンクを体系的にたどったりすることはできません。

- ハルシネーション: 汎用AIにドメイン内のすべてのURLを聞くと、実在しないのにもっともらしいリンクを作り出すことがよくあります。(/about-us ページが存在しないサイトに、それを勝手に作るのを何度も見ました。)

- 動的コンテンツに弱い: JavaScript で内容を読み込むサイト、ログインが必要なサイト、複雑なナビゲーションを使うサイトは、汎用LLMの手に負えません。

にある通りです。「数百、数千ページをスクレイピングしたいなら… ChatGPT だけでは不十分です。」この作業専用に作られたツールが必要なのです。

垂直型AIエージェントが未来である理由

ここで、SaaS と自動化の世界での私の経験が活きてきます。垂直型AIエージェント、つまりウェブデータ抽出のような特定分野向けに作られたAIツールだけが、ビジネスタスクで信頼性が高く、スケーラブルな結果を出せるのです。なぜでしょうか。

- 汎用LLMは、文章作成や検索には優秀ですが、ハルシネーションを起こしやすく、企業が求める安定性で、複数ステップの再現可能なワークフローを処理できません。

- エンタープライズ向けSaaSツールは、繰り返し発生する構造化タスクを大量に自動化する必要があります。 そこで力を発揮するのが垂直型AIエージェントです。1つのことを高精度でやり切るよう設計されているからです。

- 業界をまたいだ例はたくさんあります。 ウェブデータ抽出の Thunderbit、ソフトウェア開発の Devin AI、営業自動化の Alta、教育向けの Infinity Learn の IL VISTA、HR の Rippling、法務の Harvey……挙げればきりがありません。

要するに、ウェブサイト内のすべてのページを確実に見つけたいなら、汎用チャットボットではなく、そのために作られた垂直型AIエージェントが必要です。

Thunderbit の紹介:誰でも使えるAI搭載URL抽出

そこで登場するのが です。AIウェブスクレイパーの Chrome 拡張機能として、Thunderbit はビジネスユーザー向けに設計されています。コーディング不要、技術的な設定も不要、ただ結果が得られるだけです。何が違うのでしょうか。

- 自然言語インターフェース: 「このサイトのページURLをすべて一覧にして」のように、やりたいことを伝えるだけで、Thunderbit のAIが抽出方法を判断します。

- AIによる項目提案: Thunderbit がページを解析し、「ページURL」のような列名を自動で提案します。CSSセレクタやXPathをいじる必要はありません。

- ページネーションと無限スクロールに対応: Thunderbit は「次へ」をクリックしたり、自動で下までスクロールしたりできるので、ページの取りこぼしがありません。

- 下層ページへの移動: さらに深く掘りたい場合も、Thunderbit はリンク先の下層ページをたどり、そこからデータを取得できます。

- 構造化エクスポート: 結果を Google Sheets、Excel、Notion、Airtable、CSV に直接、ワンクリックで無料エクスポートできます。

- コーディング不要: ウェブサイトを閲覧できるなら、Thunderbit は使えます。それだけです。

しかも Thunderbit は垂直型AIエージェントなので、安定性と再現性を重視して作られています。何度も同じ作業を自動化したいビジネスユーザーにぴったりです。

ステップごとに解説: Thunderbit でドメイン内のすべてのURLを見つける方法

実際の動きを見てみましょう。ここでは、必要なすべてのURLを抜き出すための、非技術者向けの手順を説明します。

1. Thunderbit の Chrome 拡張機能をインストールする

まず最初に、 してください。Chrome、Edge、Brave、その他 Chromium ベースのブラウザで動作します。すぐ使えるように、ツールバーにピン留めしておくと便利です。

2. 対象の一覧ページまたはディレクトリページを開く

URLを抽出したいウェブサイトに移動します。ホームページ、サイトマップ、ディレクトリ、あるいは目的のページにつながる一覧ページなら何でも構いません。

3. Thunderbit を起動して項目を設定する

Thunderbit のアイコンをクリックして拡張機能を開きます。新しいスクレイパーテンプレートを開始しましょう。ここで魔法が起こります。

- 「AI Suggest Fields」をクリックします。Thunderbit のAIがページを解析し、列を提案します。「Page URL」「Link」などの項目を探してください。

- ほしい項目がぴったり出てこなくても、単に「Page URL」という列を追加すれば大丈夫です(ほかにしっくりくる名前でも構いません)。Thunderbit のAIはこうした用語を認識するよう訓練されており、適切なデータに対応付けてくれます。

4. 必要に応じてページネーションまたはスクロールを有効にする

対象ページに複数ページ(「1、2、3…」や「もっと見る」ボタンなど)がある場合は、Thunderbit でページネーションを有効にします。

- 「次へ」ボタンがあるサイトでは 「Click Pagination」 モードに、スクロールで追加読み込みされるサイトでは 「Infinite Scroll」 に切り替えます。

- Thunderbit が「次へ」ボタンまたはスクロール領域の選択を促すので、それをクリックするだけで、あとはAIが処理してくれます。

5. スクレイピングを開始して結果を確認する

「Scrape」 ボタンを押します。Thunderbit がすべてのページを巡回し、見つけたURLをすべて収集します。結果は拡張機能内の表にその場で表示されます。大規模サイトでは数分かかることもありますが、手作業よりは圧倒的に速いです。

6. URL一覧をエクスポートする

スクレイピングが終わったら、Export をクリックします。データは次の場所へ直接送れます。

- Google Sheets

- Excel/CSV

- Notion

- Airtable

エクスポートは無料で、書式もそのまま維持されます。もうコピペに悩まされることはありません。

Thunderbit と他のURL抽出ソリューションを比較する

| 方法 | 使いやすさ | 精度と網羅性 | 拡張性 | 出力オプション |

|---|---|---|---|---|

| 手作業のコピペ | つらい | 低い(見落としやすい) | なし | 手動(Excel など) |

| ブラウザのリンク抽出ツール | 1ページなら可 | 中程度 | 低い | 手動 |

Google site: 検索 | 簡単 | 中程度(完全ではない) | 約1,000件で上限 | 手動 |

| XML サイトマップ | 簡単(あれば) | 良い(最新なら) | 良い | 手動/スクリプト |

| SEOツール(Screaming Frog など) | 技術的 | 高い | 高い(有料) | CSV、Excel |

| Python スクリプト(Scrapy など) | 非常に技術的 | 高い | 高い | カスタム |

| Thunderbit | とても簡単 | 非常に高い | 高い | Google Sheets、CSV など |

Thunderbit は、プロ用クローラー並みの精度と拡張性を、ブラウザ拡張機能の手軽さで提供します。コードも設定も不要、ただ結果を得られるだけです。

おまけ: Thunderbit でURL以外も抽出する

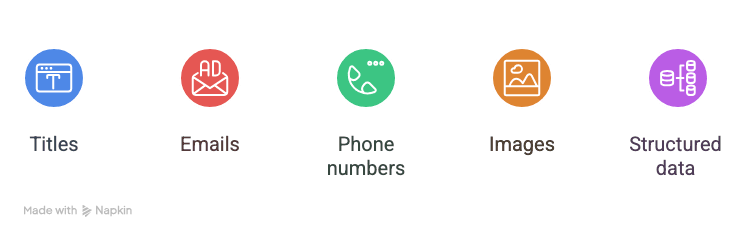

ここからが面白いところです。Thunderbit はURLだけのツールではありません。次のようなものも抽出できます。

- タイトル

- メールアドレス

- 電話番号

- 画像

- ページ上の構造化データ全般

たとえば、リードリストを作成しているなら、ディレクトリの各エントリからプロフィールURL、名前、メールアドレス、電話番号を、1回の処理でまとめて取得できます。製品監査なら、商品URL、商品名、価格、在庫状況を一気に抽出できます。Thunderbit はにも対応しているので、各リンク先をクリックして詳細情報を抜き出すことも可能です。

しかも、Thunderbit のメールアドレス抽出機能と電話番号抽出機能は完全無料です。営業やマーケティングのチームにとっては、かなり大きなメリットです。

重要ポイント: AIでウェブサイト内のすべてのページを見つけるには

要点を振り返りましょう。

- ドメイン内のすべてのURLを抽出するのは、手作業ツールや汎用ツールでは難しいです。

- GPT のような汎用AIモデルは、ウェブ操作、ページネーション、動的コンテンツの処理ができません。

- Thunderbit のような垂直型AIエージェントは、ウェブデータ抽出のために特化設計されており、安定的で再現性があり、ビジネスユーザーにも使いやすいです。

- Thunderbit なら簡単です。 拡張機能を入れて、AI に項目を提案させ、ページネーションを有効にし、スクレイピングして、エクスポートするだけ。コードも面倒もありません。

- URL以外も抽出できます。 タイトル、メールアドレス、電話番号など、リード獲得、監査、調査に最適です。

リンクのコピペにうんざりしていたり、技術的なクローラーに振り回されていたりするなら、。無料プランがあるので、どれだけ時間と気力を節約できるか、実際に確かめられます。

また、、、 など、Thunderbit の他の活用法に興味があるなら、詳しいガイドやヒントが載っている もぜひご覧ください。

手作業のデータ収集から時間を取り戻す準備はできましたか? ウェブデータ抽出の未来は垂直型AIエージェントです。そして Thunderbit がその先頭を走っています。ぜひ試して、次の監査、リードリスト、リサーチを、これまでで最も簡単なものにしてください。

さらに読む

追伸:1,000件のURLを手でコピペしたくなったら、こう思い出してください。今はそれ用のAIがあります。あなたの手首も、上司も、きっと感謝してくれます。