Imagine un peu la scène : il est tard, tu bois un café, et tu as besoin tout de suite des derniers prix de tes concurrents, de nouveaux leads ou des tendances qui cartonnent. Mais tes « datas » datent déjà de la semaine dernière, et quand tu mets enfin la main sur ce qu’il te faut, le marché a déjà bougé. Je suis passé par là, et franchement, c’est frustrant. Dans le business aujourd’hui, attendre des infos dépassées ou stockées en cache, c’est comme arriver à une vente privée quand tout est déjà parti. C’est pour ça que le crawler en direct—choper des données en temps réel, à la seconde près—c’est plus juste un bonus, c’est carrément la clé pour garder une longueur d’avance.

Après des années à bidouiller des outils SaaS et d’automatisation (et à carburer au café), j’ai vu à quel point un crawler en direct peut changer la donne pour une équipe. Avec , on a voulu rendre le crawler en direct tellement simple que n’importe qui—même sans être geek—peut récupérer les données web les plus fraîches en quelques clics. Dans ce guide, je t’explique ce qu’est vraiment un crawler en direct, pourquoi c’est devenu indispensable, et comment tu peux t’y mettre dès aujourd’hui, sans écrire une seule ligne de code.

C’est quoi un Crawler en Direct ? La data en mode instantané

On part de la base : c’est quoi un « crawler en direct » ? Pour faire simple, c’est un outil qui va chercher les infos directement sur un site web, en live, à chaque fois que tu lances la recherche. Imagine que tu mates un live à la télé, pas un replay. Les extracteurs web classiques bossent souvent avec des téléchargements programmés ou des copies en cache—donc tu as toujours un train de retard. Les crawlers en direct, eux, débarquent sur la page à l’instant T, voient ce qu’il y a, et ramènent les infos toutes fraîches.

Certains appellent ça « live crawler escort » ou « live escort crawler » (avoue, ça fait un peu agent secret pour tes tableurs !). Ce qu’il faut retenir, c’est que ces crawlers ne se contentent jamais de vieilles données. Grâce à l’automatisation du navigateur ou au cloud browsing, ils extraient le contenu comme si c’était un humain devant l’écran—même les trucs dynamiques genre JavaScript, scroll infini ou pop-ups. Que tu surveilles une promo, un post viral ou un nouveau contact, tu bosses toujours avec l’info la plus fraîche ().

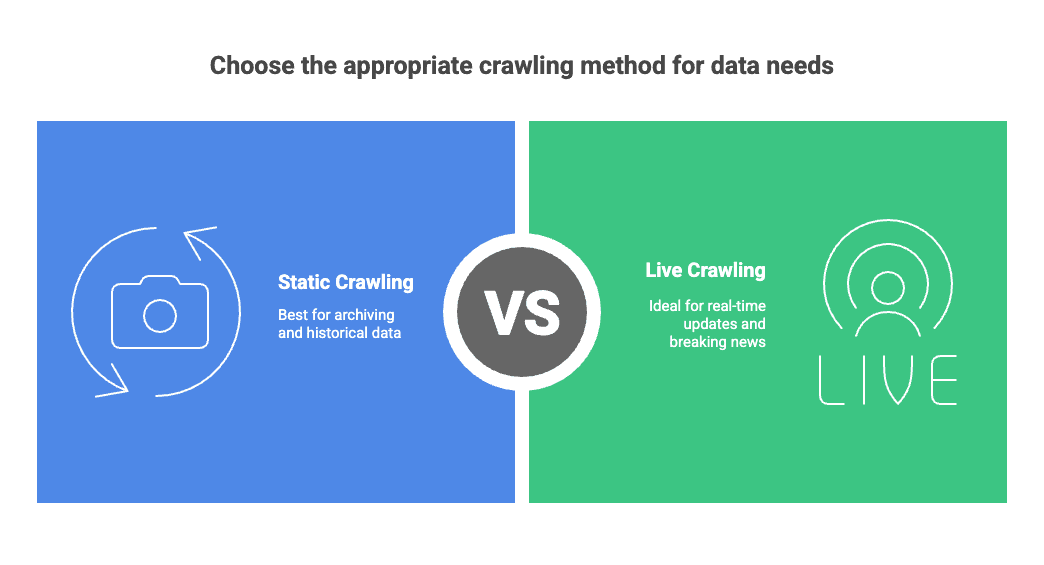

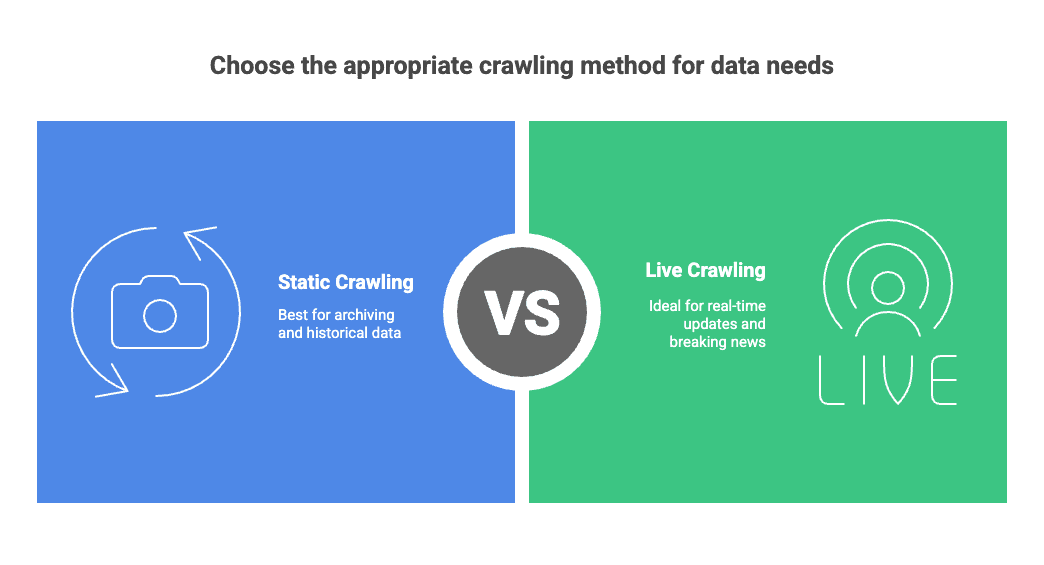

Crawling en direct vs. statique :

- Crawling statique : C’est comme prendre une photo du site chaque jour—pratique pour l’archivage, mais pas pour l’actu chaude.

- Crawling en direct : C’est comme regarder un live vidéo—ce que tu vois, c’est ce qui se passe maintenant.

Cette différence, elle est énorme pour tous ceux qui ont besoin d’infos à la minute. Dans des marchés qui bougent vite, quelques heures de retard peuvent te faire rater des opportunités ou te planter dans tes décisions ().

Pourquoi le Crawler en Direct est un vrai plus pour ton business ? Exemples concrets & avantages

Passons au concret. Pourquoi le crawler en direct, c’est devenu l’arme secrète des équipes ventes, marketing, opérations, et compagnie ? Simple : les données en temps réel, ça permet de prendre de meilleures décisions. D’après le , les boîtes qui bossent « en temps réel » font en moyenne 50 % de croissance et de marge en plus que celles qui traînent.

| Cas d’usage | Équipes/Fonction | Bénéfices/Exemples de données collectées |

|---|---|---|

| Surveillance des prix concurrents | Ventes/E-commerce | Suivi en temps réel des prix et promos pour ajuster sa stratégie (promptcloud.com Pricing) |

| Extraction de leads/contacts | Ventes/Marketing | Récupération de contacts frais (nom, email, téléphone) depuis des annuaires ou LinkedIn (Thunderbit Blog) |

| Analyse des réseaux sociaux & tendances | Marketing/Produit | Suivi des hashtags, sujets tendance et du ressenti en temps réel (promptcloud.com Pricing) |

| Mise à jour de catalogues produits | E-commerce/Opérations | Actualisation des fiches (prix, descriptions, stock) (datadwip.com Pricing) |

| Données pour pipeline commercial | Ventes | Création automatique de listes de prospects à partir d’annuaires (Thunderbit Blog) |

| Annonces immobilières | Immobilier | Agrégation des nouvelles annonces et des mises à jour de prix dès leur publication (promptcloud.com Pricing) |

Et surtout : plus tes données sont fraîches et fiables, plus tes décisions sont pertinentes. Les équipes évitent les coups de poker, repèrent les tendances dès qu’elles émergent, et agissent avant que la concurrence ne bouge. Bref, le crawler en direct transforme la data brute en intelligence exploitable—tout de suite ().

Thunderbit : Le crawler en direct le plus accessible

Tu te dis sûrement : « Ok, mais je ne suis pas dev. Je fais comment ? » C’est justement ce qu’on a voulu simplifier avec .

Thunderbit, c’est une extension Chrome boostée à l’IA qui rend le crawler en direct aussi simple que commander un plat (et parfois même plus rapide !). Ce qui change tout :

- Aucune compétence technique : Installe l’extension, ouvre le site que tu veux, et laisse l’IA de Thunderbit bosser.

- Suggestion automatique des champs : Un clic, et Thunderbit scanne la page pour te proposer les meilleures colonnes (« Nom », « Prix », « Email »…) ().

- Crawling des sous-pages : Besoin d’infos cachées derrière des liens ? Thunderbit visite chaque sous-page (fiche produit, profil contact…) et rassemble tout dans un seul tableau.

- Modèles instantanés : Pour les sites connus (Amazon, Zillow, LinkedIn…), tu as des modèles prêts à l’emploi—zéro prise de tête.

- Support multilingue : Thunderbit gère 34 langues, parfait pour les équipes internationales ().

- Export gratuit des données : Tu peux exporter vers Excel, Google Sheets, Airtable, Notion, CSV ou JSON—sans frais cachés ().

Le top ? Même sans expérience, tu peux te lancer en quelques minutes. Comme le dit un utilisateur : « Deux clics, et j’ai mes données. La précision est dingue » ().

Comparatif : Thunderbit vs. les outils classiques de crawling en direct

Soyons clairs : il existe d’autres façons de faire du crawling en direct. Tu pourrais ressortir tes skills Python et coder un crawler avec Selenium ou Beautiful Soup. Mais à moins d’aimer déboguer du code à 2h du mat, il y a plus simple.

| Aspect | Outils traditionnels (Python/Selenium) | Thunderbit AI Crawler |

|---|---|---|

| Installation & compétences | Faut coder, config complexe | Aucun code—juste installer et utiliser (Thunderbit Blog) |

| Temps de mise en place | Plusieurs heures à jours | Quelques minutes |

| Fraîcheur des données | Données figées, parfois dépassées | Données en direct, à la seconde près (dataprocorp.tech Pricing) |

| Contenu dynamique | Galère (faut du code en plus) | Géré nativement, supporte JS et scroll (Thunderbit Blog) |

| Adaptabilité | Ça casse si le site change | L’IA s’adapte toute seule (dataprocorp.tech Pricing) |

| Maintenance | Élevée (corrections fréquentes) | Faible (l’IA gère la plupart des changements) (dataprocorp.tech Pricing) |

| Format de sortie | HTML brut, nettoyage à la main | Tableaux propres, prêts à l’export (Thunderbit Blog) |

| Intégrations | Faut coder | Export direct vers Sheets, Airtable, Notion, CSV, JSON (Thunderbit Blog) |

À moins que tu veuilles faire du scripting ton nouveau hobby, Thunderbit est la solution rêvée pour ceux qui veulent des résultats rapides et fiables.

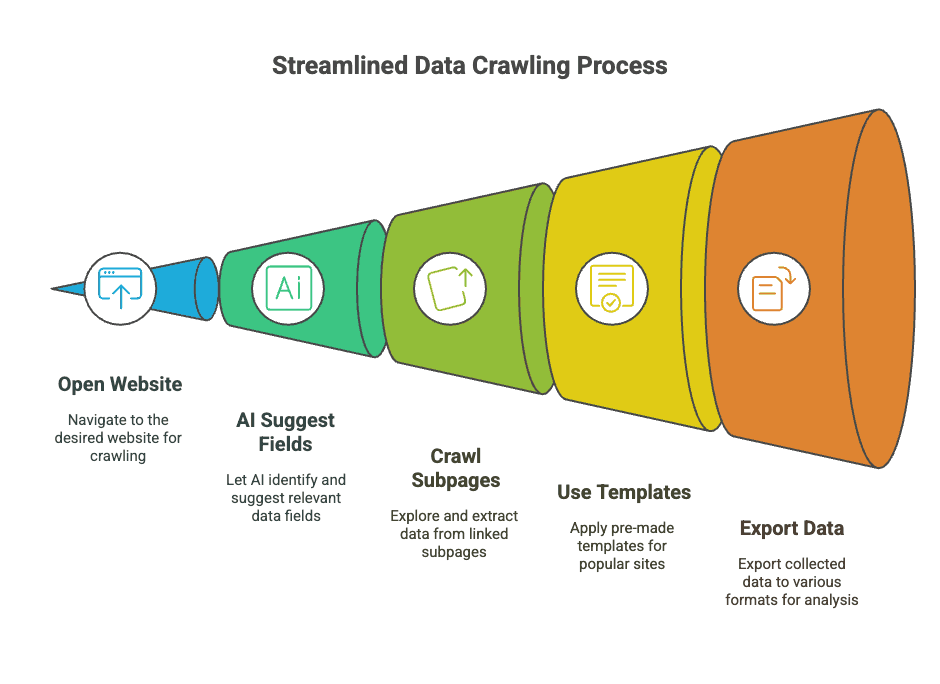

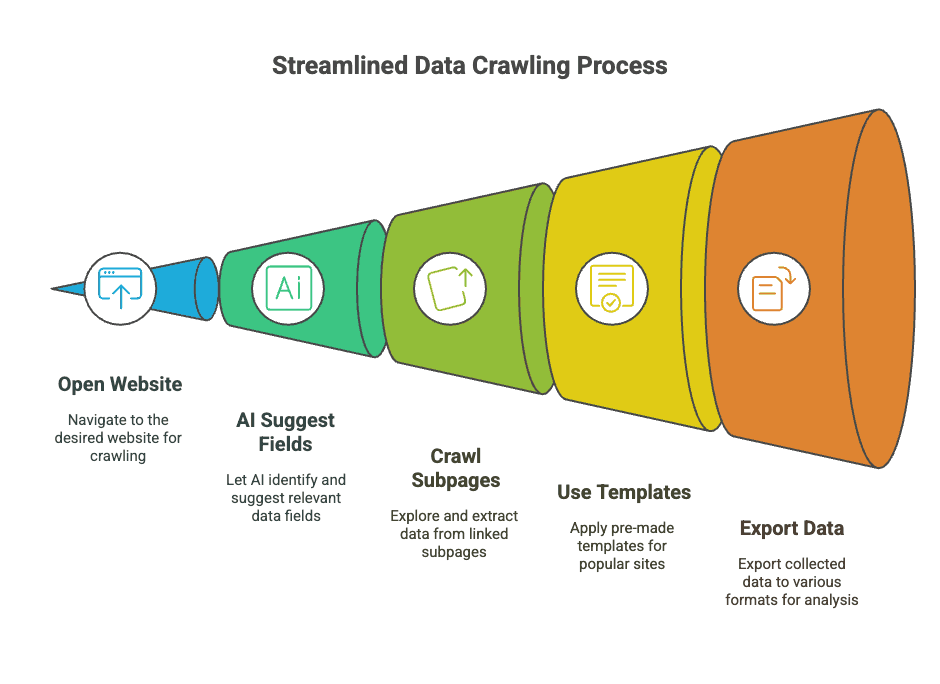

Mode d’emploi : Utiliser Thunderbit comme crawler en direct

Tu veux voir le crawler en direct en action ? Voilà comment utiliser Thunderbit pour extraire des données en temps réel de n’importe quel site—sans prise de tête ni jargon technique.

Étape 1 : Installe Thunderbit et ouvre le site à crawler

Commence par ajouter l’ à ton navigateur. Ça prend une minute (sauf si ton Wi-Fi rame !).

Une fois installée, ouvre le site que tu veux crawler. Thunderbit marche sur tout ce que tu peux voir dans ton navigateur—si tu y as accès, Thunderbit aussi.

Étape 2 : Utilise la suggestion IA pour cartographier les données en un éclair

C’est là que la magie (ou plutôt l’IA) opère. Clique sur le bouton AI Suggest Fields dans Thunderbit. L’IA scanne la page et te propose les colonnes à extraire—« Nom », « Prix », « Stock », « Email », etc. ().

Tu peux ajuster ces champs, les renommer ou en ajouter d’autres. Tu veux aller plus loin ? Ajoute des instructions personnalisées pour chaque champ—genre « formater les numéros de téléphone en E.164 » ou « classer les produits par catégorie ».

Étape 3 : Lance le crawling en direct en un clic

Une fois tes champs définis, clique sur Scraper. Thunderbit commence à parcourir la page en temps réel, en suivant la pagination ou le scroll infini si besoin. Si tu as activé le crawling des sous-pages, il cliquera sur chaque lien (fiche produit, profil…) et ajoutera ces infos à ton tableau ().

Tu verras les lignes se remplir en direct—un peu comme du pop-corn qui éclate, mais bien plus utile !

Étape 4 : Exporte tes données fraîches vers Excel, Google Sheets ou Notion

Une fois le crawling terminé, il ne te reste plus qu’à exploiter tes données. Thunderbit te permet d’exporter gratuitement vers Excel, Google Sheets, Airtable, Notion, CSV ou JSON (). Choisis le format, et tes données en direct sont prêtes à être analysImagine un peu la scène : il est tard, tu bois un café, et tu as besoin tout de suite des derniers prix de tes concurrents, de nouveaux leads ou des tendances qui cartonnent. Mais tes « datas » datent déjà de la semaine dernière, et quand tu mets enfin la main sur ce qu’il te faut, le marché a déjà bougé. Je suis passé par là, et franchement, c’est pas la joie. Dans le business aujourd’hui, attendre des infos dépassées ou stockées en cache, c’est comme arriver à une vente privée quand tout est déjà parti. C’est pour ça que le crawler en direct—choper des données en temps réel, à la seconde près—c’est plus juste un bonus, c’est carrément la clé pour garder une longueur d’avance.

Après des années à bidouiller des outils SaaS et d’automatisation (et à carburer au café), j’ai vu à quel point un crawler en direct peut changer la donne pour une équipe. Avec , on a voulu rendre le crawler en direct tellement simple que n’importe qui—même sans être geek—puisse récupérer les données web les plus fraîches en quelques clics. Dans ce guide, je t’explique ce qu’est vraiment un crawler en direct, pourquoi c’est devenu indispensable, et comment tu peux t’y mettre dès aujourd’hui, sans écrire une seule ligne de code.

C’est quoi un Crawler en Direct ? La data en mode instantané

On part de la base : c’est quoi un « crawler en direct » ? Pour faire simple, c’est un outil qui va chercher les infos directement sur un site web, en live, à chaque fois que tu lances la recherche. Imagine que tu mates un live à la télé, pas un replay. Les extracteurs web classiques, eux, bossent souvent avec des téléchargements programmés ou des copies en cache—donc t’es toujours à la bourre. Les crawlers en direct, eux, débarquent sur la page à l’instant T, voient ce qu’il y a, et ramènent les infos toutes fraîches.

Certains appellent ça « live crawler escort » ou « live escort crawler » (avoue, ça fait un peu agent secret pour tes tableurs !). Ce qu’il faut retenir, c’est que ces crawlers ne se contentent jamais de vieilles données. Grâce à l’automatisation du navigateur ou au cloud browsing, ils extraient le contenu comme si c’était un humain devant l’écran—même les trucs dynamiques genre JavaScript, scroll infini ou pop-ups. Que tu surveilles une promo, un post viral ou un nouveau contact, tu bosses toujours avec l’info la plus fraîche ().

Crawling en direct vs. statique :

- Crawling statique : C’est comme prendre une photo du site chaque jour—pratique pour l’archivage, mais pas pour l’actu brûlante.

- Crawling en direct : C’est comme regarder un live vidéo—ce que tu vois, c’est ce qui se passe maintenant.

Cette différence, elle est énorme pour tous ceux qui ont besoin d’infos à la minute. Dans des marchés qui bougent vite, quelques heures de retard peuvent te faire rater des opportunités ou te planter dans tes décisions ().

Pourquoi le Crawler en Direct est un vrai plus pour ton business ? Exemples concrets & avantages

Passons au concret. Pourquoi le crawler en direct, c’est le top pour la vente, le marketing, les opérations, et tout le reste ? Simple : les données en temps réel, ça permet de prendre de meilleures décisions. D’après le , les boîtes qui bossent « en temps réel » font environ 50 % de croissance et de marge en plus que celles qui traînent.

| Cas d’usage | Équipes/Fonction | Bénéfices/Exemples de données collectées |

|---|---|---|

| Surveillance des prix concurrents | Ventes/E-commerce | Suivi en temps réel des prix et promos pour ajuster sa stratégie (promptcloud.com Pricing) |

| Extraction de leads/contacts | Ventes/Marketing | Récupération de contacts frais (nom, email, téléphone) depuis des annuaires ou LinkedIn (Thunderbit Blog) |

| Analyse des réseaux sociaux & tendances | Marketing/Produit | Suivi des hashtags, sujets tendance et du ressenti en temps réel (promptcloud.com Pricing) |

| Mise à jour de catalogues produits | E-commerce/Opérations | Actualisation des fiches (prix, descriptions, stock) (datadwip.com Pricing) |

| Données pour pipeline commercial | Ventes | Création automatique de listes de prospects à partir d’annuaires (Thunderbit Blog) |

| Annonces immobilières | Immobilier | Agrégation des nouvelles annonces et des mises à jour de prix dès leur publication (promptcloud.com Pricing) |

Et surtout : plus tes données sont fraîches et fiables, plus tes décisions sont pertinentes. Les équipes évitent les coups de poker, repèrent les tendances dès qu’elles émergent, et agissent avant même que la concurrence ne bouge. Bref, le crawler en direct transforme la data brute en intelligence exploitable—tout de suite ().

Thunderbit : Le crawler en direct le plus simple à utiliser

Tu te dis sûrement : « Ok, mais je ne suis pas dev. Je fais comment ? » C’est justement ce qu’on a voulu régler avec .

Thunderbit, c’est une extension Chrome boostée à l’IA qui rend le crawler en direct aussi simple que commander un plat (et parfois même plus rapide !). Ce qui change tout :

- Aucune compétence technique : Installe l’extension, ouvre le site que tu veux, et laisse l’IA de Thunderbit bosser.

- Suggestion automatique des champs : Un clic, et Thunderbit scanne la page pour te proposer les meilleures colonnes (« Nom », « Prix », « Email »…) ().

- Crawling des sous-pages : Besoin d’infos cachées derrière des liens ? Thunderbit visite chaque sous-page (fiche produit, profil contact…) et rassemble tout dans un seul tableau.

- Modèles instantanés : Pour les sites connus (Amazon, Zillow, LinkedIn…), utilise des modèles prêts à l’emploi—aucune config à faire.

- Support multilingue : Thunderbit gère 34 langues, parfait pour les équipes internationales ().

- Export gratuit des données : Balance tes résultats vers Excel, Google Sheets, Airtable, Notion, CSV ou JSON—zéro frais caché ().

Le top ? Même sans expérience, tu peux te lancer en quelques minutes. Comme le dit un utilisateur : « Deux clics, et j’ai mes données. La précision est dingue » ().

Comparatif : Thunderbit vs. les outils classiques de crawling en direct

Soyons clairs : il existe d’autres façons de faire du crawling en direct. Tu pourrais ressortir tes skills Python et coder un crawler avec Selenium ou Beautiful Soup. Mais à moins d’aimer déboguer du code à 2h du mat, il y a plus simple.

| Aspect | Outils traditionnels (Python/Selenium) | Thunderbit AI Crawler |

|---|---|---|

| Installation & compétences | Faut coder, config galère | Aucun code—juste installer et utiliser (Thunderbit Blog) |

| Temps de mise en place | Plusieurs heures à jours | Quelques minutes |

| Fraîcheur des données | Données figées, parfois dépassées | Données en direct, à la seconde près (dataprocorp.tech Pricing) |

| Contenu dynamique | Galère (faut du code en plus) | Géré nativement, supporte JS et scroll (Thunderbit Blog) |

| Adaptabilité | Ça casse si le site change | L’IA s’adapte toute seule (dataprocorp.tech Pricing) |

| Maintenance | Élevée (faut corriger souvent) | Faible (l’IA gère la plupart des changements) (dataprocorp.tech Pricing) |

| Format de sortie | HTML brut, nettoyage à la main | Tableaux propres, prêts à l’export (Thunderbit Blog) |

| Intégrations | Faut coder | Export direct vers Sheets, Airtable, Notion, CSV, JSON (Thunderbit Blog) |

À moins que tu veuilles faire du scripting ton nouveau hobby, Thunderbit est la solution parfaite pour ceux qui veulent des résultats rapides et fiables.

Mode d’emploi : Utiliser Thunderbit comme crawler en direct

Tu veux voir le crawler en direct en action ? Voilà comment utiliser Thunderbit pour extraire des données en temps réel de n’importe quel site—sans prise de tête ni jargon technique.

Étape 1 : Installe Thunderbit et ouvre le site à crawler

Commence par ajouter l’ à ton navigateur. Ça prend une minute (sauf si ton Wi-Fi rame !).

Une fois installée, ouvre le site que tu veux crawler. Thunderbit marche sur tout ce que tu peux voir dans ton navigateur—si tu y as accès, Thunderbit aussi.

Étape 2 : Utilise la suggestion IA pour cartographier les données en un éclair

C’est là que la magie (ou plutôt l’IA) opère. Clique sur le bouton AI Suggest Fields dans Thunderbit. L’IA scanne la page et te propose les colonnes à extraire—« Nom », « Prix », « Stock », « Email », etc. ().

Tu peux ajuster ces champs, les renommer ou en ajouter d’autres. Tu veux aller plus loin ? Ajoute des instructions personnalisées pour chaque champ—genre « formater les numéros de téléphone en E.164 » ou « classer les produits par catégorie ».

Étape 3 : Lance le crawling en direct en un clic

Une fois tes champs définis, clique sur Scraper. Thunderbit commence à parcourir la page en temps réel, en suivant la pagination ou le scroll infini si besoin. Si tu as activé le crawling des sous-pages, il cliquera sur chaque lien (fiche produit, profil…) et ajoutera ces infos à ton tableau ().

Tu verras les lignes se remplir en direct—un peu comme du pop-corn qui éclate, mais bien plus utile !

Étape 4 : Exporte tes données fraîches vers Excel, Google Sheets ou Notion

Une fois le crawling terminé, il ne te reste plus qu’à exploiter tes données. Thunderbit te permet d’exporter gratuitement vers Excel, Google Sheets, Airtable, Notion, CSV ou JSON (). Choisis le format, et tes données en direct sont prêtes à être analysées, partagées ou intégrées.

Astuces : Optimise ton crawler en direct

Tu veux aller plus loin avec Thunderbit ? Voici quelques tips testés et approuvés :

- Planifie tes crawls : Utilise le planificateur de Thunderbit pour lancer des extractions auto (genre « chaque lundi à 9h »). Parfait pour surveiller les prix ou mettre à jour tes leads ().

- Exploite les sous-pages : Si des infos sont cachées derrière des liens (ex : contacts sur des profils), active le crawling des sous-pages. Thunderbit visitera chaque lien et fusionnera les données.

- Personnalise les champs : Pour des données plus complexes, ajoute des instructions IA personnalisées—catégorisation, formatage, etc.

- Utilise les modèles instantanés : Pour les sites connus, regarde s’il y a un modèle prêt à l’emploi avant de tout configurer à la main.

- Respecte les sites : Ne scrape pas plus vite que nécessaire. Utilise la planification et des délais raisonnables pour ne pas surcharger les serveurs ().

- Cloud intelligent vs. navigateur : Pour les sites publics, le mode Cloud est ultra-rapide (jusqu’à 50 pages d’un coup). Pour les sites où il faut être connecté, passe en mode Navigateur pour rester dans ta session.

Sécurité et conformité : crawler en direct dans les règles

Petit rappel qui compte : Respecte toujours les conditions d’utilisation et la vie privée. Avant de crawler, check le robots.txt et les CGU du site (). Certains sites limitent l’accès automatisé ou la fréquence des requêtes. Thunderbit te permet de régler la cadence et de planifier les extractions, mais c’est à toi de jouer le jeu.

- Respecte la vie privée et la loi : Ne récupère que des données publiques, et évite les infos perso sans accord. Si tu collectes des emails ou numéros, assure-toi d’être conforme au RGPD ou CCPA ().

- Sois responsable : Utilise les données pour de vraies raisons, sans surcharger les serveurs. Transparence et conformité = moins de risques et plus de confiance.

Dépasser les galères classiques du crawling en direct

Le crawling en direct, c’est pas toujours un long fleuve tranquille. Voilà les galères fréquentes—et comment Thunderbit les gère :

- Anti-bots : Certains sites balancent des CAPTCHAs ou bloquent les IP. Thunderbit imite la navigation humaine (surtout en mode Navigateur) et gère les blocages. Pour les CAPTCHAs costauds, faudra parfois les passer à la main.

- Pages dynamiques & JavaScript : Les extracteurs classiques galèrent, mais Thunderbit tourne dans un vrai navigateur, donc gère scripts, AJAX et scroll infini sans souci.

- Changements de mise en page : Quand un site change, les extracteurs classiques plantent. L’IA de Thunderbit s’adapte toute seule—clique sur « Améliorer les champs IA » si besoin ().

- Qualité des données : Thunderbit nettoie et structure les données à l’extraction, mais vérifie toujours avant d’exporter.

- JavaScript lourd : Pour les sites très complexes, alterne entre mode Cloud et Navigateur, ou change d’URL si tu peux.

- CAPTCHAs persistants : Si un site bloque fort les bots, privilégie l’API officielle ou réduis la fréquence de crawling.

La plupart de ces soucis sont bien moins galères avec Thunderbit qu’avec des scripts maison. Et si tu bloques, le est blindé d’astuces et de solutions.

Conclusion & points clés : Passe à la vitesse supérieure avec le crawling en direct

En résumé : le crawling web en direct, c’est la méthode la plus rapide pour avoir des données à la seconde pour ton activité. Que tu sois en vente, marketing, opérations, ou juste fan de data, avoir des infos fraîches, c’est prendre de meilleures décisions, réduire l’incertitude, et garder une vraie avance sur la concurrence.

Avec Thunderbit, pas besoin d’être dev ou data scientist. Tout le monde peut lancer un crawl en direct en quelques minutes, l’automatiser, et exporter les résultats vers ses outils préférés. Grâce à la détection IA des champs, au crawling des sous-pages et aux modèles instantanés, tu passeras moins de temps à manipuler la data, et plus à l’exploiter.

À retenir : Dans un monde où , le crawling en direct, c’est déjà la norme. Thunderbit le rend accessible à tous : arrête d’attendre, passe à l’action.

Prêt à tester ? , choisis un site, et découvre la simplicité du crawling en direct. Pour aller plus loin, mate notre ou explore d’autres cas d’usage sur le .

Bon crawling—et que tes données soient toujours plus fraîches que ton café du matin !

FAQ

1. C’est quoi un crawler en direct et en quoi c’est différent d’un extracteur web classique ?

Un crawler en direct, c’est un outil qui va chercher les données d’un site web en temps réel, à la demande. Contrairement aux extracteurs classiques qui bossent sur un planning ou avec des données en cache, les crawlers en direct te donnent l’info à la seconde. Souvent, ils intègrent de l’IA pour détecter les bons champs et naviguer tout seuls, ce qui les rend plus rapides et plus simples à utiliser.

2. Pourquoi la donnée en temps réel est-elle cruciale pour les équipes commerciales et opérationnelles ?

La donnée en temps réel permet de prendre des décisions tout de suite dans des environnements qui bougent vite. Que ce soit pour ajuster les prix face à la concurrence, réagir à une tendance sur les réseaux sociaux ou suivre les stocks, avoir les dernières infos aide les boîtes à rester compétitives, éviter les retards et booster leur chiffre d’affaires.

3. Comment l’IA améliore-t-elle le processus de crawling en direct ?

L’IA simplifie le crawling en détectant automatiquement les champs pertinents, en s’adaptant aux changements de mise en page, en gérant la pagination et les sous-pages, et même en transformant les données (traduction, conversion de devises…). Ça le rend accessible à tout le monde et réduit la config manuelle.

4. Exemples concrets d’utilisation du crawling en direct ?

Les crawlers en direct servent à surveiller les prix sur les sites e-commerce, extraire des commentaires sur TikTok ou Twitter, générer des leads sur LinkedIn, collecter des avis clients ou suivre le contenu des concurrents. Ça concerne le retail, l’immobilier, le marketing, la logistique, etc.

5. Comment démarrer avec un outil de crawling en direct comme Thunderbit ?

Il suffit d’installer l’extension Chrome Thunderbit, d’ouvrir une page web, et d’utiliser la fonction « AI Suggest Fields » pour choisir les données à extraire. Après avoir cliqué sur « Scraper », l’outil collecte les données et les restitue dans un format structuré, exportable vers des tableurs ou intégré à Google Sheets, Airtable… sans coder.