Ich musste über 200 Nachrichtenquellen auf angesagte Artikel überwachen. Manuell? Das ist ein Vollzeitjob. Ein herkömmlicher Scraper? Der war jedes Mal kaputt, wenn eine Website ihr Layout geändert hat.

Dann habe ich KI-gestützte Article Scraper ausprobiert. Ein Klick, saubere Daten, keine CSS-Selektoren. Der Unterschied war wie Tag und Nacht.

Wenn Sie Journalist:in, SEO-Expert:in oder Forschende:r sind und Artikel in großem Umfang erfassen müssen, erspart Ihnen dieser Vergleich viel Trial-and-Error. Ich habe sowohl traditionelle No-Code-Scraper als auch KI-gestützte Lösungen getestet — hier ist, was wirklich funktioniert.

Kurzfassung

| Vorteile | Nachteile | Am besten geeignet für | |

|---|---|---|---|

| KI-gestützter Article Scraper | - Kann mehrere Websites mit hoher Genauigkeit scrapen - Entfernt Störsignale automatisch - Passt sich an Änderungen der Webstruktur an - Unterstützt dynamisch nachgeladene Inhalte - Geringe Kosten für Datenbereinigung | - Höhere Rechenkosten - Längere Verarbeitungszeit - Einige Seiten benötigen manuelle Eingriffe - Kann Anti-Scraping-Mechanismen auslösen | - Scraping komplexer oder dynamischer Websites (z. B. Nachrichtenportale, soziale Medien) - Datenerfassung in großem Umfang |

| Traditioneller No-Code Article Scraper | - Schnelle Ausführung - Niedrigere Kosten - Geringer Server- und lokaler Ressourcenverbrauch - Hohe Steuerbarkeit | - Häufige Wartung wegen Änderungen der Webstruktur - Kann nicht mehrere Websites gleichzeitig scrapen - Kommt mit dynamischen Inhalten nicht zurecht - Hohe Kosten für Datenbereinigung | - Schnelles Scraping einfacher statischer Webseiten im großen Maßstab - Begrenzte Rechenressourcen, knappe Budgets |

Was ist ein Article Scraper? Warum ist ein KI-gestützter Article Scraper wichtig?

Ein ist eine Art , der Informationen wie Titel, Autoren, Veröffentlichungsdaten, Inhalte, Keywords, Bilder und Videos von Nachrichtenseiten finden und extrahieren kann und sie in strukturierte Formate wie JSON, CSV oder Excel organisiert.

setzen auf , um Inhalte anhand der -Struktur einer Webseite zu extrahieren. Dieser Ansatz hat jedoch einige Nachteile:

- Mangelnde Universalität: Unterschiedliche Webstrukturen erfordern für jede Seite eigene , und Änderungen an der Struktur machen sie schnell unbrauchbar, was häufige Anpassungen erfordert.

- Unfähigkeit, dynamische Inhalte zu verarbeiten: Viele Websites laden Inhalte per AJAX oder JavaScript nach, was nicht direkt scrapen können.

- Begrenzte Datenverarbeitung: liefern nur -Fragmente, ohne anschließende Datenbereinigung, Formatierung, semantische Analyse oder Sentiment-Analyse.

Dann kommt der ins Spiel.

Dann kommt der ins Spiel.

-

Diese Technologie nutzt LLMs, um Webseiten zu verstehen, und bietet:

- Intelligente Erkennung: Titel, Autoren, Zusammenfassungen und Hauptinhalte werden identifiziert.

- Automatische Entfernung von Störsignalen: Hauptinhalt wird von Navigation, Werbung und verwandten Artikeln getrennt, was Datenqualität und Scraping-Effizienz verbessert.

- Anpassungsfähigkeit an Webänderungen: Selbst wenn sich Struktur oder Design einer Website ändern, kann die KI dank semantischem Verständnis und visueller Merkmale weiter scrapen.

- Plattformübergreifende Generalisierung: Anders als lassen sich KI-Scraper ohne manuelle Anpassungen auf unterschiedlichen Websites einsetzen.

- Integration mit NLP und Deep Learning: Aufgaben wie Übersetzung, Zusammenfassung und Sentiment-Analyse lassen sich damit erledigen.

Was macht den besten Article Scraper im Jahr 2026 aus?

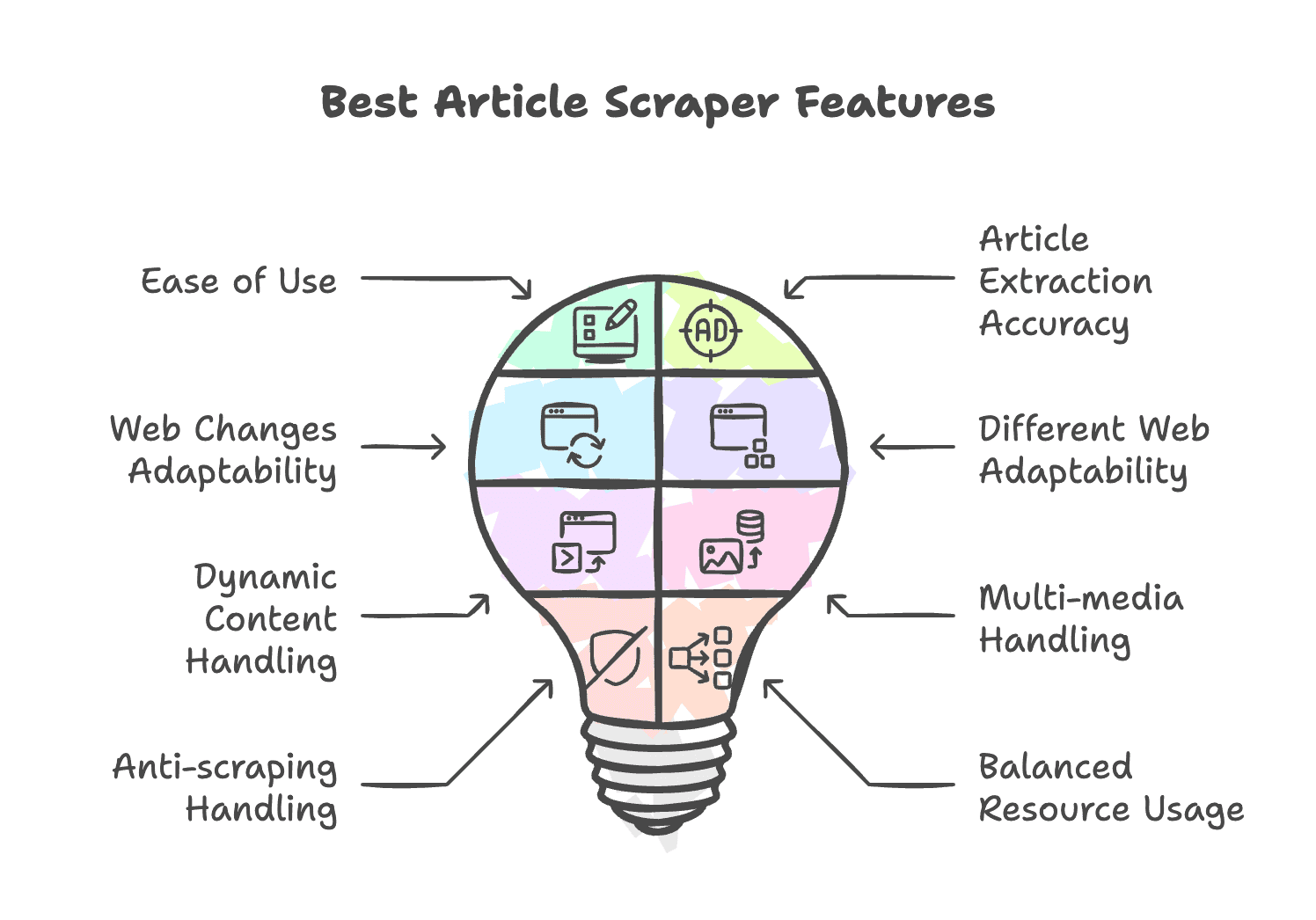

Ein erstklassiger Article Scraper balanciert Leistung, Kosten, Bedienbarkeit, Flexibilität und Skalierbarkeit. Hier sind die Kriterien für die Auswahl des besten Article Scrapers im Jahr 2026:

- Einfachheit in der Bedienung: Intuitive Oberfläche, kein Programmieren erforderlich.

- Genauigkeit bei der Artikelerfassung: Relevante Informationen werden präzise erkannt, ohne Werbung oder Navigation mitzuerfassen.

- Anpassungsfähigkeit an Webänderungen: Passt sich automatisch an Änderungen in Struktur oder Design an, ohne häufige Wartung.

- Kompatibilität mit verschiedenen Websites: Funktioniert über unterschiedliche Webstrukturen hinweg.

- Verarbeitung dynamischer Inhalte: Unterstützt das Laden dynamischer Inhalte per JavaScript oder AJAX.

- Verarbeitung von Multimedia: Erkennt Bilder, Videos und Audio.

- Anti-Scraping-Schutz: Nutzt IP-Rotation, CAPTCHA-Lösungen und Proxys, um Anti-Scraping-Mechanismen zu umgehen.

- Ausgewogene Ressourcennutzung: Verbraucht nicht übermäßig viel Speicher oder Rechenleistung.

Die besten Article- und News-Scraper auf einen Blick

| Tools | Wichtigste Funktionen | Am besten geeignet für | Preisgestaltung |

|---|---|---|---|

| Thunderbit | KI-gestützter Scraper; vorbereitete Vorlagen; Unterstützung für das Scrapen von PDFs, Bildern und Dokumenten; fortgeschrittene Datenverarbeitung | Nutzer ohne technischen Hintergrund, die mehrere Nischen-Websites scrapen möchten | 7 Tage kostenlos testen, ab 9 $/Monat (Jahresplan) |

| WebScraper.io | Browser-Erweiterung; Unterstützung für dynamische Inhalte; keine Proxy-Integration | Nutzer, die keine komplexen Webseiten oder fortgeschrittenen Funktionen benötigen | 7 Tage kostenlos testen, ab 40 $/Monat (Jahresplan) |

| Browse.ai | No-Code-Web-Scraper und Monitoring; vorgefertigte Bots; virtueller Browser; verschiedene Paginierungsmethoden; starke Integrationen | Unternehmen mit Bedarf an komplexem Scraping im großen Maßstab | 19 $/Monat (Jahresplan) |

| Octoparse | No-Code-Scraper auf Basis von CSS-Selektoren; automatische Erkennung und Generierung von Scraping-Workflows; vorgefertigte Article-Scraper-Vorlagen; virtueller Browser; Anti-Anti-Scraping-Mechanismen | Unternehmen mit Bedarf an komplexem Scraping | Ab 99 $/Monat (Jahresplan) |

| Bardeen | Umfassende Web-Automatisierung; vorgefertigte Vorlagen; No-Code-Scraper; nahtlose Integration in den Workspace | GTM-Teams, die Article Scraping in bestehende Workflows einbinden wollen | 7 Tage kostenlos testen, ab 99 $/Monat (Jahresplan) |

| PandaExtract | Benutzerfreundliche Oberfläche; automatische Erkennung und Kennzeichnung | Nutzer, die eine schnelle Extraktion mit einem Klick ohne komplexes Setup benötigen | 49 $ LTD |

Der leistungsstärkste KI-gestützte Article Scraper für Business-Anwender

- Vorteile:

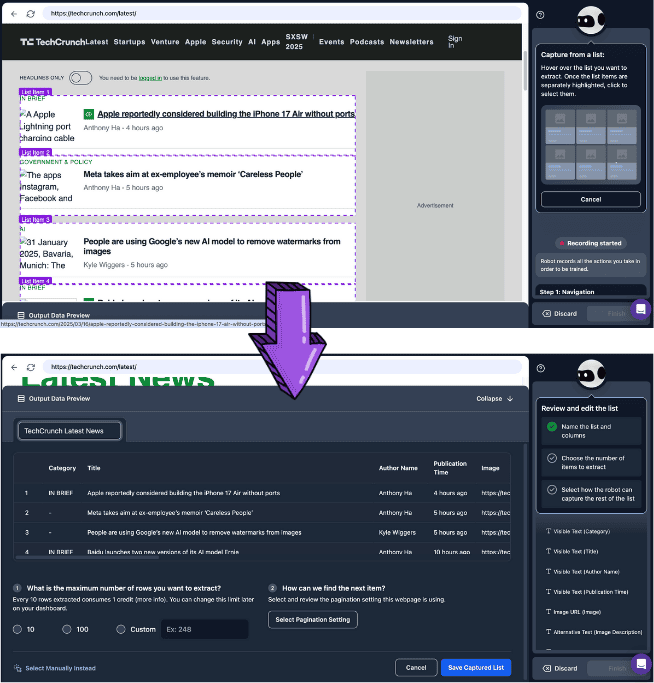

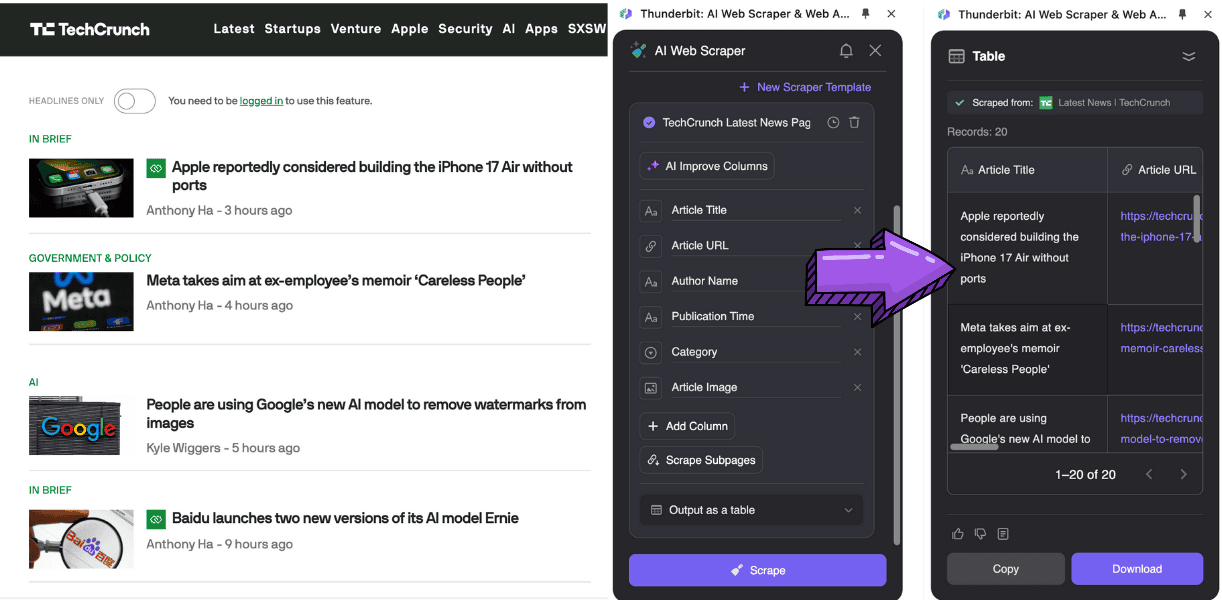

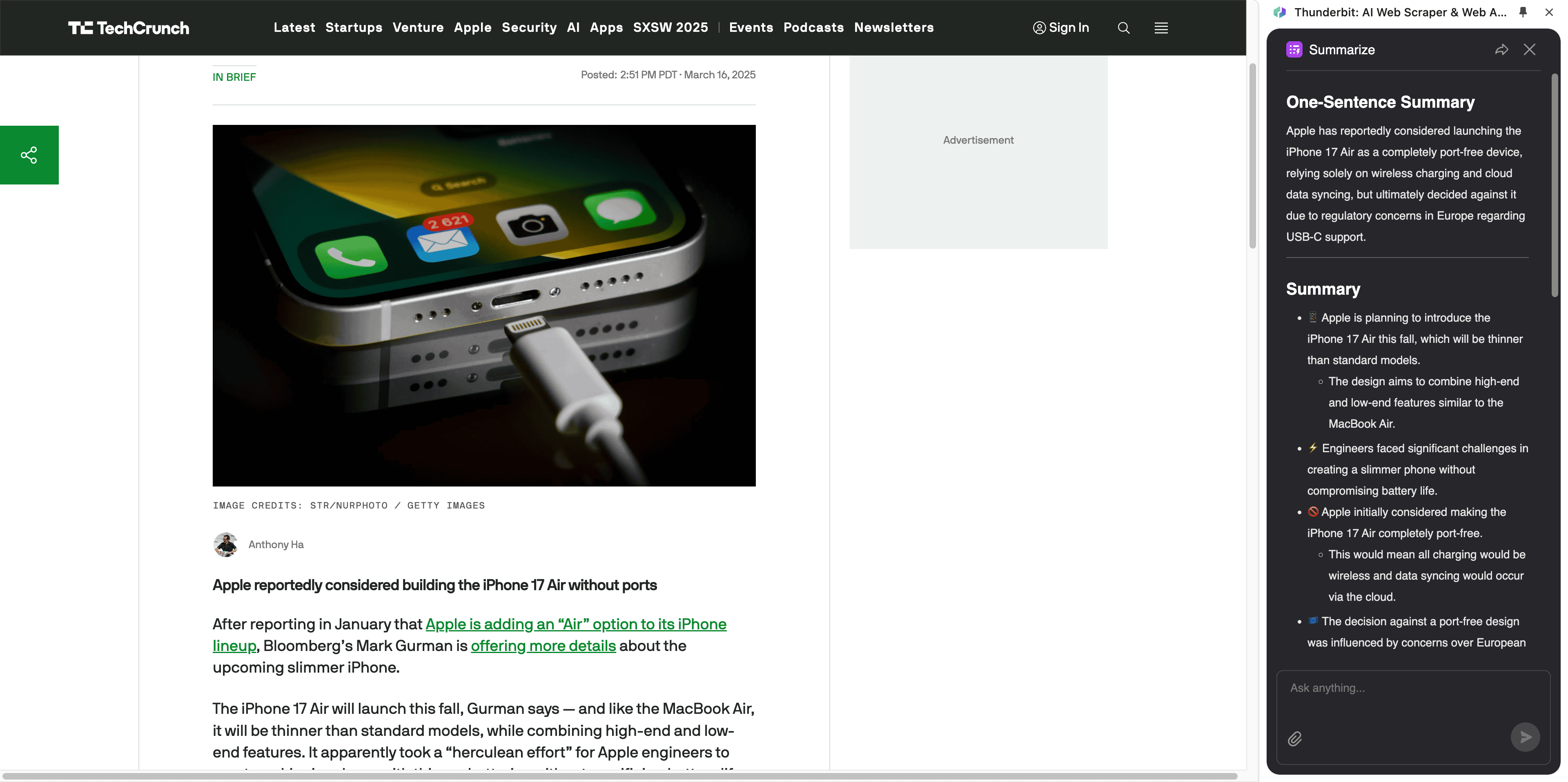

- Nutzt natürliche Sprache, um KI für die Erkennung und Analyse von Webinformationen aufzurufen, und macht CSS-Selektoren überflüssig

- KI-gestützte Datenanalyse, einschließlich Formatkonvertierung, , Klassifizierung, Übersetzung und Tagging

- für die Extraktion von Artikellisten und Inhalten mit einem Klick

- Nachteile:

- Derzeit nur als verfügbar

- Nicht für Scraping in sehr großem Umfang geeignet

- Langsamere Geschwindigkeit beim Scraping mehrerer Seiten, kann jedoch im Hintergrund scrapen, um schneller Ergebnisse zu liefern

Ein KI-gestützter Article Scraper für den Unternehmenseinsatz

Browse.ai

- Vorteile:

- No-Code-Article-Scraper und Monitoring

- Unterstützt den Betrieb eines virtuellen Browsers, um das Auslösen von Anti-Scraping-Mechanismen zu vermeiden

- Zahlreiche vorgefertigte Article-Scraping-Bots für das Scrapen von , , und mehr mit nur einem Klick

- Tiefe Integration mit Plattformen wie und zur Tool-Verknüpfung

- Nachteile:

- Für Deep Extract müssen zwei Bots erstellt werden, was den Prozess komplex macht

- CSS-Selektoren sind für Nischen-Websites ungenau

- Teuer und eher für kontinuierliche Datenerfassung im großen Maßstab geeignet

Ein No-Code-Scraper für die Datenerfassung im kleinen Umfang

PandaExtract

- Vorteile:

- Erkennt Artikellisten und Detailseiten automatisch mit einer benutzerfreundlichen Oberfläche

- Kann Listen, Detailseiten, E-Mails und Bilder extrahieren und eignet sich für strukturierte Datenerfassung im kleinen Maßstab

- Einmalzahlung für lebenslange Nutzung

- Nachteile:

- Nur als Browser-Erweiterung verfügbar, nicht in der Cloud nutzbar

- Die kostenlose Version unterstützt nur Kopieren, nicht den Export nach CSV, JSON usw.

Ein sofort einsatzbereiter Article Scraper für Organisationen

Octoparse

- Vorteile:

- No-Code-Article-Scraper mit automatischer Erkennung zur Erfassung der Webstruktur und Generierung von Scraping-Workflows

- Zahlreiche vorgefertigte Article-Scraper-Vorlagen, sofort einsatzbereit

- Nutzt einen virtuellen Browser mit IP-Rotation, CAPTCHA-Lösungen und Proxys, um Anti-Scraping-Mechanismen zu umgehen

- Nachteile:

- Die automatische Erkennung basiert weiterhin auf CSS-Selektor-Logik, mit durchschnittlicher Genauigkeit

- Für fortgeschrittene Funktionen braucht man Einarbeitung und technisches Know-how

- Hohe Kosten bei Datenerfassung in großem Umfang

Die umfassendste Automatisierung für GTM-Teams

Bardeen

- Vorteile:

- No-Code-Article-Scraper mit LLM für Automatisierung mit einem Klick

- Integriert mit über 100 Anwendungen, darunter , und

- Leistungsstarke Web-Automatisierungstools für KI-Analysen nach der Datenerfassung

- Ideal, um Datenerfassung in bestehende Workflows einzubetten

- Nachteile:

- Starke Abhängigkeit von vorgefertigten Playbooks; eigene Workflows erfordern Trial-and-Error

- Trotz No-Code-Plattform kann das Verstehen und Einrichten komplexer Automatisierungen für Nicht-Techniker Lernzeit erfordern

- Das Einrichten von Extraktionen auf Unterseiten ist komplex

- Sehr teuer

Ein leichter Article Scraper für die sofortige Datenerfassung

Webscraper.io

- Vorteile:

- No-Code-Scraper mit Point-and-Click-Oberfläche

- Unterstützt das Laden dynamischer Inhalte

- Cloud-basierter Betrieb

- Integriert sich mit , und

- Nachteile:

- Keine vorgefertigten Vorlagen, eigene Sitemap-Erstellung erforderlich

- Lernkurve für Nutzer, die mit CSS-Selektoren nicht vertraut sind

- Komplexes Setup für Paginierung und Extraktion auf Unterseiten

- Die Cloud-Version ist teuer

Fortgeschrittenere Lösungen für Entwickler

Für technisch versierte Nutzer stehen zur Verfügung. Diese Lösungen bieten:

- Flexibilität: Direkte API-Aufrufe für benutzerdefiniertes Scraping, einschließlich dynamischem Rendering und IP-Rotation

- Skalierbarkeit: Einbindung in eigene Datenpipelines für hohe Frequenz und große Datenmengen im Unternehmensmaßstab

- Geringe Wartungskosten: Keine Verwaltung von Proxy-Pools oder Anti-Scraping-Strategien nötig, was Betriebszeit spart

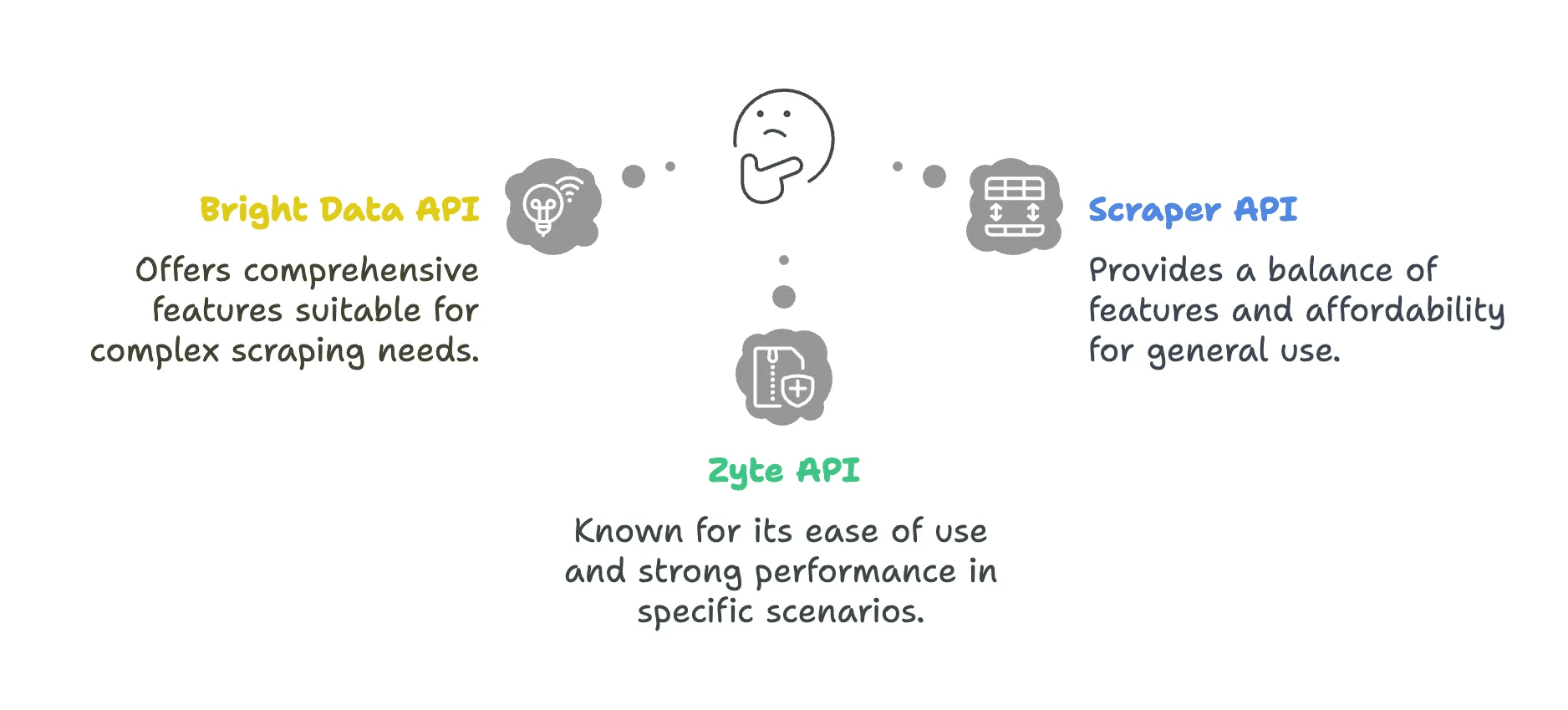

API-Lösungen auf einen Blick

| API | Vorteile | Nachteile |

|---|---|---|

| Bright Data API | - Umfangreiches Proxy-Netzwerk (72 Mio.+ IPs in 195 Ländern) - Fortschrittliches Geo-Targeting bis auf Stadt-/PLZ-Ebene - Robuster Proxy Manager für IP-Rotation | - Langsamere Antwortzeiten (durchschnittlich 22,08 s) - Höhere Preise, für kleinere Teams weniger geeignet - Steilere Lernkurve bei der Konfiguration |

| ScraperAPI | - Niedriger Einstieg ab 49 $ - Autoparse-Funktion zur automatischen Datenextraktion - Web-UI-Player zum Testen | - Berechnet häufig auch blockierte Anfragen - Begrenzte JavaScript-Rendering-Funktionen - Kosten können mit Premium-Parametern stark steigen |

| Zyte API | - KI-gestützte Parsing-Funktionen - Berechnet fehlgeschlagene Anfragen nicht | - Höhere Anfangskosten (ca. 450 $/Monat) - Guthaben wird nicht von Monat zu Monat übertragen |

- Bright Data Web Scraper API

- Vorteile:

- Deckt 195 Länder mit über 72 Mio. Residential IPs ab, unterstützt automatische IP-Rotation und Geo-Lokalisierungssimulation und ist ideal für Websites mit strengen Anti-Scraping-Maßnahmen (z. B. , )

- Unterstützt das Laden dynamischer JavaScript-Inhalte und das Erfassen von Seitenschnappschüssen

- Nachteile:

- Hohe Kosten (Abrechnung pro Anfrage und Bandbreite), geringe Kosteneffizienz für kleine Projekte

- Vorteile:

- Scraper API

- Vorteile:

- 40 Mio. Proxys weltweit, automatisches Umschalten zwischen Rechenzentrums- und Residential-IP, Umgehung der Cloudflare-Prüfung, Integration von CAPTCHA-Lösungen von Drittanbietern (z. B. )

- Strukturierte Endpunkte und asynchrone Scraper für höhere Geschwindigkeit

- Nachteile:

- Zusätzliche Kosten für das Rendering dynamischer Seiten, eingeschränkte Unterstützung für komplexe AJAX-Websites

- Vorteile:

- Zyte API

- Vorteile:

- KI-gestützte automatische Web-Datenextraktion, keine Notwendigkeit, Extraktionsregeln für jede Website zu entwickeln und zu pflegen

- Flexible Pay-as-you-go-Preisgestaltung

- Nachteile:

- Fortgeschrittene Funktionen (z. B. Session-Handling, skriptfähiger Browser) erfordern Einarbeitung

- Vorteile:

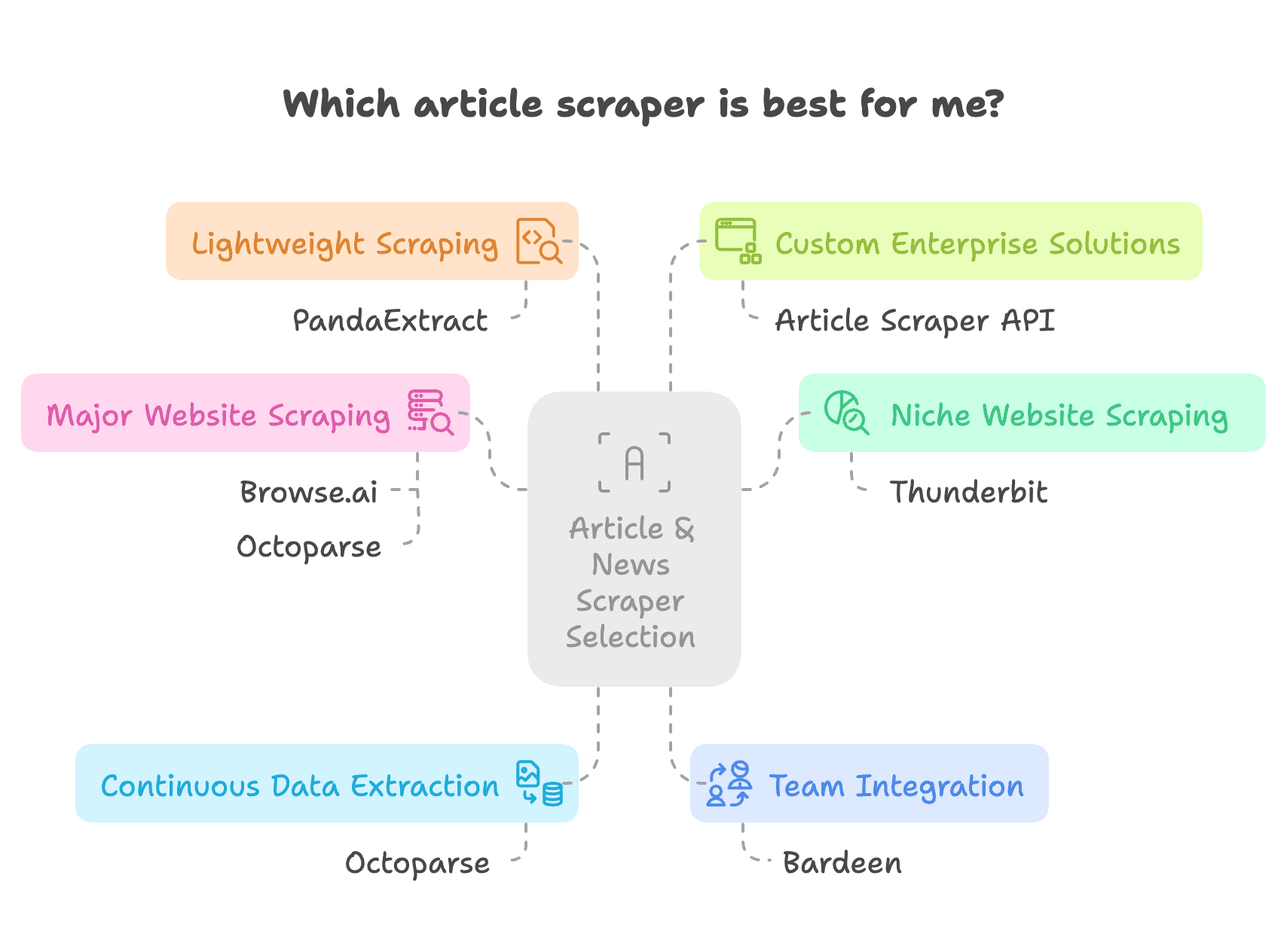

Wie wählen Sie Ihren Article- und News-Scraper aus?

Bei der Auswahl eines Article- und News-Scrapers sollten Sie Ihre geschäftlichen Anforderungen, Ihren technischen Hintergrund und Ihr Budget berücksichtigen.

- Wenn Sie mehrere Nischen-Websites scrapen müssen, ohne für jede Seite einen eigenen Scraper zu bauen, und ein Budget haben, ist die beste Wahl. Es setzt nicht auf , sondern nutzt KI zur Analyse von Webstrukturen und ermöglicht so KI-Analysen nach der Datenerfassung. Für Thunderbit AI sind alle Websites gleich, sodass komplette Artikel präzise erfasst werden.

- Wenn Sie Nachrichten und Artikel von großen Websites wie dem oder scrapen möchten, brauchen Sie einen Article Scraper mit robusten Anti-Scraping-Mechanismen und vorgefertigten Vorlagen, etwa Browse.ai oder Octoparse. Die beste Option ist jedoch eine Chrome-Erweiterung wie : Der Datenerfassungsprozess ahmt normales Surfen und Kopieren nach, sodass Logins ohne kompliziertes Setup möglich sind.

- Wenn Sie fortlaufend Daten in großem Umfang scrapen müssen, sind Tools mit Zeitplan-Funktionen wie Octoparse geeigneter.

- Für den Team-Einsatz und die nahtlose Integration in bestehende Workflows ist Bardeen ideal, da es über das Article Scraping hinaus eine Reihe von Web-Automatisierungstools bietet.

- Wenn Sie einen leichten Article Scraper für kleine Datenmengen möchten, ohne Zeit ins Lernen zu investieren, wählen Sie einen Point-and-Click-Article-Scraper wie PandaExtract.

- Wenn Sie einen technischen Hintergrund haben oder einen Enterprise-Article-Scraper bauen, sollten Sie API-Tools oder Ihren eigenen Scraper zusätzlich zu diesen in Betracht ziehen.

Fazit

Dieser Artikel hat das Konzept und die Geschäftsszenarien von Article- und News-Scrapern vorgestellt. basieren auf und erfordern etwas Wissen über Web- und , insbesondere bei fortgeschrittenen Aufgaben. Die neue Generation von verlässt sich vollständig auf die semantische Verständnis- und visuelle Erkennungsfähigkeit der KI und übertrifft bei der Anpassung an Änderungen der Webstruktur, der Generalisierung über verschiedene Websites hinweg, dem Umgang mit dynamischen Inhalten sowie der anschließenden Datenbereinigung und Analyse.

Der Artikel hat außerdem sechs nützliche Article- und News-Scraper sowie API-Tools für Entwickler aufgelistet und ihre Vor- und Nachteile, geeignete Datenumfänge, Webfunktionen und Zielgruppen verglichen. Wenn Sie Article- und News-Scraping in Betracht ziehen, wählen Sie die Lösung, die zu Ihren geschäftlichen Anforderungen passt und gleichzeitig Leistung und Kosten in Balance hält.

FAQs

1. Was ist ein KI-gestützter Article Scraper und wie funktioniert er?

- Nutzt KI, um Inhalte von Webseiten zu analysieren und zu extrahieren, ohne CSS-Selektoren zu benötigen.

- Erkennt Titel, Autoren, Veröffentlichungsdaten und Hauptinhalte mit hoher Genauigkeit.

- Entfernt automatisch Werbung, Navigationsmenüs und andere irrelevante Elemente.

- Passt sich an Änderungen der Webstruktur an und funktioniert über verschiedene Websites hinweg.

2. Welche Vorteile bietet ein KI-gestützter Article Scraper gegenüber traditionellen Scrapern?

- Kann Inhalte von mehreren Websites mit nur einem Tool extrahieren.

- Verarbeitet dynamische Inhalte, einschließlich per JavaScript und AJAX geladener Seiten.

- Erfordert weniger manuelle Einrichtung und Wartung als CSS-basierte Scraper.

- Bietet zusätzliche Funktionen wie Zusammenfassung, Übersetzung und Sentiment-Analyse.

3. Kann ich Thunderbit für das KI-gestützte Scraping von Artikeln ohne Programmierkenntnisse verwenden?

- Ja, Thunderbit ist für Nicht-Techniker mit einer einfachen No-Code-Oberfläche konzipiert.

- Nutzt KI, um Artikelinhalte automatisch zu erkennen und zu extrahieren.

- Bietet vorgefertigte Vorlagen für schnelles und effizientes Scraping.

- Ermöglicht den Export von Daten in verschiedene Formate wie CSV, JSON und Google Sheets.

Mehr erfahren: