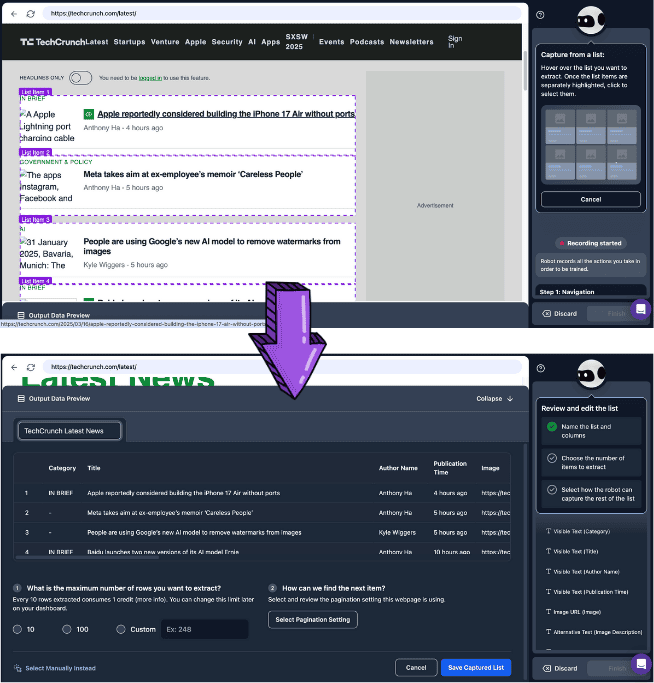

Мне нужно было мониторить больше 200 новостных источников и быстро вылавливать трендовые материалы. Делать это руками? Это реально фулл-тайм. А обычный парсер статей? Он разваливался каждый раз, когда сайт чуть-чуть менял верстку.

Потом я протестировал AI-парсеры статей. Один клик — и на выходе аккуратные данные, без плясок с CSS-селекторами. Разница — просто небо и земля.

Если ты журналист, SEO-специалист или исследователь, и тебе нужно массово собирать статьи, это сравнение сэкономит тебе кучу времени и нервов. Я прогнал и классические no-code решения, и инструменты на базе ИИ — ниже только то, что реально работает.

TL;DR

| Плюсы | Минусы | Лучше всего подходит для | |

|---|---|---|---|

| AI Article Scraper | - Высокая точность при сборе данных с разных сайтов - Автоматически убирает «шум» - Подстраивается под изменения структуры страниц - Поддерживает динамическую загрузку контента - Минимальные затраты на очистку данных | - Более высокая вычислительная стоимость - Дольше обрабатывает страницы - Иногда требуется ручная донастройка - Может срабатывать защита от парсинга | - Сбор данных со сложных или динамических сайтов (например, новостные порталы, соцсети) - Масштабный сбор данных |

| Traditional No-code Article Scraper | - Быстро работает - Дешевле - Низкая нагрузка на сервер и локальные ресурсы - Высокая управляемость | - Частое обслуживание из‑за изменений структуры страниц - Не умеет собирать данные сразу с нескольких сайтов - Плохо справляется с динамическим контентом - Дорого обходится очистка данных | - Быстрый массовый сбор с простых статичных страниц - Ограниченные ресурсы и бюджет |

Что такое парсер статей и почему важны AI-парсеры?

— это разновидность , которая находит и вытаскивает с новостных сайтов данные вроде заголовков, авторов, дат публикации, текста, ключевых слов, изображений и видео, а затем упаковывает всё это в структурированные форматы — JSON, CSV или Excel.

чаще всего завязаны на и вытягивают контент, ориентируясь на структуру . Но у такого подхода есть ощутимые минусы:

- Нет универсальности: под каждый сайт нужны свои , а любые правки в верстке быстро «убивают» настройки — приходится постоянно чинить и обновлять.

- Проблемы с динамическим контентом: многие сайты подгружают материалы через AJAX или JavaScript, и не могут напрямую «дотянуться» до такого контента.

- Слабая обработка данных: обычно вытаскивают куски — без нормальной очистки, форматирования, семантического анализа или анализа тональности.

А теперь — .

А теперь — .

-

Эта технология использует LLM для понимания веб-страниц, поэтому умеет:

- Умно распознавать элементы: выделять заголовки, авторов, краткие выжимки и основной текст.

- Автоматически убирать «мусор»: отделять главное содержимое от навигации, рекламы и блоков «похожие статьи», повышая качество данных и ускоряя работу.

- Адаптироваться к изменениям: даже если меняются структура или стили, ИИ продолжает извлекать данные за счет семантики и визуальных подсказок.

- Работать на разных сайтах без ручной подгонки: в отличие от , AI-решения проще переносить между сайтами.

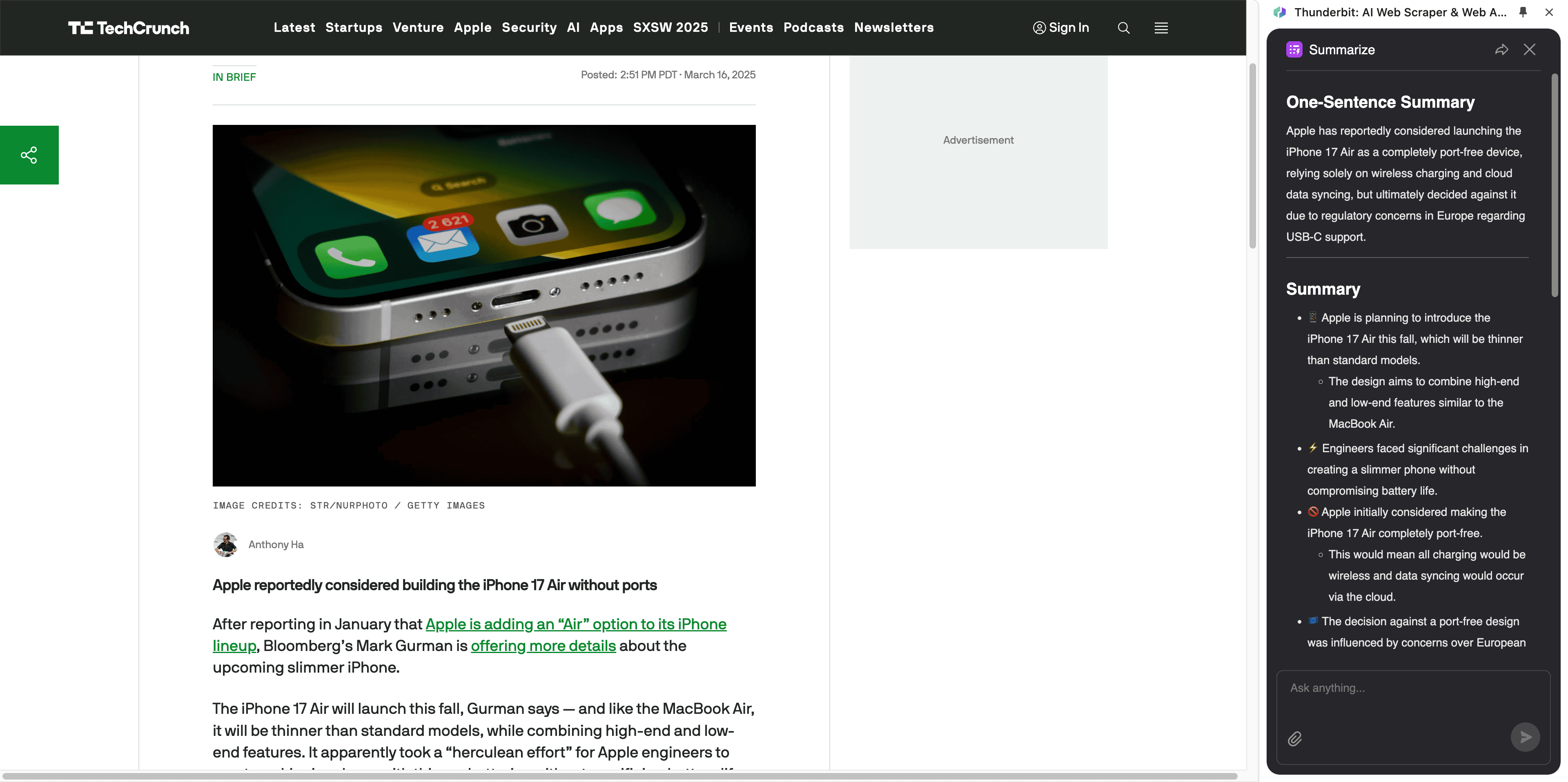

- Связка с NLP и глубоким обучением: позволяет сразу делать перевод, суммаризацию и анализ тональности.

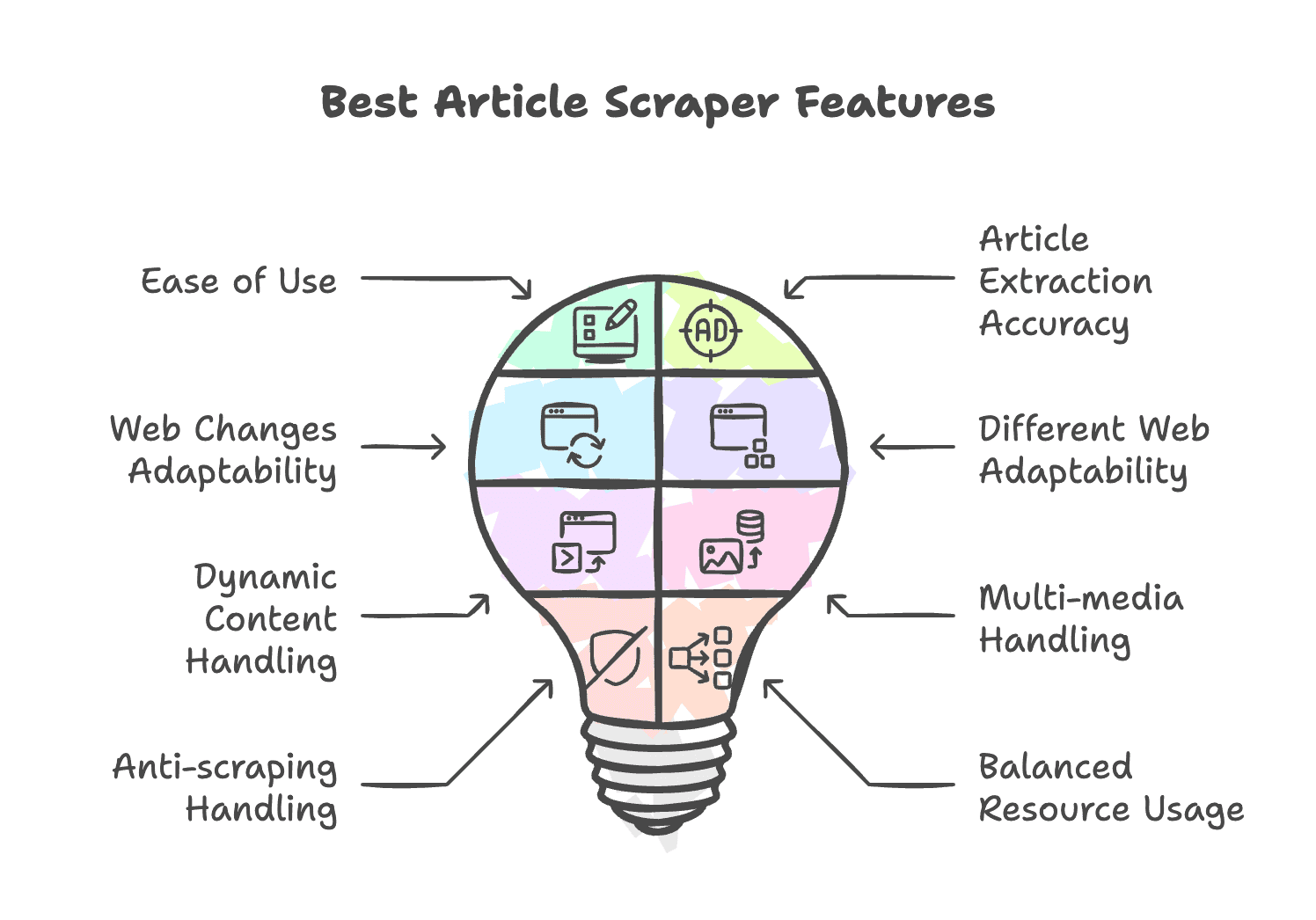

Каким должен быть лучший парсер статей в 2026 году?

Сильный парсер новостных статей — это всегда баланс скорости, стоимости, удобства, гибкости и масштабируемости. Вот по каким критериям логично выбирать инструмент в 2026 году:

- Удобство: понятный интерфейс, без программирования.

- Точность извлечения: корректно выделяет нужные поля без рекламы и навигации.

- Устойчивость к изменениям: подстраивается под изменения структуры/стилей без постоянного обслуживания.

- Совместимость с разными сайтами: работает на разных типах страниц.

- Работа с динамикой: поддерживает JavaScript/AJAX-подгрузку.

- Мультимедиа: распознает изображения, видео и аудио.

- Обход антискрейпинга: ротация IP, решения CAPTCHA, прокси.

- Разумное потребление ресурсов: не «съедает» лишнюю память и вычисления.

Лучшие парсеры статей и новостей — кратко

| Инструменты | Ключевые возможности | Лучше всего подходит для | Цена |

|---|---|---|---|

| Thunderbit | парсер на базе AI; готовые шаблоны; поддержка парсинга PDF, изображений и документов; расширенные возможности обработки данных | Пользователей без технического бэкграунда, которым нужно собирать данные с множества нишевых сайтов | 7 дней бесплатно, от $9/мес (годовой план) |

| WebScraper.io | Расширение для браузера; поддержка динамического контента; нет встроенной интеграции прокси | Тем, кому не нужны сложные страницы и продвинутые функции | 7 дней бесплатно, от $40/мес (годовой план) |

| Browse.ai | No-code парсер и мониторинг; готовые «роботы»; виртуальный браузер; разные способы пагинации; сильные интеграции | Компаниям, которым нужен масштабный сбор со сложных сайтов | $19/мес (годовой план) |

| Octoparse | No-code парсер на CSS-селекторах; автоопределение и генерация сценария; готовые шаблоны для статей; виртуальный браузер; механизмы обхода антискрейпинга | Бизнесу для парсинга сложных сайтов | От $99/мес (годовой план) |

| Bardeen | Широкие возможности веб-автоматизации; готовые шаблоны; no-code парсер; удобная интеграция с рабочими инструментами | GTM-командам, которые встраивают парсинг статей в существующие процессы | 7 дней бесплатно, от $99/мес (годовой план) |

| PandaExtract | Дружелюбный интерфейс; автоопределение и разметка | Тем, кому нужен быстрый «в один клик» сбор без сложной настройки | $49 (LTD) |

Самый мощный AI-парсер статей для бизнес-пользователей

- Плюсы:

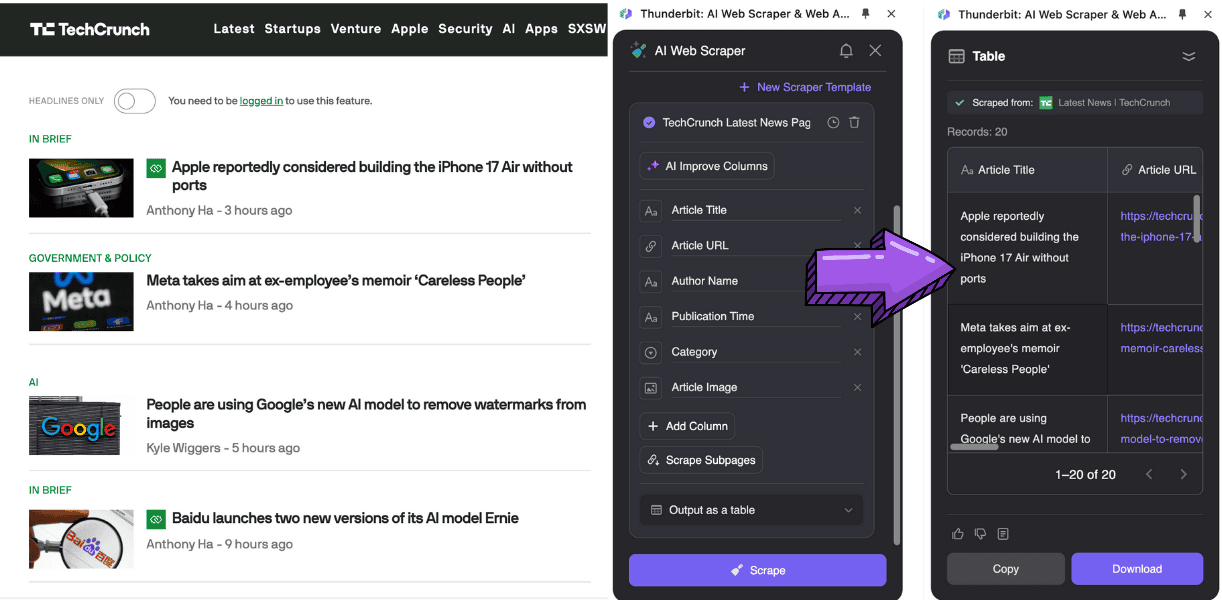

- Использует естественный язык для вызова AI-распознавания и анализа информации на странице — без CSS-селекторов

- AI-помощь в обработке данных: преобразование форматов, , классификация, перевод и теги

- — сбор списка и содержимого статей в один клик

- Минусы:

- Пока доступен только как

- Не лучший вариант для сверхкрупных объемов парсинга

- При сборе по множеству страниц может работать медленнее, но умеет парсить в фоне, чтобы быстрее получить результат

AI-парсер статей для корпоративных задач

Browse.ai

- Плюсы:

- No-code парсер статей и мониторинг изменений

- Поддерживает работу через виртуальный браузер, чтобы реже триггерить антискрейпинг

- Много готовых роботов для парсинга в один клик: , , и др.

- Глубокая интеграция с и для связки инструментов

- Минусы:

- Для deep extract нужно создавать двух роботов — процесс получается запутанным

- CSS-селекторы не всегда точны на нишевых сайтах

- Дорого; лучше подходит для непрерывного крупномасштабного сбора

No-code парсер для небольших задач

PandaExtract

- Плюсы:

- Сам распознает списки статей и страницы деталей; интерфейс дружелюбный

- Может извлекать списки, детали, email и изображения — удобно для небольшого структурированного сбора

- Разовая оплата за пожизненное использование

- Минусы:

- Только расширение для браузера — в облаке не запускается

- В бесплатной версии доступно только копирование, без экспорта в CSV/JSON и т. п.

Готовый «из коробки» парсер статей для организаций

Octoparse

- Плюсы:

- No-code парсер с автоопределением структуры страниц и генерацией сценария парсинга

- Много готовых шаблонов для парсинга статей — можно сразу использовать

- Виртуальный браузер, ротация IP, решения CAPTCHA и прокси для обхода антискрейпинга

- Минусы:

- Автоопределение все равно опирается на логику CSS-селекторов — точность средняя

- Продвинутые функции требуют обучения и технических навыков

- Для больших объемов парсинга выходит дорого

Самая комплексная автоматизация для GTM-команды

Bardeen

- Плюсы:

- No-code парсер статей с LLM и автоматизацией «в один клик»

- Интеграции с более чем 100 приложениями, включая , и

- Мощные инструменты веб-автоматизации для AI-аналитики после сбора данных

- Отлично подходит, чтобы встроить парсинг в существующие процессы

- Минусы:

- Сильно завязан на готовые playbooks; кастомные сценарии часто требуют экспериментов

- Хотя это no-code, настройка сложной автоматизации может занять время у нетехнических пользователей

- Настройка извлечения с подстраниц сложная

- Очень дорого

Легкий парсер статей для мгновенного извлечения данных

Webscraper.io

- Плюсы:

- No-code парсер с интерфейсом point-and-click

- Поддерживает динамическую загрузку контента

- Есть облачный режим

- Интеграции с , и

- Минусы:

- Нет готовых шаблонов — нужно вручную собирать sitemap

- Пользователям без опыта CSS-селекторов придется привыкать

- Сложная настройка пагинации и извлечения с подстраниц

- Облачная версия дорогая

Более продвинутые решения для инженеров

Если у тебя есть технический бэкграунд, можно посмотреть в сторону . Обычно такие решения дают:

- Гибкость: прямые API-вызовы под кастомный сбор, включая динамический рендеринг и ротацию IP

- Масштабируемость: встраивание в собственные пайплайны данных для корпоративных задач с высокой частотой и большими объемами

- Низкие затраты на поддержку: не нужно вручную рулить прокси-пулами и стратегиями обхода — экономит операционное время

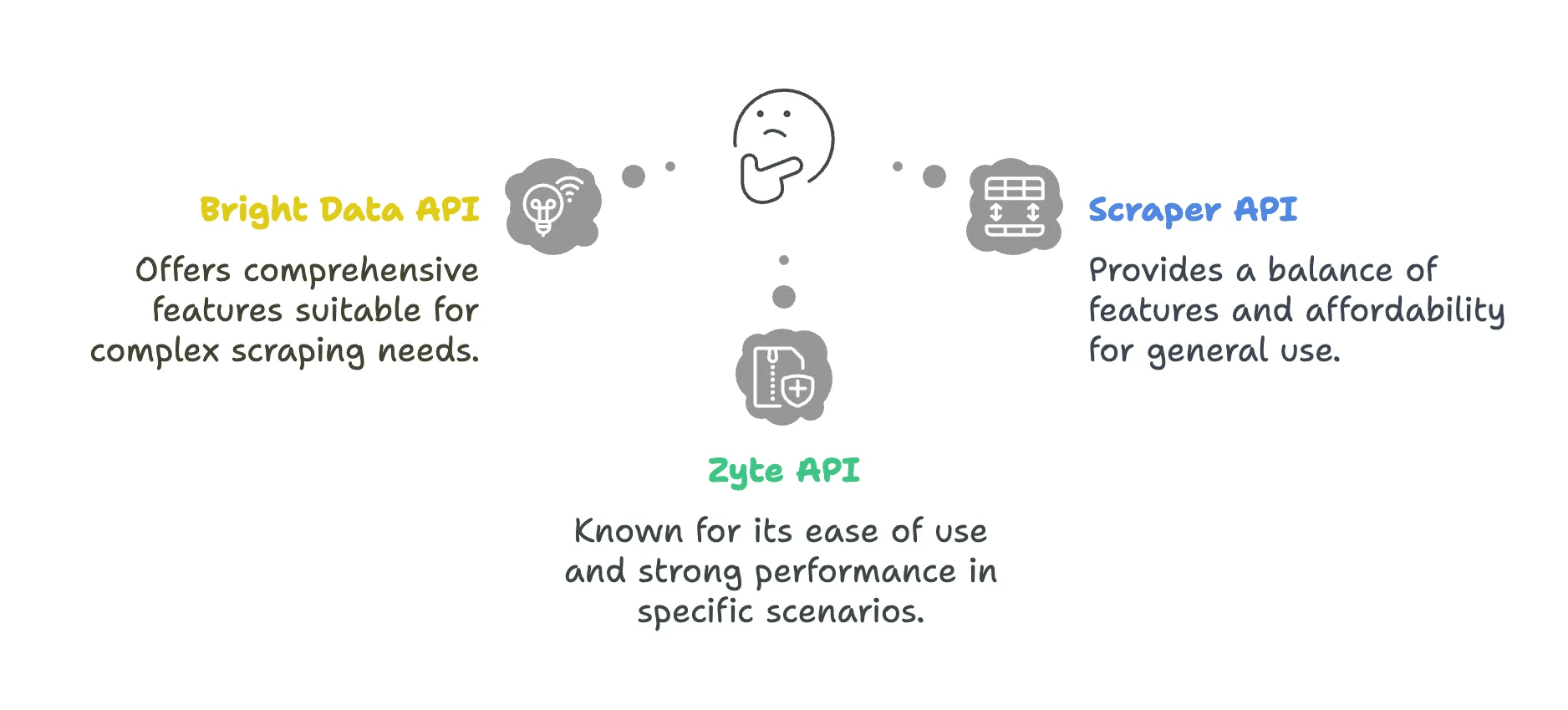

Краткое сравнение API-решений

| API | Плюсы | Минусы |

|---|---|---|

| Bright Data API | - Огромная прокси-сеть (72M+ IP в 195 странах) - Продвинутое геотаргетирование до уровня города/ZIP - Надежный Proxy Manager для ротации IP | - Более медленные ответы (в среднем 22.08 с) - Высокая цена, не подходит небольшим командам - Сложнее в настройке |

| ScraperAPI | - Низкий порог входа: $49 - Autoparse для автоматического извлечения данных - Веб-интерфейс для тестирования | - Часто списывает запросы даже при блокировках - Ограниченные возможности рендеринга JavaScript - Стоимость может резко вырасти при premium-параметрах |

| Zyte API | - AI-парсинг - Не берет оплату за неудачные запросы | - Высокая стартовая стоимость (~$450/мес) - Кредиты не переносятся на следующий месяц |

- Bright Data Web Scraper API

- Плюсы:

- 195 стран и 72M+ резидентских IP; автоматическая ротация и имитация геолокации — полезно для сайтов с жесткой защитой (например, , )

- Поддерживает динамическую загрузку через JavaScript и создание снимков страниц

- Минусы:

- Дорого (оплата за запросы и трафик); для небольших проектов окупаемость низкая

- Плюсы:

- Scraper API

- Плюсы:

- 40M прокси по миру; автоматическое переключение между дата-центровыми и резидентскими IP; обход проверки Cloudflare; интеграция сторонних CAPTCHA-решений (например, )

- Структурированные endpoints и асинхронные скрейперы для более высокой скорости

- Минусы:

- Динамический рендеринг оплачивается отдельно; ограниченная поддержка сложных AJAX-сайтов

- Плюсы:

- Zyte API

- Плюсы:

- Автоматическое извлечение данных с помощью AI — не нужно разрабатывать и поддерживать правила под каждый сайт

- Гибкая модель pay-as-you-go

- Минусы:

- Продвинутые функции (например, управление сессиями, скриптуемый браузер) требуют времени на освоение

- Плюсы:

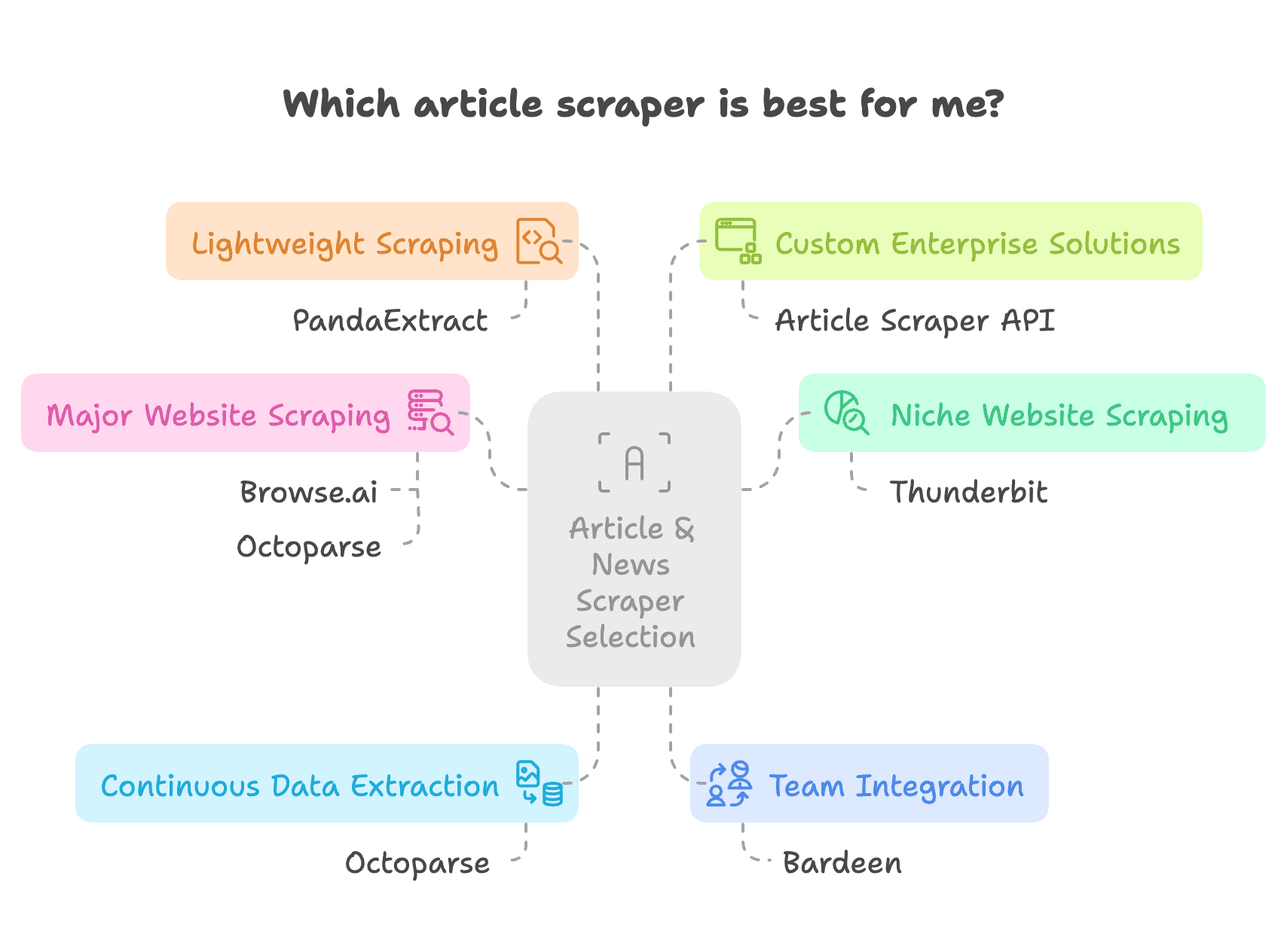

Как выбрать парсер статей и новостей?

Выбирая парсер статей и новостей, отталкивайся от задач бизнеса, технической подготовки и бюджета.

- Если тебе нужно собирать данные с множества нишевых сайтов без разработки отдельного парсера под каждую страницу и бюджет позволяет, лучший выбор — . Он не зависит от : AI анализирует структуру страниц и позволяет делать AI-обработку после сбора. Для Thunderbit AI все сайты «одинаковые», поэтому он уверенно вытаскивает статьи целиком.

- Для парсинга новостей и статей с крупных площадок вроде или нужен инструмент с сильным обходом антискрейпинга и готовыми шаблонами — например, Browse.ai или Octoparse. Но часто самый удобный вариант — расширение Chrome вроде : процесс сбора похож на обычный просмотр и копирование, поэтому можно использовать логин без сложной настройки.

- Если нужен непрерывный сбор в больших объемах, лучше зайдут инструменты с расписанием (например, Octoparse).

- Для командной работы и бесшовной интеграции в текущие процессы хорош Bardeen — у него много автоматизации помимо парсинга статей.

- Если нужен легкий парсер статей для небольших выгрузок и не хочется тратить время на обучение, выбирай point-and-click решения вроде PandaExtract.

- Если ты технический специалист или строишь корпоративный парсер, помимо этих стоит рассмотреть API-инструменты или разработку собственного парсера.

Итоги

В статье мы разобрали, что такое парсеры статей и новостей и как бизнес их использует. держатся на и требуют понимания и , особенно если сценарии не самые простые. Новое поколение опирается на семантическое понимание и визуальное распознавание, поэтому выигрывает у по устойчивости к изменениям верстки, переносимости между сайтами, работе с динамическим контентом, а также по последующей очистке и анализу данных.

Также мы собрали шесть полезных инструментов для парсинга статей/новостей и API-решения для разработчиков, сравнив их плюсы и минусы, подходящие масштабы данных, особенности сайтов и целевую аудиторию. Выбирая парсер новостных статей, ориентируйся на свои задачи и держи здоровый баланс между производительностью и стоимостью.

FAQs

1. Что такое AI-парсер статей и как он работает?

- Использует ИИ для анализа страниц и извлечения контента без CSS-селекторов.

- С высокой точностью определяет заголовки, авторов, даты публикации и основной текст.

- Автоматически удаляет рекламу, меню и другие нерелевантные элементы.

- Подстраивается под изменения структуры и работает на разных сайтах.

2. Чем AI-парсер лучше традиционных решений?

- Один инструмент может собирать контент с множества сайтов.

- Справляется с динамическими страницами на JavaScript и AJAX.

- Требует меньше ручной настройки и поддержки, чем CSS-парсеры.

- Часто дает дополнительные функции: суммаризация, перевод, анализ тональности.

3. Можно ли использовать Thunderbit для AI-парсинга статей без навыков программирования?

- Да. Thunderbit рассчитан на нетехнических пользователей и предлагает простой no-code интерфейс.

- AI автоматически находит и извлекает содержимое статей.

- Есть готовые шаблоны для быстрого и эффективного сбора.

- Данные можно экспортировать в CSV, JSON и Google Sheets.

Узнать больше: