Am avut nevoie să monitorizez peste 200 de surse de știri pentru articole în tendințe. Manual? Asta ar însemna o muncă cu normă întreagă. Un scraper tradițional? Se rupea de fiecare dată când un site își schimba aspectul.

Apoi am încercat extractoare AI de articole. Un click, date curate, fără CSS selectors. Diferența a fost uriașă.

Dacă ești jurnalist, specialist SEO sau cercetător și ai nevoie să extragi articole la scară mare, această comparație îți va salva mult timp și multe încercări și erori. Am testat atât scrapers tradiționale no-code, cât și variante bazate pe AI — iată ce funcționează cu adevărat.

Pe scurt

| Avantaje | Dezavantaje | Ideal pentru | |

|---|---|---|---|

| AI Article Scraper | - Poate extrage date din mai multe site-uri cu precizie ridicată - Elimină automat zgomotul - Se adaptează la schimbările din structura web - Suportă încărcarea conținutului dinamic - Cost redus de curățare a datelor | - Cost de calcul mai mare - Timp de procesare mai lung - Unele pagini pot necesita intervenție manuală - Poate declanșa mecanisme anti-scraping | - Extragerea conținutului complex sau dinamic (de ex., portaluri de știri, rețele sociale) - Colectare de date la scară mare |

| Traditional No-code Article Scraper | - Execuție rapidă - Cost mai mic - Consum redus de resurse locale și de server - Controlabilitate ridicată | - Întreținere frecventă din cauza schimbărilor în structura web - Nu poate extrage din mai multe site-uri simultan - Nu poate gestiona conținut dinamic - Cost mare de curățare a datelor | - Extragere rapidă, la scară mare, din pagini web statice simple - Resurse de calcul limitate, buget restrâns |

Ce este un extractor de articole? De ce contează un AI article scraper?

Un este un tip de care poate găsi și extrage informații precum titluri, autori, date de publicare, conținut, cuvinte-cheie, imagini și videoclipuri de pe site-urile de știri, organizându-le în formate structurate precum JSON, CSV sau Excel.

se bazează pe pentru a extrage conținutul în funcție de structura a unei pagini web. Totuși, această abordare are și minusuri:

- Lipsa universalității: Structuri web diferite necesită specifice pentru fiecare site, iar schimbările de structură le pot face ineficiente, necesitând actualizări frecvente.

- Incapacitatea de a gestiona conținutul dinamic: Multe site-uri folosesc AJAX sau JavaScript pentru a încărca conținutul, iar nu îl pot extrage direct.

- Procesare limitată a datelor: pot prelua doar fragmente fără curățare suplimentară a datelor, formatare, analiză semantică sau analiză de sentiment.

Aici intră în scenă .

Aici intră în scenă .

-

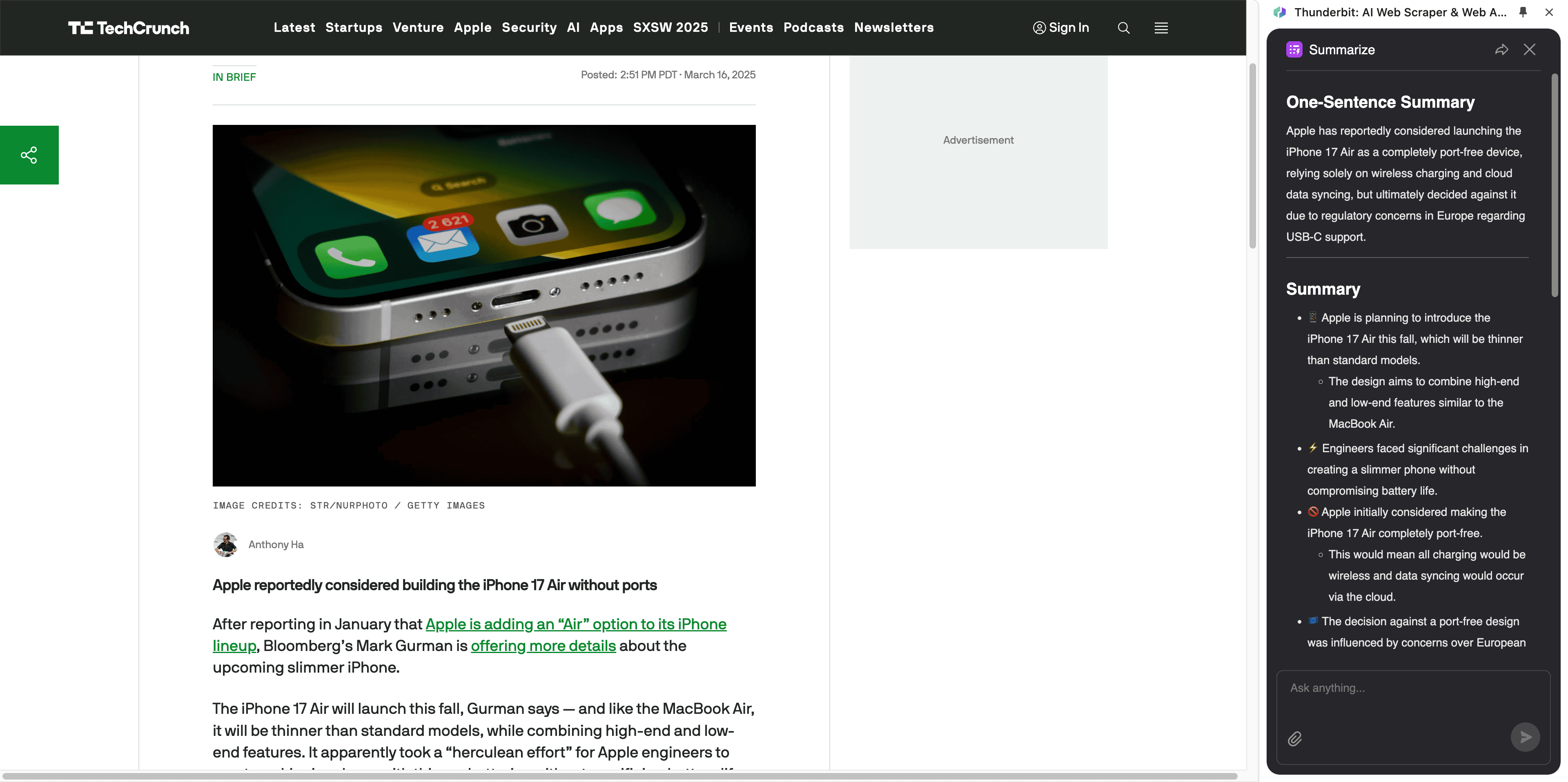

Această tehnologie folosește LLM pentru a înțelege paginile web, oferind:

- Recunoaștere inteligentă: identificarea titlurilor, autorilor, rezumatelor și conținutului principal.

- Eliminarea automată a zgomotului: diferențierea conținutului principal de navigație, reclame și articole conexe, îmbunătățind calitatea datelor și eficiența extragerii.

- Adaptabilitate la schimbările web: chiar dacă structurile sau stilurile web se schimbă, AI poate continua extragerea prin înțelegere semantică și caracteristici vizuale.

- Generalizare între site-uri: spre deosebire de , AI scrapers pot fi folosite pe site-uri diferite fără ajustări manuale.

- Integrare cu NLP și deep learning: finalizarea unor sarcini precum traducerea, rezumarea și analiza de sentiment.

Ce face cel mai bun extractor de articole în 2026?

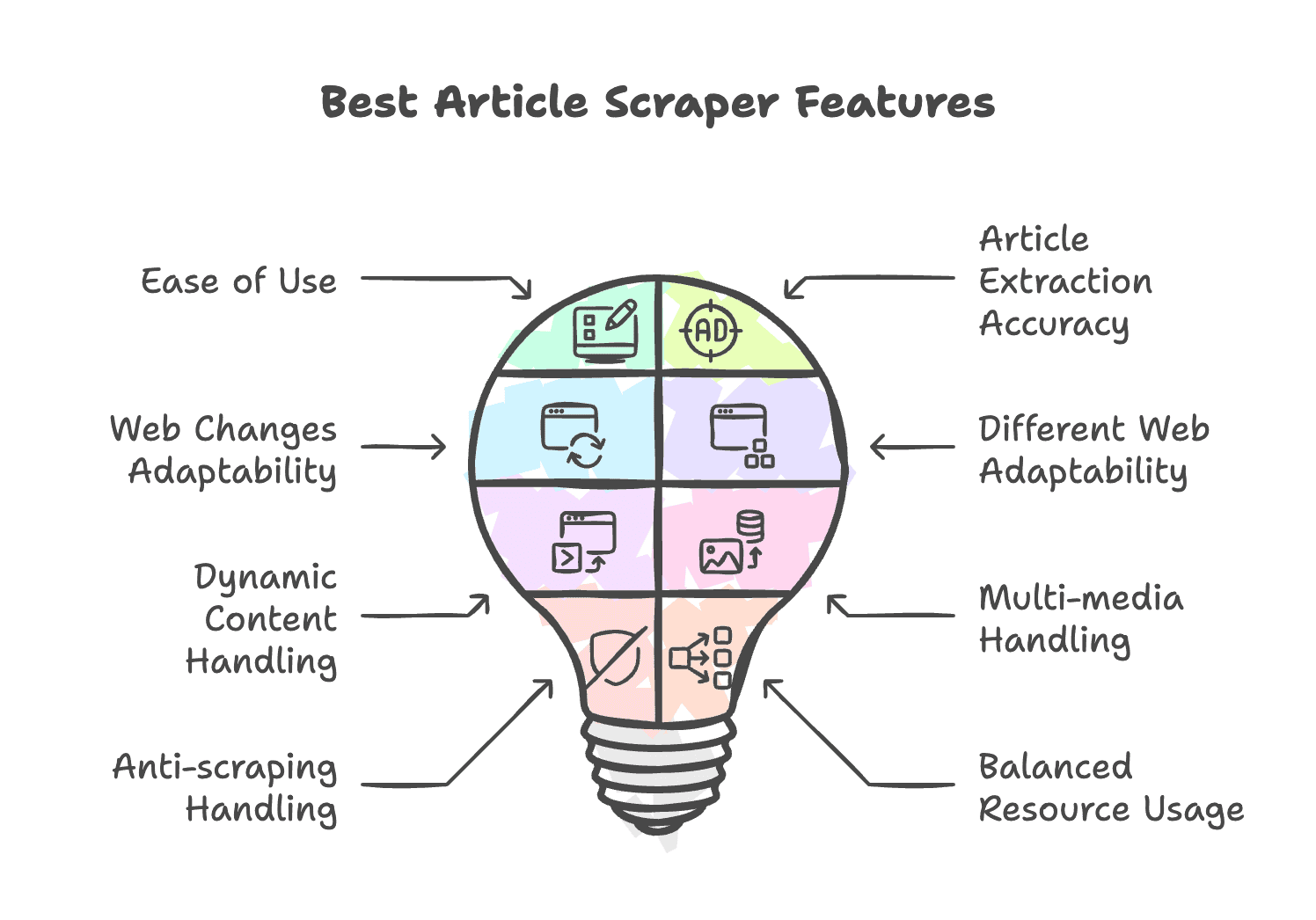

Un extractor de articole de top echilibrează performanța, costul, ușurința de utilizare, flexibilitatea și scalabilitatea. Iată criteriile pentru alegerea celui mai bun extractor de articole în 2026:

- Ușurință în utilizare: interfață intuitivă, fără cod.

- Acuratețea extragerii articolelor: identifică precis informațiile relevante, fără reclame sau navigație.

- Adaptabilitate la schimbările web: se adaptează automat la schimbările din structura sau stilul site-ului, fără întreținere frecventă.

- Adaptabilitate la site-uri diferite: funcționează pe diverse structuri web.

- Gestionarea conținutului dinamic: suportă încărcarea conținutului dinamic prin JavaScript sau AJAX.

- Gestionarea conținutului multimedia: recunoaște imagini, videoclipuri și audio.

- Gestionarea anti-scraping: folosește rotația IP-urilor, soluții CAPTCHA și proxy-uri pentru a ocoli mecanismele anti-scraping.

- Utilizare echilibrată a resurselor: nu consumă excesiv memorie și resurse de calcul.

Cele mai bune soluții de articole și știri, dintr-o privire

| Instrumente | Funcții cheie | Ideal pentru | Preț |

|---|---|---|---|

| Thunderbit | scraper bazat pe AI; șabloane predefinite; suport pentru extragerea PDF-urilor, imaginilor și documentelor; capabilități avansate de procesare a datelor | Utilizatori fără pregătire tehnică ce au nevoie să extragă date din mai multe site-uri de nișă | probă gratuită 7 zile, de la 9 USD/lună (plan anual) |

| WebScraper.io | extensie de browser; suport pentru conținut dinamic; fără integrare proxy | Utilizatori care nu lucrează cu pagini web complexe sau funcții avansate | probă gratuită 7 zile, de la 40 USD/lună (plan anual) |

| Browse.ai | scraper și monitor web no-code; roboți predefiniți; browser virtual; diverse metode de paginare; integrare puternică | Companii care au nevoie de extragerea la scară mare a site-urilor complexe | 19 USD/lună (plan anual) |

| Octoparse | scraper no-code bazat pe CSS selectors; detectare automată și generare de flux de lucru pentru scraping; șabloane predefinite pentru articole; browser virtual; mecanisme anti-anti-scraping | Companii care au nevoie de extragerea conținutului de pe site-uri complexe | De la 99 USD/lună (plan anual) |

| Bardeen | capabilități complete de automatizare web; șabloane predefinite; scraper no-code; integrare fluidă cu spațiul de lucru | Echipe GTM care integrează extragerea articolelor în fluxurile de lucru existente | probă gratuită 7 zile, de la 99 USD/lună (plan anual) |

| PandaExtract | interfață prietenoasă; detectare și etichetare automată | Utilizatori care au nevoie de extragere rapidă, cu un singur click, fără configurare complexă | 49 USD LTD |

Cel mai puternic AI article scraper pentru utilizatorii de business

- Avantaje:

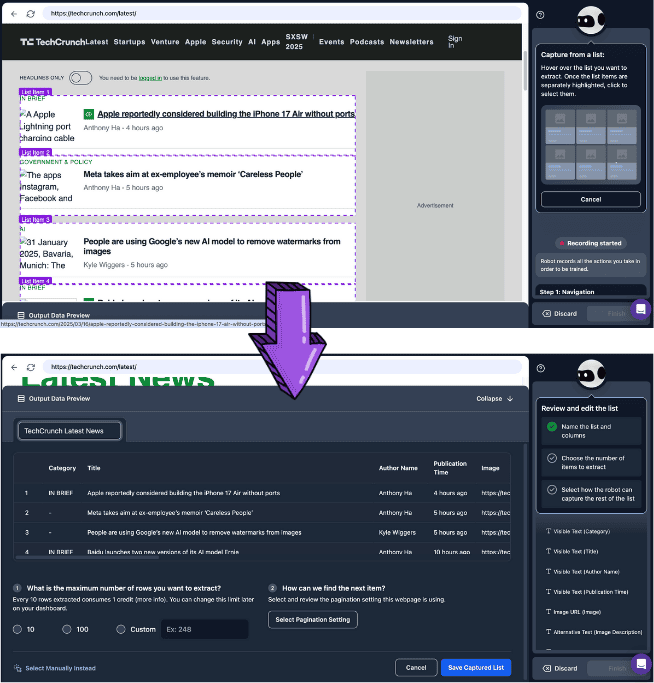

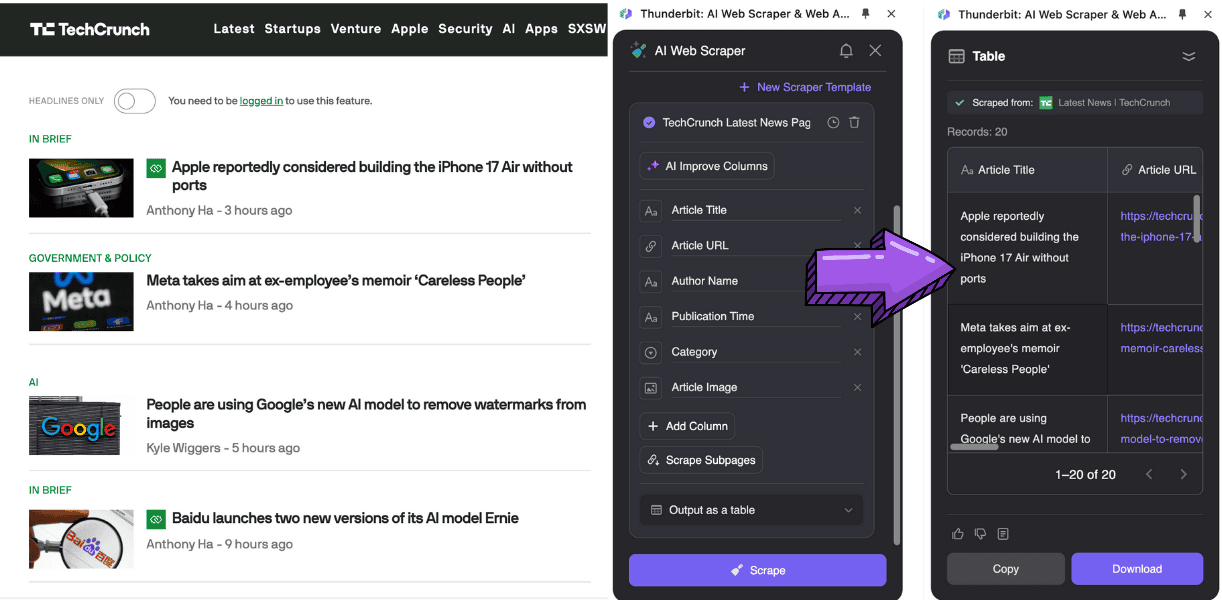

- Folosește limbajul natural pentru a apela AI în recunoașterea și analiza informațiilor web, eliminând CSS selectors

- Analiză de date asistată de AI, inclusiv conversie de format, , clasificare, traducere și etichetare

- pentru extragerea cu un singur click a listelor și conținutului articolelor

- Dezavantaje:

- În prezent este disponibil doar ca

- Nu este potrivit pentru extragerea datelor la scară mare

- Viteză mai mică pentru scraping pe mai multe pagini, dar poate rula în fundal pentru rezultate mai rapide

Un extractor de articole bazat pe AI pentru utilizare enterprise

Browse.ai

- Avantaje:

- Scraper și monitor de articole no-code

- Suportă operarea prin browser virtual pentru a evita declanșarea mecanismelor anti-scraping

- Numeroși roboți predefiniți pentru extragerea cu un singur click a , , și altele

- Integrare profundă cu platforme precum și pentru conectarea instrumentelor

- Dezavantaje:

- Folosirea deep extract necesită crearea a doi roboți, ceea ce complică procesul

- CSS selectors nu au precizie suficientă pentru site-urile de nișă

- Este scump, fiind mai potrivit pentru sarcini continue de extragere a datelor la scară mare

Un scraper no-code pentru extragerea datelor la scară mică

PandaExtract

- Avantaje:

- Identifică automat listele și detaliile articolelor, printr-o interfață ușor de folosit

- Poate extrage liste, detalii, emailuri și imagini, potrivit pentru scraping structurat la scară mică

- Plată unică pentru utilizare pe viață

- Dezavantaje:

- Disponibil doar ca extensie de browser, nu poate rula în cloud

- Versiunea gratuită permite doar copierea, nu și exportul în CSV, JSON etc.

Un extractor de articole gata de utilizare pentru organizații

Octoparse

- Avantaje:

- Scraper no-code pentru articole, cu detectare automată pentru recunoașterea structurii web și generarea fluxului de lucru de scraping

- Numeroase șabloane predefinite pentru extragerea articolelor, gata de utilizare

- Folosește browser virtual cu rotație IP, soluții CAPTCHA și proxy-uri pentru a ocoli mecanismele anti-scraping

- Dezavantaje:

- Detectarea automată se bazează încă pe logica CSS selectors, cu o precizie medie

- Funcțiile avansate necesită învățare și competențe tehnice

- Cost ridicat pentru extragerea datelor la scară mare

Cea mai completă automatizare pentru echipe GTM

Bardeen

- Avantaje:

- Scraper no-code pentru articole, folosind LLM pentru automatizare cu un singur click

- Se integrează cu peste 100 de aplicații, inclusiv , și

- Instrumente puternice de automatizare web pentru analiză AI după extragerea datelor

- Ideal pentru integrarea extragerii de date în fluxurile de lucru existente

- Dezavantaje:

- Depinde în mare măsură de playbook-uri predefinite, iar fluxurile personalizate necesită încercări și ajustări

- Deși este o platformă no-code, înțelegerea și configurarea automatizărilor complexe pot necesita timp de învățare pentru utilizatorii non-tehnici

- Configurarea extragerii pe subpagini este complexă

- Foarte scump

Un extractor de articole ușor pentru extragerea instantanee a datelor

Webscraper.io

- Avantaje:

- Scraper no-code cu interfață point-and-click

- Suportă încărcarea conținutului dinamic

- Funcționează în cloud

- Se integrează cu , și

- Dezavantaje:

- Nu are șabloane predefinite, necesitând crearea manuală a unui sitemap personalizat

- Curba de învățare pentru utilizatorii nefamiliarizați cu CSS selectors

- Configurare complexă pentru paginare și extragerea subpaginilor

- Versiunea cloud este scumpă

Soluții mai avansate pentru ingineri

Pentru cei cu pregătire tehnică, există . Aceste soluții oferă:

- Flexibilitate: apeluri API directe pentru scraping personalizat, cu suport pentru randare dinamică și rotație IP

- Scalabilitate: integrare în pipeline-uri personalizate de date pentru nevoi enterprise de volum mare și frecvență ridicată

- Cost redus de întreținere: nu trebuie să administrezi pool-uri de proxy-uri sau strategii anti-scraping, economisind timp operațional

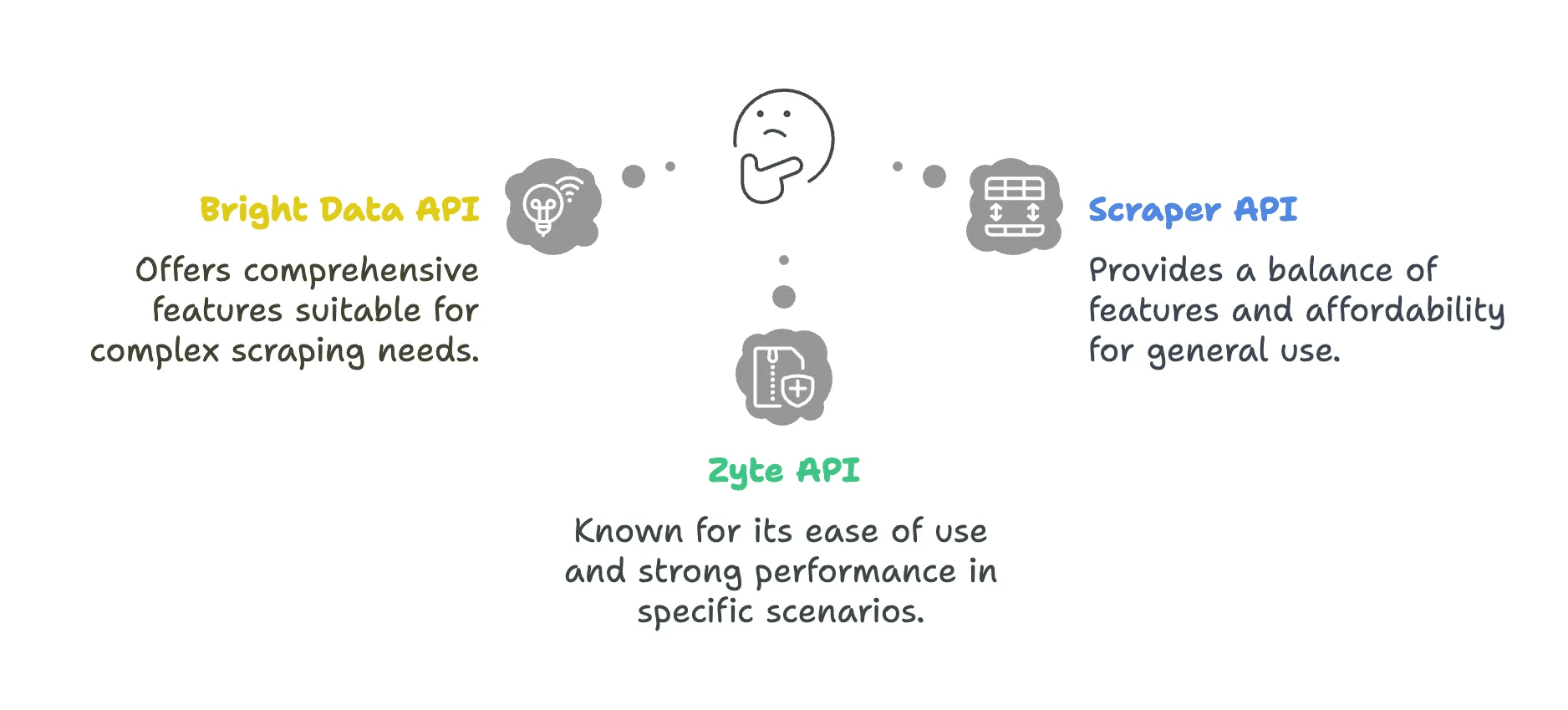

Soluții API, dintr-o privire

| API | Avantaje | Dezavantaje |

|---|---|---|

| Bright Data API | - Rețea extinsă de proxy-uri (peste 72M IP-uri în 195 de țări) - Geo-targeting avansat până la nivel de oraș/ZIP - Proxy Manager robust pentru rotația IP-urilor | - Timp de răspuns mai lent (22,08 secunde în medie) - Preț mai mare, nepotrivit pentru echipe mici - Curba de învățare mai abruptă pentru configurare |

| ScraperAPI | - Prag de intrare mai mic, de la 49 USD - Funcția Autoparse pentru extragerea automată a datelor - Player web UI pentru testare | - Taxează adesea cererile blocate - Funcții limitate de randare JavaScript - Costurile pot crește odată cu parametrii premium |

| Zyte API | - Capabilități de analiză AI - Nu taxează cererile eșuate | - Cost inițial mai mare (aprox. 450 USD/lună) - Creditele nu se reportează de la o lună la alta |

- Bright Data Web Scraper API

- Avantaje:

- Acoperă 195 de țări cu peste 72M IP-uri rezidențiale, suportă rotație automată a IP-urilor și simularea locației geografice, ideal pentru site-uri cu măsuri stricte anti-scraping (de ex., , )

- Suportă încărcarea conținutului dinamic prin JavaScript și capturarea snapshot-urilor paginii

- Dezavantaje:

- Cost ridicat (taxare per cerere și lățime de bandă), cu raport calitate-preț slab pentru proiecte mici

- Avantaje:

- Scraper API

- Avantaje:

- 40M de proxy-uri globale, comutare automată între IP-uri de data center și rezidențiale, ocolește verificarea Cloudflare, integrează soluții CAPTCHA terțe (de ex., )

- Endpoint-uri structurate și scrapers asincrone pentru o viteză mai mare de extragere

- Dezavantaje:

- Cost suplimentar pentru randarea paginilor dinamice, suport limitat pentru site-uri AJAX complexe

- Avantaje:

- Zyte API

- Avantaje:

- Extragere automată a datelor web cu AI, fără a dezvolta și întreține reguli de extragere pentru fiecare site

- Prețuri flexibile, pay-as-you-go

- Dezavantaje:

- Funcțiile avansate (de ex., gestionarea sesiunilor, browser scriptabil) necesită învățare

- Avantaje:

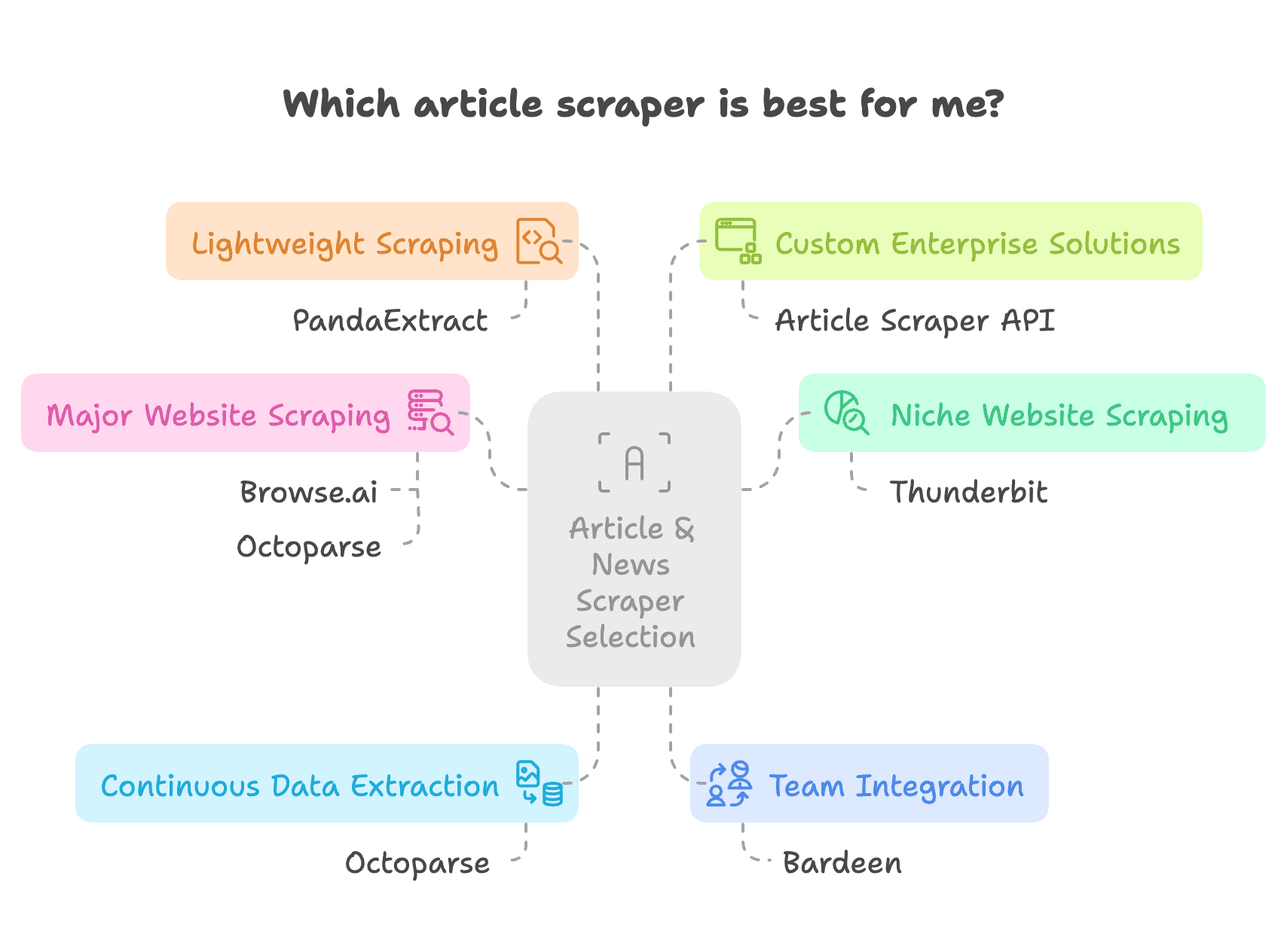

Cum alegi extractorul tău de articole și știri?

Când alegi un extractor de articole și știri, gândește-te la nevoile afacerii tale, la pregătirea tehnică și la buget.

- Dacă ai nevoie să extragi date din mai multe site-uri de nișă fără să construiești un scraper pentru fiecare pagină și ai un buget, este cea mai bună alegere. Nu se bazează pe , ci folosește AI pentru a analiza structurile web, permițând apoi analiză AI după extragerea datelor. Pentru Thunderbit AI, toate site-urile arată la fel, astfel că poate captura cu precizie articolele complete.

- Pentru extragerea știrilor și articolelor de pe site-uri mari precum sau , ai nevoie de un extractor de articole cu mecanisme anti-scraping solide și șabloane predefinite, precum Browse.ai sau Octoparse. Totuși, cea mai bună opțiune este o extensie Chrome precum : procesul de extragere imită navigarea și copierea făcute de o persoană, permițând autentificarea fără configurări complicate.

- Dacă ai nevoie de extragere continuă de date la scară mare, sunt mai potrivite instrumentele cu funcții de programare, precum Octoparse.

- Pentru utilizare în echipă și integrare fluentă în fluxurile de lucru existente, Bardeen este ideal, oferind o gamă largă de instrumente de automatizare web dincolo de extragerea articolelor.

- Dacă vrei un extractor de articole ușor, pentru extrageri mici, fără să pierzi timp învățând, alege un extractor point-and-click precum PandaExtract.

- Dacă ai pregătire tehnică sau construiești un extractor de articole pentru enterprise, ia în calcul instrumente API sau construiește-ți propriul scraper, pe lângă aceste .

Concluzie

Acest articol a introdus conceptul și scenariile de utilizare pentru extractoarele de articole și știri. se bazează pe , necesitând o anumită cunoaștere a și web, mai ales pentru operațiuni avansate. Noua generație de se bazează în întregime pe înțelegerea semantică și pe capacitățile de recunoaștere vizuală ale AI-ului, depășind în adaptarea la schimbările structurii web, generalizarea între site-uri, gestionarea conținutului dinamic și curățarea și analiza ulterioară a datelor.

Articolul a enumerat, de asemenea, șase extractoare de articole și știri utile, plus instrumente API pentru dezvoltatori, comparând avantajele și dezavantajele lor, scara de date potrivită, caracteristicile web și utilizatorii-țintă. Când iei în considerare extragerea articolelor și știrilor, alege soluția care se potrivește nevoilor afacerii tale, echilibrând în același timp performanța și costul.

Întrebări frecvente

1. Ce este un AI article scraper și cum funcționează?

- Folosește AI pentru a analiza și extrage conținut din pagini web fără a necesita CSS selectors.

- Identifică titluri, autori, date de publicare și conținutul principal cu precizie ridicată.

- Elimină automat reclamele, meniurile de navigare și alte elemente irelevante.

- Se adaptează la schimbările din structura web și funcționează pe site-uri diferite.

2. Care sunt avantajele folosirii unui extractor de articole bazat pe AI în locul celor tradiționale?

- Poate extrage conținut din mai multe site-uri cu un singur instrument.

- Gestionează conținutul dinamic, inclusiv paginile încărcate cu JavaScript și AJAX.

- Necesită mai puțină configurare manuală și întreținere decât scrapers bazate pe CSS.

- Oferă funcții suplimentare precum rezumarea, traducerea și analiza de sentiment.

3. Pot folosi Thunderbit pentru extragerea articolelor cu AI fără abilități de programare?

- Da, Thunderbit este conceput pentru utilizatorii non-tehnici, cu o interfață simplă, no-code.

- Folosește AI pentru a detecta și extrage automat conținutul articolelor.

- Oferă șabloane predefinite pentru extragere rapidă și eficientă.

- Permite exportul datelor în diverse formate precum CSV, JSON și Google Sheets.

Află mai multe: