„Poți avea date fără informații, dar nu poți avea informații fără date.” — *

Estimările recente arată că există peste de site-uri pe internet, cu aproximativ 2 milioane de postări noi publicate în fiecare zi. Acest ocean de date ascunde informații valoroase pentru luarea deciziilor, dar există o problemă: aproximativ dintre ele sunt nestructurate, ceea ce înseamnă că au nevoie de procesare suplimentară ca să poată fi folosite. Aici intră în scenă instrumentele de web scraping, care au devenit esențiale pentru oricine vrea să valorifice datele online.

Dacă ești la început cu web scraping-ul, termeni precum și pot părea puțin intimidanti. Dar, în era AI, astfel de provocări sunt mult mai ușor de depășit. Instrumentele de scraping bazate pe AI de azi te pot ajuta să începi fără cunoștințe tehnice avansate. Ele fac posibilă colectarea și procesarea rapidă a datelor, fără să ai nevoie de abilități de programare.

Cele mai bune instrumente și software de web scraping

- pentru un AI Web Scraper ușor de folosit, cu rezultate excelente

- pentru monitorizare în timp real și extragere de date în masă

- pentru automatizare fără cod, cu integrări extinse cu aplicații

- pentru un web scraping vizual, mai potrivit pentru utilizatori avansați

- pentru scraping puternic fără cod, care evită blocarea IP-ului și detectarea boturilor

- pentru API avansat de extragere a datelor cu AI și grafuri de cunoștințe

Încearcă AI pentru Web Scraping

Încearcă! Poți face clic, explora și rula fluxul de lucru în timp ce urmărești.

Cum funcționează web scraping-ul?

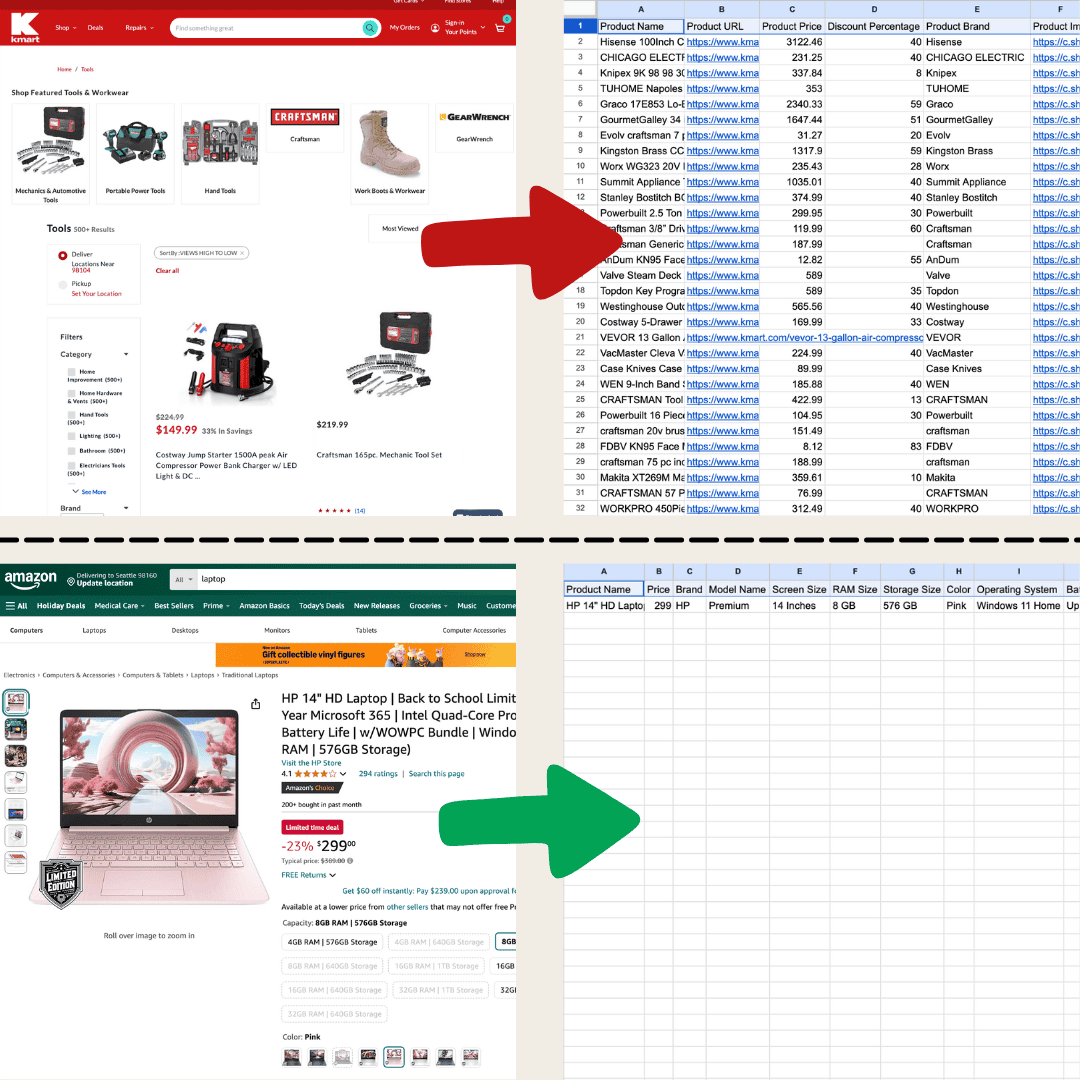

Web scraping-ul înseamnă, pe scurt, colectarea de date de pe site-uri. Dai unui instrument un set de instrucțiuni, iar acesta extrage text, imagini sau orice ai nevoie într-un tabel de pe o pagină web. Poate fi util în tot felul de situații, de la urmărirea prețurilor pe site-uri de e-commerce până la strângerea de date pentru cercetare sau chiar la construirea unui spreadsheet Excel bun ori a unor foi Google Sheets.

Am făcut asta cu Thunderbit folosind AI Web Scraper.

Am făcut asta cu Thunderbit folosind AI Web Scraper.

Există câteva moduri de a face asta. La cel mai simplu nivel, ai putea doar să copiezi și să lipești manual, dar asta cere multă muncă dacă ai de-a face cu un volum mare de date. Așa că majoritatea oamenilor folosesc una dintre trei metode: web scrapers tradiționali, AI web scrapers sau cod personalizat.

Web scrapers tradiționali funcționează prin stabilirea unor reguli precise despre ce date trebuie extrase, în funcție de structura paginii. De exemplu, poți seta instrumentul să preia numele produselor sau prețurile din anumite taguri HTML. Sunt cei mai buni pe site-uri care nu se schimbă prea des, deoarece orice ajustare de layout înseamnă că va trebui să revii și să îți modifici scraperul.

Folosirea unui scraper tradițional durează destul de mult până îl înveți, iar configurarea îți va lua probabil zeci de clicuri.

Folosirea unui scraper tradițional durează destul de mult până îl înveți, iar configurarea îți va lua probabil zeci de clicuri.

AI web scrapers înseamnă, în esență: ChatGPT citește întregul site și apoi extrage conținutul în funcție de nevoile tale. Poate face în același timp extragere de date, traducere și sumarizare. Folosesc procesarea limbajului natural pentru a analiza și înțelege structura site-ului, ceea ce înseamnă că se adaptează mai ușor la schimbările de pe pagină. Să zicem că site-ul își reorganizează puțin secțiunile — un AI web scraper s-ar putea ajusta fără să fie nevoie să rescrii nimic. De aceea sunt o alegere excelentă pentru site-uri care se schimbă des sau au structuri mai complexe.

AI Web Scraper este ușor de pornit și îți oferă date detaliate în doar câteva clicuri!

AI Web Scraper este ușor de pornit și îți oferă date detaliate în doar câteva clicuri!

Pe care ar trebui să-l alegi? Depinde. Dacă te descurci bine cu codul sau ai nevoie să colectezi volume mari de date de pe un site popular, scrapers tradiționali pot fi foarte eficienți. Dar dacă ești nou în web scraping sau vrei ceva care să țină pasul cu actualizările site-ului, AI web scrapers sunt de obicei alegerea mai bună. Verifică tabelul de mai jos pentru scenarii mai detaliate!

| Scenariu | Cea mai bună alegere |

|---|---|

| Scraping simplu pe pagini precum directoare, site-uri de cumpărături sau orice site cu o listă | AI Web Scraper |

| Pagina conține mai puțin de 200 de rânduri de date, iar construirea unui scraper cu un web scraper tradițional durează prea mult | AI Web Scraper |

| Datele pe care vrei să le extragi trebuie să aibă un anumit format pentru a fi încărcate în altă parte. De exemplu: extragerea informațiilor de contact pentru a le încărca în HubSpot. | AI Web Scraper |

| Site-uri folosite la scară largă, cum ar fi zeci de mii de pagini de produse Amazon sau listări imobiliare Zillow. | Traditional Web Scraper |

Cele mai bune instrumente și software de web scraping, pe scurt

| Instrument | Preț | Funcții cheie | Avantaje | Dezavantaje |

|---|---|---|---|---|

| Thunderbit | De la 9 $/lună, există și variantă gratuită | AI web scraper, detectează și formatează automat datele, suportă mai multe formate, export cu un singur clic, interfață ușor de folosit. | Fără cod, suport AI, integrări cu aplicații precum Google Sheets | Scraping-ul la scară mare poate fi lent, funcțiile avansate pot costa mai mult |

| Browse AI | De la 48,75 $/lună, există și variantă gratuită | Interfață fără cod, monitorizare în timp real, extragere de date în masă, integrare în fluxuri de lucru. | Ușor de folosit, se integrează cu Google Sheets și Zapier | Paginile complexe au nevoie de configurare suplimentară, scraping-ul în masă poate cauza timeout-uri |

| Bardeen AI | De la 60 $/lună, există și variantă gratuită | Automatizare fără cod, se integrează cu peste 130 de aplicații, MagicBox transformă sarcinile în fluxuri de lucru. | Integrări extinse, scalabil pentru business-uri | Curba de învățare este abruptă pentru utilizatorii noi, configurare consumatoare de timp |

| Web Scraper | Gratuit pentru utilizare locală, 50 $/lună pentru cloud | Creare vizuală a sarcinilor, suportă site-uri dinamice (AJAX/JavaScript), scraping în cloud. | Funcționează bine pe site-uri dinamice | Necesită cunoștințe tehnice pentru configurarea optimă |

| Octoparse | De la 119 $/lună, există și variantă gratuită | Scraping fără cod, autodetectarea elementelor paginii, scraping în cloud cu sarcini programate, bibliotecă de template-uri pentru site-uri comune. | Funcții puternice pentru site-uri dinamice, gestionează restricțiile | Site-urile complexe necesită timp pentru învățare |

| Diffbot | De la 299 $/lună | API de extragere a datelor, API fără reguli, NLP pentru text nestructurat, grafic de cunoștințe extins. | Extragere AI puternică, integrare API extinsă, scraping la scară mare | Curba de învățare pentru utilizatorii non-tehnici, timp de configurare |

Cel mai bun web scraper în era AI

Thunderbit este un instrument puternic și ușor de folosit pentru automatizarea web cu AI, care le permite utilizatorilor fără abilități de programare să extragă și să organizeze datele cu ușurință. Cu , de la Thunderbit simplifică extragerea datelor — utilizatorii pot prelua rapid date de pe web fără să interacționeze manual cu elementele paginii și fără să configureze scrapers separate pentru layout-uri diferite.

Funcții cheie

- Flexibilitate bazată pe AI: AI Web Scraper de la Thunderbit detectează și formatează automat datele web, eliminând nevoia de CSS selectors.

- Cea mai ușoară experiență de scraping: Tot ce trebuie să faci este să dai clic pe „AI suggest column” și apoi pe „Scrape” pe pagina din care vrei să extragi datele. Atât.

- Suport pentru diverse formate de date: Thunderbit poate extrage URL-uri, imagini și afișa datele capturate în mai multe formate.

- Procesare automată a datelor: AI-ul Thunderbit poate reformata datele din mers, inclusiv prin sumarizare, categorizare și traducere în formatul necesar.

- Export de date simplu: Exportă datele în Google Sheets, Airtable sau Notion cu un singur clic, simplificând gestionarea datelor.

- Interfață ușor de folosit: O interfață intuitivă îl face accesibil pentru utilizatori de orice nivel.

Preț

Thunderbit oferă planuri pe niveluri, începând de la 9 $ pe lună pentru 5.000 de credite. Ajunge până la 199 $ pentru 240.000 de credite. De asemenea, pentru planul anual, primești toate creditele în avans.

Avantaje:

- Suportul AI puternic simplifică extragerea și procesarea datelor.

- Fără cod, accesibil utilizatorilor de orice nivel.

- Perfect pentru scraping ușor, cum ar fi directoare, site-uri de cumpărături etc.

- Capacitate mare de integrare pentru export direct către aplicații populare.

Dezavantaje:

- Scraping-ul de date la scară mare poate dura ceva timp pentru a asigura acuratețea.

- Anumite funcții avansate pot necesita un abonament plătit.

Vrei mai multe informații? Începe prin sau descoperă cu Thunderbit.

Cel mai bun web scraper pentru monitorizarea datelor și extragerea în masă

Browse AI

Browse AI este un instrument robust de scraping de date fără cod, conceput pentru a ajuta utilizatorii să extragă și să monitorizeze date fără să scrie cod. Browse AI are câteva funcții AI, dar nu ajunge chiar la nivelul unui scraping AI complet. Totuși, îi ajută pe utilizatori să pornească mai ușor.

Funcții cheie

- Interfață fără cod: Le permite utilizatorilor să creeze fluxuri de lucru personalizate prin clicuri simple.

- Monitorizare în timp real: Folosește boți pentru a urmări schimbările paginilor web și pentru a livra informații actualizate.

- Extragere de date în masă: Poate gestiona până la 50.000 de înregistrări de date dintr-o dată.

- Integrare în fluxuri de lucru: Leagă mai mulți boți pentru procesare de date mai complexă.

Preț

Începe de la 48,75 $ pe lună, inclusiv 2.000 de credite. Există și o variantă gratuită, care oferă 50 de credite pe lună pentru a testa funcțiile de bază.

Avantaje:

- Oferă integrări cu Google Sheets și Zapier.

- Boții preconfigurați simplifică sarcinile comune de extragere a datelor.

Dezavantaje:

- Poate necesita configurare suplimentară pentru paginile complexe.

- Viteza scraping-ului în masă poate varia, ducând uneori la timeout-uri.

Cel mai bun web scraper pentru integrarea în fluxuri de lucru

Bardeen AI

Bardeen AI este un instrument de automatizare fără cod, conceput pentru a eficientiza fluxurile de lucru prin conectarea diferitelor aplicații. Deși folosește AI pentru a crea automatizări personalizate, îi lipsește adaptabilitatea unui instrument complet de AI Scraping.

Funcții cheie

- Automatizare fără cod: Le permite utilizatorilor să configureze fluxuri de lucru prin clicuri.

- MagicBox: Descrii sarcinile în limbaj simplu, iar Bardeen AI le transformă în fluxuri de lucru.

- Opțiuni largi de integrare: Se integrează cu peste 130 de aplicații, inclusiv Google Sheets, Slack și LinkedIn.

Preț

Începe de la 60 $ pe lună, cu 1.500 de credite (aproximativ 1.500 de rânduri de date). Varianta gratuită oferă 100 de credite lunar pentru a testa funcțiile de bază.

Avantaje:

- Opțiunile extinse de integrare susțin nevoi diverse de business.

- Flexibil și scalabil pentru companii de orice dimensiune.

Dezavantaje:

- Utilizatorii noi pot avea nevoie de timp pentru a învăța platforma completă.

- Configurarea inițială poate consuma mult timp.

Cel mai bun web scraper vizual pentru cei cu experiență

Web Scraper

Da, ai auzit bine: instrumentul chiar se numește „Web Scraper”. Web Scraper este o extensie populară de browser pentru Chrome și Firefox, care le permite utilizatorilor să extragă date fără cod, oferind o metodă vizuală de creare a sarcinilor de scraping. Totuși, s-ar putea să ai nevoie de câteva zile în care să urmărești și să înveți din tutorialele de mai sus ca să stăpânești cu adevărat acest instrument. Dacă vrei să faci scraping-ul mai ușor pentru creierul tău, alege AI Web Scraper.

Funcții cheie

- Creare vizuală: Le permite utilizatorilor să configureze sarcini de scraping dând clic pe elementele paginii.

- Suport pentru site-uri dinamice: Poate gestiona cereri AJAX și JavaScript pentru site-uri dinamice.

- Scraping în cloud: Programează sarcini prin Web Scraper Cloud pentru scraping periodic.

Preț

Gratuit pentru utilizare locală; planurile plătite încep de la 50 $/lună pentru funcțiile cloud.

Avantaje:

- Funcționează bine pentru site-uri dinamice.

- Gratuit pentru utilizare locală.

Dezavantaje:

- Necesită cunoștințe tehnice pentru o configurare optimă.

- Sunt necesare teste complexe atunci când apar modificări.

Cel mai bun web scraper care evită blocarea IP-ului și detectarea boturilor

Octoparse

Octoparse este un software versatil pentru utilizatorii mai tehnici, care doresc să colecteze și să monitorizeze anumite date web fără cod, ideal pentru nevoi de date la scară mare. Octoparse nu se bazează pe browserul utilizatorului pentru a funcționa; în schimb, folosește servere cloud pentru extragerea datelor. Așa că poate oferi diferite metode pentru a ocoli blocarea IP-ului și anumite mecanisme de detectare a boturilor de pe site-uri.

Funcții cheie

- Funcționare fără cod: Utilizatorii pot crea sarcini de scraping fără să scrie cod, ceea ce îl face accesibil persoanelor cu niveluri diferite de competență tehnică.

- Autodetectare inteligentă: Detectează automat datele din pagină, identificând rapid elementele disponibile pentru scraping și simplificând configurarea.

- Scraping în cloud: Suportă scraping de date în cloud 24/7, cu sarcini programate pentru extragere flexibilă a datelor.

- Bibliotecă extinsă de template-uri: Oferă sute de template-uri presetate, permițând utilizatorilor să acceseze rapid date de pe site-uri populare fără configurare complicată.

Preț

Planul de prețuri al Octoparse începe de la 119 $ pe lună, incluzând 100 de sarcini. Este disponibilă și o variantă gratuită cu 10 sarcini pe lună pentru a testa funcționalitatea de bază.

Avantaje:

- Funcțiile puternice susțin scraping-ul site-urilor dinamice cu adaptabilitate ridicată.

- Oferă soluții pentru gestionarea restricțiilor de scraping și a problemelor legate de conținutul dinamic.

Dezavantaje:

- Structurile complexe ale site-urilor pot necesita mai mult timp pentru configurare.

- Utilizatorii noi pot avea nevoie de timp pentru a învăța tehnicile de utilizare.

Cel mai bun web scraper pentru API avansat de extragere a datelor cu AI

Diffbot

Diffbot este un instrument avansat de extragere a datelor web care folosește AI pentru a transforma conținutul web nestructurat în date structurate. Cu API-uri puternice și un grafic de cunoștințe, Diffbot îi ajută pe utilizatori să extragă, să analizeze și să gestioneze informații de pe web, potrivite pentru diverse industrii și aplicații.

Funcții cheie

- API de extragere a datelor: Diffbot oferă un API de extragere a datelor fără reguli, permițând utilizatorilor să furnizeze pur și simplu un URL pentru extragerea automată a datelor, fără să mai fie nevoie de reguli personalizate pentru fiecare site.

- API de procesare a limbajului natural: Extrage entități structurate, relații și sentimente din text nestructurat, ajutând utilizatorii să își construiască propriile grafuri de cunoștințe.

- Grafic de cunoștințe: Diffbot are unul dintre cele mai mari grafuri de cunoștințe, conectând un volum extins de date despre entități, inclusiv detalii despre persoane și organizații.

Preț

Planul de prețuri Diffbot începe de la 299 $ pe lună, incluzând 250.000 de credite (echivalentul a aproximativ 250.000 de extrageri de pagini web bazate pe API).

Avantaje:

- Capacități puternice de extragere a datelor fără reguli, cu adaptabilitate ridicată.

- Opțiuni extinse de integrare prin API, ușor de conectat cu sistemele existente.

- Suportă scraping la scară mare, potrivit pentru aplicații la nivel enterprise.

Dezavantaje:

- Configurarea inițială poate necesita ceva timp de învățare pentru utilizatorii non-tehnici.

- Utilizatorii trebuie să scrie un program pentru a apela API-ul.

La ce poți folosi scrapers?

Dacă ești nou în web scraping, iată câteva cazuri populare de utilizare ca să te ajute să începi. Mulți oameni folosesc scrapers pentru a prelua listări de produse Amazon, pentru a extrage date imobiliare de pe Zillow sau pentru a aduna detalii despre afaceri din Google Maps. Dar asta e doar începutul — poți folosi Thunderbit pentru a colecta date de pe aproape orice site, simplificând sarcinile și economisind timp în fluxul tău zilnic de lucru. Fie că e vorba de cercetare, urmărirea prețurilor sau construirea de baze de date, web scraping-ul deschide nenumărate moduri de a pune datele internetului să lucreze pentru tine.

Întrebări frecvente

-

Este legal web scraping-ul?

De obicei, web scraping-ul este legal, dar trebuie să respecte termenii de utilizare ai site-ului și natura datelor accesate. Verifică întotdeauna politicile relevante și respectă ghidurile legale.

-

Am nevoie de abilități de programare ca să folosesc instrumente de web scraping?

Majoritatea instrumentelor prezentate aici nu necesită abilități de programare, dar instrumente precum Octoparse și Web Scraper pot fi folosite mai bine de cei care au cunoștințe de bază despre structura web și o gândire orientată spre programare.

-

Există instrumente gratuite de web scraping?

Da, există instrumente gratuite precum BeautifulSoup, Scrapy și Web Scraper, iar unele instrumente oferă și planuri gratuite cu funcții limitate.

-

Care sunt provocările comune în web scraping?

Printre provocările comune se numără gestionarea conținutului dinamic, CAPTCHA-urile, blocarea IP-ului și structurile HTML complexe. Instrumentele și tehnicile avansate pot rezolva eficient aceste probleme.

Află mai multe:

-

Folosește AI pentru a lucra fără efort.