Musiałem ogarniać monitoring ponad 200 źródeł newsów i wyłapywać trendujące artykuły. Ręcznie? To robota na pełen etat. Klasyczny scraper artykułów? Rozsypywał się za każdym razem, gdy serwis robił choćby mały lifting layoutu.

Potem wziąłem na warsztat scrapery artykułów newsowych oparte na AI. Jedno kliknięcie, czyste dane, zero dłubania w selektorach CSS. Różnica? Niebo a ziemia.

Jeśli jesteś dziennikarzem, SEO-wcem albo badaczem i musisz hurtowo pobierać artykuły, to zestawienie oszczędzi ci masę czasu i frustracji. Przetestowałem zarówno klasyczne scrapery no‑code, jak i te napędzane AI — i poniżej masz to, co realnie dowozi.

TL;DR

| Zalety | Wady | Najlepsze zastosowanie | |

|---|---|---|---|

| AI Article Scraper | - Wysoka skuteczność na wielu stronach jednocześnie - Automatycznie usuwa „szum” - Dostosowuje się do zmian w strukturze stron - Obsługuje dynamiczne ładowanie treści - Niski koszt czyszczenia danych | - Wyższy koszt obliczeniowy - Dłuższy czas przetwarzania - Część stron może wymagać ręcznej korekty - Może uruchamiać mechanizmy anty‑scrapingowe | - Zbieranie danych z serwisów złożonych lub dynamicznych (np. portale newsowe, social media) - Duże wolumeny danych |

| Traditional No-code Article Scraper | - Szybkie działanie - Niższy koszt - Małe zużycie zasobów serwera i komputera - Duża kontrola nad procesem | - Częsta konserwacja przez zmiany w strukturze stron - Brak możliwości scrapowania wielu serwisów naraz - Słaba obsługa treści dynamicznych - Wysoki koszt czyszczenia danych | - Szybkie, masowe pobieranie danych z prostych, statycznych stron - Ograniczone zasoby obliczeniowe i budżet |

Czym jest Article Scraper i dlaczego AI Article Scraper ma znaczenie?

to typ , który potrafi wyszukiwać i pobierać z serwisów informacyjnych dane takie jak tytuły, autorzy, daty publikacji, treść, słowa kluczowe, obrazy czy wideo, a potem układać je w uporządkowane formaty typu JSON, CSV albo Excel.

jadą głównie na , czyli wyciągają treści na podstawie struktury . Brzmi sensownie, ale w praktyce ma kilka konkretnych minusów:

- Brak uniwersalności: różne układy stron wymagają różnych , a każda zmiana w strukturze potrafi je „zabić” — co oznacza ciągłe poprawki.

- Problemy z treścią dynamiczną: sporo serwisów ładuje content przez AJAX albo JavaScript, czego nie ogarną bez dodatkowych obejść.

- Ograniczone przetwarzanie danych: wyciągają kawałki , ale nie dają z automatu czyszczenia, formatowania ani analizy semantycznej czy sentymentu.

Czas na .

Czas na .

-

Ta technologia wykorzystuje LLM do rozumienia stron, dzięki czemu dostajesz:

- Inteligentne rozpoznawanie: wykrywanie tytułów, autorów, streszczeń i głównej treści.

- Automatyczne usuwanie szumu: oddzielanie mięsa artykułu od nawigacji, reklam i sekcji „powiązane”, co podbija jakość danych i przyspiesza robotę.

- Odporność na zmiany na stronie: nawet jeśli zmieni się układ albo styl, AI nadal potrafi pobierać dane, bo rozumie znaczenie i bazuje też na cechach wizualnych.

- Uogólnianie między serwisami: w przeciwieństwie do , scrapery AI działają na różnych stronach bez ręcznego dopasowywania.

- Połączenie z NLP i deep learningiem: pozwala m.in. na tłumaczenie, streszczanie i analizę sentymentu.

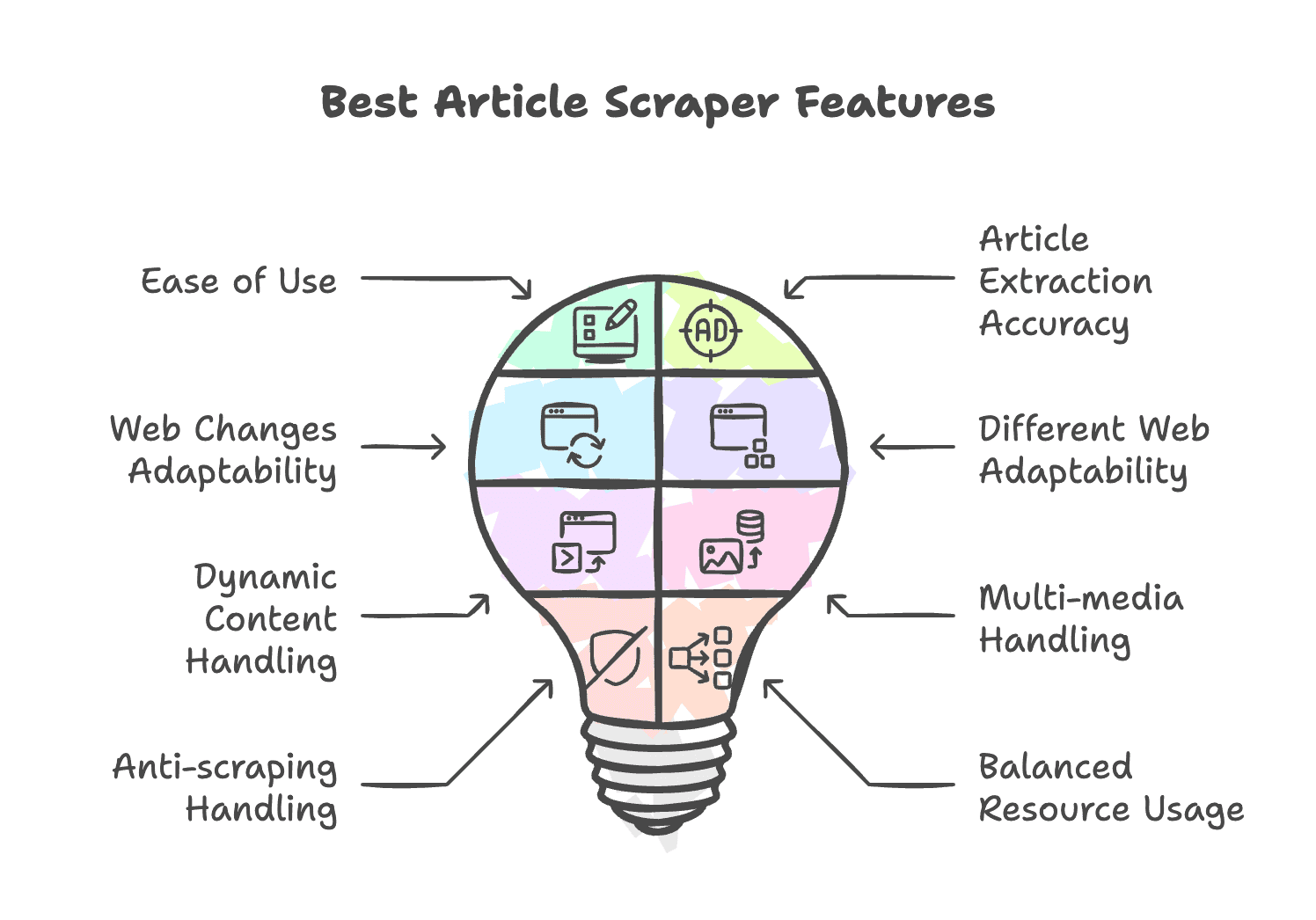

Co wyróżnia najlepszy Article Scraper w 2026 roku?

Dobry scraper artykułów to zawsze balans między wydajnością, kosztem, łatwością obsługi, elastycznością i skalowalnością. Oto, na co warto patrzeć, wybierając narzędzie w 2026 roku:

- Łatwość użycia: intuicyjny interfejs, bez kodowania.

- Dokładność ekstrakcji: precyzyjne wyłapywanie właściwych informacji bez reklam i elementów nawigacji.

- Odporność na zmiany: automatyczne dopasowanie do zmian w strukturze lub stylu bez ciągłej konserwacji.

- Dopasowanie do różnych stron: działanie na wielu typach struktur.

- Obsługa treści dynamicznych: wsparcie dla stron ładowanych przez JavaScript lub AJAX.

- Obsługa multimediów: rozpoznawanie obrazów, wideo i audio.

- Radzenie sobie z anty‑scrapingiem: rotacja IP, rozwiązywanie CAPTCHA i proxy.

- Zrównoważone zużycie zasobów: bez niepotrzebnego zjadania pamięci i mocy obliczeniowej.

Najlepsze narzędzia do scrapowania artykułów i newsów — szybki przegląd

| Narzędzia | Kluczowe funkcje | Najlepsze dla | Cennik |

|---|---|---|---|

| Thunderbit | scraper oparty na AI; gotowe szablony; wsparcie dla scrapowania PDF, obrazów i dokumentów; zaawansowane przetwarzanie danych | Osób nietechnicznych, które muszą zbierać dane z wielu niszowych serwisów | 7 dni za darmo, od 9 USD/mies. (plan roczny) |

| WebScraper.io | Rozszerzenie przeglądarki; obsługa treści dynamicznych; brak integracji z proxy | Użytkowników, którzy nie potrzebują zaawansowanych funkcji ani pracy na złożonych stronach | 7 dni za darmo, od 40 USD/mies. (plan roczny) |

| Browse.ai | Scraper i monitoring no‑code; gotowe roboty; wirtualna przeglądarka; różne metody paginacji; mocne integracje | Firm, które potrzebują masowego scrapowania złożonych serwisów | 19 USD/mies. (plan roczny) |

| Octoparse | Scraper no‑code oparty o selektory CSS; auto‑wykrywanie i generowanie workflow; gotowe szablony do artykułów; wirtualna przeglądarka; mechanizmy anty‑antyscrapingowe | Biznesów scrapujących złożone strony | Od 99 USD/mies. (plan roczny) |

| Bardeen | Rozbudowana automatyzacja webowa; gotowe szablony; scraper no‑code; integracja z narzędziami pracy | Zespołów GTM, które chcą wpiąć scrapowanie w istniejące procesy | 7 dni za darmo, od 99 USD/mies. (plan roczny) |

| PandaExtract | Przyjazny interfejs; automatyczne wykrywanie i etykietowanie | Osób, które chcą szybkiej ekstrakcji „jednym kliknięciem” bez konfiguracji | 49 USD (LTD) |

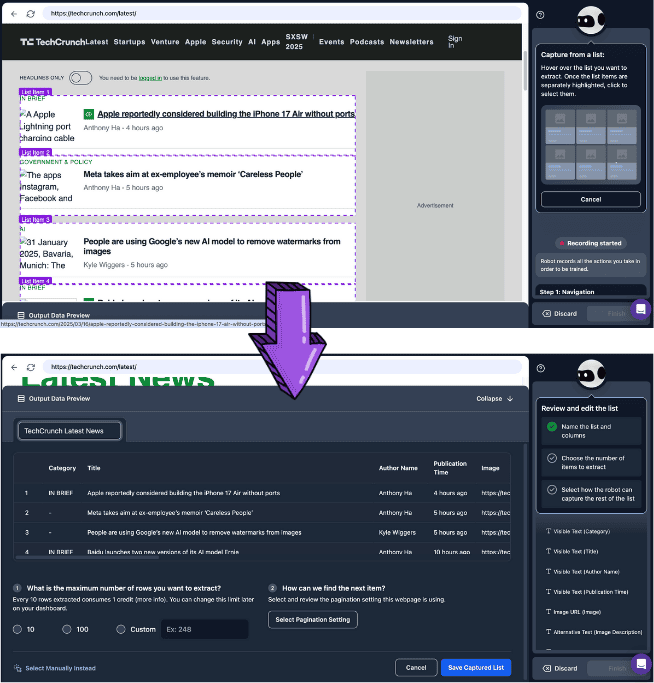

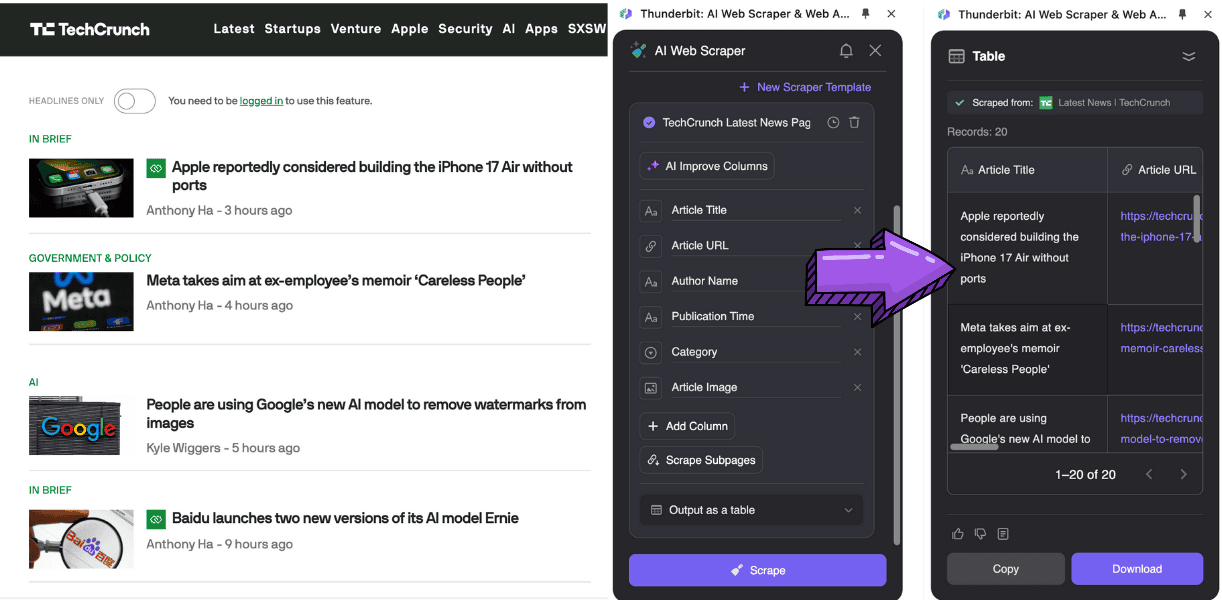

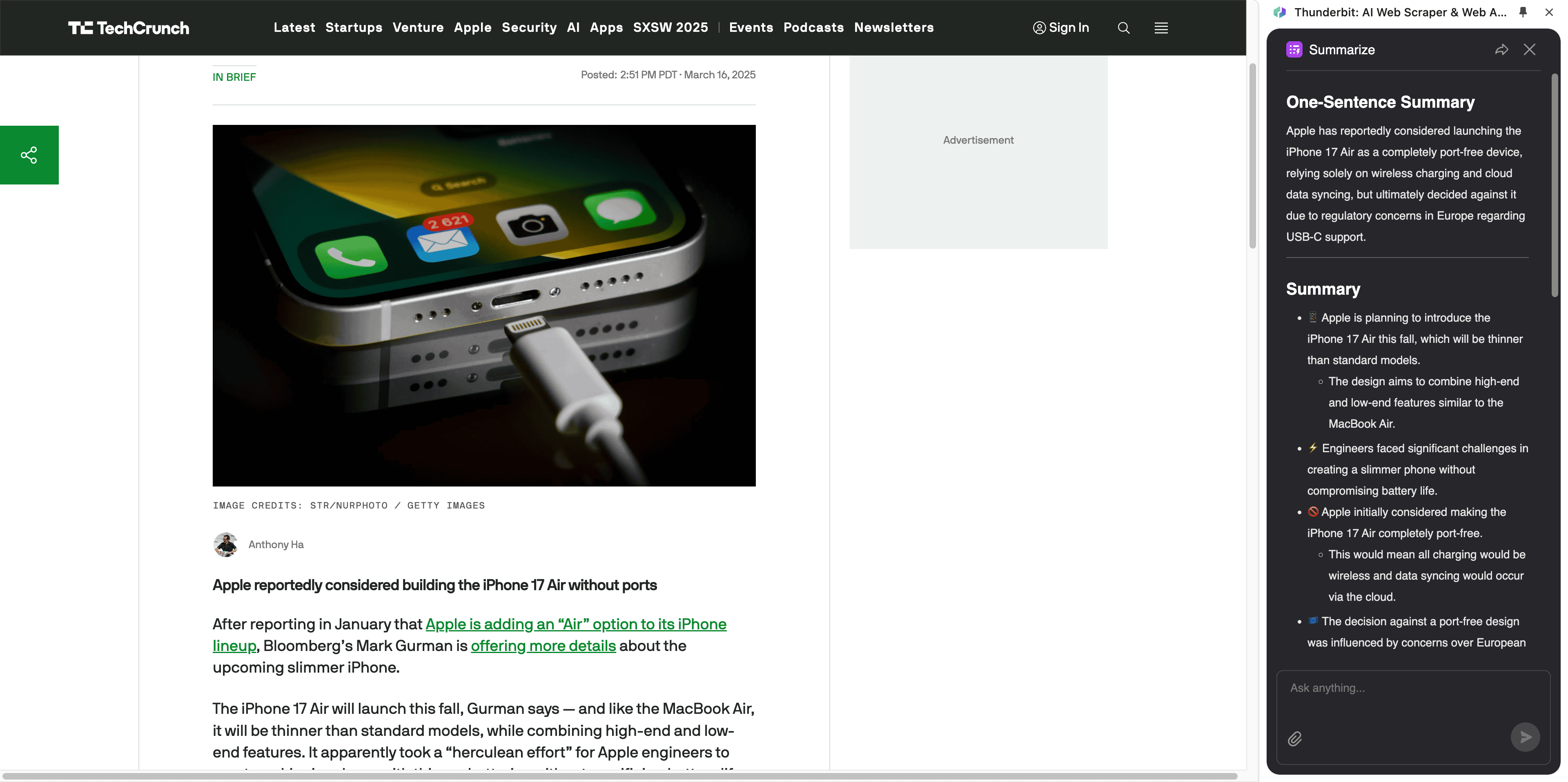

Najmocniejszy AI Article Scraper dla użytkowników biznesowych

- Zalety:

- Wykorzystuje język naturalny do uruchamiania AI rozpoznającej i analizującej informacje na stronie — bez selektorów CSS

- Analiza danych wspierana przez AI: konwersja formatów, , klasyfikacja, tłumaczenie i tagowanie

- do scrapowania list i pełnych treści jednym kliknięciem

- Wady:

- Na ten moment dostępny wyłącznie jako

- Nie jest najlepszym wyborem do bardzo dużej skali scrapowania danych

- Przy scrapowaniu wielu podstron bywa wolniejszy, ale może działać w tle, co przyspiesza uzyskanie wyników

AI Article Scraper dla zastosowań enterprise

Browse.ai

- Zalety:

- Scraper i monitoring artykułów no‑code

- Obsługa wirtualnej przeglądarki, co pomaga nie uruchamiać mechanizmów anty‑scrapingowych

- Wiele gotowych robotów do scrapowania jednym kliknięciem m.in. , , i innych

- Głęboka integracja z narzędziami typu i do łączenia procesów

- Wady:

- „Deep extract” wymaga tworzenia dwóch robotów, co komplikuje proces

- Selektory CSS bywają mało precyzyjne na niszowych stronach

- Wysoka cena — bardziej opłacalne przy ciągłych, dużych wolumenach

Scraper no‑code do małej skali ekstrakcji danych

PandaExtract

- Zalety:

- Automatycznie rozpoznaje listy artykułów i szczegóły w przyjaznym interfejsie

- Potrafi wyciągać listy, szczegóły, e‑maile i obrazy — dobre do małej skali ustrukturyzowanych danych

- Jednorazowa płatność za dożywotnie użycie

- Wady:

- Tylko jako rozszerzenie przeglądarki — bez uruchamiania w chmurze

- Wersja darmowa pozwala głównie kopiować dane, bez eksportu do CSV/JSON itd.

Gotowy do użycia Article Scraper dla organizacji

Octoparse

- Zalety:

- Scraper no‑code z auto‑wykrywaniem struktury strony i generowaniem workflow

- Dużo gotowych szablonów do scrapowania artykułów — start od razu

- Wirtualna przeglądarka z rotacją IP, rozwiązaniami CAPTCHA i proxy do omijania blokad

- Wady:

- Auto‑detect nadal bazuje na logice selektorów CSS, a skuteczność bywa przeciętna

- Funkcje zaawansowane wymagają nauki i pewnych umiejętności technicznych

- Przy dużej skali koszt robi się wysoki

Najbardziej kompleksowa automatyzacja dla zespołów GTM

Bardeen

- Zalety:

- Scraper artykułów no‑code wykorzystujący LLM do automatyzacji „jednym kliknięciem”

- Integruje się z ponad 100 aplikacjami, m.in. , i

- Mocne narzędzia automatyzacji webowej do analizy AI po zebraniu danych

- Świetny do wpinania scrapowania w istniejące procesy

- Wady:

- Duża zależność od gotowych playbooków; własne workflow często wymagają prób i błędów

- Mimo że to no‑code, złożone automatyzacje mogą wymagać czasu na naukę dla osób nietechnicznych

- Konfiguracja ekstrakcji z podstron jest skomplikowana

- Bardzo drogi

Lekki Article Scraper do natychmiastowej ekstrakcji danych

Webscraper.io

- Zalety:

- Scraper no‑code typu point‑and‑click

- Obsługuje dynamiczne ładowanie treści

- Działa w chmurze

- Integruje się z , i

- Wady:

- Brak gotowych szablonów — trzeba samodzielnie budować sitemapę

- Krzywa uczenia dla osób, które nie znają selektorów CSS

- Paginacja i ekstrakcja z podstron bywają trudne w konfiguracji

- Wersja chmurowa jest droga

Bardziej zaawansowane rozwiązania dla inżynierów

Dla osób technicznych są też . Takie podejście zwykle daje:

- Elastyczność: bezpośrednie wywołania API pod własne scenariusze, z renderowaniem dynamicznym i rotacją IP

- Skalowalność: łatwe wpięcie w własne pipeline’y danych dla potrzeb enterprise (wysoka częstotliwość i duże wolumeny)

- Niższy koszt utrzymania: bez zarządzania pulą proxy i strategiami anty‑scrapingowymi, co oszczędza czas operacyjny

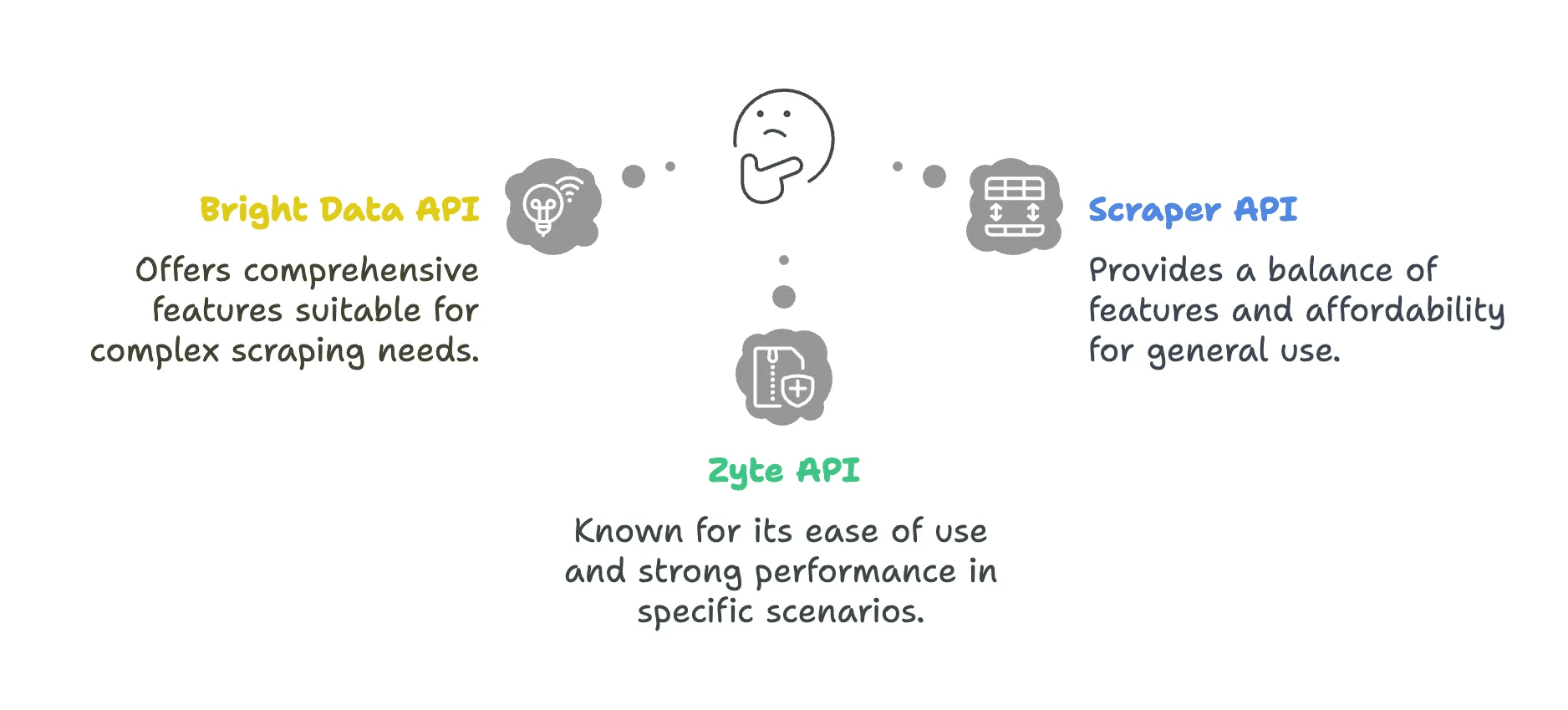

Przegląd rozwiązań API

| API | Zalety | Wady |

|---|---|---|

| Bright Data API | - Ogromna sieć proxy (72M+ IP w 195 krajach) - Zaawansowane geotargetowanie aż do poziomu miasta/kodu ZIP - Solidny Proxy Manager do rotacji IP | - Wolniejsze odpowiedzi (średnio 22,08 s) - Wyższe ceny, słabsze dla małych zespołów - Trudniejsza konfiguracja i większa krzywa uczenia |

| ScraperAPI | - Niższy próg wejścia od 49 USD - Funkcja autoparse do automatycznej ekstrakcji danych - Web UI player do testów | - Często nalicza opłaty za zablokowane żądania - Ograniczone renderowanie JavaScript - Koszty mogą rosnąć przy parametrach premium |

| Zyte API | - Parsowanie wspierane przez AI - Brak opłat za nieudane żądania | - Wyższy koszt startowy (~450 USD/mies.) - Niewykorzystane kredyty nie przechodzą na kolejny miesiąc |

- Bright Data Web Scraper API

- Zalety:

- 195 krajów i 72M+ domowych IP, automatyczna rotacja IP i symulacja lokalizacji — świetne dla serwisów z ostrym anty‑scrapingiem (np. , )

- Obsługa dynamicznego ładowania przez JavaScript oraz wykonywanie snapshotów stron

- Wady:

- Wysoki koszt (rozliczanie za request i transfer), mało opłacalne dla małych projektów

- Zalety:

- Scraper API

- Zalety:

- Globalnie 40M proxy, automatyczne przełączanie IP data center/domowe, omijanie weryfikacji Cloudflare, integracja z zewnętrznymi rozwiązaniami CAPTCHA (np. )

- Ustrukturyzowane endpointy i scrapery asynchroniczne dla szybszego działania

- Wady:

- Dodatkowe koszty renderowania stron dynamicznych, ograniczone wsparcie dla złożonych serwisów AJAX

- Zalety:

- Zyte API

- Zalety:

- Automatyczna ekstrakcja danych z sieci wspierana przez AI — bez budowania i utrzymywania reguł dla każdej strony

- Elastyczne rozliczanie pay‑as‑you‑go

- Wady:

- Funkcje zaawansowane (np. obsługa sesji, skryptowalna przeglądarka) wymagają nauki

- Zalety:

Jak wybrać scraper do artykułów i newsów?

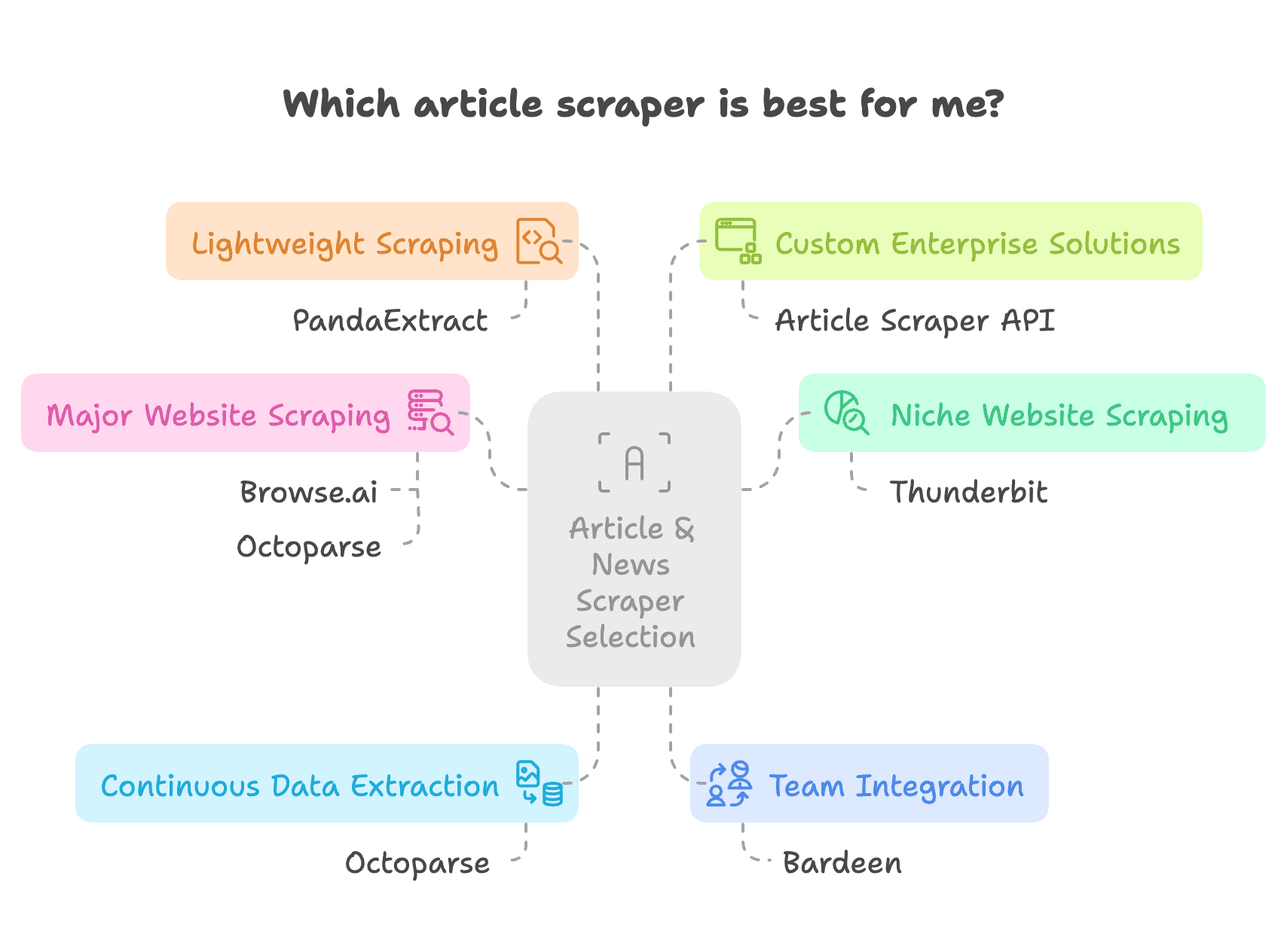

Wybierając narzędzie do scrapowania artykułów i newsów, dopasuj je do potrzeb biznesowych, zaplecza technicznego i budżetu.

- Jeśli chcesz zbierać dane z wielu niszowych serwisów bez stawiania osobnego scrapera dla każdej strony i masz na to budżet, będzie najlepszym wyborem. Nie jedzie na , tylko analizuje strukturę stron przez AI i pozwala też ogarniać analizę danych po zebraniu. Dla Thunderbit AI wszystkie strony są „podobne”, więc potrafi precyzyjnie przechwycić całe artykuły.

- Do pobierania newsów i artykułów z dużych serwisów typu czy przyda się narzędzie z mocnymi mechanizmami anty‑scrapingowymi i gotowymi szablonami, jak Browse.ai albo Octoparse. Ale najwygodniejszą opcją często jest rozszerzenie Chrome takie jak : scrapowanie przypomina zwykłe przeglądanie i kopiowanie, a logowanie działa bez kombinowania.

- Jeśli potrzebujesz ciągłego scrapowania na dużą skalę, lepiej sprawdzą się narzędzia z harmonogramami (np. Octoparse).

- Do pracy zespołowej i płynnego wpięcia w istniejące procesy świetny będzie Bardeen, bo daje szeroką automatyzację wykraczającą poza samo scrapowanie.

- Jeśli chcesz lekkie narzędzie do małej ekstrakcji danych i nie masz czasu na naukę, wybierz point‑and‑click, np. PandaExtract.

- Jeśli masz zaplecze techniczne albo budujesz rozwiązanie enterprise, rozważ narzędzia API lub własny scraper — obok tych .

Podsumowanie

W tym artykule rozłożyliśmy na czynniki pierwsze, czym są scrapery artykułów i newsów oraz kiedy biznesowo naprawdę się przydają. bazują na , więc wymagają choć podstawowej znajomości i , szczególnie przy bardziej zaawansowanych akcjach. Nowa fala korzysta z semantycznego rozumienia treści i rozpoznawania wizualnego, dzięki czemu wygrywa z pod kątem odporności na zmiany, uogólniania między serwisami, obsługi treści dynamicznych oraz późniejszego czyszczenia i analizy danych.

Zebraliśmy też sześć sensownych narzędzi do scrapowania artykułów i newsów oraz rozwiązania API dla developerów, porównując plusy i minusy, skalę danych, typy stron i grupy docelowe. Wybierając rozwiązanie, dopasuj je do swoich potrzeb biznesowych, trzymając równowagę między wydajnością a kosztami.

FAQ

1. Czym jest AI article scraper i jak działa?

- Wykorzystuje AI do analizy i ekstrakcji treści ze stron bez potrzeby używania selektorów CSS.

- Z dużą dokładnością rozpoznaje tytuły, autorów, daty publikacji i główną treść.

- Automatycznie usuwa reklamy, menu nawigacyjne i inne nieistotne elementy.

- Dostosowuje się do zmian w strukturze stron i działa na różnych serwisach.

2. Jakie są korzyści z używania scrapera AI zamiast tradycyjnych narzędzi?

- Jedno narzędzie może zbierać treści z wielu stron.

- Radzi sobie z treścią dynamiczną, w tym stronami ładowanymi przez JavaScript i AJAX.

- Wymaga mniej ręcznej konfiguracji i utrzymania niż scrapery oparte o CSS.

- Oferuje dodatki takie jak streszczanie, tłumaczenie i analiza sentymentu.

3. Czy mogę używać Thunderbit do scrapowania artykułów AI bez umiejętności programowania?

- Tak. Thunderbit jest zaprojektowany dla osób nietechnicznych i ma prosty interfejs no‑code.

- AI automatycznie wykrywa i wyciąga treść artykułów.

- Dostępne są gotowe szablony do szybkiego scrapowania.

- Dane można eksportować do formatów takich jak CSV, JSON czy Google Sheets.

Dowiedz się więcej: