„Możesz mieć dane bez informacji, ale nie możesz mieć informacji bez danych.” — *

Najnowsze szacunki pokazują, że w internecie jest ponad stron, a każdego dnia pojawia się około 2 milionów nowych wpisów. Ten ocean danych kryje wartościowe spostrzeżenia, które pomagają podejmować decyzje, ale jest jeden problem: około z nich ma postać nieustrukturyzowaną, więc zanim da się je wykorzystać, trzeba je jeszcze przetworzyć. I właśnie tu wchodzą do gry narzędzia do web scrapingu — stają się niezbędne dla każdego, kto chce pracować z danymi online.

Jeśli dopiero zaczynasz przygodę z web scrapingiem, pojęcia takie jak czy mogą brzmieć trochę onieśmielająco. Ale w erze AI te przeszkody są dużo łatwiejsze do pokonania. Dzisiejsze narzędzia scrapingowe oparte na AI pozwalają zacząć bez głębokiej wiedzy technicznej. Umożliwiają szybkie zbieranie i przetwarzanie danych — bez programowania.

Najlepsze narzędzia i oprogramowanie do web scrapingu

- — łatwy w obsłudze AI Web Scraper z najlepszymi wynikami

- — do monitorowania w czasie rzeczywistym i masowego pobierania danych

- — do automatyzacji bez kodowania z szerokimi integracjami aplikacji

- — bardziej profesjonalny wizualny web scraping

- — potężny scraper bez kodowania, omijający blokady IP i wykrywanie botów

- — zaawansowane API do ekstrakcji danych opartej na AI i grafy wiedzy

Wypróbuj AI w web scrapingu

Spróbuj! Możesz klikać, eksplorować i uruchamiać proces, obserwując go na żywo.

Jak działa web scraping?

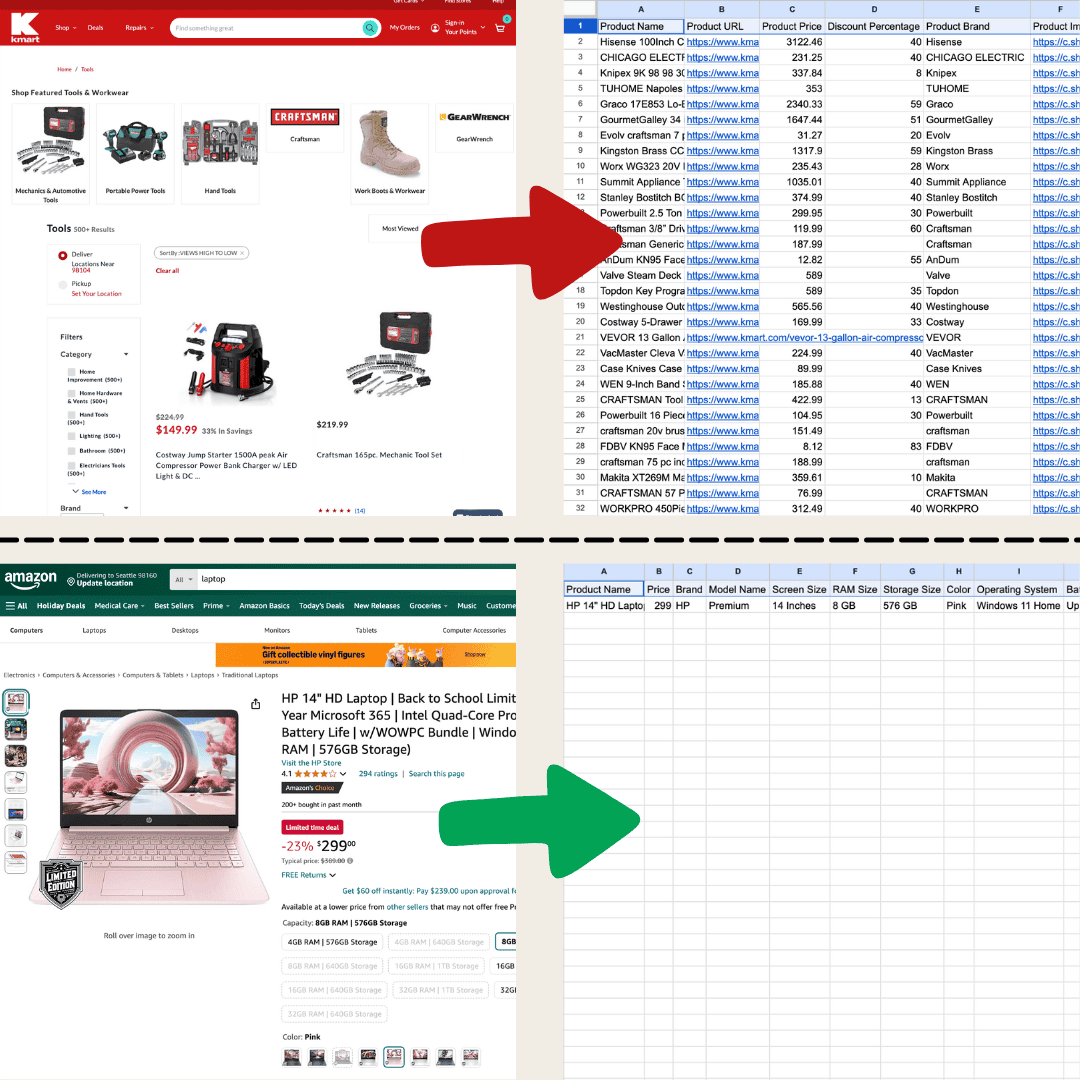

Web scraping polega po prostu na pobieraniu danych ze stron internetowych. Dajesz narzędziu zestaw instrukcji, a ono wyciąga tekst, obrazy albo inne potrzebne dane do tabeli z danej strony. Może się to przydać dosłownie do wszystkiego — od śledzenia cen w sklepach internetowych po zbieranie danych do badań, a nawet po prostu tworzenie porządnego arkusza w Excelu lub Google Sheets.

Zrobiłem to w Thunderbit, używając AI Web Scraper.

Zrobiłem to w Thunderbit, używając AI Web Scraper.

Da się to zrobić na kilka sposobów. Na najprostszym poziomie można po prostu kopiować i wklejać ręcznie, ale przy większej ilości danych to ogrom pracy. Dlatego większość osób korzysta z jednej z trzech metod: tradycyjnych scraperów webowych, AI web scraperów albo własnego kodu.

Tradycyjne web scrapery działają na podstawie ściśle określonych reguł dotyczących tego, jakie dane pobierać, zależnie od struktury strony. Na przykład można ustawić pobieranie nazw produktów lub cen z konkretnych tagów HTML. Najlepiej sprawdzają się na stronach, które nie zmieniają się zbyt często, bo nawet drobna zmiana układu oznacza, że trzeba wejść i dostosować scraper.

Nauka tradycyjnego scrapera zajmie sporo czasu, a konfiguracja prawdopodobnie pochłonie dziesiątki kliknięć.

Nauka tradycyjnego scrapera zajmie sporo czasu, a konfiguracja prawdopodobnie pochłonie dziesiątki kliknięć.

AI web scrapery działają w praktyce tak: ChatGPT czyta całą stronę, a potem wyciąga treści zgodnie z Twoimi potrzebami. Potrafią jednocześnie pobierać dane, tłumaczyć je i podsumowywać. Korzystają z przetwarzania języka naturalnego, żeby analizować i rozumieć układ strony, więc dużo lepiej radzą sobie ze zmianami w witrynie. Jeśli serwis lekko przestawi sekcje, AI web scraper może się dostosować bez przepisywania czegokolwiek. Dlatego świetnie nadają się do stron wymagających częstych poprawek albo tych o bardziej złożonej strukturze.

AI web scraper jest łatwy do uruchomienia i pozwala uzyskać szczegółowe dane w zaledwie kilku kliknięciach!

AI web scraper jest łatwy do uruchomienia i pozwala uzyskać szczegółowe dane w zaledwie kilku kliknięciach!

Który wybrać? To zależy. Jeśli dobrze czujesz się z kodem albo musisz zebrać duże ilości danych z popularnej strony, tradycyjne scrapery mogą być bardzo wydajne. Ale jeśli dopiero zaczynasz z web scrapingiem albo chcesz narzędzia, które poradzi sobie ze zmianami na stronie, AI web scrapery zwykle będą lepszym wyborem. Sprawdź tabelę poniżej, żeby zobaczyć bardziej konkretne scenariusze!

| Scenariusz | Najlepszy wybór |

|---|---|

| Lekkie scrapowanie na stronach takich jak katalogi, sklepy internetowe lub dowolna strona z listą | AI Web Scraper |

| Strona zawiera mniej niż 200 wierszy danych, a zbudowanie scrapera tradycyjnym narzędziem zajmuje zbyt dużo czasu | AI Web Scraper |

| Dane, które chcesz wyciągnąć, muszą mieć określony format, aby można je było załadować gdzie indziej. Na przykład: wyciągnięcie danych kontaktowych do importu do HubSpot. | AI Web Scraper |

| Popularne strony używane na dużą skalę, takie jak dziesiątki tysięcy stron produktów Amazon albo oferty nieruchomości Zillow | Tradycyjny Web Scraper |

Najlepsze narzędzia i oprogramowanie do web scrapingu w skrócie

| Narzędzie | Cena | Najważniejsze funkcje | Zalety | Wady |

|---|---|---|---|---|

| Thunderbit | Od 9 USD/mies., dostępny darmowy plan | AI web scraper, automatycznie wykrywa i formatuje dane, obsługuje wiele formatów, eksport jednym kliknięciem, przyjazny interfejs. | Bez kodu, wsparcie AI, integracje z aplikacjami takimi jak Google Sheets | Scrapowanie na dużą skalę może być wolne, zaawansowane funkcje mogą kosztować więcej |

| Browse AI | Od 48,75 USD/mies., dostępny darmowy plan | Interfejs bez kodowania, monitorowanie w czasie rzeczywistym, masowe pobieranie danych, integracja z workflow. | Łatwy w obsłudze, integruje się z Google Sheets i Zapier | Złożone strony wymagają dodatkowej konfiguracji, masowe scrapowanie może powodować przekroczenia czasu |

| Bardeen AI | Od 60 USD/mies., dostępny darmowy plan | Automatyzacja bez kodowania, integracje z ponad 130 aplikacjami, MagicBox zamienia zadania w workflow. | Szerokie integracje, skalowalny dla firm | Stroma krzywa uczenia dla nowych użytkowników, czasochłonna konfiguracja |

| Web Scraper | Darmowy do użytku lokalnego, 50 USD/mies. za chmurę | Wizualne tworzenie zadań, obsługa dynamicznych stron (AJAX/JavaScript), scrapowanie w chmurze. | Dobrze działa na dynamicznych stronach | Do najlepszego użycia wymaga wiedzy technicznej |

| Octoparse | Od 119 USD/mies., dostępny darmowy plan | Scrapowanie bez kodowania, automatyczne wykrywanie elementów strony, scrapowanie w chmurze z zadaniami według harmonogramu, biblioteka szablonów dla popularnych stron. | Potężne funkcje dla dynamicznych stron, radzi sobie z ograniczeniami | Złożone strony wymagają nauki |

| Diffbot | Od 299 USD/mies. | API do ekstrakcji danych, API bez reguł, NLP dla nieustrukturyzowanego tekstu, rozbudowany graf wiedzy. | Silna ekstrakcja AI, szerokie możliwości integracji API, scrapowanie na dużą skalę | Krzywa uczenia dla użytkowników nietechnicznych, czas konfiguracji |

Najlepszy web scraper w erze AI

Thunderbit to wydajne i przyjazne użytkownikowi narzędzie do automatyzacji webowej oparte na AI, które pozwala osobom bez umiejętności programowania łatwo wyciągać i porządkować dane. Dzięki od Thunderbit upraszcza proces scrapowania danych — użytkownicy mogą szybko pobierać dane ze stron bez ręcznej interakcji z elementami strony czy konfigurowania osobnych scraperów dla różnych układów.

Najważniejsze funkcje

- Elastyczność oparta na AI: AI Web Scraper Thunderbit automatycznie wykrywa i formatuje dane ze strony, eliminując potrzebę używania selektorów CSS.

- Najprostsze możliwe scrapowanie: Wystarczy kliknąć „AI suggest column”, a potem „Scrape” na stronie, z której chcesz pobrać dane. To wszystko.

- Obsługa różnych formatów danych: Thunderbit potrafi scrapować adresy URL, obrazy i prezentować pozyskane dane w wielu formatach.

- Automatyczne przetwarzanie danych: AI Thunderbit może na bieżąco przekształcać dane, w tym je podsumowywać, kategoryzować i tłumaczyć do wymaganego formatu.

- Łatwy eksport danych: Eksportuj dane do Google Sheets, Airtable lub Notion jednym kliknięciem, upraszczając zarządzanie danymi.

- Przyjazny interfejs: Intuicyjny interfejs sprawia, że narzędzie jest dostępne dla użytkowników o każdym poziomie zaawansowania.

Cena

Thunderbit oferuje plany warstwowe, zaczynające się od 9 USD miesięcznie za 5 000 kredytów. Najwyższy plan sięga 199 USD za 240 000 kredytów. W planie rocznym wszystkie kredyty otrzymujesz z góry.

Zalety:

- Mocne wsparcie AI upraszcza pobieranie i przetwarzanie danych.

- Bez kodu, dostępne dla użytkowników o każdym poziomie zaawansowania.

- Idealne do lekkiego scrapowania, np. katalogów, sklepów internetowych itp.

- Szerokie możliwości integracji i bezpośredniego eksportu do popularnych aplikacji.

Wady:

- Scrapowanie dużych zbiorów danych może zająć trochę czasu, jeśli zależy Ci na dokładności.

- Niektóre zaawansowane funkcje mogą wymagać płatnej subskrypcji.

Chcesz dowiedzieć się więcej? Zacznij od albo sprawdź z Thunderbit.

Najlepszy web scraper do monitorowania danych i masowej ekstrakcji

Browse AI

Browse AI to solidne narzędzie do scrapowania danych bez kodowania, stworzone z myślą o pobieraniu i monitorowaniu danych bez pisania ani jednej linijki kodu. Browse AI ma pewne funkcje AI, ale nie dorównuje jeszcze pełnoprawnemu AI scrapingowi. Mimo to ułatwia start i pozwala szybciej wejść w temat.

Najważniejsze funkcje

- Interfejs bez kodowania: Umożliwia tworzenie własnych workflow za pomocą prostych kliknięć.

- Monitorowanie w czasie rzeczywistym: Wykorzystuje boty do śledzenia zmian na stronach i dostarczania aktualnych informacji.

- Masowa ekstrakcja danych: Potrafi obsłużyć do 50 000 rekordów danych jednorazowo.

- Integracja z workflow: Łączy wiele botów dla bardziej złożonego przetwarzania danych.

Cena

Cena startuje od 48,75 USD miesięcznie, w tym 2 000 kredytów. Dostępny jest darmowy plan z 50 kredytami miesięcznie do przetestowania podstawowych funkcji.

Zalety:

- Oferuje integracje z Google Sheets i Zapier.

- Gotowe boty upraszczają typowe zadania ekstrakcji danych.

Wady:

- Może wymagać dodatkowej konfiguracji przy złożonych stronach.

- Szybkość masowego scrapowania bywa różna, czasem prowadząc do przekroczeń czasu.

Najlepszy web scraper do integracji workflow

Bardeen AI

Bardeen AI to narzędzie do automatyzacji bez kodowania, które usprawnia workflow, łącząc różne aplikacje. Choć wykorzystuje AI do tworzenia niestandardowych automatyzacji, nie ma takiej elastyczności jak pełnoprawne narzędzie do AI Scraping.

Najważniejsze funkcje

- Automatyzacja bez kodowania: Pozwala tworzyć workflow za pomocą kliknięć.

- MagicBox: Opisujesz zadania prostym językiem, a Bardeen AI zamienia je w workflow.

- Szerokie możliwości integracji: Integruje się z ponad 130 aplikacjami, w tym Google Sheets, Slack i LinkedIn.

Cena

Cena startuje od 60 USD miesięcznie i obejmuje 1 500 kredytów (około 1 500 wierszy danych). Darmowy plan oferuje 100 kredytów miesięcznie do testowania podstawowych funkcji.

Zalety:

- Szerokie możliwości integracji wspierają różne potrzeby biznesowe.

- Elastyczne i skalowalne rozwiązanie dla firm każdej wielkości.

Wady:

- Nowi użytkownicy mogą potrzebować czasu, by nauczyć się całej platformy.

- Początkowa konfiguracja może być czasochłonna.

Najlepszy wizualny web scraper dla osób z doświadczeniem

Web Scraper

Tak, dobrze słyszysz: narzędzie naprawdę nazywa się „Web Scraper”. Web Scraper to popularne rozszerzenie do przeglądarek Chrome i Firefox, które umożliwia pobieranie danych bez kodowania, oferując wizualny sposób tworzenia zadań scrapowania. Jednak być może trzeba będzie poświęcić kilka dni na oglądanie materiałów i naukę, żeby w pełni opanować to narzędzie. Jeśli chcesz, żeby scraping był prosty w użyciu, wybierz AI Web Scraper.

Najważniejsze funkcje

- Tworzenie wizualne: Pozwala ustawiać zadania scrapowania poprzez klikanie elementów strony.

- Obsługa dynamicznych stron: Radzi sobie z żądaniami AJAX i JavaScript na stronach dynamicznych.

- Scraping w chmurze: Umożliwia planowanie zadań przez Web Scraper Cloud do cyklicznego scrapowania.

Cena

Darmowy do użytku lokalnego; płatne plany zaczynają się od 50 USD/mies. za funkcje chmurowe.

Zalety:

- Dobrze działa na dynamicznych stronach.

- Darmowy do użytku lokalnego.

Wady:

- Do optymalnej konfiguracji wymaga wiedzy technicznej.

- Zmiany wymagają dokładnych testów.

Najlepszy web scraper omijający blokady IP i wykrywanie botów

Octoparse

Octoparse to wszechstronne oprogramowanie dla bardziej technicznych użytkowników, które pozwala bez kodowania zbierać i monitorować określone dane ze stron internetowych — idealne przy dużych potrzebach danych. Octoparse nie działa w oparciu o przeglądarkę użytkownika; zamiast tego korzysta z serwerów chmurowych do scrapowania danych. Dzięki temu oferuje różne metody omijania blokad IP i niektórych mechanizmów wykrywania botów na stronach.

Najważniejsze funkcje

- Obsługa bez kodowania: Użytkownicy mogą tworzyć zadania scrapowania bez pisania kodu, co czyni narzędzie dostępnym dla osób o różnym poziomie technicznym.

- Inteligentne automatyczne wykrywanie: Automatycznie wykrywa dane na stronie, szybko identyfikuje elementy dostępne do scrapowania i upraszcza konfigurację.

- Scraping w chmurze: Obsługuje całodobowe scrapowanie danych w chmurze z zadaniami według harmonogramu, zapewniając elastyczne pobieranie danych.

- Rozbudowana biblioteka szablonów: Oferuje setki gotowych szablonów, pozwalając szybko pobierać dane z popularnych stron bez skomplikowanej konfiguracji.

Cena

Plan cenowy Octoparse zaczyna się od 119 USD miesięcznie i obejmuje 100 zadań. Dostępny jest także darmowy plan z 10 zadaniami miesięcznie do testowania podstawowych funkcji.

Zalety:

- Potężne funkcje wspierają scrapowanie dynamicznych stron z dużą elastycznością.

- Oferuje rozwiązania problemów związanych z ograniczeniami scrapowania i dynamiczną treścią.

Wady:

- Złożone struktury stron mogą wymagać więcej czasu na konfigurację.

- Nowi użytkownicy mogą potrzebować czasu, by nauczyć się obsługi.

Najlepszy web scraper do zaawansowanego API ekstrakcji danych opartej na AI

Diffbot

Diffbot to zaawansowane narzędzie do ekstrakcji danych webowych, które wykorzystuje AI do przekształcania nieustrukturyzowanych treści ze stron w dane strukturalne. Dzięki potężnym API i grafowi wiedzy Diffbot pomaga użytkownikom wyciągać, analizować i zarządzać informacjami z sieci, sprawdzając się w różnych branżach i zastosowaniach.

Najważniejsze funkcje

- API do ekstrakcji danych: Diffbot oferuje API do ekstrakcji danych bez reguł, pozwalając po prostu podać URL, a dane zostaną pobrane automatycznie — bez konieczności ustawiania własnych reguł dla każdej strony.

- API przetwarzania języka naturalnego: Wyciąga ze złożonego tekstu ustrukturyzowane encje, relacje i wydźwięk emocjonalny, pomagając użytkownikom budować własne grafy wiedzy.

- Graf wiedzy: Diffbot ma jeden z największych grafów wiedzy, łączących rozbudowane dane o encjach, w tym informacje o osobach i organizacjach.

Cena

Plan cenowy Diffbota zaczyna się od 299 USD miesięcznie i obejmuje 250 000 kredytów (co odpowiada około 250 000 ekstrakcjom stron opartym na API).

Zalety:

- Silne możliwości ekstrakcji danych bez reguł z dużą elastycznością.

- Rozbudowane opcje integracji API, ułatwiające łączenie z istniejącymi systemami.

- Obsługuje scrapowanie na dużą skalę, odpowiednie dla zastosowań enterprise.

Wady:

- Początkowa konfiguracja może wymagać trochę czasu na naukę u użytkowników nietechnicznych.

- Aby korzystać z API, trzeba napisać program wywołujący.

Do czego możesz używać scraperów?

Jeśli dopiero zaczynasz z web scrapingiem, oto kilka popularnych zastosowań, które pomogą Ci ruszyć z miejsca. Wiele osób używa scraperów do pobierania list produktów Amazon, wyciągania danych o nieruchomościach z Zillow albo zbierania informacji biznesowych z Google Maps. Ale to dopiero początek — możesz użyć Thunderbit , aby zbierać dane z niemal każdej strony, usprawniając zadania i oszczędzając czas w codziennym workflow. Niezależnie od tego, czy chodzi o badania, śledzenie cen czy budowanie baz danych, web scraping otwiera mnóstwo sposobów na wykorzystanie danych z internetu.

FAQ

-

Czy web scraping jest legalny?

Web scraping jest zazwyczaj legalny, ale trzeba przestrzegać regulaminu strony oraz uwzględniać charakter pobieranych danych. Zawsze sprawdzaj odpowiednie zasady i przestrzegaj wymogów prawnych.

-

Czy do korzystania z narzędzi do web scrapingu potrzebuję umiejętności programowania?

Większość opisanych tutaj narzędzi nie wymaga umiejętności programowania, ale w przypadku narzędzi takich jak Octoparse i Web Scraper przydatna może być podstawowa znajomość struktury stron internetowych oraz podejście „programistyczne”, by korzystać z nich optymalnie.

-

Czy są darmowe narzędzia do web scrapingu?

Tak, dostępne są darmowe narzędzia, takie jak BeautifulSoup, Scrapy i Web Scraper, a niektóre z nich oferują też bezpłatne plany o ograniczonych funkcjach.

-

Jakie są najczęstsze wyzwania w web scrapingu?

Do najczęstszych wyzwań należą dynamiczna treść, CAPTCHA, blokady IP i złożone struktury HTML. Zaawansowane narzędzia i techniki potrafią skutecznie sobie z nimi poradzić.

Dowiedz się więcej:

-

Korzystaj z AI bez żadnego wysiłku.