Heb je ooit geprobeerd om data te verzamelen van een website die pas laadt als je naar beneden scrolt, prijzen achter een login verstopt of steeds zijn layout verandert? Dan weet je hoe frustrerend dat kan zijn. Met een simpele webscraper kom je er tegenwoordig niet meer. Sterker nog, meer dan vertrouwt inmiddels op webscraping voor alternatieve data, en automatiseert het monitoren van concurrentieprijzen. Maar hier zit het venijn: het grootste deel van die data staat op dynamische websites, geladen via JavaScript en verstopt achter gebruikersacties. Daar komt browserautomatisering zonder interface—en tools als Puppeteer—om de hoek kijken.

Na jaren ervaring met het bouwen van automatiserings- en AI-tools (en ja, ook heel wat websites gescrapet voor sales- en operationele teams), heb ik zelf gezien hoe Puppeteer data kan ontsluiten die traditionele webscrapers missen. Maar ik weet ook dat code schrijven voor veel zakelijke gebruikers een flinke drempel is. In deze gids leg ik uit wat een Puppeteer-webscraper is, hoe je het inzet voor webscraping, en wanneer je misschien beter voor iets nóg laagdrempeligers kiest—zoals , onze AI-gedreven, no-code webscraper.

Wat is een Puppeteer Scraper? Een korte introductie

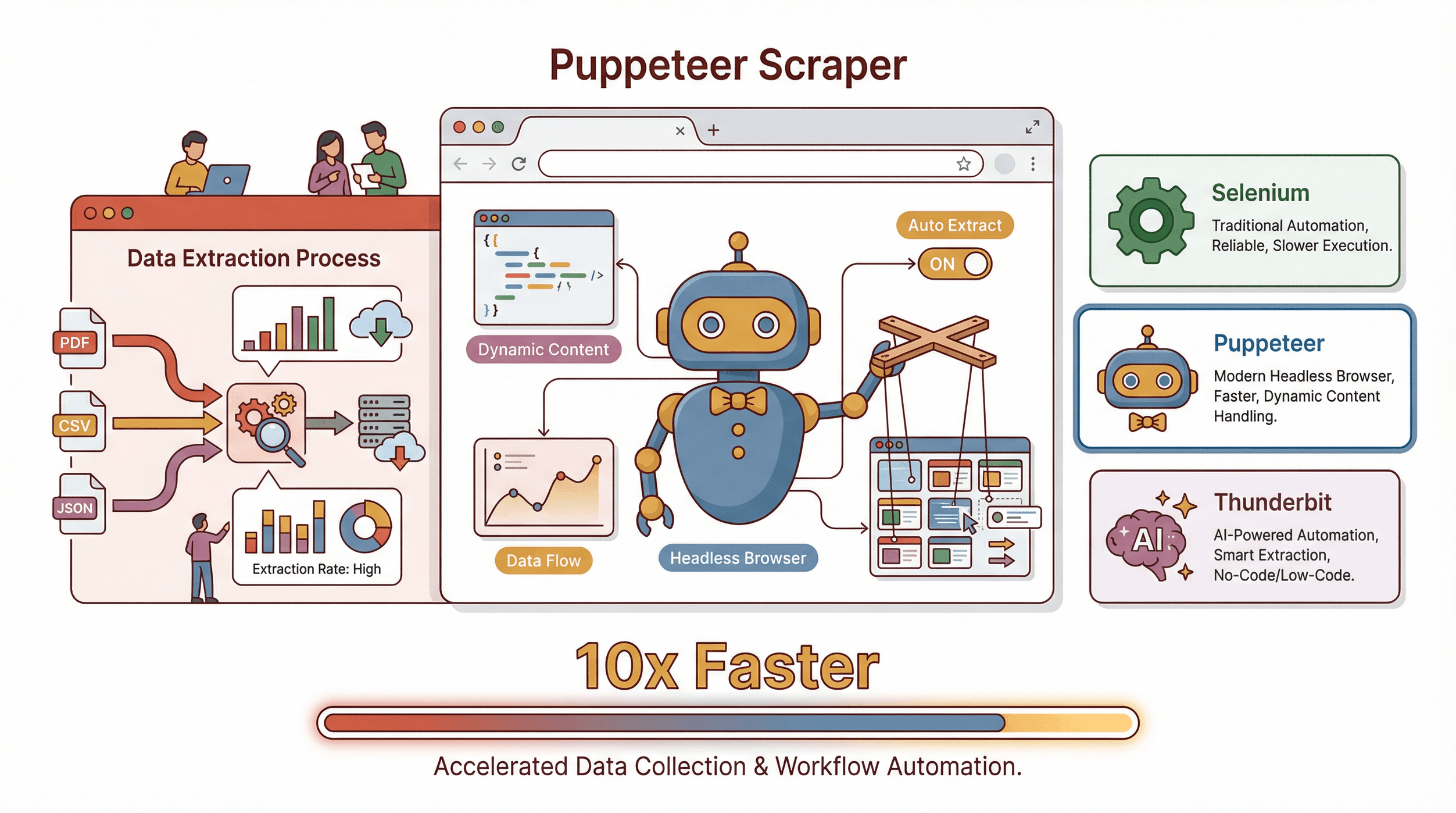

Laten we bij het begin beginnen. is een open-source Node.js-bibliotheek van Google waarmee je een headless Chrome- of Chromium-browser kunt aansturen met JavaScript. Simpel gezegd: het is alsof je een digitale assistent hebt die webpagina’s opent, op knoppen klikt, formulieren invult, scrolt en—het belangrijkste—data ophaalt, zonder dat je iets op je scherm ziet.

Laten we bij het begin beginnen. is een open-source Node.js-bibliotheek van Google waarmee je een headless Chrome- of Chromium-browser kunt aansturen met JavaScript. Simpel gezegd: het is alsof je een digitale assistent hebt die webpagina’s opent, op knoppen klikt, formulieren invult, scrolt en—het belangrijkste—data ophaalt, zonder dat je iets op je scherm ziet.

Wat maakt Puppeteer uniek?

- Het kan dynamische content renderen—oftewel, het wacht tot JavaScript geladen is, net als een echte gebruiker.

- Het kan gebruikersacties nadoen: klikken, typen, scrollen en zelfs pop-ups afhandelen.

- Ideaal voor het scrapen van sites waar data pas na interactie zichtbaar wordt, zoals e-commerce, social media of dashboards.

Hoe verhoudt het zich tot andere tools?

- Selenium: De klassieker onder browserautomatisering. Werkt met veel browsers en programmeertalen, maar is wat logger en traditioneler. Perfect voor cross-browser testen, maar Puppeteer is sneller voor Chrome/Node.js-projecten.

- Thunderbit: Hier word ik enthousiast van. Thunderbit is een no-code, AI-webscraper die direct in je browser werkt. In plaats van scripts schrijven, klik je op “AI Suggest Fields” en de AI bepaalt zelf wat er uitgelezen moet worden. Ideaal voor zakelijke gebruikers die snel resultaat willen zonder te programmeren (daarover straks meer).

Kortom: Puppeteer = maximale controle (voor wie kan coderen). Thunderbit = maximaal gemak (voor wie niet wil coderen).

Waarom Puppeteer Webscraping belangrijk is voor bedrijven

Laten we eerlijk zijn: webscraping is allang niet meer alleen voor hackers of dataspecialisten. Sales, operations, marketing en zelfs vastgoedteams gebruiken webdata om voorsprong te nemen. En omdat zoveel cruciale informatie achter dynamische websites zit, is Puppeteer vaak de sleutel om die data te ontsluiten.

Hier zijn een paar praktijkvoorbeelden:

| Toepassing | Wie profiteert | Impact / ROI |

|---|---|---|

| Leadgeneratie | Sales, Business Development | Automatisch prospects verzamelen; bespaart 8+ uur/week per medewerker (case study) |

| Prijsmonitoring | E-commerce, Productteams | Real-time concurrentieanalyse; één bedrijf bespaarde $3,8M/jaar (bron) |

| Marktonderzoek | Marketing, Strategie, Finance | 67% van de beleggingsadviseurs gebruikt webdata; tot 890% ROI in sommige gevallen (bron) |

| Vastgoeddata verzamelen | Makelaars, Analisten | Meer dan 50 woningpagina’s scrapen in minuten in plaats van uren (bron) |

| Compliance monitoring | Operations, Juridisch | Automatisch toezicht houden; één verzekeraar voorkwam $50M aan boetes (bron) |

En niet te vergeten: besteedt een kwart van hun werkweek aan repetitieve taken zoals dataverzameling. Dit automatiseren met webscraping is dus niet alleen handig—het is een concurrentievoordeel.

Aan de slag: Zo zet je je eigen Puppeteer Scraper op

Wil je zelf aan de slag? Zo heb je Puppeteer binnen 10 minuten werkend (mits je een beetje JavaScript kent):

1. Installeer Node.js

Puppeteer draait op Node.js. Download de nieuwste LTS-versie via .

2. Maak een nieuwe projectmap aan

Open je terminal en voer uit:

1mkdir puppeteer-scraper-demo

2cd puppeteer-scraper-demo

3npm init -y3. Installeer Puppeteer

1npm install puppeteerHiermee wordt ook een geschikte versie van Chromium gedownload (ongeveer 100MB).

4. Maak je eerste script

Maak een bestand genaamd scrape.js:

1const puppeteer = require('puppeteer');

2(async () => {

3 const browser = await puppeteer.launch();

4 const page = await browser.newPage();

5 await page.goto('https://example.com', { waitUntil: 'domcontentloaded' });

6 const title = await page.title();

7 console.log('Page title:', title);

8 await browser.close();

9})();Voer het uit met:

1node scrape.jsZie je “Page title: Example Domain”? Top—je hebt zojuist Chrome geautomatiseerd!

Je eerste Puppeteer Webscraping Script bouwen

Laten we praktisch worden. Stel, je wilt quotes scrapen van (een demo-site voor webscrapers).

Stap 1: Navigeer naar de pagina

1await page.goto('http://quotes.toscrape.com', { waitUntil: 'networkidle0' });Stap 2: Data extraheren

1const quotes = await page.evaluate(() => {

2 return Array.from(document.querySelectorAll('.quote')).map(node => ({

3 text: node.querySelector('.text')?.innerText.trim(),

4 author: node.querySelector('.author')?.innerText.trim(),

5 tags: Array.from(node.querySelectorAll('.tag')).map(tag => tag.innerText.trim())

6 }));

7});

8console.log(quotes);Stap 3: Paginering afhandelen

1let hasNext = true;

2let allQuotes = [];

3while (hasNext) {

4 // Quotes extraheren zoals hierboven

5 const quotes = await page.evaluate(/* ... */);

6 allQuotes.push(...quotes);

7 const nextButton = await page.$('li.next > a');

8 if (nextButton) {

9 await Promise.all([

10 page.click('li.next > a'),

11 page.waitForNavigation({ waitUntil: 'networkidle0' })

12 ]);

13 } else {

14 hasNext = false;

15 }

16}Stap 4: Opslaan als JSON

1const fs = require('fs');

2fs.writeFileSync('quotes.json', JSON.stringify(allQuotes, null, 2));En klaar! Je hebt nu een basis Puppeteer webscraper die navigeert, data ophaalt, door pagina’s bladert en alles opslaat.

Geavanceerde Puppeteer Scraper-technieken: Dynamische content aanpakken

De meeste echte websites zijn niet zo simpel als een statische lijst. Zo pak je de uitdagingen aan:

1. Wachten op dynamische elementen

1await page.waitForSelector('.product-list-item');Zo weet je zeker dat de content geladen is voordat je deze probeert te scrapen.

2. Gebruikersacties nadoen

- Knop aanklikken:

await page.click('#load-more'); - Tekst invullen:

await page.type('#search', 'laptop'); - Scrollen voor oneindig laden:

1let previousHeight = await page.evaluate('document.body.scrollHeight'); 2while (true) { 3 await page.evaluate('window.scrollTo(0, document.body.scrollHeight)'); 4 await page.waitForTimeout(1500); 5 const newHeight = await page.evaluate('document.body.scrollHeight'); 6 if (newHeight === previousHeight) break; 7 previousHeight = newHeight; 8}

3. Inloggen automatiseren

1await page.goto('https://exampleshop.com/login');

2await page.type('#login-username', 'myusername');

3await page.type('#login-password', 'mypassword');

4await page.click('#login-button');

5await page.waitForNavigation({ waitUntil: 'networkidle0' });4. Omgaan met AJAX-data Soms staat de data niet direct in de HTML, maar komt deze uit een API-call. Je kunt netwerkverkeer onderscheppen met:

1page.on('response', async response => {

2 if (response.url().includes('/api/products')) {

3 const data = await response.json();

4 // Verwerk de data

5 }

6});Praktijkvoorbeeld: Productdata scrapen van een e-commerce site

Laten we alles samenbrengen. Stel, je wilt productnamen, prijzen en afbeeldingen scrapen van een (demo) webshop na inloggen.

1const puppeteer = require('puppeteer');

2const fs = require('fs');

3(async () => {

4 const browser = await puppeteer.launch({ headless: true });

5 const page = await browser.newPage();

6 // Stap 1: Inloggen

7 await page.goto('https://exampleshop.com/login');

8 await page.type('#login-username', 'myusername');

9 await page.type('#login-password', 'mypassword');

10 await page.click('#login-button');

11 await page.waitForNavigation({ waitUntil: 'networkidle0' });

12 // Stap 2: Ga naar de categoriepagina

13 await page.goto('https://exampleshop.com/category/laptops', { waitUntil: 'networkidle0' });

14 // Stap 3: Producten extraheren

15 const products = await page.evaluate(() => {

16 return Array.from(document.querySelectorAll('.product-item')).map(item => ({

17 name: item.querySelector('.product-title')?.innerText.trim() || '',

18 price: item.querySelector('.product-price')?.innerText.trim() || '',

19 image: item.querySelector('img.product-image')?.src || ''

20 }));

21 });

22 // Stap 4: Opslaan als JSON

23 fs.writeFileSync('products.json', JSON.stringify(products, null, 2));

24 await browser.close();

25})();Dit script logt in, navigeert, scrapt en slaat alles automatisch op. Wil je het nog uitgebreider? Voeg paginering toe of klik per product door voor meer details.

Thunderbit: Puppeteer Scraper eenvoudiger maken met AI

Ben je tot hier gekomen en denk je: “Leuk, maar ik wil niet elke keer code schrijven als ik data nodig heb”? Je bent niet de enige. Precies daarom hebben we ontwikkeld.

Wat maakt Thunderbit anders?

- Geen code nodig: Installeer de , open de pagina die je wilt scrapen en klik op “AI Suggest Fields.”

- AI-gedreven veldherkenning: Thunderbit scant de pagina en stelt automatisch de beste kolommen voor—zoals “Productnaam”, “Prijs”, “Afbeelding”, enzovoort.

- Kan overweg met dynamische content: Oneindig scrollen, pop-ups en subpagina’s? Thunderbit’s AI regelt het, klikt door paginering of bezoekt zelfs elke productpagina voor extra data.

- Direct exporteren: Stuur je data met één klik naar Excel, Google Sheets, Notion of Airtable. Exporteren is altijd inbegrepen.

- Templates voor populaire sites: Amazon, Zillow of LinkedIn scrapen? Thunderbit heeft kant-en-klare sjablonen—geen gedoe met instellen.

- Cloud- of browserscraping: Voor grote klussen kan Thunderbit tot 50 pagina’s tegelijk in de cloud scrapen.

Ik heb gebruikers in minder dan vijf minuten zien gaan van “Hoe krijg ik deze data?” naar “Hier is mijn spreadsheet.” En het mooiste? Geen zorgen meer over scripts die breken als de website verandert—Thunderbit’s AI past zich automatisch aan.

Puppeteer vs. Thunderbit: De juiste webscraping-tool kiezen

Welke kies je nu? Zo leg ik het uit aan teams:

| Factor | Puppeteer (Code) | Thunderbit (No-Code, AI) |

|---|---|---|

| Gebruiksgemak | Vereist kennis van JavaScript en DOM | Aanwijzen en klikken, AI stelt velden voor |

| Snelheid van opzetten | Uren tot dagen voor complexe taken | Minuten—gewoon installeren en starten |

| Controle/Flexibiliteit | Maximaal: elk script en logica mogelijk, integratie met andere code | Hoog voor standaardtaken; minder geschikt voor zeer maatwerkprocessen |

| Dynamische content | Handmatig scripten voor wachten, klikken, scrollen | AI regelt dynamische content, paginering en subpagina’s automatisch |

| Onderhoud | Je beheert de scripts—zelf bijwerken bij sitewijzigingen | AI past zich aan bij layout-wijzigingen; minder onderhoud voor de gebruiker |

| Data exporteren | Zelf exportlogica schrijven | Eén klik export naar Excel, Sheets, Notion, Airtable, CSV, JSON |

| Ideaal voor | Developers, maatwerk of grootschalige scraping | Zakelijke gebruikers, snelle projecten, niet-technische teams |

| Kosten | Gratis (behalve je tijd en eventuele infrastructuur) | Gratis instapniveau; betaalde plannen op basis van credits (zie Thunderbit Prijzen) |

Kort samengevat:

- Gebruik Puppeteer als je volledige controle wilt, programmeerkennis hebt of scraping wilt integreren in een groter systeem.

- Gebruik Thunderbit als je snel resultaat wilt, niet wilt coderen of niet-technische collega’s wilt laten scrapen.

Eerlijk gezegd zie ik teams vaak beide gebruiken: Thunderbit voor snelle resultaten en prototyping, Puppeteer voor diepgaande integraties of uitzonderingen.

Stappenplan: Zo run je een succesvol Puppeteer webscraping-project

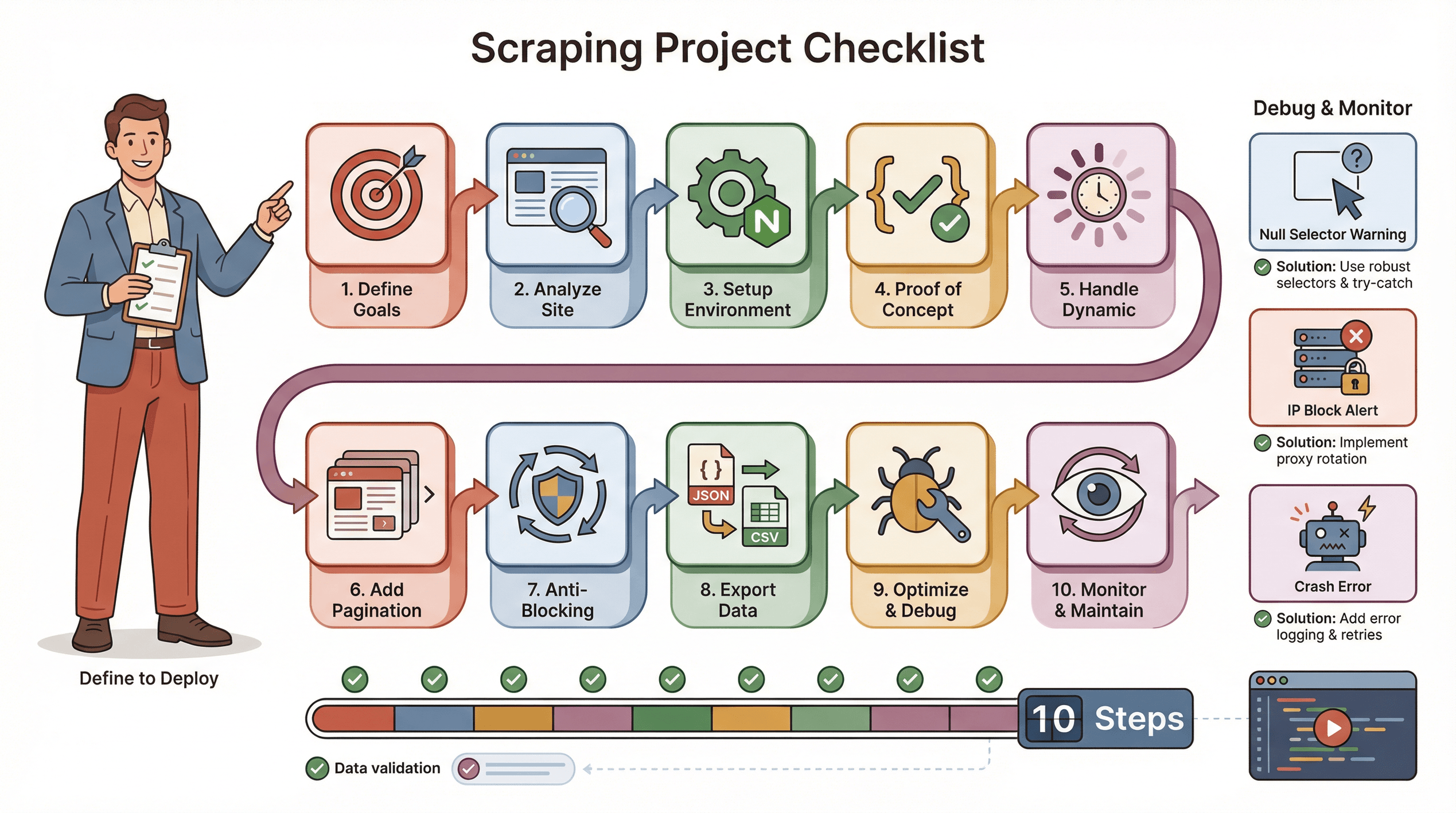

Mijn checklist voor een soepel Puppeteer scraping-project:

Mijn checklist voor een soepel Puppeteer scraping-project:

- Bepaal je doelen: Welke data heb je nodig? Waar staat het?

- Analyseer de site: Is het dynamisch? Is inloggen nodig? Zijn er anti-botmaatregelen?

- Zet je omgeving op: Node.js, Puppeteer en eventuele hulplibraries.

- Schrijf een proof-of-concept: Begin met één pagina, zorg dat je de juiste selectors hebt.

- Pak dynamische content aan: Gebruik

waitForSelector, simuleer klikken/scrollen waar nodig. - Voeg paginering of loops toe: Scrape alle pagina’s, niet alleen de eerste.

- Implementeer anti-blokkeringstactieken: Varieer wachttijden, stel een echte User-Agent in, gebruik proxies indien nodig.

- Exporteer en controleer data: Sla op als JSON/CSV, check op volledigheid.

- Optimaliseer en vang fouten af: Gebruik try/catch, log voortgang, ga netjes om met ontbrekende data.

- Monitor en onderhoud: Websites veranderen—zorg dat je script makkelijk aan te passen is.

Tips bij problemen:

- Geeft een selector null terug? Check de HTML en gebruik waits.

- Word je geblokkeerd? Vertraag, roteer IP’s of gebruik stealth-plugins.

- Crasht je script? Controleer op geheugenlekken of niet-afgevangen fouten.

Conclusie & belangrijkste inzichten

Webscraping is een onmisbare skill geworden voor datagedreven teams. Puppeteer geeft je de kracht om data te halen van zelfs de meest dynamische, JavaScript-rijke sites—maar vereist wel programmeerkennis en onderhoud. Voor zakelijke gebruikers die direct aan de slag willen zonder code, biedt Thunderbit een AI-gedreven, no-code alternatief dat snel, flexibel en verrassend krachtig is.

Mijn advies:

- Ben je technisch en wil je maatwerk? Begin met Puppeteer.

- Wil je snelheid, eenvoud en minder onderhoud? Probeer (de is een goed startpunt).

- Voor de meeste teams is een combinatie van beide dekkend voor 99% van je webdata-behoefte.

Meer van dit soort gidsen lezen? Check de voor tutorials, vergelijkingen en het laatste nieuws over AI-webscraping.

Veelgestelde vragen

1. Wat is een Puppeteer scraper en waarom wordt het gebruikt voor webscraping?

Puppeteer is een Node.js-bibliotheek waarmee je een headless Chrome-browser kunt aansturen met JavaScript. Het wordt gebruikt voor webscraping omdat het dynamische content kan laden, gebruikersacties kan nadoen en data kan halen van sites waar traditionele webscrapers niet bij kunnen.

2. Hoe verhoudt Puppeteer zich tot Selenium en Thunderbit?

Selenium werkt met meerdere browsers en talen, maar is zwaarder. Puppeteer is geoptimaliseerd voor Chrome/Node.js en sneller voor veel scraping-taken. Thunderbit is juist een no-code, AI-tool waarmee niet-technische gebruikers met een paar klikken data kunnen scrapen.

3. Wat zijn de belangrijkste zakelijke voordelen van Puppeteer webscraping?

Automatiseren van dataverzameling bespaart tijd, vermindert fouten en levert realtime inzichten op voor sales, marketing, operations en meer. Toepassingen zijn onder andere leadgeneratie, prijsmonitoring en marktonderzoek.

4. Wat zijn de grootste uitdagingen bij Puppeteer scraping?

De grootste uitdagingen zijn omgaan met dynamische content, anti-botmaatregelen en het onderhouden van scripts als websites veranderen. Je moet code schrijven om te wachten, interacties te simuleren en fouten af te handelen.

5. Wanneer kies je voor Thunderbit in plaats van Puppeteer?

Gebruik Thunderbit als je niet wilt coderen, snel resultaat wilt of niet-technische collega’s wilt laten scrapen. Het is ideaal voor standaard scraping-taken, snelle projecten of als je data direct naar Excel of Google Sheets wilt exporteren zonder gedoe.

Klaar om slimmer te scrapen? of lees meer gidsen op de . Veel succes met scrapen!

Meer weten?