Webdata groeit explosief—en de druk om bij te blijven ook. Ik zie van dichtbij hoe sales- en operationele teams meer tijd kwijt zijn aan het temmen van spreadsheets en eindeloos kopiëren-plakken van websites dan aan het nemen van beslissingen. Volgens Salesforce besteden salesmedewerkers inmiddels , en Asana meldt dat . Dat zijn enorm veel uren die verdwijnen in handmatige dataverzameling—uren die je ook kunt gebruiken om deals te sluiten of campagnes te lanceren.

Maar er is goed nieuws: webscraping met ruby is al lang niet meer alleen voor developers, en je hoeft echt geen programmeur te zijn om er voordeel uit te halen. Ruby is al jaren populair voor het automatiseren van webdata-extractie, maar combineer je het met moderne ai-webscraper tools zoals , dan krijg je het beste van twee werelden: flexibiliteit voor coders én no-code webscraper gemak voor iedereen. Of je nu marketeer bent, een ecommerce manager, of gewoon klaar bent met copy-paste-marathons—deze gids laat je zien hoe je webscraping met ruby en AI beheerst, zonder dat je code hoeft te schrijven.

Wat is webscraping met Ruby? Jouw toegangspoort tot geautomatiseerde data

Eerst even de basis. Webscraping is het proces waarbij software webpagina’s ophaalt en daar precies de info uit vist die je nodig hebt—zoals productprijzen, contactgegevens of reviews—om het daarna om te zetten naar een gestructureerd formaat (denk aan CSV of Excel). Met Ruby is webscraping met ruby zowel krachtig als lekker toegankelijk. De taal staat bekend om z’n leesbare syntax en een enorme verzameling “gems” (libraries) die automatisering een stuk makkelijker maken ().

Hoe ziet “webscraping met ruby” er in de praktijk uit? Stel: je wilt alle productnamen en prijzen van een webshop verzamelen. Met Ruby kun je een script maken dat:

- De webpagina downloadt (met een library zoals )

- De HTML analyseert en de gewenste data vindt (met )

- Alles exporteert naar een spreadsheet of database

Maar nu wordt het pas echt interessant: je hoeft niet altijd code te schrijven. AI-gedreven no-code webscraper oplossingen zoals nemen tegenwoordig het zware werk uit handen—ze lezen webpagina’s, herkennen velden en zetten alles om naar strakke datatabellen met maar een paar klikken. Ruby blijft top als “automatiseringslijm” voor maatwerk-workflows, maar ai-webscraper tools maken het voor business users veel makkelijker om mee te doen.

Waarom webscraping met Ruby belangrijk is voor business teams

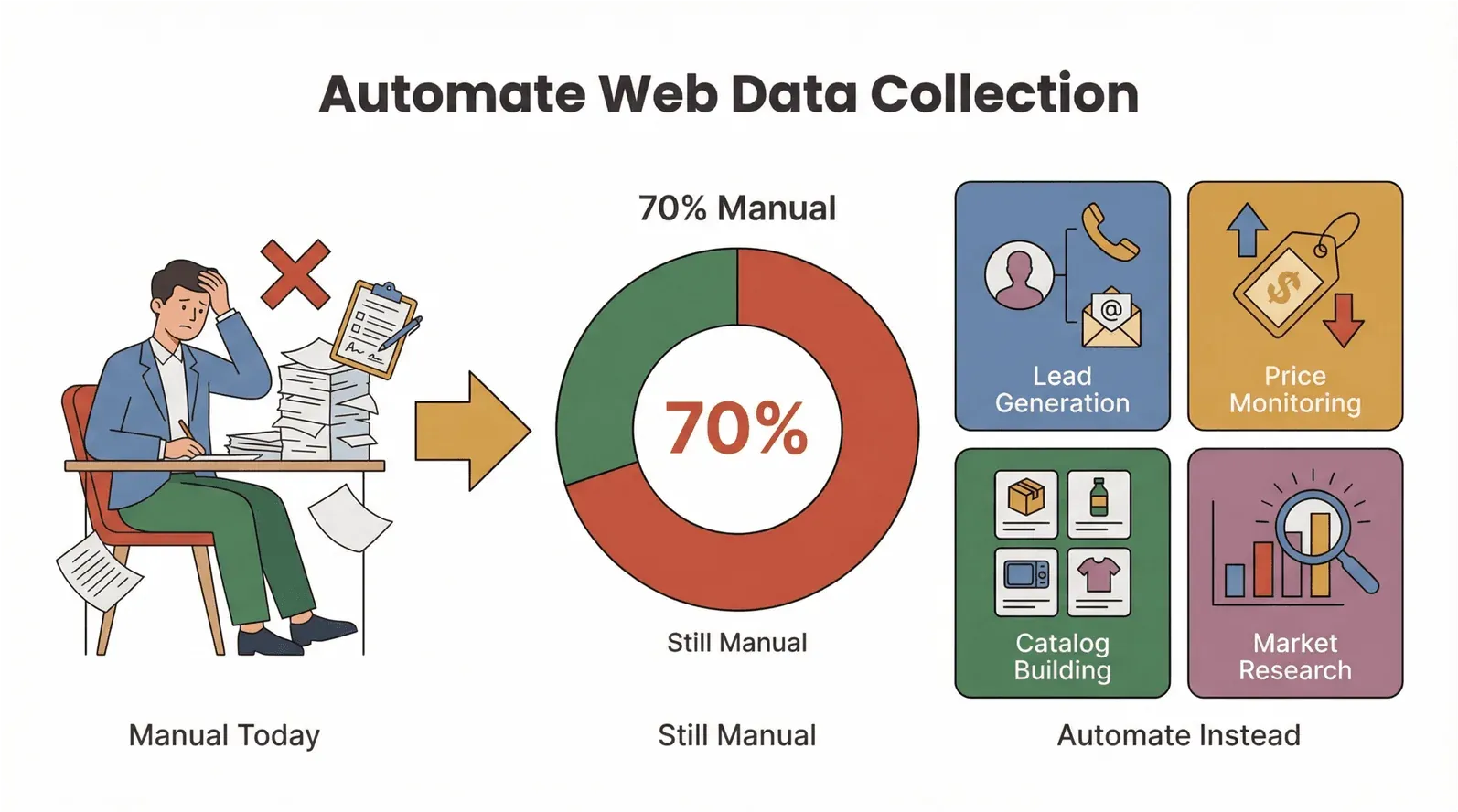

Laten we eerlijk zijn: niemand wil z’n dag vullen met kopiëren en plakken. De vraag naar geautomatiseerde webdata-extractie schiet omhoog, en dat is niet voor niets. Zo verandert webscraping met ruby (en AI-tools) de manier waarop teams werken:

- Leadgeneratie: Haal in één keer contactgegevens uit directories of LinkedIn voor je sales pipeline.

- Prijsmonitoring bij concurrenten: Volg prijswijzigingen voor honderden ecommerce-SKU’s—zonder handmatige checks.

- Productcatalogus opbouwen: Verzamel productdetails en afbeeldingen voor je eigen shop of marketplace.

- Marktonderzoek: Verzamel reviews, ratings of nieuwsartikelen voor trendanalyse.

De ROI is duidelijk: teams die webdata automatisch verzamelen besparen wekelijks uren, maken minder fouten en werken met actuelere, betrouwbaardere data. In de maakindustrie bijvoorbeeld verzamelt , terwijl de hoeveelheid data in slechts twee jaar is verdubbeld. Dat is een enorme kans voor automatisering.

Hier is een korte samenvatting van de waarde van webscraping met ruby en AI-tools:

| Use Case | Handmatige pijn | Voordeel van automatisering | Typisch resultaat |

|---|---|---|---|

| Leadgeneratie | E-mails één voor één kopiëren | Duizenden in minuten scrapen | 10x meer leads, minder monnikenwerk |

| Prijsmonitoring | Dagelijks sites controleren | Geplande, automatische prijsupdates | Realtime prijsinzichten |

| Catalogus opbouwen | Handmatige data-invoer | Bulk extractie & opmaak | Snellere lanceringen, minder fouten |

| Marktonderzoek | Reviews handmatig doorlezen | Op schaal scrapen en analyseren | Diepere, actuelere inzichten |

En het gaat niet alleen om snelheid—automatisering betekent ook minder fouten en consistentere data, wat cruciaal is wanneer .

Webscraping-oplossingen verkennen: Ruby-scripts vs. AI-webscraper tools

Dus: schrijf je een eigen Ruby-script, of kies je voor een ai-webscraper die als no-code webscraper werkt? Laten we de opties naast elkaar zetten.

Ruby-scripting: maximale controle, meer onderhoud

Het Ruby-ecosysteem zit bomvol gems voor elke scraping-behoefte:

- : De standaard voor het parsen van HTML en XML.

- : Voor het ophalen van webpagina’s en API’s.

- : Voor sites met cookies, formulieren en navigatie.

- / : Voor het automatiseren van echte browsers (ideaal voor JavaScript-zware sites).

Met Ruby-scripts heb je volledige vrijheid—maatwerklogica, datacleaning en integraties met je eigen systemen. Maar je neemt ook het onderhoud op je: als een website de layout wijzigt, kan je script breken. En als je niet graag codeert, is er een leercurve.

AI-webscrapers & no-code tools: snel, gebruiksvriendelijk en flexibel

Moderne no-code webscraper tools zoals draaien het om. In plaats van code te schrijven, doe je dit:

- Open de Chrome-extensie

- Klik op “AI Suggest Fields” zodat de AI bepaalt wat je het beste kunt ophalen

- Klik op “Scrape” en exporteer je data

Thunderbit’s AI past zich aan veranderende weblayouts aan, kan subpagina’s verwerken (zoals productdetails) en exporteert direct naar Excel, Google Sheets, Airtable of Notion. Ideaal voor business users die snel resultaat willen zonder gedoe.

Vergelijking naast elkaar:

| Aanpak | Pluspunten | Minpunten | Beste voor |

|---|---|---|---|

| Ruby-scripting | Volledige controle, maatwerklogica, flexibel | Steilere leercurve, onderhoud | Developers, power users |

| AI-webscraper | No-code, snel opzetten, past zich aan | Minder fijnmazige controle, soms limieten | Business users, ops teams |

De trend is duidelijk: websites worden complexer (en defensiever), waardoor ai-webscraper oplossingen voor veel business workflows de voorkeurskeuze worden.

Aan de slag: je Ruby-webscraping omgeving opzetten

Als je Ruby-scripting wilt proberen, zetten we eerst je omgeving goed neer. Het fijne: Ruby is eenvoudig te installeren en werkt op Windows, macOS en Linux.

Stap 1: Ruby installeren

- Windows: Download en volg de stappen. Installeer ook MSYS2 voor native extensions (nodig voor gems zoals Nokogiri).

- macOS/Linux: Gebruik voor versiebeheer. In Terminal:

1brew install rbenv ruby-build

2rbenv install 4.0.1

3rbenv global 4.0.1(Check voor de nieuwste stabiele versie.)

Stap 2: Bundler en essentiële gems installeren

Bundler helpt je dependencies beheren:

1gem install bundlerMaak een Gemfile voor je project:

1source 'https://rubygems.org'

2gem 'nokogiri'

3gem 'httparty'Voer daarna uit:

1bundle installZo blijft je omgeving consistent en klaar om te scrapen.

Stap 3: Je setup testen

Probeer dit in IRB (Ruby’s interactieve shell):

1require 'nokogiri'

2require 'httparty'

3puts Nokogiri::VERSIONZie je een versienummer? Dan zit je goed.

Stap-voor-stap: je eerste Ruby-webscraper bouwen

We lopen een echt voorbeeld door: productdata scrapen van , een site die speciaal is gemaakt om scraping te oefenen.

Hier is een eenvoudig Ruby-script dat boektitels, prijzen en voorraadstatus ophaalt:

1require "net/http"

2require "uri"

3require "nokogiri"

4require "csv"

5BASE_URL = "https://books.toscrape.com/"

6def fetch_html(url)

7 uri = URI.parse(url)

8 res = Net::HTTP.get_response(uri)

9 raise "HTTP #\{res.code\} for #\{url\}" unless res.is_a?(Net::HTTPSuccess)

10 res.body

11end

12def scrape_list_page(list_url)

13 html = fetch_html(list_url)

14 doc = Nokogiri::HTML(html)

15 products = doc.css("article.product_pod").map do |pod|

16 title = pod.css("h3 a").first["title"]

17 price = pod.css(".price_color").text.strip

18 stock = pod.css(".availability").text.strip.gsub(/\s+/, " ")

19 { title: title, price: price, stock: stock }

20 end

21 next_rel = doc.css("li.next a").first&.[]("href")

22 next_url = next_rel ? URI.join(list_url, next_rel).to_s : nil

23 [products, next_url]

24end

25rows = []

26url = "#\{BASE_URL\}catalogue/page-1.html"

27while url

28 products, url = scrape_list_page(url)

29 rows.concat(products)

30end

31CSV.open("books.csv", "w", write_headers: true, headers: %w[title price stock]) do |csv|

32 rows.each { |r| csv << [r[:title], r[:price], r[:stock]] }

33end

34puts "Wrote #\{rows.length\} rows to books.csv"Dit script haalt elke pagina op, parseert de HTML, extraheert de data en schrijft alles weg naar een CSV-bestand. Je kunt books.csv openen in Excel of Google Sheets.

Veelvoorkomende valkuilen:

- Krijg je errors over ontbrekende gems? Check je Gemfile en draai

bundle install. - Laadt een site data via JavaScript? Dan heb je browser-automatisering nodig, zoals Selenium of Watir.

Ruby-scraping versnellen met Thunderbit: AI-webscraper in actie

Nu: hoe kan je scraping naar een hoger niveau tillen—zonder code?

Thunderbit is een waarmee je in twee klikken gestructureerde data van vrijwel elke website haalt. Zo werkt het:

- Open de Thunderbit-extensie op de pagina die je wilt scrapen.

- Klik op “AI Suggest Fields.” Thunderbit’s AI scant de pagina en stelt de beste kolommen voor (zoals “Product Name”, “Price”, “Stock”).

- Klik op “Scrape.” Thunderbit verzamelt de data, regelt paginering en kan ook subpagina’s volgen voor extra details.

- Exporteer je data direct naar Excel, Google Sheets, Airtable of Notion.

Wat Thunderbit onderscheidt, is dat het goed omgaat met complexe, dynamische webpagina’s—zonder fragiele selectors of code. En wil je workflows combineren, dan kun je Thunderbit gebruiken voor de extractie en daarna met Ruby verder verwerken of verrijken.

Pro tip: Thunderbit’s subpagina-scraping is goud waard voor ecommerce- en vastgoedteams. Scrape een lijst met productlinks en laat Thunderbit vervolgens elke detailpagina bezoeken om specificaties, afbeeldingen of reviews op te halen—automatisch verrijk je zo je dataset.

Praktijkvoorbeeld: ecommerce product- en prijsdata scrapen met Ruby en Thunderbit

Laten we dit vertalen naar een workflow die ecommerce teams echt gebruiken.

Scenario: Je wilt prijzen en productdetails van concurrenten monitoren voor honderden SKU’s.

Stap 1: Gebruik Thunderbit om de hoofdproductlijst te scrapen

- Open de productoverzichtspagina van de concurrent.

- Start Thunderbit en klik op “AI Suggest Fields” (bijv. Product Name, Price, URL).

- Klik op “Scrape” en exporteer naar CSV.

Stap 2: Verrijk de data met subpagina-scraping

- Gebruik in Thunderbit de functie “Scrape Subpages” om elke productdetailpagina te bezoeken en extra velden op te halen (zoals beschrijving, voorraad of afbeeldingen).

- Exporteer de verrijkte tabel.

Stap 3: Verwerken of analyseren met Ruby

- Gebruik een Ruby-script om de data verder op te schonen, te transformeren of te analyseren. Bijvoorbeeld:

- Prijzen omrekenen naar één valuta

- Niet-voorraad items eruit filteren

- Samenvattende statistieken maken

Een eenvoudige Ruby-snippet om alleen producten op voorraad te bewaren:

1require 'csv'

2rows = CSV.read('products.csv', headers: true)

3in_stock = rows.select { |row| row['stock'].include?('In stock') }

4CSV.open('in_stock_products.csv', 'w', write_headers: true, headers: rows.headers) do |csv|

5 in_stock.each { |row| csv << row }

6endResultaat:

Je gaat van ruwe webpagina’s naar een schone, bruikbare datatabel—klaar voor prijsanalyse, voorraadplanning of marketingcampagnes. En je hebt geen enkele regel scraping-code hoeven schrijven.

No-code? Geen probleem: webdata-extractie automatiseren voor iedereen

Wat ik zo sterk vind aan Thunderbit, is dat het niet-technische gebruikers echt zelfstandig maakt. Je hoeft niets te weten van Ruby, HTML of CSS—open de extensie, laat de AI het werk doen en exporteer.

Leercurve: Met Ruby-scripts moet je programmeren en webstructuren leren. Met Thunderbit ben je in minuten klaar, niet in dagen.

Integratie: Thunderbit exporteert direct naar tools die teams al gebruiken—Excel, Google Sheets, Airtable, Notion. Je kunt zelfs terugkerende scrapes plannen voor doorlopende monitoring.

Feedback uit teams: Ik heb marketingteams, sales ops en ecommerce managers Thunderbit zien inzetten voor alles van leadlijsten tot prijsmonitoring—zonder ooit IT te hoeven inschakelen.

Best practices: Ruby en AI-webscraper combineren voor schaalbare automatisering

Wil je een robuuste, schaalbare scraping-workflow opzetten? Dit zijn mijn belangrijkste tips:

- Omgaan met websitewijzigingen: AI-webscrapers zoals Thunderbit passen zich automatisch aan, maar bij Ruby-scripts moet je selectors bijwerken als sites veranderen.

- Plan je scrapes: Gebruik Thunderbit’s planning voor periodieke dataruns. Voor Ruby kun je een cron job of task scheduler gebruiken.

- Batchverwerking: Bij grote datasets: werk in batches om blokkades te voorkomen en je systeem niet te overbelasten.

- Data-opmaak: Maak data altijd schoon en valideer vóór analyse—Thunderbit exporteert gestructureerd, maar Ruby-scripts kunnen extra checks nodig hebben.

- Compliance: Scrape alleen publiek beschikbare data, respecteer

robots.txten let op privacywetgeving (zeker in de EU—). - Fallback-strategieën: Wordt een site te complex of blokkeert die scraping? Kijk naar officiële API’s of alternatieve databronnen.

Wanneer gebruik je wat?

- Gebruik Ruby-scripts als je maximale controle, maatwerklogica of integratie met interne systemen nodig hebt.

- Gebruik Thunderbit als je snelheid, gebruiksgemak en aanpasbaarheid wilt—zeker voor eenmalige of terugkerende business taken.

- Combineer beide voor geavanceerde workflows: laat Thunderbit de extractie doen en gebruik Ruby voor verrijking, QA of integratie.

Conclusie & belangrijkste inzichten

Webscraping met ruby is al jaren een superkracht voor het automatiseren van dataverzameling—maar met ai-webscraper tools zoals Thunderbit is die kracht nu voor iedereen bereikbaar. Of je nu developer bent en flexibiliteit zoekt, of een business user die vooral resultaat wil: je kunt webdata-extractie automatiseren, uren handwerk besparen en sneller betere beslissingen nemen.

Dit zijn de kernpunten:

- Ruby is een uitstekende tool voor webscraping en automatisering, zeker met gems zoals Nokogiri en HTTParty.

- AI-webscrapers zoals Thunderbit maken data-extractie toegankelijk voor niet-coders, met functies zoals “AI Suggest Fields” en subpagina-scraping.

- Ruby + Thunderbit samen geeft je het beste van twee werelden: snelle no-code extractie én maatwerk automatisering en analyse.

- Webdata automatisch verzamelen is een slimme strategie voor sales, marketing en ecommerce teams—minder handwerk, hogere nauwkeurigheid en nieuwe inzichten.

Klaar om te starten? , probeer een eenvoudig Ruby-script en ontdek hoeveel tijd je kunt besparen. En als je verder wilt verdiepen: bekijk de voor meer handleidingen, tips en praktijkvoorbeelden.

Veelgestelde vragen

1. Moet ik kunnen programmeren om Thunderbit te gebruiken voor webscraping?

Nee. Thunderbit is gemaakt voor niet-technische gebruikers. Open de extensie, klik op “AI Suggest Fields” en laat de AI de rest doen. Je exporteert naar Excel, Google Sheets, Airtable of Notion—zonder code.

2. Wat zijn de belangrijkste voordelen van Ruby voor webscraping?

Ruby biedt krachtige libraries zoals Nokogiri en HTTParty voor flexibele, op maat gemaakte scraping-workflows. Ideaal voor developers die volledige controle, eigen logica en integraties met andere systemen willen.

3. Hoe werkt Thunderbit’s functie “AI Suggest Fields”?

Thunderbit’s AI scant de webpagina, herkent de meest relevante datavelden (zoals productnamen, prijzen, e-mails) en stelt een gestructureerde tabel voor. Je kunt de kolommen nog aanpassen voordat je gaat scrapen.

4. Kan ik Thunderbit combineren met Ruby-scripts voor geavanceerde workflows?

Zeker. Veel teams gebruiken Thunderbit om data te extraheren (vooral van complexe of dynamische sites) en verwerken of analyseren die daarna verder met Ruby. Deze hybride aanpak is ideaal voor maatwerkrapportages of dataverrijking.

5. Is webscraping legaal en veilig voor zakelijk gebruik?

Webscraping is toegestaan wanneer je publiek beschikbare data verzamelt en de voorwaarden van websites en privacywetgeving respecteert. Check altijd robots.txt en vermijd het scrapen van persoonsgegevens zonder geldige grondslag—zeker voor EU-gebruikers onder GDPR.

Benieuwd hoe webscraping jouw workflow kan veranderen? Probeer Thunderbit’s gratis tier of experimenteer vandaag nog met een Ruby-script. En als je vastloopt: de en het staan vol tutorials en tips om webdata-automatisering onder de knie te krijgen—zonder code.

Meer lezen