Laissez-moi vous planter le décor : il est 8 h 30 un lundi matin, et vous êtes en train de fixer un tableau Excel en copiant-collant des noms d’entreprise, des e-mails et des numéros de téléphone depuis une douzaine de sites différents. Et vous n’êtes pas le seul : il se trouve que plus de à simplement déplacer des données d’un endroit à un autre. Je l’ai vécu moi-même, et croyez-moi, ce n’est pas la façon la plus motivante de démarrer la semaine. Pour les équipes commerciales, c’est encore plus costaud : , et plus de 20 % disent que c’est leur plus gros casse-tête CRM.

Le monde tourne grâce à la donnée, mais notre manière de la collecter est restée coincée à l’âge de pierre — jusqu’à maintenant. Grâce aux outils modernes d’extraction de données, comme les web scraper et les solutions propulsées par l’IA, on peut enfin s’affranchir de la tyrannie du copier-coller à répétition. Dans ce guide, je vais vous expliquer ce qu’est vraiment l’extraction de données, pourquoi c’est essentiel et comment l’utiliser pour transformer des heures de boulot répétitif en quelques minutes d’analyse utile. Que vous travailliez dans la vente, l’e-commerce ou les opérations, c’est votre passeport pour travailler plus intelligemment, pas plus dur.

Démystifier l’extraction de données : qu’est-ce que c’est et pourquoi est-ce important ?

Allons droit au but. L’extraction de données, c’est tout simplement une façon un peu plus technique de dire : « récupérer des infos utiles à plusieurs endroits et les regrouper dans une liste bien propre. » Imaginez que vous ramassez des pommes dans plusieurs vergers et que vous ne gardez que les meilleures dans votre panier : en gros, c’est ça l’extraction de données.

Plus précisément, il s’agit du processus qui consiste à récupérer ou à extraire des données depuis différentes sources, puis à les convertir dans un format exploitable pour l’analyse de données, le reporting ou le stockage (). L’objectif ? Faire sortir ces données dispersées de leurs silos et les centraliser pour pouvoir vraiment s’en servir.

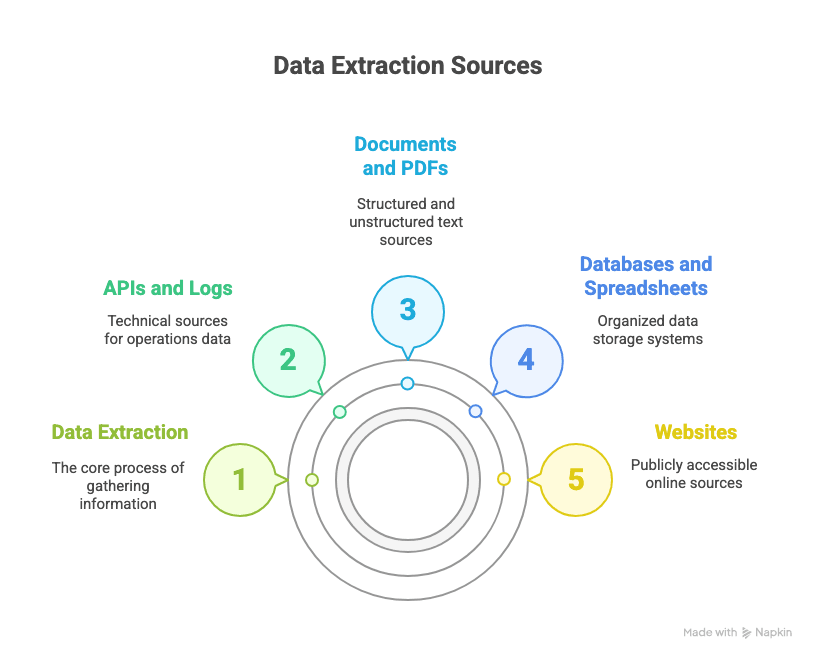

Où se fait l’extraction de données ?

- Sites web : annuaires publics, fiches produits ou sites d’avis.

- Bases de données et tableurs : votre CRM, votre ERP ou ce fichier Excel sans fin.

- Documents et PDF : factures, rapports ou contrats.

- API et journaux (logs) : pour les profils plus techniques, ce sont de vraies mines d’or pour les données opérationnelles.

Qu’elles soient structurées (comme des lignes bien rangées dans une base) ou non structurées (comme une vraie jungle de publications sur les réseaux sociaux), les données doivent d’abord être extraites avant de pouvoir être comprises. C’est un peu du « copier-coller sous stéroïdes » : plus rapide, plus précis et bien moins pénible mentalement.

Pourquoi l’extraction de données est indispensable pour les entreprises d’aujourd’hui

Soyons francs : le temps, c’est de l’argent. Chaque heure que votre équipe passe à manipuler des données, c’est une heure en moins pour vendre, bâtir une stratégie ou servir les clients. En réalité, . Un trillion, avec un “T”. Ça fait mal.

Mais il ne s’agit pas seulement de gagner du temps : il s’agit aussi d’ouvrir de nouvelles opportunités. Voici ce que l’extraction automatisée de données peut apporter :

| Cas d’usage | Qui en profite | À quoi cela ressemble |

|---|---|---|

| Génération de leads | Équipes commerciales | Extraire les coordonnées depuis des annuaires, LinkedIn ou des sites d’entreprise dans une liste prête à l’emploi |

| Veille des prix et des stocks | Opérations e-commerce | Surveiller les prix des concurrents ou les niveaux de stock sur des centaines de références — fini les vérifications manuelles |

| Étude de marché | Analystes / marketing | Regrouper avis, publications sociales ou fiches produits pour l’analyse concurrentielle |

| Gestion des fournisseurs | Achats | Suivre automatiquement les catalogues fournisseurs et les mises à jour tarifaires |

| Enrichissement des données | Tout le monde | Ajouter des infos complémentaires (e-mails, numéros de téléphone, adresses) pour enrichir le CRM ou la base de données |

Et n’oublions pas la précision : la saisie manuelle des données affiche environ . Ça peut sembler peu, mais à grande échelle, cela veut dire que votre équipe commerciale appelle les mauvais numéros ou que votre tableau de bord tarifaire est décalé de plusieurs centaines de dollars.

Les outils automatisés d’extraction de données ne font pas que vous faire gagner du temps : ils vous aident aussi à éviter des erreurs coûteuses et à prendre de meilleures décisions plus vite. Ce n’est donc pas étonnant que près de .

Les défis bien réels de l’extraction de données

Si l’extraction de données est si utile, pourquoi tout le monde ne l’utilise pas déjà ? Eh bien, les anciennes méthodes étaient… disons, « formatrices pour le caractère ».

Voici ce qui coinçait autrefois :

- Le copier-coller manuel est lent et source d’erreurs. Même l’employé le plus rigoureux finit par se tromper après la 50e ligne. Et soyons honnêtes, personne ne rêve de faire carrière comme ninja du copier-coller.

- Les scripts cassent tout le temps. Les profils techniques peuvent écrire leurs propres scripts de web scraping, mais les sites adorent modifier leur mise en page. Le moindre changement, et votre script devient inutilisable ().

- Chaque site est différent. Ce qui marche sur un site ne marchera pas forcément sur un autre. Certains ont une pagination compliquée, d’autres cachent les données derrière des boutons ou des connexions.

- Les barrières anti-bots. Les sites déploient des CAPTCHA, des bannissements d’IP et d’autres techniques pour bloquer les scrapers ().

- Les problèmes juridiques et de conformité. Tous les sites n’acceptent pas que vous récupériez leurs données, et les lois sur la confidentialité comme le RGPD demandent de rester prudent.

Et le défi le plus important, sans doute ? Le fossé de communication entre les utilisateurs métier non techniques et les équipes techniques. J’ai vu des responsables commerciaux essayer d’expliquer leurs besoins à un développeur, pour finalement recevoir un script qui fonctionne presque… jusqu’à la prochaine mise à jour du site.

Comment fonctionne l’extraction de données : du manuel à l’automatisé

Alors, comment extrait-on concrètement des données ? Que ce soit à la main ou avec les dernières technologies d’IA, les étapes sont étonnamment proches :

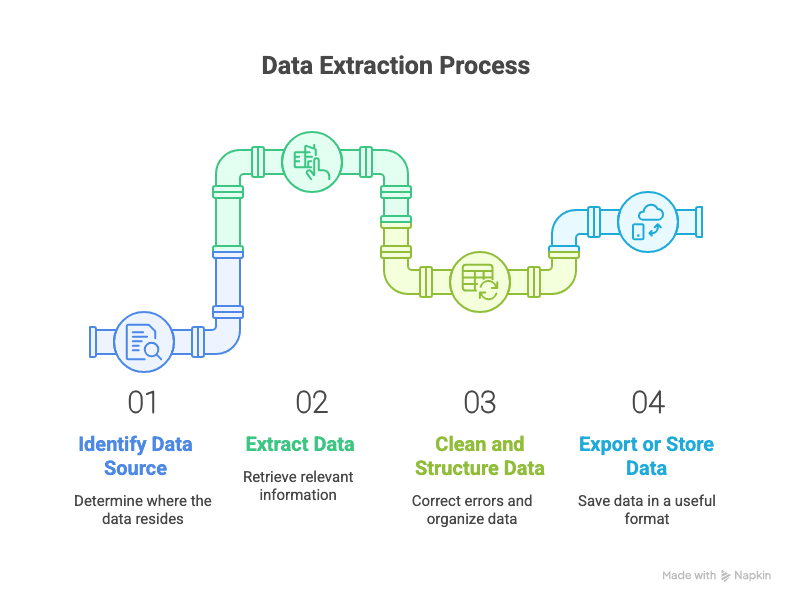

- Identifier la source des données. Où se trouve l’information ? (site web, PDF, base de données, etc.)

- Extraire les données. Récupérer les éléments utiles — par copie, via un script ou avec un outil.

- Nettoyer et structurer les données. Corriger les erreurs, harmoniser les formats, supprimer les doublons.

- Exporter ou stocker les données. Les enregistrer dans un endroit pratique — Excel, Google Sheets, une base de données, etc.

Comparons les principales approches :

| Approche | Avantages | Inconvénients |

|---|---|---|

| Copier-coller manuel | Tout le monde peut le faire | Lent, sujet aux erreurs, difficile à faire évoluer |

| Scrapers basés sur du code | Flexibles, puissants | Nécessitent des compétences en programmation, cassent facilement, maintenance importante |

| Scrapers web no-code / IA | Rapides, simples à utiliser, s’adaptent aux changements | Parfois moins personnalisables pour les cas particuliers |

Les outils modernes, surtout ceux propulsés par l’IA, ont transformé ce processus en pipeline automatisé. Vous indiquez à l’outil ce que vous voulez, et il fait le gros du travail — sans coder.

Explorer les outils d’extraction de données : scrapers web, API et plus encore

Il existe tout un buffet d’outils d’extraction de données, mais la plupart se rangent dans quelques grandes catégories :

- Outils de web scraping : l’incontournable pour les utilisateurs métier. Ils extraient des données depuis des sites web — imaginez des extensions de navigateur boostées ou des applications cloud.

- API et intégrations : si un site propose une API, foncez dessus ! Les API sont propres, structurées et moins susceptibles de casser.

- Outils de traitement par lots et ETL : pour déplacer de gros volumes de données entre bases ou fichiers — plus courant en IT et en analyse de données.

- RPA (Robotic Process Automation) : des robots qui imitent les clics et les frappes humaines. Très utile pour les systèmes hérités, mais parfois capricieux.

- Outils manuels : import web d’Excel, fonctions Google Sheets ou extensions de navigateur. Pratiques pour les petites tâches, mais pas faites pour passer à l’échelle.

Outils de web scraper : rendre l’extraction de données accessible

Les web scraper sont l’outil de référence pour la plupart des utilisateurs métier. Ils automatisent la collecte de données sur les sites web, transformant des heures de clics en quelques minutes de résultats.

Les scrapers web traditionnels vous demandent de pointer et cliquer sur chaque champ ou d’écrire des règles pour préciser ce qu’il faut extraire. Si le site change, il faut souvent tout refaire presque à zéro.

Les scrapers web alimentés par l’IA (comme Thunderbit) vont plus loin. Il suffit de décrire ce que vous voulez — « récupère-moi tous les noms de produits et les prix de cette page » — et l’IA s’occupe du reste. Plus besoin de se battre avec le HTML ou XPath.

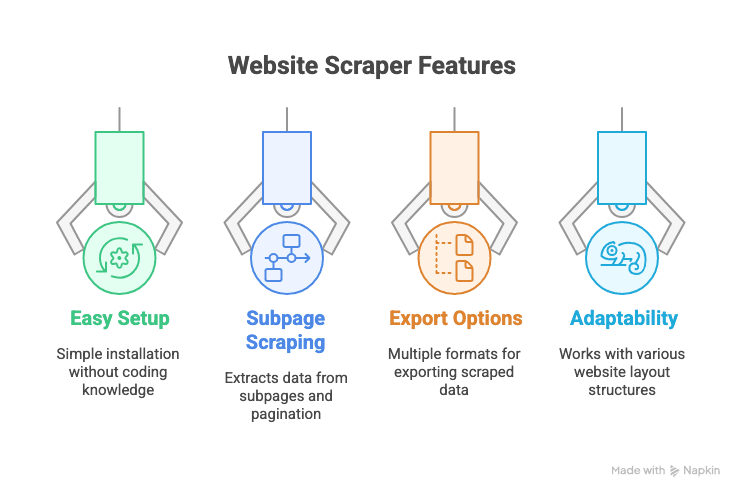

Fonctionnalités clés à rechercher :

- Mise en route facile (sans code)

- Extraction des sous-pages et gestion de la pagination

- Plusieurs options d’export (Excel, Google Sheets, Notion, etc.)

- Capacité à s’adapter à différentes structures de sites

Thunderbit : l’extraction de données alimentée par l’IA, pour tous

Après des années à construire des outils SaaS et d’automatisation, j’ai vu de mes propres yeux là où la plupart des outils d’extraction de données échouent : ils sont soit trop techniques, soit trop rigides, soit trop lents à s’adapter aux besoins concrets des entreprises.

C’est pour cela que nous avons créé , un web scraper basé sur l’IA, conçu spécialement pour les utilisateurs métier non techniques. Notre objectif ? Rendre l’extraction de données aussi simple que commander un plat à emporter.

Voici ce qui distingue Thunderbit :

- Suggestion de champs par IA : cliquez simplement sur « AI Suggest Fields » et Thunderbit lit le site, propose les colonnes les plus pertinentes et génère même des prompts personnalisés pour chaque champ. Fini les suppositions sur le sélecteur à utiliser.

- Extraction des sous-pages : vous avez besoin d’infos depuis chaque page produit ou profil ? Thunderbit peut visiter chaque sous-page et enrichir automatiquement votre tableau.

- Gestion de la pagination : qu’il s’agisse d’un bouton « Suivant » ou d’un défilement infini, Thunderbit s’en charge — vous récupérez toutes les données, pas seulement la première page.

- Export simple : envoyez vos données directement vers Excel, Google Sheets, Notion ou Airtable. Téléchargez en CSV ou JSON — selon votre flux de travail.

- Expérience no-code et intuitive : si vous savez utiliser un navigateur, vous savez utiliser Thunderbit. Aucun bagage technique requis.

- Extraction dans le cloud ou dans le navigateur : choisissez ce qui vous convient le mieux — Thunderbit peut fonctionner dans le cloud pour aller plus vite, ou dans votre navigateur pour les sites nécessitant une connexion.

Et oui, nous avons veillé à rester abordables. Notre formule gratuite vous permet d’extraire jusqu’à 6 pages, et nos offres payantes commencent à seulement 15 $/mois pour 500 crédits. Pour la plupart des petites équipes, c’est largement suffisant pour démarrer.

Curieux ? Téléchargez l’extension Chrome de Thunderbit et testez-la par vous-même.

Thunderbit en action : cas d’usage concrets

Passons à la pratique. Voici comment des équipes utilisent Thunderbit au quotidien :

Vente : extraire des leads en quelques minutes

Imaginez que vous êtes commercial et que votre mission consiste à construire une liste de prospects à partir d’un annuaire sectoriel. Au lieu de passer des heures à copier noms, e-mails et numéros de téléphone, vous :

- Ouvrez l’annuaire dans Chrome.

- Cliquez sur « AI Suggest Fields » dans Thunderbit.

- Vérifiez les colonnes proposées (Nom, E-mail, Téléphone, Entreprise).

- Cliquez sur « Scrape ».

- Exportez les résultats vers Google Sheets et lancez votre prospection.

Un utilisateur nous a confié : « J’ai constitué une liste de 200 leads en moins de 10 minutes. Avant, ça me prenait une demi-journée ! »

E-commerce : surveiller les prix des concurrents

Les responsables e-commerce doivent garder un œil sur les prix des concurrents. Avec Thunderbit, vous pouvez :

- Charger la page produit du concurrent.

- Utiliser un modèle prêt à l’emploi ou laisser l’IA suggérer les champs (nom du produit, prix, disponibilité).

- Mettre en place une extraction planifiée pour vérifier les prix chaque jour.

- Recevoir des alertes en cas de changement de prix — fini les vérifications manuelles.

Opérations : suivre les catalogues fournisseurs

Les équipes opérations doivent souvent maintenir les catalogues fournisseurs à jour. Thunderbit simplifie cela :

- Extraire les listes de produits depuis les sites des fournisseurs.

- Exporter les données vers Airtable ou Notion pour le suivi des stocks.

- Programmer des mises à jour régulières afin de toujours travailler avec les infos les plus récentes.

Les fonctionnalités clés à rechercher dans un outil d’extraction de données

Tous les outils d’extraction de données ne se valent pas. Voici ce que je vous conseille d’évaluer :

- Facilité d’utilisation : un utilisateur non technique peut-il démarrer rapidement ?

- Prise en charge de plusieurs sources de données : sites web, PDF, images, API, etc.

- Sortie de données structurée : des tableaux clairs, pas des blocs de texte illisibles.

- Automatisation et planification : configurez une fois, puis laissez l’outil fonctionner en pilote automatique.

- Intégration avec les outils métier : export vers Excel, Google Sheets, Notion, Airtable ou votre CRM.

- Scalabilité : peut-il gérer des milliers d’enregistrements ou seulement quelques-uns ?

- Précision et fiabilité : détecte-t-il les erreurs et s’adapte-t-il aux changements ?

- Extraction des sous-pages et pagination : plus aucun détail caché ne vous échappe.

- Assistance IA : l’outil doit vous aider, pas l’inverse.

Et ne sous-estimez pas la valeur d’un bon support et d’une bonne documentation : quand un problème survient, vous voulez une réponse rapide.

Bonnes pratiques pour une extraction et une analyse efficaces des données

Avoir le bon outil, c’est déjà la moitié du chemin. Voici comment tirer le meilleur parti de vos efforts d’extraction de données :

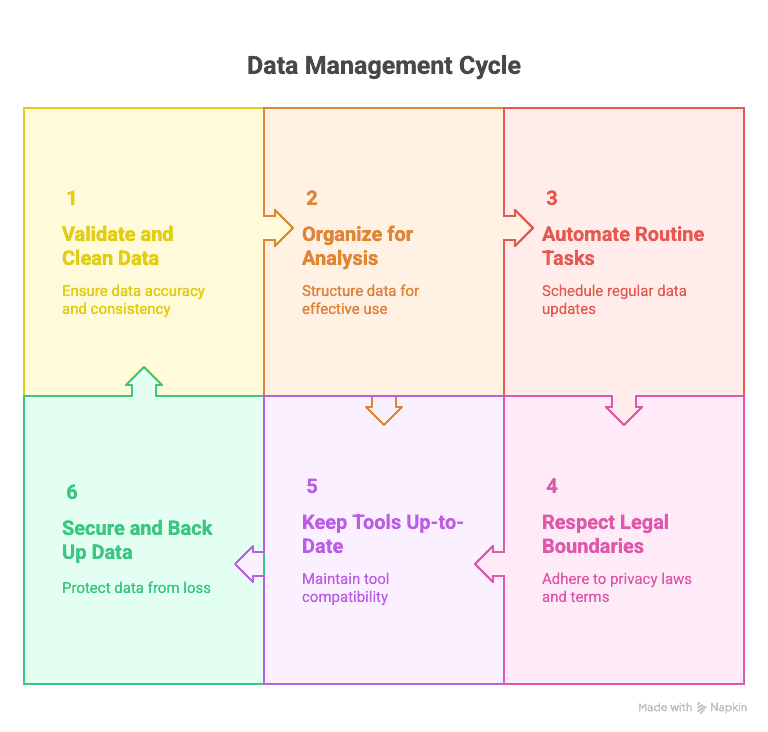

- Validez et nettoyez vos données : vérifiez toujours les erreurs, les doublons et les problèmes de format. Des données sales produisent des résultats sales.

- Organisez pour l’analyse : utilisez des en-têtes clairs et des formats cohérents. Pensez à la manière dont les données seront exploitées ensuite.

- Automatisez les tâches récurrentes : programmez des extractions régulières pour garder des données à jour.

- Respectez les règles juridiques et de confidentialité : vérifiez toujours les conditions du site et les lois en vigueur avant de scraper.

- Gardez vos outils à jour : les sites changent — assurez-vous que vos outils suivent le rythme.

- Sécurisez et sauvegardez vos données : évitez de perdre vos précieuses analyses à cause d’une panne de disque dur.

Petite checklist après chaque extraction : contrôlez quelques enregistrements, supprimez les doublons, chargez les données dans votre outil d’analyse de données, puis programmez le prochain rafraîchissement.

Exploiter tout le potentiel de l’extraction de données pour votre entreprise

Récapitulons. L’extraction de données n’est pas qu’un mot à la mode : c’est un outil concret et transformateur pour toute personne qui travaille avec de l’information. Que vous cherchiez des leads, surveilliez les prix ou essayiez simplement de mieux maîtriser vos données, le bon outil peut transformer des heures de corvée en quelques minutes d’insights.

Et voici mon avis personnel : l’avenir appartient aux agents IA verticaux — des outils ultra-spécialisés pour résoudre des problèmes métier précis, et pas seulement des chatbots généralistes. Pourquoi ? Parce que les entreprises ont besoin de fiabilité, de répétabilité et de résultats à grande échelle. Les agents IA généralistes sont excellents pour brainstormer ou répondre à des questions, mais quand il s’agit d’automatiser des workflows répétitifs et critiques, il vous faut un outil pensé pour votre métier.

C’est exactement ce que nous construisons chez . Notre mission est de rendre l’extraction de données accessible à tout le monde — sans code, sans prise de tête, juste des résultats. Si vous êtes prêt à laisser la saisie manuelle derrière vous, testez Thunderbit et voyez tout ce que vous pouvez accomplir en plus.

Vous voulez aller plus loin ? Consultez nos autres guides sur le , comme et .

Travaillez plus intelligemment, pas plus durement. Les informations sont là — maintenant, vous avez les moyens de les saisir et d’avancer.

P.-S. Si vous vous surprenez un jour à rêver de copier-coller des données, il est probablement temps d’automatiser. Ou peut-être simplement de prendre des vacances. Dans tous les cas, Thunderbit est là pour vous.

FAQ

1. Qu’est-ce que Thunderbit ?

Thunderbit est une extension Chrome alimentée par l’IA qui permet à n’importe qui d’extraire des données depuis des sites web — sans coder. Idéal pour les équipes commerciales, marketing, e-commerce et opérations.

2. En quoi est-il différent des scrapers traditionnels ?

- L’IA détecte automatiquement les champs

- Gère les sous-pages et la pagination

- Aucune configuration ni programmation

- Export vers Sheets, Excel, Notion, etc.

3. Peut-il gérer les connexions, les PDF ou les pages dynamiques ?

Oui.

- Mode navigateur : pour les connexions, les PDF et les pages interactives

- Mode cloud : extraction rapide pour les sites publics

Il prend également en charge le résumé de texte et la traduction.