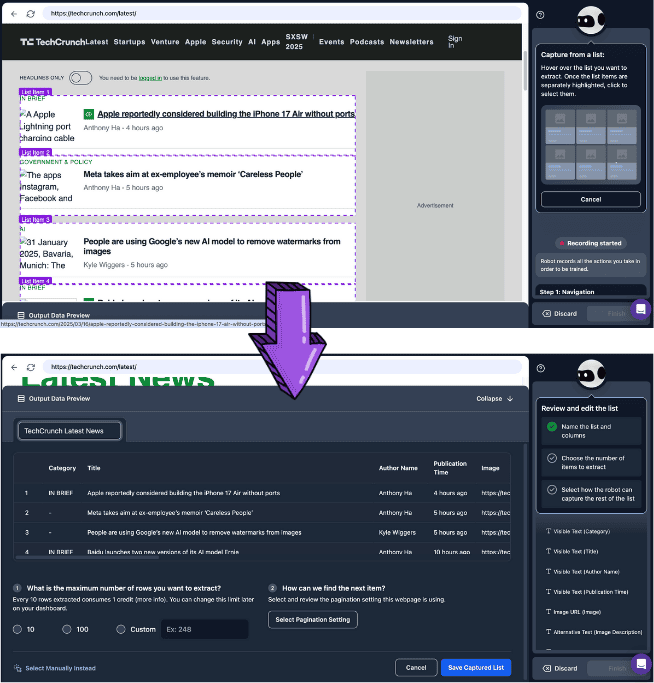

Je devais suivre plus de 200 sources d’actualité pour repérer les articles tendance. Le faire manuellement ? Un vrai travail à plein temps. Un extracteur traditionnel ? Il cassait à chaque fois qu’un site changeait de mise en page.

Puis j’ai testé des extracteurs d’articles IA. Un clic, des données propres, aucun sélecteur CSS. La différence était flagrante.

Si vous êtes journaliste, expert SEO ou chercheur et que vous devez extraire des articles à grande échelle, cette comparaison vous évitera bien des essais infructueux. J’ai testé des extracteurs no-code traditionnels et des solutions dopées à l’IA — voici ce qui fonctionne vraiment.

En bref

| Avantages | Inconvénients | Idéal pour | |

|---|---|---|---|

| Extracteur d’articles IA | - Peut extraire plusieurs sites avec une grande précision - Supprime automatiquement le bruit - S’adapte aux changements de structure web - Gère le chargement de contenu dynamique - Faible coût de nettoyage des données | - Coût de calcul plus élevé - Temps de traitement plus long - Certaines pages peuvent nécessiter une intervention manuelle - Risque de déclencher des mécanismes anti-extraction | - Extraction de sites à contenu complexe ou dynamique (par ex. portails d’actualité, réseaux sociaux) - Collecte de données à grande échelle |

| Extracteur d’articles no-code traditionnel | - Exécution rapide - Coût plus faible - Faible consommation de ressources serveur et locales - Forte maîtrise | - Maintenance fréquente en raison des changements de structure web - Impossible d’extraire plusieurs sites en même temps - Incapable de gérer le contenu dynamique - Coût élevé de nettoyage des données | - Extraction rapide à grande échelle de pages web statiques simples - Ressources informatiques limitées, contraintes budgétaires |

Qu’est-ce qu’un extracteur d’articles ? Pourquoi l’extracteur d’articles IA est-il important ?

Un est un type d’ capable de repérer et d’extraire des informations comme les titres, les auteurs, les dates de publication, le contenu, les mots-clés, les images et les vidéos à partir de sites d’actualité, puis de les organiser dans des formats structurés comme JSON, CSV ou Excel.

Les s’appuient sur des pour extraire le contenu selon la structure d’une page web. Cette approche a toutefois ses limites :

- Manque d’universalité : des structures web différentes nécessitent des spécifiques à chaque site, et tout changement de structure peut les rendre inefficaces, ce qui impose des mises à jour fréquentes.

- Incapacité à gérer le contenu dynamique : de nombreux sites utilisent AJAX ou JavaScript pour charger du contenu, ce que les ne peuvent pas extraire directement.

- Traitement des données limité : les ne récupèrent que des fragments , sans nettoyage, mise en forme, analyse sémantique ou analyse de sentiment supplémentaires.

Voici l’.

Voici l’.

-

Cette technologie utilise les LLM pour comprendre les pages web, ce qui permet :

- Reconnaissance intelligente : identification des titres, auteurs, résumés et contenu principal.

- Suppression automatique du bruit : distinction entre le contenu principal, la navigation, les publicités et les articles associés, pour améliorer la qualité des données et l’efficacité de l’extraction.

- Adaptation aux changements du web : même si la structure ou le style d’un site change, l’IA peut continuer à extraire grâce à la compréhension sémantique et aux signaux visuels.

- Généralisation intersites : contrairement aux , les extracteurs IA peuvent s’appliquer à différents sites sans ajustements manuels.

- Intégration avec le NLP et le deep learning : réalisation de tâches comme la traduction, le résumé et l’analyse de sentiment.

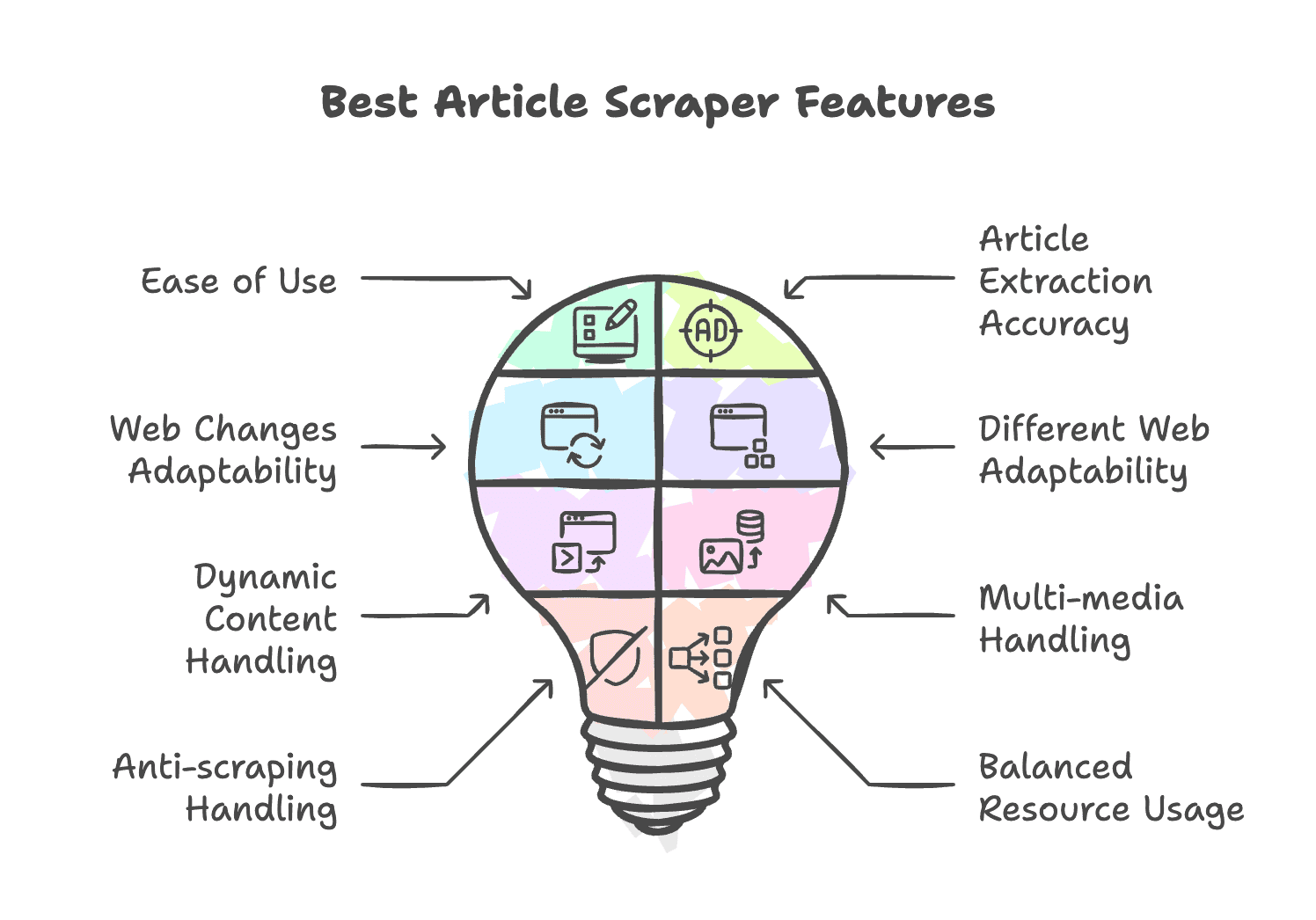

Qu’est-ce qui fait le meilleur extracteur d’articles en 2026 ?

Un extracteur d’articles performant trouve le bon équilibre entre performance, coût, facilité d’utilisation, flexibilité et évolutivité. Voici les critères pour choisir le meilleur extracteur d’articles en 2026 :

- Facilité d’utilisation : interface intuitive, sans code.

- Précision d’extraction des articles : identification précise des informations pertinentes, sans publicités ni éléments de navigation.

- Adaptabilité aux changements du web : adaptation automatique aux changements de structure ou de style, sans maintenance fréquente.

- Adaptabilité à différents sites : fonctionnement sur diverses structures web.

- Gestion du contenu dynamique : prise en charge du chargement dynamique via JavaScript ou AJAX.

- Gestion des multimédias : reconnaissance des images, vidéos et fichiers audio.

- Gestion de l’anti-extraction : utilisation de la rotation d’IP, de solutions CAPTCHA et de proxys pour contourner les mécanismes anti-extraction.

- Consommation de ressources équilibrée : sans usage excessif de mémoire ni de ressources de calcul.

Les meilleurs extracteurs d’articles et de news en un coup d’œil

| Outils | Fonctionnalités clés | Idéal pour | Tarifs |

|---|---|---|---|

| Thunderbit | extracteur propulsé par l’IA ; modèles prêts à l’emploi ; prise en charge de l’extraction de PDF, d’images et de documents ; capacités avancées de traitement des données | Utilisateurs sans profil technique ayant besoin d’extraire plusieurs sites de niche | Essai gratuit de 7 jours, à partir de 9 $/mois (forfait annuel) |

| WebScraper.io | Extension de navigateur ; prise en charge du contenu dynamique ; sans intégration de proxy | Utilisateurs ne traitant pas de pages web complexes ni de fonctionnalités avancées | Essai gratuit de 7 jours, à partir de 40 $/mois (forfait annuel) |

| Browse.ai | Extracteur et outil de surveillance no-code ; robots préconstruits ; navigateur virtuel ; plusieurs méthodes de pagination ; intégration puissante | Entreprises ayant besoin d’extraire des sites complexes à grande échelle | 19 $/mois (forfait annuel) |

| Octoparse | Extracteur no-code basé sur les sélecteurs CSS ; détection automatique et génération du workflow d’extraction ; modèles d’extracteur d’articles prêts à l’emploi ; navigateur virtuel ; mécanismes anti-anti-extraction | Entreprises ayant besoin d’extraire des sites complexes | À partir de 99 $/mois (forfait annuel) |

| Bardeen | Capacités complètes d’automatisation web ; modèles prêts à l’emploi ; extracteur no-code ; intégration fluide avec l’espace de travail | Équipes GTM intégrant l’extraction d’articles dans des workflows existants | Essai gratuit de 7 jours, à partir de 99 $/mois (forfait annuel) |

| PandaExtract | Interface conviviale ; détection et étiquetage automatiques | Utilisateurs ayant besoin d’une extraction rapide en un clic, sans configuration complexe | 49 $ à vie |

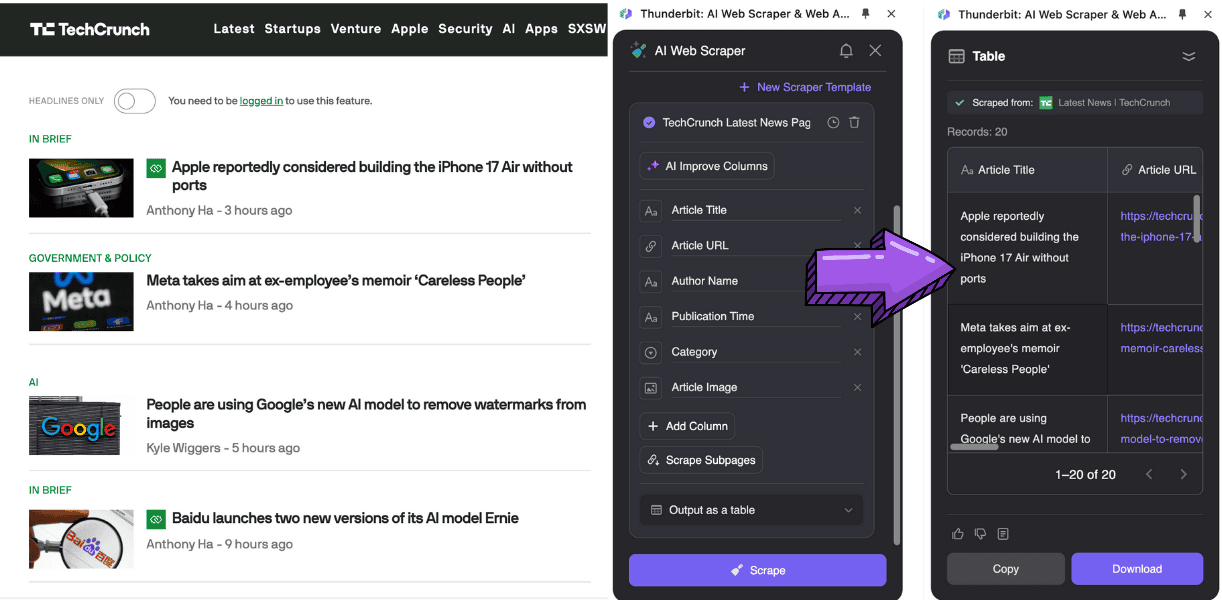

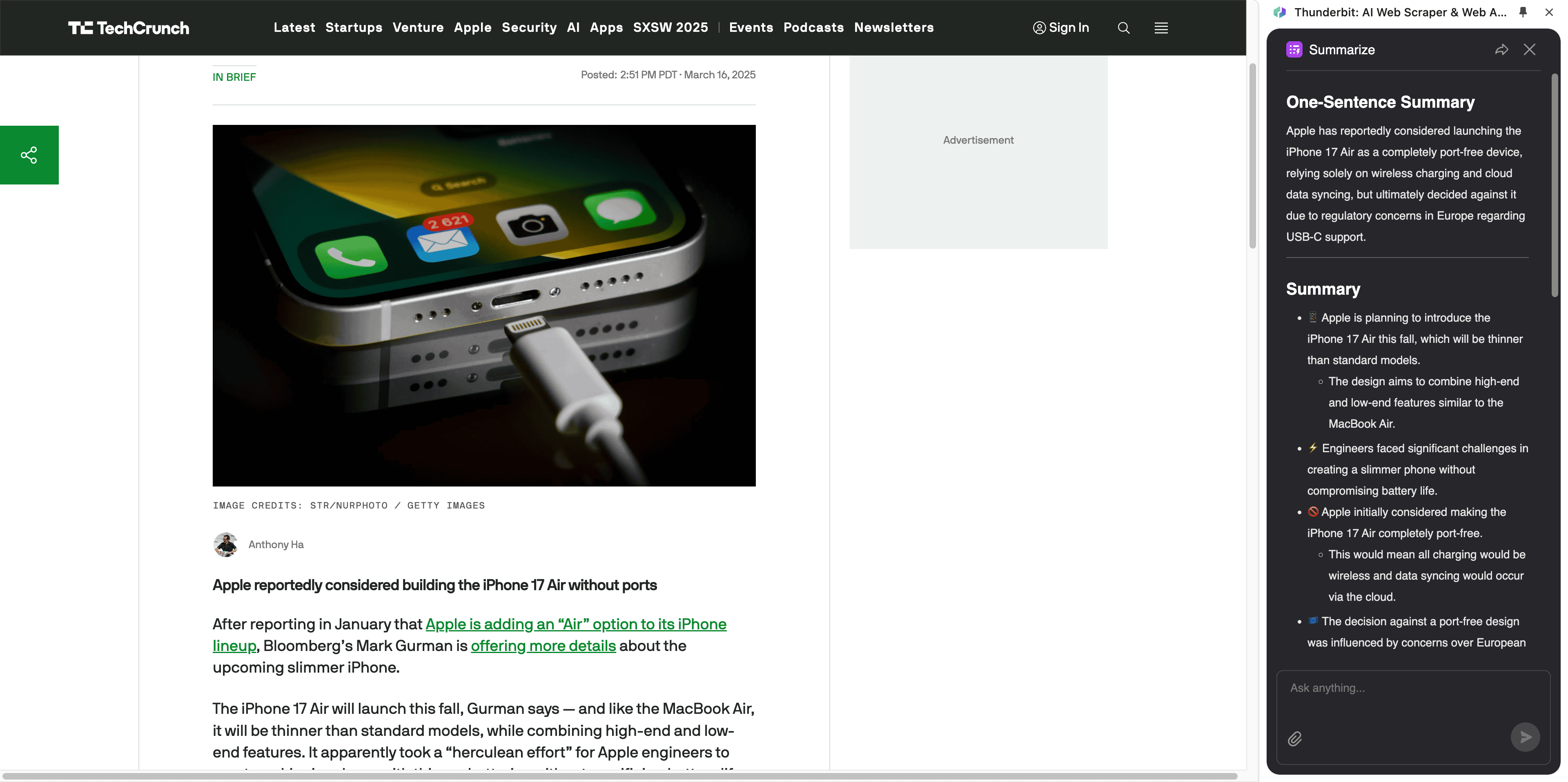

L’extracteur d’articles IA le plus puissant pour les utilisateurs professionnels

- Avantages :

- Utilise le langage naturel pour faire appel à l’IA afin de reconnaître et d’analyser les informations web, sans sélecteurs CSS

- Analyse de données assistée par l’IA, incluant la conversion de format, la , la classification, la traduction et le balisage

- pour extraire en un clic des listes d’articles et leur contenu

- Inconvénients :

- Actuellement disponible uniquement en tant qu’

- Ne convient pas à l’extraction de données à grande échelle

- Vitesse plus lente pour l’extraction sur plusieurs pages, mais possibilité d’extraire en arrière-plan pour obtenir des résultats plus rapidement

Un extracteur d’articles propulsé par l’IA pour les entreprises

Browse.ai

- Avantages :

- Extracteur et outil de surveillance d’articles no-code

- Prise en charge du fonctionnement via navigateur virtuel pour éviter de déclencher les mécanismes anti-extraction

- Nombreux robots d’extraction d’articles préconstruits pour extraire en un clic , , et bien plus

- Intégration poussée avec des plateformes comme et pour connecter les outils

- Inconvénients :

- L’extraction approfondie nécessite la création de deux robots, ce qui complexifie le processus

- Les sélecteurs CSS manquent de précision pour les sites de niche

- Prix élevé, mieux adapté aux tâches d’extraction continue à grande échelle

Un extracteur no-code pour l’extraction de données à petite échelle

PandaExtract

- Avantages :

- Identifie automatiquement les listes d’articles et les détails grâce à une interface conviviale

- Peut extraire des listes, des fiches détaillées, des e-mails et des images, ce qui convient à l’extraction de données structurées à petite échelle

- Paiement unique pour une utilisation à vie

- Inconvénients :

- Disponible uniquement sous forme d’extension de navigateur, sans exécution dans le cloud

- La version gratuite ne permet que le copier-coller, pas l’export vers CSV, JSON, etc.

Un extracteur d’articles prêt à l’emploi pour les organisations

Octoparse

- Avantages :

- Extracteur d’articles no-code avec détection automatique pour reconnaître la structure web et générer le workflow d’extraction

- Nombreux modèles d’extracteurs d’articles prêts à l’emploi

- Utilise un navigateur virtuel avec rotation d’IP, solutions CAPTCHA et proxys pour contourner les mécanismes anti-extraction

- Inconvénients :

- La détection automatique repose toujours sur la logique des sélecteurs CSS, avec une précision moyenne

- Les fonctionnalités avancées demandent un apprentissage et des compétences techniques

- Coût élevé pour l’extraction de données à grande échelle

L’automatisation la plus complète pour les équipes GTM

Bardeen

- Avantages :

- Extracteur d’articles no-code utilisant un LLM pour une automatisation en un clic

- S’intègre avec plus de 100 applications, dont , et

- Outils puissants d’automatisation web pour l’analyse IA après l’extraction des données

- Idéal pour intégrer l’extraction de données dans des workflows existants

- Inconvénients :

- Très dépendant des playbooks préconstruits, les workflows personnalisés nécessitent des essais et des ajustements

- Malgré l’absence de code, comprendre et configurer des automatisations complexes peut demander du temps d’apprentissage aux utilisateurs non techniques

- La configuration de l’extraction des sous-pages est complexe

- Très cher

Un extracteur d’articles léger pour une extraction instantanée des données

Webscraper.io

- Avantages :

- Extracteur no-code avec interface point-and-click

- Prend en charge le chargement de contenu dynamique

- Fonctionnement dans le cloud

- Intégration avec , et

- Inconvénients :

- Aucun modèle prêt à l’emploi, nécessite la création d’un sitemap personnalisé

- Courbe d’apprentissage pour les utilisateurs peu familiers avec les sélecteurs CSS

- Configuration complexe pour la pagination et l’extraction des sous-pages

- La version cloud est chère

Des solutions plus avancées pour les ingénieurs

Pour les profils techniques, il existe des . Ces solutions offrent :

- Flexibilité : appels API directs pour une extraction personnalisée, avec prise en charge du rendu dynamique et de la rotation d’IP

- Évolutivité : intégration dans des pipelines de données personnalisés pour des besoins d’entreprise à haute fréquence et à grande échelle

- Faible coût de maintenance : pas besoin de gérer des pools de proxys ni des stratégies anti-extraction, ce qui réduit le temps opérationnel

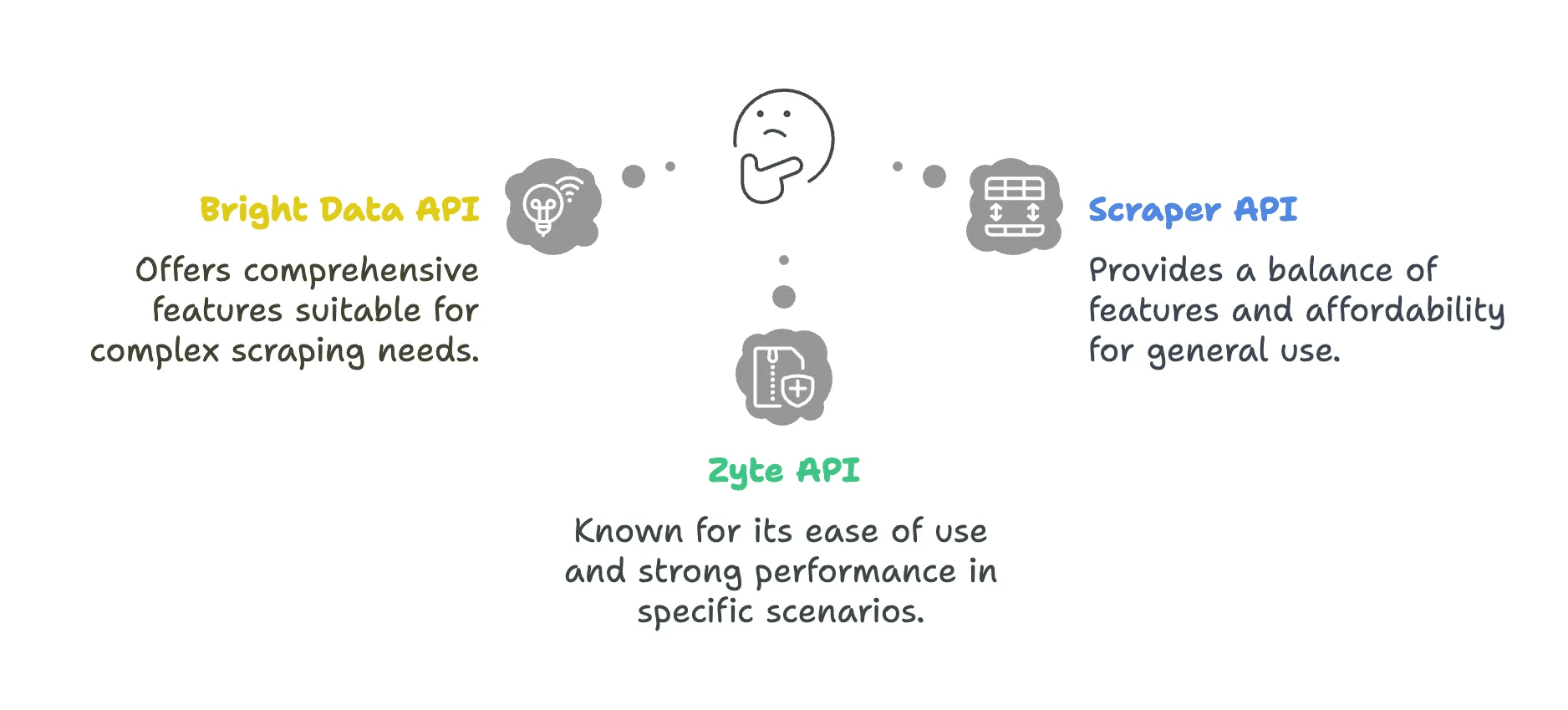

Les solutions API en un coup d’œil

| API | Avantages | Inconvénients |

|---|---|---|

| Bright Data API | - Réseau de proxys très étendu (plus de 72 M d’IP dans 195 pays) - Géociblage avancé jusqu’au niveau de la ville ou du code postal - Proxy Manager robuste pour la rotation d’IP | - Temps de réponse plus lents (22,08 s en moyenne) - Tarifs élevés, peu adaptés aux petites équipes - Courbe d’apprentissage plus forte pour la configuration |

| ScraperAPI | - Entrée de gamme à 49 $ - Fonction Autoparse pour l’extraction automatique des données - Lecteur d’interface web pour les tests | - Facture souvent les requêtes bloquées - Capacités limitées de rendu JavaScript - Les coûts peuvent grimper avec les paramètres premium |

| Zyte API | - Capacités d’analyse par IA - Ne facture pas les requêtes échouées | - Coût initial plus élevé (environ 450 $/mois) - Les crédits ne sont pas reportés d’un mois à l’autre |

- API d’extraction Web Bright Data

- Avantages :

- Couvre 195 pays avec plus de 72 M d’IP résidentielles, prend en charge la rotation automatique des IP et la simulation de géolocalisation, idéal pour les sites aux mécanismes anti-extraction stricts (par ex. et )

- Prend en charge le chargement dynamique de contenu JavaScript et la capture de snapshots de page

- Inconvénients :

- Coût élevé (facturation à la requête et à la bande passante), faible rentabilité pour les petits projets

- Avantages :

- Scraper API

- Avantages :

- 40 M de proxys à l’échelle mondiale, bascule automatique entre IP de centre de données et IP résidentielles, contournement de la vérification Cloudflare, intégration de solutions CAPTCHA tierces (par ex. )

- Points de terminaison structurés et extracteurs asynchrones pour une vitesse d’extraction plus rapide

- Inconvénients :

- Coût supplémentaire pour le rendu des pages dynamiques, prise en charge limitée des sites AJAX complexes

- Avantages :

- Zyte API

- Avantages :

- Extraction automatique des données web propulsée par l’IA, sans avoir à développer et maintenir des règles d’extraction pour chaque site

- Tarification flexible à l’usage

- Inconvénients :

- Les fonctionnalités avancées (par ex. gestion de session, navigateur scriptable) demandent un apprentissage

- Avantages :

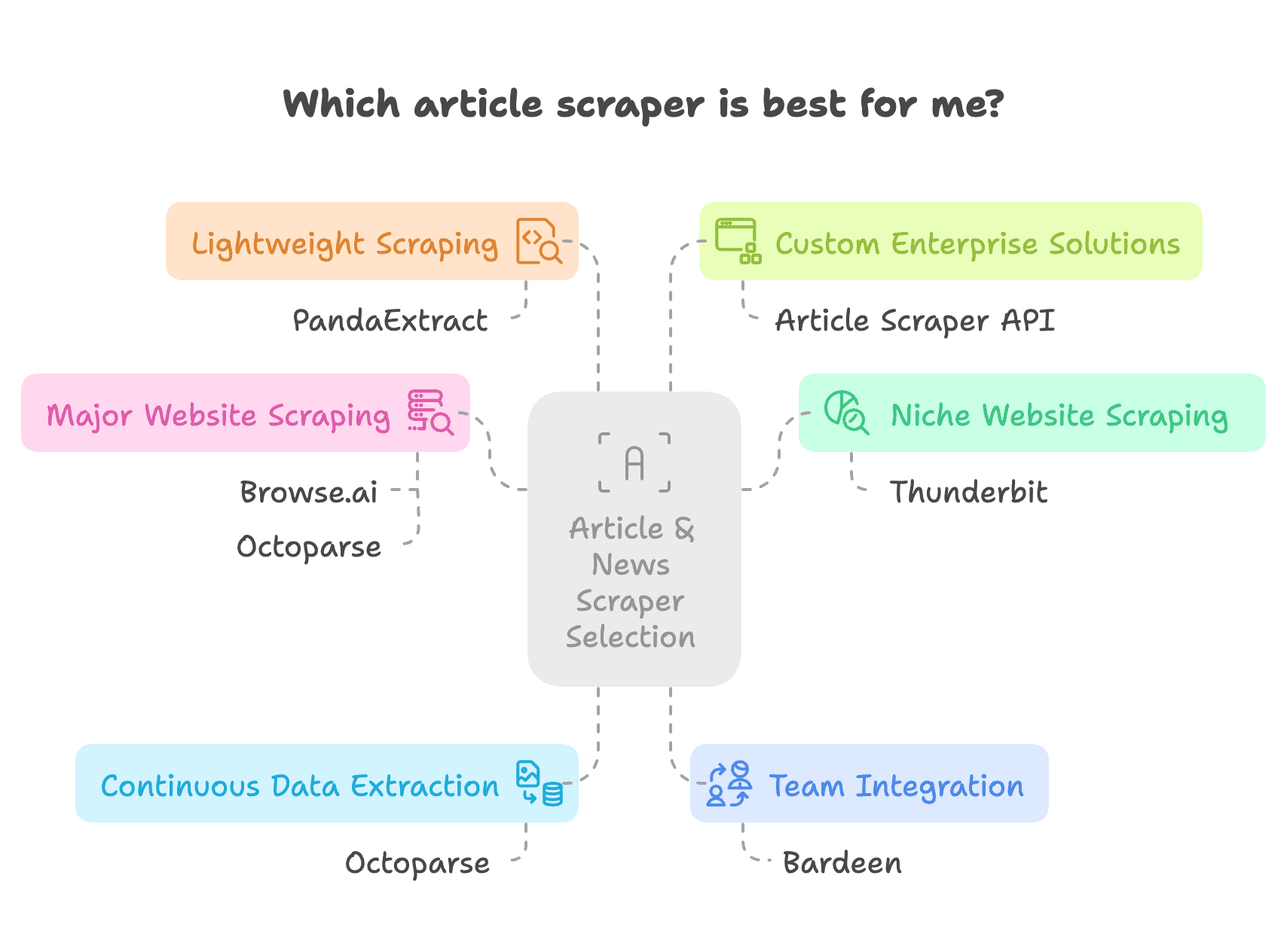

Comment choisir votre extracteur d’articles et de news ?

Au moment de choisir un extracteur d’articles et de news, pensez à vos besoins métier, à votre niveau technique et à votre budget.

- Si vous devez extraire plusieurs sites de niche sans créer un extracteur pour chaque page, et que vous avez le budget, est votre meilleur choix. Il ne repose pas sur des mais utilise l’IA pour analyser les structures web, ce qui permet aussi une analyse IA après l’extraction. Pour l’IA de Thunderbit, tous les sites se valent, et les articles entiers sont capturés avec précision.

- Pour extraire des news et des articles de grands sites comme le ou , vous aurez besoin d’un extracteur d’articles doté de mécanismes anti-extraction robustes et de modèles prêts à l’emploi, comme Browse.ai ou Octoparse. Cependant, la meilleure option reste une extension Chrome comme : le processus d’extraction imite la navigation et le copier-coller d’une personne, ce qui permet de gérer les informations de connexion sans configuration compliquée.

- Si vous avez besoin d’une extraction continue à grande échelle, les outils dotés de fonctions de planification, comme Octoparse, sont plus adaptés.

- Pour un usage en équipe et une intégration fluide dans des workflows existants, Bardeen est idéal, avec une large palette d’outils d’automatisation web au-delà de l’extraction d’articles.

- Si vous voulez un extracteur léger pour de petites extractions sans perdre du temps à apprendre, choisissez un extracteur d’articles point-and-click comme PandaExtract.

- Si vous avez un profil technique ou que vous construisez un extracteur d’articles d’entreprise, envisagez des outils API ou la création de votre propre extracteur, en plus de ces .

Conclusion

Cet article a présenté le concept et les cas d’usage métier des extracteurs d’articles et de news. Les reposent sur des , ce qui exige une certaine connaissance du et du du web, surtout pour les opérations avancées. La nouvelle génération d’ s’appuie entièrement sur la compréhension sémantique et la reconnaissance visuelle de l’IA, et dépasse les pour l’adaptation aux changements de structure web, la généralisation intersites, la gestion du contenu dynamique, ainsi que le nettoyage et l’analyse des données en aval.

L’article a également सूची six extracteurs d’articles et de news utiles, ainsi que des outils API pour les développeurs, en comparant leurs avantages et inconvénients, leurs volumes de données adaptés, leurs fonctionnalités web et leurs publics cibles. Quand vous envisagez l’extraction d’articles et de news, choisissez la solution qui correspond à vos besoins métier tout en équilibrant performance et coût.

FAQ

1. Qu’est-ce qu’un extracteur d’articles IA et comment fonctionne-t-il ?

- Il utilise l’IA pour analyser et extraire le contenu des pages web sans nécessiter de sélecteurs CSS.

- Il identifie avec grande précision les titres, auteurs, dates de publication et contenu principal.

- Il supprime automatiquement les publicités, menus de navigation et autres éléments non pertinents.

- Il s’adapte aux changements de structure web et fonctionne sur différents sites.

2. Quels sont les avantages d’un extracteur d’articles propulsé par l’IA par rapport aux extracteurs traditionnels ?

- Il peut extraire le contenu de plusieurs sites avec un seul outil.

- Il gère le contenu dynamique, y compris les pages chargées en JavaScript et AJAX.

- Il demande moins de configuration manuelle et de maintenance que les extracteurs basés sur CSS.

- Il offre des fonctions supplémentaires comme la synthèse, la traduction et l’analyse de sentiment.

3. Puis-je utiliser Thunderbit pour l’extraction d’articles IA sans compétences en code ?

- Oui, Thunderbit est conçu pour les utilisateurs non techniques avec une interface simple, sans code.

- Il utilise l’IA pour détecter et extraire automatiquement le contenu des articles.

- Il propose des modèles prêts à l’emploi pour une extraction rapide et efficace.

- Il permet d’exporter les données vers différents formats comme CSV, JSON et Google Sheets.

En savoir plus :