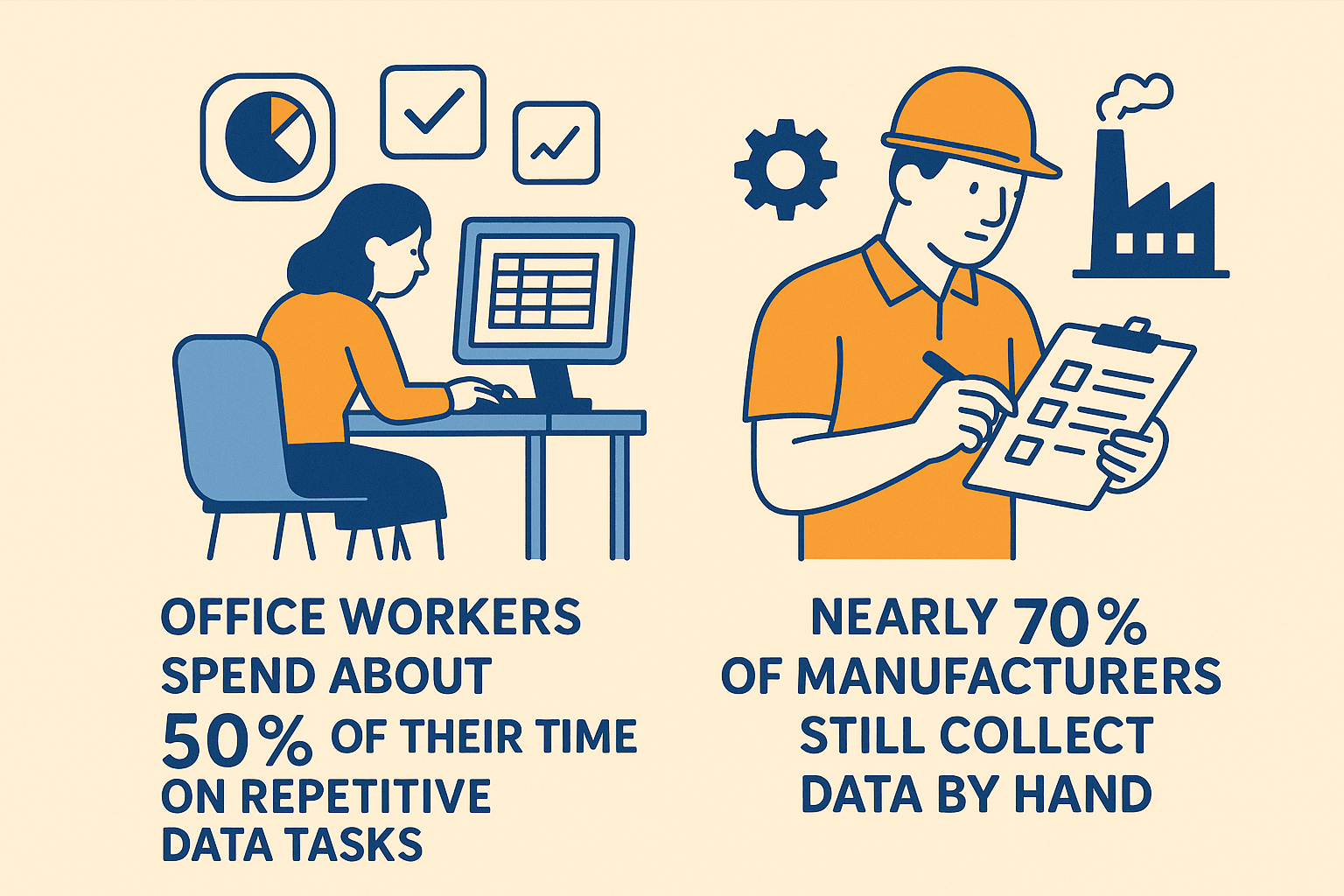

Hast du schon mal versucht, deinen Garten mit einem löchrigen Schlauch zu gießen? Dann weißt du, wie nervig es ist, wenn das Wasser einfach nicht da ankommt, wo es hin soll. Stell dir jetzt vor, dieser Schlauch ist die Dateninfrastruktur deines Unternehmens – und statt ein paar Tropfen musst du einen reißenden Strom an Infos aus zig Quellen gleichzeitig bändigen. Willkommen im Zeitalter der modernen Datenverwaltung! Bis 2025 werden voraussichtlich an Daten produziert – Unternehmen stehen also mächtig unter Druck, mitzuhalten. Die Herausforderungen sind enorm: Büroangestellte verbringen etwa mit immer gleichen Datentätigkeiten, und fast tippen Daten immer noch per Hand ein. Kein Wunder, dass sich viele Teams fühlen, als müssten sie mit einem Teelöffel ein sinkendes Boot ausschöpfen.

Hier kommen Data Pipelines ins Spiel. Sie sind quasi das „Rohrsystem“ für deine Unternehmensdaten: Sie verbinden, säubern und liefern Infos genau dorthin, wo sie gebraucht werden – schnell, zuverlässig und ohne große Verluste. Nach vielen Jahren in der SaaS- und Automatisierungswelt (und einigen „Schlauchsystemen“, die unter Druck geplatzt sind) weiß ich: Eine gute Data Pipeline macht aus Datenchaos echte Klarheit. Lass uns anschauen, was eine Data Pipeline eigentlich ist, warum sie so wichtig ist und wie neue Tools – vor allem KI-gestützte Web-Scraper wie – die Spielregeln für Vertrieb, Marketing und viele andere Bereiche komplett verändern.

Hier kommen Data Pipelines ins Spiel. Sie sind quasi das „Rohrsystem“ für deine Unternehmensdaten: Sie verbinden, säubern und liefern Infos genau dorthin, wo sie gebraucht werden – schnell, zuverlässig und ohne große Verluste. Nach vielen Jahren in der SaaS- und Automatisierungswelt (und einigen „Schlauchsystemen“, die unter Druck geplatzt sind) weiß ich: Eine gute Data Pipeline macht aus Datenchaos echte Klarheit. Lass uns anschauen, was eine Data Pipeline eigentlich ist, warum sie so wichtig ist und wie neue Tools – vor allem KI-gestützte Web-Scraper wie – die Spielregeln für Vertrieb, Marketing und viele andere Bereiche komplett verändern.

Was ist eine Data Pipeline? Einfach erklärt

Im Kern ist eine Data Pipeline eine automatisierte Abfolge von Schritten, die Daten von einer Quelle zu einem Ziel bringt und sie dabei so aufbereitet, dass sie wirklich nutzbar werden. Zwei Vergleiche machen es anschaulich:

- Rohrsystem-Vergleich: Wie Wasser durch Rohre vom Reservoir zum Wasserhahn fließt – gefiltert und gereinigt –, so transportiert eine Data Pipeline Rohdaten aus Quellen (wie Datenbanken, APIs oder Webseiten) zu Zielen (wie Dashboards oder Data Warehouses) und bereitet sie unterwegs auf ().

- Pizzaküchen-Vergleich: Stell dir eine Pizzaküche vor: Teig, Soße, Belag, Backen, Verpacken. Eine Data Pipeline funktioniert ähnlich – aus Rohdaten werden durch verschiedene Verarbeitungsschritte wertvolle Infos, die am Ende als „fertige Pizza“ zur Analyse bereitstehen ().

Kurz gesagt: Eine Data Pipeline sammelt Daten aus verschiedenen Quellen, verarbeitet sie (z. B. säubern, zusammenführen, umwandeln) und liefert sie automatisch und oft in Echtzeit dorthin, wo dein Team sie braucht.

Die wichtigsten Phasen einer Data Pipeline

- Datenerfassung (Ingestion): Daten werden aus Quellen wie Datenbanken, APIs, Dateien oder per Web Scraping eingesammelt.

- Verarbeitung/Transformation: Die Daten werden gesäubert, vereinheitlicht und angereichert (z. B. Tippfehler korrigieren, Listen zusammenführen, Summen berechnen).

- Speicherung und Bereitstellung: Die aufbereiteten Daten landen in einem Data Warehouse, Dashboard oder einer App und stehen für Analysen oder Aktionen bereit.

Ohne Pipeline bleibt nur der manuelle Export, endlose Excel-Tabellen und die Hoffnung, dass unterwegs nichts verloren geht.

Warum Data Pipelines für Unternehmen unverzichtbar sind

Warum sollten sich auch Leute ohne IT-Background für Data Pipelines interessieren? Ganz einfach: Sie sind die Basis für schnelle, datenbasierte Entscheidungen. So profitieren Unternehmen davon:

- Schnelle Erkenntnisse & bessere Entscheidungen: Mit Pipelines stehen Daten fast in Echtzeit bereit. Vertriebsteams sehen neue Leads sofort – wer innerhalb von 5 Minuten reagiert, hat .

- Abbau von Datensilos: Pipelines holen Daten aus verschiedenen Abteilungen (Vertrieb, Marketing, Operations) zusammen und schaffen eine einheitliche Sicht. sehen Datensilos als großes Problem.

- Effizienz & Automatisierung: Automatisierte Datenprozesse sparen richtig viel Zeit. Ein Marketingteam sparte durch automatisierte Berichte.

- Datengetriebene Unternehmenskultur: Wenn alle auf aktuelle Daten zugreifen können, sind Self-Service-Analysen möglich – kein Warten mehr auf IT-Reports.

- Mehrwert & Wettbewerbsvorteil: Unternehmen mit modernen Pipelines erzielen in drei Jahren – dank Effizienz und besseren Entscheidungen.

Hier siehst du, wie verschiedene Teams profitieren:

Hier siehst du, wie verschiedene Teams profitieren:

| Team | Pipeline-Vorteil | Beispielhafte Auswirkung |

|---|---|---|

| Vertrieb | Echtzeit-Leads/Kundendaten, CRM-Updates | Schnellere Reaktion = 21× höhere Lead-Qualifizierung (Voiso) |

| Operations | Einheitliche, aktuelle Kennzahlen | Genaue Bestände = weniger Ausverkäufe, bessere Prognosen (Aampe) |

| Marketing | Integrierte Analysen, Kampagnenoptimierung | 80 Stunden/Monat bei Berichten gespart (Coupler) |

| Finanzen | Automatisierte Konsolidierung, schnellere Berichte | Echtzeit-Gewinnübersicht, schnellere Monatsabschlüsse |

| Analytics/BI | Zentrale, saubere Datenbasis für Analysen | Weniger Zeit für Datenaufbereitung, mehr Zeit für Insights |

Fazit: Data Pipelines machen aus Daten ein strategisches Asset statt einer Dauerbaustelle.

Die klassische Datenmanagement-Herausforderung: Warum Veränderung nötig war

Vor Data Pipelines war Datenmanagement oft ein mühsames, fehleranfälliges Handwerk. So sah das aus:

- Manuelle Datenübertragung: Teams exportierten CSVs, verschickten Dateien per E-Mail und kopierten Daten zwischen Systemen. Das war zeitaufwendig und fehleranfällig. gingen für Routineaufgaben drauf.

- Datensilos: Jede Abteilung hatte eigene Zahlen – das führte zu widersprüchlichen Berichten und endlosen Abstimmungsrunden. berichten von Silos in ihren Unternehmen.

- Langsame, periodische Updates: Berichte wurden wöchentlich oder monatlich aktualisiert – Entscheidungen hinkten der Realität hinterher. Im Handel verfügen .

- Fehleranfällige Prozesse: Manuelle Schritte führten zu Fehlern – von Copy-Paste-Pannen bis zu veralteten Dateien. enthalten mindestens einen kritischen Fehler.

- Mangelnde Flexibilität: Ein neuer Bericht oder eine Kennzahl? Das bedeutete oft wochenlange Handarbeit oder IT-Projekte.

Mit dem rasanten Datenwachstum waren diese Methoden nicht mehr tragbar – wie ein Marathon in Flip-Flops: langsam, schmerzhaft und nicht zu empfehlen (außer man steht auf Blasen und Nachtschichten mit chaotischen Tabellen).

Wie Data Pipelines das Datenmanagement revolutionieren

Data Pipelines automatisieren und optimieren den kompletten Datenfluss. Was ändert sich konkret?

Vorher (manuell):

- Wöchentliche Verkaufsberichte dauern 8 Stunden.

- Daten sind immer veraltet.

- Fehler schleichen sich ein, jede neue Anfrage bedeutet mehr Handarbeit.

Nachher (mit Pipeline):

- Daten werden täglich (oder in Echtzeit) erfasst, gesäubert und bereitgestellt.

- Berichte aktualisieren sich automatisch – keine nächtlichen Excel-Marathons mehr.

- Fehler werden früh erkannt, alle arbeiten mit denselben, aktuellen Daten.

Beispiel: Ein Handelsunternehmen mit Pipeline sieht jeden Morgen aktuelle Verkaufs-, Bestands- und Marketingzahlen im Dashboard. Sinkt der Absatz eines Produkts plötzlich, weiß das Team sofort Bescheid – nicht erst eine Woche später. Das ist echte Agilität.

Die Bausteine einer Data Pipeline

Jede Data Pipeline – egal ob simpel oder komplex – besteht aus diesen Grundelementen:

- Datenquellen: Woher die Daten kommen – Datenbanken, Apps, Dateien, APIs oder Webseiten (per Web Scraping).

- Erfassung/Extraktion: Der Prozess, mit dem Daten aus den Quellen in die Pipeline gelangen.

- Transformation/Verarbeitung: Die Daten werden gesäubert, zusammengeführt und formatiert.

- Speicherung: Die verarbeiteten Daten werden in einem Data Warehouse, Data Lake oder einer Datenbank abgelegt.

- Bereitstellung (Konsum): Die Daten werden in Dashboards, Berichten oder anderen Anwendungen verfügbar gemacht.

Kurz: Quelle → Erfassung → Transformation → Speicherung → Bereitstellung.

Beispiel: Eine Vertriebspipeline zieht Leads von einer Website (Quelle), extrahiert sie (Erfassung), säubert Telefonnummern (Transformation), speichert sie im CRM (Speicherung) und benachrichtigt die Vertriebsmitarbeiter (Bereitstellung).

Arten von Data Pipelines: Batch vs. Echtzeit

| Aspekt | Batch-Pipeline | Echtzeit-Pipeline |

|---|---|---|

| Datenfrequenz | Periodisch (täglich, stündlich, wöchentlich) | Kontinuierlich (Sekunden oder Millisekunden) |

| Latenz | Höher (Minuten bis Stunden) | Gering (nahezu sofort) |

| Anwendungsfälle | Regelmäßige Berichte, Monatsabschlüsse, Massenimporte | Live-Dashboards, Betrugserkennung, Echtzeit-Personalisierung |

| Vorteile | Einfacher, zuverlässig, gut für historische Analysen | Sofortige Einblicke, schnelle Reaktionen, ideal für zeitkritische Prozesse |

| Herausforderungen | Daten können zwischen den Läufen veralten | Komplexer, benötigt robuste Streaming-Infrastruktur |

Die meisten Unternehmen nutzen beides: Batch für z. B. Gehaltsabrechnung oder historische Analysen, Echtzeit für alles, wo Geschwindigkeit zählt (z. B. Börsenhandel, Live-Bestände, Betrugswarnungen).

Wo passt Web Scraping in die Data Pipeline?

Jetzt wird’s spannend (und hier glänzt Thunderbit): Nicht alle Daten liegen schön strukturiert in Datenbanken oder als API vor. Oft sind die gesuchten Infos in Webseiten, PDFs oder Bildern versteckt – unstrukturiert und nicht einfach exportierbar.

Web Scraping ist die Kunst, Daten automatisiert von Webseiten zu holen. In einer Data Pipeline ist Web Scraping die Methode zur Datenerfassung für Quellen, die sonst nicht zugänglich wären.

Typische Business-Anwendungen für Web Scraping in Data Pipelines

- Preisbeobachtung bei Wettbewerbern: Einzelhändler checken Preise auf Konkurrenzseiten und passen ihre eigenen dynamisch an ().

- Lead-Generierung: Vertriebsteams holen Kontakte aus Verzeichnissen, LinkedIn oder Eventseiten und spielen sie direkt ins CRM ein.

- Marktforschung: Marketing sammelt Bewertungen, Forenbeiträge oder Social-Media-Kommentare für Stimmungsanalysen und Trendbeobachtung.

- Immobilien: Makler aggregieren Angebote von verschiedenen Portalen, um Markttrends zu analysieren oder eigene Datenbanken aufzubauen ().

- Öffentliche Datensammlung: Scraping von Regierungs-, Forschungs- oder öffentlichen Portalen für Analysen oder Compliance.

Web Scraping ist der „erste Kilometer“ der Pipeline für externe, unstrukturierte Daten – und macht aus Webseiten verwertbare Infos.

Thunderbit: Die Datenerfassung mit KI-Web-Scraping optimieren

Ich bin vielleicht etwas voreingenommen, aber schauen wir uns an, wie die Datenerfassung nicht nur einfacher, sondern auch schlauer macht.

Was macht Thunderbit besonders?

- 2-Klick-Scraping mit KI-Vorschlägen: Einfach auf „KI-Felder vorschlagen“ klicken – Thunderbits KI liest die Seite, schlägt passende Spalten vor (z. B. „Produktname“, „Preis“, „Bewertung“) und extrahiert die Daten. Kein Code, kein Selector-Gefummel – einfach Ergebnisse ().

- Funktioniert mit Webseiten, PDFs und Bildern: Thunderbit kann nicht nur Webseiten, sondern auch PDFs und Bilder per KI-OCR auslesen – und das in .

- Unterseiten & Paginierung: Du brauchst Details von Unterseiten (z. B. einzelne Profile oder Produktseiten)? Thunderbits KI klickt sich durch, sammelt Zusatzinfos und fügt alles automatisch zusammen.

- Sofort-Vorlagen für beliebte Seiten: Für Plattformen wie Amazon, Zillow oder LinkedIn gibt’s fertige Templates – auswählen und loslegen, ohne Konfiguration.

- Direkter Export in deine Tools: Exportiere Daten direkt nach Excel, Google Sheets, Airtable oder Notion – oder lade sie als CSV/JSON herunter.

- Geplanter Scraper: Richte wiederkehrende Scrapes ein („jeden Montag um 9 Uhr“), damit deine Pipeline immer mit frischen Daten versorgt wird – ganz ohne manuelle Updates.

- KI-Datenanreicherung: Mit Field-AI-Prompts kannst du Daten beim Scraping automatisch labeln, kategorisieren oder sogar übersetzen lassen.

Thunderbit im Einsatz: Ein Praxisbeispiel für die Pipeline

Angenommen, du bist Marketing-Analyst und willst Bewertungen von drei E-Commerce-Seiten beobachten. Mit Thunderbit:

- Öffne jede Seite, starte die Erweiterung und lass „KI-Felder vorschlagen“ die Spalten „Bewertungstext“, „Bewertung“ und „Datum“ erkennen.

- Plane wöchentliche Scrapes – Thunderbit zieht die neuesten Bewertungen und exportiert sie nach Google Sheets.

- Nutze KI-Prompts, um die Stimmung (positiv/negativ/neutral) direkt im Output zu markieren.

- Deine Pipeline liefert jetzt jede Woche ein aktuelles Bewertungs-Dashboard – ohne Copy-Paste, ohne Datenlücken.

So sparen Teams stundenlanges manuelles Datensammeln und bekommen in Minuten alle nötigen Infos. Und weil Thunderbit so einfach ist, können auch Nicht-Techniker eigene Pipelines bauen und pflegen.

Die Zukunft: KI-gesteuerte Data Pipelines für smarte Entscheidungen

Jetzt wird’s richtig spannend. Die nächste Generation von Data Pipelines transportiert nicht nur Daten – sie macht sie unterwegs auch schlauer.

- Automatisierte Datenaufbereitung: KI kann Daten automatisch säubern, anreichern und sogar zusammenführen. Bald reicht ein Befehl wie „Kombiniere Verkaufs- und Wetterdaten nach Region“ – und die KI erledigt den Rest ().

- Echtzeit-Intelligenz: Pipelines analysieren Daten schon beim Eintreffen, erkennen Auffälligkeiten und können Aktionen auslösen (z. B. Benachrichtigung, wenn ein Wettbewerber die Preise senkt).

- KI-Empfehlungen: Statt nur Zahlen zu liefern, geben Pipelines konkrete Hinweise – „Umsatz in Region X um 15 % gesunken, vermutlich wegen einer Aktion des Wettbewerbers“.

- Natürliche Sprachsteuerung: Bald kannst du Pipelines einfach per Sprache oder Text konfigurieren – ganz ohne Programmierkenntnisse.

Thunderbit ist da schon auf dem Weg: mit KI-Feldvorschlägen, automatischer Anreicherung und natürlicher Sprachplanung. Die Vision: Pipelines, die nicht nur Daten bewegen, sondern auch helfen, sie zu verstehen und zu nutzen – ganz ohne Data-Engineering-Studium.

Fazit: Warum jedes Unternehmen Data Pipelines braucht

Die wichtigsten Punkte auf einen Blick:

- Eine Data Pipeline ist die Lieferkette deiner Daten – sie automatisiert den Weg von chaotischen Quellen zu verwertbaren Erkenntnissen.

- Pipelines lösen klassische Probleme wie manuelle Arbeit, Datensilos und langsame, fehleranfällige Berichte.

- Alle Teams profitieren: Vertrieb reagiert schneller auf Leads, Marketing bekommt Echtzeit-Analysen, Operations hat aktuelle Bestände, Führungskräfte eine zentrale Datenbasis.

- Web Scraping ist dank KI-Tools wie Thunderbit fester Bestandteil moderner Pipelines und macht externe Daten für alle zugänglich.

- Die Zukunft ist KI-gesteuert: Pipelines werden immer schlauer, automatisierter und benutzerfreundlicher – so können auch Fachabteilungen ohne IT-Hürden Datenflüsse aufbauen und nutzen.

Wenn dein Unternehmen noch im Copy-Paste-Zeitalter feststeckt, ist jetzt der perfekte Zeitpunkt für einen Neustart. Fang klein an – automatisiere einen Wochenbericht, probiere ein Tool wie aus und erlebe, wie viel Zeit (und Nerven) du sparst. Der Sprung vom Tabellen-Chaos zu klaren, automatisierten Datenflüssen ist näher – und einfacher – als du denkst.

Du willst tiefer einsteigen? Im findest du weitere Anleitungen – oder erfahre, wie du und .

FAQs

1. Was ist eine Data Pipeline einfach erklärt?

Eine Data Pipeline ist ein automatisierter Prozess, der Daten aus verschiedenen Quellen sammelt, verarbeitet und an einen Zielort liefert – wie ein Rohrsystem für die Infos deines Unternehmens.

2. Warum sind Data Pipelines für Unternehmen wichtig?

Sie sparen Zeit, reduzieren Fehler und sorgen dafür, dass alle mit denselben, aktuellen Daten arbeiten. Das ermöglicht schnellere Entscheidungen, bessere Zusammenarbeit und mehr Wertschöpfung in Vertrieb, Marketing, Operations und Co.

3. Wie passt Web Scraping in eine Data Pipeline?

Web Scraping dient als Datenquelle und extrahiert Infos von Webseiten, die keine einfachen Exporte oder APIs bieten. Es ist unverzichtbar, um externe, unstrukturierte Daten wie Preise, Bewertungen oder öffentliche Verzeichnisse zu erfassen.

4. Was macht Thunderbit zur guten Wahl für die Datenerfassung in Pipelines?

Thunderbit nutzt KI, um Web Scraping einfach und leistungsstark zu machen – mit nur zwei Klicks strukturierte Daten von jeder Website extrahieren, inklusive Unterseiten, Vorlagen und direktem Export in deine Lieblingstools.

5. Wie sieht die Zukunft von Data Pipelines mit KI aus?

KI-gesteuerte Pipelines automatisieren nicht nur den Datenfluss, sondern auch Bereinigung, Anreicherung und Analyse – so können Fachabteilungen mit natürlicher Sprache Pipelines bauen und verwalten und in Echtzeit proaktiv handeln.

Neugierig, was eine moderne Data Pipeline für dein Unternehmen leisten kann? und starte noch heute mit eigenen, smarten Datenflüssen. Mehr erfahren