Das Web wächst in einem Tempo, das man sich ehrlich gesagt kaum vorstellen kann. Jeden Tag werden Milliarden neue Seiten, Produkte, Bewertungen und Datensätze veröffentlicht – und treiben alles an, von Marktanalysen über KI-Training bis hin zu Ihrem nächsten Amazon-Einkauf. Als jemand, der viele Jahre in SaaS und Automatisierung gearbeitet hat, habe ich aus erster Hand erlebt, wie die richtigen Daten über Erfolg oder Misserfolg einer Geschäftsentscheidung entscheiden können. Doch hier liegt das Problem: Diese Webdaten zu sammeln, aktuell zu halten und sinnvoll auszuwerten wird immer schwieriger, nicht einfacher. Klassische Web Scraper kommen kaum noch hinterher, und Unternehmen suchen nach einer intelligenteren, schnelleren Möglichkeit, das Internet in verwertbare Erkenntnisse zu verwandeln. Genau hier kommt der Cloud Crawler ins Spiel – ein Tool, das still und leise verändert, wie Organisationen Webdaten in großem Maßstab finden und nutzen.

Aber was genau ist ein Cloud Crawler? Worin unterscheidet er sich von den Web-Scrapern, die Sie vielleicht schon kennen? Und warum setzen Teams von Vertrieb bis Operations auf diese Technologie, um in einer datengetriebenen Welt vorne zu bleiben? Schauen wir uns das genauer an, entzaubern die Fachbegriffe und sehen wir, wie Cloud Crawler – insbesondere die Lösung von Thunderbit – die Spielregeln für moderne Unternehmen verändern.

Was ist ein Cloud Crawler? Der nächste Schritt bei der Datenerkennung

Kurz gesagt: Ein Cloud Crawler ist nicht einfach nur ein Web Scraper, der in der Cloud läuft. Er funktioniert eher wie eine Engine zur Datenerkennung – ein intelligentes, cloudbasiertes System, das automatisch riesige Datenmengen im Internet findet, extrahiert und analysiert. Während ein herkömmlicher Web Scraper Informationen von einigen wenigen Seiten abruft – meist nacheinander und oft nur auf einem einzelnen Gerät –, arbeitet ein Cloud Crawler auf einer ganz anderen Ebene. Er läuft in leistungsstarken Cloud-Rechenzentren, durchsucht tausende oder sogar Millionen von Seiten gleichzeitig und kann alles verarbeiten, von Text über Bilder bis hin zu PDFs – ganz gleich, wie komplex oder umfangreich die Zielwebsite ist.

Stellen Sie sich das so vor: Ein Web Scraper ist wie ein einzelner Bibliothekar, der Passagen aus einem Buch abschreibt. Ein Cloud Crawler hingegen ist ein Team aus Supercomputern, das gleichzeitig jedes Buch in der Bibliothek scannt, Inhalte markiert, organisiert und analysiert. Das Ergebnis? Unternehmen erhalten reichhaltigere, aktuellere und besser nutzbare Daten – ohne die Engpässe lokaler Hardware oder manuellen Aufwand (, ).

Cloud Crawler vs. klassischer Web Scraper: Wo liegt der echte Unterschied?

Wenn Sie schon einmal einen Web Scraper genutzt haben, kennen Sie das Prinzip: Seite angeben, gewünschte Daten definieren und das Tool die Informationen ziehen lassen. Doch je größer und komplexer das Web wird, desto deutlicher zeigen sich die Grenzen dieses alten Ansatzes. So schneiden Cloud Crawler und traditionelle Web Scraper im Vergleich ab:

| Merkmal/Aspekt | Klassischer Web Scraper | Cloud Crawler |

|---|---|---|

| Bereitstellung | Läuft auf Ihrem lokalen Gerät oder Server | Läuft in der Cloud (entfernte Rechenzentren) |

| Skalierung | Begrenzung durch die Leistung Ihres Computers | Massive Parallelisierung – tausende Seiten gleichzeitig |

| Geschwindigkeit | Langsamer, besonders bei großen Aufgaben | Hochgeschwindigkeits-Batch-Verarbeitung |

| Wartung | Braucht häufige Updates, bricht bei Website-Änderungen | Cloudbasiert, automatisch aktuell, deutlich robuster |

| Datentypen | Meist Text, manchmal Bilder | Text, Bilder, PDFs, komplexe Layouts |

| Zugriff | An Ihr Gerät/Ihr Netzwerk gebunden | Von überall und auf jedem Gerät nutzbar |

| Zeitplanung | Manuell oder einfache Automatisierung | Erweiterte Zeitplanung, wiederkehrende Jobs |

| Am besten geeignet für | Kleine Projekte, einfache Websites | Große, häufige oder komplexe Datenanforderungen |

Cloud Crawler sind für das moderne Web gemacht – in einer Welt, in der Daten überall sind und Geschwindigkeit sowie Skalierung nicht verhandelbar sind (, ).

Wie Cloud Crawler die Effizienz der Datenerfassung massiv steigern

Hier wird es richtig spannend. Cloud Crawler nutzen die Leistung des Cloud-Computings, um tausende Webseiten parallel zu verarbeiten. So können Sie einen kompletten E-Commerce-Katalog extrahieren, Preise von Wettbewerbern auf Dutzenden Websites überwachen oder Immobilienangebote von allen großen Portalen zusammenführen – und das in einem Bruchteil der Zeit, die ein klassischer Scraper benötigen würde.

Warum ist das wichtig? Weil in Branchen wie E-Commerce, Finanzwesen und Immobilien aktuelle Daten alles sind. Preise, Bestände und Markttrends können sich minütlich ändern. Stunden oder gar Tage darauf zu warten, dass ein lokaler Scraper fertig wird, ist keine Option. Cloud Crawler sind weder auf den RAM Ihres Laptops noch auf das WLAN im Büro beschränkt – sie skalieren bei Bedarf mit und ermöglichen so auch große Jobs ohne Stress (, ).

Zu den Branchen, die besonders von dieser Effizienz profitieren, gehören:

- E-Commerce: Preisüberwachung, Zusammenführung von Produktkatalogen, Analyse von Bewertungen

- Immobilien: Aggregation von Inseraten, Verfolgung von Markttrends, Objektvergleiche

- Finanzen: Nachrichten- und Sentiment-Analyse, Monitoring von Aktien und Krypto, regulatorisches Tracking

- Vertrieb & Marketing: Lead-Generierung, Wettbewerbsrecherche, Trend-Erkennung

Und ehrlich gesagt ist das nur die Spitze des Eisbergs. Wenn Sie Webdaten in großem Umfang brauchen, ist ein Cloud Crawler Ihr neuer bester Freund.

Thunderbits Cloud-Crawler-Lösung: Schnell, flexibel und leistungsstark

Ich setze für einen Moment meinen Thunderbit-Hut auf (okay, den nehme ich eigentlich nie wirklich ab). Der Cloud-Scraping-Modus von ist unsere Antwort auf die moderne Datenherausforderung – ein Cloud Crawler für Business-Anwender, die Ergebnisse wollen und keinen Frust.

Das macht Thunderbits Cloud Crawler besonders:

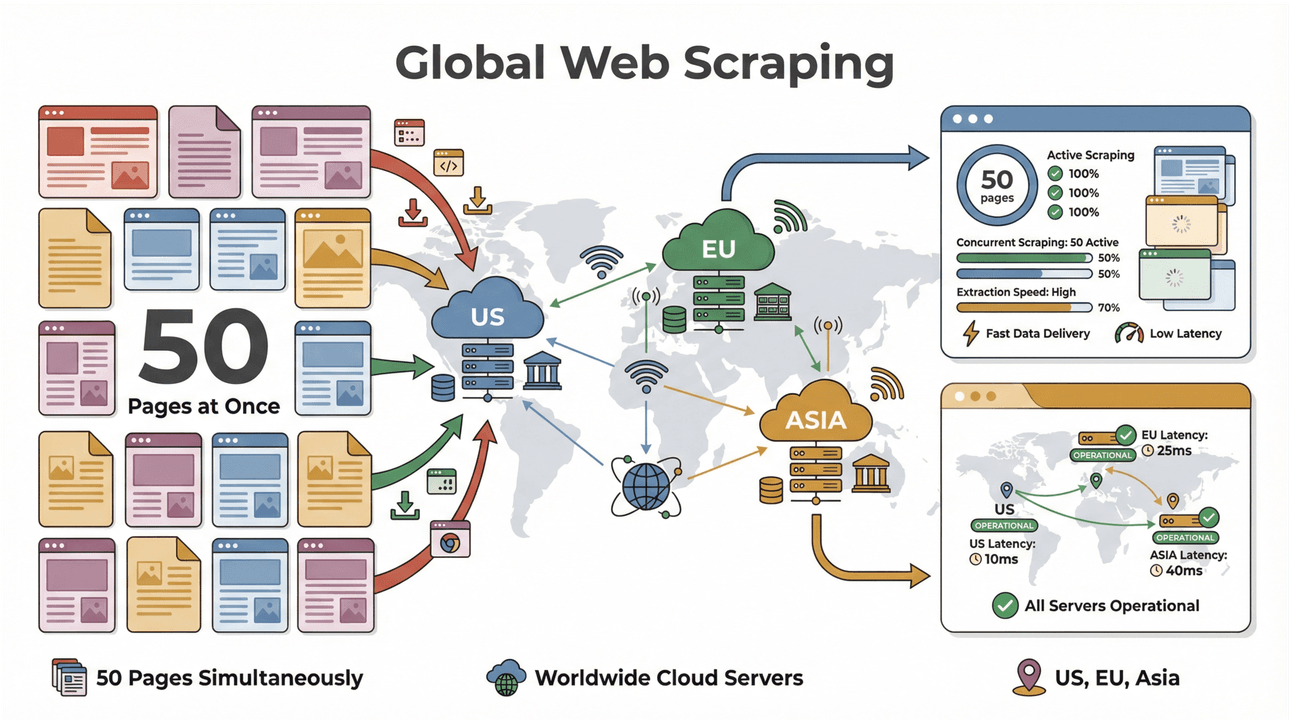

- Batch-Scraping mit hoher Geschwindigkeit: Bis zu 50 Seiten gleichzeitig verarbeiten, mit Cloud-Servern in den USA, der EU und Asien für globale Reichweite. Kein Warten mehr, bis sich Ihr Laptop durch eine lange Liste quält.

- Unterstützung komplexer Seiten: Die KI von Thunderbit kommt mit dynamischen E-Commerce-Seiten, kniffligen PDFs und sogar Bilderextraktion zurecht. Was im Web steckt, kann Thunderbit mit hoher Wahrscheinlichkeit extrahieren ().

- Crawling von Unterseiten: Sie möchten Ihre Daten mit Details von Unterseiten anreichern, etwa Produktdaten oder Autorenprofile? Thunderbits KI kann jede Unterseite besuchen und die Ergebnisse in Ihren Hauptdatensatz übernehmen ().

- Intelligente Datenstrukturierung: Mit „AI Suggest Fields“ analysiert Thunderbit die Website und schlägt die passenden Spalten vor – ganz ohne Code oder Vorlagenarbeit.

- Export überallhin: Senden Sie Ihre Daten direkt an Excel, Google Sheets, Airtable oder Notion. Oder laden Sie sie einfach als CSV/JSON herunter – ganz wie es zu Ihrem Workflow passt ().

- Keine Wartung nötig: Thunderbits KI passt sich an Website-Änderungen an, sodass Sie nicht ständig kaputte Scraper reparieren müssen ().

Und ja, Sie können all das in einem testen – Sie müssen mir also nicht einfach so glauben.

Bereitstellung von Cloud Crawlern: Cloud oder lokal – was passt besser?

Einer der größten Vorteile von Cloud Crawlern ist die Flexibilität bei der Bereitstellung. Mit einem klassischen lokalen Crawler sind Sie an ein bestimmtes Gerät, ein bestimmtes Netzwerk und oft auch an viele Setup-Probleme gebunden. Wenn Ihr Computer in den Ruhezustand geht oder die Internetverbindung abbricht, stoppt der Crawl. Für mehr Skalierung müssen Sie zusätzliche Hardware kaufen oder mehrere Skripte gleichzeitig ausführen.

Cloud Crawler drehen das Prinzip um:

- Keine Spezialhardware erforderlich: Die ganze Rechenarbeit findet in der Cloud statt. Sie können große Crawls sogar von einem Chromebook, einem Mac oder Ihrem Smartphone aus starten.

- Zugriff von überall: Auf Reisen? Im Homeoffice? Kein Problem – Ihr Cloud Crawler ist immer verfügbar.

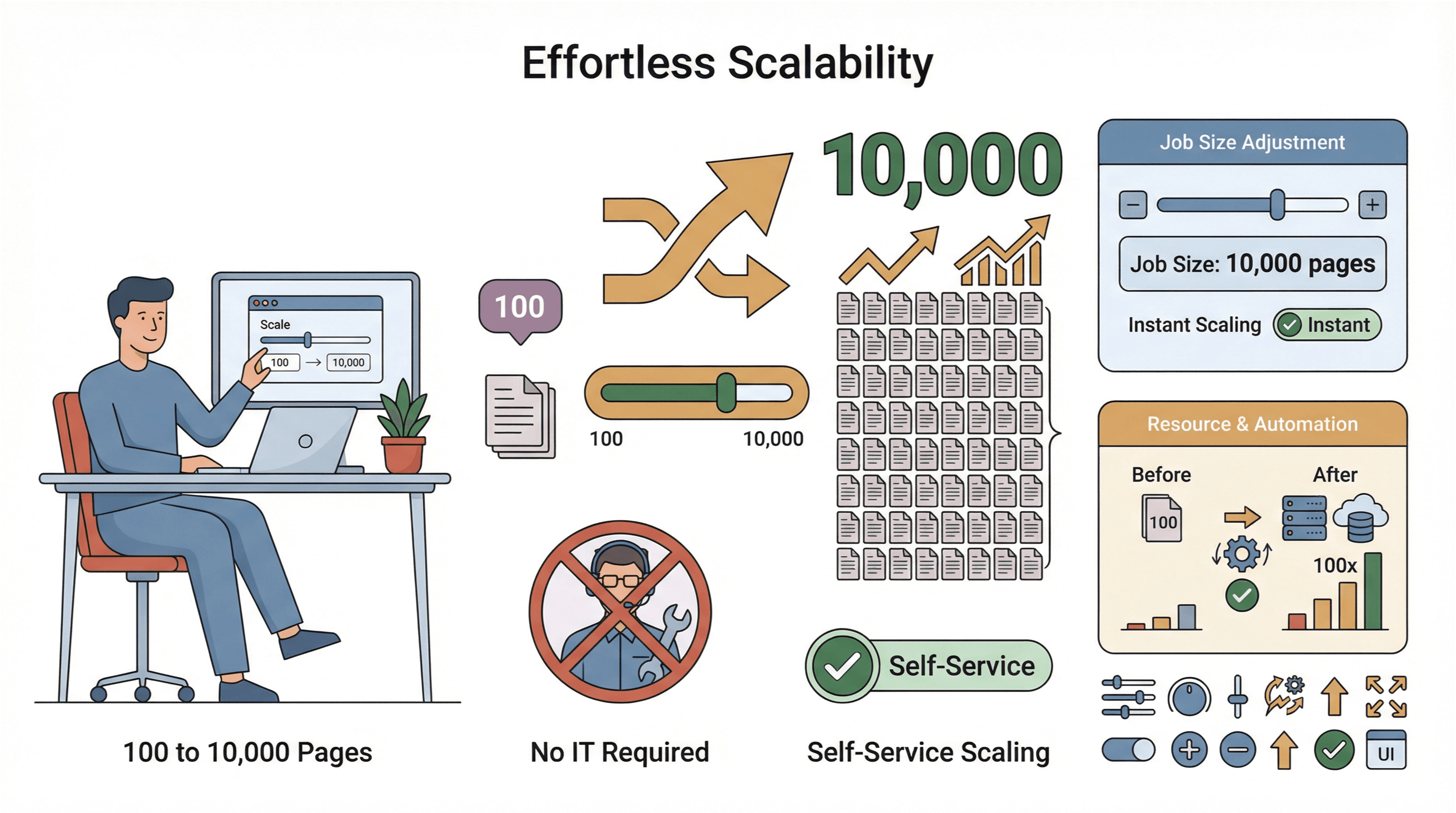

- Einfache Skalierung: Statt 100 Seiten müssen Sie 10.000 Seiten crawlen? Erhöhen Sie einfach die Jobgröße – ganz ohne IT-Unterstützung.

- Globale Datenerfassung: Mit Cloud-Servern in mehreren Regionen können Sie auf geografisch eingeschränkte Inhalte zugreifen und Compliance einfacher steuern ().

Natürlich bleiben Sicherheit und Compliance immer zentrale Themen. Die besten Cloud Crawler – darunter auch Thunderbit – nutzen verschlüsselte Verbindungen, respektieren die Nutzungsbedingungen von Websites und bieten Funktionen, mit denen Sie sensible Daten verantwortungsvoll verwalten können.

Praxiswirkung: Wie Cloud Crawler datengetriebene Strategien verändern

Werden wir konkret. Warum steigen Unternehmen auf Cloud Crawler um? Weil sie messbare Ergebnisse sehen:

- Marktanalyse in Echtzeit: Händler nutzen Cloud Crawler, um Preise und Bestände von Wettbewerbern live zu überwachen und so dynamische Preisgestaltung sowie schnellere Reaktionen auf Marktveränderungen zu ermöglichen ().

- Vorhersage von Verbrauchstrends: Marken bündeln Bewertungen, Social-Media-Beiträge und Forendiskussionen, um neue Trends frühzeitig zu erkennen und Kampagnen flexibel anzupassen.

- Vertrieb & Lead-Generierung: Vertriebsteams erstellen aktuelle Lead-Listen aus Verzeichnissen, Event-Websites und sogar PDFs – und versorgen CRMs mit frischen, qualifizierten Kontakten ().

- Operations & Compliance: Finanzunternehmen nutzen Cloud Crawler, um regulatorische Updates, Nachrichten und Einreichungen über verschiedene Rechtsräume hinweg zu überwachen – das senkt Risiken und hält sie bei Änderungen auf dem Laufenden.

Der rote Faden dabei? Cloud Crawler helfen Teams, schneller zu handeln, bessere Entscheidungen zu treffen und Wettbewerber zu überholen, die noch im Schneckentempo unterwegs sind.

Wichtige Funktionen, auf die Sie bei einem Cloud Crawler achten sollten

Cloud Crawler ist nicht gleich Cloud Crawler. Wenn Sie Optionen vergleichen, sind diese Funktionen besonders wichtig – und genau hier punktet Thunderbit:

- Skalierbarkeit: Kann das Tool tausende Seiten gleichzeitig verarbeiten? Wird es langsamer, wenn Jobs größer werden?

- Benutzerfreundlichkeit: Ist die Oberfläche auch für Nicht-Techniker verständlich? Lässt sich ein Scrape mit wenigen Klicks einrichten?

- Unterstützung verschiedener Datentypen: Text, Bilder, PDFs, Unterseiten – kann das Tool all das verarbeiten?

- Integration: Exportiert es in Ihre bevorzugten Tools (Excel, Sheets, Notion, Airtable)?

- Zeitplanung: Lassen sich wiederkehrende Jobs für stets aktuelle Daten einrichten?

- KI-Unterstützung: Gibt es intelligente Feldvorschläge, Datenanreicherung und Anpassung an Website-Änderungen?

- Sicherheit & Compliance: Sind Ihre Daten und Zugänge geschützt? Hilft das Tool dabei, Datenschutzvorgaben einzuhalten?

Thunderbit erfüllt all diese Anforderungen und ist damit eine starke Wahl für Teams, die Leistung ohne unnötigen Aufwand wollen.

Der Einstieg: So nutzen Sie einen Cloud Crawler für Ihr Unternehmen

Bereit loszulegen? So kann ein typischer Business-Anwender mit einem Cloud Crawler wie Thunderbit starten:

- Installieren Sie die : Schnell eingerichtet, ohne IT-Aufwand.

- Wählen Sie Ihr Ziel: Öffnen Sie die Website, Liste oder das Dokument, das Sie auslesen möchten.

- Klicken Sie auf „AI Suggest Fields“: Lassen Sie Thunderbits KI die Seite scannen und die besten zu extrahierenden Spalten vorschlagen.

- Bei Bedarf anpassen: Felder hinzufügen, entfernen oder umbenennen – ganz nach Ihrem Bedarf.

- Cloud-Scraping-Modus auswählen: Für große Jobs oder komplexe Websites wechseln Sie in den Cloud-Modus für maximale Geschwindigkeit.

- Scrape starten: Thunderbit verarbeitet bis zu 50 Seiten gleichzeitig in der Cloud.

- Prüfen und exportieren: Sehen Sie sich die Ergebnisse an und exportieren Sie sie anschließend nach Excel, Google Sheets, Notion oder Airtable.

- Wiederkehrende Jobs planen: Für laufende Anforderungen richten Sie geplante Scrapes ein – Ihre Daten werden automatisch aktualisiert ().

Tipp: Beginnen Sie mit einem kleinen Auftrag, um ein Gefühl dafür zu bekommen, und skalieren Sie dann hoch, sobald Sie sich sicher fühlen. Und scheuen Sie sich nicht, die Unterstützung oder Dokumentation von Thunderbit zu nutzen – genau dafür sind sie da.

Die Zukunft der Datenerfassung: Wohin entwickeln sich Cloud Crawler?

Die Cloud-Crawler-Revolution hat gerade erst begonnen. Darauf achte ich in den nächsten Jahren besonders:

- Intelligentere KI-Extraktion: Cloud Crawler verstehen Kontext, Beziehungen und sogar Stimmung immer besser – und machen die gesammelten Daten dadurch wertvoller ().

- Unterstützung neuer Datentypen: Rechnen Sie mit besserer Verarbeitung von Video, Audio und interaktiven Inhalten – nicht nur von statischem Text und Bildern.

- Tiefere Automatisierung: Von automatisierter Planung bis hin zu Echtzeit-Benachrichtigungen werden Cloud Crawler für Business-Anwender noch stärker zum Selbstläufer.

- Mehr Compliance-Funktionen: Mit der Weiterentwicklung von Datenschutzgesetzen werden Cloud Crawler mehr Werkzeuge einbauen, um Teams regelkonform zu halten.

- Integration mit BI- und KI-Tools: Direkte Datenpipelines von Cloud Crawlern zu Analyseplattformen, Dashboards und Machine-Learning-Systemen.

Kurz gesagt: Cloud Crawler werden sich voraussichtlich zum Rückgrat digitaler Geschäftsstrategien entwickeln – und alles antreiben, von Produkteinführungen bis zu KI-gestützten Prognosen ().

Fazit: Warum Cloud Crawler für moderne Unternehmen unverzichtbar sind

Kurz zusammengefasst: Das Web explodiert förmlich vor Daten, und die alten Methoden der Datenerfassung kommen damit nicht mehr mit. Cloud Crawler sind die nächste Entwicklungsstufe – sie bieten Geschwindigkeit, Skalierung und Intelligenz, mit denen klassische Scraper einfach nicht mithalten können. Tools wie machen es jedem Team möglich, unabhängig von technischem Know-how das volle Potenzial von Webdaten zu nutzen – für bessere Entscheidungen, schnellere Reaktionen und einen echten Wettbewerbsvorteil.

Wenn Sie bereit sind, manuelles Scraping und langsame Daten hinter sich zu lassen, ist jetzt der richtige Zeitpunkt, herauszufinden, was ein Cloud Crawler für Ihr Unternehmen leisten kann. Testen Sie den Cloud-Scraping-Modus von Thunderbit und erleben Sie, wie einfach – und leistungsstark – moderne Datenerkennung sein kann. Und wenn Sie tiefer einsteigen möchten, besuchen Sie den für weitere Anleitungen, Tipps und Praxisbeispiele.

FAQs

1. Was ist ein Cloud Crawler in einfachen Worten?

Ein Cloud Crawler ist ein cloudbasiertes Tool, das große Datenmengen automatisch im Web findet, extrahiert und analysiert. Anders als klassische Scraper, die auf Ihrem lokalen Gerät laufen, arbeiten Cloud Crawler in leistungsstarken Rechenzentren und ermöglichen dadurch enorme Skalierung und Geschwindigkeit.

2. Worin unterscheidet sich ein Cloud Crawler von einem normalen Web Scraper?

Cloud Crawler laufen in der Cloud, verarbeiten tausende Seiten gleichzeitig, unterstützen komplexe Datentypen wie Bilder und PDFs und benötigen weder Wartung noch lokale Hardware. Herkömmliche Scraper sind durch die Leistung Ihres Geräts begrenzt und eignen sich am besten für kleinere, einfachere Aufgaben.

3. Was sind die wichtigsten Vorteile eines Cloud Crawlers?

Cloud Crawler ermöglichen schnelle Datenerfassung im großen Maßstab, unterstützen komplexe Websites, sind von überall aus zugänglich und bieten fortgeschrittene Funktionen wie Zeitplanung und KI-gestützte Extraktion. Sie sind ideal für Unternehmen, die schnell frische, verwertbare Daten benötigen.

4. Wie funktioniert Thunderbits Cloud Crawler für Business-Anwender?

Mit Thunderbits Cloud Crawler können Sie einen Scrape mit nur wenigen Klicks einrichten – ganz ohne Code. Sie können Daten aus Websites, PDFs und Bildern extrahieren, sie mit KI anreichern und direkt nach Excel, Google Sheets, Notion oder Airtable exportieren. Das Tool ist für Nicht-Techniker entwickelt, die Ergebnisse statt Komplexität wollen.

5. Ist Cloud Crawling sicher und mit Datenschutzgesetzen vereinbar?

Ja, führende Cloud Crawler wie Thunderbit verwenden verschlüsselte Verbindungen und bewährte Sicherheitsstandards. Achten Sie immer darauf, nur öffentlich zugängliche Daten zu erfassen und die Nutzungsbedingungen der Websites sowie Datenschutzvorgaben einzuhalten.

Bereit zu sehen, was ein Cloud Crawler leisten kann? und noch heute mit der Welt der großskaligen, cloudbasierten Datenerfassung starten.

Mehr erfahren