Wer schon mal mit Python versucht hat, Daten aus dem Web zu ziehen, kennt das Drama: Erst läuft alles wie geschmiert – Produktpreise oder Leads werden fleißig gesammelt – und dann plötzlich: Aus, vorbei! Das Skript wird geblockt, die IP landet auf der schwarzen Liste und ein CAPTCHA-Tsunami rollt an, der selbst die entspanntesten Leute zur Weißglut bringt. Im Jahr 2025 ist das für alle, die im Vertrieb, Marketing oder Operations auf öffentlich verfügbare Webdaten setzen, leider Alltag – denn nur so bleibt man der Konkurrenz einen Schritt voraus.

Das Krasse daran: Über gehen auf das Konto von Anti-Bot-Maßnahmen wie IP-Sperren und CAPTCHAs. Und etwa stolpern regelmäßig über diese Hürden. Da mittlerweile fast die Hälfte des gesamten Internet-Traffics von Bots stammt, rüsten Webseiten immer weiter auf. Aber keine Panik – egal ob du Python-Profi bist oder einfach eine Abkürzung suchst: Hier erfährst du, wie du Blockaden clever umgehst, Proxys richtig einsetzt und mit KI-Tools wie dein Scraping aufs nächste Level bringst.

Web Scraping ohne Blockaden in Python: Die Basics

Starten wir ganz von vorne. Web-Scraper bedeutet nichts anderes, als automatisiert Daten von Webseiten zu sammeln. Python ist dafür die absolute Lieblingssprache – setzen auf Python-basierte Tools. Webseiten sind davon aber meist wenig begeistert. Warum? Zu viele automatisierte Anfragen können Server lahmlegen, Inhalte klauen oder Wettbewerbern einen Vorteil verschaffen.

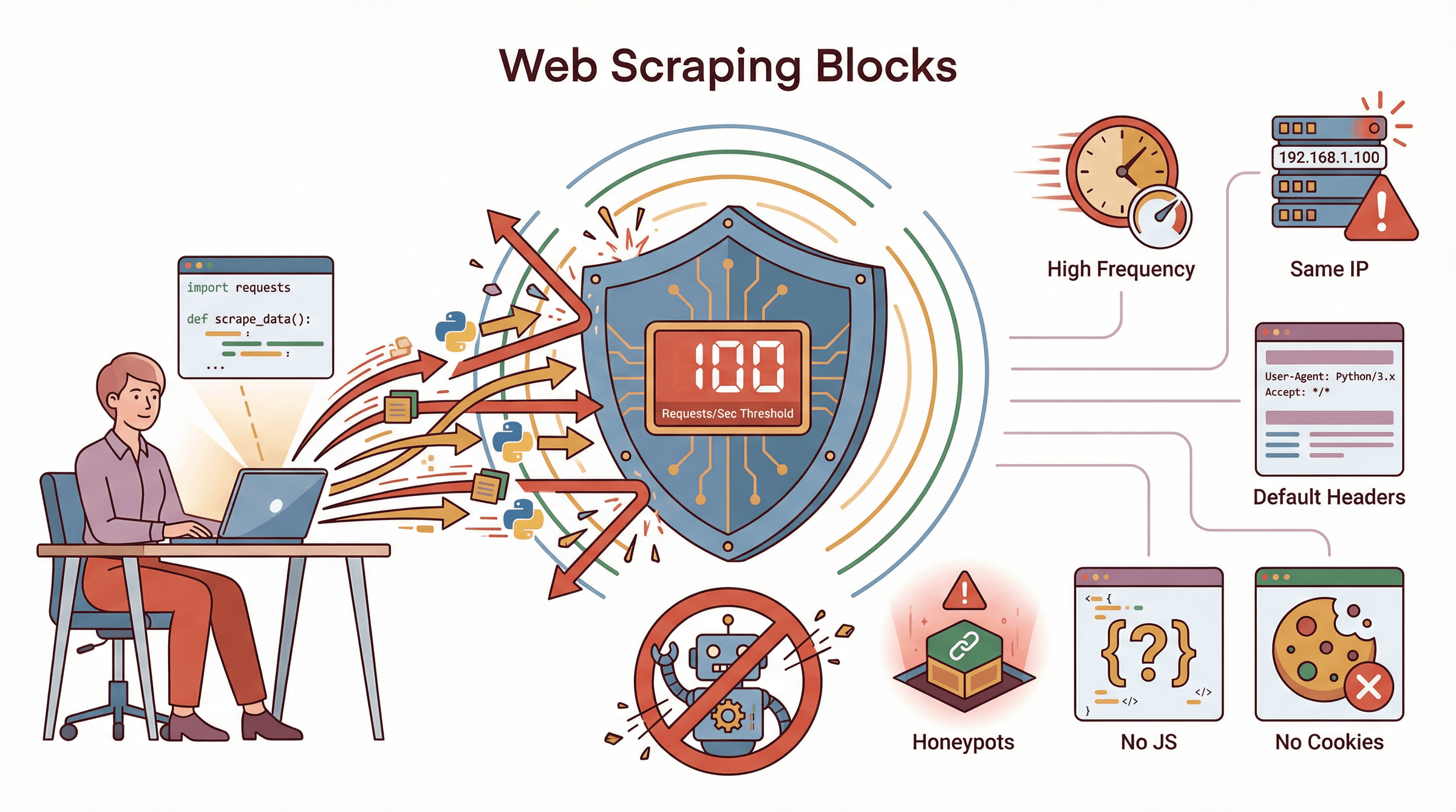

Wie schützen sich Webseiten? Die gängigsten Anti-Scraping-Methoden sind:

- IP-Sperren & Rate Limiting: Zu viele Anfragen von einer IP? Zack, gesperrt oder gedrosselt.

- CAPTCHAs: Die nervigen „Beweise, dass du ein Mensch bist“-Rätsel, die Bots (und manchmal auch uns) in den Wahnsinn treiben.

- User-Agent- und Header-Filter: Wenn dein Skript sich als „python-requests/2.x“ ausgibt, ist das ein klarer Bot-Hinweis.

- JavaScript-Prüfungen & Browser-Fingerprinting: Manche Seiten verlangen, dass JavaScript ausgeführt wird oder prüfen subtile Browser-Merkmale.

- Honeypots: Versteckte Links oder Felder, die nur Bots auslösen.

Wer hier nicht aufpasst, sorgt mit seinem Python-Skript schneller für Alarm als man „403 Forbidden“ sagen kann.

Warum IP-Blockaden beim Python Web Scraping richtig nerven

Geblockt zu werden ist nicht nur ein technisches Problem – es kann auch geschäftlich richtig wehtun. Stell dir vor, dein Vertriebsteam kann keine neuen Leads mehr sammeln, der Preisanalyst verpasst eine Preissenkung beim Wettbewerber oder deine Marktforschung basiert auf lückenhaften Daten. Das kostet bares Geld.

Hier ein Überblick:

| Anwendungsfall | Beispiel-Szenario | Risiko bei Blockade | Vorteil zuverlässigen Scrapings |

|---|---|---|---|

| Lead-Generierung | Kontakte aus Verzeichnissen oder LinkedIn sammeln | Unvollständige Listen, entgangene Verkaufschancen | Stetiger Nachschub an aktuellen Leads |

| Preisüberwachung | Tägliches Tracken von Wettbewerberpreisen | Veraltete Daten, verpasste Preisänderungen | Immer aktuelle Preisinformationen, schnelle Reaktion |

| Wettbewerbsanalyse | Produktdetails oder Bewertungen extrahieren | Blind Spots, verpasste Produkt-Launches | Volle Markttransparenz, bessere Strategie |

| Marktforschung & SEO | News, Foren oder Suchergebnisse aggregieren | Verzerrte Insights, Zeitverschwendung | Umfassende, aktuelle Datensätze für Analysen |

Für sind Webdaten nicht nur „nice to have“, sondern absolut geschäftskritisch.

Wie Webseiten Python Web Scraping blockieren: Die größten Stolperfallen

Was bringt einen Python-Web-Scraper am schnellsten ins Aus? Hier die Klassiker:

Was bringt einen Python-Web-Scraper am schnellsten ins Aus? Hier die Klassiker:

- Hohe Anfragefrequenz: Kein Mensch klickt 100 Seiten pro Sekunde an. Wer das macht, fällt sofort auf.

- Immer dieselbe IP: Alle Anfragen kommen von einer IP, vor allem aus einem Rechenzentrum? Verdächtig!

- Standard-Header: Wer den Standard-User-Agent von Python nutzt oder Header weglässt, wird schnell erkannt.

- Keine Cookies oder Sessions: Echte Nutzer sammeln beim Surfen Cookies. Bots ohne Cookies wirken auffällig.

- Kein JavaScript-Rendering: Kann dein Scraper kein JS ausführen, fehlen dir Daten oder du bestehst Bot-Checks nicht.

- Robots.txt ignorieren: Kein technisches Hindernis, aber ein schneller Weg, aufzufallen.

- Honeypots: Versteckte Links anklicken oder unsichtbare Felder ausfüllen? Sofortige Sperre.

Typische Anfängerfehler: zu viele Anfragen in kurzer Zeit, keine Proxy-Rotation, fehlende Zufalls-User-Agents und keine Pausen. Ich hab schon erlebt, dass eine ganze Uni-IP-Range bei NASDAQ gesperrt wurde, weil tausende Anfragen pro Sekunde kamen. Autsch.

Mit Python Web Scraping Proxys IP-Blockaden austricksen

Hier kommen Proxys ins Spiel – dein bester Kumpel gegen IP-Sperren. Ein Proxy ist quasi ein Mittelsmann, der deine Anfragen über eine andere IP-Adresse weiterleitet. Für die Zielseite sieht es so aus, als kämen die Anfragen von verschiedenen Orten.

Proxy-Arten im Überblick

- Datacenter-Proxys: Günstig und schnell, aber leicht zu erkennen. Für einfache Scraping-Aufgaben okay.

- Residential-Proxys: Echte Privatanschlüsse – schwerer zu blockieren, aber langsamer und teurer.

- Rotierende Proxys: Wechseln bei jeder Anfrage die IP. Perfekt für große Datenmengen.

- Mobile Proxys: Nutzen Mobilfunk-IP-Adressen. Nur für besonders harte Fälle nötig.

Für die meisten Business-Anwendungen sind rotierende Residential-Proxys die beste Wahl – vertrauenswürdig und flexibel genug, um Sperren zu vermeiden.

Proxys in Python mit Requests, Selenium und Beautiful Soup nutzen

So bindest du Proxys praktisch in deine Python-Skripte ein:

Mit Requests:

1import requests

2proxy = "http://USERNAME:PASSWORD@PROXY_IP:PORT"

3proxies = {"http": proxy, "https": proxy}

4headers = {"User-Agent": "Mozilla/5.0 ..."}

5response = requests.get("https://target-website.com/data", proxies=proxies, headers=headers)

6html = response.textMit Beautiful Soup:

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html, 'html.parser')

3data_items = soup.find_all('div', class_='item')Mit Selenium:

1from selenium import webdriver

2proxy = "PROXY_IP:PORT"

3chrome_options = webdriver.ChromeOptions()

4chrome_options.add_argument(f'--proxy-server=http://{proxy}')

5driver = webdriver.Chrome(options=chrome_options)

6driver.get("https://target-website.com")Bei rotierenden Proxys kannst du eine Liste durchgehen oder einen Dienst nutzen, der die Rotation übernimmt. Wichtig: Wenn ein Proxy ausfällt, Fehler abfangen und mit dem nächsten weitermachen.

Best Practices für Proxy-Management und Rotation

- Großer Proxy-Pool: Je mehr Proxys, desto besser. Nach jeder Anfrage oder jedem Batch rotieren.

- Proxy-Qualität überwachen: Schlechte Proxys aussortieren. Fehlgeschlagene Anfragen mit neuer IP wiederholen.

- Keine Überlastung einzelner Proxys: Anfragen verteilen, nicht alles über eine IP laufen lassen.

- Geotargeting: Proxys aus dem Zielland nutzen, falls nötig.

- Proxy-Typen mischen: Erst Datacenter, bei Sperren auf Residential wechseln.

- Keine Gratis-Proxys: Die sind langsam, unzuverlässig und oft schon geblacklistet.

- Provider-Limits beachten: Proxy-Kontingent nicht zu schnell aufbrauchen.

Proxy-Management ist fast schon eine eigene Wissenschaft. Aber selbst das beste Setup reicht allein nicht aus.

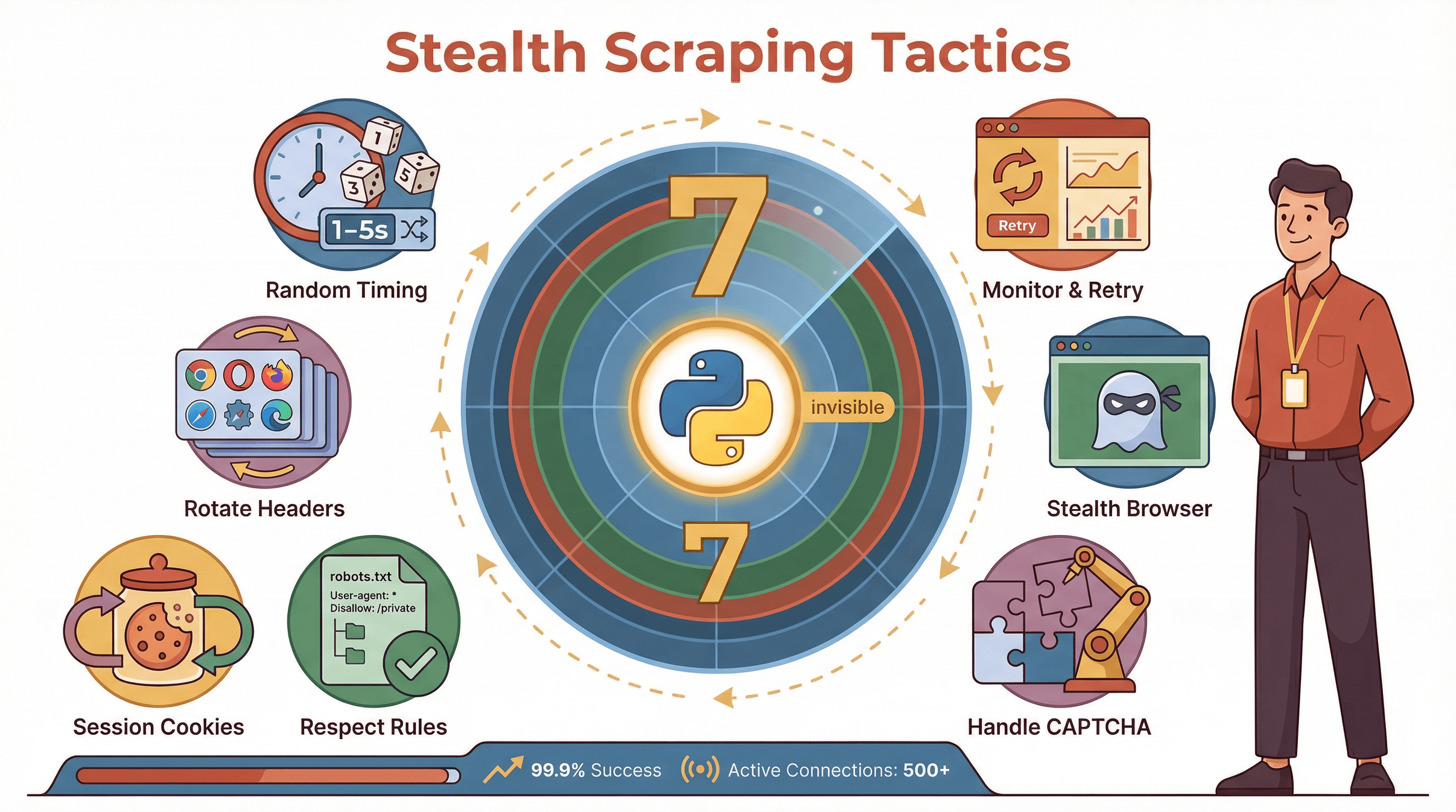

Mehr als Proxys: Smarte Methoden gegen Blockaden in Python

Wer wirklich unauffällig bleiben will, kombiniert Proxys mit diesen Taktiken:

Wer wirklich unauffällig bleiben will, kombiniert Proxys mit diesen Taktiken:

- Zufällige Anfragezeiten: Nicht im Sekundentakt senden, sondern Pausen (z. B. 1–5 Sekunden) zufällig einbauen.

- User-Agents und Header rotieren: Echte Browser-User-Agents nutzen, Accept-Language, Referer etc. variieren.

- Sessions und Cookies verwenden: Cookies über mehrere Anfragen hinweg speichern, um echtes Surfen zu simulieren.

- Robots.txt respektieren & bei Fehlern pausieren: Site-Regeln beachten. Bei 429- oder 503-Fehlern Tempo drosseln.

- CAPTCHAs lösen: Entweder einen CAPTCHA-Service einbinden oder mit neuem Proxy erneut versuchen.

- Stealth-Headless-Browser: Tools wie undetected-chromedriver oder Playwright mit Stealth-Plugins nutzen.

- Überwachen & Wiederholen: Logs führen, Fehler überwachen und automatisch mit neuen Proxys wiederholen.

Für diese Tricks gibt’s super Python-Bibliotheken – fake-useragent, requests.Session() und Stealth-Plugins sind Gold wert.

Scraping auf dem nächsten Level: KI-Tools vs. klassische Python-Proxy-Methoden

Jetzt wird’s spannend: Was wäre, wenn du dir das ganze Proxy-Management, Header-Tuning und Anti-Block-Stress sparen könntest? Genau hier kommt ins Spiel.

Thunderbit ist ein KI-Web-Scraper als Chrome-Erweiterung, mit dem du Daten von jeder Website in wenigen Klicks extrahierst – ganz ohne Programmierung, Proxy-Setup oder Wartung. Einfach auf „KI-Felder vorschlagen“ klicken, die KI erkennt automatisch die relevanten Daten, und mit „Scrape“ startest du die Extraktion. Thunderbit übernimmt Proxys, Anti-Blockaden, Paginierung und sogar das Navigieren auf Unterseiten im Hintergrund.

Hier der direkte Vergleich:

| Kriterium | Python Scraping (Proxys) | Thunderbit KI-Web-Scraper |

|---|---|---|

| Einrichtungszeit | Stunden (Code, Proxys, Parsing) | Minuten (anklicken, fertig) |

| Technisches Know-how | Hoch (Programmierung, HTTP, Proxys) | Gering (jeder kann es nutzen) |

| Blockaden vermeiden | Manuell (Proxys, Header rotieren) | Automatisch (KI + integriertes Proxy-Management) |

| Wartung | Laufend (Code, Proxys aktualisieren) | Minimal (KI passt sich an, Templates gepflegt) |

| Paginierung/Unterseiten | Manuell programmieren | Ein Klick, KI übernimmt |

| Datenexport | Manuell (CSV, Excel per Code) | Ein Klick zu Sheets, Excel, Notion, Airtable |

| Skalierbarkeit | Abhängig von Infrastruktur/Proxys | Hoch (Cloud-Scraping, parallele Seiten) |

| Kosten | Proxy-Gebühren + Entwicklerzeit | Gratis-Tarif, danach günstige Pläne |

| Zuverlässigkeit | Variabel (abhängig vom Setup) | Hoch (optimiert für Business-Anwender) |

Thunderbit ist besonders für nicht-technische Teams oder alle, die einfach nur schnell an Daten kommen wollen, ideal.

Schritt-für-Schritt: Blockadefreies Scraping mit Thunderbit

So nutze ich Thunderbit, um eine Seite zu scrapen, die Python-Skripte normalerweise blockieren würden:

- Thunderbit Chrome-Erweiterung installieren: .

- Zur Zielseite navigieren: Falls nötig einloggen – Thunderbit nutzt deine Browser-Session.

- „KI-Felder vorschlagen“ klicken: Thunderbit scannt die Seite und schlägt passende Spalten vor (z. B. „Name“, „Preis“, „E-Mail“).

- „Scrape“ klicken: Thunderbit sammelt die Daten in einer strukturierten Tabelle.

- Paginierung aktivieren: Mit „Alle Seiten scrapen“ klickt Thunderbit automatisch durch alle Seiten und sammelt die Ergebnisse.

- Unterseiten scrapen: Mit „Unterseiten scrapen“ werden Detailseiten besucht und die Daten angereichert.

- Exportieren: Mit einem Klick die Daten nach Google Sheets, Excel, Notion oder Airtable senden.

Thunderbit übernimmt alle Anti-Blockaden im Hintergrund – IP-Rotation, Anfrage-Timing und sogar das Lösen kleiner CAPTCHAs. Für die meisten Business-Anwender funktioniert das einfach und zuverlässig.

Thunderbits Umgang mit Paginierung und Unterseiten

Thunderbit extrahiert nicht nur die Daten der ersten Seite, sondern kann:

- Scrollen und Klicken wie ein Mensch: Bei Endlos-Scroll oder „Nächste Seite“-Buttons wird echtes Nutzerverhalten simuliert.

- Sessions beibehalten: Bei Login bleibt die Session über alle Seiten hinweg erhalten.

- Last verteilen: Im Cloud-Modus werden mehrere Seiten parallel und von unterschiedlichen IPs gescrapt.

- Dynamische Inhalte erfassen: Thunderbit führt JavaScript aus und holt so auch nachgeladene Daten.

- Unterseiten scrapen: Thunderbit kann in jede Detailseite klicken, zusätzliche Felder extrahieren und alles in einer Tabelle zusammenführen.

Für die Zielseite sieht das aus wie ganz normale Nutzeraktivität – nicht wie ein Bot-Netzwerk.

Python-Proxys vs. Thunderbit: Was ist besser für Unternehmen?

Welche Methode passt zu dir? Hier ein schneller Vergleich:

| Faktor | Python + Proxys | Thunderbit |

|---|---|---|

| Geschwindigkeit | Langsam einzurichten | Sofort Ergebnisse |

| Wartung | Hoch (Code, Proxys) | Gering (KI passt sich an) |

| Know-how | Entwickler erforderlich | Jeder kann es nutzen |

| Blockaden | Mittel (bei Fehlern) | Gering (KI/Proxy-Automation) |

| Kosten | Proxy-Gebühren + Zeit | Gratis-Tarif, ab 15 $/Monat |

| Ideal für | Individuelles, komplexes Scraping | Vertrieb, Marketing, Research-Teams |

Wer als Entwickler gerne tüftelt und volle Kontrolle braucht, ist mit Python und Proxys weiterhin gut beraten. Für die meisten Business-Anwender – vor allem, wenn man sich den Proxy-Stress sparen will – ist Thunderbit ein echter Produktivitäts-Booster.

Fazit: Scrape clever, nicht kompliziert

Was ich gelernt habe (und gerne früher gewusst hätte):

- Proxys sind unverzichtbar, um IP-Sperren beim Python-Scraping zu umgehen – aber das Management ist aufwendig.

- Cleveres Anti-Blocking (Zufalls-Pausen, Header-Rotation, Sessions) macht einen riesigen Unterschied.

- KI-Tools wie Thunderbit automatisieren alles – Proxys, Blockaden, Paginierung, Unterseiten und Export – damit du dich auf die Daten konzentrieren kannst.

- Das richtige Tool für dein Team: Wer Geschwindigkeit und Zuverlässigkeit will, ist mit Thunderbit bestens beraten. Wer individuelle Workflows und volle Kontrolle braucht, bleibt bei Python + Proxys.

Du willst sehen, wie einfach Scraping sein kann? und probiere es beim nächsten Projekt aus. Noch mehr Tipps findest du im .

Viel Erfolg beim Scrapen – und möge deine IP immer frei bleiben und deine Daten aktuell sein.

Häufige Fragen (FAQ)

1. Was ist der Hauptgrund, warum Python-Web-Scraper blockiert werden?

Meistens liegt es daran, dass zu viele Anfragen von einer einzigen IP gesendet werden oder Standard-Header verwendet werden, die sofort als Bot auffallen. Webseiten erkennen solche Muster schnell und blockieren oder drosseln den Zugriff.

2. Wie helfen Proxys, IP-Blockaden beim Python-Web-Scraping zu vermeiden?

Proxys leiten Anfragen über verschiedene IP-Adressen weiter, sodass es aussieht, als kämen die Zugriffe von vielen unterschiedlichen Nutzern. Rotierende Proxys sind besonders effektiv für große Datenmengen.

3. Was sind Best Practices für Proxy-Management in Python?

Einen großen Proxy-Pool nutzen, regelmäßig rotieren, Ausfälle überwachen, keine Gratis-Proxys verwenden und Proxy-Standorte ans Zielland anpassen. Außerdem Anfragezeiten und Header immer variieren.

4. Wie verhindert Thunderbit Blockaden ohne manuelles Proxy-Setup?

Thunderbit automatisiert Proxy-Rotation, Anfrage-Timing und Anti-Blocking-Techniken im Hintergrund. Die KI simuliert echtes Nutzerverhalten, übernimmt Paginierung und Unterseiten und exportiert die Daten mit einem Klick – ganz ohne Programmierung.

5. Sollte ich für mein Unternehmen Python oder Thunderbit nutzen?

Wer als Entwickler komplexe, individuelle Anforderungen hat, ist mit Python und Proxys flexibel. Für die meisten Vertriebs-, Marketing- und Research-Teams, die schnell und zuverlässig Daten ohne Technikaufwand wollen, ist Thunderbit die bessere und einfachere Wahl.

Bereit für cleveres Scraping? und lass Blockaden hinter dir.

Mehr erfahren