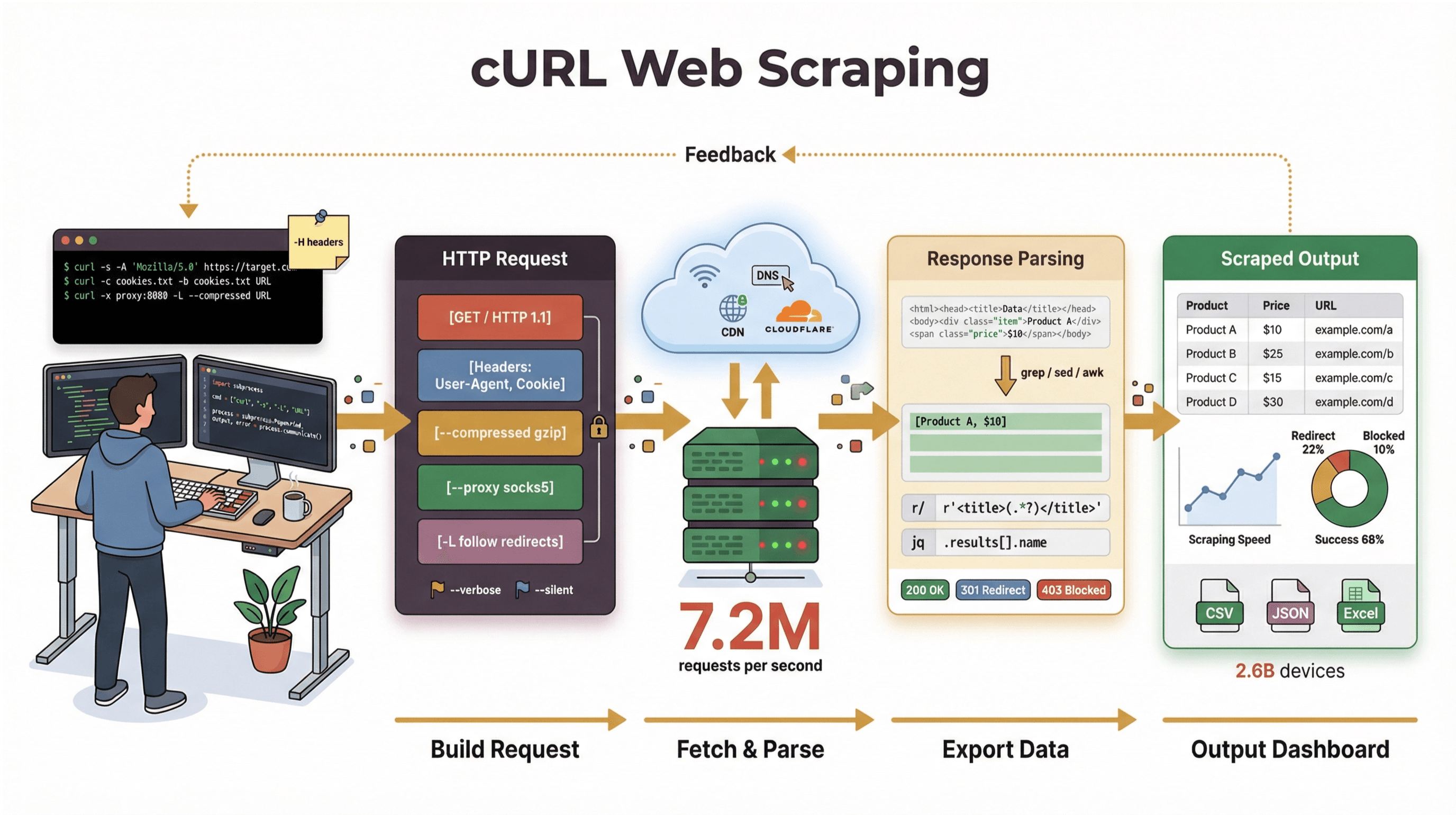

Es hat etwas Zeitloses, ein Terminal zu öffnen, einen einzigen Befehl einzugeben und zuzusehen, wie Rohdaten aus dem Web hereinströmen, als hätte man gerade die Matrix aufgebrochen. Für Entwickler und technische Power-User ist genau dieser Zauberstab – ein unscheinbares Kommandozeilen-Tool, das still und leise auf Milliarden von Geräten läuft, von Cloud-Servern bis hin zu Ihrem Smart Fridge. Und selbst 2026, mit all den schicken No-Code- und KI-Scraping-Tools da draußen, ist Web-Scraping mit cURL immer noch ein Go-to für alle, die Geschwindigkeit, Kontrolle und Skriptbarkeit wollen.

Ich habe jahrelang Automatisierungstools gebaut und Teams dabei geholfen, Webdaten zu bändigen, und ich greife immer noch zu cURL, wenn ich eine Seite abrufen, eine API debuggen oder einen Scraping-Workflow prototypisch aufsetzen will. In diesem Leitfaden führe ich Sie durch ein cURL-Web-Scraping-Tutorial, das sowohl die Grundlagen als auch Profi-Tricks abdeckt – mit echten Befehlsbeispielen, praktischen Tipps und einem nüchternen Blick darauf, wo cURL glänzt und wo es an seine Grenzen stößt. Und falls Sie eher ein Business-User sind und lieber nicht mit der Kommandozeile arbeiten möchten, zeige ich Ihnen, wie , unser KI-gestützter Web-Scraper, Sie in zwei Klicks von „Ich brauche diese Daten“ zu „Hier ist meine Tabelle“ bringt – ganz ohne Code.

Ich habe jahrelang Automatisierungstools gebaut und Teams dabei geholfen, Webdaten zu bändigen, und ich greife immer noch zu cURL, wenn ich eine Seite abrufen, eine API debuggen oder einen Scraping-Workflow prototypisch aufsetzen will. In diesem Leitfaden führe ich Sie durch ein cURL-Web-Scraping-Tutorial, das sowohl die Grundlagen als auch Profi-Tricks abdeckt – mit echten Befehlsbeispielen, praktischen Tipps und einem nüchternen Blick darauf, wo cURL glänzt und wo es an seine Grenzen stößt. Und falls Sie eher ein Business-User sind und lieber nicht mit der Kommandozeile arbeiten möchten, zeige ich Ihnen, wie , unser KI-gestützter Web-Scraper, Sie in zwei Klicks von „Ich brauche diese Daten“ zu „Hier ist meine Tabelle“ bringt – ganz ohne Code.

Lassen Sie uns eintauchen und sehen, warum cURL 2025 fürs Web-Scraping immer noch relevant ist, wie Sie es effektiv einsetzen und wann es Zeit ist, zu etwas noch Leistungsfähigerem zu greifen.

Was ist cURL? Die Grundlage von Web-Scraping mit cURL

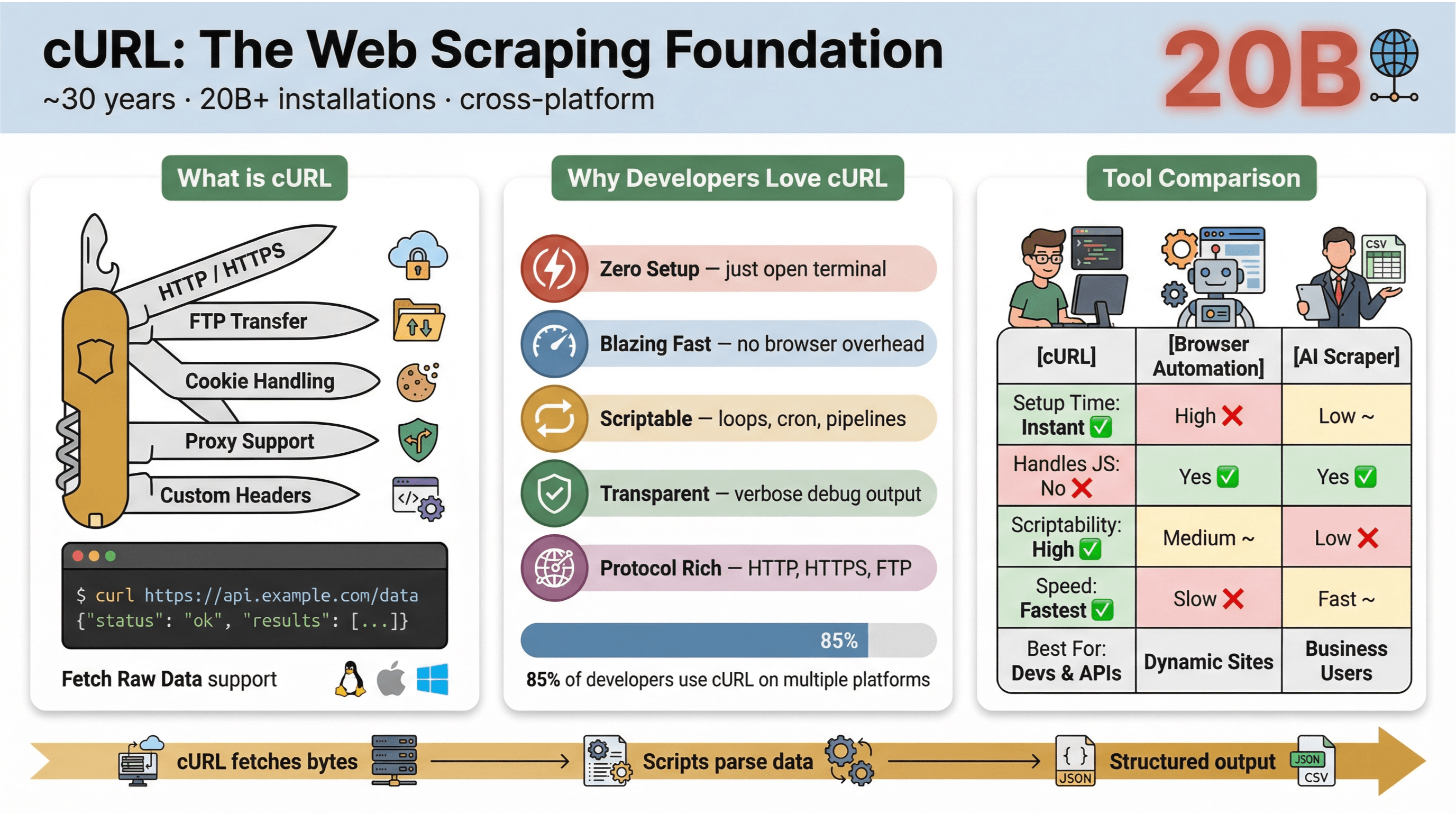

Im Kern ist ein Kommandozeilen-Tool und eine Bibliothek zum Übertragen von Daten per URL. Es gibt es seit fast 30 Jahren (ja, wirklich), und es ist überall zu finden – eingebettet in Betriebssysteme, in Scripts und still und leise bei Datenübertragungen in mehr als . Wenn Sie schon einmal schnell eine Webseite abgerufen, eine API getestet oder eine Datei heruntergeladen haben, ist die Wahrscheinlichkeit groß, dass Sie cURL benutzt haben.

Das macht cURL fürs Web-Scraping so beliebt:

Das macht cURL fürs Web-Scraping so beliebt:

- Leichtgewichtig und plattformübergreifend: Läuft unter Linux, macOS, Windows und sogar auf Embedded Devices.

- Protokollunterstützung: Unterstützt HTTP, HTTPS, FTP und mehr.

- Skriptbar: Perfekt für Automatisierung, Cronjobs und Glue Code.

- Keine Benutzerinteraktion nötig: Für den nicht-interaktiven Einsatz entwickelt – ideal für Batch-Jobs und Pipelines.

Aber eines muss klar sein: cURLs Hauptaufgabe ist es, Rohdaten abzurufen – HTML, JSON, Bilder, was auch immer. Es parst, rendert oder strukturiert diese Daten nicht für Sie. Denken Sie bei cURL an die „erste Meile“ des Web-Scrapings: Es liefert Ihnen die Bytes, aber für strukturierte Informationen brauchen Sie andere Werkzeuge (wie Python-Skripte, grep/sed/awk oder einen KI-Web-Scraper).

Wenn Sie die offiziellen Dokus sehen möchten, schauen Sie sich an.

Warum cURL fürs Web-Scraping verwenden? (cURL Web-Scraping-Tutorial)

Warum greifen Entwickler und technische Anwender trotz all der neuen Tools immer wieder zu cURL für Web-Scraping? Dafür sprechen vor allem diese Punkte:

- Minimaler Aufwand: Nichts installieren, keine Abhängigkeiten – einfach Terminal öffnen und loslegen.

- Geschwindigkeit: Daten sofort abrufen, ohne auf das Laden eines Browsers zu warten.

- Skriptbarkeit: URLs einfach in Schleifen verarbeiten, Requests automatisieren und Befehle verketten.

- Protokoll- und Funktionsunterstützung: Cookies, Proxies, Redirects, benutzerdefinierte Header und mehr.

- Transparenz: Mit ausführlicher Debug-Ausgabe genau sehen, was passiert.

In der gaben über 85 % der Befragten an, das cURL-Kommandozeilen-Tool zu nutzen, und fast alle berichteten, dass sie es auf mehreren Plattformen einsetzen. Es ist immer noch das Schweizer Taschenmesser für HTTP-Requests, schnelle Datenabrufe und Fehlersuche.

Hier ist ein kurzer Vergleich von cURL mit anderen Scraping-Methoden:

| Funktion | cURL | Browser-Automatisierung (z. B. Selenium) | KI-Web-Scraper (z. B. Thunderbit) |

|---|---|---|---|

| Einrichtungszeit | Sofort | Hoch | Niedrig |

| Skriptbarkeit | Hoch | Mittel | Niedrig (kein Code nötig) |

| JavaScript-Unterstützung | Nein | Ja | Ja (Thunderbit: über den Browser) |

| Cookie-/Session-Support | Manuell | Automatisch | Automatisch |

| Datenstrukturierung | Manuell (später parsen) | Manuell (später parsen) | KI-/vorlagenbasiert |

| Am besten für | Entwickler, schnelle Abrufe | Komplexe, dynamische Websites | Business-User, strukturierter Export |

Kurz gesagt: cURL ist unschlagbar für schnelle, skriptbare Datenabrufe – vor allem bei statischen Seiten, APIs oder wenn Sie einfache Workflows automatisieren möchten. Sobald Sie aber komplexes HTML parsen, JavaScript handhaben oder strukturierte Daten exportieren müssen, ist ein spezialisiertes Tool die bessere Wahl.

Einstieg: Grundlegende cURL-Web-Scraping-Befehle mit Beispielen

Jetzt wird es praktisch. So nutzen Sie cURL Schritt für Schritt für grundlegende Web-Scraping-Aufgaben.

Rohes HTML mit cURL abrufen

Der einfachste Anwendungsfall: das HTML einer Webseite abrufen.

1curl https://books.toscrape.com/Dieser Befehl ruft die Startseite von ab, einer öffentlichen Demo-Website fürs Web-Scraping. Im Terminal sehen Sie die rohe HTML-Ausgabe – achten Sie auf Tags wie <title> oder Ausschnitte wie „In stock“.

Ausgabe in einer Datei speichern

Möchten Sie das HTML später parsen? Verwenden Sie das -o-Flag:

1curl -o page.html https://books.toscrape.com/Jetzt haben Sie eine Datei page.html mit dem vollständigen HTML-Inhalt. Perfekt für weitere Analysen oder für das Parsen mit anderen Tools.

POST-Requests mit cURL senden

Müssen Sie ein Formular absenden oder mit einer API interagieren? Nutzen Sie das -d-Flag für POST-Requests. Hier ein Beispiel mit , einer Website zum Testen von HTTP:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"Sie erhalten eine JSON-Antwort, die Ihre gesendeten Daten zurückspiegelt – ideal für Tests und Prototyping.

Header prüfen und debuggen

Manchmal möchten Sie die Response-Header sehen oder den Request debuggen:

-

Nur Header (HEAD-Request):

1curl -I https://books.toscrape.com/ -

Header mit Body einschließen:

1curl -i https://httpbin.org/get -

Ausführliche Debug-Ausgabe:

1curl -v https://books.toscrape.com/

Diese Flags helfen Ihnen zu verstehen, was unter der Haube passiert – entscheidend für die Fehlersuche.

Hier ist eine kurze Referenztabelle für diese Befehle:

| Aufgabe | Befehlsbeispiel | Hinweise |

|---|---|---|

| HTML abrufen | curl URL | Gibt HTML im Terminal aus |

| In Datei speichern | curl -o datei.html URL | Schreibt die Ausgabe in eine Datei |

| Header prüfen | curl -I URL oder curl -i URL | -I nur HEAD, -i schließt Header mit Body ein |

| Formulardaten per POST | curl -d "a=1&b=2" URL | Sendet formularcodierte Daten |

| Request/Response debuggen | curl -v URL | Zeigt detaillierte Informationen zu Request und Response |

Weitere Beispiele finden Sie in den .

Nächste Stufe: Fortgeschrittenes Web-Scraping mit cURL (Web-Scraping mit cURL)

Sobald Sie die Grundlagen beherrschen, öffnet cURL die Tür zu fortgeschrittenen Funktionen für komplexere Scraping-Aufgaben.

Cookies und Sessions handhaben

Viele Websites brauchen Cookies, um Login-Sessions aufrechtzuerhalten oder Nutzer zu verfolgen. Mit cURL können Sie Cookies speichern und bei späteren Requests wiederverwenden:

1# Cookies nach dem Login speichern

2curl -c cookies.txt https://example.com/login

3# Cookies für spätere Requests verwenden

4curl -b cookies.txt https://example.com/accountSo können Sie Browser-Sessions nachbilden und auf Seiten hinter einem Login zugreifen (sofern keine JavaScript-Hürde im Weg steht).

User-Agent und benutzerdefinierte Header vortäuschen

Einige Websites liefern unterschiedliche Inhalte je nach User-Agent oder Headern. Standardmäßig identifiziert sich cURL als „curl/VERSION“, was zu Blockierungen oder alternativen Inhalten führen kann. Um einen Browser zu imitieren:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/Sie können auch benutzerdefinierte Header setzen, etwa Sprachpräferenzen:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/So erhalten Sie denselben Inhalt, den auch ein echter Browser sehen würde.

Proxies fürs Web-Scraping nutzen

Müssen Ihre Requests über einen Proxy laufen, etwa für Geo-Tests oder um IP-Sperren zu vermeiden? Dann verwenden Sie das -x-Flag:

1curl -x http://proxy.example.org:4321 https://remote.example.org/Achten Sie nur darauf, Proxies verantwortungsvoll und im Rahmen der Nutzungsbedingungen der Website einzusetzen.

Mehrseitiges Scraping automatisieren

Möchten Sie mehrere Seiten scrapen – etwa paginierte Produktlisten? Dann nutzen Sie eine einfache Shell-Schleife:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-$\{p\}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-$\{p\}.html"

4 sleep 1

5doneDamit werden die Seiten 2 bis 5 des Books-to-Scrape-Katalogs abgerufen und jeweils als separate Datei gespeichert. (Seite 1 ist die Startseite.)

Grenzen von Web-Scraping mit cURL: Was Sie wissen sollten

So sehr ich cURL auch schätze – es ist kein Wundermittel. Hier sind die Schwächen:

- Keine JavaScript-Ausführung: cURL kann keine Seiten verarbeiten, die JavaScript zum Rendern von Inhalten oder zum Lösen von Anti-Bot-Hürden benötigen ().

- Manuelles Parsen erforderlich: Sie erhalten rohes HTML oder JSON, müssen es aber selbst parsen – oft mit zusätzlichen Skripten oder Tools.

- Begrenztes Session-Handling: Komplexe Logins, Token oder mehrstufige Formulare können schnell unübersichtlich werden.

- Keine integrierte Datenstrukturierung: cURL verwandelt Webseiten nicht in Zeilen, Tabellen oder Tabellenkalkulationen.

- Anfällig für Anti-Bot-Erkennung: Viele Websites setzen heute fortgeschrittene Bot-Abwehrmechanismen ein (JavaScript, Fingerprinting, CAPTCHAs), die cURL schlicht nicht umgehen kann ().

Hier ist eine kurze Vergleichstabelle:

| Einschränkung | Nur cURL | Moderne Scraping-Tools (z. B. Thunderbit) |

|---|---|---|

| JavaScript-Unterstützung | Nein | Ja |

| Datenstrukturierung | Manuell | Automatisch (KI/Vorlage) |

| Session-Handling | Manuell | Automatisch |

| Anti-Bot-Umgehung | Begrenzt | Fortgeschritten (browserbasiert/KI) |

| Benutzerfreundlichkeit | Technisch | Nicht-technisch |

Für statische Seiten und APIs ist cURL großartig. Für alles Dynamische oder Geschützte sollten Sie auf ein leistungsfähigeres Tool wechseln.

Thunderbit vs. cURL: Der beste Web-Scraping-Ansatz für nicht-technische Nutzer

Jetzt sprechen wir über , unsere KI-gestützte Chrome-Erweiterung für Web-Scraping. Wenn Sie im Vertrieb, Marketing oder Operations arbeiten und Daten einfach nur von einer Website nach Excel, Google Sheets oder Notion bringen möchten – ohne die Kommandozeile anzufassen –, ist Thunderbit genau dafür gebaut.

So schneidet Thunderbit im Vergleich zu cURL ab:

| Funktion | cURL | Thunderbit |

|---|---|---|

| Benutzeroberfläche | Kommandozeile | Per Klick bedienbar (Chrome-Erweiterung) |

| KI-Feldvorschläge | Nein | Ja (KI liest die Seite und schlägt Spalten vor) |

| Paginierung/Unterseiten | Manuelle Skripte | Automatisch (KI erkennt und extrahiert) |

| Datenexport | Manuell (parsen + speichern) | Direkt nach Excel, Google Sheets, Notion, Airtable |

| JavaScript/Geschützte Seiten | Nein | Ja (browserbasiertes Scraping) |

| Kein Code erforderlich | Nein (Scripting nötig) | Ja (für alle nutzbar) |

| Kostenloser Tarif | Immer kostenlos | Kostenlos für bis zu 6 Seiten (10 mit Test-Boost) |

Mit Thunderbit öffnen Sie einfach die Erweiterung, klicken auf „KI-Felder vorschlagen“ und lassen die KI herausfinden, welche Daten extrahiert werden sollen. Sie können Tabellen, Listen, Produktdetails und sogar Unterseiten automatisch besuchen. Anschließend exportieren Sie Ihre Daten direkt in Ihre bevorzugten Business-Tools – ohne Parsen, ohne Stress.

Thunderbit wird von über genutzt und ist besonders beliebt bei Teams aus Vertrieb, E-Commerce und Immobilien, die schnell strukturierte Daten brauchen.

Möchten Sie es testen? .

cURL und Thunderbit kombinieren: Flexible Web-Scraping-Strategien

Wenn Sie technisch unterwegs sind, müssen Sie sich nicht für nur ein Tool entscheiden. Tatsächlich nutzen viele Teams cURL und Thunderbit zusammen, um maximale Flexibilität zu erreichen:

- Mit cURL prototypisieren: Nutzen Sie cURL, um Endpunkte schnell zu testen, Header zu prüfen und zu verstehen, wie eine Website antwortet.

- Mit Thunderbit skalieren: Wenn Sie strukturierte Daten, mehrseitiges Scraping oder einen wiederholbaren Workflow brauchen, wechseln Sie zu Thunderbit für Klick-basierte Extraktion und direkten Export.

Hier ist ein beispielhafter Workflow für Marktforschung:

- Nutzen Sie cURL, um einige Seiten abzurufen und die HTML-Struktur zu prüfen.

- Identifizieren Sie die gewünschten Datenfelder, z. B. Produktnamen, Preise oder Bewertungen.

- Öffnen Sie Thunderbit, klicken Sie auf „KI-Felder vorschlagen“ und lassen Sie die KI den Scraper einrichten.

- Scrapen Sie alle Seiten, einschließlich Unterseiten oder paginierter Listen, und exportieren Sie nach Google Sheets.

- Analysieren, teilen und nutzen Sie Ihre Daten – ganz ohne manuelles Parsen.

Hier ist eine kurze Entscheidungstabelle:

| Szenario | cURL verwenden | Thunderbit verwenden | Beides verwenden |

|---|---|---|---|

| Schneller API- oder Seitenabruf | ✅ | ||

| Strukturierte Daten in einer Tabelle | ✅ | ||

| Header/Cookies debuggen | ✅ | ||

| Dynamische/JavaScript-lastige Seiten scrapen | ✅ | ||

| Einen wiederholbaren, No-Code-Workflow aufbauen | ✅ | ||

| Prototyping, danach Skalierung | ✅ | ✅ | Hybrid-Workflow |

Häufige Herausforderungen und Stolperfallen beim Web-Scraping mit cURL

Bevor Sie mit cURL loslegen, sollten Sie die realen Herausforderungen kennen:

- Anti-Bot-Systeme: Viele Websites verwenden heute fortgeschrittene Schutzmechanismen (JavaScript-Challenges, CAPTCHAs, Fingerprinting), die cURL nicht umgehen kann ().

- Probleme mit der Datenqualität: Änderungen im HTML, fehlende Felder oder inkonsistente Layouts können Ihre Skripte brechen.

- Wartungsaufwand: Jedes Mal, wenn sich eine Website ändert, müssen Sie Ihre Parsing-Logik anpassen.

- Rechtliche und Compliance-Risiken: Prüfen Sie immer die Nutzungsbedingungen, robots.txt und die geltenden Gesetze, bevor Sie scrapen. Nur weil Daten öffentlich sind, heißt das nicht, dass ihre Nutzung frei ist (, ).

- Skalierungsgrenzen: cURL ist großartig für kleine Jobs, aber bei Scraping im großen Maßstab müssen Sie Proxies, Rate Limits und Fehlerbehandlung managen.

Tipps zur Fehlersuche und für Compliance:

- Beginnen Sie immer mit genehmigten oder Demo-Seiten (wie ).

- Halten Sie sich an Rate Limits – nicht auf Endpunkte einprügeln.

- Vermeiden Sie das Scraping personenbezogener Daten, sofern keine rechtliche Grundlage vorliegt.

- Wenn Sie an JavaScript- oder CAPTCHA-Wände stoßen, wechseln Sie zu einem browserbasierten Tool wie Thunderbit.

Schritt-für-Schritt-Zusammenfassung: Websites mit cURL scrapen

Hier ist Ihre Schnellübersicht für Web-Scraping mit cURL:

- Ziel-URL(s) identifizieren: Beginnen Sie mit einer statischen Seite oder einem API-Endpunkt.

- Seite abrufen:

curl URL - Ausgabe in Datei speichern:

curl -o datei.html URL - Header prüfen / debuggen:

curl -I URL,curl -v URL - POST-Daten senden:

curl -d "a=1&b=2" URL - Cookies/Sessions handhaben:

curl -c cookies.txt ...,curl -b cookies.txt ... - Benutzerdefinierte Header/User-Agent setzen:

curl -A "..." -H "..." URL - Weiterleitungen folgen:

curl -L URL - Proxies verwenden (falls nötig):

curl -x proxy:port URL - Mehrseitiges Scraping automatisieren: Nutzen Sie Shell-Schleifen oder Skripte.

- Daten parsen und strukturieren: Verwenden Sie bei Bedarf zusätzliche Tools/Skripte.

- Für strukturiertes No-Code-Scraping oder dynamische Seiten zu Thunderbit wechseln.

Fazit und wichtigste Erkenntnisse: Das richtige Web-Scraping-Tool wählen

Web-Scraping mit cURL ist 2026 für technische Nutzer immer noch eine starke Fähigkeit – vor allem für schnelle Datenabrufe, Prototyping und Automatisierung. Geschwindigkeit, Skriptbarkeit und Allgegenwart machen cURL zu einem festen Bestandteil jedes Developer-Toolkits. Doch je dynamischer und besser geschützt das Web wird und je mehr Business-User strukturierte Daten ohne Code erwarten, desto stärker verändern Tools wie die Möglichkeiten.

Wichtigste Erkenntnisse:

- Verwenden Sie cURL für statische Seiten, APIs und schnelles Prototyping – besonders dann, wenn Sie volle Kontrolle wollen.

- Wechseln Sie zu Thunderbit (oder ähnlichen KI-Web-Scrapern), wenn Sie strukturierte Daten brauchen, dynamische/JavaScript-lastige Seiten verarbeiten oder einen No-Code-Workflow für Business-Anwender möchten.

- Kombinieren Sie beides für maximale Flexibilität: mit cURL prototypisieren, mit Thunderbit skalieren und strukturieren.

- Scrapen Sie immer verantwortungsvoll – beachten Sie Nutzungsbedingungen, Rate Limits und rechtliche Grenzen.

Neugierig, wie einfach Web-Scraping sein kann? und erleben Sie KI-gestützte Datenextraktion selbst. Und wenn Sie tiefer einsteigen möchten, schauen Sie im vorbei – mit weiteren Tutorials, Tipps und Brancheneinblicken. Vielleicht gefallen Ihnen auch diese Beiträge:

Viel Erfolg beim Scraping – und mögen Ihre Daten immer sauber, strukturiert und nur einen Befehl (oder Klick) entfernt sein.

FAQs

1. Kann cURL mit JavaScript gerenderte Webseiten verarbeiten?

Nein, cURL kann JavaScript nicht ausführen. Es ruft nur das rohe HTML ab, wie es vom Server ausgeliefert wird. Wenn eine Seite JavaScript braucht, um Inhalte zu rendern oder Anti-Bot-Hürden zu lösen, kann cURL nicht auf die Daten zugreifen. Verwenden Sie in solchen Fällen browserbasierte Tools wie .

2. Wie speichere ich cURL-Ausgaben direkt in einer Datei?

Verwenden Sie das -o-Flag: curl -o dateiname.html URL. Dadurch wird der Response-Body in eine Datei geschrieben, statt im Terminal angezeigt zu werden.

3. Was ist der Unterschied zwischen cURL und Thunderbit beim Web-Scraping?

cURL ist ein Kommandozeilen-Tool zum Abrufen roher Webdaten – ideal für technische Nutzer und Automatisierung. Thunderbit ist eine KI-gestützte Chrome-Erweiterung für Business-User, die strukturierte Daten von jeder Website extrahieren, dynamische Seiten verarbeiten und direkt nach Excel oder Google Sheets exportieren möchten – ganz ohne Code.

4. Ist es legal, Websites mit cURL zu scrapen?

Das Scrapen öffentlicher Daten ist in den USA nach jüngeren Gerichtsentscheidungen grundsätzlich legal, aber prüfen Sie immer die Nutzungsbedingungen der Website, robots.txt und die relevanten Gesetze. Vermeiden Sie das Scrapen personenbezogener oder geschützter Daten ohne Erlaubnis und beachten Sie Rate Limits sowie ethische Richtlinien (, ).

5. Wann sollte ich von cURL zu einem fortgeschritteneren Tool wie Thunderbit wechseln?

Wenn Sie dynamische/JavaScript-lastige Seiten scrapen müssen, strukturierte Daten in einer Tabelle brauchen oder einen No-Code-Workflow bevorzugen, ist Thunderbit die bessere Wahl. Nutzen Sie cURL für schnelle, technische Aufgaben; Thunderbit für geschäftstaugliche, wiederholbare Datenextraktion.

Weitere Tipps und Anleitungen zum Web-Scraping finden Sie im oder auf unserem .