Ist Web-Scraping illegal? Das ist die Millionenfrage, die ich jede Woche von Gründern, Marketingverantwortlichen und Daten-Nerds höre.

Da inzwischen – und damit zum ersten Mal automatisierter Traffic den menschlichen übertrifft – und ein großer Teil davon auf Web-Scraping für Business Intelligence, Vertrieb und KI-Training entfällt, ist es kein Wunder, dass alle wissen wollen, wo die rechtlichen Grenzen liegen.

Mal liest du eine Schlagzeile über ein Gerichtsurteil, wonach das Scrapen öffentlicher Daten fair und zulässig sei. Am nächsten Tag warnen Regulierungsbehörden vor „rechtswidriger“ Datenerfassung aus sozialen Medien. Das ist verwirrend – selbst für Leute wie mich, die ihre Tage mit dem Bau von KI-Web-Scraping-Tools bei verbringen.

Also: Ist Web-Scraping illegal? Die Antwort ist nicht einfach Ja oder Nein. Es hängt davon ab, was du scrapest, woher die Daten kommen, wie du sie nutzt und was das Gesetz in deinem Land sagt.

In diesem Deep Dive erkläre ich die rechtliche Lage, räume mit gängigen Mythen auf und teile praktische Tipps – plus ein paar Geschichten aus der Praxis –, damit du rechtssicher bleibst, egal ob du Solo-Gründer bist oder Teil eines Data-Teams bei einem Fortune-500-Unternehmen.

Web-Scraping und das Recht: Gibt es eine klare Grenze?

Wenn du auf eine Ein-Satz-Antwort hoffst, muss ich dich enttäuschen: Das Gesetz hat für Web-Scraping keine glasklare Linie gezogen.

Stattdessen gibt es ein Flickwerk aus überlappenden Regeln – Datenhoheit, Datenschutz, geistiges Eigentum, Anti-Hacking-Gesetze und die berüchtigten Nutzungsbedingungen (Terms of Service, ToS). All das kann eine Rolle spielen, und die Antwort hängt oft von deinem konkreten Fall ab ().

Hier die drei großen rechtlichen Bereiche:

- Datenhoheit: Grundsätzlich sind Fakten und öffentliche Informationen (wie Preise oder Telefonnummern) nicht urheberrechtlich geschützt. Kreative Inhalte (Artikel, Bilder) und proprietäre Datenbanken können jedoch geschützt sein – besonders in der EU, wo es „Datenbankrechte“ gibt ().

- Datenschutz: Moderne Datenschutzgesetze (etwa die DSGVO in Europa oder das PIPL in China) behandeln personenbezogene Daten als reguliertes Gut – selbst wenn sie öffentlich gepostet wurden. Namen, E-Mails oder Social-Media-Profile ohne rechtliche Grundlage zu scrapen, kann schnell heikel werden ().

- Verträge (Nutzungsbedingungen): Viele Websites verbieten Scraping ausdrücklich in ihren ToS. Auch wenn ToS keine Gesetze sind, können Gerichte sie als verbindliche Verträge behandeln. Verstöße können zu Klagen führen und in manchen Fällen sogar Anti-Hacking-Vorschriften auslösen, wenn technische Schutzmaßnahmen umgangen werden ().

Also: Ist Web-Scraping illegal? Manchmal ja, manchmal nein, und oft lautet die ehrliche Antwort: „Es kommt darauf an.“ Der Teufel steckt im Detail.

Rechtliche Perspektiven im Vergleich: USA, EU, UK, China

Hier ist eine kurze Tabelle, die zeigt, wie wichtige Regionen Web-Scraping bewerten:

| Region | Scraping öffentlicher Daten | Scraping personenbezogener/private Daten | Durchsetzung & wichtige Punkte |

|---|---|---|---|

| USA | Für öffentliche Daten in der Regel erlaubt (siehe hiQ v. LinkedIn). Verstöße gegen ToS können zu Zivilklagen führen. | Eingeschränkt/illegal, wenn du Logins umgehst oder personenbezogene Daten missbrauchst. Landesgesetze (etwa CCPA) können greifen. | Unterlassungsschreiben, IP-Blocking, Klagen. Das CFAA gilt, wenn technische Hürden umgangen werden. |

| EU | Unter bestimmten Bedingungen für nicht personenbezogene, öffentliche Daten erlaubt. Datenbankrechte können greifen. Der EU AI Act (2026) bringt Transparenzanforderungen für KI-Trainingsdaten. | Unter der DSGVO stark reguliert – selbst öffentliche personenbezogene Daten brauchen eine Rechtsgrundlage. | Datenschutzbehörden können wegen Datenschutzverstößen Bußgelder verhängen. Auch Urheber- und Datenbankrechte werden durchgesetzt. Der EU AI Act verbietet das Scrapen von Gesichtsaufnahmen für KI. |

| UK | Ähnlich wie in der EU. Öffentliche, nicht personenbezogene Daten können gescrapt werden, doch Datenrechte und Verträge müssen beachtet werden. | Streng bei personenbezogenen Daten – es gilt die UK-GDPR. Der Computer Misuse Act stellt unbefugten Zugriff unter Strafe. | Das ICO kann bei Datenschutzverstößen sanktionieren. Gerichte können ToS durchsetzen. |

| China | Stark reguliert. Öffentliche, nicht personenbezogene Daten dürfen möglicherweise für den internen Gebrauch gescrapt werden, aber das Umfeld ist vorsichtig. | Stark eingeschränkt – das PIPL verlangt für personenbezogene Daten eine Einwilligung. Gesetze gegen unlauteren Wettbewerb gelten ebenfalls. | Strafverfahren bei Scraping in großem Maßstab. Gerichte nutzen das Wettbewerbsrecht, um unbefugtes Scraping zu stoppen. |

(, )

Ist Web-Scraping illegal? Wichtige rechtliche Faktoren

Was entscheidet also tatsächlich darüber, ob dein Scraping-Projekt legal oder riskant ist? Hier sind die wichtigsten Faktoren:

- Öffentliche vs. private Daten: Daten zu scrapen, die jeder im offenen Web sehen kann, ist in der Regel sicherer. Alles zu scrapen, was hinter einem Login, einer Paywall oder einer technischen Hürde liegt? Das ist wahrscheinlich illegal ().

- Art der Daten: Personenbezogene Daten (Namen, E-Mails, Profile) lösen Datenschutzgesetze aus. Urheberrechtlich geschützte Inhalte (Artikel, Bilder) dürfen nicht einfach komplett kopiert werden. Reine Fakten (Preise, Wetter) sind meist zulässig ().

- Geplanter Zweck: Interne Analysen oder Forschung werden meist großzügiger bewertet als das erneute Veröffentlichen oder der Verkauf von gescrapten Daten. Gescrapte Daten direkt zur Konkurrenz gegen die Quelle einzusetzen? Das ist eine Klage mit Ansage ().

- Einhaltung der Website-Regeln: Prüfe immer robots.txt und ToS. robots.txt ist rechtlich nicht bindend, aber es ist gute Praxis, sie zu respektieren. Verstöße gegen ToS können Zivilklagen oder Schlimmeres bedeuten ().

- Technische Maßnahmen: Entscheidend ist, in menschlichem Tempo zu scrapen und Sicherheitsmaßnahmen nicht zu umgehen. Einen Server zu überlasten oder CAPTCHAs zu umgehen, kann schnell in Richtung Hacking gehen ().

Was sich 2024–2026 geändert hat: Wichtige Urteile und Regeln

Die Rechtslage für Web-Scraping hat sich seit 2023 deutlich verschoben. Hier sind die Entwicklungen, die jeder Scraper kennen sollte:

Wichtige Gerichtsentscheidungen

-

Meta gegen Bright Data (2024): Ein US-Bundesgericht . Der Richter stellte fest, dass „ein Besucher nicht als ‚Nutzer‘ gilt, solange er kein Konto hat“. Kurz danach nahm Meta die übrigen Ansprüche zurück. Das ist ein Meilenstein für das Scraping öffentlicher Daten.

-

X Corp gegen Bright Data (2024): Twitter (heute X) verlor eine ähnliche Klage und bestätigte damit denselben Grundsatz: Das Scrapen öffentlich zugänglicher Daten ohne Login verstößt nicht gegen ToS, weil der Scraper diesen Bedingungen nie zugestimmt hat.

-

Reddit gegen Perplexity AI (Oktober 2025): Reddit und berief sich dabei auf den DMCA sowie auf die Umgehung von Anti-Bot-Systemen. Das zeigt eine neue Strategie: Plattformen setzen zunehmend auf Urheberrecht und Anti-Umgehungs-Ansprüche statt auf das CFAA.

-

NYT gegen OpenAI (März 2025): Ein Bundesrichter und wies den Antrag von OpenAI auf Abweisung zurück. Das könnte einen wichtigen Präzedenzfall dafür schaffen, ob das Scrapen von Inhalten zum Training von KI-Modellen als „Fair Use“ gilt.

-

Anthropic-Vergleich (September 2025): Anthropic stimmte zu, 1,5 Milliarden US-Dollar zu zahlen, um eine US-amerikanische Urheberrechts-Sammelklage über die Nutzung urheberrechtlich geschützter Texte zum Training seines KI-Modells beizulegen – ein klares Signal, dass die Kosten von Scraping für KI sehr real sind.

Der große Trend: Vom CFAA hin zu Vertrags- und Urheberrecht

Das Muster ist klar: Das CFAA (Computer Fraud and Abuse Act) verliert als Waffe gegen Scraper öffentlicher Daten an Bedeutung. Unternehmen, die das CFAA gegen das Scrapen öffentlicher Daten einsetzen wollten – Meta, X, LinkedIn – sind weitgehend gescheitert. Stattdessen verlagert sich das juristische Schlachtfeld auf:

- Vertragsrecht (ToS-Verstöße – wobei Gerichte sagen, dass Nicht-Nutzer nicht an ToS gebunden sind)

- Urheberrechtsansprüche (vor allem bei KI-Trainingsdaten)

- Anti-Umgehungs-Vorschriften (DMCA Section 1201)

Für Scraper heißt das: Das rechtliche Risiko ist nicht verschwunden – es hat sich nur verlagert.

Regulatorische Änderungen

- CCPA-Updates 2026: Die überarbeiteten CCPA-Regeln Kaliforniens und enthalten neue Vorgaben für automatisierte Entscheidungssysteme (ADMT), Risikobewertungen und Pflichten für Datenbroker.

- Neue US-Datenschutzgesetze der Bundesstaaten: Indiana, Kentucky und Rhode Island haben umfassende Datenschutzgesetze erlassen, die 2026 wirksam wurden.

- EU AI Act: Die vollständige Durchsetzung beginnt am – mit der Pflicht für KI-Entwickler, Trainingsdatenquellen offenzulegen, Copyright-Opt-outs zu respektieren und das Scrapen von Gesichtsaufnahmen für KI-Systeme zu verbieten.

- AI Accountability for Publishers Act (Februar 2026): Ein vorgeschlagenes US-Gesetz, das KI-Unternehmen verpflichten würde, vor dem Scrapen von Inhalten die Erlaubnis der Publisher einzuholen und dafür zu zahlen.

Scraping-Richtlinien großer Plattformen: Was du wissen musst

Nicht jede Website geht gleich mit Scraping um. Hier ist ein Überblick pro Plattform darüber, was die größten Anbieter erlauben, was sie blockieren und was Gerichte dazu gesagt haben:

| Plattform | ToS zum Scraping | Technische Abwehrmaßnahmen | Rechtliche Durchsetzung | Was praktisch sicher ist |

|---|---|---|---|---|

| Google (Suche & Maps) | Verbietet automatisierten Zugriff in den ToS. Die Maps-Plattform hat eine ausdrückliche „No Scraping“-Klausel. | SearchGuard-JS-Challenges, CAPTCHAs, Rate-Limiting. Die robots.txt wurde 2025 aktualisiert, um KI-Crawler zu blockieren. | Klagte im Dezember 2025 mit dem DMCA gegen Scraper. Blockiert aktiv KI-Crawler (Anthropic, Meta, OpenAI). | Öffentliche Google-Maps-Geschäftsdaten zu scrapen ist rechtlich vertretbar (hiQ-Präzedenzfall), aber mit technischen Sperren ist zu rechnen. Wenn möglich, offizielle APIs nutzen. |

| Amazon | Verbietet in den Nutzungsbedingungen ausdrücklich jedes Scraping („no robot, spider, scraper, or other automated means“). | Aggressive Bot-Erkennung, CAPTCHA, IP-Blocking. robots.txt blockiert alle Bots außer Googlebot/Bingbot. Blockiert seit 2025 ausdrücklich KI-Crawler. | Verklagte Perplexity AI im November 2025. Versendet regelmäßig Unterlassungsschreiben. Aktualisierte die BSA im März 2026 um Regeln für KI-Agenten. | Öffentliche Produktdaten (Preise, Listings) sind nach US-Recht sachlich und scrapebar, aber Amazon wehrt sich massiv. Requests drosseln und keine personenbezogenen Daten erfassen. |

| Verbietet Scraping in den ToS; für den Zugriff auf Dienste ist die Zustimmung des Nutzers erforderlich. | Login-Schranken für die meisten Profildaten, Anti-Bot-Erkennung, Rate-Limiting. | Der hiQ-Fall bestätigte, dass das Scraping öffentlicher Profile kein CFAA-Verstoß ist, aber LinkedIn gewann bei Vertrags- und Wettbewerbsansprüchen, als Fake-Konten verwendet wurden. | Öffentliche Profile (ohne Login sichtbar) sind rechtlich vertretbar zu scrapen. Niemals Fake-Konten anlegen oder eingeloggte Daten scrapen. | |

| Meta (Facebook & Instagram) | ToS verbieten Scraping; getrennte Regeln für eingeloggte und ausgeloggte Daten. | Login-Schranken für die meisten Inhalte, fortschrittliche Bot-Erkennung. | Verlor 2024 gegen Bright Data – das Gericht entschied, dass ToS für nicht eingeloggte Scraper nicht gelten. Die übrigen Ansprüche wurden zurückgezogen. | Öffentliche Daten (Unternehmensseiten, öffentliche Beiträge), die ohne Login sichtbar sind, sind rechtlich sicherer. Niemals private Profile oder Daten hinter Login-Schranken scrapen. |

| X (Twitter) | Aktualisierte 2023 die ToS, um jedes Scraping und Crawling ohne schriftliche Zustimmung zu verbieten. Die frühere robots.txt-Ausnahme wurde gestrichen. | robots.txt blockiert alle Crawler (Disallow: /). Cloudflare-Turnstile-Challenges. Strenge Rate-Limits (300 Anfragen/Stunde). IP-Reputationsbewertung. | Verlor den Fall gegen Bright Data bei öffentlichen Daten, begrenzt den technischen Zugriff aber sehr aggressiv. | Öffentliche Tweets und Profile sind rechtlich vertretbar zu scrapen, aber X gehört 2026 zu den technisch schwierigsten Plattformen. Ohne Premium-Proxy-Infrastruktur sind Sperren zu erwarten. |

Fazit: Gerichte haben wiederholt entschieden, dass das Scrapen öffentlich sichtbarer Daten ohne Login nicht gegen das CFAA verstößt. Plattformen können dich aber weiterhin über Vertragsrecht, Urheberrecht oder Anti-Umgehungs-Regeln belangen – und sie werden dir mit technischen Hürden das Leben schwer machen. Scrape also immer verantwortungsvoll.

KI-Trainingsdaten und Web-Scraping: Die neue rechtliche Front

Wenn du 2026 die Nachrichten verfolgst, weißt du: Das Scrapen von Daten zum Training von KI-Modellen ist zum heißesten juristischen Schlachtfeld geworden. Das passiert gerade:

- Urheberrechtsklagen häufen sich. Die New York Times, Autoren und Verlage haben OpenAI, Anthropic und andere verklagt und argumentieren, dass massenhaftes Scrapen urheberrechtlich geschützter Inhalte zum Training von LLMs kein „Fair Use“ sei. Anthropic legte 2025 eine große Sammelklage für 1,5 Milliarden US-Dollar bei – ein Signal, dass die Kosten von Scraping für KI sehr real sind.

- Die „Fair-Use“-Verteidigung ist wacklig. US-Gerichte haben bislang noch keine endgültige Entscheidung dazu getroffen, ob das Training von KI mit gescrapten Daten als Fair Use gilt. Erste Entscheidungen deuten darauf hin, dass es stark davon abhängt, wie die Daten gewonnen wurden und was mit der KI-Ausgabe gemacht wird.

- Neue Gesetze sind in Arbeit. Der (eingebracht im Februar 2026) will KI-Unternehmen dazu verpflichten, vor dem Scrapen von Inhalten Erlaubnis einzuholen und Publisher zu bezahlen.

- Der EU AI Act (vollständige Anwendung ab ) verlangt von KI-Entwicklern, Trainingsdatenquellen offenzulegen, maschinenlesbare Copyright-Opt-outs zu respektieren (im Rahmen der TDM-Ausnahme der Urheberrechtsrichtlinie) und KI-generierte Inhalte zu kennzeichnen. Außerdem verbietet er KI-Systeme, die Gesichtsaufnahmen aus dem Internet scrapen.

- KI-/LLM-Crawler explodieren. KI-Crawler haben ihren Anteil am Web-Traffic innerhalb von nur acht Monaten von 2,6 % auf 10,1 % vervierfacht. Allein OpenAIs GPTBot wuchs um 305 %. Als Reaktion aktualisieren große Websites (Amazon, Reddit, die NYT) ihre robots.txt, um KI-Crawler ausdrücklich zu blockieren.

Was das für dich bedeutet: Wenn du Daten für klassische Geschäftszwecke scrapen willst (Lead-Generierung, Preisüberwachung, Marktforschung), gelten diese KI-spezifischen Regeln nicht immer direkt. Aber wenn du gescrapte Daten in KI-Modelle einspeist, solltest du extrem vorsichtig sein – und dir rechtlichen Rat holen.

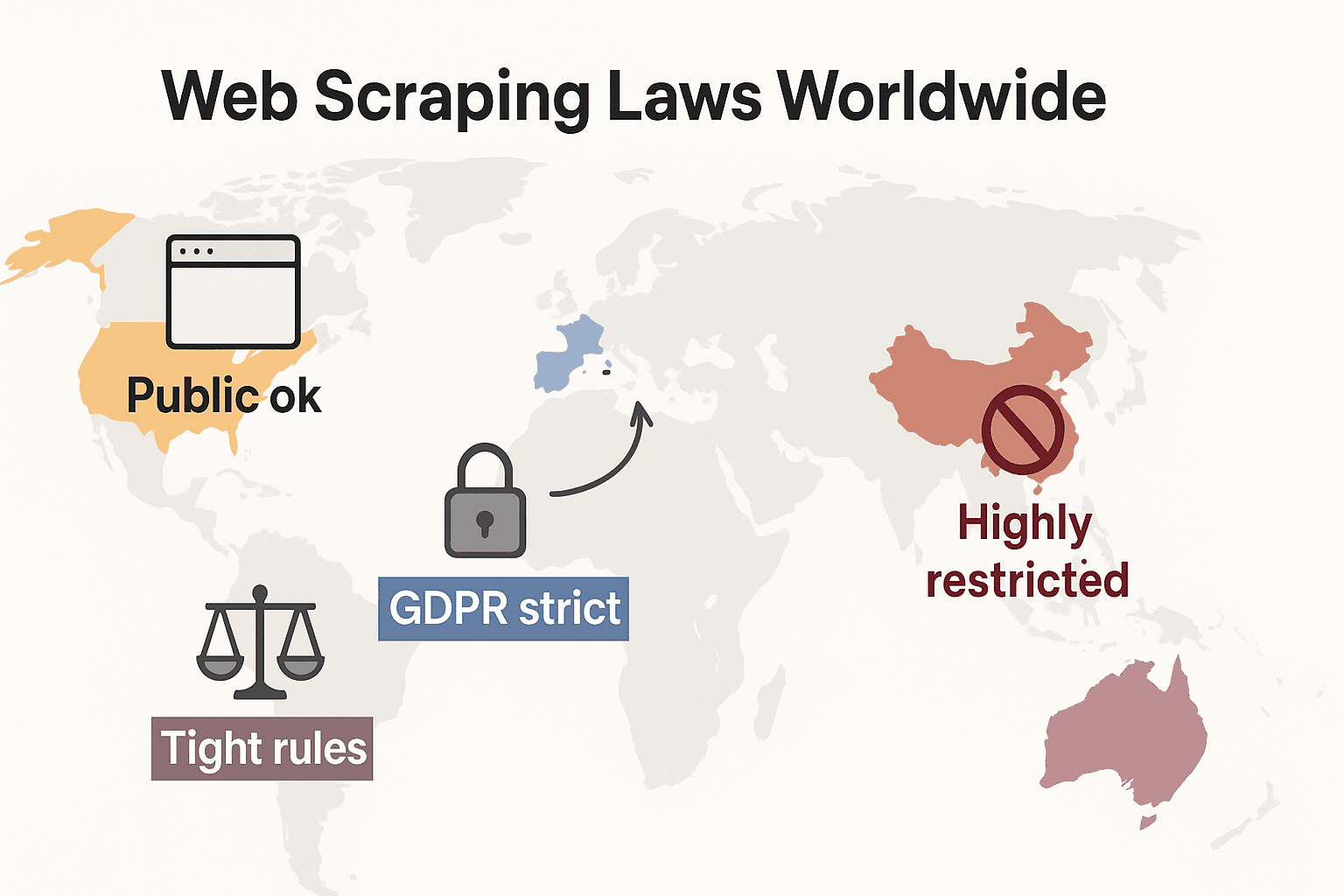

Web-Scraping-Gesetze weltweit: Ein kurzer Vergleich

Schauen wir einmal global auf die Lage:

- Vereinigte Staaten: Kein generelles Verbot. Das Scrapen öffentlich zugänglicher Websites ist in der Regel zulässig (), und die Urteile von 2024 in den Fällen Meta und X Corp haben das Argument für das Scraping öffentlicher Daten weiter gestärkt. Das Scrapen hinter Logins oder technischen Sperren kann aber weiterhin das CFAA auslösen. Der Trend geht inzwischen dahin, dass Unternehmen stattdessen Vertragsrecht und Urheberrecht nutzen. Datenschutzgesetze werden schnell ausgeweitet: CCPA erhielt zum 1. Januar 2026 umfangreiche Updates, darunter neue Regeln für automatisierte Entscheidungen und Pflichten für Datenbroker. Auch Indiana, Kentucky und Rhode Island haben 2026 umfassende Datenschutzgesetze erlassen.

- Europäische Union: Strenge Datenschutzgesetze. Die DSGVO gilt auch für öffentliche personenbezogene Daten. Datenbankrechte können das groß angelegte Scraping strukturierter Daten verhindern (). NEU: Der tritt am 2. August 2026 vollständig in Kraft und verpflichtet KI-Entwickler, Trainingsdatenquellen offenzulegen und Copyright-Opt-outs zu respektieren. Das Gesetz verbietet das Scrapen von Gesichtsaufnahmen aus dem Internet für KI-Systeme.

- Vereinigtes Königreich: Folgt nach dem Brexit weitgehend den EU-Regeln. Öffentliche Daten können gescrapt werden, aber das Scraping personenbezogener Informationen ist streng reguliert. Der Computer Misuse Act kann unbefugten Zugriff unter Strafe stellen.

- China: Sehr restriktiv. Das PIPL und das Data Security Law verlangen für personenbezogene Daten eine Einwilligung. Gerichte nutzen das Recht gegen unlauteren Wettbewerb, um Scraping zu stoppen, das Unternehmen schadet ().

Kurz gesagt: Das Scraping öffentlicher, nicht personenbezogener Daten für den internen Gebrauch ist in der Regel am sichersten. Alles andere? Prüfe die lokalen Gesetze und gehe vorsichtig vor.

Häufige Mythen über die Legalität von Web-Scraping

Räumen wir mit ein paar Mythen auf, die ich ständig höre:

- Mythos 1: „Web-Scraping ist grundsätzlich illegal.“

Falsch. Es gibt kein Gesetz, das jedes Web-Scraping verbietet. Entscheidend ist, wie und was du scrapest (). - Mythos 2: „Wenn Daten öffentlich sind, kann ich damit machen, was ich will.“

Nicht ganz. Öffentliche Daten können trotzdem durch Datenschutz- oder Urheberrecht geschützt sein, und ToS können bestimmte Nutzungen einschränken (). - Mythos 3: „Web-Scraping ist dasselbe wie Hacking.“

Nein. Öffentliche Webseiten zu scrapen ist kein Hacking. Logins oder technische Barrieren zu umgehen ist eine andere Geschichte (). - Mythos 4: „Wenn ich nicht erwischt werde, ist alles in Ordnung.“

Gefährliches Denken. Viele Websites setzen Anti-Bot-Technik ein und merken es. Schweigen ist keine Zustimmung. - Mythos 5: „Wenn ich Quellen nenne oder die Daten intern nutze, ist es okay.“

Eine Quellenangabe setzt Urheber- oder Datenschutzrecht nicht außer Kraft. Interne Nutzung ist sicherer, aber kein Freifahrtschein. - Mythos 6: „Jedes Web-Scraping verletzt den Datenschutz.“

Nicht jedes Scraping betrifft personenbezogene Daten. Aber große Mengen personenbezogener Informationen ohne Schutzmaßnahmen zu scrapen, ist fast immer illegal (). - Mythos 7: „Wenn eine Website in ihren ToS Scraping verbietet, ist Scraping immer illegal.“

Nicht unbedingt. 2024 entschieden Gerichte in Meta v. Bright Data und X Corp v. Bright Data, dass ToS Nutzer, die ihnen nie zugestimmt haben, nicht binden können – also: Wenn du ohne Login oder Konto scrapest, gelten die ToS der Website möglicherweise nicht für dich. Das ist noch im Wandel, aber ein bedeutender Kurswechsel.

Wie man Daten legal scraped: Best Practices für Compliance

Hier ist meine Standard-Checkliste für legales und ethisches Web-Scraping:

- Lies die Nutzungsbedingungen und halte dich daran. Wenn dort „kein Scraping“ steht, hör auf oder frag um Erlaubnis ().

- Bleib bei öffentlichen Daten. Wenn du ein Passwort brauchst, sind die Daten eingeschränkt – scrapen solltest du sie nicht ().

- Prüfe robots.txt und crawl höflich. Nicht rechtlich bindend, aber gute Etikette. Überlaste keine Server – verteile deine Anfragen ().

- Vermeide personenbezogene Daten, außer du hast eine rechtliche Grundlage. Wenn du sie erfassen musst, halte dich an DSGVO/CCPA und minimiere die Menge.

- Veröffentliche gescrapte Inhalte nicht 1:1 erneut. Füge Mehrwert oder Analyse hinzu oder hol dir eine Erlaubnis ().

- Füttere gescrapte Inhalte nicht ohne Urheberrechtsprüfung in KI-Modelle. Die Rechtslage ändert sich schnell – hol dir Rat, wenn das dein Use Case ist.

- Nutze offizielle APIs oder Datenexporte, wenn verfügbar. Sie sind genau dafür gedacht und meist sicherer ().

- Handle transparent und verantwortungsvoll. Wenn du personenbezogene Daten sammelst, informiere die Betroffenen und führe ein Protokoll deiner Aktivitäten.

- Minimiere und sichere deine Daten. Erhebe nur das Nötigste, halte es korrekt und speichere es sicher.

- Bleib informiert und hol dir bei Grenzfällen rechtlichen Rat. Gesetze und Urteile ändern sich schnell – besonders der EU AI Act und die US-Datenschutzgesetze der Bundesstaaten. Im Zweifel: Frag eine Fachperson.

Web-Scraping-Tools legal nutzen: Was Unternehmen wissen müssen

Web-Scraping-Tools wie machen Datenerfassung auch für Nicht-Programmierer zugänglich, aber du musst sie trotzdem verantwortungsvoll einsetzen:

- Wähle Tools mit Compliance-Fokus. Thunderbit etwa scrapt nur, was du in deinem Browser sehen kannst – keine versteckten API-Hacks oder unbefugten Zugriffe ().

- Bleib bei legitimen Use Cases. Interne Analysen, Marktforschung und Wettbewerbsbeobachtung bei Preisen sind in der Regel unproblematisch. Gescrapte Daten erneut veröffentlichen oder verkaufen? Viel riskanter.

- Konfiguriere die Tools auf Compliance. Lege Crawl-Verzögerungen fest, beachte robots.txt und nutze Vorlagen, die nur die nötigen Daten erfassen.

- Behalte die Nutzung intern. Interne Nutzung ist sicherer als eine erneute Veröffentlichung.

- Schule dein Team. Stelle sicher, dass alle die Regeln und Best Practices kennen.

- Nutze integrierte Compliance-Funktionen. Thunderbit warnt Nutzer vor riskanten Websites, scrapt mit menschlichem Tempo und speichert deine Daten nicht auf seinen Servern.

- Nicht mit Gewalt erzwingen. Wenn ein Tool eine Website nicht scrapen kann, versuche nicht, das System zu umgehen. Nicht alle Daten lassen sich risikolos abrufen.

Thunderbits Ansatz: Regelkonformes KI-Web-Scraping ermöglichen

Bei haben wir viel Zeit darauf verwendet, über Compliance nachzudenken. So hilft unser KI-Web-Scraper Nutzern, auf der sicheren Seite des Gesetzes zu bleiben:

- Scrapt nur, was du sehen kannst. Thunderbit arbeitet in deiner Browser-Sitzung und kann daher keine Daten abrufen, die du nicht manuell kopieren könntest.

- Leitet Nutzer mit Warnhinweisen. Wenn du versuchst, eine Website mit strengen Anti-Scraping-Regeln zu scrapen, warnt dich Thunderbit.

- Menschliche Scraping-Geschwindigkeit. Egal ob lokal oder in der Cloud: Thunderbit vermeidet es, Server zu überlasten.

- Anpassbare Datenauswahl. Unsere KI schlägt relevante Spalten vor, damit du nur das erfassen kannst, was du wirklich brauchst.

- Unterseiten und Pagination. Thunderbit navigiert wie ein echter Nutzer und respektiert die Struktur der Website.

- Datenschutz und Sicherheit. Deine Daten bleiben bei dir – Thunderbit speichert oder wiederverwendet sie nicht.

- Compliance-freundliche Exporte. Exportiere direkt nach Google Sheets, Airtable, Notion oder als CSV für eine sichere interne Nutzung.

- Zeitplanung und Automatisierung. Richte wiederkehrende Scrapes in verantwortungsvollen Intervallen ein.

- Mehrsprachige Unterstützung. Die UI von Thunderbit unterstützt 34 Sprachen und macht Compliance weltweit zugänglich.

- Regelmäßige Vorlagen-Updates. Unsere Sofortvorlagen für beliebte Websites werden laufend an rechtliche und technische Änderungen angepasst.

Indem Compliance direkt ins Produkt eingebaut wird, hilft Thunderbit Teams dabei, die benötigten Daten zu sammeln – ohne rechtlichen Ärger.

Immer einen Schritt voraus: Auf rechtliche und technische Änderungen im Web-Scraping reagieren

Web-Scraping ist kein „einrichten und vergessen“-Spiel. Gesetze und Website-Strukturen ändern sich ständig. So bleibst du vorne:

- Beobachte rechtliche Entwicklungen. Das Tempo der Veränderungen hat sich 2024–2026 beschleunigt – verfolge Tech-Recht, Updates von Regulierungsbehörden und Branchenblogs (wie ). Behalte die Durchsetzung des EU AI Act (August 2026), neue US-Datenschutzgesetze der Bundesstaaten und laufende Urheberrechtsfälle zu KI im Blick.

- Passe dich technischen Änderungen an. Websites aktualisieren ständig ihre Layouts und Anti-Bot-Abwehr. Große Plattformen (Amazon, X, Google) haben ihre Schutzmechanismen 2025–2026 deutlich verschärft. Thunderbits KI und Vorlagen sind darauf ausgelegt, sich automatisch anzupassen.

- Nutze offizielle APIs, wenn verfügbar. Wenn eine Website auf ein kostenpflichtiges API-Modell umstellt, denke aus Gründen der Zuverlässigkeit und Compliance über einen Wechsel nach.

- Prüfe dein Scraping regelmäßig. Dokumentiere deine Quellen, kontrolliere ToS- oder Richtlinienänderungen und passe deine Strategie bei Bedarf an.

- Nutze Thunderbits Vorlagen-Updates. Unser Team hält die Vorlagen aktuell, damit du dich nicht um Breaking Changes oder neue Compliance-Anforderungen kümmern musst.

- Bleib flexibel. Wenn eine Datenquelle zu riskant wird, wechsle zu einer anderen oder suche eine Partnerschaft.

Mit den richtigen Tools und der richtigen Denkweise kannst du deine Datenpipeline am Laufen halten – ohne auf rechtliche Minen zu treten.

Fazit: Sich durch die rechtliche Lage des Web-Scraping navigieren

Web-Scraping ist nicht von sich aus illegal – es ist ein starkes Werkzeug für Business, Forschung und Innovation. Aber wie jedes Werkzeug hat es Regeln. Entscheidend ist, zu verstehen, was du scrapest, wie du es scrapest und was du mit den Daten machst. Respektiere lokale Gesetze, halte dich an Website-Richtlinien und nutze compliance-orientierte Tools wie , um rechtlich sauber zu bleiben.

Die Urteile von 2024–2026 (Meta v. Bright Data, X Corp v. Bright Data) haben das Argument für das Scraping öffentlicher Daten gestärkt, aber neue Risiken entstehen rund um KI-Trainingsdaten, Urheberrechtsansprüche und den EU AI Act. Die Richtlinien der einzelnen Plattformen unterscheiden sich stark – Google, Amazon, LinkedIn, Meta und X setzen ihre Regeln jeweils anders durch – also kennst du die Lage, bevor du scrapest.

Wenn du dir jemals unsicher bist, hol dir rechtlichen Rat – besonders bei großen oder sensiblen Projekten. Und denk daran: Die Rechtslage verändert sich ständig, also bleib informiert und beweglich.

Willst du mehr über Web-Scraping, Compliance und Automatisierung erfahren? Schau im nach weiteren Leitfäden oder teste selbst.

FAQs

1. Ist Web-Scraping überall illegal?

Nein. Web-Scraping ist nicht von sich aus illegal, aber die Rechtmäßigkeit hängt davon ab, was du scrapest, wie du es scrapest und wo du dich befindest. Das Scrapen öffentlicher, nicht personenbezogener Daten für den internen Gebrauch ist in den meisten Regionen grundsätzlich erlaubt, aber das Scrapen personenbezogener oder urheberrechtlich geschützter Daten oder Verstöße gegen Website-Bedingungen können illegal sein ().

2. Macht robots.txt das Scrapen illegal, wenn ich sie ignoriere?

robots.txt ist rechtlich nicht bindend, aber es ist gute Praxis, sie zu respektieren. Das Ignorieren von robots.txt führt nicht allein zu einer Klage, kann dich aber im Streitfall wie einen „bad actor“ aussehen lassen ().

3. Kann ich Google, Amazon oder LinkedIn scrapen?

Das ist kompliziert. Alle drei verbieten Scraping in ihren ToS, aber Gerichte haben entschieden, dass ToS für nicht eingeloggte Nutzer möglicherweise nicht bindend sind (siehe Meta v. Bright Data und X Corp v. Bright Data, beide 2024). Öffentlich sichtbare Daten (Produktpreise, Unternehmenslisten, öffentliche Profile) zu scrapen, ist in den USA meist rechtlich vertretbar. Allerdings setzt jede Plattform ihre Regeln anders durch: Amazon ist bei rechtlichen Schritten am aggressivsten (es verklagte Perplexity AI im November 2025); LinkedIn setzt auf technische Sperren und Vertragsansprüche; Google nutzt zunehmend Durchsetzung über den DMCA. Scrape immer verantwortungsvoll und rechne mit technischen Gegenmaßnahmen.

4. Kann ich Facebook oder Instagram scrapen?

Nach Meta v. Bright Data (2024) ist das Scrapen öffentlicher Daten von Facebook und Instagram ohne Login rechtlich besser abgesichert. Das Gericht entschied, dass Metas ToS für Nicht-Nutzer nicht gelten. Lege aber niemals Fake-Konten an oder scrape Daten hinter Login-Schranken – das überschreitet die Grenze.

5. Kann ich X (Twitter) scrapen?

X hat seine ToS 2023 aktualisiert, um jedes Scraping ohne schriftliche Zustimmung zu verbieten, und setzt aggressive technische Abwehr ein (Cloudflare Turnstile, Rate-Limits von 300 Anfragen/Stunde, IP-Reputationsbewertung). Bright Data gewann jedoch vor Gericht in einem ähnlichen Zusammenhang – öffentlich ohne Konto gescrapte Daten sind nicht an Xs ToS gebunden. Technisch gesehen gehört X 2026 zu den am schwersten zu scrapenden Plattformen.

6. Ist das Scrapen von Daten zum Training von KI-Modellen legal?

Das ist 2026 die größte offene Frage. Große Klagen (NYT gegen OpenAI, der 1,5-Milliarden-Vergleich von Anthropic) deuten auf erhebliches rechtliches Risiko hin. Der EU AI Act verlangt die Offenlegung von Trainingsdatenquellen und die Beachtung von Copyright-Opt-outs. Der vorgeschlagene AI Accountability for Publishers Act würde Erlaubnis und Bezahlung verlangen. Wenn du für KI trainierst, hole dir vorher rechtlichen Rat.

7. Was ist der sicherste Weg, Web-Scraping-Tools wie Thunderbit zu nutzen?

Bleib bei öffentlichen Daten, halte dich an die Website-Bedingungen, vermeide personenbezogene Informationen, sofern du keine rechtliche Grundlage hast, und nutze die Daten intern. Thunderbit soll dir helfen, regelkonform zu bleiben, indem es nur das scrapt, was in deinem Browser sichtbar ist, und dich vor riskanten Websites warnt ().

8. Kann ich Daten für kommerzielle Zwecke scrapen?

Das hängt davon ab. Die Nutzung gescrapter Daten für interne Analysen oder Forschung ist in der Regel sicherer. Das erneute Veröffentlichen oder Verkaufen von gescrappten Daten, insbesondere wenn sie urheberrechtlich geschützt oder personenbezogen sind, ist deutlich riskanter und kann eine Erlaubnis oder Lizenz erfordern.

9. Wie halte ich mich über rechtliche und technische Änderungen im Web-Scraping auf dem Laufenden?

Verfolge Tech-Recht-News, beobachte die ToS- oder Richtlinienänderungen deiner Zielseiten und nutze Tools wie Thunderbit, die ihre Vorlagen und Compliance-Funktionen regelmäßig aktualisieren. Wichtige Themen für 2026: Durchsetzung des EU AI Act (August), laufende Urheberrechtsfälle zu KI und neue Datenschutzgesetze in den US-Bundesstaaten. Im Zweifel: Wende dich an eine juristische Fachkraft.