Am 1. Mai 2024 setzte die niederländische Datenschutzbehörde mit einer Schlagzeile ein Ausrufezeichen, das in ganz Europa jedes Datenteam aufhorchen ließ: Wenn Sie in Sales, E-Commerce oder Immobilien arbeiten — also überall dort, wo Webdaten eine Rolle spielen —, dürfte Ihnen bei diesem Satz kurz der Magen gerutscht sein.

Ich kenne das. Bei sprechen wir jeden Tag mit Teams, die Webdaten für Preisüberwachung, Lead-Generierung und Marktforschung brauchen. Die Frustration ist immer dieselbe: Man googelt „is web scraping legal in Europe“, und jede Antwort lautet im Kern „es kommt darauf an“. Das hilft wenig, wenn eine Deadline drängt und eine Liste von URLs darauf wartet, gescraped zu werden.

Also habe ich Wochen damit verbracht, die tatsächlichen Regeln, Leitlinien der Datenschutzbehörden, Durchsetzungsfälle und Gerichtsurteile durchzuarbeiten — mit dem Ziel, etwas wirklich Nützliches zu bauen: eine praktische Entscheidungs-Checkliste, eine zusammengefasste Tabelle mit Schutzmaßnahmen, echte Bußgeldbeträge und eine Schritt-für-Schritt-Anleitung, wie man europäische Websites scraped, ohne auf der falschen Seite eines Regulators zu landen. Ob Sie Amazon-Produktpreise scrapen oder B2B-Kontakte aus einem Verzeichnis ziehen: Dieser Artikel zeigt Ihnen, wo die Grenzen liegen — und wie Sie auf der sicheren Seite bleiben.

Was ist Web-Scraping (und warum sollten europäische Unternehmen sich darum kümmern)?

Web-Scraping ist die automatisierte Extraktion von Daten aus Websites in ein strukturiertes Format — etwa eine Tabelle, eine Datenbank oder ein CRM. Statt Produktnamen und Preise von 200 Seiten per Copy-and-Paste zu übernehmen, ruft ein Scraper jede Seite ab und zieht die benötigten Felder sauber in Spalten.

Warum ist das für nicht-technische Teams wichtig? Weil Webdaten echte Geschäftsentscheidungen antreiben. Vertriebsteams scrapen Verzeichnisse nach Leads. E-Commerce-Manager überwachen täglich die Preise der Wettbewerber. Immobilienanalysten verfolgen Angebots-Trends über Portale hinweg. Marktforscher sammeln öffentliche Bewertungen und Rezensionen im großen Stil. Der wächst schnell, und Unternehmen scrapen jeden Tag Millionen von Datenpunkten.

Doch Europas regulatorisches Umfeld unterscheidet sich von dem der USA. Die DSGVO, die Datenbankrichtlinie und sich weiterentwickelnde Leitlinien der Datenschutzbehörden bedeuten, dass „öffentlich verfügbar“ nicht automatisch „frei nutzbar“ heißt. Wie der Vorsitzende der niederländischen DPA, Aleid Wolfsen, formulierte: „öffentlich bedeutet nicht automatisch Erlaubnis zum Scraping.“ Die Regeln zu kennen, bevor man loslegt, ist kein Nice-to-have — es ist der Unterschied zwischen einem sauberen Datensatz und einem Bußgeld in sechsstelliger Höhe.

Ist Web-Scraping in Europa legal? Die kurze Antwort

Web-Scraping ist in Europa nicht per se illegal. Die Rechtmäßigkeit hängt aber von drei Dingen ab: welche Daten Sie scrapen, wie Sie scrapen und warum.

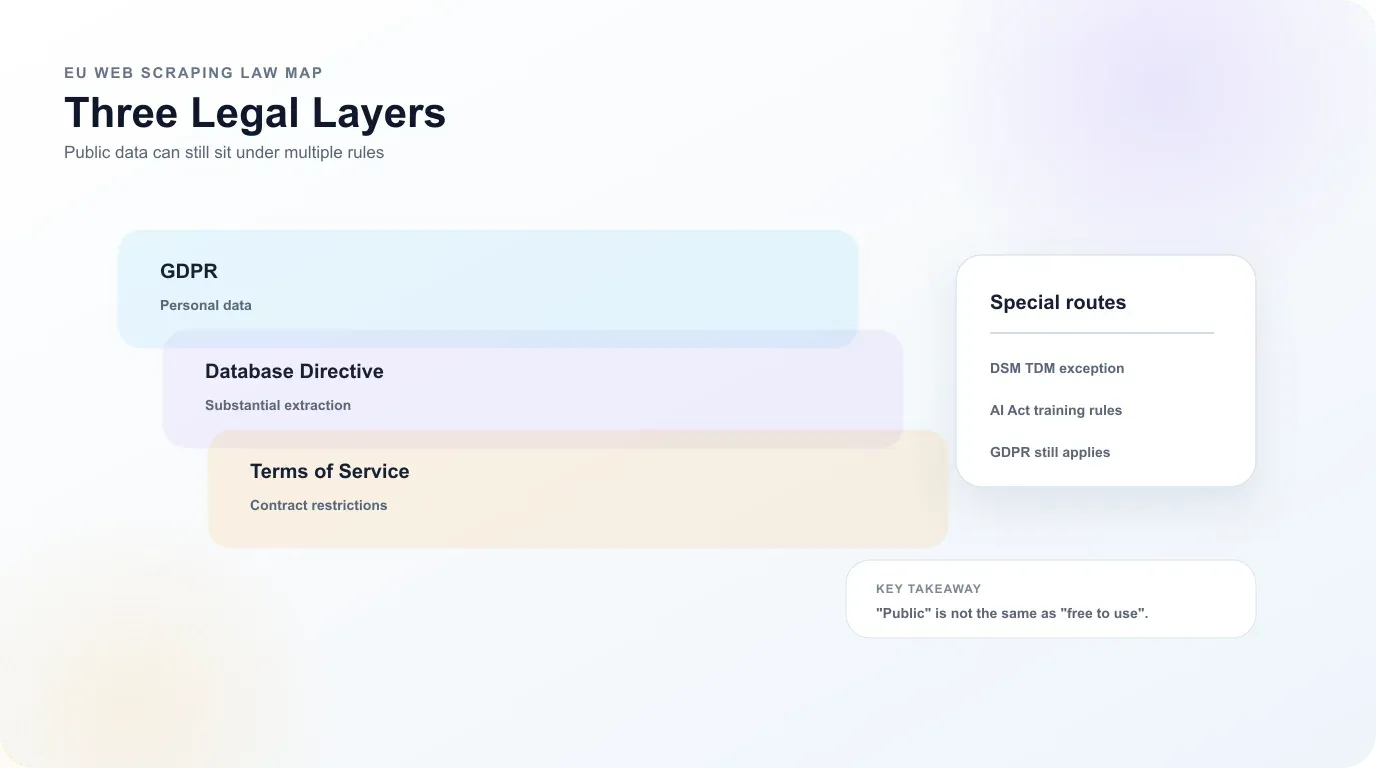

Drei sich überschneidende Rechtsebenen regeln Scraping in der EU:

- DSGVO — gilt immer dann, wenn Sie personenbezogene Daten scrapen (Namen, E-Mails, Telefonnummern, IP-Adressen, sogar pseudonymisierte Kennungen).

- Die EU-Datenbankrichtlinie — schützt Datenbanken, in die der Hersteller eine „wesentliche Investition“ in die Organisation der Daten gesteckt hat.

- Vertragsrecht/AGB-Recht — viele Websites verbieten Scraping ausdrücklich in ihren Nutzungsbedingungen, und EU-Gerichte haben diese Bedingungen durchgesetzt.

Der entscheidende Punkt: „öffentlich“ heißt nicht „regelfrei“. Selbst nicht-personenbezogene Daten können durch Datenbankrechte oder Vertragsrecht geschützt sein. Jedes Scraping-Projekt muss alle drei Ebenen gemeinsam betrachten.

Die wichtigsten EU-Gesetze, die Web-Scraping regeln

DSGVO: Wenn Sie personenbezogene Daten scrapen

Jede Information, die einer identifizierbaren Person zugeordnet werden kann, löst DSGVO-Pflichten aus. Dazu gehören Namen, E-Mail-Adressen, Telefonnummern, IP-Adressen, Fotos und sogar pseudonymisierte Daten, die re-identifiziert werden können. Sobald Sie personenbezogene Daten scrapen, sind Sie ein „Verantwortlicher“ mit Pflichten nach der DSGVO:

- Rechtsgrundlage (Artikel 6): Sie brauchen einen rechtlichen Grund für die Verarbeitung. Einwilligung ist beim Scraping in großem Maßstab fast nie praktikabel — Millionen Menschen um Erlaubnis zu bitten, bevor man ihre öffentlich geposteten Informationen sammelt, ist unrealistisch. Am häufigsten wird berechtigtes Interesse (Artikel 6 Absatz 1 Buchstabe f) angeführt. Dafür braucht es aber einen dokumentierten Drei-Stufen-Test: (1) Ihr Interesse ist berechtigt, (2) die Verarbeitung ist erforderlich und (3) sie beeinträchtigt die Rechte der betroffenen Personen nicht unverhältnismäßig, unter Berücksichtigung ihrer vernünftigen Erwartungen.

- Transparenz (Artikel 14): Da Sie die Daten nicht direkt bei der Person erheben, müssen Sie sie in der Regel innerhalb eines Monats darüber informieren, was Sie gesammelt haben, warum und wie sie ihre Rechte ausüben können. Ist eine individuelle Benachrichtigung unverhältnismäßig, müssen Sie stattdessen einen allgemeinen Hinweis mit allen Inhalten nach Artikel 14 veröffentlichen.

- Datenminimierung: Sammeln Sie nur, was Sie wirklich brauchen. Wenn Sie Produktpreise wollen, greifen Sie nicht zusätzlich E-Mail-Adressen von Verkäufern ab.

- Speicherbegrenzung und Rechte-Management: Legen Sie Aufbewahrungsfristen fest, respektieren Sie Löschersuchen und stellen Sie Zugriff auf Quelleninformationen bereit.

Der (angenommen im Mai 2024) fügte noch eine weitere Ebene hinzu: Er stellte klar, dass unterschiedliche Verarbeitungsschritte — Erhebung, Vorverarbeitung, Training, Prompts und Ausgabe — jeweils eine eigene Prüfung der Rechtsgrundlage benötigen. Der EDPB hat berechtigtes Interesse für Web-Scraping nicht ausgeschlossen, aber auf die vollständige Drei-Stufen-Prüfung mit angemessenen Schutzmaßnahmen bestanden.

Die EU-Datenbankrichtlinie: Schutz der Datenorganisation

Die Datenbankrichtlinie gewährt Herstellern von Datenbanken ein sui-generis-Recht, wenn sie eine „wesentliche Investition“ in das Beschaffen, Prüfen oder Darstellen ihrer Daten getätigt haben. Wenn Ihr Scraping einen „wesentlichen Teil“ einer solchen Datenbank extrahiert, kann dieses Recht verletzt werden.

In der Praxis ist die Schwelle relativ hoch. Ein paar hundert Produktpreise von einem großen Händler zu scrapen, erfüllt sie wahrscheinlich nicht. Aber das Massen-Downloaden des gesamten Katalogs eines Wettbewerbers — zigtausend Einträge — kann die Grenze überschreiten, vor allem wenn dadurch die Möglichkeit des Herstellers gefährdet wird, seine Investition wieder einzuspielen. Der Gerichtshof der Europäischen Union hat diese Schwelle in mehreren Fällen ausgelegt; die Kernfrage ist immer die Verhältnismäßigkeit.

Für das meiste Business-Scraping — also das Ziehen bestimmter Felder aus Produktseiten oder der Vergleich von Angeboten innerhalb einer Kategorie — ist das Risiko aus der Datenbankrichtlinie eher geringer. Null ist es aber nicht, und bei der Planung des Scraping-Umfangs sollte man es im Hinterkopf behalten.

Nutzungsbedingungen: die Wildcard des Vertragsrechts

Hier stolpern viele. Viele Websites verbieten Scraping in ihren Nutzungsbedingungen. In Europa ist ein Verstoß gegen die AGB zwar zivilrechtlich, nicht strafrechtlich, kann aber trotzdem Unterlassungsansprüche, Vertragsklagen und echte finanzielle Risiken nach sich ziehen.

Zwei Varianten sind wichtig: Browsewrap (passive Bedingungen, oft nur ein Link am Seitenende) ist schwerer durchzusetzen, weil der Nutzer nie aktiv zugestimmt hat. Clickwrap (man setzt ein Häkchen oder klickt auf „Ich stimme zu“) ist deutlich besser durchsetzbar.

Der wegweisende EU-Fall ist Ryanair v. PR Aviation: Das Gericht setzte Ryanairs Nutzungsbedingungen gegenüber einem Scraper durch, obwohl Datenbankrechte nicht griffen, weil der Scraper den Bedingungen zugestimmt hatte. Daher gilt: Prüfen Sie vor dem Scraping immer die Nutzungsbedingungen der Website. Wenn es sich um eine Clickwrap-Vereinbarung handelt, die Scraping ausdrücklich verbietet, gehen Sie vorsichtig vor — oder suchen Sie stattdessen nach einer API.

Die DSM-Richtlinie und der AI Act: Ausnahmen für Forschung und Text- und Data-Mining

Nicht jedes Scraping unterliegt denselben Einschränkungen. Die Richtlinie über das Urheberrecht im digitalen Binnenmarkt (DSM-Richtlinie, 2019) führte zwei Ausnahmen für Text- und Data-Mining (TDM) ein:

- Artikel 3: Forschungseinrichtungen und Einrichtungen des Kulturerbes dürfen TDM mit rechtmäßig zugänglichen Inhalten durchführen.

- Artikel 4: Jeder — einschließlich kommerzieller Unternehmen — darf TDM durchführen, sofern die Rechteinhaber nicht ausdrücklich widersprochen haben (z. B. über robots.txt, ai.txt oder TDMRep-Header).

Der EU AI Act (Artikel 53) fügt Anbietern von KI-Modellen Pflichten hinzu: Sie müssen die TDM-Opt-out-Mechanismen beachten und ihre Trainingsdatenquellen dokumentieren.

Ein wichtiger Haken: Diese Ausnahmen betreffen Urheberrecht und Datenbankrechte, nicht die DSGVO. Wenn Ihr TDM personenbezogene Daten umfasst, brauchen Sie weiterhin eine eigene DSGVO-Rechtsgrundlage.

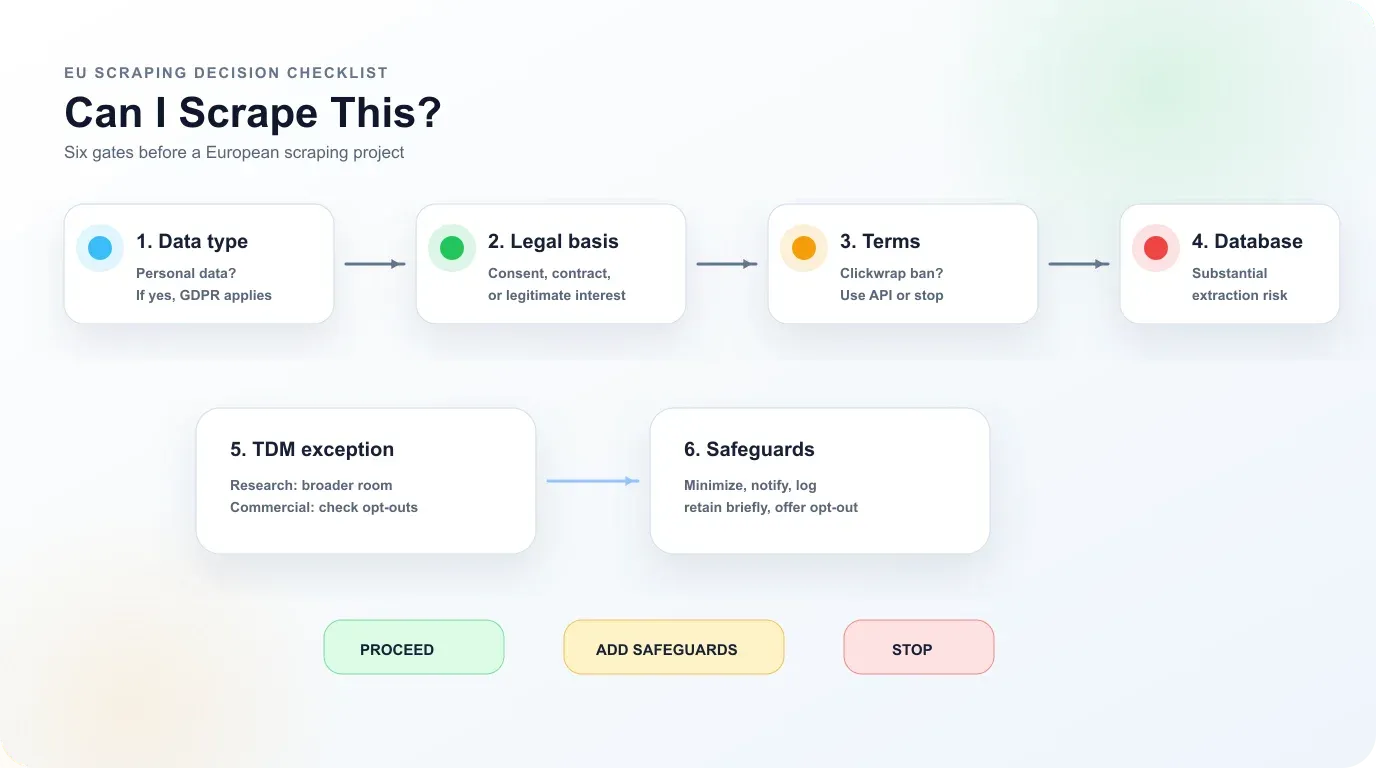

Die Entscheidungs-Checkliste: „Darf ich das scrapen?“ für europäische Daten

Das ist die Passage, die ich mir gewünscht hätte, als ich mit der Recherche angefangen habe. Jeder Rechtsartikel sagt „es kommt darauf an“ — aber wie sieht der Entscheidungsbaum konkret aus? Hier ist eine Schritt-für-Schritt-Compliance-Checkliste mit klaren Entscheidungspunkten. Jeder Schritt führt zu ✅ weiter, ⚠️ Schutzmaßnahmen ergänzen oder 🛑 stoppen.

Schritt 1: Sind die Daten personenbezogen oder nicht-personenbezogen?

Nicht-personenbezogene Daten (Produktpreise, SKU-Nummern, Geschäftsadressen, die keiner Person zugeordnet sind): geringere regulatorische Belastung. Sie müssen weiterhin die Datenbankrichtlinie und die AGB prüfen, aber die DSGVO greift nicht. ✅ Weiter zu Schritt 3.

Personenbezogene Daten (Namen, E-Mails, Telefonnummern, Fotos, jede Kennung, die mit einer Person verknüpft ist): Die DSGVO gilt. ⚠️ Weiter zu Schritt 2.

Schritt 2: Welche DSGVO-Rechtsgrundlage gilt?

- Einwilligung: Beim Scraping in großem Maßstab fast nie praktikabel. 🛑 Außer in einem sehr engen, spezifischen Szenario.

- Berechtigtes Interesse (Artikel 6 Absatz 1 Buchstabe f): Die häufigste Grundlage. Dafür braucht es aber einen dokumentierten Drei-Stufen-Test:

- Ihr Interesse ist berechtigt (ein kommerzielles Interesse kann ausreichen, wie der bestätigt hat).

- Die Verarbeitung ist für dieses Interesse erforderlich.

- Die Abwägung fällt zu Ihren Gunsten aus, ohne die Rechte der betroffenen Personen zu überwiegen, unter Berücksichtigung ihrer vernünftigen Erwartungen.

- Dokumentieren Sie die Interessenabwägung vor dem Scraping. Wenn Sie nicht plausibel erklären können, warum die Personen, deren Daten Sie scrapen, diese Nutzung vernünftigerweise erwarten würden, ist das ein Warnsignal. ⚠️ Nur mit dokumentiertem berechtigtem Interesse fortfahren.

Schritt 3: Beschränken die Nutzungsbedingungen der Website das Scraping?

- Clickwrap-Vereinbarung, die Scraping verbietet: 🛑 Hohes Risiko. Prüfen Sie alternative Datenquellen oder eine offizielle API.

- Browsewrap oder keine Scraping-Beschränkung in den AGB: ⚠️ Geringeres Risiko, aber robots.txt und technische Ablehnungssignale trotzdem respektieren.

Schritt 4: Gilt die Datenbankrichtlinie?

- Handelt es sich beim Ziel um eine Datenbank mit erheblicher Investition in die Datenorganisation?

- Würde Ihr Scraping einen „wesentlichen Teil“ dieser Datenbank extrahieren?

- Wenn beides mit Ja beantwortet wird: ⚠️ Risiko einer Verletzung des sui-generis-Rechts. Begrenzen Sie den Extraktionsumfang.

Schritt 5: Fallen Sie unter eine Forschungs- oder TDM-Ausnahme?

- Registrierte Forschungseinrichtung oder Einrichtung des Kulturerbes? Dann kann Artikel 3 der DSM-Richtlinie greifen. ✅

- Kommerzielles TDM? Prüfen Sie Opt-out-Signale nach Artikel 4 (robots.txt, ai.txt, TDMRep). Hat die Website widersprochen, 🛑 für diese Quelle stoppen.

Schritt 6: Haben Sie die von den Datenschutzbehörden empfohlenen Schutzmaßnahmen umgesetzt?

Wenn Sie die obigen Hürden genommen haben, besteht der letzte Schritt darin, die Schutzmaßnahmen umzusetzen, die CNIL, die niederländische DPA und der EDPB empfehlen. Diese werden im nächsten Abschnitt im Detail behandelt. ✅ Mit Schutzmaßnahmen fortfahren.

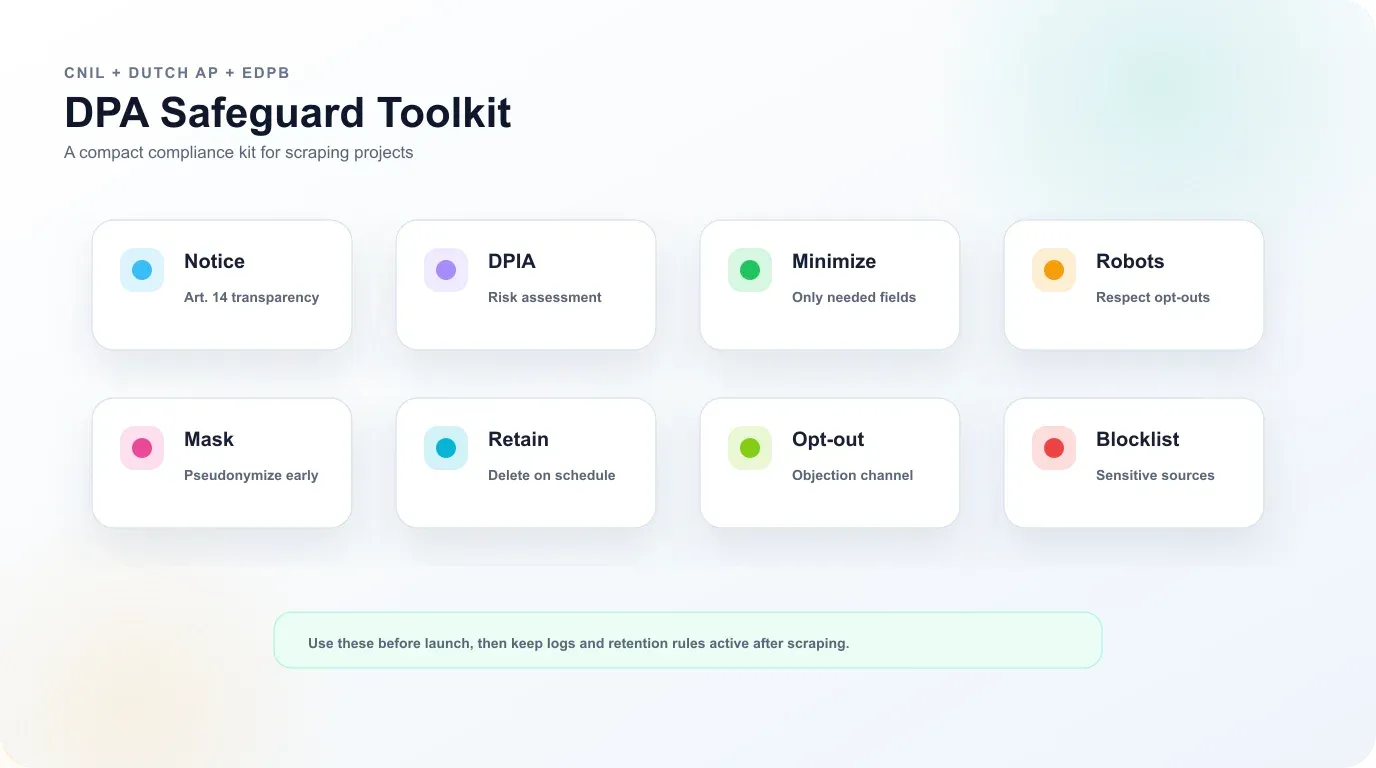

Compliance-Schutzmaßnahmen: Was CNIL, niederländische DPA und EDPB empfehlen

Kein einzelner Wettbewerber-Artikel, den ich gefunden habe, bündelt die Schutzmaßnahmen der drei aktivsten europäischen Aufsichtsbehörden zum Thema Scraping. Deshalb habe ich diese Tabelle erstellt, indem ich den , die und den abgeglichen habe.

| Schutzmaßnahme | CNIL | Niederländische DPA (AP) | EDPB-Taskforce | Umsetzungstipps |

|---|---|---|---|---|

| Transparenzhinweis nach Art. 14 | ✅ Erforderlich | ✅ Erforderlich | ✅ Erforderlich | Öffentlichen Hinweis veröffentlichen mit Quellenkategorien, Zwecken, Rechtsgrundlage, Aufbewahrung, Kontaktwegen für Betroffenenrechte und DSB-Kontakt |

| DSFA vor dem Scraping | ✅ Empfohlen (bei hohem Risiko verpflichtend) | ✅ Erforderlich | ✅ Erforderlich | Interessenabwägung, Datenkategorien, Risiken und Gegenmaßnahmen vor dem Start dokumentieren |

| Datenminimierung | ✅ Erforderlich (präzise Erhebungskriterien festlegen) | ✅ Erforderlich | ✅ Erforderlich | Scraper so konfigurieren, dass nur benötigte Felder extrahiert werden; irrelevante Daten sofort löschen |

| Rate Limiting / robots.txt beachten | ✅ Erforderlich (Websites ausschließen, die per robots.txt/CAPTCHA widersprechen) | — | — | robots.txt auslesen, Verzögerungen zwischen Anfragen einbauen, eigenen User-Agent kennzeichnen |

| Pseudonymisierung / Anonymisierung | ⚠️ Empfohlen (unmittelbar nach der Erhebung) | ✅ Nachdrücklich empfohlen | ✅ Empfohlen | IDs hashieren oder randomisieren; Profil-URLs entfernen; Gesichter verpixeln, wenn Identität nicht benötigt wird |

| Aufbewahrungsfrist | ✅ Festgelegte Grenze | ✅ So kurz wie möglich | ✅ Festgelegte Grenze | Löschpläne automatisieren; Rohcache von extrahierten Fakten trennen |

| Opt-out-/Blacklist-Mechanismus | ✅ Empfohlen (discretionary prior objection) | ✅ Erforderlich (Widerspruch nach Art. 21) | ✅ Erforderlich | Opt-out-Formular, Domain-Blacklist, Sperrung auf Personenebene bereitstellen |

| Sensible Quellen ausschließen | ✅ Erforderlich (Gesundheitsforen, Seiten für Minderjährige, Pornoseiten, Genealogie) | ✅ Erforderlich | ✅ Erforderlich | Standard-Blocklisten für Gesundheit, Religion, Politik, Biometrie und Minderjährige pflegen |

Ein praktischer Hinweis von unserer Seite: Mit Thunderbits -Funktion können Nutzer genau festlegen, welche Spalten extrahiert werden — Preis, SKU, Produktname —, sodass der Scraper nur das sammelt, was notwendig ist. Sie laden also nicht pauschal ganze Seiten herunter, sondern wählen strukturierte Felder, die mit Zweckbindung und Datenminimierung vereinbar sind. Trotzdem: Kein Tool macht rechtswidriges Scraping legal. Die rechtliche Prüfung steht immer an erster Stelle.

Ist Web-Scraping in Europa für Ihren Use Case legal? Branchenbezogene Einordnung

Die Frage, die ich in Foren am häufigsten sehe, lautet nicht „ist Scraping legal?“, sondern „ist mein Scraping legal?“. Abstrakte DSGVO-Theorie beantwortet das nicht. Deshalb hier eine Einordnung nach typischen Business-Use-Cases.

| Use Case | Datentyp | Zentrale rechtliche Risiken | Wahrscheinliches Ergebnis |

|---|---|---|---|

| Preisüberwachung im E-Commerce (öffentliche Produktlisten) | Nicht-personenbezogen (Preise, SKUs, Produktnamen) | sui-generis-Recht der Datenbankrichtlinie; Verstoß gegen AGB | In der Regel geringeres Risiko, wenn keine personenbezogenen Daten und keine systematische Extraktion eines „wesentlichen Teils“ der Datenbank erfolgt |

| B2B-Lead-Generierung (Kontaktdaten aus Verzeichnissen) | Personenbezogen (Namen, E-Mails, Telefonnummern) | DSGVO Art. 6 Rechtsgrundlage; Art. 14-Benachrichtigung; ePrivacy für elektronische Kontakte | Höheres Risiko — dokumentierte Interessenabwägung plus Benachrichtigungspflicht erforderlich |

| Immobilienanzeigen (Objektdaten von Portalen) | Gemischt (Adressen können nicht-personenbezogen sein; Eigentümernamen sind personenbezogen) | Datenbankrichtlinie; AGB; DSGVO bei Eigentümerbezug | Mittleres Risiko — Eigentümerdaten anonymisieren, AGB prüfen, robots.txt beachten |

| Trainingsdaten für KI (Scraping großer Webinhalte) | Potenziell personenbezogen, wenn nicht gefiltert | DSGVO + EU AI Act Art. 53 TDM-Pflichten | Hohes Risiko — DSGVO und AI Act müssen beide eingehalten werden; Opt-out-Mechanismen und robuste Filterung erforderlich |

Für risikoärmere Szenarien wie öffentliche E-Commerce-Daten reduzieren Tools mit strukturierten Vorlagen — etwa Thunderbits — das Risiko, weil sie konkrete, nicht-personenbezogene Felder extrahieren, ohne unnötige Inhalte mitzunehmen. Bei risikoreicheren Szenarien mit personenbezogenen Daten, etwa Lead-Generierung, muss die rechtliche Prüfung zuerst kommen. Kein Scraper der Welt macht aus einer nicht-konformen Erhebung eine konforme.

EU vs. USA vs. UK: Wie sich die Gesetze zum Web-Scraping unterscheiden

Wenn Ihr Unternehmen grenzüberschreitend arbeitet, müssen Sie die Unterschiede kennen. Ich habe keinen Wettbewerber-Artikel gefunden, der das als gut scannbare Vergleichstabelle darstellt — also hier ist sie.

| Dimension | EU | USA | UK (nach dem Brexit) |

|---|---|---|---|

| Primärrecht | DSGVO + Datenbankrichtlinie + ePrivacy | CFAA + einzelstaatliche Gesetze (begrenzter föderaler Datenschutz) | UK GDPR + Data Protection Act 2018 |

| Scraping öffentlicher Daten | Für personenbezogene Daten weiterhin DSGVO-Rechtsgrundlage erforderlich | In der Regel legal nach hiQ v. LinkedIn (öffentliche Daten) | Ähnlich wie EU; ICO-Leitlinien gelten |

| Durchsetzung von AGB | Zivilrechtlich; Ryanair v. PR Aviation setzte das sui-generis-Recht durch | Van Buren schränkte CFAA ein; AGB-Verstoß ≠ Straftat | Zivilrechtlich, ähnlich wie EU |

| Datenbankschutz | Sui-generis-Recht (stark) | Kein entsprechendes föderales Recht | Beibehaltenes sui-generis-Recht |

| KI-/TDM-Ausnahme | DSM-Richtlinie Art. 3–4; AI Act Art. 53 | Keine föderale TDM-Ausnahme (Fair-Use-Doktrin) | UK prüft eine TDM-Ausnahme (Stand 2026 festgefahren) |

| Wichtige Aufsichtsbehörde | Nationale Datenschutzbehörden (CNIL, niederländische AP usw.) | FTC + Generalstaatsanwälte der Bundesstaaten | ICO |

| Jüngster Trend | Strenger (niederländische AP: „fast immer illegal“ bei personenbezogenen Daten) | Nach hiQ großzügiger | Moderat; folgt im Allgemeinen der EU-Linie |

Wenn Sie europäische Websites oder Daten über europäische Einwohner scrapen, gelten die EU-Regeln — auch wenn Ihr Unternehmen in den USA oder im Vereinigten Königreich sitzt.

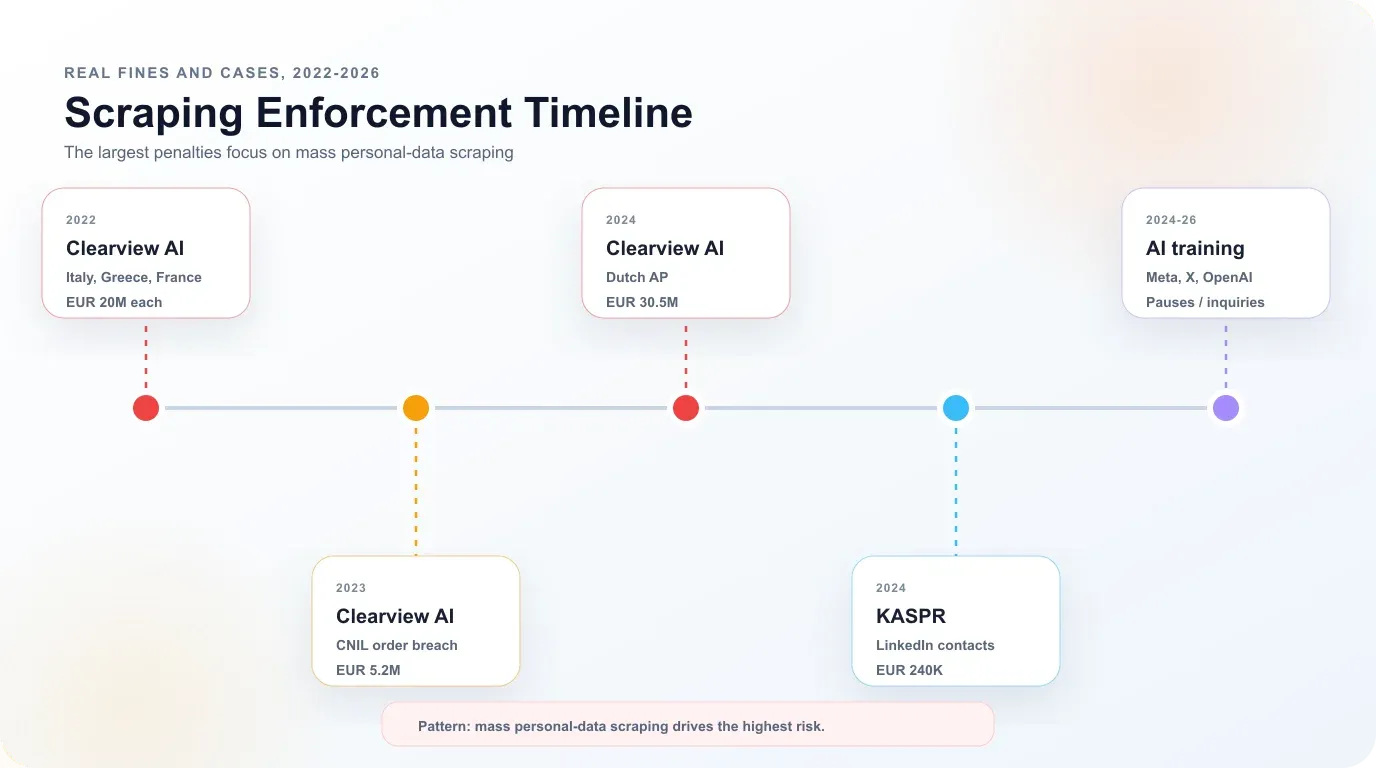

Echte Bußgelder und Fälle: Was passiert tatsächlich, wenn man erwischt wird (2022–2026)

Hier geht es um die Frage hinter der Frage: „Wie hoch ist das echte Risiko?“ Ich habe alle öffentlich bekannten Durchsetzungsmaßnahmen von Datenschutzbehörden zu Web-Scraping oder gescrapten personenbezogenen Daten von 2022 bis April 2026 zusammengetragen.

| Jahr | Behörde | Betroffener | Verstoß | Bußgeld/Ergebnis |

|---|---|---|---|---|

| 2022 | Italienischer Garante | Clearview AI | Scraping von Gesichtsaufnahmen ohne Rechtsgrundlage | 20 Mio. € Bußgeld + Verbot + Löschanordnung |

| 2022 | Hellenische DPA (Griechenland) | Clearview AI | Gleiches — Scraping für Gesichtserkennung | 20 Mio. € Bußgeld + Verbot + Löschung |

| 2022 | CNIL (Frankreich) | Clearview AI | Datenbank für Gesichtserkennung | 20 Mio. € Bußgeld + mögliches Zwangsgeld von 100.000 €/Tag |

| 2023 | CNIL (Frankreich) | Clearview AI | Nichtbefolgung der Anordnung von 2022 | 5,2 Mio. € Zwangsgeld |

| 2023 | Österreichische DSB | Clearview AI | Mehr als 30 Mrd. Gesichtsaufnahmen aus dem öffentlichen Web | Löschung + Anordnung eines EU-Vertreters (kein veröffentlichtes Bußgeld) |

| 2024 | Niederländische AP | Clearview AI | Illegale Erhebung von Daten für Gesichtserkennung | 30,5 Mio. € Bußgeld + Anordnungen zur Einhaltung |

| 2024 | CNIL (Frankreich) | KASPR | Scraping von LinkedIn-Kontaktdaten für Lead-Gen | 240.000 € Bußgeld — 160 Mio. Kontakte, Daten mit eingeschränkter Sichtbarkeit, 5 Jahre Aufbewahrung |

| 2024 | Irish DPC | X / Grok | Öffentliche Posts für KI-Training genutzt | Aussetzungsvereinbarung; förmliche Untersuchung 2025 eingeleitet |

| 2024 | Irish DPC | Meta | Geplantes LLM-Training auf öffentlichen Facebook-/Instagram-Inhalten | Meta pausierte seine EU-KI-Trainingspläne |

| 2024 | Italienischer Garante | OpenAI | Trainingsdaten von ChatGPT + Transparenz | 15 Mio. € Bußgeld verhängt, im März 2026 vom Romer Gericht aufgehoben |

Die gesamten Geldbußen in der EU/EWR-Kategorie Scraping/Open-Web: über 95 Mio. € (ohne das aufgehobene OpenAI-Bußgeld).

Jede dieser großen Sanktionen betraf massives Scraping biometrischer oder personenbezogener Daten ohne Rechtsgrundlage. Clearview scrapte Milliarden von Gesichtsaufnahmen. KASPR scrapte 160 Millionen Kontakte, darunter Daten aus LinkedIn-Profilen mit eingeschränkter Sichtbarkeit, und speicherte sie fünf Jahre lang.

Verhältnismäßiges, zielgerichtetes Scraping öffentlicher, nicht-personenbezogener Daten — etwa Produktpreise oder SKU-Nummern — war bislang nicht Gegenstand solcher Maßnahmen. Das heißt nicht, dass es risikofrei ist, aber es hilft, die Zahlen richtig einzuordnen.

So scrapen Sie europäische Websites sicher: eine Schritt-für-Schritt-Anleitung

- Schwierigkeitsgrad: Anfänger

- Benötigte Zeit: ca. 15 Minuten (inklusive Compliance-Check)

- Was Sie brauchen: Chrome-Browser, (kostenlose Stufe reicht), eine Ziel-URL und einen kurzen Check der obigen Liste

Schritt 1: Zweck und Datenbedarf definieren

Bevor Sie irgendein Tool öffnen, schreiben Sie auf, warum Sie die Daten brauchen und welche Felder Sie genau benötigen. Das ist nicht nur gute Praxis — es ist die Grundlage der DSGVO-Prinzipien Zweckbindung und Datenminimierung.

Beispiel: „Ich brauche Produktnamen, Preise und Lagerstatus von 50 Amazon-Produktseiten, um unsere Wettbewerbs-Preistabelle zu aktualisieren.“ Das ist konkret. Im Vergleich dazu: „Ich will alles von Amazon scrapen.“ Der erste Fall besteht den Minimierungstest, der zweite nicht.

Schritt 2: Die Compliance-Checkliste durchgehen

Gehen Sie die oben stehende sechsstufige „Darf ich das scrapen?“-Checkliste durch. Wenn an irgendeiner Stelle 🛑 steht, stoppen Sie und holen Sie vor dem Fortfahren juristischen Rat ein.

Wenden wir das auf unser Amazon-Preisbeispiel an: Die Daten sind nicht-personenbezogen (Preise, SKUs, Produktnamen) ✅, es gibt kein DSGVO-Problem mit personenbezogenen Daten ✅, die Amazon-AGB müssen geprüft werden (Scraping wird dort eingeschränkt, also wenn möglich offizielle Produktdaten-APIs nutzen) ⚠️, und das Risiko der Datenbankrichtlinie ist bei 50 Produkten gering ✅.

Schritt 3: Den richtigen Scraping-Ansatz wählen

| Methode | Benutzerfreundlichkeit | Compliance-Unterstützung | Wartung | Genauigkeit |

|---|---|---|---|---|

| Manuelles Copy-Paste | Niedrig | Nicht zutreffend (Sie kontrollieren, was Sie kopieren) | Hoch (zeitaufwendig) | Fehleranfällig |

| Code-basiertes Scraper-Tool (Python, Scrapy) | Niedrig (erfordert Programmierung) | Keine integrierte Unterstützung | Hoch (bricht, wenn sich Websites ändern) | Hoch, wenn gepflegt |

| Thunderbit (KI-gestützt) | Sehr hoch | Integrierte Minimierung auf Feldebene | Gering (KI passt sich Seitenänderungen an) | Hoch |

| Offizielle API | Mittel | Am höchsten (strukturierter, freigegebener Zugriff) | Gering | Am höchsten |

Für Business-Anwender ohne Dev-Team ist der schnellste Weg. Für Websites mit offiziellen APIs (wie der Amazon Product Advertising API) ist die API immer die sicherste Variante — allerdings oft mit Einschränkungen bei Datenmenge und Feldern.

Schritt 4: Ihren Scraper auf Compliance konfigurieren

In Thunderbit:

- Öffnen Sie Ihre Zielseite (z. B. eine Produktlistenseite bei Amazon).

- Klicken Sie in der Chrome-Toolbar auf das Thunderbit-Symbol und wählen Sie „AI Suggest Fields“. Die KI scannt die Seite und schlägt Spalten wie „Produktname“, „Preis“, „Bewertung“ und „Lagerstatus“ vor.

- Entfernen Sie alle Felder, die Sie nicht brauchen. Wenn die KI „Verkäufername“ oder „Verkäufer-E-Mail“ vorschlägt und Sie nur Preisdaten benötigen, löschen Sie diese Spalten. Das ist gelebte Datenminimierung.

- Nutzen Sie den Field AI Prompt, um Anweisungen hinzuzufügen wie „personenbezogene Kennungen ausschließen“ oder „nur öffentliche Preisdaten extrahieren“.

- Wählen Sie Cloud Scraping für öffentliche E-Commerce-Seiten (schneller, kein Login nötig) oder Browser Scraping für Seiten, die eine Authentifizierung verlangen.

- Bevor Sie auf „Scrape“ klicken, prüfen Sie, ob robots.txt das Scraping für Ihren Anwendungsfall verbietet. Das können Sie tun, indem Sie

[domain]/robots.txtim Browser aufrufen.

Sie sollten jetzt eine Tabellenvorschau mit genau den Feldern sehen, die Sie konfiguriert haben — keine überflüssigen personenbezogenen Daten, keine unnötigen Metadaten.

Schritt 5: Daten verantwortungsvoll exportieren, speichern und verwalten

Nach dem Scraping exportieren Sie Ihre Daten in — Thunderbit unterstützt alle diese Ziele mit kostenfreiem Export.

Dann:

- Legen Sie eine Aufbewahrungsfrist fest. Speichern Sie gescrapte Daten nicht unbegrenzt. Wenn Sie wöchentlich Preise überwachen, werden die Rohdaten vom letzten Monat wahrscheinlich nicht mehr gebraucht.

- Wenn personenbezogene Daten erfasst wurden (z. B. für Lead-Generierung), dokumentieren Sie Ihre Rechtsgrundlage, veröffentlichen Sie einen Transparenzhinweis nach Artikel 14 und richten Sie einen Prozess für Opt-out- und Löschersuchen ein.

- Automatisieren Sie Löschpläne, wo immer möglich. Thunderbits kann wiederkehrende Scrapes in festgelegten Intervallen automatisieren und dabei dieselbe Feldebene-Konfiguration beibehalten, sodass jeder Lauf innerhalb Ihrer Compliance-Vorgaben bleibt.

Tipps, um beim Scraping in Europa compliant zu bleiben

Einige Praktiken, die ich bei der Recherche und im Gespräch mit compliance-orientierten Teams mitgenommen habe:

- Prüfen Sie immer die AGB, bevor Sie eine neue Website scrapen. Das kostet zwei Minuten und kann Ihnen Monate an juristischem Ärger ersparen.

- Nutzen Sie APIs, wenn sie verfügbar sind. Sie sind strukturiert, offiziell freigegeben und der sicherste Weg. Scraping sollte die Alternative sein, nicht der Standard.

- Führen Sie für jedes Projekt mit personenbezogenen Daten in großem Umfang eine DSFA durch. CNIL sagt, dass KI-Trainingsdatensätze ein hohes Risiko erzeugen können, und die DSFA ist Ihr Nachweis der Rechenschaftspflicht. Auch bei kleineren Projekten ist es klug, die Analyse zu dokumentieren.

- Führen Sie ein Scraping-Log. Halten Sie fest, was wann und von wo gescraped wurde, auf welcher Rechtsgrundlage und mit welcher Aufbewahrungsfrist. Wenn eine Datenschutzbehörde nachfragt, werden Sie froh sein, es zu haben.

- Behalten Sie regulatorische Updates im Blick. Die Leitlinien entwickeln sich schnell — CNIL veröffentlichte im Januar 2026 neue KI-Scraping-Merkblätter, und weitere Stellungnahmen des EDPB werden erwartet. Was heute gilt, kann morgen schärfer werden.

- Scrapen Sie nicht aus eingeschränkten oder sensiblen Quellen. CNILs umfasst Gesundheitsforen, Seiten, die hauptsächlich von Minderjährigen genutzt werden, Pornoseiten, Genealogie-Seiten und hoch strukturierte personenbezogene Datenseiten. Wenn Sie ein Scraping-Projekt aufsetzen, pflegen Sie eine Standard-Blockliste.

- Automatisierter Traffic ist operativ ein großes Thema. , dass Bots 2024 42 % des gesamten Web-Traffics ausmachten, und , dass automatisierter Bot-Traffic erstmals den menschlichen Traffic überstieg und 2024 51 % erreichte. Regulierer werten Bot-Verhalten, Anfragerate und Umgehungsversuche zunehmend als Hinweise auf Risiko und Unfairness. Sich wie ein verantwortungsvoller Scraper zu verhalten — den User-Agent zu identifizieren, Raten zu begrenzen, Ablehnungssignale zu respektieren — ist nicht nur höflich, sondern rechtlich relevant.

Fazit

Web-Scraping ist in Europa nicht illegal. Es ist aber reguliert — besonders dann, wenn personenbezogene Daten im Spiel sind.

Das rechtliche Ergebnis hängt davon ab, was Sie scrapen (personenbezogen vs. nicht-personenbezogen), wie Sie scrapen (AGB, robots.txt, Rate Limiting, Minimierung auf Feldebene) und warum (dokumentierter Zweck und Rechtsgrundlage). Die Durchsetzungslage ist eindeutig: Massenhaftes, wahlloses Scraping personenbezogener Daten ohne Rechtsgrundlage ist der Bereich, in dem Unternehmen mit Bußgeldern in sieben- oder achtstelliger Höhe konfrontiert werden. Verhältnismäßiges, zielgerichtetes Scraping öffentlicher nicht-personenbezogener Daten — mit Schutzmaßnahmen — fällt in eine ganz andere Risikokategorie.

Das praktische Rahmenwerk:

- Verwenden Sie vor jedem Scraping-Projekt die Entscheidungs-Checkliste.

- Setzen Sie die von den Datenschutzbehörden empfohlenen Schutzmaßnahmen um (Transparenz, Minimierung, Aufbewahrungsgrenzen, Opt-out-Mechanismen).

- Wählen Sie Tools, die Compliance by Design unterstützen. Thunderbits KI-gestützte Feldauswahl, strukturierte Extraktion und machen es einfach, nur die Daten zu scrapen, die Sie brauchen — nicht mehr und nicht weniger.

- Dokumentieren Sie alles. Interessenabwägung, Quellenliste, Aufbewahrungsplan, DSFA. Wenn ein Regulator fragt, ist Ihre Akte Ihre Verteidigung.

Der obligatorische Hinweis: Dieser Artikel dient nur zu Informationszwecken und ist keine Rechtsberatung. Bei Hochrisikoszenarien mit personenbezogenen Daten in großem Maßstab sollten Sie eine qualifizierte Fachanwaltskanzlei für Datenschutzrecht konsultieren. Die Vorschriften entwickeln sich weiter, und die Kosten eines Fehlers sind real.

Möchten Sie selbst konformes, zielgerichtetes Web-Scraping ausprobieren? erlaubt Ihnen, strukturierte Extraktion im kleinen Maßstab zu testen — Felder definieren, nur das Nötige scrapen und mit wenigen Klicks exportieren. Außerdem können Sie unseren für Schritt-für-Schritt-Anleitungen besuchen.

FAQs

1. Ist Web-Scraping in Europa legal, wenn die Daten öffentlich verfügbar sind?

Öffentliche Verfügbarkeit befreit Daten nicht von der DSGVO, wenn es sich um personenbezogene Informationen handelt. Wie die niederländische DPA sagte: „öffentlich bedeutet nicht automatisch Erlaubnis zum Scraping.“ Öffentliche nicht-personenbezogene Daten (Produktpreise, SKUs) sind in der Regel weniger riskant, aber Sie müssen trotzdem die Datenbankrichtlinie und die Nutzungsbedingungen der Website prüfen.

2. Kann ich E-Mails und Telefonnummern von europäischen Websites scrapen?

E-Mails und Telefonnummern sind personenbezogene Daten im Sinne der DSGVO. Sie brauchen eine Rechtsgrundlage — typischerweise ein berechtigtes Interesse mit dokumentierter Interessenabwägung — und Sie müssen die betroffenen Personen nach Artikel 14 informieren. CNIL verhängte 2024 gegen KASPR ein Bußgeld von 240.000 € wegen des Scrapings von LinkedIn-Kontaktdaten ohne ausreichende Transparenz oder Rechtsgrundlage. Das zeigt: Hier wird aktiv durchgesetzt.

3. Wie hoch ist das größte Bußgeld für illegales Web-Scraping in Europa?

Die niederländische AP verhängte 2024 gegen Clearview AI ein Bußgeld von wegen illegaler Erhebung von Gesichtserkennungsdaten aus dem öffentlichen Web. Mehrere andere EU-Datenschutzbehörden belegten Clearview jeweils mit 20 Millionen € Bußgeld. Die gesamten EU-/EWR-Bußgelder im Zusammenhang mit Scraping von 2022 bis 2026 übersteigen 95 Millionen €.

4. Macht die Beachtung von robots.txt Web-Scraping in Europa legal?

Die Beachtung von robots.txt ist eine Best Practice und entspricht , garantiert aber für sich allein keine Rechtmäßigkeit. Sie müssen weiterhin die DSGVO einhalten, wenn personenbezogene Daten betroffen sind, ebenso die Datenbankrichtlinie und die Nutzungsbedingungen der Website. Verstehen Sie robots.txt-Compliance als eine Ebene in einem mehrschichtigen Compliance-Rahmen.

5. Wie unterscheidet sich das Web-Scraping-Recht in Europa von dem in den USA?

Die EU ist deutlich strenger. Die DSGVO gilt für alle personenbezogenen Daten — auch öffentlich verfügbare —, und die Datenbankrichtlinie bietet starken Schutz für organisierte Datensätze. Die USA haben keine föderale Entsprechung zu beiden Gesetzen; nach hiQ v. LinkedIn ist das Scraping öffentlicher Daten dort grundsätzlich zulässig. Das Vereinigte Königreich liegt nach dem Brexit dazwischen: UK GDPR und fortgeltende Datenbankrechte spiegeln die EU-Regeln weitgehend wider, allerdings mit ICO-Durchsetzung. Für grenzüberschreitende Unternehmen setzt die EU die höchste Messlatte — und wenn Sie Daten über EU-Bürger scrapen, gelten diese Regeln unabhängig davon, wo Ihr Unternehmen sitzt.

Mehr erfahren