Daten von Websites zu extrahieren klingt einfach – bis du zum zehnten Mal auf den „Weiter“-Button klickst und merkst, dass du nur an der Oberfläche kratzt. Wer schon einmal versucht hat, einen Produktkatalog aufzubauen, eine Lead-Liste zu erstellen oder Immobilienangebote zu analysieren, weiß: Das eigentliche Gold steckt oft auf Seite zwei, drei oder fünfzig. Das habe ich selbst erlebt: Geschäftskritische Daten verteilen sich fast immer über mehrere Seiten, und wer diese Zusatzseiten übersieht, verpasst wertvolle Erkenntnisse – und manchmal auch die Zustimmung des Chefs.

Die gute Nachricht? Du musst dich weder mit unvollständigen Datensätzen zufriedengeben noch deinen Nachmittag mit endlosem Klicken und Kopieren verbringen. Web-Scraper-Pagination – besonders mit KI-Tools wie – ermöglicht es dir, wirklich jede Zeile zu erfassen, ganz egal, wie tief die Daten versteckt sind. Schauen wir uns an, was Web-Scraper-Pagination ist, warum sie wichtig ist und wie du mit Thunderbit die Extraktion über mehrere Seiten ganz entspannt automatisierst.

Was ist Web-Scraper-Pagination und warum ist sie wichtig?

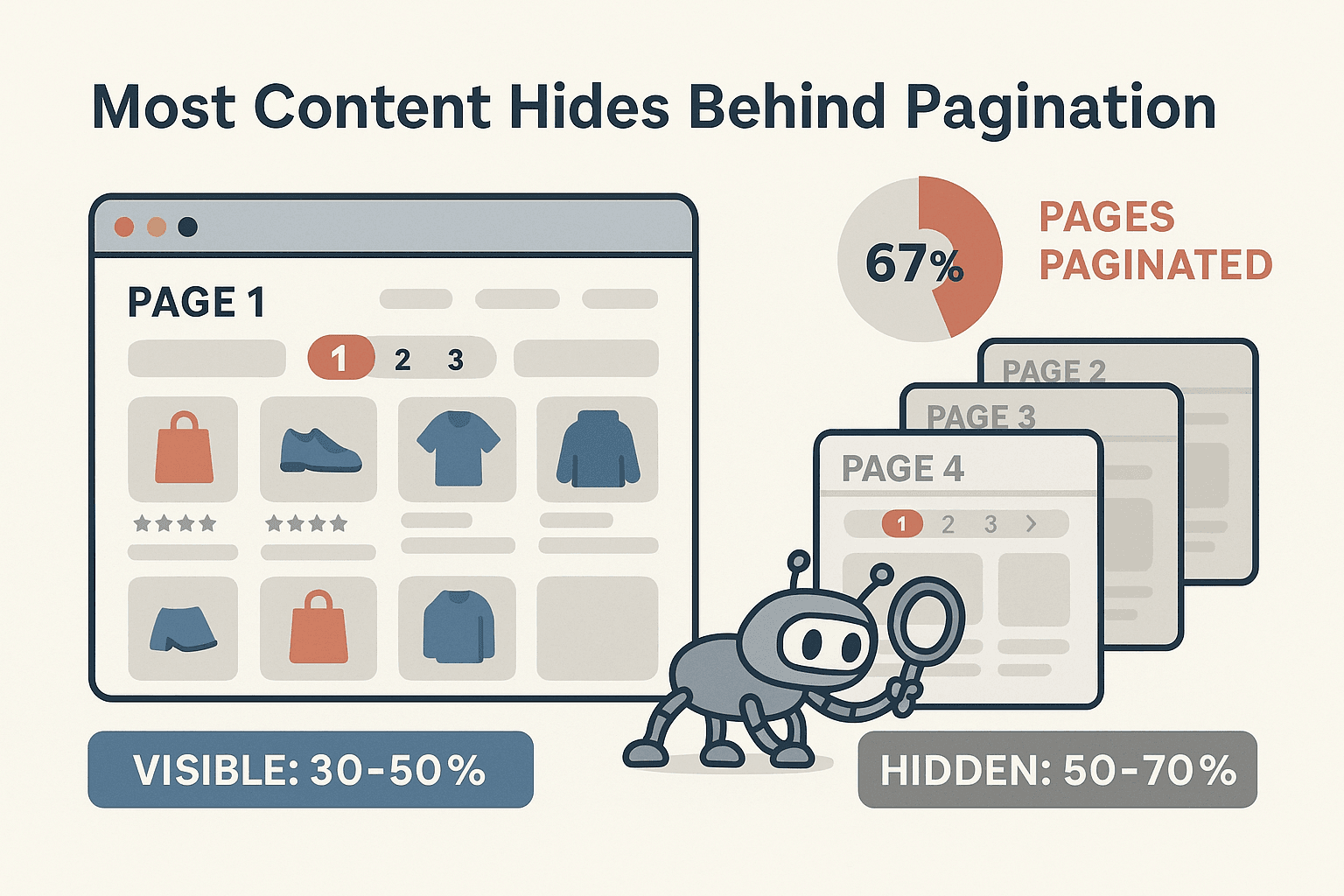

Web-Scraper-Pagination bezeichnet das Extrahieren von Daten von Websites, die ihre Inhalte auf mehrere Seiten aufteilen. Denk an E-Commerce-Seiten wie Amazon, Immobilienportale wie Zillow oder Branchenverzeichnisse – solche Seiten paginieren ihre Einträge aus Performance- und Usability-Gründen und zeigen pro Seite nur einen Teil der Ergebnisse (). Für die Datenerfassung bedeutet das: Dein Scraper muss die Seiten automatisch „weiterblättern“, genau wie ein Mensch.

Warum ist das so wichtig? Weil der Großteil wertvoller Daten oft jenseits der ersten Seite liegt. Tatsächlich können paginiert sein, und Untersuchungen zu führenden E-Commerce-Seiten zeigen, dass 30–50 % des Produktinhalts auf Folgeseiten verborgen sind. Wenn dein Scraper nur die erste Seite erfasst, lässt du den Großteil der Daten – und damit Chancen – einfach liegen.

Das Übersehen paginierter Daten kann echte geschäftliche Folgen haben. Stell dir vor, du führst eine Preisanalyse durch und vergleichst nur die ersten 20 Produkte – oder du erstellst eine Liste mit Vertriebsleads und übersiehst den Großteil der potenziellen Kontakte. Das ist nicht nur unvollständig, sondern riskant. Web-Scraper-Pagination stellt sicher, dass du alle Informationen erfasst, die du brauchst – ohne nervtötende manuelle Arbeit.

Gängige Pagination-Typen und ihre Herausforderungen beim Web Scraping

Nicht jede Pagination ist gleich. Websites nutzen verschiedene Methoden, um Inhalte aufzuteilen, und jede bringt eigene Herausforderungen für Scraper mit sich:

Pagination per „Weiter“-Button

Das ist der Klassiker: Ein „Weiter“-Button (oder „>“) am Seitenende führt dich Schritt für Schritt durch die Ergebnisse. Man findet das überall – Amazon, LinkedIn, Yelp, überall. Für Scraper besteht die Herausforderung darin, das wiederholte Klicken auf „Weiter“ zu automatisieren und zu erkennen, wann Schluss ist. Verpasst du den Button, verpasst du auch die Daten.

Pagination mit Seitennummern

Manche Seiten zeigen eine Reihe von Seitennummern – „1 2 3 … 10 Weiter“ – sodass du direkt zu einer beliebigen Seite springen kannst. Das wirkt zwar simpel, kann Scraper aber aus dem Tritt bringen, wenn sich die Links dynamisch ändern oder der „Weiter“-Button ab einer bestimmten Seite verschwindet. Das Risiko: Seiten werden übersprungen oder Daten doppelt erfasst.

Endloses Scrollen und „Mehr laden“-Buttons

Moderne Websites setzen gern auf Endlos-Scrollen: Beim Herunterscrollen werden automatisch weitere Inhalte nachgeladen. Oder du siehst einen „Mehr laden“-Button, der zusätzliche Ergebnisse an die aktuelle Seite anhängt. Für klassische Scraper sind diese Varianten besonders knifflig, weil die Daten dynamisch per JavaScript geladen werden. Wenn dein Tool Scrollen oder Klicken nicht simulieren kann, bekommst du nur den ersten Ergebnisschub ().

Der manuelle Schmerz

Diese Pagination-Arten per Hand zu bewältigen ist ein Rezept für Sehnenscheidenentzündung und Datenfehler. Stell dir vor, du klickst 50-mal auf „Weiter“, kopierst die Ergebnisse jeder Seite und versuchst dabei, nicht den Überblick zu verlieren. Das ist nicht nur mühsam – es ist auch der sicherste Weg, etwas Wichtiges zu übersehen.

Wie Thunderbits KI Web-Scraper-Pagination handhabt

Hier kommt ins Spiel und verändert für Business-User das Spiel. Statt Loops zu konfigurieren oder eigene Skripte zu schreiben, erkennt und navigiert Thunderbits KI die Pagination automatisch – egal ob „Weiter“-Buttons, Seitennummern, endloses Scrollen oder „Mehr laden“ ().

KI-gestützte Erkennung und Navigation

Thunderbits KI liest die Webseite so, wie es ein Mensch tun würde. Sie findet Pagination-Elemente – ganz gleich, wie sie beschriftet oder gestaltet sind – und interagiert programmgesteuert damit. Nutzt die Seite einen „Weiter“-Button, klickt Thunderbit so lange, bis keine weiteren Seiten mehr vorhanden sind. Bei endlosem Scrollen scrollt Thunderbit weiter, bis alle Inhalte geladen sind. Das bedeutet: Du bekommst jedes Mal einen vollständigen Datensatz, ohne den Prozess überwachen oder Einstellungen nachjustieren zu müssen.

Besonders stark ist Thunderbits Anpassungsfähigkeit. Ändert eine Website ihr Pagination-Layout oder ersetzt das Wort „Weiter“ durch ein Pfeilsymbol, erkennt die KI das sofort. Das ist ein riesiger Vorteil gegenüber klassischen, regelbasierten Scrapern, die bei Änderungen schnell ausfallen.

Einrichtung per natürlicher Sprache für die Pagination-Extraktion

Du musst kein Technikprofi sein, um Thunderbit zu nutzen. Beschreibe einfach in normalem Deutsch, was du brauchst – „Alle Produkte aus dieser Kategorie extrahieren, inklusive Name, Preis und Bewertung“ – und Thunderbits KI richtet den Scraper inklusive Pagination automatisch ein. Die Funktion „KI-Felder vorschlagen“ scannt die Seite, schlägt die passenden Spalten vor und legt die Logik für die Pagination im Hintergrund an. Kein Code, kein manuelles Mapping, kein Stress.

Schritt-für-Schritt-Anleitung: Thunderbit für Web-Scraper-Pagination verwenden

Gehen wir gemeinsam durch, wie du mit Thunderbit Daten von einer paginierten Website extrahierst – etwa Amazon oder Zillow. Ich zeige dir, wie leicht es ist, von „Ich brauche all diese Daten“ zu „Hier ist meine vollständige Tabelle“ zu kommen.

Schritt 1: Thunderbit installieren und starten

Lade zuerst die herunter. Klicke auf „Zu Chrome hinzufügen“, erstelle ein kostenloses Konto und pinne die Erweiterung an deine Symbolleiste. In weniger als zwei Minuten bist du startklar.

Schritt 2: Zur Zielwebsite navigieren

Öffne deinen Browser und rufe die Website auf, die du scrapen möchtest. In diesem Beispiel nehmen wir eine Amazon-Suchergebnisseite für „Gaming-Laptops“. Falls die Seite einen Login erfordert (wie LinkedIn), melde dich zuerst an, damit Thunderbit auf die Inhalte zugreifen kann.

Schritt 3: Mit „KI-Felder vorschlagen“ die Extraktion einrichten

Klicke auf das Thunderbit-Erweiterungssymbol. In der Seitenleiste wählst du „KI-Felder vorschlagen“. Thunderbit scannt die Seite und schlägt Spalten wie Produktname, Preis, Bewertung und Produkt-URL vor. Du kannst Felder bei Bedarf bearbeiten, hinzufügen oder entfernen. Die KI erkennt außerdem, dass du eine paginierte Liste vor dir hast, und bereitet das Crawling aller Seiten vor – ohne zusätzliche Einrichtung.

Schritt 4: Scraping starten und den Fortschritt beobachten

Klicke auf „Scrapen“, um die Extraktion zu starten. Thunderbit sammelt die Daten von der aktuellen Seite und navigiert dann automatisch durch alle folgenden Seiten – klickt auf „Weiter“, scrollt oder lädt weitere Ergebnisse nach, je nach Bedarf. Du siehst, wie die Datentabelle in Echtzeit wächst. Bei großen Aufgaben kann der Cloud-Modus von Thunderbit bis zu 50 Seiten gleichzeitig verarbeiten und macht den Vorgang dadurch blitzschnell.

Wenn du pausieren, stoppen oder den Ablauf anpassen möchtest, geht das in Thunderbits Oberfläche ganz einfach. Du kannst „KI-Felder vorschlagen“ sogar erneut ausführen, wenn du merkst, dass ein Feld nicht korrekt erfasst wird.

Schritt 5: Strukturierte Daten exportieren

Sobald das Scraping abgeschlossen ist, zeigt Thunderbit deine Ergebnisse in einer Tabelle an. Exportiere die Daten als Excel oder CSV oder sende sie direkt an Google Sheets, Airtable oder Notion. Jede Zeile von jeder Seite – sauber organisiert und bereit für die Analyse.

Praxisbeispiel: Mehrseitige Daten von E-Commerce-Seiten extrahieren

Nehmen wir an, du möchtest alle „Gaming-Laptops“ auf Amazon analysieren. Normalerweise müsstest du Seite für Seite kopieren und einfügen – eine Geduldsprobe (und eine Belastung für die Hände). Mit Thunderbit gehst du so vor:

- Öffne die Amazon-Suchergebnisse für „Gaming-Laptops“.

- Klicke auf Thunderbit, nutze „KI-Felder vorschlagen“ und starte „Scrapen“.

- Thunderbit navigiert durch alle 20+ Seiten und sammelt Produktnamen, Preise, Bewertungen und mehr.

- Exportiere die Daten nach Excel.

Das Ergebnis? Eine Tabelle mit Hunderten von Produkten, nicht nur den ersten 20. Du kannst nach Preis sortieren, nach Bewertung filtern oder deine eigene Analyse durchführen – mit der Sicherheit, nichts übersehen zu haben.

So könnte ein Ausschnitt deiner Daten aussehen:

| Produktname | Preis | Bewertung | Anzahl der Bewertungen |

|---|---|---|---|

| Acer Nitro 5 Gaming Laptop | 799,99 $ | 4,5 | 1.234 |

| ASUS TUF Gaming F15 | 1.099,00 $ | 4,6 | 567 |

| HP Pavilion Gaming Laptop | 699,99 $ | 4,3 | 845 |

| ...und Hunderte weitere Zeilen... | ... | ... | ... |

Das Gleiche funktioniert mit Zillow, Shopify, LinkedIn oder jeder anderen Website mit Pagination.

Thunderbit im Vergleich zu anderen Tools für Web-Scraper-Pagination

Wie schlägt sich Thunderbit im Vergleich zu anderen bekannten Tools wie Octoparse und ParseHub? Schauen wir uns das an:

| Tool | Einrichtung der Pagination | Benutzerfreundlichkeit | KI-Funktionen | Datenqualität & Vollständigkeit | Wichtige Einschränkungen |

|---|---|---|---|---|---|

| Thunderbit | Automatisch (KI erkennt und navigiert) | Sehr einfach (Einrichtung mit 2 Klicks) | Ja (Felderkennung, natürliche Sprache, passt sich Änderungen an) | Hoch (kommt mit dynamischen, sich ändernden Websites zurecht) | Neueres Tool; manche fortgeschrittenen KI-Prompts brauchen Einarbeitung |

| Octoparse | Manuell (Nutzer richtet eine Schleife ein) | Mittel (visuelle Oberfläche) | Nein (nur musterbasierend) | Gut (wenn korrekt konfiguriert) | Manuelle Einrichtung für Pagination; kann bei Website-Änderungen brechen |

| ParseHub | Manuell (Nutzer fügt einen „nächste Seite“-Schritt hinzu) | Mittel (visuelle Oberfläche) | Nein | Gut (wenn korrekt konfiguriert) | Kann Daten verpassen, wenn nicht richtig eingerichtet; langsamer bei großen Aufgaben |

Thunderbits größter Vorteil ist die KI-gestützte Automatisierung. Du musst keine Loops oder Selektoren manuell konfigurieren. Die KI passt sich an Website-Änderungen an, reduziert Wartungsaufwand und senkt das Risiko, Daten zu verpassen. Octoparse und ParseHub sind leistungsstark, erfordern aber mehr Handarbeit – vor allem bei Pagination ().

Tipps, um mit Web-Scraper-Pagination effizienter zu arbeiten

Möchtest du das Maximum aus deinen Projekten mit paginiertem Scraping herausholen? Hier sind einige Tipps:

- Immer auf Pagination achten: Stelle sicher, dass dein Tool „Weiter“-Buttons, Seitennummern oder endloses Scrollen verfolgt. Bei Thunderbit passiert das automatisch, trotzdem solltest du es mit einem kurzen Test prüfen.

- KI-Feld-Prompts nutzen: Thunderbit erlaubt dir, benutzerdefinierte Anweisungen für Felder zu hinterlegen – etwa „nur die Stadt aus der Adresse extrahieren“. So bleiben deine Daten über alle Seiten hinweg sauber und konsistent.

- Große Datensätze einplanen: Wenn du Hunderte Seiten scrapen willst, teile den Auftrag in Abschnitte auf oder nutze den Cloud-Modus für mehr Tempo.

- Auf Anti-Scraping-Maßnahmen achten: Manche Seiten blockieren schnelle Anfragen. Der Browser-Modus von Thunderbit kann hier helfen, und bei Bedarf kannst du das Scraping verlangsamen.

- Wiederkehrende Scrapes planen: Wenn du regelmäßig frische Daten brauchst, nutze Thunderbits Zeitplanfunktion („jeden Montag um 9 Uhr“), um den Prozess zu automatisieren.

- Die letzte Seite prüfen: Kontrolliere nach dem Scraping, ob du auch die Daten der letzten Seite erfasst hast – vergleiche dazu die letzte Zeile deiner Tabelle mit dem letzten Eintrag auf der Website.

- Gut organisiert bleiben: Verwende klare Dateinamen und behalte den Überblick über deine Exporte, besonders bei großen oder wiederkehrenden Projekten.

Fazit und wichtigste Erkenntnisse

Web-Scraper-Pagination ist der Schlüssel, um vollständige, verwertbare Datensätze aus dem Web zu gewinnen. Da so viele geschäftskritische Daten jenseits der ersten Seite liegen – teils bis zu 70 % – kannst du Pagination nicht ignorieren. Manuelle Extraktion ist langsam, fehleranfällig und unvollständig; KI-gestützte Tools wie Thunderbit machen sie schnell, präzise und für alle zugänglich.

Das solltest du dir merken:

- Pagination ist überall: E-Commerce, Immobilien, Verzeichnisse und mehr.

- Thunderbits KI erledigt alles: „Weiter“-Buttons, Seitennummern, endloses Scrollen und „Mehr laden“ – keine manuelle Einrichtung nötig.

- Du erhältst jedes Mal vollständige Daten: Keine fehlenden Seiten und keine unvollständigen Datensätze mehr.

- Es ist für alle einfach: Einrichtung in natürlicher Sprache, KI-Vorschläge für Felder und Export nach Excel, Google Sheets, Airtable oder Notion.

- Die Produktivität steigt stark: Unternehmen, die KI-gestütztes Web-Scraping einsetzen, berichten von 30–40 % Zeitersparnis bei der Datenerfassung ().

Bereit, das manuelle Weiterklicken hinter dir zu lassen? und erlebe, wie einfach Web-Scraper-Pagination sein kann. Für mehr Tipps und tiefere Einblicke schau im vorbei.

FAQs

1. Was ist Web-Scraper-Pagination?

Web-Scraper-Pagination ist das Extrahieren von Daten von Websites, die Inhalte auf mehrere Seiten aufteilen. So stellst du sicher, dass du alle verfügbaren Daten erfasst – nicht nur die der ersten Seite.

2. Warum ist Pagination-Unterstützung für die Datenerfassung wichtig?

Weil die meisten geschäftskritischen Daten – etwa Produktlisten oder Kontaktverzeichnisse – sich über mehrere Seiten erstrecken. Ohne Pagination-Unterstützung riskierst du, 30–70 % der Daten zu verpassen.

3. Wie handhabt Thunderbit verschiedene Pagination-Typen?

Thunderbits KI erkennt und navigiert automatisch „Weiter“-Buttons, Seitennummern, endloses Scrollen und „Mehr laden“-Buttons. Manuelle Einrichtung oder Programmierung ist nicht erforderlich.

4. Kann ich Thunderbit nutzen, um Daten von Seiten wie Amazon oder Zillow zu scrapen?

Auf jeden Fall. Thunderbit ist dafür gemacht, bekannte E-Commerce-, Immobilien- und Verzeichnisseiten zu verarbeiten, Daten über alle Seiten hinweg zu erfassen und sie nach Excel, Google Sheets, Airtable oder Notion zu exportieren.

5. Was macht Thunderbit bei Pagination besser als andere Web-Scraping-Tools?

Thunderbit nutzt KI, um die Pagination automatisch zu handhaben, passt sich Website-Änderungen an und benötigt keine manuelle Konfiguration. Es ist schneller, genauer und einfacher zu bedienen als klassische Tools wie Octoparse oder ParseHub.

Viel Erfolg beim Scrapen – und mögen deine Datensätze immer vollständig sein!

Mehr erfahren